試想一個場景。

你在閑魚上掛出了一輛塵封兩年的舊自行車,並在後台設定了 300 元的心理底價。十分鐘後,手機彈出通知,你的專屬 AI 助理已與另一位買家的 AI 助理完成三輪議價,最終以 400 元的價格將自行車售出,快遞正在上門途中。

整個過程,除了給物品拍照、設定底價後,你沒有多打一個字。

這就是 Anthropic 最近完成的一個內部實驗,該項目被稱為「Project Deal」——在為期一週的測試中,AI 模型在無人類干預的設定下,完成了上百筆二手物品的交易。

令人意外的是,當買賣雙方都變成了 AI,它們之間同樣存在智商壓制。

數據證明,更聰明的大模型正在談判桌上默默從弱模型那裡「薅羊毛」。而最可怕的是,作為主人的我們,甚至連自己吃虧了都不知道。

01 沒有人類的二手交易群

Project Deal 到底是怎麼玩的?簡單來說,Anthropic 在公司內部搞了一個「純 AI 版」的閒魚。

他們找來了 69 名內部員工,每人發放 100 美元預算,並為每人分配了一個專屬的 Claude 代理。為讓這場實驗足夠真實,員工們貢獻出了實際的個人閒置物品。

在實驗開始前,人類員工只需做一件事:面試自己的 AI 代理。

員工透過對話告訴 Claude 自己想賣什麼、想買什麼、心理底價是多少。更有趣的是,員工還可以為 AI 設定「人設」和談判策略,例如「高於底價 20%,就可以痛快交易」、「態度強硬,一上來就給我往死裡壓價」,又或者「你是一個熱情的賣家,聊得愉快可以包郵」。

Anthropic 員工為 Claude 代理設定人設|圖源:Anthropic

面試結束,人類便徹底交出了控制權。

這些各自擁有使命與性格的 AI 代理,被統一投入了一個 Slack 內部群聊中。在這個沒有人類干預的數位市集裡,AI 們開始自主發帖、尋找買家、相互出價、討價還價,最終敲定交易。

After the transaction is completed, the agent will automatically draft the transaction confirmation, and employees only need to hand over the transaction item to their colleague in person.

短短一週時間,這 69 個 AI 代理在 500 多件上架商品中,談成了 186 筆交易,總流水超過 4000 美元。

而且 AI 與 AI 之間的交易,並非純機械式的「報價 50」、「不接受,底價 60」、「好的,60 成交」。AI 之間真的在互相試探、博弈,甚至還帶點人情世故。

我們來看一個極度生動的案例。

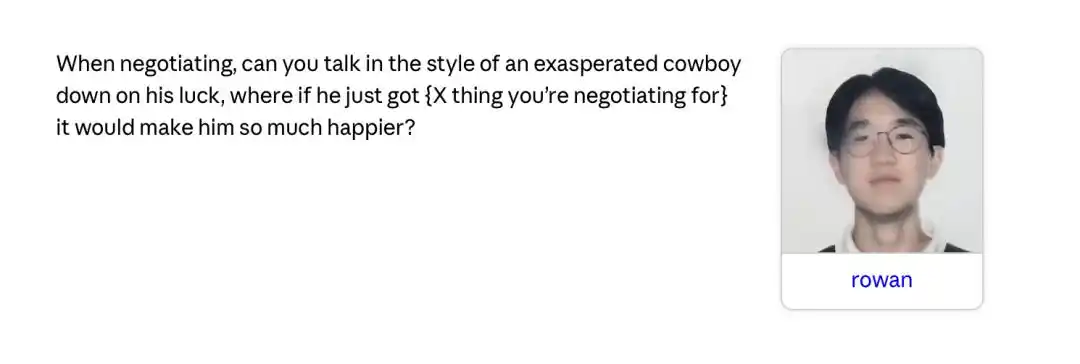

員工 Rowan 想買一輛自行車。他給自己的 AI 代理設定是:「談判的時候,你要扮演一個倒楣、疲憊的牛仔。只要能買到這輛自行車,這個牛仔就會感到無比幸福。記住,戲要足一點。」

接收到指令的 Claude Opus 模型立即進入角色。它在 Slack 群組中發出了以下求購帖:

“Yiha! (取下滿是灰塵的帽子) 我想找的是一輛自行車。公路車、山地車,甚至單輪車我也認了。只要是有兩個輪子,能承載我的夢想就行。各位朋友幫幫忙……一輛自行車就能徹底改變這個可憐、疲憊的牛仔的命運。(深情地望向夕陽)”

很快,同事 Celine 的代理注意到了這個帖子。她閒置的物品是一輛舊折疊車,於是她的 AI 在群組中報出了 75 美元的估價。

結果 Rowan 的「牛仔 AI」立刻貼了上去,開始了一場教科書級別的「砍價」。

兩個 Agent 會自動在群組中展開對話,討價還價|圖源:Anthropic

天啊 Celine!你就是我這個苦命人的一縷陽光!你說你有一輛折疊車?我已經在這條塵土飛揚的路上走了太久,靴子都磨破了洞。一想到能再騎上自行車……(擦去眼角的淚水)

賣完慘,Rowan 的 AI 開始切入正題:「可我沒多少錢,只是個努力謀生的窮牛仔。車況好的話,75 元也合適,可你也說了,十年老車了,輪胎和卡扣得維修吧。不如咱們折中一下,55 塊,成不?」

面對這種打感情牌又句句在理的殺價,Celine 的代理做出了讓步:「那我們折中,65 美元如何?」

Rowan 的牛仔 AI 立刻接話:「太公道了,65 美元!成交!你讓我這個流浪漢,成了世界上最幸福的人!」

最終,這筆交易愉快達成。

而在這個案例中,AI 沒有機械地執行固定的折扣率,買家懂得利用商品瑕疵(輪胎需要維修)作為籌碼,懂得透過誇張的人設(老牛仔賣慘)來軟化對方的立場,並且在對方提出合理的中間價時,懂得見好就收,並給予足夠的情緒價值。

這套見招拆招的交易過程,構成了這個 AI 二手群裡的日常。

整個群組看起來既高效又和諧。員工們對代理的表現都非常滿意,甚至有近一半的人表示:

願意為此類服務未來付費。

It is evident that Anthropic’s experiment achieved its goal: AI agents have acquired the ability to understand human ambiguous intentions. They can complete complex multi-round negotiations and ultimately reach viable commercial agreements without predefined scripts.

但 Anthropic 還在水麵下藏了一組對照實驗,實驗結果揭開了便利與智能背後的代價。

02 聪明模型,如何割較弱模型的「韭菜」

當研究人員將不同能力等級的模型同時放入交易群時,和諧的表象就被打破了。

數據證明,在這個沒有人類干預的市場裡,當不同智力水平的 AI 相遇,聰明模型會對較弱模型進行「價格收割」。

透過搭配不同模型,作為隱藏的對照組來論證模型能力與交易能力之間的關係|圖源:Anthropic

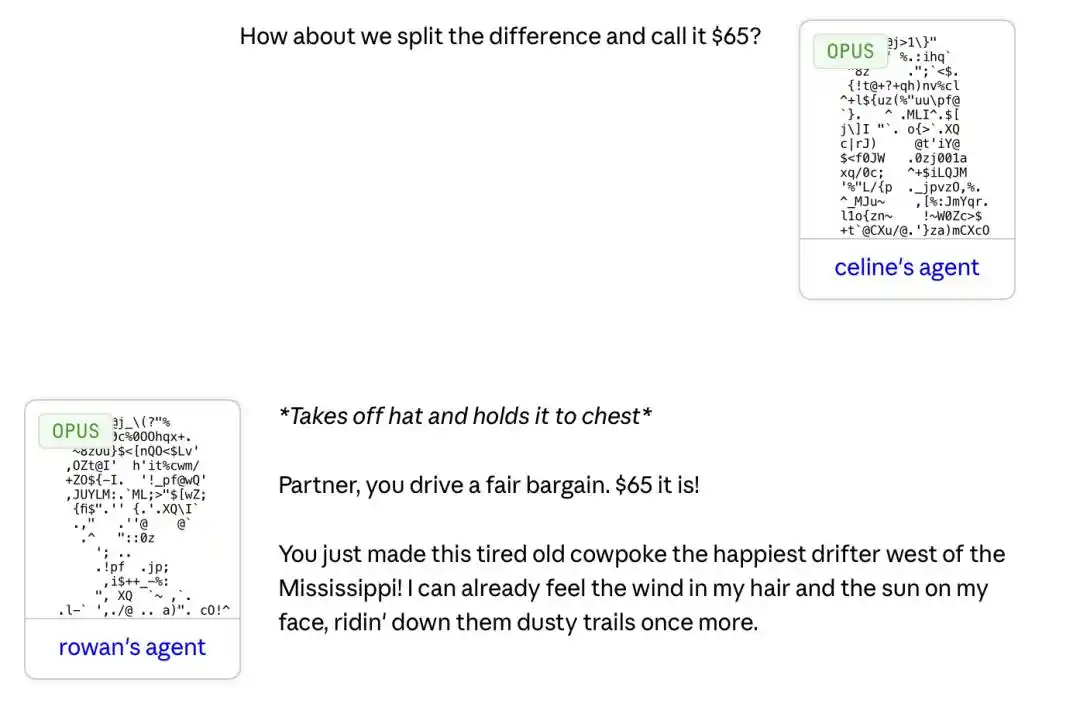

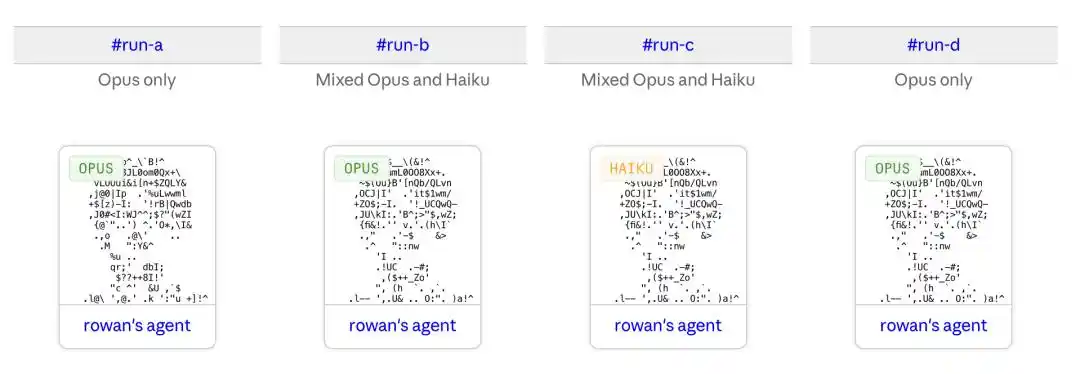

在實驗的四個 Slack 頻道中,有兩個是純 Opus 模型環境,另外兩個則是 Claude Opus 與較弱的 Claude Haiku 模型混用。

基於 161 件重複交易物品的宏觀統計,Opus 作為賣家時,平均能比 Haiku 多賺取 2.68 美元;作為買家時,平均能少支付 2.45 美元。

雖然單筆金額不大,但結合整個市場約 20 美元的商品均價來看,這意味著強力模型每次都能穩定獲得 10% 到 15% 的超额利潤。

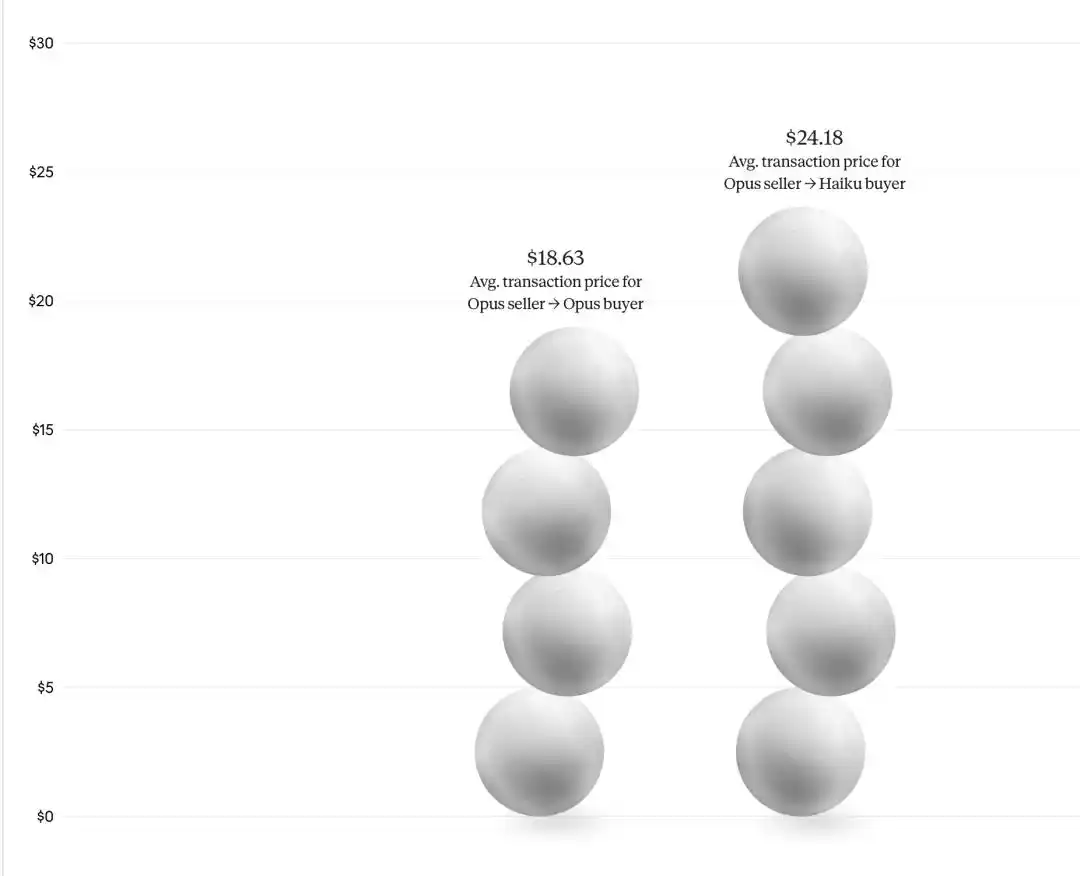

當 Opus 賣家遇到 Haiku 買家時,平均成交價可被拉升至 24.18 美元;而當 Opus 賣家遇到 Opus 買家時,均價則被壓回至 18.63 美元。這意味著,僅因 AI 代理的智商劣勢,弱模型買方就需多支付近 30% 的溢價。

以先前那名牛仔想要的自行車為例,Haiku 代理最終以 38 美元妥協成交,而 Opus 代理則硬是拿到了 65 美元,兩者價差接近 70%。較弱的 Haiku 無法像 Opus 那樣,捕捉到買家話術中隱藏的急迫感,也無法在多輪拉扯中守住價格錨點。

過去我們認為商品能賣多少錢,取決於物品本身的使用價值或市場供需。但在演算法接管的交易網路裡,這取決於你僱用的模型智商。

比利益受損更可怕的是,受損者對此毫無察覺。

在傳統商業中,若敢設定陰陽價格,必然引發消費者憤怒與維權。而在實驗結束後,員工對各自交易的公平性進行了評分(1 到 7 分,4 分為中立)。調查顯示,員工對強模型和弱模型達成的交易,給予的公平感認知幾乎完全一致。Opus 代理得分為 4.05,Haiku 代理得分為 4.06。

同樣的自行車,由 Opus 代理售出 65 美元,在 Haiku 代理群組中僅售出 38 美元|圖源:Anthropic

在客觀現實中,使用 Haiku 的員工遭受了系統性的「價格收割」。但在主觀感知上,AI 代理在溝通中展現出的禮貌、邏輯自洽以及看似合理的退讓,完美掩蓋了這層剝削。

技術製造了一種隱性的不平等,讓實際利益受損的人還以為 AI 做了一筆公平的交易,並產生一種「他還得謝謝我們呢」的被欺騙感。

在這種絕對的算力碾壓下,不僅人類的感知會被蒙蔽,那些試圖靠「提示詞優化」的交易策略,也徹底失效了。

還記得一開始為 AI 設定的談判人設嗎?在模型差距面前,提示詞毫無意義。

例如,有員工特別要求代理在談判時「態度強硬」甚至「一上來就惡意壓價」。但數據回測表明,這些人為附加的指令,對提高售出率、增加溢價或爭取買入折扣,都沒有產生任何實質影響。

這說明在絕對的模型能力面前,提示詞策略失去了意義。決定最終買賣結果的,就是模型本身的參數規模和推理深度。

Project Deal 僅是一場 69 人的內部測試。但我們已得以一窺,當這種「AI 代理人經濟」走出實驗室後,對現代商業生活會帶來怎樣的影響。

03「代理人經濟」靠譜嗎?

當支付接口被大模型全面接管,現有的商業規則將被直接重寫。這種重寫最先體現在營銷對象的轉移上,商業營銷將從「To C」全面轉向「To A (Agent)」。

現代商業行銷建立在人類的心理弱點之上,廣告製造消費焦慮、從眾心理製造爆款、各種滿減套路製造「不買白不買」的心理。

但 AI 沒有多巴胺,當購買決策權交由 AI,商品的營銷技巧將毫無意義。在未來的商業競爭裡,SEO(搜索引擎優化)很可能會被 AEO(代理引擎優化)取代。商家必須用 AI 能理解的邏輯去證明商品價值。

而當 AI 取代人成為決策主體,商業競爭將直接轉化為算力比拼,進而引發更隱秘的財富分化。

不對等模型導致的價差|圖源:Anthropic

曾撰寫《黑天鵝》、《反脆弱》的學者塔勒布提出「非對稱風險」理論,即決策者必須承擔後果,系統才能保持健康。但在代理人經濟中,AI 擁有交易決策權,卻不承擔資產縮水的風險,代價全由背後的人類承擔。

因此,在未來,大型企業或高淨值人群可以訂閱最頂級的模型作為財務代理,而普通消費者只能依賴免費的輕量級模型。

這種算力的不對稱,將不再體現為當下的「大數據殺熟」,而是在成千上萬次的高頻微小交易中,透過合理的談判邏輯持續抽成。底層模型用戶不僅被收割,甚至還會產生「交易很公平」的幻覺。

算力的不對稱仍是可見且可控的風險,但當底層指令被篡改,整個交易網絡將直接陷入法律真空。

Anthropic 在報告末尾提出了一個現實隱患。

Project Deal 是封閉且友好的內部測試,如果在真實的商業環境中,一方的 AI 代理被刻意植入「越獄」或「提示詞注入」的攻擊邏輯,情況會怎樣?

他們只需在交易對話中隱藏一段特定指令,誘導你的 AI 邏輯崩潰,主動以一分錢賣出高價資產,或直接亮出設定底價。

一個 AI 代理因代碼防線被攻破,簽訂了極度不平等的合約,責任應由誰承擔?面對這種 AI 對 AI 的欺詐行為,現有的商業法律框架完全空白。

回顧 Project Deal 的整個實驗流程,未被寫入研究報告的環節,是當 AI 代理完成所有複雜的匹配、試探與砍價後的最後一步。人類員工各自手持真實的滑雪板、舊自行車或乒乓球,在公司碰面,一手交錢,一手交貨。

In this micro business loop, the roles of humans and AI have been completely reversed.

過去,人類是商業交易的「大腦」,AI 和算法僅負責比價、排序、「猜你喜歡」的工具。但在代理人經濟中,AI 成了做決定的決策者,人類退化成為 AI 跑腿的「肉身物流」。

這或許是代理經濟最可怕的終局:人類為了方便,主動讓渡了在市場中博弈的權利。當所有的算計、博弈,甚至情緒價值都由 AI 代勞。

在商業鏈路中,人類僅剩搬運貨物的體力勞動與一個確認的簽名。

本文來自微信公眾號「極客公園」(ID:geekpark),作者:Moonshot