如果 AI 突然說你有罪,並且所有人都盲目相信它的判斷,你應如何自證清白?

這聽起來像是電影《預知犯罪》中預測犯罪然後被嫁禍的情節,但抽象的是,現實中已經上演了一個更潦草的版本:

AI 誤認了罪犯,導致一位無辜的大姐坐牢半年,人生差點歸零。

一、什麼是警方逮捕了「閃電俠」?

美國田納西州的 Angela Lipps 就是這位倒楣的大姐。2025 年 7 月,一隊全副武裝的警察突然闖入她平靜的生活,並用槍指著她,告訴她被逮捕了。

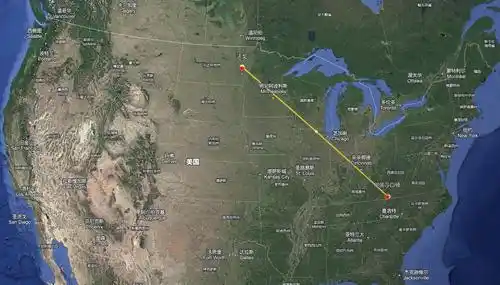

當時她有點懵,畢竟根本不知道自己犯了什麼錯。警方則說她涉嫌參與了北達科他州的一起銀行詐騙案,瞅這架勢像是證據確鑿,並且對面開了5星通緝,但她聽完這個理由卻怔在了原地:

But I’ve never been to that state in my life.

從地圖上看,美國田納西州與北達科他州確實有段距離,而將她與嫌疑人聯繫起來的正是 AI。

警方逮捕她時,自動屏蔽了她的辯解,具體的案件細節直到入獄後才得知。北達科他州法戈市警方在調查一宗詐騙案,嫌疑人偽裝成軍人,從銀行騙取數萬美元,而警方的調查方式是先查監控,再詢問AI,最後抓人。

你可能以為是用 AI 煉化了福爾摩斯,然後化身神探透過嚴密的邏輯推理破案,但其實沒那麼「複雜」。警方使用 AI 系統對監控錄像的截圖進行面部識別,然後在圖庫中篩選嫌疑人。

結果AI這次誤判,錯誤匹配到Angela Lipps的照片。這份情報隨後被轉交給正在辦案的警局,工作人員犯了更大的錯誤,在手動查閱她的駕照和社群媒體後,認為兩者的面部特徵、身材和髮型相似,便斷定她是嫌疑人。

圖片來自 GoFundMe

姐姐聽完後相當崩潰,沒再多查其他線索,萬一撞臉呢?但更崩潰的還在後頭,那就是一套連招下來,她沒機會證明自己的清白。

根據當地的程序,她並未被直接押送至北達科他州接受進一步調查,而是在田納西州的當地監獄等候。由於被認定為「跨州逃犯」,她既無法保釋,也沒有機會接受警方問訊,就這樣莫名其妙地被關押了108天,從7月入獄一直坐牢到10月底,很難想像這段期間她有多絕望。

Angela Lipps 一直熬到 10 月 30 日,終於被警察帶出監獄,準備轉往北達科他州。當時她面臨多項指控,出行期間不僅戴著手銬,腰上還綁著鏈子,在她看來,穿過機場時簡直如同遊街示眾。

這其實是她人生中第一次搭飛機。

她沒想到,到了北達科他州後,仍要繼續等待。直到12月,她才有正式的機會解釋這件事,她的律師直接調取了她的銀行記錄與時間對比,顯示案發時她正在1900公里外的田納西州買披薩,這意味著除非她是「閃電俠」,否則不可能跨時空作案。

The lawyer clarified the matter for her in just 5 minutes.

到 12 月 24 日,她的指控終於被撤銷,但她根本高興不起來,因為此時「斬殺線」已經來到腳踝了。

Angela Lipps 的 50 歲生日都是在監獄裡度過的,入獄期間不允許佩戴假牙,她只能吃垃圾食品,精神壓力巨大,體重暴增。她進監獄時穿的是夏裝,出獄時已是冬天,連件厚外套都沒有,保暖都成問題,更別說回家了。當時警方也沒有提供任何路費,出獄後她等於被困在北達科他州,也困在了被 AI 誣陷的那一天。

不過好在還是有好心人拉了她一把。

Her lawyer arranged for her to stay at a hotel and got her some food to get through the toughest moments; a local nonprofit organization rescued her and sent her back home to Tennessee.

但回家後,重新開始生活的難度也是地獄級的。在監獄這段時間,她的經濟狀況崩潰了,租的房子沒了,家裡的狗子沒了,甚至她的車和車內存放的東西也都沒了。她的個人物品當時被暫存於倉庫,但後來因付不起租金,導致所有生活用品都被清空。甚至人際關係也岌岌可危,因為鄰居都看到她被逮捕並「消失」了半年,以為她真的犯了事。

同時,她這段離譜的經歷很快就在網絡上傳開,引發了大家的瘋狂吐槽。例如,很多人表示無語,在美國一些人可以「0元購」,但只要你動了資本家的銀行,就會被光速逮捕,即使那不是你幹的。

由於事情鬧得太大,她的絕境再次迎來轉機,獲得了更多幫助,目前她已籌集了 8 萬美元的善款,完全足以用來重新開始生活。

但現在網友最大的期待是她能找一個律師天團,然後告他們一個天翻地覆,或許能贏得官司並獲得另一筆賠償。

因為這不是警方的偶然失誤,在此之前已出現批量冤案,有些人經歷比她更慘。

二、AI「失誤」帶來的驚悚科幻時刻

Angela Lipps 的經歷其實已在不同地區上演過十多次,甚至其他國家也發生過。

例如,羅伯特·威廉斯就是這類事件中最早的受害者之一;2020年,警方在他妻子和女兒面前逮捕了他,並拘留了30個小時,然而他比真正的罪犯高了20厘米。

另一位Chris Gatlin也是頂級倒霉蛋,AI根據模糊的監控畫面,將他匹配為地鐵打人案的潛在嫌疑人,隨後就被關押了17個月,成為目前羈押時間最長的無辜人員。離譜的是,直到最後辦案人員才發現還有一部執法記錄儀可作為關鍵證據,但影片中的嫌疑人與他完全不相符。

2023年,Porcha Woodruff 也經歷了同樣的情況,警方指控她涉嫌車輛盜竊。她聽完當場氣笑,以為警方在開玩笑,因為當時她懷孕八個月,外觀完全不具備動手的能力。不過她仍被帶走並關押了十幾個小時,後來她打官司還敗訴了。

今年,英國一名名叫 Alvi Choudhury 的年輕人也因類似情況被捕,被指涉嫌「入室盜竊」,但根據證據顯示,這起案件是「遠程」實施的,這一幕在電影中也曾出現。AI 識別出的是他 2021 年被拘留時的照片,警方看到真人後不禁笑出聲,因為他看起來至少比嫌疑人老了 10 歲。

圖片來自《心靈傳輸者》

2022 年,印度商人 Praveen Kumar 在前往瑞士的途中於阿布扎比轉機時被捕,當時 AI 將他誤認為一名通緝犯。當地對他進行了嚴厲審問,最終確認他並非嫌疑人,遂將其遣返回印度,結果他在印度機場又連續被扣留了兩次。

在這類事件中,最離譜的應屬俄羅斯科學家 Alexander Tsvetkov 的遭遇,AI 說他長得像殺人犯,隨後他被關押了 10 個月。

這位科學家可說是遭遇了AI與人類的雙重誣陷。2023年2月,他結束科研考察返回俄羅斯,剛下飛機就被逮捕。原因是AI顯示,他與二十多年前一樁連環殺人案嫌疑人的畫像有55%的相似度,同時這起案件中還有一位污點證人,為求減刑故意作偽證指認他。要命的是,警方也未仔細調查,就直接抓人了。

被拘押後,他起初以為是小誤會,但調查久久無法結束,在巨大的精神壓力與健康問題影響下,他曾被迫認罪,隨後又翻供。所幸妻子與研究所同事始終為他奔走,蒐集了無數資料證明案發當年他正在外地考察。隨著媒體報導,案件也受到大眾廣泛討論,此事直到12月才出現轉機,指控直至2024年2月才正式撤銷。

而這類案件隨著 AI 的進化變得越來越頻繁,看起來更像是 AI 在「指揮」,而部分人卻變成了執行的機器。

三、「AI 說了算」的職業病

之所以會有「角色互換」的抽象感覺,是因為 AI 和人都會掉鏈子,再強的 AI 也會犯錯,人類更是會隨時「偷懶」。

以美國的 Clearview AI 系統為例,正是它將文章開頭的那位大姐送進了監獄,但它可不是什麼野雞軟件。Clearview AI 聲稱擁有全球最大的圖片數據庫,頂著多國罰款瘋狂抓取數百億張圖片,美國有超過 3000 個執法機構在使用,去年還與 ICE 簽下了一筆 920 萬美元的合約。

但簡單來說,Clearview AI 是一款「人臉搜尋引擎」,使用時只需上傳一張圖片,它會在資料庫中進行匹配,並返回一堆相似圖片,最終是否為你要找的人,仍需自行判斷。

Although AI has made rapid progress over the years, "accuracy" remains controversial, as there are always various differences between experimental test data and real-world image search scenarios.

例如,大多數時候,警方找到的監控圖片畫質像座機拍的,再加上什麼詭異燈光、刁鑽角度、臉上有遮擋等各種因素,識別難度確實不小,圖庫裡也可能是老圖,匹配的結果或許只是碰巧兩個人長得像。

而這些誤差應用到具體的人身上,自然就要遭罪了。

這是烏鴉還是貓?

按理說,如果只是 AI 偶爾犯病,那還有得救,因為這些只是「線索」,後面的「結論」還需要人來把關,但很多時候人比 AI 更「離譜」。

其實幾年前就有人抱怨美國警方被 AI 牽著鼻子走,陷入「自動化偏見心理」,也就是過度依賴甚至過度信任 AI 提供的結果。只要 AI 說這兩個人匹配,人類就信了,身高對不上不是我的問題,雖有不在場證明但我只負責抓人,其他所有證據都去跟監獄說吧,跳過基本調查步驟的同時也讓別人「跳過人生」。

其實人類自己對AI的缺點心知肚明,美國警方在賠償了大量金錢後,許多地區也設立了「防火線」,例如在破案時除了AI線索外,還必須有獨立證據,甚至有些地方直接禁止使用AI技術破案。

但這些限制,抵不住AI實在太好用了。雖然有概率出錯,但顯然成功的次數更多。有時候警方費盡心思找到的線索,往往只是一張「門鎖」級別的監控照片,很大概率就會想用AI試試運氣。早在2023年就有報導稱美國警方使用Clearview AI進行了上百萬次搜索,甚至後來明令禁止後仍偷偷使用,反正用了也可以說沒用過;這個軟件不能用就換另一個,本地被禁就託其他機構幫忙使用,純粹玩上癮了。

因此,一旦 AI 先提供一條不可靠的線索,接著人類偷懶跳過調查,臥龍鳳雛打出組合技,冤案自然就出現了。

像巴西的 Smart Sampa 系統,這兩年也在面對類似的問題。2024 年,巴西聖保羅上線了拉丁美洲最大的 AI 人臉識別警務系統,據稱接入了 4 萬個攝像頭。

好消息是效果確實顯著,幾年來近4000名罪犯當場被捕,並捉回3000多名逃犯,搶劫案在2025年下降了近15%,堪稱「抓賊流水線」。

壞消息是,至少有 59 人被認錯。

當中不乏抽象案例,例如有精神病患者在醫院被當成罪犯帶走,後來發現他的逮捕令已過期,便被釋放。還有一位男士在七個月內被逮捕了四次,AI 將他與一名在逃殺人犯混淆了。每次都是被帶回警局後立即釋放,過幾天又再發生一次,他都已經嚇到麻木了。

以前談到哪些工作不能被 AI 取代時,都說 AI 不能替人坐牢,但我們從未想過這個問題的另一面:它現在能讓人「坐牢」。

這句話放在以前是個段子,但現在看來幾乎已不算新聞了。其實不僅是人臉識別,AI 在物品識別這方面偶爾也能搞出大動作。

去年,美國一所高中的AI安保系統,將一名少年手中的薯片包裝識別為「潛在槍支」,並立即觸發警報。八輛警車迅速趕到,將該少年當場控制,直到在垃圾桶中翻出零食包裝,才確認是誤判,場面極為尷尬,該少年一度以為自己會喪命。

你別說还真別說

誰能想到,AI越強,有些人用它製造的麻煩也越大。以前AI笨拙,看圖認錯,讓全網笑話半天;現在AI變強了,認錯一個人,就能讓人類蹲半年牢。未來別再搞什麼AI審判、AI律師、新能源法庭這類抽象的操作。說到底,AI本身只是一種工具,關鍵還在於使用者的能力與目的;換句話說,AI越強,人越不能偷懶。

總之,開始有點懷念那個笨笨的 AI 了。

本文來自微信公眾號「酷玩實驗室」,作者:酷玩實驗室