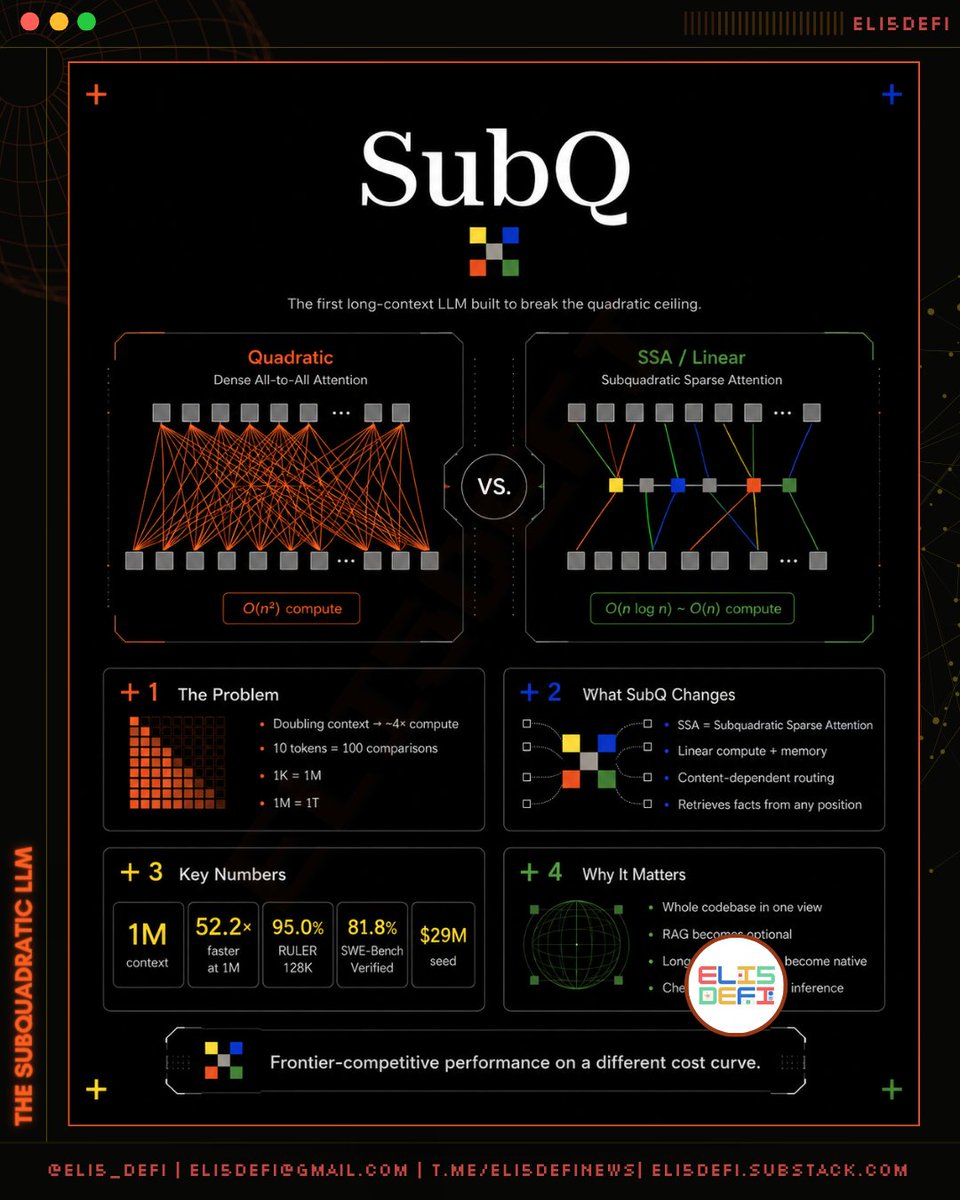

ایک نئی AI کمپنی @subquadratic نے ایک ماڈل جاری کیا ہے جو جدید AI کے سب سے پرانے حدود میں سے ایک کو توڑ دیتا ہے۔ اس کی اہمیت کو سمجھنے کے لیے، آپ کو ایک ایسا ریاضی کا مسئلہ سمجھنا ہوگا جو آپ کے استعمال کیے جانے والے ہر چیٹ بات کو چپکے سے شکل دے رہا ہے۔ — ➠ مسئلہ: AI جوڑوں میں پڑھتی ہے، اور جوڑے قابل توسیع نہیں ہوتے ہر جدید LLM (ChatGPT، Claude، Gemini) متن کو پڑھتے ہوئے ہر لفظ کو دوسرے ہر لفظ سے منسلک کرتا ہے۔ یہ اچھا لگتا ہے، جب تک کہ آپ ریاضی نہیں کرتے: ▸ 10 الفاظ → 100 تقابل ▸ 1,000 الفاظ → 1 ملین تقابل ▸ 1 ملین الفاظ → 1 ٹریلین تقابل ان پٹ کو دگنا کرنا کام کو دگنا نہیں کرتا۔ یہ اسے چار گنا کر دیتا ہے۔ اسے مربع توسیع (quadratic scaling) کہتے ہیں، اور 2017 سے یہ AI میں شامل ہو چکا ہے۔ اس کا آپ کے لیے مطلب: ▸ لمبے دستاویزات جلد مہنگے ہو جاتے ہیں ▸ ماڈلز اکثر لمبے ان پٹس میں گھلے ہوئے حقائق کو نظرانداز کر دیتے ہیں ▸ پورے کوڈ بیسز یا تحقیقی لائبریریز فٹ نہیں ہوتیں اب آپ جانتے ہیں کہ زیادہ لمبا کونٹیکسٹ آپ کے LLMs کو زیادہ بکواس اور مہنگا کیوں بناتا ہے۔ — ➠ آج کی AI مسئلہ کو کس طرح چھپاتی ہے صنعت نے ریاضی کو درست نہ کرکے اس کے لیے حل تلاش کر لیا: ▸ RAG: ایک سرچ انجن صرف کچھ متعلقہ حصّے حاصل کرتا ہے، اور صرف انہیں ماڈل کو دیتا ہے ▸ Chunking: لمبے دستاویزات چھوٹے چھوٹے حصّوں میں تقسیم کر دیے جاتے ہیں ▸ Agent سسٹمز: متعدد AI کالز مختلف حصّوں پر عمل کرتی ہیں، جنہیں کوڈ سے جوڑا جاتا ہے ▸ FlashAttention: ذخیرہ کرنے کے حوصلہ مند طرīقے جو اسی مہنگے ریاضی کو تیز تر چلانے دیتے ہیں یہ سب کام تو کرتے ہیں، لیکن ان میں سے کوئی بھی اصل مسئلہ حل نہیں کرتا۔ جدید AI سٹैک (ویکٹر ڈیٹابیسز، رٹریول پائپ لائنز، پرامپٹ انجینئرنگ) اس لیے وجود رکھتی ہے کہ ماڈلز صرف پورا متن اپنے دائرۂ نظر میں نہیں رکھ سکتے۔ — ➠ SubQ مختلف طرīقہ سے کرتا ہے SubQ SSA (Subquadratic Sparse Attention) نام کا ایک نया طرīقہ استعمال کرتا ہے۔ ایک جملے میں خلاصہ: تمام الفاظ کو تمام دوسرے الفاظ سے تقابل نہیں کرتا، بلکہ ماڈل پتہ لگاتا ہے کہ سوال کے لیے کون سے الفاظ حقیقی طور پر اہم ہیں، اور باقی سب کو نظرانداز کر دेतا ہے۔ اس سے توسیع مربع (quadratic) سے لینئر (linear) میں بدل جاتی ہے۔ ان پٹ کو دگنا کرنا اب صرف کام دگنا کرتا ہے، نکل دینا نہीں۔ مشکل بات صرف خيال نہीں، کیونکہ لوگ پہلے بھی اس طرح کوشش کر چکے ہیں۔ پچھلی تمام کوششوں نے کچھ نقصان برداشت کیا: چاہے درستگی، چاہے لمبائی میں پوشیدہ حقائق تلاش کرنے کا صلاحِت، چاہے خودِ فعالِت۔ Subquadratic، جس کا تعاون @alex_whedon نے کیا، دعوٰى کرتا ہے کہ وہ بالآخر تینوں معاملات اُس وقت حل کر لئے جبکہ پچھلِ تمام لوگ ناکام رہے۔ — ➠ ثبوت تین طرفہ تصدّق شدہ بینچ مارکس: ▸ RULER 128K (لمبایت والي استدلال ٹيسٹ) پر Claude Opus 4.6 سے برابر ▸ MRCR v2 (متعدد ثبوت تلاش) پر Opus 4.7، GPT 5.4، اور Gemini 3.1 Pro سے بڑھتَا ہے، لेकن Opus 4.6 اور GPT 5.5 سے پِچھي رهتا ہے ▸ SWE-Bench (حقīقī كودنگ كام) پر Opus 4.6 اور Gemini 3.1 Pro سे بڑھتا هـيـ، لेकن Opus 4.7 سे پِچھي رهتا هـيـ ▸ 1 ملین ٹوکنز پر FlashAttention سे 52× تَيز ▸ اِسک research ورژن 12 ملین ٹوکنز كھينچتا هـيـ، جس كي توجّه كي حساب كاري باقي سب سامنِي ماڈلز كي تقرِيبًا 1,000× كم هـيـ خلاصه: اس سب سे مراد "دنِيا كا بَهترِين ماڈل" نهِيـن هـيـ۔ اس كي مراد يه هـيـ كه اُس كي بنِياَدِي قيمت كي منحنى كي نسبت فرانٹِير لِيول كي درستگى هـيـ۔ — ➠ سم الٹمن كي جگه كيسي؟ الٹمن كي دو بڑي علنِي دعويين SubQ كي طرف سحل كرنَي والي مسئلَه كي طرف اشاره كرتِي هـين۔ قِيمت كي بات: فبرورى 2025 كي اپنِي بلاگ پوسٹ "Three Observations" ميـن، الٹمن نِكَلَه كه AI استعمال كي قِيمت هر12 ماھ ميـن تقرِيبًا10× كم هوتى هـيـ۔ اُس نِكَلَه "بَهترِين" قانونِ موور سى زِياَدَه قويَت قِيمت كه "انفرينس" كى قِيمت AI كى شكل دينَي والى بنِياَدِي طاقت هـيـ۔ سائز كى بات:2023 تك، الٹمن نِكَلَه كه بڑّى بڑّى ماڈلز كى دور ختم هوتى هـيـ، اور حقِيقى مقابلَه "دولار كى نسبت صلاحِيت" هـيـ۔ اُس نِكَلَه پیرامِيٹر كى مقابلَه كو1990s كى GHz مقابلَه كى طرح بُرايا۔ غلط محور۔ SubQ دونوں باتوں كى طرف قدم رکھتا هـيـ۔ اُس كا شعار "كارآمدِيت = ذكاء" هـيـ۔ مگر: الٹمن كا AI كى قِيمت كم كرنَي كا طريقوً: "آلات ميـن ترقى"، "سافٹ وير آپتيمائزيشن"، "ماڈل ديستيليشن" هـيـ۔ اُس نِكَلَه "توجّه رياضيات" كى بنِياَدِي تغيير كى حمايت نهِيـن كى۔ تو SubQ كا دعوى الٹمن كى معاشيات كى طرف مطابقت رکھتا هـيـ، لेकن يه بھى يقين هـiـ كه بڑّى لابز نِكَلَه "آركيتيكتورل دولار" كو بروئد رکھ ديا هـiـ۔ — ➠ يه زمانيٰ زمانيٰ ؟ اگر SubQ قابلِ استعمال سطح پر عمل آور هوتا هـiـ: ▸ تمام كود بيسز صرف ايك منفرد باتچيت ميـن۔ فائلز كو جُملا رکھنَي والّي متعدد agent سسٹمز كى ضرورت ختم۔ ماڈل پورا ريبوزيتري رکھتا هـiـ۔ ▸ RAG اختيارى بن جاتا هـiـ۔ آج كا زياترتر AI انفرااسٹركتشر صرف مربع حد كو پُراكارنَي والّا هـiـ۔ حد ختم هوتى هـiـ تو سُكّن واقعًا بوجھ بن جاتا هـiـ۔ ▸ لمبى وقت تك جارى agentز صرف "حيله" نهِيـ رहتّين۔ لمبّى وقت تك جارى سيشنز جن ميـن مستقل يادداشت هوتى هـiـ، طبيعي طور پر شامل هوتّين۔ ▸ نئّى ايپس ممكِن بن جاتّين۔ ووه وركلودز جو بُدھ تو زياتر مُحبت تھّين (پورّا دستاويزات كا جائزه، تمام كود سرچ، توافق سكن)، عام عمل بن جاتّين۔ — ➠ صاف صاف تحفظات ▸ يه ذاتى بيٹا ميـن هـiـ۔ حقِيقى دنيا كى قابلِيت كو تجرباتِي طور پر اختبار نهِيـن كيا جا سكا۔ تو تب تك، اعلان كو صرف "تيزر" سمجھين، حتّى بَهت سارّين يه خوف رکھتّين كه يه صرف "پرفارمانس" هـiـ۔ ▸ MRCR v2 سكور (65.9%) اچھا هـiـ لेकن Opus4.6 (78.3%) اور GPT5.5 (74%) سे پِچھي رهتا هـiـ۔ SSA زياتر موثر هـiـ، لेकن بالكُل زياتر صلاحِيت والّا نهِيـن। ▸ بینچماركس خود شائع شدّه نيْ، لेकن تین طرفاء تصدّق شدّه نيْ۔ علمى تكرار حقِيقى اختبار هـiـ۔ ▸12M-ٹوکنز نتيجَه research ماڈل هـiـ، شپنگ پروڈكٹ نهِيـ (جو1M هـiـ)। — ➠ خلاصه نو سال تك، كل transformer-بندي AI نِكَلَه وحشتناك مربع قانون ديا। Subquadratic دعوى كرتا هـiـ كه وهم بالآخر يه طريقوً حل كر ليا۔ بینچماركس يه ظاهر كرتّين كه وهم بالكُل صحّيح راستة پر نيْ। الٹمن تین سال تك صنعت كو بتارها رهيْ هـiـ كه "دولار كى نسبت صلاحِيت" جديد مقابلَه هـiـ۔ SubQ ان بينديون ميـن سे ايكي پहليْ شركت هـiـ جو يه مقابلَه جيتنيْ والّي خود رياضيات كو بدلتى هُويْ حصول حاصل كرنَي كو كوشيش كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى هُويْ حصول حاصل كرتى हुई।

بانٹیں

ذریعہ:اصل دکھائیں۔

اعلان دستبرداری: اس صفحہ پر معلومات تیسرے فریق سے حاصل کی گئی ہوں گی اور یہ ضروری نہیں کہ KuCoin کے خیالات یا خیالات کی عکاسی کرے۔ یہ مواد کسی بھی قسم کی نمائندگی یا وارنٹی کے بغیر صرف عام معلوماتی مقاصد کے لیے فراہم کیا گیا ہے، اور نہ ہی اسے مالی یا سرمایہ کاری کے مشورے کے طور پر سمجھا جائے گا۔ KuCoin کسی غلطی یا کوتاہی کے لیے، یا اس معلومات کے استعمال کے نتیجے میں کسی بھی نتائج کے لیے ذمہ دار نہیں ہوگا۔

ڈیجیٹل اثاثوں میں سرمایہ کاری خطرناک ہو سکتی ہے۔ براہ کرم اپنے مالی حالات کی بنیاد پر کسی پروڈکٹ کے خطرات اور اپنے خطرے کی برداشت کا بغور جائزہ لیں۔ مزید معلومات کے لیے، براہ کرم ہماری استعمال کی شرائط اور خطرے کا انکشاف دیکھیں۔