Model, OpenClaw'un beynidir ve kullanım etkisini doğrudan etkiler.

Yazar: Zhang Haining

Kaynak: Henry Notları

OpenClaw kurulum ve dağıtımı için çeşitli yöntemler denedim: fiziksel sunucular, bulut sunucular, sanal makineler, konteynerler, yerel ve yurt dışı modeller ve ağlar vb. Genel olarak oldukça karmaşık bir süreç ve dikkat edilmesi gereken birçok faktör var. Bu konuda kapsamlı bir makale yazmayı planlıyorum. Bu yazı, ön hikaye olarak, çok önemli bir unsuru ele alacak: model seçimi.

Model, OpenClaw'un beynidir ve kullanım etkisini doğrudan etkiler. Şu anda kabul gören görüş, yurt dışı modellerinin yurt içi modellere göre biraz daha akıllı olmasıdır; ancak yurt dışı modelleri bilimsel internet erişimi gerektirir, maliyeti yüksektir ve yurt dışı ödeme yöntemleri gerekir, hafif bir hata bile hesap kapatılmasına neden olabilir. Daha ekonomik hizmetler sunan ara sunucular olsa da, bu tür hizmetler gri alanda yer aldığı için belirsizlikler vardır. Bu nedenle, hizmet kararlılığını arayan kullanıcılar çoğunlukla yurt içi modelleri tercih eder.

Bu makale, yerel modellerin kullanımını ve fiyatlarını karşılaştırarak referans amaçlı bazı öneriler sunar.

OpenClaw açık kaynak AI aracısı çerçevesi, üretkenlik devrimini getirirken aynı zamanda çarpıcı faturalar da getirdi.

OpenClaw, geleneksel tarayıcı veya uygulama tabanlı diyalog tabanlı AI'lardan tamamen farklı bir çalışma moduna sahiptir. Kullanıcı bir komut verdiğinde, araç otomatik olarak onlarca hatta yüzlerce model çağrısı başlatır, dosyaları okur, kod üretir ve hataları giderir; tüm süreç boyunca Token tüketilir.

Orta düzeyde karmaşık bir tam yığın geliştirme görevi, model çağrıları 10 ile 40 arasında olabilir; 200K bağlamı destekleyen bir bayrak modeli kullanılırsa, tek bir görevin maliyeti kolayca onlarca yuan'a ulaşır.

📊 Gerçek Maliyet Hesaplama

Orta düzeyde bir görev örneği: OpenClaw, ortalama her birinde 20.000 girdi Token ve 2.000 çıktı Token ile yaklaşık 30 oturum konuşma tetikler; popüler model kullanılarak (yaklaşık 0,005 yuan / bin girdi Token, 0,02 yuan / bin çıktı Token):

Tek görev maliyeti ≈ 30 × (20.000 × 0,005 ÷ 1.000 + 2.000 × 0,02 ÷ 1.000) = 30 × (0,1 + 0,04) = 4,2 yuan

Ağır geliştiriciler, günlük 5-10 görev tamamlayarak aylık maliyeti 630-1.260 yuan'a çıkarabilir. Bu orta seviye bir model kullanılarak yapılan bir tahmindir; üst düzey model seçildiğinde maliyet iki katına çıkacaktır.

Tam da bu bağlamda, 2025 yılının sonundan 2026 yılının Mart ayına kadar ülke çapında önde gelen bulut sağlayıcıları ve büyük model şirketleri, Token bazlı ücretlendirme yerine sabit aylık ücretli "Coding Plan" abonelik paketlerini piyasaya sürerek yoğun bir şekilde girdi. Bu fiyat savaşı, Zhipu AI'nın 2025 yılının sonunda GLM Coding Plan'ı piyasaya sürmesiyle başladı; ardından Alibaba Cloud BAILIAN, "7,9 yuan ilk ay" gibi çok düşük bir giriş sınırıyla güçlü bir şekilde piyasaya girdi ve Tencent Cloud, 5 Mart 2026 tarihinde son parçayı yerleştirdi.

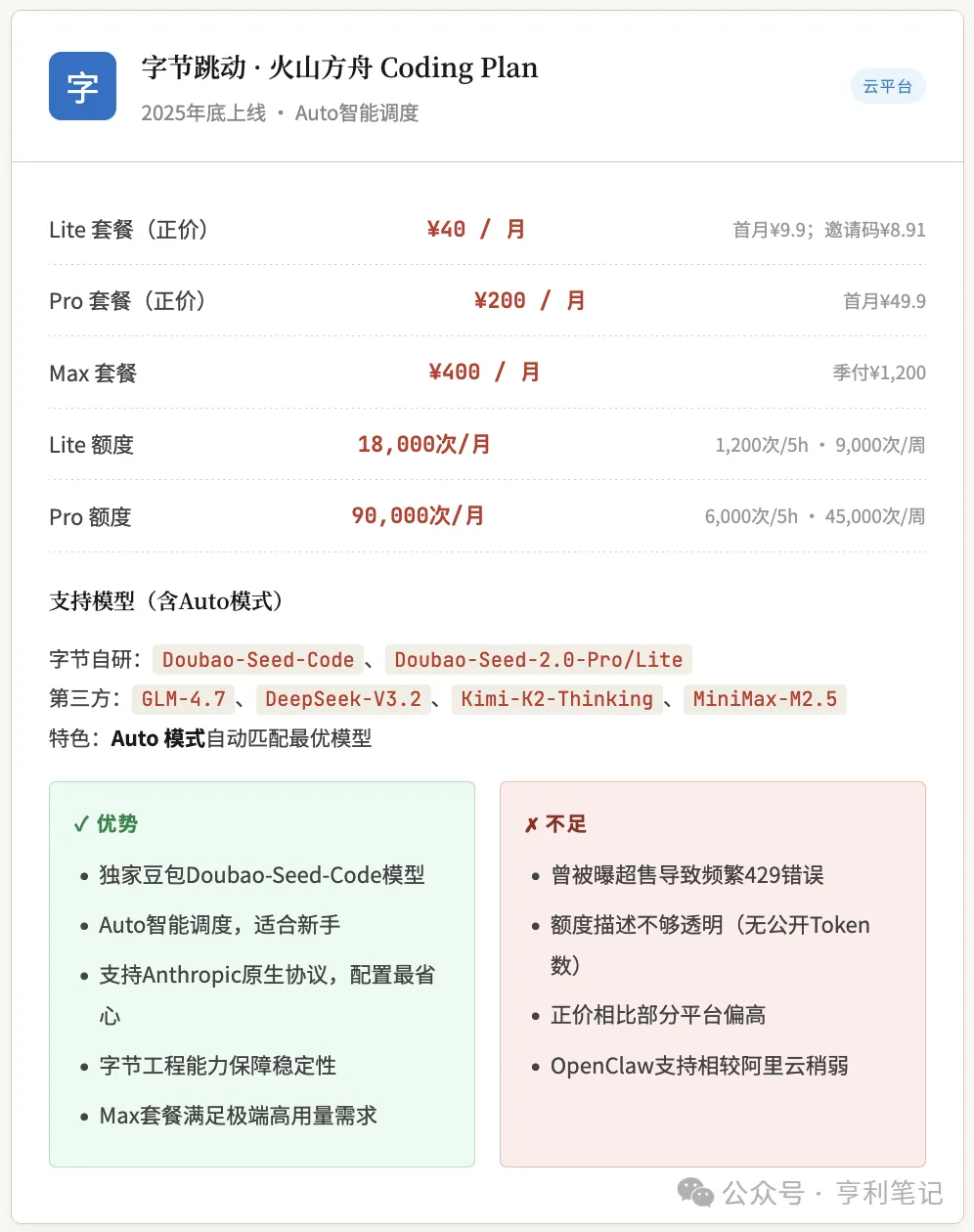

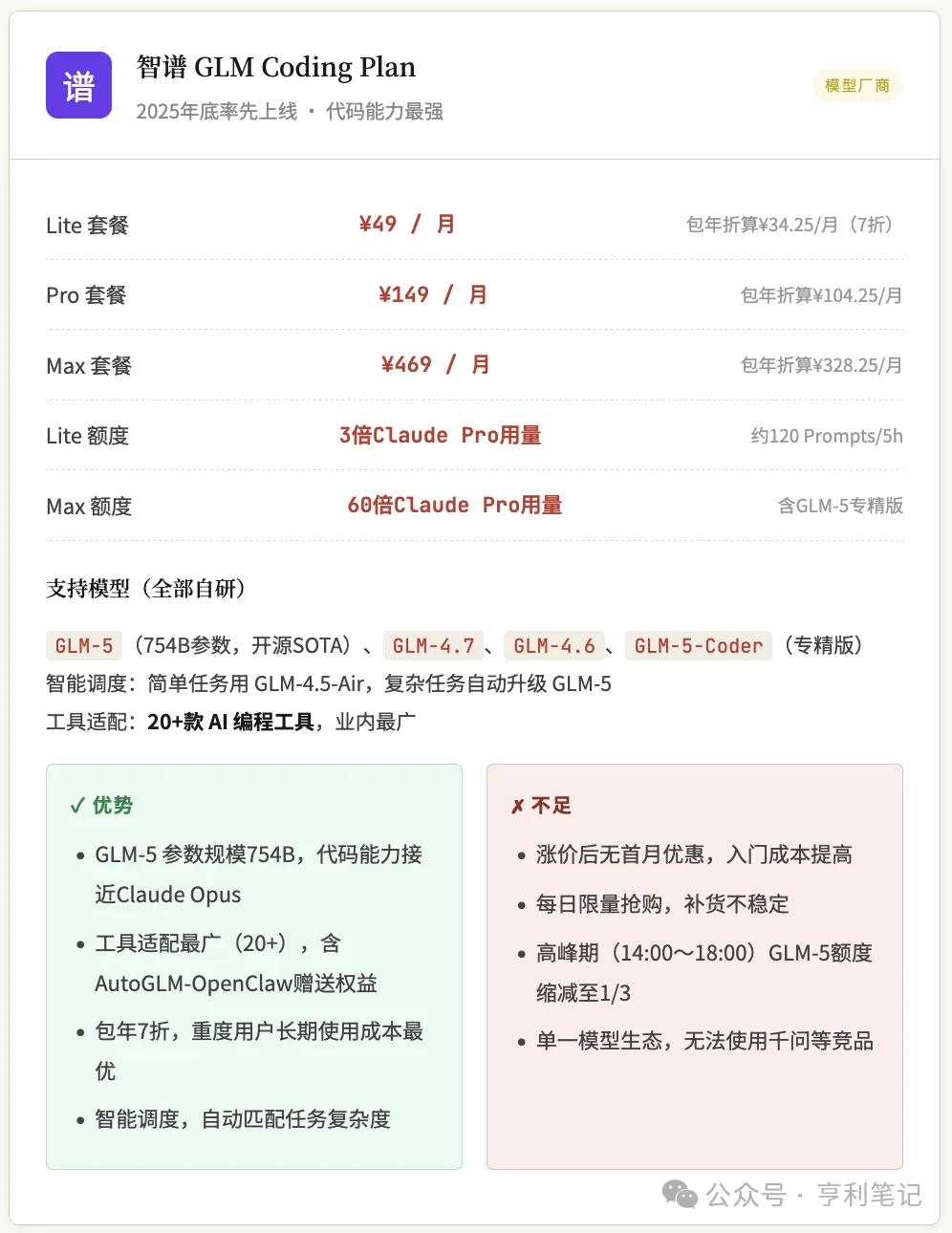

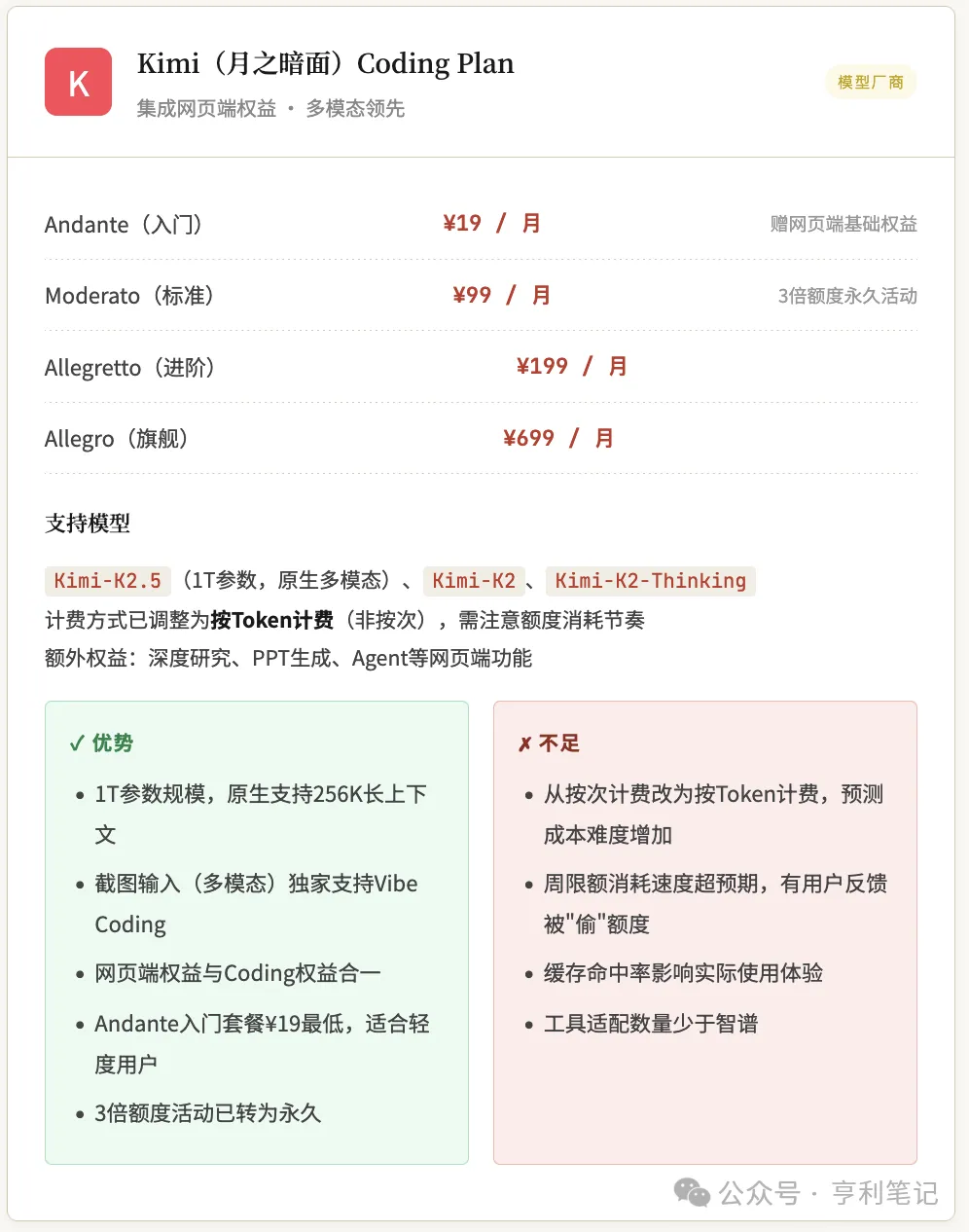

Bu makale, iç piyasadaki altı ana platformun Coding Plan'ını sistematik bir şekilde inceleyecek ve阿里云百炼, 字节火山方舟, 腾讯云 gibi bulut sağlayıcıları ile 智谱 GLM, Kimi 月之暗面, MiniMax gibi model sağlayıcıları olmak üzere iki ana çizgi boyunca karşılaştıracaktır; bu da OpenClaw kullanıcıları için bir referans sağlayacaktır.

OpenClaw, Coding Plan satın almalıdır. Evet, programcıların Cursor, Trae vb. IDE'leri kullandığı aynı kullanım modeli, çünkü OpenClaw ve Cursor gibi araçlar temelde agent'tir. Coding Plan'ı (yabancı ülkelerde genellikle API olarak bilinir) satın almadıysanız, harcadığınız para yalnızca tarayıcı aracılığıyla büyük modellere erişim için kullanılabilir.

(Dışarıdaki modeller bu makalenin konusu değildir)

Bulut sağlayıcı

Üç büyük bulut sağlayıcı: Model süpermarketinin rekabeti

Bulut sağlayıcı yoluun temel mantığı "platformu birleştirme": Qwen, GLM, Kimi, MiniMax gibi birçok açık kaynak büyük modeli aynı pakette birleştirmek ve geliştiricilerin bir API anahtarı ile serbestçe geçiş yapabilmesini sağlamak, farklı platformlarda ayrı ayrı yüklemeye gerek kalmadan. Bu paketler, "prompt" (ipucu) yerine "başlık isteği" birimiyle ölçülür; sayısal olarak daha büyük görünür, ancak gerçek dönüşümle birlikte değerlendirilmelidir.

Üç bulut sağlayıcının ayrıntıları şunlardır:

Büyük model üreticileri

Üç büyük model üreticisi: Derinlik odaklı seçim

Bulut sağlayıcıların "Model Süpermarketi" ile farklı olarak, model üreticilerinin Coding Planı "Özel Mağaza" yaklaşımını izliyor: Sadece kendi modellerini sunuyor, ancak derinlemesine optimize edilmiş ve model yetenekleri ile kota tasarımı daha ince ayarlı. Bu paketler genellikle "Prompts" birimiyle ölçülür; 1 Prompt ≈ 15 model çağrısı (MiniMax tahminine göre), bu nedenle sayılar çok daha küçük görünür, ancak her biri daha fazla diyalog kapasitesine sahiptir.

Platformlar Arası Temel Veri Karşılaştırma Tablosu

Not: Fiyatlar, 31 Mart 2026 itibarıyla resmi fiyat baz alınarak belirlenmiştir. İlk ay indirimi yalnızca yeni kullanıcılar içindir ve detaylar sipariş sayfasında yer almaktadır. OpenClaw uyumluluk puanlaması, resmi belgelerin tamamlanma düzeyi ve topluluk geri bildirimlerine dayanmaktadır.

Kuyruklardan Kaçınma Rehberi

Faturalandırma Yöntemi Açıklaması: Rakamların Ardındaki Gerçek

Kodlama Planı: Piyasadaki en büyük bilgi bariyeri, platformların tamamen farklı ölçü birimlerini kullanmasıdır; sayıları doğrudan karşılaştırmak anlamsızdır. Bu bölüm, satın alma öncesinde gerçekçi bir değerlendirme yapmanıza yardımcı olmak için üç temel fatura unsurunu özetlemektedir.

Ölçü birimleri tutarsız

Şu anda piyasada iki sistem birlikte var: bulut sağlayıcılar (Alibaba Cloud, Volcano, Tencent) "istek sayısı" ile ölçüm yapıyor; model sağlayıcılar (Zhipu, MiniMax) "Prompts" ile ölçüm yapıyor. Ana dönüşüm oranı şudur: 1 Prompt ≈ 15 model çağrısı.

Faturalandırma, kullanıcı tarafından başlatılan etkileşim döngüleri baz alınarak yapılır; bir soru, arka planda kaç kez model çağrılırsa çağrılsın, sadece bir kez kredi düşer. Sayı bazlı faturalandırma, geleneksel bulut sağlayıcılarının modelidir ve API çağrı sayısı baz alınarak yapılır; bir kullanıcı sorusu birden fazla model çağrısına neden olursa, birden fazla ücret düşer. İlk yöntem, arka planda sıkça çağrı yapan OpenClaw gibi Agent'lar için daha uygun olup maliyetler öngörülebilir; ikinci yöntem, gerçek istek sayısı baz alınarak kesin faturalandırma yapar ve dahili çağrılar nedeniyle beklenmedik faturalar ortaya çıkabilir.

OpenClaw için hafif kullanıcılar için iki yöntem de uygundur, çünkü token sayısı değil sadece sayılar hesaplanır ve aylık bir üst sınır vardır, bu da kullanıcıların token endişelerini ortadan kaldırır.

2. Çevirim Örneği

AliCloud BaiLian Pro paketi aylık 90.000 istek, yaklaşık 6.000 Prompt'a denk gelmektedir.

ZhiPu GLM Lite paketi, her 5 saatte yaklaşık 120 İfade, yani yaklaşık 1.800 istek içerir.

Bu nedenle "90.000" ve "120" doğrudan karşılaştırılabilir sayılar değildir.

3. Kayan pencere / 5 saat gerçek darboğazdır

Çoğu platform, "her 5 saatlik kota" sınırını ortak olarak uygular; bu sayı, aylık toplam kota değil, sürekli yoğun kullanım yapabilmenizin anahtarıdır. 5 saatlik pencere, kayan bir geri yükleme mekanizmasına sahiptir (sabit doğal zaman dilimi değil): 14:00'te kullanmaya başlarsanız ve 15:00'te kota biterse, ilk kota 19:00'a kadar yenilenmeyecektir. Öğleden sonra yoğun saatlerde 2-3 saatlik sürekli kullanım kolayca kota sınırını aşar.

4. ZhiPu GLM-5'in gizli ağırlık indirme kuralları

ZhiPu GLM Kodlama Planı'nda özel bir kural vardır: Yoğun saatlerde (UTC+8 14:00–18:00) GLM-5 kullanıldığında, gerçek kullanılabilir kullanım sayısı yoğun olmayan saatlerdeki kullanımın 1/3'ü kadardır. Diğer platformlarda bu kural mevcut değildir, ana kullanım saatlerinize dikkat edin.

5. İade ve iptal desteklenmemektedir

Tüm platformlar, abonelik sonrası iade veya iptal imkanı olmadığını açıkça belirtmektedir; satın almadan önce ihtiyaçlarınızı kesinlikle doğrulayın. Yeni kullanıcılar, yıllık planı doğrudan satın almak yerine ilk ayın düşük fiyatlı paketini denemelerini öneririz.

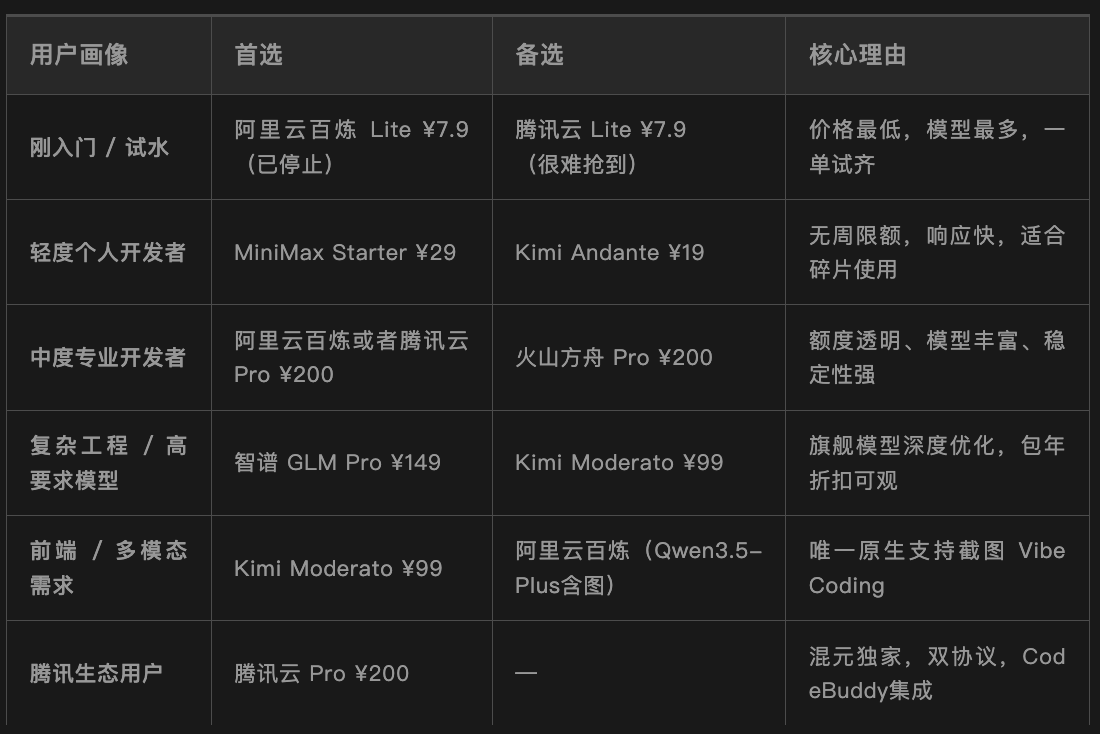

OpenClaw Kullanıcıları İçin Özel Alım Rehberi

OpenClaw, bir kendi kendine çalışan Agent çerçevesi olarak, Coding Plan için standart IDE eklentilerinden daha yüksek gereksinimler sunar: yüksek eşzamanlı çağrı toleransı, kararlı uzun bağlam işleme kapasitesi ve Anthropic protokolüne yerel uyumluluk (çünkü OpenClaw alt yapısı Claude protokolüne dayanarak tasarlanmıştır). Aşağıda kullanım senaryolarına göre özel öneriler verilmiştir.

🌱 Giriş Seviyesi

Öneri: Alibaba Cloud BaiLian Lite ilk ay 7,9 RMB (hizmet sona erdi) veya Tencent Cloud ilk ay 7,9 RMB

Coding Plan’i ilk kez deneyimlemek ve OpenClaw’un tam sürecini en düşük maliyetle yaşamak istiyorsanız, Bailian’ın 8 farklı modeli, bir pakette Qwen, GLM-5 ve Kimi’yi yan yana deneyimlemenizi sağlar ve hızlı bir şekilde sezgisel bir değerlendirme oluşturmanıza yardımcı olur. Alibaba Cloud’da şu anda sadece 200 TL/ay’lık Pro paketi mevcut, Tencent Cloud’da ise hâlâ 7,9 TL ve 40 TL’lik Lite paketleri bulunuyor; ancak gerçek kullanıcılar, bu paketlerin saniyeler içinde tükendiğini ve aslında sadece 200 TL/ay’lık paketin daha kolay elde edilebilir olduğunu belirtiyor.

💼 Günlük Geliştirme Tipi

Öneri: MiniMax Plus 49 RMB/ay

Günlük sabit programlama görevleri vardır, ancak sürekli yoğun kullanım değildir. MiniMax’in hızlı yanıt hızı (101 token/s) ve haftalık sınırı olmayan Starter paketi, parçalı ancak sıklıkla tekrarlanan geliştirme ritmine en uygunudur.

⚡ Aşırı Sürekli

Öneri: Tencent Cloud veya Alibaba Cloud Pro, aylık 200 CNY

Günde 6 saatten fazla sürekli geliştirme yapmak, büyük kod tabanları ve karmaşık Agent iş akışlarını işlemeyi gerektirir. Tencent/Bailian Pro'nun aylık 90.000 kezlik kota ve 5 saatlik pencerede 6.000 kezlik kotası, bulut platformlarında maliyet-verimlilik ve kararlılık açısından en iyi genel çözümü sunar.

🎨 Ön uç / Çok modlu

Öneri: Kimi Moderato 99 ¥/ay

Tasarım taslaklarının ekran görüntülerini ve UI krokiğini AI'ya analiz etmek ve kod üretmek için sık sık girmeniz gerekiyor. Kimi-K2.5, şu anda Coding Plan pazarında ekran görüntüsü çok modlu girişi destekleyen tek orijinal pakettir ve ön uç ile Vibe Coding senaryoları için uygundur.

🔬 Karmaşık Mühendislik Tipi

Öneri: ZhiPu GLM Pro 149 RMB/ay

Büyük monolitik projeler, karmaşık Agent yönetimi ve yüksek eşzamanlı otomasyon testleri gibi üst düzey model yeteneklerini gerektiren senaryoları işlemek. GLM-5'in 754 milyar parametre boyutu, ulusal açık kaynak modelleri arasında en yüksektir ve kodlama yeteneği Claude Opus'a yakındır; uzun vadeli maliyetler, yıllık %30 indirimli paketle daha da düşürülebilir.

Özet

Satın Alma Stratejisi

2026 yılı için yerel Coding Plan pazarı aşırı rekabet aşamasına girmiştir. Fiyat savaşının doğrudan yararlanıcıları geliştiriciler ve kullanıcılar: bir yıl önce hayal edilemeyen bir durum olarak, ilk ay 10 yuanın altında birçok önde gelen modeli deneyimleyebiliyorsunuz.

Ancak paket eşiklerinin düşürülmesi, seçim zorluğunu azaltmaz: ölçü birimi farklılıkları, gizli limit kuralları ve fiyat artış eğilimleri, dikkate alınması gereken değişkenlerdir.

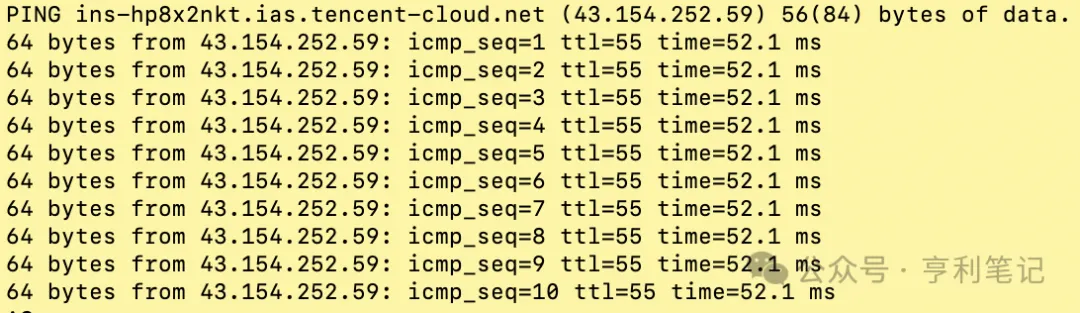

Bir diğer önemli nokta, OpenClaw makinenizin hangi büyük model hizmetine daha hızlı eriştiğine bakmaktır. En basit yöntem, OpenClaw makinesinde ping komutunu kullanarak ağ gecikmesini ve paket kaybını kontrol etmektir.

Örneğin, OpenClaw ana makinesinden Tencent Cloud servis uç noktasına ağ durumunu kontrol edin, icmp_seq'de paket kaybı olup olmadığını ve gecikme süresi time'nin düşük olup olmadığını dikkatle izleyin:

$ ping api.lkeap.cloud.tencent.com

Önceki analizlere göre şu sonuçlara varıyoruz:

📌 Son İpucu

Bu metin, 2026 yılının Mart ayı sonu itibarıyla güncellenmiştir. Platformların fiyat politikaları sıkça değişmektedir (örneğin, Zhipu zaten fiyatları artırmıştır, Alibaba Cloud Bailing Lite yeni satın alımları durdurmuştur); bu nedenle satın almadan önce lütfen ilgili platformların resmi duyurularını kontrol edin. Paketler iadeye uygun değildir. İlk satın alımınızda, aracın uyumluluğunu ve kişisel kullanım alışkanlıklarınızı test etmek için ilk ayın düşük fiyatlı paketinden başlamayı öneririz.

Bir sonraki sefer, OpenClaw'u dağıtırken dikkat edilmesi gereken çeşitli dengeleri konuşalım.