Yazar | ZeR0, ZhiDongXin

Düzenle | Suskunluk

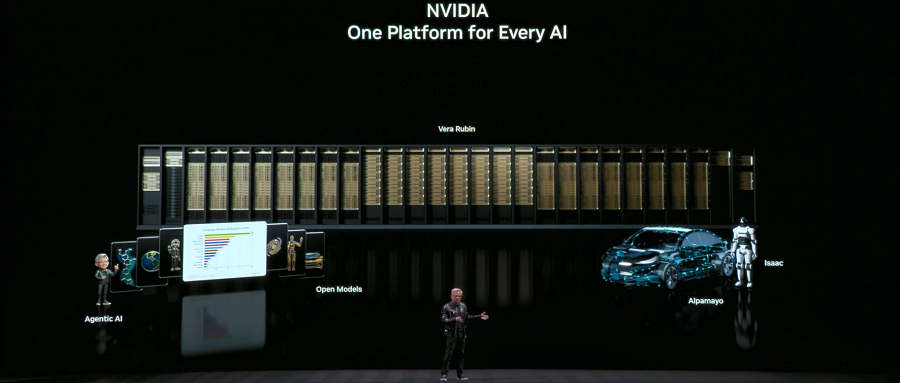

5 Ocak 2026, Las Vegas'ta - Çin'deki Jiedian Technology tarafından bildirildiğine göre, yeni açılış konuşmasında, Nvidia kurucusu ve CEO'su Jensen Huang, CES 2026 Uluslararası Tüketici Elektroniği Fuarı'nda 8 önemli duyuruyu 1,5 saat içinde sıraladı. Huang, her zamanki gibi deri ceket giydi ve çiplerden raf sistemlerine ve ağ tasarımına kadar yeni nesil platformun tüm yönlerini derinlemesine anlattı.

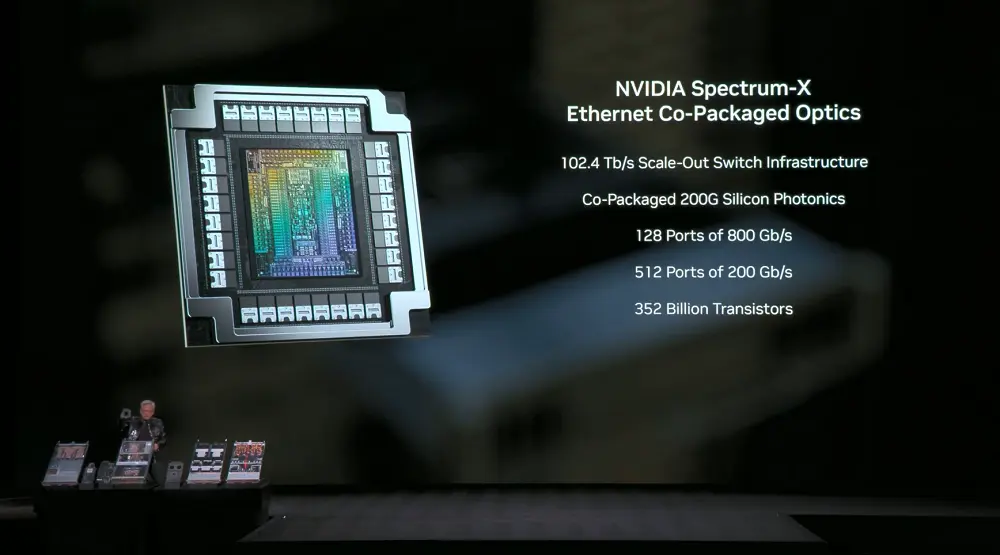

Yüksek hızlı hesaplama ve yapay zeka altyapısı alanında, NVIDIA, NVIDIA Vera Rubin POD AI süper bilgisayarı, NVIDIA Spectrum-X Ethernet paketleme optiği, NVIDIA Çıkarsama Bağlam Bellek Depolama Platformu ve NVIDIA DGX SuperPOD tabanlı DGX Vera Rubin NVL72'yi açıkladı.

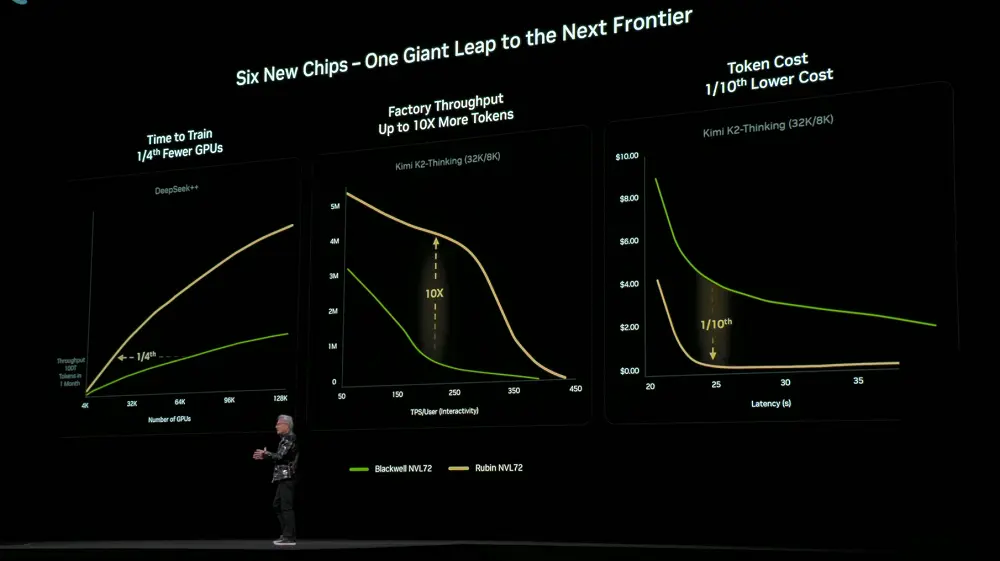

NVIDIA Vera Rubin POD, CPU, GPU, ölçeklenebilirlik, dağıtık yapı, depolama ve işleme kapasitesini içeren kendi geliştirdiği 6 NVIDIA çipini kullanmaktadır. Tüm bileşenler, gelişmiş model ihtiyaçlarını karşılamak ve hesaplama maliyetlerini azaltmak amacıyla ko-küçük yapıda tasarlanmıştır.

Vera CPU özel Olympus çekirdek mimarisi kullanırken, Rubin GPU Transformer motoru sayesinde NBFP4 çıkarım performansı 50 PFLOPS'a ulaşmaktadır. Her GPU NVLink bant genişliği saniyede 3,6 TB'ya kadar çıkmaktadır. Ayrıca, üçüncü nesil genel gizlilik hesaplamalarını (ilk raflı TEE) destekleyen cihaz, CPU ve GPU arasında tam güvenli yürütme ortamı sunmaktadır.

Tüm bu çipler geri dönmüş durumda ve NVIDIA, tamamıyla NVIDIA Vera Rubin NVL72 sistemini doğrulamıştır. Ortaklar, dahili entegre yapay zeka modellerini ve algoritmalarını çalıştırma işlemini başlatmışlardır. Tüm ekosistem, Vera Rubin için dağıtım hazırlıklarını yapmaktadır.

Diğer açıklamalarda, NVIDIA Spectrum-X Ethernet ile paketlenmiş optikler, güç verimliliğini ve uygulama çalışma süresini önemli ölçüde optimize etmiştir; NVIDIA Çıkarım Bağlam Bellek Depolama Platformu, yinelenen hesaplamaları azaltmak ve çıkarım verimliliğini artırmak için depolama yığınını yeniden tanımlamıştır; NVIDIA DGX SuperPOD, DGX Vera Rubin NVL72 tabanlı büyük MoE modellerinin token maliyetini 1/10'a düşürmüştür.

Açık modeller konusunda NVIDIA, kaynak kodlu modeller ailesini genişlettiğini duyurdu ve yeni modeller, veri kümeleri ve kütüphaneler paylaştı. Bunlara, NVIDIA Nemotron açık modeli ailesine eklenen ajan tabanlı RAG modelleri, güvenlik modelleri ve ses modelleri ile tüm robot türlerine uygun全新的 açık modeller dahildir. Ancak, Jensen Huang bu konuşmasında ayrıntılı bilgi vermedi.

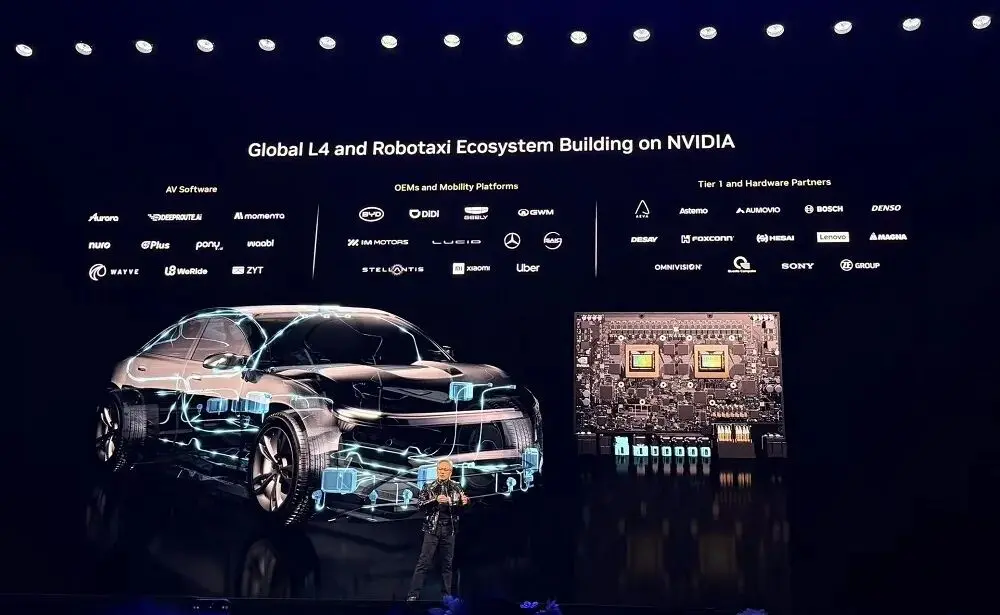

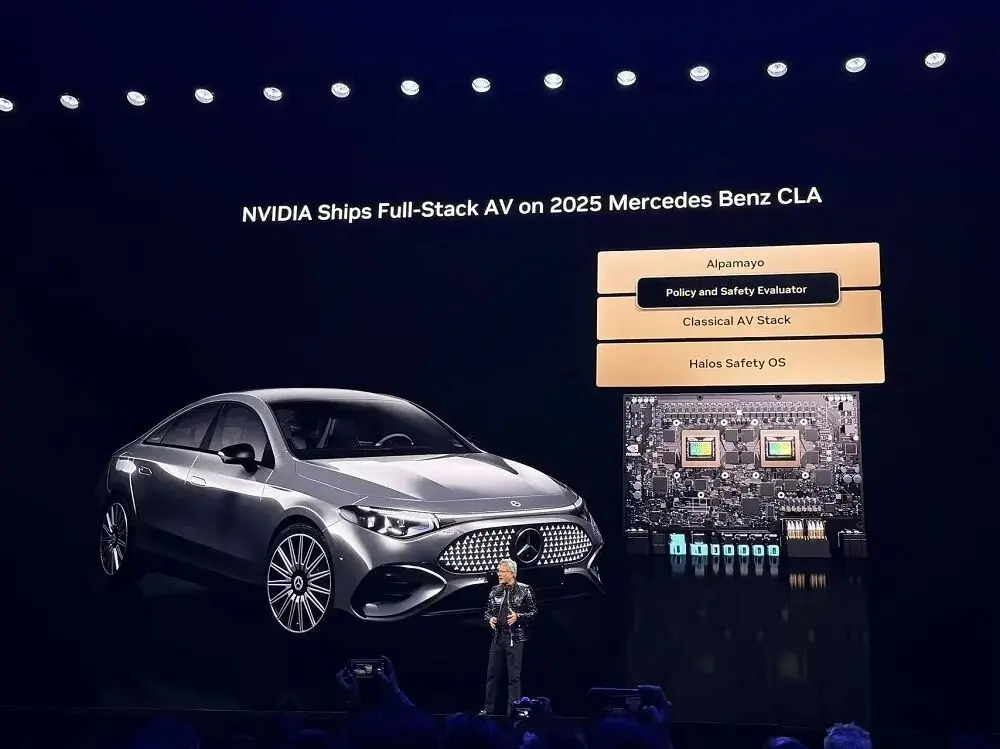

Fiziksel AI konusunda,Fiziksel bir AI'nın ChatGPT anı geldi.NVIDIA'nın tam yığın teknolojisi, dünya çapındaki ekosistemlerin yapay zeka (AI) destekli robotik sayesinde endüstrileri dönüştürmesine olanak tanıyor. NVIDIA'nın kapsamlı AI araç kutusu, yeni Alpamayo açık kaynaklı model yelpazesini de içerecek şekilde, tüm dünyadaki ulaşım sektörünün L4 seviyesinde güvenli sürüş için hızlıca geçiş yapmasına yardımcı olacak. NVIDIA DRIVE otomatik sürüş platformu artık seri üretimde olup, yeni tüm Mercedes-Benz CLA modellerinde L2++ AI tanımlı sürüş için kullanılıyor.

01. Yeni Nesil AI Süper Bilgisayarı: 6 Adet Kendi Üretilen Çip, Tek Bir Rafta 3,6 EFLOPS İşlem Gücüne Sahip

Jensen Huang’a göre, bilgisayar endüstrisi her 10 ila 15 yılda tamamen yeniden yapılandırılıyor. Ancak bu kez, iki platform değişikliği aynı anda meydana geliyor: CPU’lardan GPU’lara, "yazılım programlamasından" "eğitim yazılımına" kadar. Hesaplama ve yapay zeka, tüm hesaplama yığınını yeniden yapılandırmaktadır. Geçtiğimiz on yılda 10 trilyon dolarlık değer yaratan hesaplama endüstrisi, bir modernleşme süreci yaşamaktadır.

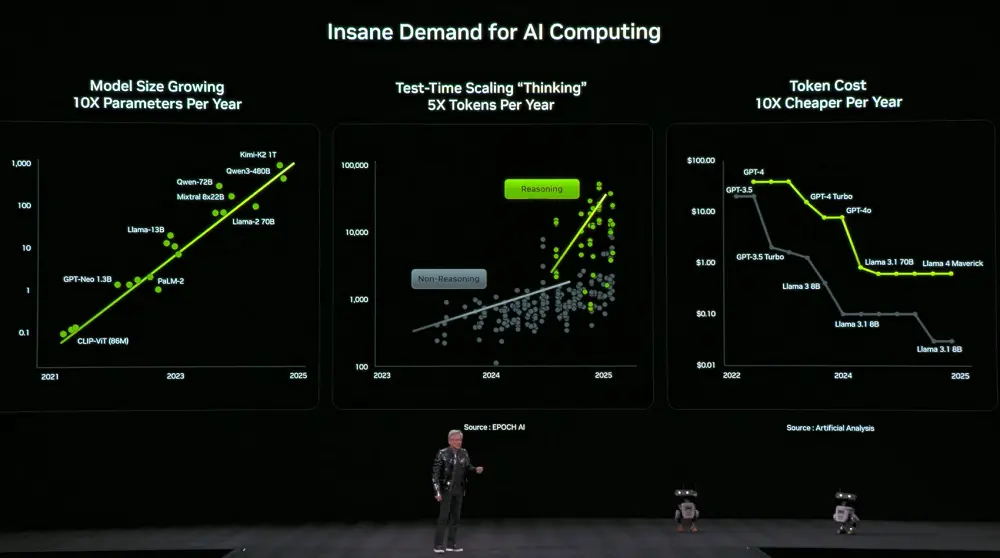

Bu arada, hesaplama kapasitesi talebi de ciddi şekilde arttı. Modellerin boyutu her yıl 10 katına çıktı, modellerin düşündüğü token sayısı yıllık olarak 5 katına çıktı ve her tokenin maliyeti yıllık olarak 10 kat azaldı.

Bu talebe cevap vermek için, Nvidia her yıl yeni hesaplama donanımı çıkarmaya karar verdi. Huang, şu anda Vera Rubin'in tam kapasiteyle üretimde olduğunu açıkladı.

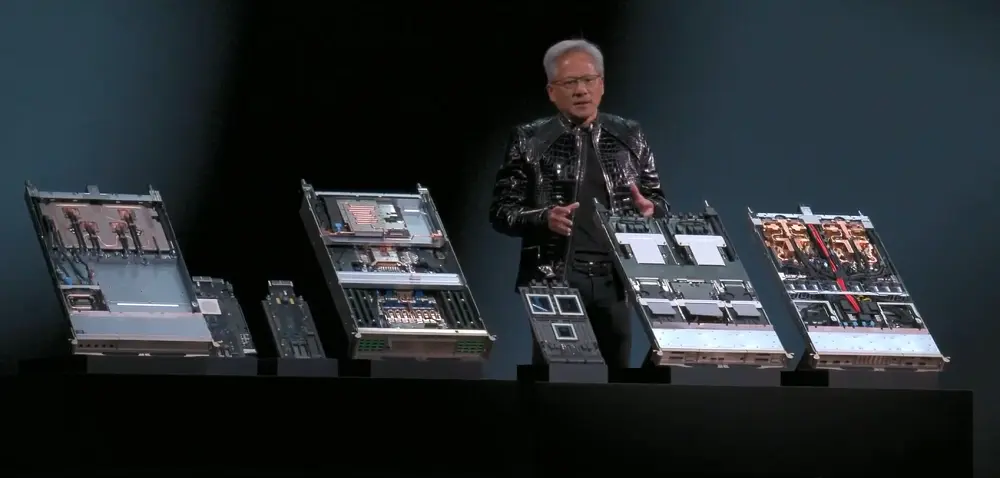

NVIDIA, yeni AI süper bilgisayarı NVIDIA Vera Rubin POD'da 6 adet özel olarak geliştirilmiş çip kullanıyor: Vera CPU, Rubin GPU, NVLink 6 Switch, ConnectX-9 (CX9) akıllı ağ kartı, BlueField-4 DPU, Spectrum-X 102.4T CPO.

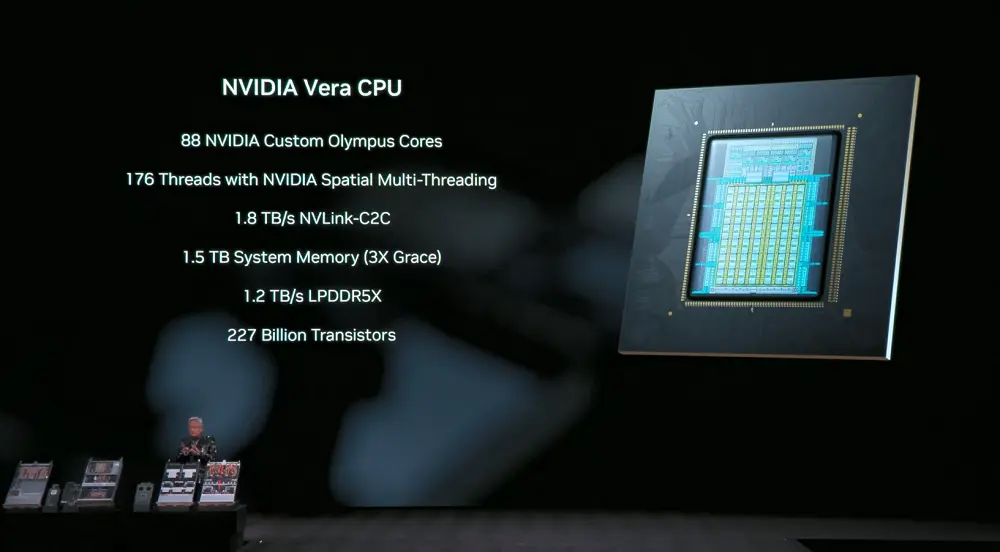

Vera CPU:Veri taşımaları ve ajan işleme için tasarlanmış, 88 özel NVIDIA Olympus çekirdeği, 176 iş parçacıklı NVIDIA uzamsal çok iş parçacığı, 1.8 TB/s NVLink-C2C desteği, CPU:GPU birleşik bellek, sistem belleği 1.5 TB (Grace CPU'nun 3 katı), SoC AMM LPDDR5X bellek bant genişliği 1.2 TB/s ve raf seviyesinde gizlilik hesaplamasını destekler, veri işleme performansı iki katına çıkarılır.

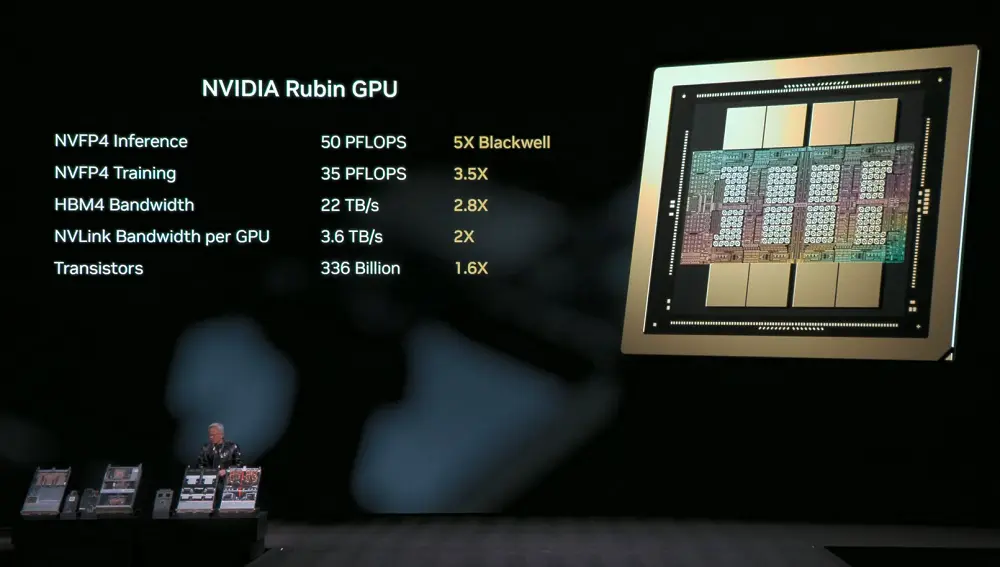

Rubin GPU:Transformer motoru ile NVFP4 çıkarım performansı 50 PFLOPS'a kadar ulaşır ve Blackwell GPU'nun 5 katıdır. Geriye dönük uyumluluk sağlarken çıkarım hassasiyetini korurken BF16/FP4 düzeyinde performansı artırır; NVFP4 eğitim performansı 35 PFLOPS'a ulaşır ve Blackwell'in 3,5 katıdır.

Rubin, aynı zamanda HBM4'ü destekleyen ilk platformdur. 22 TB/s bant genişliğine sahip olan HBM4, önceki neslinin 2,8 katıdır ve zorlayıcı MoE modelleri ve AI iş yükleri için gerekli olan performansı sağlar.

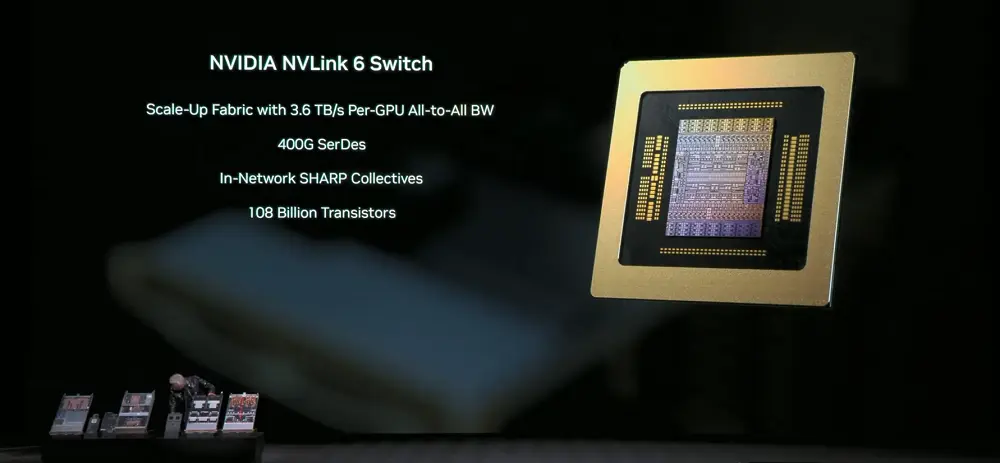

NVLink 6 Anahtarı:Tek yollu (single-lane) hız 400 Gbps'e çıkarıldı ve SerDes teknolojisi yüksek hızlı sinyal iletimi için kullanıldı; her GPU 3,6 TB/s tam bağlantılı iletişim bant genişliğine sahip olur ve önceki nesilin 2 katı olur. Toplam bant genişliği 28,8 TB/s'dir. FP8 hassasiyetinde ağ içi (in-network) hesaplama performansı 14,4 TFLOPS'e ulaşır ve %100 sıvı soğutma desteklenir.

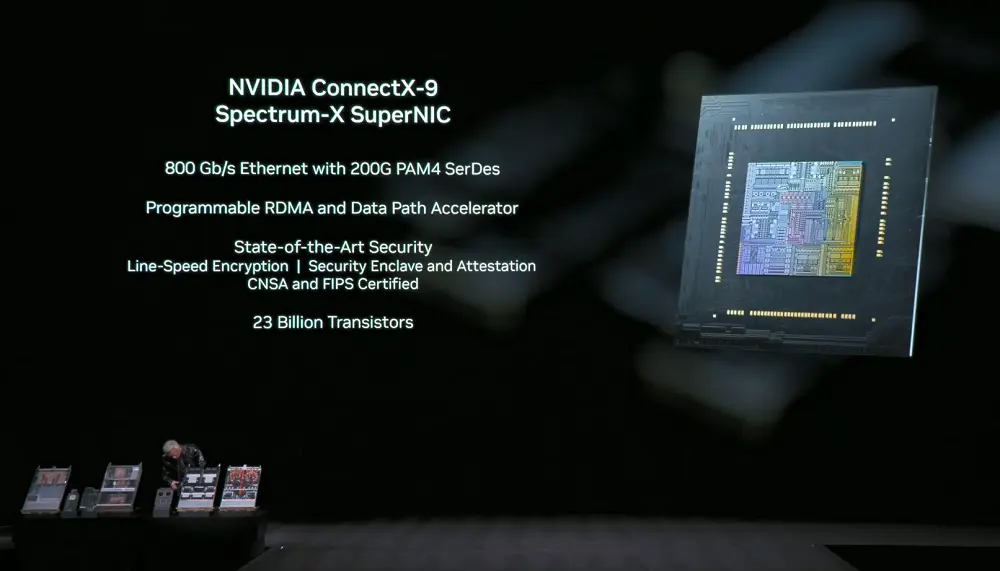

NVIDIA ConnectX-9 SuperNIC:Her GPU, büyük ölçekli yapay zeka uygulamaları için optimize edilmiş, 1,6 Tb/s bant genişliğine, tamamen yazılım tanımlı, programlanabilir ve hızlandırılmış veri yollarına sahiptir.

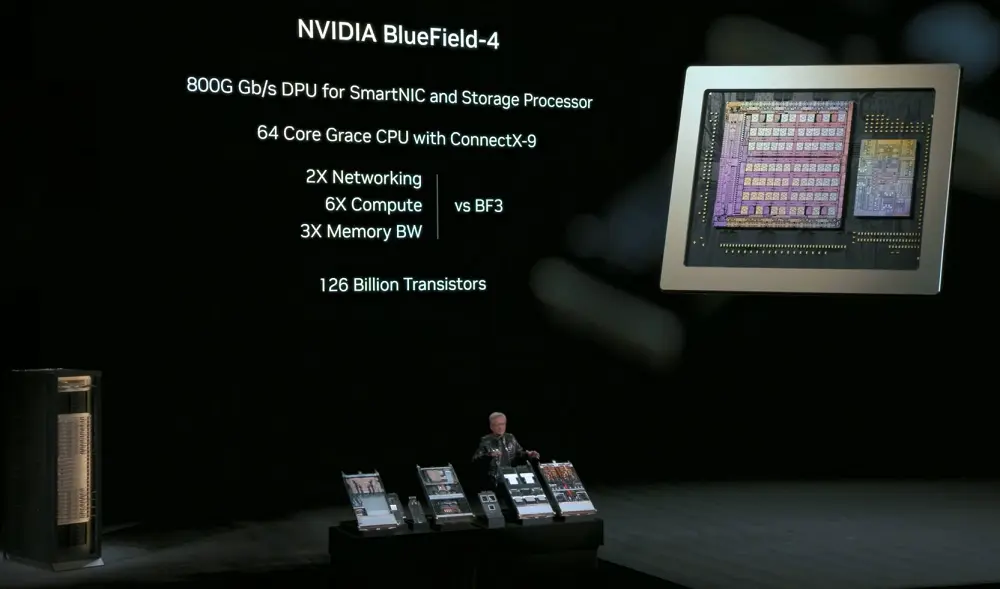

NVIDIA BlueField-4:64 çekirdekli Grace CPU ile donatılmış 800 Gbps DPU, akıllı ağ kartları ve depolama işlemcileri için, ConnectX-9 SuperNIC ile birlikte ağ ve depolama ile ilgili hesaplama görevlerinin işlevsiz hale getirilmesi için kullanılır. Aynı zamanda ağ güvenliğini artırır. Hesaplama performansı önceki neslin 6 katı, bellek bant genişliği 3 kat, GPU'nun veri depolama erişim hızı 2 kat artmıştır.

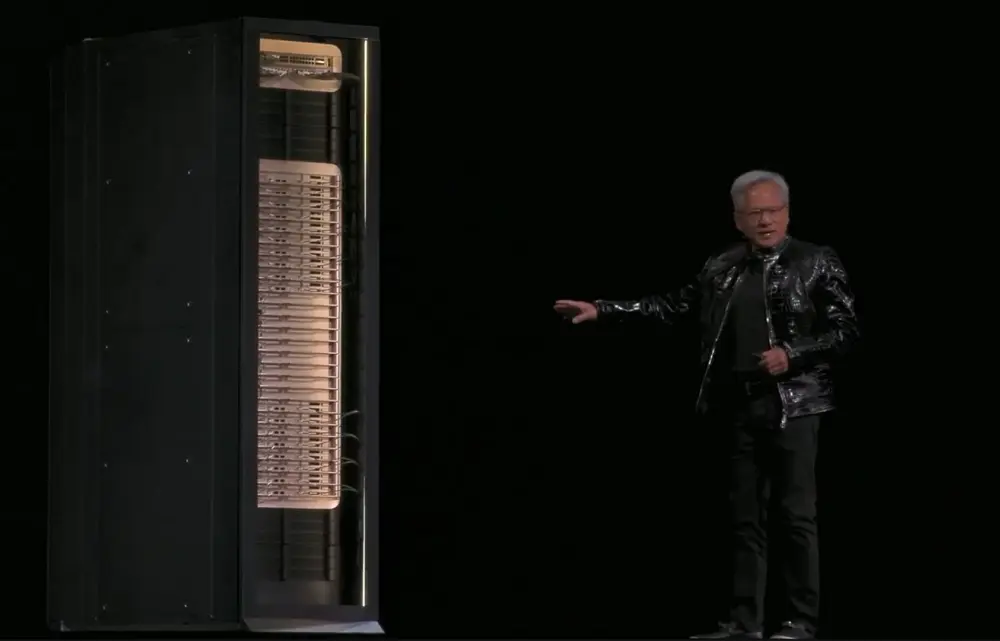

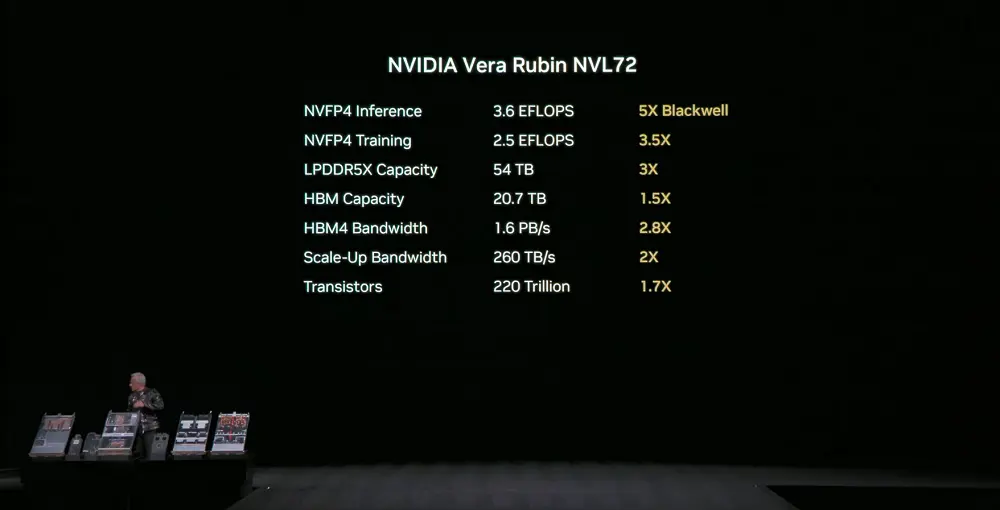

NVIDIA Vera Rubin NVL72:Yukarıdaki tüm bileşenleri, 2 trilyon transistörlü, NVFP4 çıkarım performansı 3,6 EFLOPS ve NVFP4 eğitim performansı 2,5 EFLOPS olan tek raf işlem sistemi haline getiren sistem düzeyinde entegrasyon.

Sistemdeki LPDDR5X bellek kapasitesi 54 TB'ye ulaşmakta ve önceki neslin 2.5 katıdır. Toplam HBM4 bellek 20.7 TB'ye ulaşmakta ve önceki neslin 1.5 katıdır. HBM4 bant genişliği 1.6 PB/s'dir ve önceki neslin 2.8 katıdır. Toplam dikey genişletilebilir bant genişliği 260 TB/s'ye ulaşmakta ve dünya geneli internet toplam bant genişliği ölçeğini aşmaktadır.

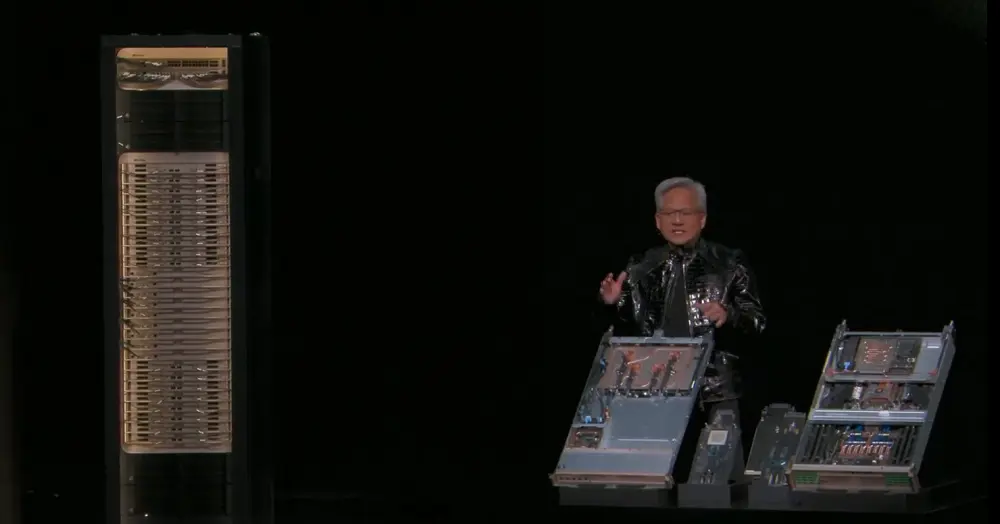

Sistem, üçüncü nesil MGX raf mimarisi üzerine kurulmuştur. Hesaplama rafı, modüler, ana bilgisayar olmayan, kablo olmayan ve vantilatör olmayan bir yapıya sahiptir. Bu sayede, GB200'e göre 18 kat daha hızlı kurulum ve bakım yapılabilir. Geçmişte 2 saat süren kurulum işi, şimdi sadece 5 dakikada tamamlanabilmektedir. Sistemde önce %80 sıvı soğutma kullanılıyordu, şimdi tamamen sıvı soğutma kullanılmaktadır. Sistem tek başına 2 ton ağırlığındadır. Su soğutma sıvısı eklendiğinde ağırlığı 2,5 tona ulaşmaktadır.

NVLink Switch kasa, kasa kaldırıldığında veya kısmen dağıtıldığında rafin çalışmaya devam edebilen, sıfır kesintili bakım ve hata toleransı sağlar. İkinci nesil RAS motoru, sıfır kesintili sağlık denetimlerini destekler.

Bu özellikler, sistemin çalışma süresini ve işlem kapasitesini artırarak, hem eğitim hem de çıkarım maliyetlerini düşürür ve veri merkezlerinin yüksek güvenilirlik ve yüksek bakım kolaylığına olan ihtiyaçlarını karşılar.

Zaten 80'den fazla MGX ortağı, Rubin NVL72'nin hiperölçekli ağlarda dağıtımını desteklemeye hazır.

02. Yeni Üç Ürünle AI Akıl Yürütme Verimliliği Yeniden Yapılandırıldı: Yeni CPO Cihazı, Yeni Bağlam Depolama Katmanı, Yeni DGX SuperPOD

Aynı anda NVIDIA, Spectrum-X Ethernet Co-Packaged Optics, NVIDIA Inference Context Memory Storage Platform ve NVIDIA DGX SuperPOD (DGX Vera Rubin NVL72 tabanlı) olmak üzere 3 önemli yeni ürün tanıttı.

1. NVIDIA Spectrum-X Ethernet ile paketlenmiş optik aygıtlar

NVIDIA Spectrum-X Ethernet'in paketleme optikleri, Spectrum-X mimarisi temelli, 200 Gbps SerDes kullanan 2 çip mimarisiyle, her bir ASIC'in 102,4 Tb/s bant genişliğine sahip olacak şekilde geliştirilmiştir.

Bu borsa, her biri 800 Gb/s hızında 512 bağlantı noktalı yüksek yoğunluklu bir sistem ve 128 bağlantı noktalı kompakt bir sistemden oluşur.

CPO (Yakın Optikli Paketleme) iletim sistemi, %5 daha yüksek enerji verimliliği, %10 daha yüksek güvenilirlik ve %5 daha yüksek uygulama çalışma süresi sunar.

Bu, günlük olarak daha fazla jetonun işlenmesine olanak tanıyarak veri merkezinin toplam sahip olma maliyetini (TCO) daha da azaltacaktır.

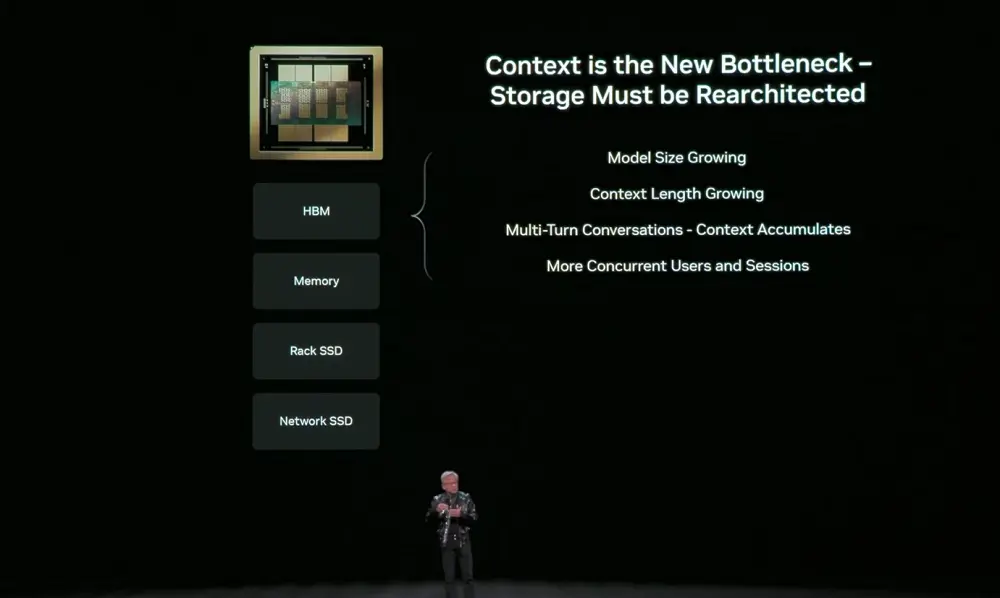

2. NVIDIA Çıkarım Bağlam Hafıza Depolama Platformu

NVIDIA Çıkarım Bağlam Hafıza Depolama Platformu, BlueField-4 ve Spectrum-X Ethernet hızlandırma ile güçlendirilmiş, KV Cache depolamak için geliştirilmiş, NVIDIA Dynamo ve NVLink ile yakından entegre edilmiş, hafıza, depolama ve ağ arasında işbirliği yapan bir POD seviyesi AI tabanlı depolama altyapısıdır.

Bu platform, konteksi birinci sınıf bir veri türü olarak ele alır, çıkarım performansında 5 kat, enerji verimliliğinde 5 kat daha iyi sonuçlar elde eder.

Uzun bağlam uygulamaları için çok turcu sohbet, RAG, ajan tabanlı çok adımlı çıkarım gibi bu tür iş yüklerinin, bağlamın sistemin tamamında etkili bir şekilde depolanması, yeniden kullanılması ve paylaşılmasına bağlı olduğu için bu çok kritiktir.

AI, sohbet botlarından ajan tabanlı AI'ya (intellektüel varlıklar) evrilmektedir. Bu ajanlar, akıl yürütmeyi, araçları çağırmayı ve uzun vadeli durumları korumayı bilir. Bağlam penceresi milyonlarca tokena kadar genişletilmiştir. Bu bağlam KV (anahtar-değer) önbellek içinde saklanır. Her adımda yeniden hesaplamak GPU zamanını boşa harcayacak ve büyük gecikmelere neden olacak. Bu yüzden saklanması gerekir.

Ancak GPU belleği hızlı olsa da sınırlıdır ve geleneksel ağ depolama, kısa vadeli bağlam için yetersizdir. AI çıkarımı darboğazları, hesaplamadan bağlam depolamasına kaymaktadır. Bu nedenle çıkarım için optimize edilmiş, GPU ve depolama arasında yer alan yeni bir bellek katmanına ihtiyaç vardır.

Bu katman artık bir sonradan uygulanan yamaya dönüşmemeli ve aksine, bağlam verilerini en düşük maliyetle taşımak için ağ depolama ile koordineli şekilde tasarlanmalıdır.

Yeni bir depolama hiyerarşisi olarak NVIDIA NIM (NVIDIA Inference Memory) bellek depolama platformu doğrudan ana sistemde değil, BlueField-4 aracılığıyla hesaplama cihazlarının dışında bağlanır. Ana avantajı, KV (anahtar-değer) önbelleğini tekrar hesaplamadan depolama havuzunu daha verimli bir şekilde ölçeklendirmesidir.

NVIDIA, NVIDIA Çıkarsama Bağlam Belleği Depolama Platformu'nun Rubin platformuna entegre edilmesi için depolama ortaklarıyla yakın iş birliği içinde çalışarak, müşterilerin bunu tam entegre AI altyapısının bir parçası olarak dağıtabileceği şekilde geliştiriyor.

3. NVIDIA DGX SuperPOD, Vera Rubin'a dayalı olarak inşa edilmiştir.

Sistem düzeyinde, NVIDIA DGX SuperPOD, 8 adet DGX Vera Rubin NVL72 sistemi, NVLink 6 dikey ölçeklendirme ağı, Spectrum-X Ethernet yatay ölçeklendirme ağı, dahili NVIDIA çıkarım bağlam belleği depolama platformu ve mühendislik doğrulaması içeren büyük ölçekli bir yapay zeka fabrikası dağıtım mimarisi olarak kullanılmaktadır.

Sistem, NVIDIA Mission Control yazılımı tarafından yönetilir ve maksimum verimliliği sağlar. Müşteriler, daha az GPU ile eğitim ve çıkarım görevlerini gerçekleştirmek için bu sistemleri anahtar teslimi platformu olarak dağıtabilirler.

Rubin platformı, 6 çip, tepsiler, raf, Pod, veri merkezi ve yazılım katmanlarında gerçekleştirilen uçtan uca koordineli tasarım sayesinde hem eğitim hem de çıkarım maliyetlerinde büyük düşüş sağladı. Blackwell'in önceki nesiline kıyasla aynı ölçekli bir MoE modelini eğitmek, yalnızca 1/4 GPU gerektirir. Aynı gecikme seviyesinde, büyük MoE modellerinin token maliyeti 1/10 oranında düşer.

Aynı zamanda DGX Rubin NVL8 sistemi kullanan bir NVIDIA DGX SuperPOD da tanıtıldı.

NVIDIA, Vera Rubin mimarisi sayesinde iş ortaklarıyla ve müşterileriyle birlikte dünyadaki en büyük, en gelişmiş ve en düşük maliyetli AI sistemlerini inşa ederek, yapay zekâ kullanımını yaygınlaştırmayı hızlandırıyor.

Rubin altyapısı, bu yılın ikinci yarısında CSP'ler ve sistem entegratörleri aracılığıyla sunulacak ve Microsoft ilk dağıtım sağlayıcıları arasında yer alacak.

03. Açık Model Evreni Yeniden Genişliyor: Yeni Modeller, Veriler ve Açık Kaynak Ekosistemine Önemli Katkılar

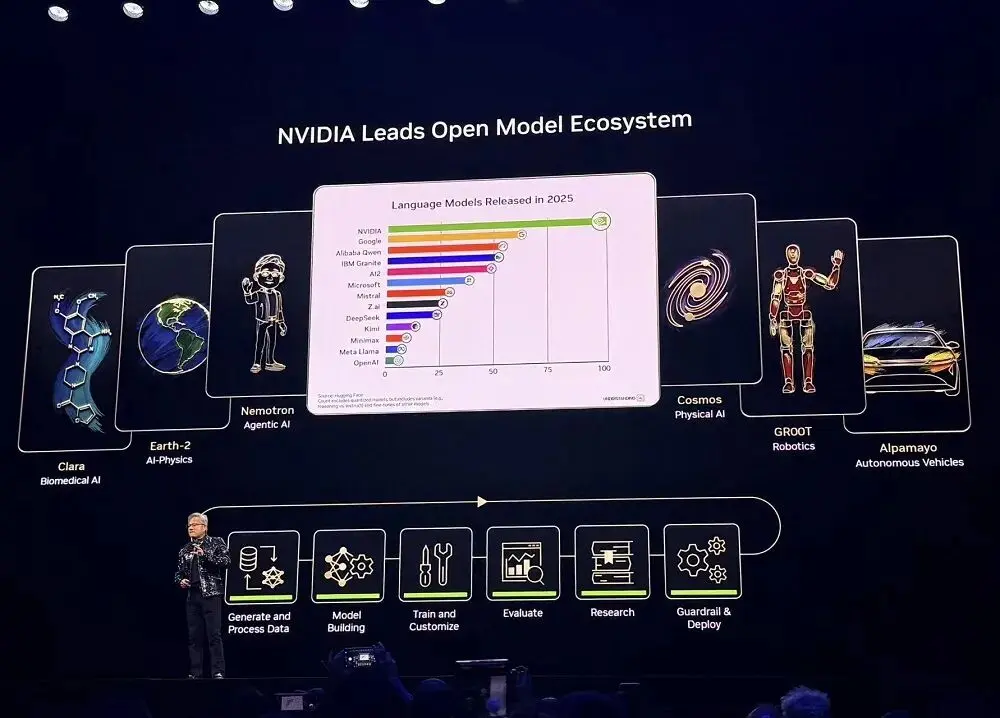

Yazılım ve model düzeyinde NVIDIA, açık kaynak projelerine olan katkısını artırarak devam ediyor.

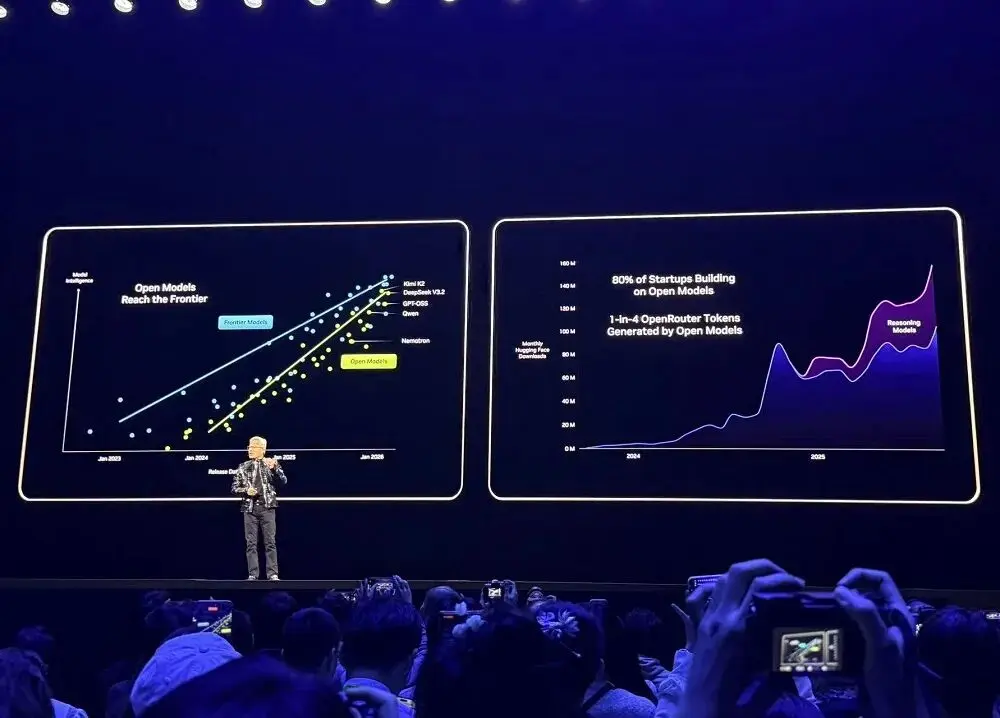

OpenRouter gibi popüler geliştirme platformlarına göre, geçen yıl AI model kullanımında 20 kat artış yaşandı ve token'ların yaklaşık 1/4'ü açık kaynak modellerden geldi.

2025'te, NVIDIA Hugging Face üzerinde açık kaynaklı modeller, veri kümeleri ve tariflerin en büyük katkısı olan kurumdur. 650 açık kaynaklı model ve 250 açık kaynaklı veri kümesi yayınlamıştır.

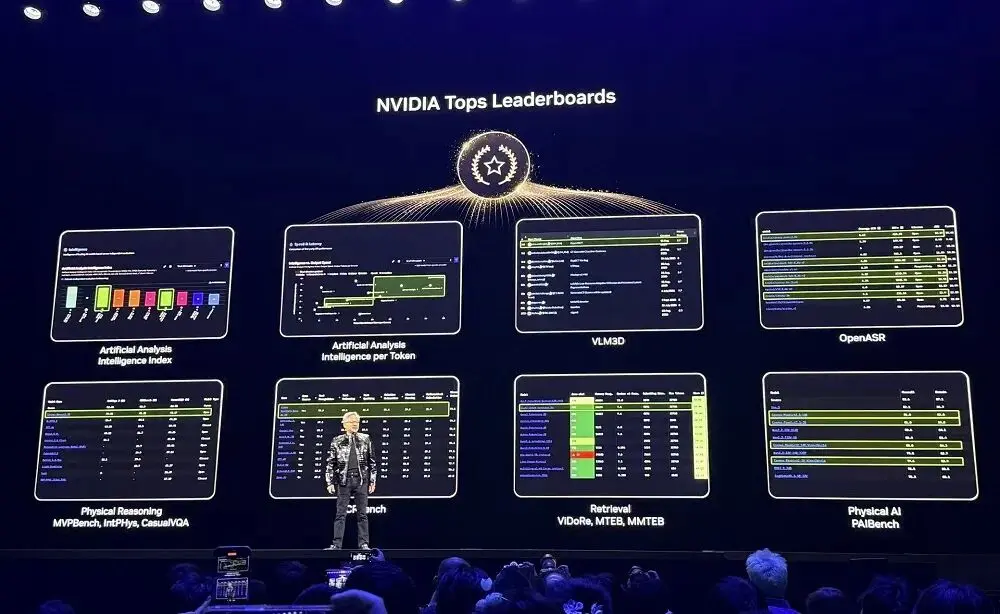

NVIDIA'nin açık kaynak modelleri birçok sıralamada önde yer alıyor. Geliştiriciler bu açık kaynak modelleri kullanmanın yanı sıra bunlardan öğrenmeleri, devam eden eğitimler, veri setlerini genişletmeleri ve belgelenmiş tekniklerle birlikte açık kaynak araçları kullanarak yapay zeka sistemleri inşa etmeleri mümkün.

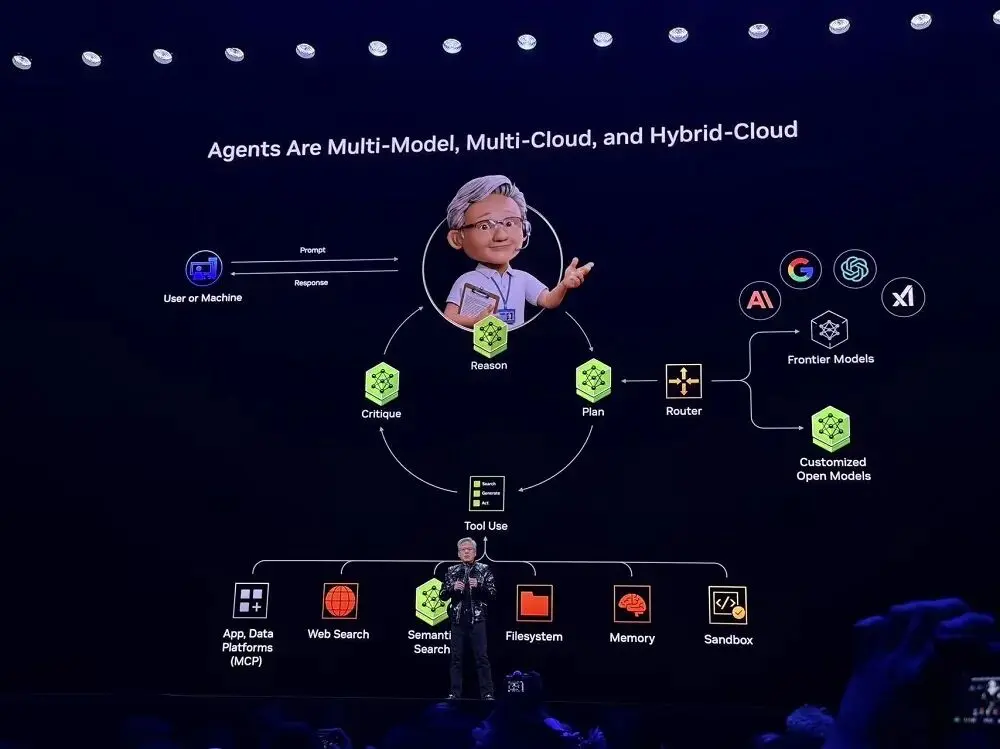

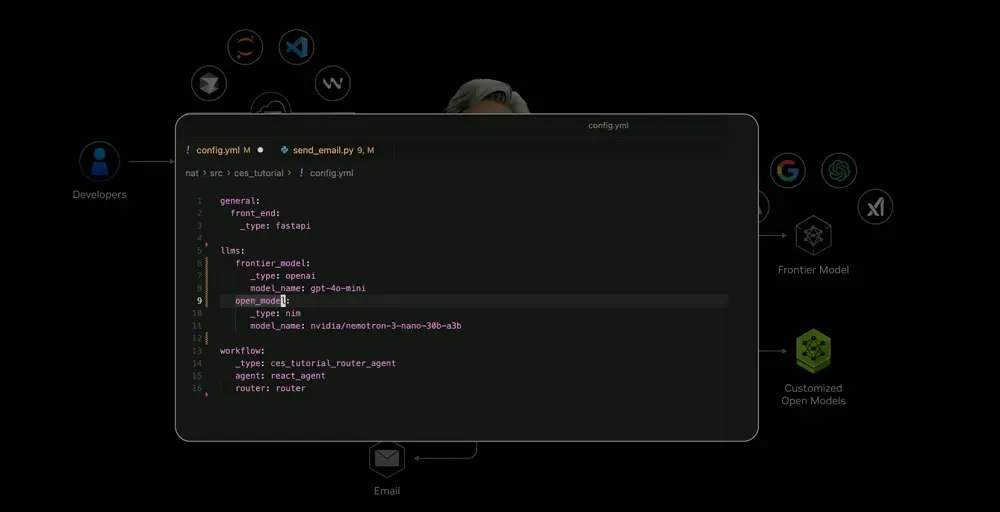

Perplexity'den esinlenerek, Huang Jian, ajanların çok modelli, çok bulutlu ve hibrit bulutlu olması gerektiğini fark etti. Bu da neredeyse tüm yaratıcı girişimlerin benimsediği ajans AI sisteminin temel mimarisiydi.

NVIDIA'nin sunduğu açık kaynaklı modeller ve araçlar sayesinde geliştiriciler artık yapay zeka sistemlerini özelleştirebilir ve en son modellerin gücünden yararlanabilir. Şu anda NVIDIA, bu çerçeveleri "blueprint" (harita) olarak entegre etmiş ve SaaS platformuna dahil etmiştir. Kullanıcılar, hızlı dağıtım gerçekleştirmek için bu blueprint'leri kullanabilir.

Canlı demo örneğinde, bu sistem kullanıcı niyetine göre görevin yerel özel model tarafından mı yoksa bulut modeli tarafından mı işlenmesi gerektiğini otomatik olarak belirleyebilir, ayrıca dış araçları (örneğin e-posta API'si, robot kontrol arayüzü, takvim hizmeti vb.) çağırabilir ve çok modallı entegrasyonu gerçekleştirebilir, metin, ses, görüntü, robot algılama sinyalleri gibi bilgileri birlikte işleyebilir.

Bu karmaşık yetenekler, geçmişte kesinlikle hayal edilemezdi, ancak şimdi önemsiz hale gelmiştir. ServiceNow, Snowflake gibi kurumsal platformlarda bu tür yeteneklere erişilebilir.

04. Açık kaynak Alpha-Mayo modeli, otomatik sürüş arabalarının "düşünmesini" sağlıyor

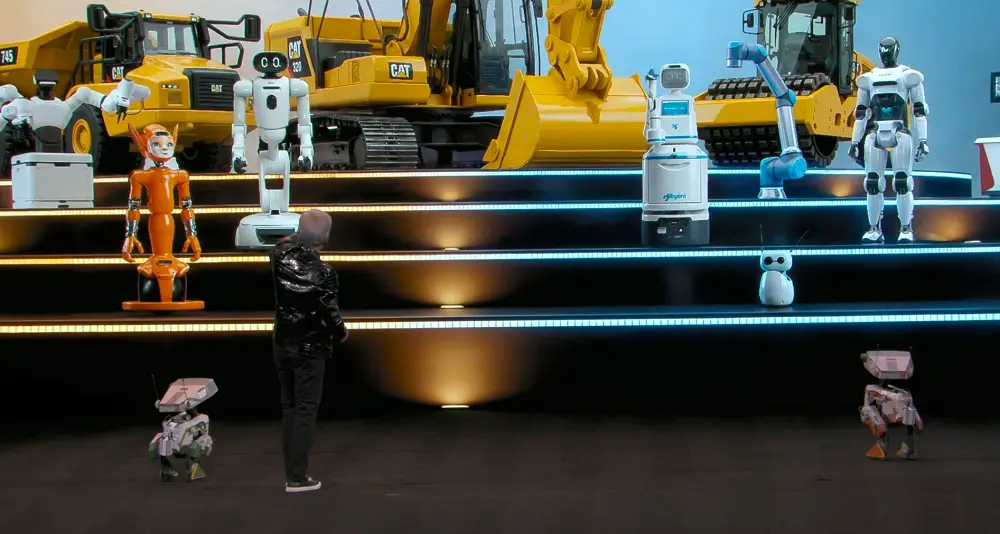

NVIDIA, fiziksel yapay zeka ve robotların sonunda küresel en büyük tüketici elektroniği segmenti haline geleceğine inanıyor. Hareket edebilen her şeyin, sonunda tamamen otonom ve fiziksel yapay zekâ tarafından sürdürüleceğine inanıyoruz.

Yapay zeka, algılayıcı yapay zekâ, üretici yapay zekâ ve ajan tabanlı yapay zekâ aşamalarından geçti ve şimdi fiziksel yapay zekâ çağına girmektedir. Zekâ, gerçek dünyaya girmektedir ve bu modeller fiziksel yasaları anlayabilir ve fiziksel dünyanın algılanmasından doğrudan eylemler üretebilirler.

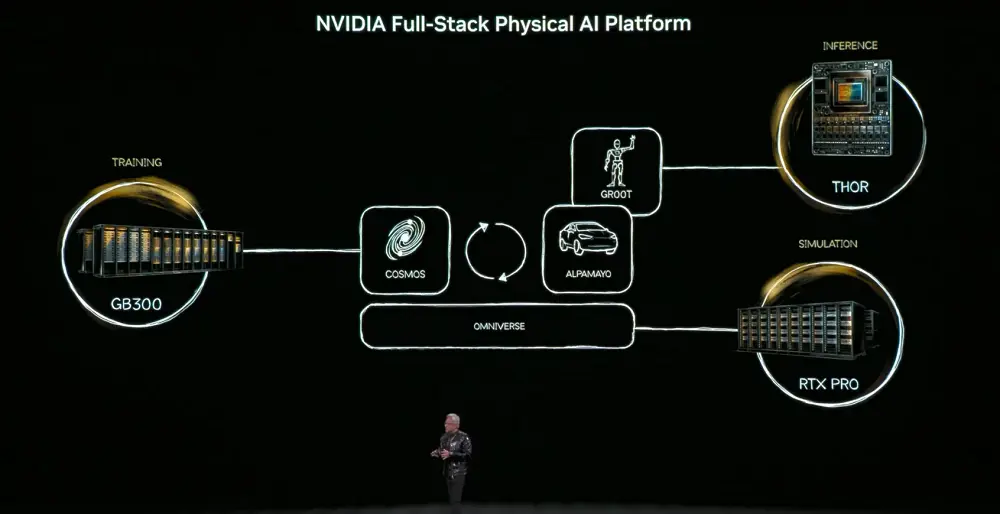

Bu hedefe ulaşmak için fiziksel bir AI, dünyaya dair genel bilgileri öğrenmelidir: Nesnelerin sürekliliği, yerçekimi ve sürtünme gibi. Bu yeteneklerin elde edilmesi, üç bilgisayara dayanacaktır: DGX adlı eğitim bilgisayarı, AI modellerinin oluşturulması için kullanılır; çıkarım bilgisayarı (robotlar/otomobil çipleri), gerçek zamanlı işlemler için kullanılır; Omniverse adlı benzetim bilgisayarı ise sentetik veri üretimi ve fiziksel mantığın doğrulanması için kullanılır.

Çekirdek model ise dilleri, görüntüler, 3B ve fizik yasalarını hizalayarak simülasyonlardan eğitim verisi üretimi için tam zinciri destekleyen Cosmos World temel modelidir.

Fiziksel AI'ler üç tür varlıkta görünecek: binalar (fabrikalar, depolar gibi), robotlar ve otomatik sürüş araçları.

Jensen Huang, otomatik sürüşün fiziksel bir AI'nın ilk büyük ölçekli uygulama alanının olacağını düşünüyor. Bu tür sistemler, gerçek dünyayı anlama, karar verme ve eylem gerçekleştirmenin yanı sıra güvenlik, benzetim ve veri konularında çok yüksek gereksinimler barındırır.

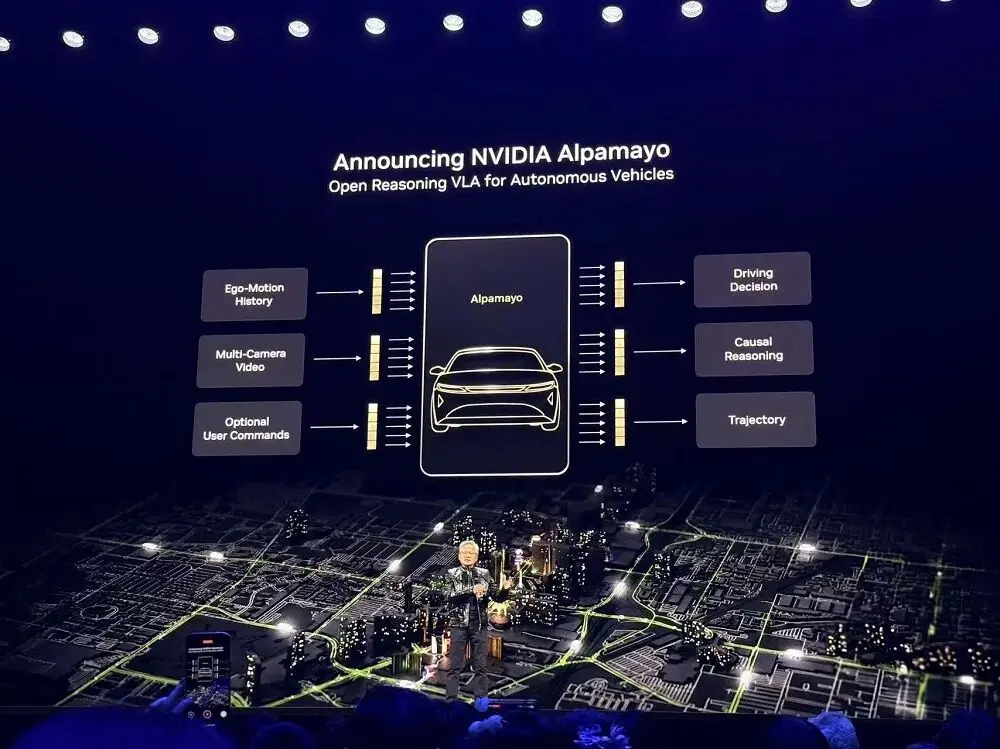

Bunun üzerine NVIDIA, çıkarımlara dayalı, güvenli fiziksel yapay zeka geliştirmeyi hızlandırmak için açık kaynaklı modeller, benzetim araçları ve fiziksel yapay zeka veri kümelerinden oluşan tam bir sistem olan Alpha-Mayo'yu açıkladı.

Ürün yelpazesi, küresel otomotiv üreticileri, tedarikçiler, yaratıcı girişimciler ve araştırmacılar için L4 seviyesindeki otomatik sürüş sistemlerini oluşturan temel modülleri sunar.

Alpha-Mayo, bu model, otomatik sürüş arabalarının "düşünmesini" sağlayan ilk gerçek modeldir ve açık kaynaklıdır. Sorunları adımlara ayırarak tüm olasılıkları çıkarım yapar ve en güvenli yolu seçer.

Bu akıl yürütmeli görev-aksiyon modeli, önceden hiç deneyimlenmemiş karmaşık uç senaryoları çözebilmesi için otomatik sürüş sistemlerine olanak tanır. Örneğin, yoğun kavşaklardaki trafik ışıklarının bozulması gibi durumlar.

Alpha-Mayo, 10 milyar parametreden oluşur. Bu ölçek, otomatik sürüş görevlerini işlemek için yeterli olurken, aynı zamanda otomatik sürüş araştırmacıları için geliştirilen istasyonlarda çalışacak kadar hafiftir.

Metin, çevre kamerası, araç geçmişi durumu ve navigasyon girdilerini alır ve yolcu araç neden belirli bir eylemde bulunduğunu anlayabilmek için sürüş yörüngesi ve çıkarımı çıkarır.

Alpha-Mayo sürücüsü tarafından yürütülen sahne kaydı reklamında, otomatik araç, yaya engelini önleyerek, sola dönüş yapan araçları öngörerek ve geçiş yaparak 0 müdahale ile işlemleri bağımsız olarak tamamlayabilir.

Jensen Huang, Alpha-Mayo ile donatılmış Mercedes-Benz CLA'nın üretiminin başladığını ve sadece NCAP tarafından dünyanın en güvenli aracısı olarak değerlendirildiğini açıkladı. Her satır kod, her çip ve sistem güvenlik sertifikalarına sahip. Sistem, ABD pazarında satışa sunulacak ve bu yıl daha gelişmiş sürüş yetenekleri, yani otoyolda elden bırakma sürüşü ve şehir içi ortamlarda tam uçtan-uca otomatik sürüş özellikleri sunulacak.

NVIDIA, Alpha-Mayo'nun eğitimi için kısmi veri setlerini ve açık kaynaklı çıkarım modeli değerlendirme simülasyonu çerçevesi olan Alpha-Sim'i de açıkladı. Geliştiriciler kendi verilerini kullanarak Alpha-Mayo'yu ince ayarlayabilir, Cosmos ile sentetik veri oluşturabilir ve gerçek verilerle sentetik verilerin birleşimine dayalı olarak otomatik sürüş uygulamalarını eğitip test edebilirler. Bunun dışında NVIDIA, NVIDIA DRIVE platformunun artık seri üretimde olduğunu açıkladı.

NVIDIA, Boston Dynamics, Franka Robotics, Cerrahi robotları, LG Electronics, NEURA, XRLabs, Zhiyuan Robotics ve diğerleri gibi dünya çapında önde gelen robot şirketlerinin hepsinin NVIDIA Isaac ve GR00T üzerinde inşa edildiğini açıkladı.

Jensen Huang, Siemens ile yapılan en son iş birliğini resmi olarak duyurdu. Siemens, NVIDIA CUDA-X, yapay zeka modelleri ve Omniverse'ü, EDA, CAE ve dijital ikiz araçları ve platformları paketine entegre etmektedir. Fiziksel yapay zeka, tasarım, simülasyondan üretim ve operasyonlara kadar olan tüm süreçlerde yaygın olarak kullanılacaktır.

05. Sonuç: Sol el açık kaynakla kucaklaşırken, sağ el ile değiştirilemez bir donanım sistemi yaratmak

AI altyapısının odak noktası, eğitimden büyük ölçekli çıkarıma doğru kayarken, platform yarışması, tek nokta hesaplama kapasitesinden, çipler, raf, ağ ve yazılımı kapsayan bir sistem mühendisliğine evrildi. Hedef, en düşük TCO ile en yüksek çıkarım hacmini teslim etmektir. AI, "fabrika işletimi"nin yeni bir aşamasına girmektedir.

NVIDIA, sistemin geneli tasarımı konusunda çok dikkatli olur. Rubin, hem eğitim hem de çıkarımda performans ve maliyet verimliliği sağlarken, Blackwell için bir "plug-and-play" alternatif olarak, Blackwell ile sorunsuz bir geçişi mümkün kılar.

Platform konumlamasında NVIDIA, sadece hızlı şekilde en gelişmiş modelleri eğiterek çıkarım platformlarının gerçekten faydalanabileceğini düşünmekte ve bu nedenle Rubin GPU'larında NVFP4 eğitimi sunarak, performansı artırmayı ve TCO'yu düşürmeyi hedeflemektedir.

Ayrıca, bu AI hesaplama devi, hem dikey hem de yatay ölçeklendirme mimarilerinde ağ iletişim kapasitesini önemli ölçüde artırmaya devam etmektedir ve depolama, ağ ve hesaplama ile koordineli tasarım gerçekleştirmek için kontekstü ana darboğaz olarak ele almaktadır.

NVIDIA, hem açık kaynak projelere büyük ölçüde katkıda bulunurken, hem de donanım, bağlantı ve sistem tasarımı konularında giderek daha "değiştirilmez" hale gelmekte. Talebi sürekli artırmak, token tüketimini teşvik etmek, çıkarımı ölçeklendirmek ve yüksek maliyet etkinliği sunan altyapılar sunmak suretiyle oluşturulan bu stratejik döngü, NVIDIA'nın daha da dayanıklı bir rekabet avantajı sağlamasına yardımcı olmaktadır.