Yazar: Şen Çay TechFlow

Geçen hafta, "Yapay Zeka bellek kullanımını 1/6'ya indirir" iddiasında bulunan bir makale, Micron, SanDisk gibi küresel depolama çip hisselerinde 90 milyar dolarlık piyasa değeri kaybına neden oldu.

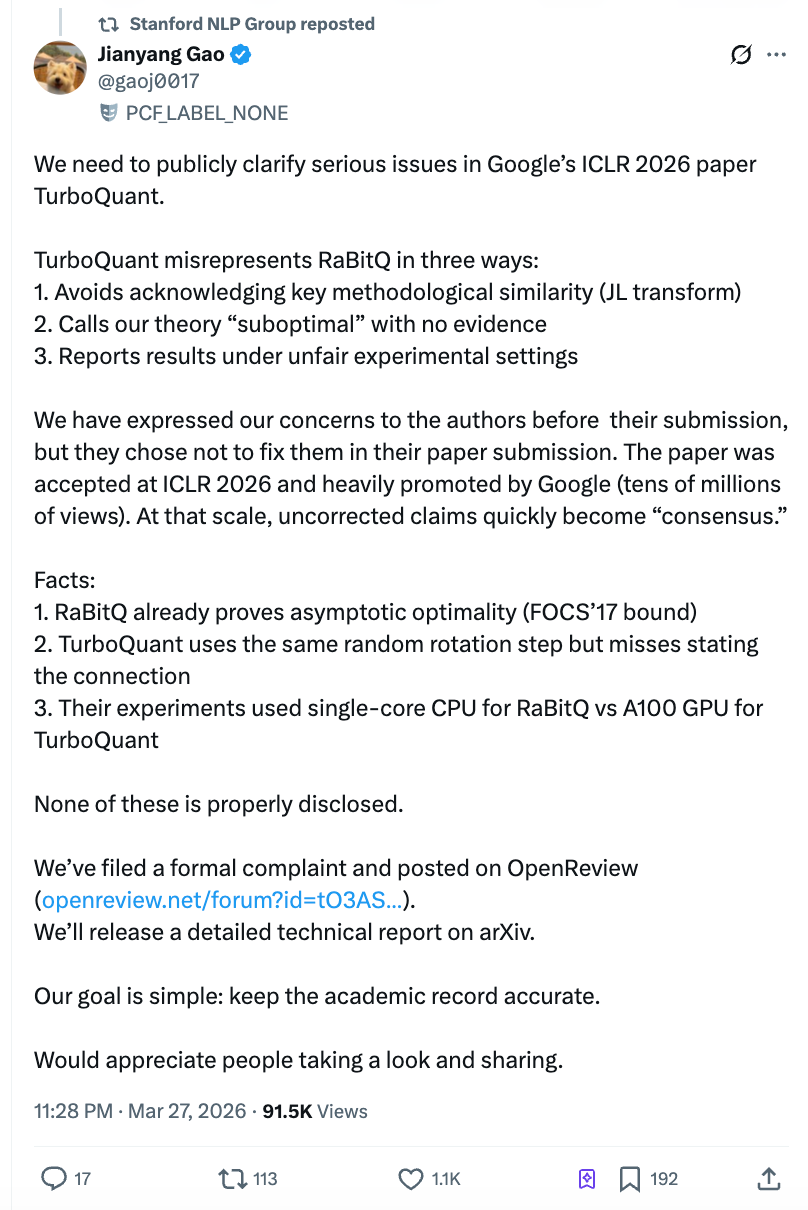

Ancak makale yayınlandıktan sadece iki gün sonra, algoritma tarafından "ezilen" karşı taraf olan Zürih Federal Teknoloji Enstitüsü postdoktora araştırmacısı Gao Jianyang, Google ekibinin deneylerde rakibi tek çekirdekli CPU ile Python betikleriyle test ettiğini, kendi algoritmasını ise A100 GPU ile test ettiğini ve gönderimden önce sorunun bildirilmesine rağmen düzeltmeyi reddettiğini iddia eden on binlerce kelimelik açık mektup yayınladı. Zhihu'da okunma sayısı hızla 4 milyonu aştı, Stanford NLP resmi hesabı paylaşım yaptı ve akademik çevre ile piyasa aynı anda sarsıldı.

(Referans okuma: Bir makale, depolama hisselerini düşürdü)

Çatışmanın temel sorusu karmaşık değil: Google'ın resmi olarak büyük ölçekli olarak tanıttığı ve küresel çip sektöründe panik satımına neden olan bir AI konferansı makalesi, önceden yayınlanan bir çalışmayı sistematik olarak çarpıttı mı ve kasıtlı olarak oluşturulmuş adil olmayan deneylerle sahte performans üstünlüğü anlatısını mı şekillendirdi?

TurboQuant, AI'nin "taslak kağıdını" orijinalinin altıda birine kadar incelemiştir.

Büyük dil modelleri, cevap üretirken yazarken aynı zamanda daha önce hesaplanan içerikleri geriye doğru kontrol etmelidir. Bu ara sonuçlar geçici olarak GPU belleğinde saklanır ve endüstride «KV Cache» (anahtar-değer önbelleği) olarak bilinir. Konuşma ne kadar uzunsa, bu «taslak kağıdı» o kadar kalınlaşır, GPU belleği tüketimi artar ve maliyet de yükselir.

Google araştırma ekibi tarafından geliştirilen TurboQuant algoritmasının temel avantajı, bu taslak kağıdını orijinal boyutunun 1/6'sına sıkıştırmak ve aynı zamanda sıfır doğruluk kaybı ve en fazla 8 kat hızlanan çıkarım hızı iddiasında bulunmaktır. Makale, 2025 yılında Nisan ayında akademik ön baskı platformu arXiv'de ilk kez yayınlandı, 2026 yılında Ocak ayında AI alanının en üst düzey konferansı ICLR 2026 tarafından kabul edildi ve 24 Mart'ta Google resmi blogu tarafından yeniden pazarlandı.

Teknik açıdan TurboQuant'in yaklaşımı şu şekilde basitçe anlaşılabilir: Önce karmaşık veriler, bir matematiksel dönüşümle tek bir formata "yıkılır", ardından önceden hesaplanmış en iyi sıkıştırma tablosu kullanılarak tek tek sıkıştırılır ve son olarak 1 bitlik bir hata düzeltme mekanizması, sıkıştırma sırasında oluşan hesaplama sapmalarını düzeltir. Topluluk tarafından bağımsız olarak gerçekleştirilen uygulama, sıkıştırma etkisinin temelde doğru olduğunu doğrulamıştır; algoritmik düzeydeki matematiksel katkı gerçektedir.

Sorun, TurboQuant'un kullanılabilir olup olmaması değil, Google'ın bunun "rekabetçilerinden çok daha iyi" olduğunu kanıtlamak için ne yaptığında.

Gao Jianyang'ın açık mektubu: Üç iddia, hepsi doğrudan kalbe vuruyor

27 Mart'ta saat 22:00'da, Gao Jianyang, 知乎'da uzun bir yazı yayınladı ve aynı anda ICLR resmi inceleme platformu OpenReview'e resmi yorumunu gönderdi. Gao Jianyang, 2024'te veritabanları alanındaki en üst düzey konferans SIGMOD'da yayımlanan RaBitQ algoritmasının ilk yazarıdır; bu algoritma, yüksek boyutlu vektörlerin verimli sıkıştırılması gibi aynı tür bir sorunu çözmektedir.

İddiaları üç madde halinde olup, her biri e-posta kayıtları ve zaman çizelgesiyle desteklenmektedir.

İddia 1: Başkalarının temel yöntemini kullandı, metinde hiçbir yerde belirtmedi.

TurboQuant ve RaBitQ'un teknik çekirdeğinde, verileri sıkıştırmadan önce bir «rastgele döndürme» adımı bulunur. Bu işlem, düzensiz dağılımlı verileri öngörülebilir bir düzgün dağılıma dönüştürerek sıkıştırma zorluğunu büyük ölçüde azaltır. Bu, iki algoritmanın en temel ve en benzer kısmıdır.

TurboQuant'un yazarı, kendi inceleme yanıtında bunu kabul etmiş olsa da, makalenin tamamında bu yöntemin RaBitQ ile olan ilişkisini hiçbir zaman doğrudan belirtmemiştir. Daha da önemli olan arka plan: TurboQuant'un ikinci yazarı Majid Daliri, 2025 yılında Ocak ayında, RaBitQ kaynak kodundan türetilmiş Python sürümünü hata ayıklamak için Gao Jianyang ekibine başvurmuştur. E-postada, yeniden üretme adımları ve hata mesajları ayrıntılı şekilde açıklanmıştır—yani TurboQuant ekibi, RaBitQ'nun teknik detaylarını iyi bilmektedir.

ICLR'nin gizli bir gözden geçiricisi, ikisinin aynı teknolojiyi kullandığını bağımsız olarak belirtti ve yeterli bir tartışma talep etti. Ancak nihai versiyon makalede, TurboQuant ekibi tartışma eklemek yerine, RaBitQ'a ilişkin (zaten eksik olan) orijinal metin açıklamasını eklerke taşıdı.

İkinci iddia: Karşı tarafın teorisini kanıt olmadan "ikinci en iyi" olarak nitelendirmek.

TurboQuant, RaBitQ'ya "teorik olarak alt-optimal" etiketini, RaBitQ'nun matematiksel analizinin "kaba" olduğunu iddia ederek verdi. Ancak Gao Jianyang, RaBitQ'nun genişletilmiş makalesinin, kompresyon hatasının matematiksel olarak en iyi sınırı sağladığını kesin olarak kanıtladığını ve bu sonucun teorik bilgisayar bilimlerinin en üst düzey konferanslarında yayınlandığını belirtti.

Mayıs 2025'te Gao Jianyang ekibi, RaBitQ teorisinin optimalliğini birkaç e-posta yoluyla ayrıntılı bir şekilde açıklamıştı. TurboQuant'un ikinci yazarı Daliri, tüm yazarlara bu bilginin iletildiğini doğruladı. Ancak makale sonunda hâlâ "ikinci en iyi" ifadesi korundu ve hiçbir itiraz argümanı sunulmadı.

İddia 3: Deney karşılaştırmasında “sol elde insan, sağ elde bıçak”.

Bu, tüm metindeki en etkili madde. Gao Jianyang, TurboQuant makalesinin hız karşılaştırma deneylerinde iki adet adil olmayan koşul eklediğini belirtti:

Birincisi, RaBitQ resmi olarak optimize edilmiş C++ kodunu (varsayılan olarak çoklu iş parçacığı paralel desteğiyle) sağladı, ancak TurboQuant ekibi bunu kullanmadı ve RaBitQ'yu kendi çevirdiği Python sürümüyle test etti. İkincisi, RaBitQ test edilirken tek çekirdekli bir CPU kullanıldı ve çoklu iş parçacığı kapatıldı, ancak TurboQuant, NVIDIA A100 GPU kullandı.

Bu iki koşulun birleşik etkisi, okuyucunun "RaBitQ, TurboQuant'tan birkaç sıralık daha yavaş" sonucunu görmesi ancak bu sonucun, Google ekibinin rakibini el ve ayakları bağlı şekilde yarışa soktuğu varsayımına dayandığını öğrenememesidir. Makalede bu deney koşullarındaki farklılıklar yeterince açıklanmamıştır.

Google'un yanıtı: "Rastgele döndürme, genel bir teknolojidir ve her makalede atıfta bulunmak mümkün değildir."

Gao Jianyang'a göre, TurboQuant ekibi 2026年3月'te gönderdiği e-posta yanıtında: "Rastgele döndürme ve Johnson-Lindenstrauss dönüşümünün kullanımı bu alanda zaten standart tekniklerdir ve bu yöntemleri kullanan her makaleyi alıntılamak mümkün değildir."

Gao Jianyang ekibi bunun kavramların değiştirildiğini düşünüyor: Soru, rastgele döndürme kullanan tüm makalelere atıfta bulunulup bulunmaması değil, RaBitQ'nun tamamen aynı problem ayarında bu yöntemi vektör sıkıştırma ile birleştiren ve bunun en iyi olduğunu kanıtlayan ilk çalışma olması; TurboQuant makalesinin bu ikisi arasındaki ilişkiyi doğru şekilde tanımlaması gerekiyor.

Stanford NLP Grubu'nun resmi X hesabı, Gao Jianyang'ın açıklamasını retweetledi. Gao Jianyang ekibi, ICLR OpenReview platformunda açık bir yorum yayınladı ve ICLR konferansı başkanına ile etik komitesine resmi bir şikayet sundu; daha sonra arXiv üzerinde ayrıntılı bir teknik rapor yayınlayacak.

Bağımsız teknoloji yazarı Dario Salvati, analizinde nispeten nötr bir değerlendirme verdi: TurboQuant, matematiksel yöntemlerde gerçekten bir katkı sağlamıştır, ancak RaBitQ ile olan ilişkisi makalede ifade edilenden çok daha sıkıdır.

90 milyar dolarlık piyasa değeri kaybı: Makale tartışması ve piyasa panikleri bir araya geldi

Bu akademik tartışmanın gerçekleştiği zaman noktası son derece hassastır. Google, 24 Mart'ta resmi blogunda TurboQuant'u duyurduktan sonra, küresel depolama çip sektöründe şiddetli satış dalgası yaşanmıştır. CNBC ve diğer birçok medya kuruluşuna göre, Micron Technology altı işlem gününde düşüşe geçerek toplamda %20'nin üzerinde kayıp yaşamıştır; SanDisk tek günde %11 düşüş göstermiştir; Güney Kore'nin SK Hynix'i yaklaşık %6, Samsung Electronics yaklaşık %5, Japonya'nın Kioxia ise yaklaşık %6 düşüş yaşamıştır. Piyasa korkusunun mantığı basit ve kabadır: Yazılım sıkıştırması, AI çıkarımı için gerekli bellek talebini 6 kat azaltabilir ve depolama çipleri için talep beklentisi yapısal olarak düşürülür.

Morgan Stanley analisti Joseph Moore, 26 Mart'ta yayımladığı raporda bu mantığı reddederek Micron ve SanDisk için 'Alım' değerlendirmesini korudu. Moore, TurboQuant'un yalnızca KV Cache adlı belirli bir önbellek türünü sıkıştırdığını, genel bellek kullanımını değil ve bunu 'normal bir verimlilik iyileşmesi' olarak tanımladı. Wells Fargo analisti Andrew Rocha da Jevons paradoksu argümanını kullanarak, verimlilik artışı maliyetleri düşürdükten sonra daha büyük ölçekli AI dağıtımlarını teşvik edebilir ve nihayetinde bellek talebini artırabilir dedi.

Eski tez, yeni ambalaj: AI araştırmasından pazar hikayesine iletim zinciri riski

Teknoloji blog yazarı Ben Pouladian'in analizine göre, TurboQuant makalesi Nisan 2025'te zaten açıkça yayınlanmıştı ve yeni bir araştırma değildi. Google, 24 Mart'ta resmi blogu aracılığıyla bunu yeniden paketleyerek tanıttı, ancak pazar bunu tamamen yeni bir gelişmiş olarak fiyatlandırdı. Bu “eski makale, yeni yayın” pazarlama stratejisi, makalede olası deneysel sapmalarla birlikte, AI araştırmalarının akademik makalelerden pazar hikayelerine aktarım zincirindeki sistemik riskleri ortaya koyuyor.

AI altyapı yatırımcıları için, bir makale "birkaç sıralık" performans artışı sağladığını iddia ettiğinde, ilk sorulması gereken karşılaştırma temelinin adil olup olmadığıdır.

Gao Jianyang ekibi, sorunun resmi çözümünü sürdürmeye kararlı olduğunu açıkça belirtti. Google, açık mektuptaki iddialara henüz resmi bir yanıt vermedi.