Bu çılgın otuz gün, on bir büyük model, gürültülü bir ateş işi gösterisi gibi.

Yazı yazarı, kaynak: 0x9999in1, ME News

Kısa Özet

- Sürekli rekabetin 30 günü: 26 Mart ile 24 Nisan arasında, dünya çapında 11 büyük model yayınlandı, ortalama 2,7 günde bir. Piyasa ciddi bir “parametre yorgunluğu” ile karşı karşıya.

- Parametre büyük yiyenin “kiloyu verme ameliyatı”: V4-Pro toplam parametresi 1,6 T, ancak etkinleştirilen sadece 49 B. CSA+HCA mimarisiyle yeniden yapılandırılarak 1 M bağlam altında FLOPs %27'ye, KV önbelleği ise son derece korkutucu bir oranda %10'a düşürüldü.

- Cübbeciliğin nesil ayrımı: “Önce bağımsız pekiştirmeli öğrenme, ardından doğrudan buharlaştırma ve birleştirme” sonrası eğitim paradigmalarını ilk kez tanıtan V4-Pro-Max, çıkarım ve Agent görevlerinde kapalı kaynaklı üst sınıra yaklaşmaktadır.

- Gerçek para ile verilen oy: GPT-5.5, NVIDIA'nın tek günlük %4,2 artışını tetikledikten sonra zirveye ulaştı, ancak V4, MIT tarafından tamamen açık kaynak kodlu olarak Çin ve Hong Kong yerel hesaplama zincirinin sürekli yükselişini tamamen ateşledi.

- Derin oyun mantığı: Kapalı kaynak modeller "vergi" satıyor, açık kaynak büyük modeller "demir" satıyor. V4'ün ortaya çıkışı, küresel kurumsal özel dağıtım hesaplamalarının sonunda dengelenmesini sağladı.

Tanrılar Çarpıntısı'nın Nisan'ı ve piyasa tüketiciliği

Delirdi. Hepsi delirdi.

Eğer AI sektörünü takip eden bir gözlemciyseniz, geçen otuz gün büyük olasılıkla fiziksel bir rahatsızlık hissi uyandıracaktır. 2026年3月26日 ile 4月24日 arasında, sadece bir aydan kısa bir sürede, dünya çapında en az 11 adet önemli etkiye sahip büyük model piyasaya sürüldü.

Liste, bir menü okunuyormuş gibi: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance DouBao 2.5 Pro, Tencent HunYuan 3.0, Kimi K2.6 Plus.

Ayrıca, 23 Nisan sabahı, bir derin su bombası gibi sessizce başlatılan DeepSeek V4.

Ortalama olarak her 2,7 günde bir yeni model ortaya çıkıyor. Bu, fon yöneticilerinin dahi duyuru metinlerini okuyamayacağı bir hız. Yatırımcılar A şirketinin “parametre aşımı” duyurusunu tamamlarken, B şirketinin “performans baskını” duyurusu zaten masalarına ulaşmış durumda. Piyasa aslında bıkmış durumda. Yüksek rekabet ortamında,所谓的“Benchmark (benchmark)” sıralama yapma, giderek kendi kendini eğlendiren bir sayı oyunu haline geliyor.

Ancak para akıllıdır. Ya da K çubukları asla yalan söylemez.

Bu 30 günlük ABD, Çin ve Hong Kong AI varlık kandillerini incelediğinizde, bu “tanrılar savaşı”nda piyasa üzerinde kalıcı izler bırakan yalnızca iki düğüm olduğunu görürsünüz.

Birincisi, 8 Nisan'da ABD'deki OpenAI, GPT-5.5'i duyurdu. Bu tartışmasız kral, NVIDIA'nın tek günde %4,2 artış yapmasını sağladı. Sonra ne oldu? Sonra hiçbir şey olmadı, bir gün içinde zirveye ulaşıp olumlu haberler tükenmişti. Herkes fark etti: Ne kadar büyük bir kapalı kaynak kral olsa da, iki yıl önce olduğu gibi kolayca küresel sermayenin ağır dağınığına kuvvet uygulayamazdı.

İkinci düğüm, 23-24 Nisan. DeepSeek V4 önizleme sürümü yayınlandı. Şık bir etkinlik yok, etkileyici bir tanıtım videosu yok. Ağırlıklar doğrudan Hugging Face ve ModelScope'a yükleniyor, MIT lisansı.

Sonuç? Bu, Çin-Hong Kong hesaplama gücü zincirinin ardışık sıçramalarını tetikledi.

Neden? Neden kapalı kaynaklı büyüklerin yapamadığı şeyi bir açık kaynak model başardı?

Bu soruyu cevaplamak için, sıkıcı kamu ilişkileri metinlerini bir kenara bırakıp, DeepSeek V4'ün motor kaputunu açıp içine hangi canavarların yerleştirildiğine bakmalıyız.

V4'ü Analiz Edin: Parametrelerin Brutalist Estetiğine İnanmayı Bırakın

Büyük modeller. Çok para harcıyor. Bu konu herkes tarafından biliniyor.

Geçen yıl, büyük modelleri üreten şirketler “güç yetersizliği korkusu”na kapıldı. Sen trilyon yaparsan, ben iki trilyon yaparım. Hepsi, sadece güçlü olmakla ortaya çıkan akıllılığın her şeyi çözeceğine inanıyordu. Ancak bununla birlikte son derece korkutucu bir hesaplama maliyeti ortaya çıktı. Toprak sahibinin artan tahıl bile yakmak için yeterli değildi.

DeepSeek V4, bu sefer iki MoE (Karışık Uzman) modeli çıkarttı: V4-Pro ve V4-Flash. Öncelikle birkaç temel veriye bakalım.

V4-Pro: Toplam parametre 1,6T (1,6 trilyon), ancak her token için etkin parametre yalnızca 49B (49 milyar).

V4-Flash: Toplam parametre 284B (284 milyar), etkin parametre sadece 13B (13 milyar).

Anladınız mı? Bu, aşırı bir şekilde kontrol altına alınmış bir “dört çekiçle binlik kuvveti harekete geçirmek”tir. MoE mimarisinin özü, her seferinde tüm alarmları çalmaktan kaçınmaktır. Tavuk öldürme göreviyle karşılaşırsanız, birkaç tavuk öldürme uzmanını harekete geçirin; Eşekarısı öldürme göreviyle karşılaşırsanız, Eşekarısı öldürme bıçağını çağırın. 1,6 trilyonluk temel, onun “dünyayı görmüş, bilgili” olmasını garanti eder; 490 milyarlık etkinleştirme, onun “hızlı tepki veren, çevik” olmasını sağlar.

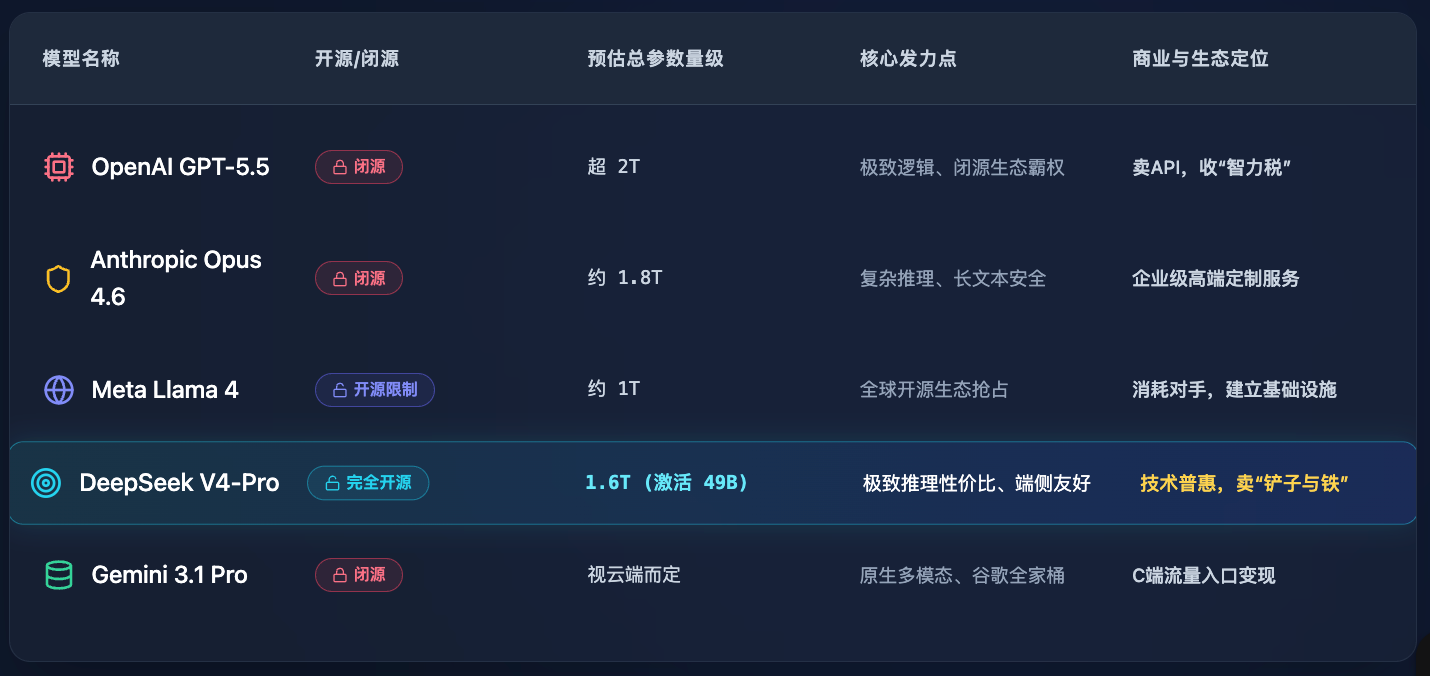

Bu farkı daha net anlamak için, mevcut piyasadaki ana akım yaklaşımları karşılaştıran bir tablo çıkaralım (veriler piyasa tarafından açıkça tahmin edilmiştir ve hesaplanmıştır):

Tabloya bakıldığında, V4-Pro toplam parametrelerde GPT-5.5'yi aşmaya odaklanmamış, ancak bu devin az yiyip hızlı koşmasını sağlamaya tüm çabalarını harcamıştır.

Ancak bu yeterli değil. Uzmanları nefes kesen, “VRAM katiline” karşı gösterdiği acımasızlık.

VRAM katili için son gün: Mimarideki üç kemik kazıma bıçağı

Ne demek bellek katili? “Uzun bağlam (Long Context)” demek.

Şu anda herkes, 1M (bir milyon) token bağlamını desteklediğini iddia ediyor. Çok etkileyici geliyor, tamamı bir kitap olan "Üç Krallık"ı içine sığdırıyorsunuz ve birkaç saniyede okuyor. Ancak maliyeti nedir? Uzun metinler, çıkarım sırasında büyük bir KV önbelleği (geçmiş bilgileri saklayan GPU belleği kullanımı) oluşturur. Bu, kitabın her sayfasını okurken, önceki sayfanın içeriğini bir büyük tahtaya kopyalayıp gözünüzün önünde tutmanız gibi. Bir milyonuncu kelimeye geldiğinizde, tahtalar o kadar çok olur ki Zhongguancun'daki veri merkezleri bile doldurulamaz.

Bellek, hesaplama gücünden daha pahalıdır. Bu, AI endüstrisinin gizli kuralıdır.

DeepSeek V4, bu durumu nasıl çözer? Onlar, temel dikkat mekanizmasına doğrudan “cerrahi müdahale” yaptılar. Bu, mimari güncellemelerinin ilk ve en sert adımı: karışık dikkat mekanizması (CSA + HCA).

CSA (Sıkıştırılmış Seyrek Dikkat) ve HCA (Aşırı Sıkıştırılmış Dikkat), uzun sözlerle ifade edilirse: artık ezberlemek yerine "önemli noktaları vurgulamayı" ve "çok sade notlar almayı" öğrenmiştir.

Etkisi son derece şiddetli: 1M bağlam altında, V4-Pro'nun tek token çıkarımı için FLOPs'ı (noktalı işlem sayısı), bir önceki nesil V3.2'nin yalnızca %27'si! Daha korkutucu olanı, KV önbelleğinin V3.2'nin %10'u olması!

Bu nedir? Daha önce milyonlarca kelime uzunluğundaki bir görevi tamamlamak için 10 adet en üst düzey sunucuya ihtiyaç vardı, şimdi ise sadece 1 sunucu ile kolayca hallediliyor. Hesaplama maliyeti doğrudan onda birine düştü. Bu, masayı çevirme düzeyinde bir optimizasyon.

Hâlâ iki bıçak var.

İkinci bıçak, "Manifold Kısıtlı Hiperbağlantı (mHC)" adını taşır. Geçmişteki büyük modellerde, katmanlar arası bilgi iletimi "geleneksel kalan bağlantılar" ile yapılır, bu da eski, paslanmış demir borularla su akıtmaya benzer; su basıncı arttığında kolayca sızar. 32T token'lık devasa ön eğitim verileriyle eski borular dayanamaz. mHC, fiber ağlarla değiştirilmesi gibi düşünülebilir; katmanlar arası sinyal iletiminin kararlılığını artırır. Paket kaybı olmaz, sapma olmaz.

Üçüncü bıçak, motor yağını değiştirin. Geleneksel yöntemi bırakın ve Muon optimizatörünü kullanın. Bu aracın işlevi, yakınsamayı hızlandırmaktır. Başkaları bir ilacın pişirilmesi için yedi hafta, yani kırk dokuz gün harcarken, bu sistem belki yirmi günde tamamlar. Zaman para, hesaplama süresi dolar değerindedir.

Bu üç kesimle V4, büyük modelin "zenginlik hastalığını" tamamen tedavi etti.

Dönüşüm fırınındaki sırrı: Birbirinden bağımsızlıkten tüm yöntemlerin birleşimine

Büyük modeller konusunda sektör içi herkes bilir, ön eğitim sadece bir “okuryazar olmayanı” “çok şey bilir ama konuşamayan bir aptala” dönüştürür. Onu gerçek bir efsane haline getiren, post-egitimdir (Post-training).

DeepSeek V4, sonrası eğitimde son derece sert bir "iki aşamalı strateji" oynadı.

Geçmişte, MoE'yi eğitmek, bir öğrenciye çevrilen bir grup öğretmen gibiydi ve kolayca çatışmalar olurdu. V4 bunu nasıl yapıyor?

Birinci aşama: “Herkes kendi işinde”. Bu aşama, SFT (Denetimli İnce Ayar) ve GRPO (Gruplu Göreceli Strateji Optimizasyonu) takviyeli öğrenimini kullanarak modeldeki her bir “uzman ağı” ayrı ayrı ince ayarlar. Kod yazma uzmanı sadece kod yazmayı, matematik uzmanı ise sadece matematik sorularını çözmeyi sürekli olarak eğitir. Birbirinden tamamen bağımsız. Bu, tekil yetenekleri maksimum seviyeye çıkarmaktır.

İkinci aşama: “Bütün yöntemler birleşir.” Bu zirve seviyesindeki uzmanları, çevrimiçi damıtma tekniğiyle tek, bütüncül bir modele birleştirin. İçsel çatışma yok, donma yok.

Onların zorladıkları iki "büyük hamle"ye bir bakalım.

Birinci olarak V4-Pro-Max modu. Bu, en yüksek çıkarım gücü modudur. Bu, genetik kilitlerin açılması gibidir. Kendilerine göre (ve topluluk tarafından kısa sürede doğrulandığına göre), kodlama performans testlerinde V4-Pro zaten üst düzeydeyken, karmaşık çıkarım ve Agent (akıllı ajan) görevlerinde önde gelen kapalı kaynak modellerle (örneğin GPT-5.5, Opus 4.6) arasındaki fark önemli ölçüde daralmıştır.

İkinci olarak V4-Flash-Max. Bu daha ilginç. Sadece 284B boyutunda bir küçük model, ancak yeterli düşünme bütçesi verildiğinde çıkarımsal performansı Pro'ya yaklaşabiliyor. Bu ne anlama geliyor? Algoritma kalitesinin parametre hacminin üstüne çıktığını gösteriyor. Yeterli zaman verirseniz, küçük beyniniz bile büyük sorunları çözebilir. Elbette, saf bilgi birikimi ve son derece karmaşık çok adımlı Agent görevlerinde hala parametre boyutundan dolayı sınırlı (çünkü midesi o kadar büyük değil), ancak çoğu kurumsal günlük uygulama için bu zaten aşırı performans sunuyor.

Son olarak, ağırlık depolama, FP4+FP8 karışık hassasiyet depolamayı son derece akıllıca kullanır. Hem hassasiyeti korur hem de video belleğini tasarruf eder. Her yerde bir mühendisliğin titizlikle hesapladığı cinsiyetini hissettirir.

Bu sonrası eğitimden kaynaklanan mühendislik verimliliği artışı daha net bir şekilde karşılaştırmak için sert bir performans karşılaştırma tablosu daha çıkaralım:

Sermayenin koku duyusu: V4, Çin-Hong Kong hesaplama zincirini neden ateşledi?

Buraya kadar teknik açıdan inceleme tamamlandı. Ancak başta sorduğumuz o temel soruyu hâlâ cevaplamadık:

GPT-5.5, hesaplama gücü sektörünü sürekli bir coşkuyla karşılamadı, ancak DeepSeek V4 yaptı.

Bu, oyunu kodların dışından sermaye ve ticari bir bakış açısıyla değerlendirmemizi gerektirir.

GPT-5.5 çok güçlü, yenilmez kadar güçlü. Ancak kapalı kaynaklı. Kapalı kaynaklı olmak ne anlama gelir? OpenAI'nin dev bir "kara delik" olduğu anlamına gelir. Yeteneklerini kullanmak istiyorsanız, API'sini satın almanız gerekir. Bu, bir "veri alma" modelidir. Karlar Silicon Valley'e doğru akar, hesaplama talepleri Microsoft'un bulut veri merkezlerinde yoğunlaşır. Bu, küresel donanım üreticileri, yerel hesaplama merkezleri ve ülkelerin sunucu temsilcileri için, sadece bakabilmekten başka hiçbir şey bırakmaz. GPT-5.5 ne kadar güçlü olursa olsun, bu başkalarının şenliği. NVIDIA'nın fiyatı yükseliyor, çünkü insanlar OpenAI'nin daha fazla kart satın alacağını düşünüyor.

Ancak DeepSeek V4 farklı.

Açık kaynaktır ve son derece kapsamlı MIT lisansına sahiptir. MIT lisansı, açık kaynak dünyasının en cömert hediyesidir ve ticari şirketlerin hukuki risklerden endişe etmeden bunu ücretsiz olarak kullanmasına, değiştirmesine ve satmasına izin verir.

Daha ölümcül olanı, daha önceki bölümlerde V4'ün modelin çıkarım maliyetini ve GPU bellek kullanımını ayak bileğine kadar düşürdüğünü gösterdik.

Bu iki noktayı birleştirirseniz, sermaye piyasalarını çılgınca heyecanlandıracak bir sonuca varırsınız: özelleştirilmiş dağıtımın kritik noktası gerçekten geldi.

Geçmişte, şirketler 1 TB'den büyük bir modeli kendi kendine dağıtmak istediğinde donanım fiyat listesine baktıktan sonra sessizce kapatıp API satın almak için dönerdi. Şimdi V4, size sadece çok az sayıda makineyle yerel olarak GPT-4'e çok yakın hatta GPT-5.5 seviyesini zorlayabilecek bir süper zeka çalıştırmak gerektiğini söylüyor. Verileriniz il dışına çıkmayacak, ülke dışına çıkmayacak, tamamen güvenli olacak.

Herkes yerel olarak çalıştırmaya başladığında, şimdi ne olacak?

Makine satın alın! Sunucu satın alın! Işık modülü satın alın! Akıllı hesaplama merkezi kurun!

Kapalı kaynaklı büyük şirketler zeka vergisi satıyor, ancak açık kaynaklı büyük şirketler temelde tüm sektörün donanım üreticilerine “ürün tanıtımı” yapıyor. DeepSeek V4, alevi düşüren kişi. Ne kadar iyi ve açık kaynaklıysa, Çin, Hong Kong ve Tayvan’daki yerel hesaplama gücü talebi o kadar patlıyor. Sunucu montajı yapan, sıvı soğutma yapan, veri merkezi bakımını yapan şirketler, büyük ölçekli uygulamanın gerçek para kazandırdığını sonunda görüyor.

Bu yüzden 23 Nisan'da V4 yayınlandığında Çin-Hong Kong hesaplama gücü zinciri sürekli sıçradı. Sermaye duygusal nedenler için değil, yakında yaşanaacak “binlerce sektörün özel dağıtımı dalgası” için önceden konumlanıyor.

Bu, temeldeki ticari stratejidir.

Sonuç: Çekilme ve kayalar

Bu çılgın otuz gün, on bir büyük model, gürültülü bir ateş işi gösterisi gibi.

Büyükler, parametrelerin ringinde birbirlerine büyüklerle sallanıyor ve rakiplerini hesaplama gücüyle yere yığılmaya çalışıyorlar. Ancak gürültü geçtikten sonra, endüstrinin coğrafyasını değiştirebilecek olan, en gürültülü olan değil, sıklıkla diğerleri oluyor.

DeepSeek V4'ün ortaya çıkışı, sakin bir katil gibi. Kimin daha çok para harcadığını kıyaslamaz, sadece en acı veren zayıf noktada bıçaklar: gereksiz video belleğini kaldırır, dağıtım engelini düşürür ve üst düzey oyunu halka açar.

KuCoin

Rüzgâr her zaman geri çekilmektedir; çekildikten sonra, kimler çıplak yüzmektedir, kimin ise dayanılmaz bir kayalık olduğu belli olur.

V4, tüm kişilere silahları dağıttı. Şimdi, her bir hanedanın bu yeni topraklarda kamp kurma şekli görülecek.

Bu katmanı anladıktan sonra, sürekli "şok edici duyuru" veya "yeniden tanımlama" gibi gürültülere kulak verirken, biraz daha hafif ve endişesiz olabilirsiniz.

Sonuçta, ne kadar görkemli bir sihir olsa da, nihayetinde hesap defterine düşer ve birkaç küçük gümüş para hesaplanır.

Kaynak:

- DeepSeek V4 Serisi Önizlemesi Resmi Yayınlandı, DeepSeek Takımı, GitHub/ModelScope/HuggingFace. (2026).

- Nisan AI Yükselişi: 30 Günlük Büyük Model Döngüsünü Analiz Etme, ME Haber Pazar Gözlemcisi. (2026).

- Ölçek Kanunları ve Eğitim Sonrası Paradigma Değişimi, Yapay Zeka Ekonomisi Dergisi. (2026).

- Global Bilişim Tedarik Zinciri Pazar Nokta Raporu (Nisan 2026), Pan-Asya Finansal Veri Analitiği. (2026).