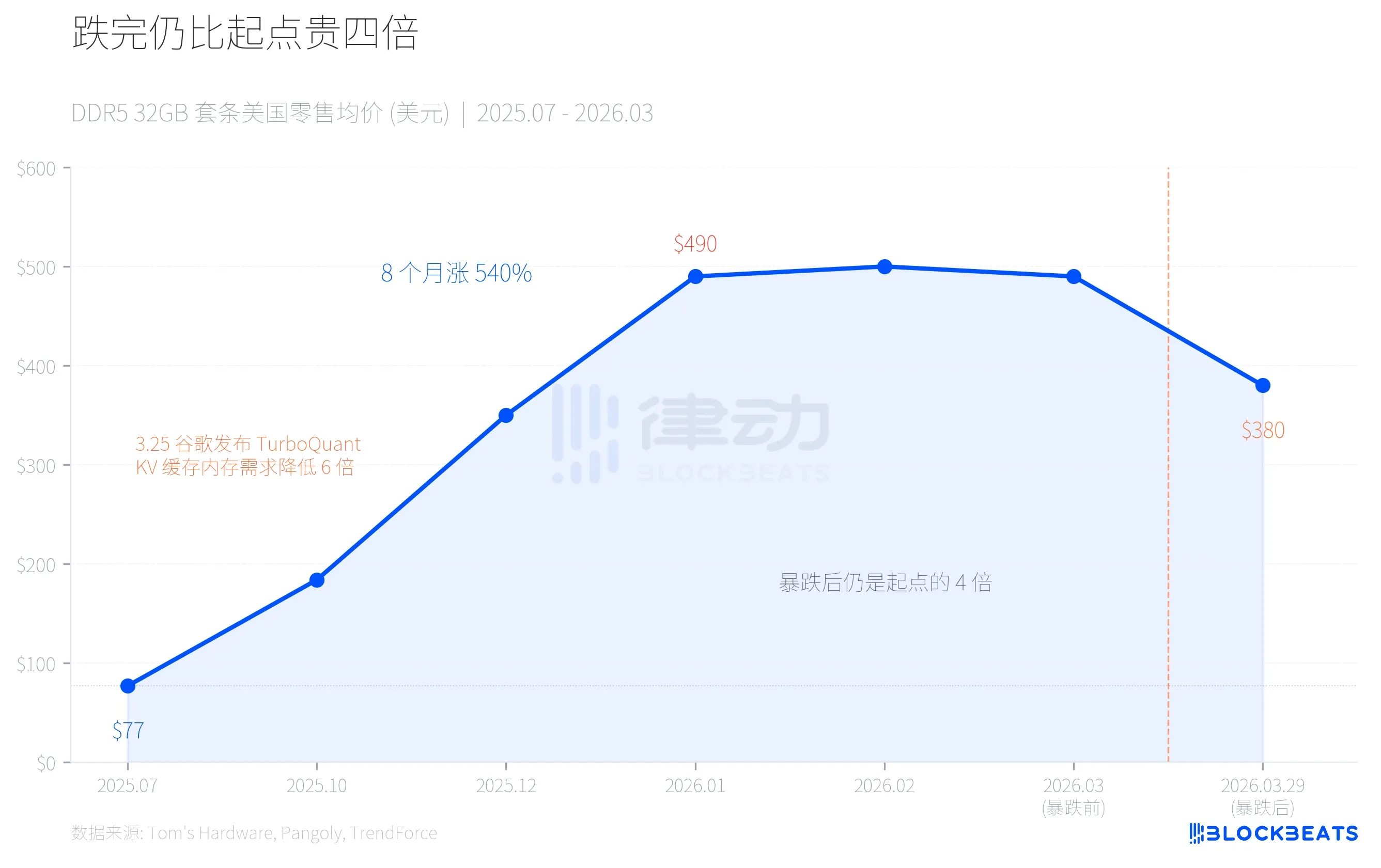

29 Mart'ta, Huaqiangbei ve ABD perakende pazarı, bellek modülleri fiyatlarında ani bir düşüş yaşadı. Corsair 32 GB DDR5-6400 seti 490 dolarlardan 380 dolara düştü ve günlük düşüş %22 oldu. Yerel piyasada 32 GB DDR5 yüksek frekanslı setler bir haftada 800 yuan düşüş yaşadı, dağıtım zinciri panikle satış yaptı ve bir distribütör "Bir günde yüzlerce yuan düştü" dedi.

Ancak bu rakam daha uzun bir zaman çizelgesine konduğunda, görüntü tamamen farklı: Düşüş tamamlandığında bile, mevcut DDR5 fiyatı Temmuz 2025 seviyesinin dört katıdır. Bu, AI zinciri üzerindeki kesin bir arz-talep dengesizliğidir; aynı kuvvet önce kıtlık yarattı, ardından aşırı arz korkusunu.

Koşu: Sekiz ayda %540 artış, bir ayda %22 düşüş

Temmuz 2025'te, ABD perakende piyasasında 32 GB DDR5-6000 bir bellek seti sadece 77 dolarla satılıyordu. Ocak 2026'ya gelindiğinde, aynı setin fiyatı 490 dolara yükseldi. Sekiz ay içinde %540'lık bir artış.

Fiyatlardaki artış, tüketicilerin aniden bilgisayarlarını yükseltmesinden kaynaklanmamaktadır. TrendForce verilerine göre, 2026 birinci çeyrekte DRAM sözleşmeli fiyatlar yüzde 90-95 artmış olup, PC DRAM'da artış yüzde 100'ü aşmış ve her ikisi de kayıtlara geçilen en yüksek çeyreklik artışları sağlamıştır. Bunların hepsini harekete geçiren, özel bir bellek türüne yönelik AI altyapı inşaatının yoğun talebidir.

Ardından, 25 Mart'ta Google, TurboQuant adlı bir sıkıştırma algoritması yayınladı. Dört gün sonra, bellek fiyatları çöktü.

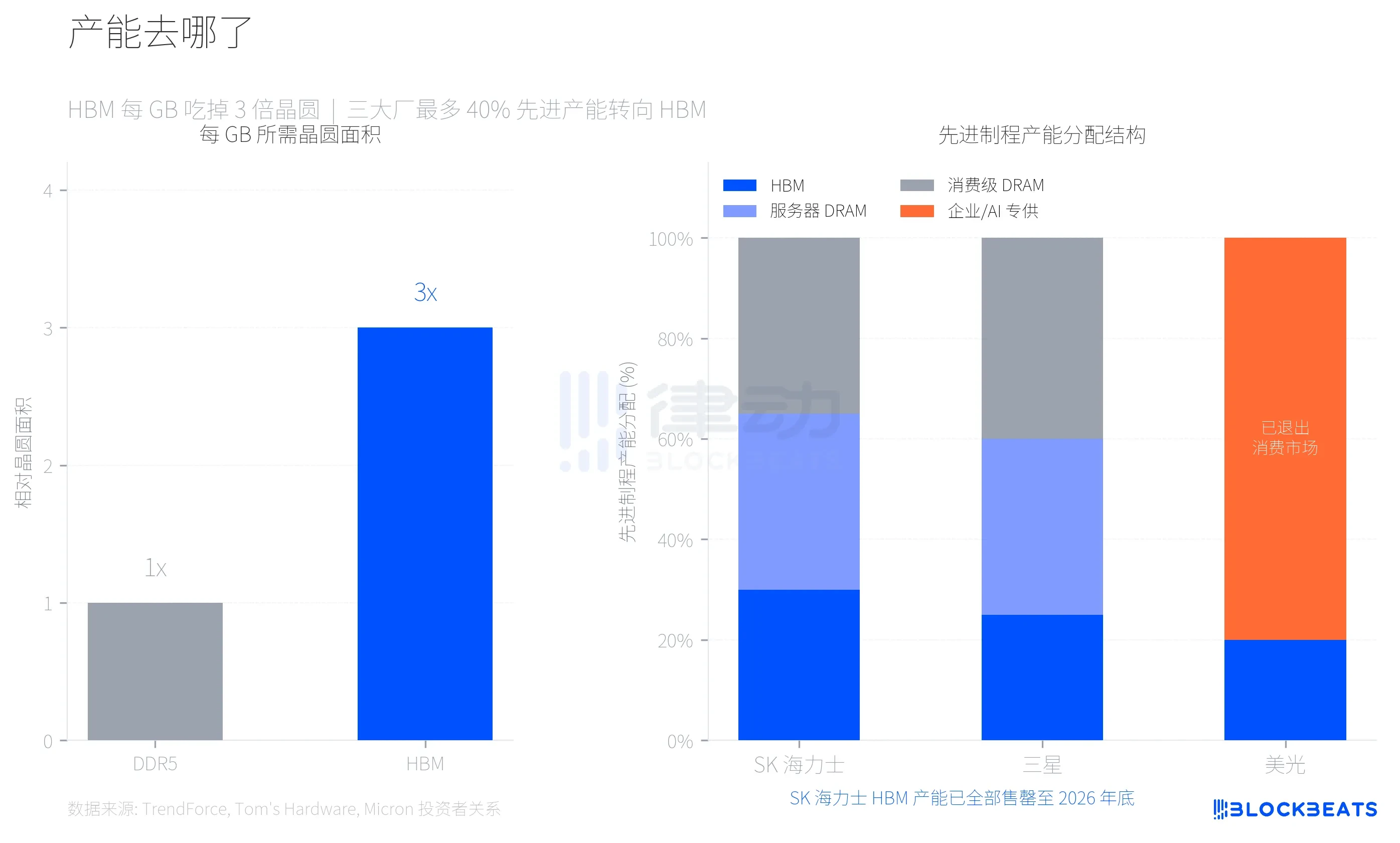

Üretim kapasitesi nereye gitti? HBM, RAM modüllerinizi yuttu

Bu fiyat artışını anlamak için bir teknik parametreyi anlamak gerekir. HBM (yüksek bant genişlikli bellek, NVIDIA AI çipleri için özel bellek), DDR5'in üç katı alan tüketir. Tom's Hardware'e göre, bu, aynı bir çip üzerinde HBM'nin DDR5'in sadece üçte biri kadar kapasite ürettiği anlamına gelir.

Samsung, SK Hynix ve Micron, üç büyük bellek üreticisi, HBM'nin yüksek kar marjına karşı mantıklı bir seçim yaparak ileri üretim prosesinin en fazla %40'ını HBM üretimine yönlendirdi. TrendForce verilerine göre, 2026 birinci çeyrekte DDR5'in kar marjı, HBM3e'yi ilk kez aşacak ve tüketici düzeyi bellek arzının ne kadar sıkıştırıldığını gösterecek.

Micron en agresif seçimi yaptı. 2025 Aralık'ta, bu şirket 29 yıldır faaliyet gösteren tüketici markası Crucial'i kapattı ve tüketiciler için bellek ve depolama pazarından tamamen çekildi; tüm odaklarını kurumsal ve AI müşterilerine kaydırdı. Micron'un yatırımcı ilişkileri duyurusuna göre, 2025 mali yılı toplam geliri 37,38 milyar ABD dolarıydı ve veri merkezleri ve AI uygulamaları toplam gelirin %56'sını oluşturuyordu. Tüketici pazarı, yapılmaya değer değil.

SK Hynix'in HBM üretimi, 2026 yılının sonuna kadar tamamen satılmıştır. Samsung, 2026 yılının sonuna kadar HBM aylık üretim kapasitesini 170.000 wafer'den 250.000 wafer'e çıkarmayı planlıyor. Yeni fabrikalar (Samsung P4L ve SK Hynix M15X), en erken 2027-2028 yıllarında seri üretime başlayabilecek. Başka bir deyişle, tüketici düzeyindeki DRAM tedarik açığı yapısal bir sorundur ve bir veya iki çeyreklik bekleme ile giderilemez.

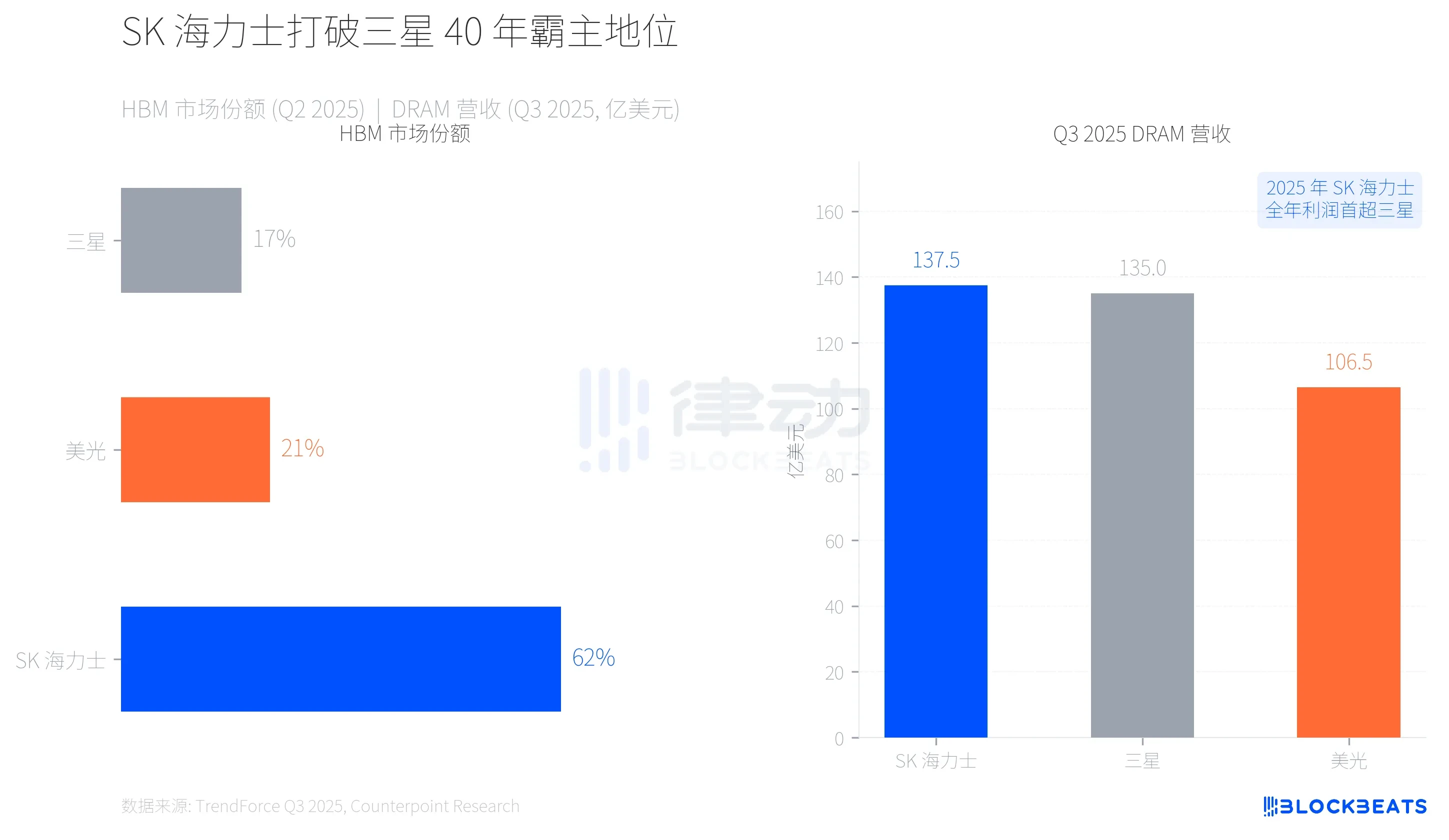

Durum tersine döndü, SK Hynix, Samsung'ın 40 yıllık egemenliğini kırdı

Bu üretim transferi, bellek endüstrisinin güç haritasını yeniden yazdı. TrendForce verilerine göre, 2025 ikinci çeyrekte SK Hynix, NVIDIA ile derin bağ kurarak HBM pazarında %62 paya sahip oldu; Samsung %17, Micron ise %21 paya sahip oldu.

Daha da önemli olan, gelir düzeyindeki dönüşüm. TrendForce'un Q3 2025 raporuna göre, SK Hynix, tek bir çeyreklik DRAM geliriyle 13,75 milyar dolarla ilk kez birinci oldu; Samsung ise 13,5 milyar dolarla ikinci oldu. İkisi arasındaki fark sadece 250 milyon dolar olsa da, bu, Samsung'un yaklaşık 40 yıldır hafıza gelirinde birinci olmaktan çıkarılması anlamına geliyor. CNBC'e göre, SK Hynix'in 2025 yılı yıllık operasyonel karı da ilk kez Samsung'u geçti.

HBM'nin erken avantajı, SK Hynix'e yeterli bir avantaj sağladı, ancak bu yarış henüz sona ermedi. Samsung, HBM4'ün seri üretimini tamamlamak için tam hızla ilerliyor; Micron, tüketici pazarından çekilmiş olsa da, şirket ve AI alanlarındaki gelir artış hızı (Q3'te %53,2 artış) üç üretici arasında en hızlı.

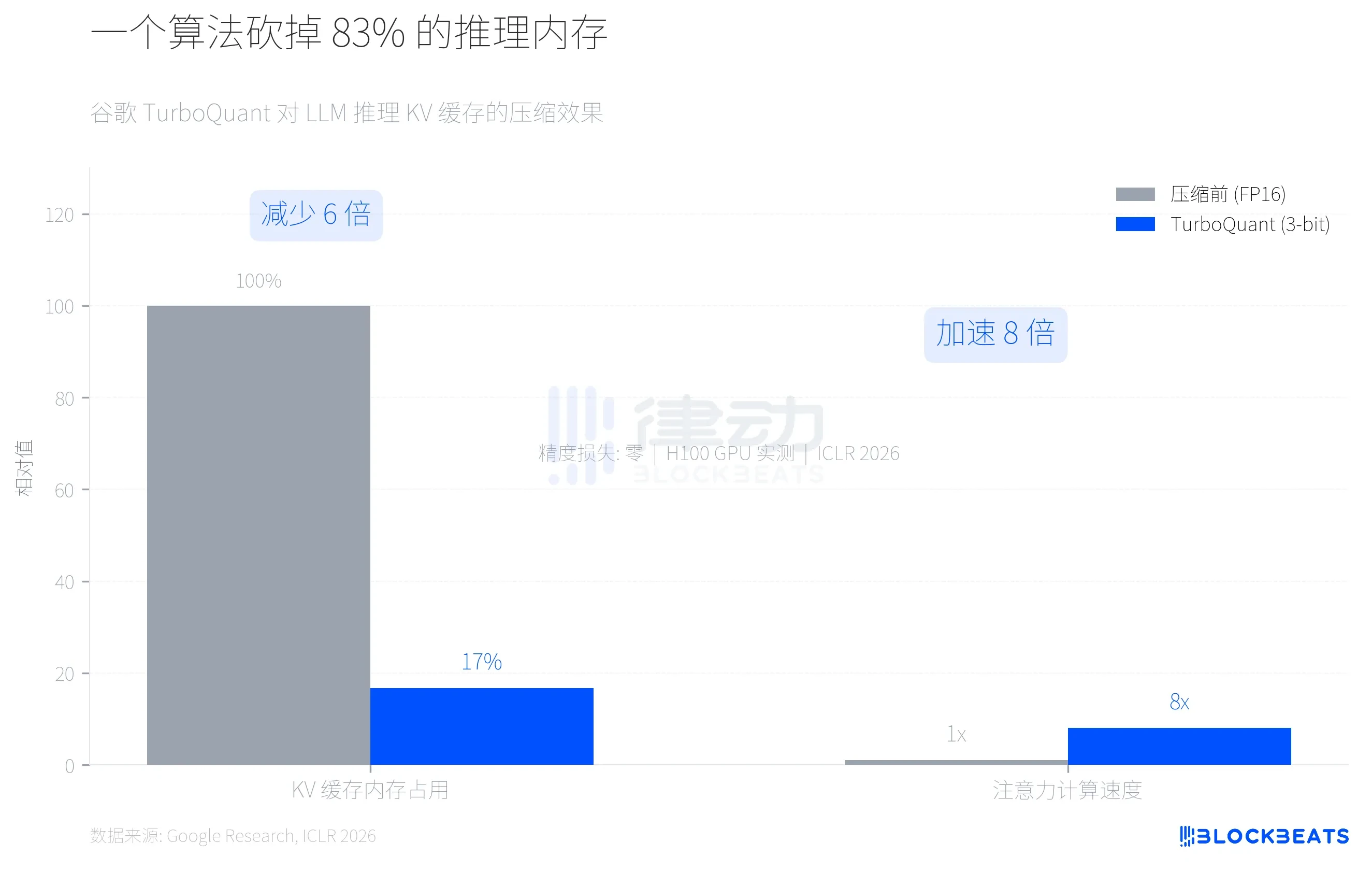

Bir algoritma fiyat artış mantığını nasıl sarstı?

25 Mart'ta Google, ICLR 2026'da TurboQuant algoritmasını duyurdu. Bu algoritma, büyük dil modellerinin çıkarım sırasında en çok bellek tüketen kısmı olan KV önbelleğini (anahtar-değer önbelleği) FP16 hassasiyetinden 3-bit'e sıkıştırarak bellek kullanımını en az 6 kat azaltır ve aynı zamanda H100 GPU'da dikkat hesaplamalarında en fazla 8 kat hızlanma sağlar. Google araştırma bloguna göre, Needle-in-a-Haystack gibi beş uzun bağlam benchmark'ında kesinlik kaybı sıfırdır.

Piyasa hızla bir hesap yaptı. Eğer TurboQuant veya benzeri bir algoritma ana akım AI şirketleri tarafından yaygın olarak benimsenirse, AI çıkarımı için DRAM'a olan artı talep büyük ölçüde azalacaktır. Geçen yarım yılda hafıza fiyatlarındaki yükselişi destekleyen temel hikaye, "AI altyapısının çok fazla hafıza üretimi tükettiği" idi.

Dört gün sonra, kanal güveni çöktü.

TürboQuant'un hedefi, eğitim tarafındaki HBM talebi değil, AI çıkarım tarafındaki KV önbelleğidir. HBM'nin arz-talep dengesi, kısa sürede bir çıkarım optimizasyon algoritması nedeniyle değişmeyecektir. Ancak pazar her zaman bunları ayırt etmez. Sina Finance'e göre, düşüşün başlangıcında yerel kanallar fiyat artışından dolayı dışarıdan büyük miktarda stok alıcı çekmişti; yüksek fiyatlar nedeniyle perakende satışlar %60'tan fazla düştü ve nakit akışı sorunları nedeniyle zincirleme satışlar düşüşü artırdı.

Bir AI zinciri, aynı anda bellek kıtlığı ve fazlalık korkusunu yarattı. HBM'nin fiziksel üretim kapasitesi daralması, tüketici düzeyi bellek talebini arzın altında bıraktı; TurboQuant'un algoritmik verimlilik atılımı ise AI bellek talebi beklentisini ani şekilde düşürdü. Fiyat artışını ve çöküşü yaratan, aynı güçtür.