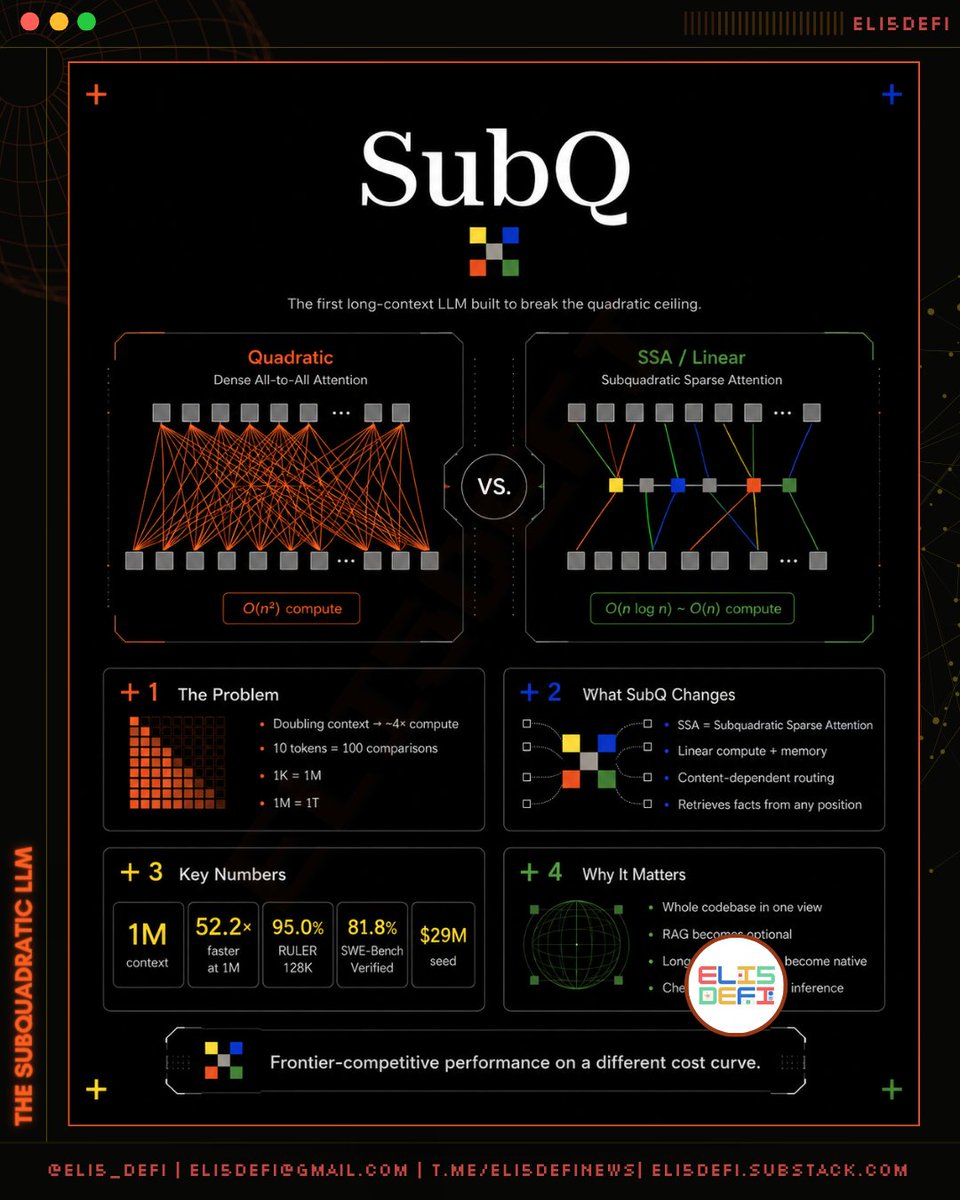

บริษัทปัญญาประดิษฐ์ใหม่ชื่อ @subquadratic เพิ่งเปิดตัวโมเดลที่ทำลายข้อจำกัดหนึ่งที่เก่าแก่ที่สุดในปัญญาประดิษฐ์สมัยใหม่ เพื่อเข้าใจว่าทำไมมันถึงสำคัญ คุณต้องเข้าใจปัญหาคณิตศาสตร์เดียวที่กำลังรูปแบบทุกแชทบอทที่คุณเคยใช้ - ➠ ปัญหา: AI อ่านเป็นคู่ และคู่ไม่สามารถขยายขนาดได้ LLM สมัยใหม่ทุกตัว (ChatGPT, Claude, Gemini) อ่านข้อความโดยตรวจสอบว่าแต่ละคำเกี่ยวข้องกับคำอื่นๆ ทั้งหมดอย่างไร ฟังดูโอเค จนกว่าคุณจะคำนวณ: ▸ 10 คำ → 100 การเปรียบเทียบ ▸ 1,000 คำ → 1 ล้านการเปรียบเทียบ ▸ 1 ล้านคำ → 1 ล้านล้านการเปรียบเทียบ การเพิ่มอินพุตเป็นสองเท่า ไม่ได้เพิ่มงานเป็นสองเท่า แต่เพิ่มเป็นสี่เท่า นี่เรียกว่าการขยายแบบกำลังสอง และถูกฝังไว้ใน AI ตั้งแต่ปี 2017 สิ่งที่หมายถึงสำหรับคุณ: ▸ เอกสารยาวกลายเป็นค่าใช้จ่ายสูงอย่างรวดเร็ว ▸ โมเดลมักพลาดข้อเท็จจริงที่ซ่อนอยู่ลึกในอินพุตที่ยาว ▸ โค้ดทั้งชุดหรือห้องสมุดวิจัยไม่สามารถจัดเก็บได้ ตอนนี้คุณรู้แล้วว่าทำไมยิ่งบริบทยาวเท่าไร โมเดล LLM ของคุณยิ่งดูโง่และแพงขึ้นเท่านั้น - ➠ วิธีที่ AI สมัยใหม่ซ่อนปัญหานี้ อุตสาหกรรมสร้างทางเลี่ยงแทนการแก้ไขคณิตศาสตร์: ▸ RAG: เครื่องมือค้นหาดึงข้อความย่อยที่เกี่ยวข้องไม่กี่ชิ้น ส่งเฉพาะส่วนเหล่านั้นให้โมเดล ▸ Chunking: เอกสารยาวถูกตัดเป็นชิ้นเล็กๆ ▸ ระบบตัวแทน: การเรียกใช้งาน AI หลายครั้งจัดการส่วนต่างๆ และเชื่อมต่อกันด้วยโค้ด ▸ FlashAttention: เทคนิคหน่วยความจำอัจฉริยะที่ทำให้การคำนวณที่แพงเดิมทำงานเร็วขึ้น สิ่งเหล่านี้ใช้งานได้ แต่ไม่มีอะไรแก้ปัญหาหลักจริงๆ ทั้งระบบนิเวศ AI สมัยใหม่ (ฐานข้อมูลเวกเตอร์, ท่อการดึงข้อมูล, การออกแบบพรอมต์) มีอยู่เพราะโมเดลไม่สามารถจับภาพทั้งหมดได้ — ➠ SubQ ทำแตกต่างอย่างไร SubQ ใช้วิธีใหม่ชื่อ SSA (Subquadratic Sparse Attention) แนวคิดในหนึ่งประโยค: แทนที่จะเปรียบเทียบทุกคำกับทุกคำอื่นๆ โมเดลจะระบุว่าคำไหนสำคัญจริงๆ กับคำถาม และละเว้นส่วนที่เหลือ สิ่งนี้เปลี่ยนการขยายจากแบบกำลังสองเป็นเชิงเส้น การเพิ่มอินพุตเป็นสองเท่าตอนนี้ทำให้งานเพิ่มเป็นสองเท่าแทนที่จะเป็นสี่เท่า ส่วนยากไม่ใช่แนวคิด เพราะเคยมีคนลองมาก่อนแล้ว ความพยายามก่อนหน้านี้ทุกครั้งต้องแลกด้วยบางอย่าง: ความแม่นยำ, ความสามารถในการหาข้อเท็จจริงที่ซ่อนอยู่ไกลๆ ในข้อความ, หรือประสิทธิภาพเอง Subquadratic ซึ่งร่วมก่อตั้งโดย @alex_whedon อ้างว่าพวกเขาแก้ไขทั้งสามอย่างได้พร้อมกันเป็นครั้งแรก — ➠ เอกสารยืนยัน ผลการทดสอบจากภายนอก: ▸ เสมอกับ Claude Opus 4.6 ใน RULER 128K (การทดสอบเหตุผลบริบทยาว) ▸ เหนือ Opus 4.7, GPT 5.4 และ Gemini 3.1 Pro ใน MRCR v2 (การดึงข้อมูลจากหลักฐานหลายชุด) แต่แพ้ Opus 4.6 และ GPT 5.5 ▸ เหนือ Opus 4.6 และ Gemini 3.1 Pro ใน SWE-Bench (งานเขียนโค้ดจริง) แต่ตามหลัง Opus 4.7 ▸ เร็วกว่า FlashAttention 52 เท่าที่ 1 ล้านโทเค็น ▸ เวอร์ชันวิจัยจัดการได้ถึง 12 ล้านโทเค็น โดยใช้การคำนวณการให้ความสนใจน้อยกว่าอีกโมเดลชั้นนำประมาณ 1,000 เท่า สรุปสั้นๆ: สิ่งนี้ไม่ใช่ “โมเดลที่ดีที่สุดในโลก” แต่เป็นความแม่นยำระดับชั้นนำในต้นทุนพื้นฐานที่ถูกกว่ามาก — ➠ ส่วนของ Sam Altman เข้ามาเกี่ยวข้องอย่างไร คำกล่าวสองข้อใหญ่ของ Altman พุ่งตรงไปยังปัญหาเดียวกันกับที่ SubQ กำลังแก้ เรื่องต้นทุน: ในโพสต์บล็อกเดือนกุมภาพันธ์ 2025 เรื่อง Three Observations Altman เขียนว่าต้นทุนการใช้งาน AI ลดลงประมาณ 10 เท่าทุกๆ 12 เดือน เขาเรียกสิ่งนี้ว่า “แข็งแกร่งกว่ามาก” กว่ากฎหมายของมัวร์ เขาเชื่อว่าการลดต้นทุนการประมวลผลคือแรงขับเคลื่อนหลักที่กำหนดว่า AI จะกลายเป็นอะไร เรื่องขนาด: ย้อนกลับไปปี 2023 Altman เคยกล่าวว่ายุคของโมเดลใหญ่ขึ้นเรื่อยๆ สิ้นสุดลงแล้ว และการแข่งขันจริงอยู่ที่ความสามารถต่อเหรียญ เขาเปรียบเทียบการแข่งขันจำนวนพารามิเตอร์กับการแข่งขันความถี่ GHz ในชิปยุคปี 90s — มุมผิด SubQ เอาเงินเดิมพันสองข้อนี้มาใช้อย่างจริงจัง สโลแกนของพวกเขาคือ “ประสิทธิภาพคือปัญญา” แต่มีเงื่อนไข: เส้นทางของ Altman สู่ AI ราคาถูกกว่าคือความก้าวหน้าของฮาร์ดแวร์ การปรับปรุงซอฟต์แวร์ และการลดขนาดโมเดล เขายังไม่เคยสนับสนุนอย่างเปิดเผยให้มีการออกแบบสมการการให้ความสนใจใหม่ ดังนั้น การเสนอของ SubQ สอดคล้องกับเศรษฐศาสตร์ของเขา แต่มันยังเป็นการเดิมพันว่าห้องแล็บใหญ่ๆ เหล่านี้ละเลยโอกาสทางสถาปัตยกรรมไว้อย่างหนึ่ง — ➠ เพราะเหตุใดจึงสำคัญ หาก SubQ ส่งมอบได้ในระดับผลิตจริง: ▸ โค้ดเบสทั้งหมดในบทสนทนาระยะเดียว — ไม่จำเป็นต้องใช้ระบบตัวแทนหลายตัวจัดการไฟล์ — โมเดลเก็บรีโพสitoryทั้งหมดไว้ได้ ▸ RAG จะกลายเป็นทางเลือก — พื้นฐาน AI ส่วนใหญ่ในปัจจุบันมีอยู่เพื่อชดเชยขีดจำกัดแบบกำลังสอง — เมื่อเอาขีดจำกัดออก ส่วนเสริมเหล่านี้จะกลายเป็นภาระ ▸ การใช้งานตัวแทนระยะยาวจะไม่ใช่วิธีแก้ชั่วคราว — การสนทนานานหลายวันพร้อมหน่วยความจำถาวรจะกลายเป็นฟีเจอร์พื้นฐาน ▸ เกิดแอปใหม่ๆ — การทำงานที่เคยแพงเกินไป (การตรวจสอบเอกสารเต็มชุด, การค้นหาโค้ดอย่างละเอียด, การสแกนความสอดคล้อง) จะกลายเป็นเรื่องธรรมดา — ➠ ข้อจำกัดอย่างตรงไปตรงมา ▸ มันอยู่ในช่วงเบต้าเฉพาะกลุ่ม — ความเชื่อถือได้ในโลกจริงยังไม่ได้รับการทดสอบอย่างเข้มข้น — ดังนั้นจนกว่าจะถึงเวลานั้นให้มองประกาศนี้เป็นเพียงตัวอย่างเบื้องต้น เพราะหลายคนสงสัยว่านี่อาจเป็นเพียงการแสดงออกเพื่อสร้างภาพเท่านั้น ▸ คะแนน MRCR v2 (65.9%) เป็นผลดีแต่ยังตามหลัง Opus 4.6 (78.3%) และ GPT 5.5 (74%) — SSA มีประสิทธิภาพมากกว่าแต่ไม่ได้มีความสามารถเหนือกว่าโดยตรง ▸ การทดสอบผลลัพธ์เผยแพร่โดยผู้พัฒนาเองพร้อมการยืนยันจากภายนอก — การทำซ้ำทางวิชาการคือการทดสอบจริง ▸ ผลลัพธ์ 12 ล้านโทเค็นเป็นโมเดลวิจัยไม่ใช่ผลิตภัณฑ์จริง (ซึ่งอยู่ที่ 1 ล้าน) — ➠ สรุป ตลอดเก้าปีที่ผ่านมา AI แบบ transformer ทุกตัวต้องจ่ายภาษีแบบกำลังสองเหมือนกัน Subquadratic อ้างว่าพวกเขาพบทางออกครั้งแรกแล้ว — การทดสอบแสดงว่าพวกเขาอยู่ในทางที่ถูกต้องอย่างน้อยก็ในเชิงแนวโน้ม Altman พูดกับอุตสาหกรรมมาสามปีแล้วว่า “ความสามารถต่อเหรียญ” เป็นสนามรบใหม่ — SubQ เป็นหนึ่งในบริษัทแรกๆ ที่พยายามชนะการแข่งขันนี้โดยเปลี่ยนคณิตศาสตร์พื้นฐานแทนการสะสมทางเลี่ยง ตอนนี้คำถามสำคัญกลายเป็นคำถามเชิงประจักษ์สาธารณะแล้ว

แชร์

แหล่งที่มา:แสดงต้นฉบับ

คำปฏิเสธความรับผิดชอบ: ข้อมูลในหน้านี้อาจได้รับจากบุคคลที่สาม และไม่จำเป็นต้องสะท้อนถึงมุมมองหรือความคิดเห็นของ KuCoin เนื้อหานี้จัดทำขึ้นเพื่อวัตถุประสงค์ในการให้ข้อมูลทั่วไปเท่านั้น โดยไม่มีการรับรองหรือการรับประกัน และจะไม่ถูกตีความว่าเป็นคำแนะนำทางการเงินหรือการลงทุน KuCoin จะไม่รับผิดชอบต่อความผิดพลาดหรือการละเว้นในเนื้อหา หรือผลลัพธ์ใดๆ ที่เกิดจากการใช้ข้อมูลนี้

การลงทุนในสินทรัพย์ดิจิทัลอาจมีความเสี่ยง โปรดประเมินความเสี่ยงของผลิตภัณฑ์และความเสี่ยงที่คุณยอมรับได้อย่างรอบคอบตามสถานการณ์ทางการเงินของคุณเอง โปรดดูข้อมูลเพิ่มเติมได้ที่ข้อกำหนดการใช้งานและเอกสารเปิดเผยข้อมูลความเสี่ยงของเรา