Модели становятся всё больше, и доминирующее мнение гласит, что чем больше параметров у модели, тем ближе она становится к способу мышления человека. Однако команда из Цзяньдзянского университета в статье, опубликованной 1 апреля в Nature Communications, выдвигает иное мнение (оригинал статьи: https://www.nature.com/articles/s41467-026-71267-5). Они обнаружили, что при увеличении размера моделей (в основном SimCLR, CLIP, DINOv2) способность распознавать конкретные объекты действительно продолжает улучшаться, но способность понимать абстрактные концепции не только не растёт, а даже снижается. Когда количество параметров увеличилось с 22,06 миллиона до 304,37 миллиона, точность выполнения задач по конкретным концепциям выросла с 74,94% до 85,87%, а по абстрактным концепциям — снизилась с 54,37% до 52,82%.

Различия в способах мышления человека и модели

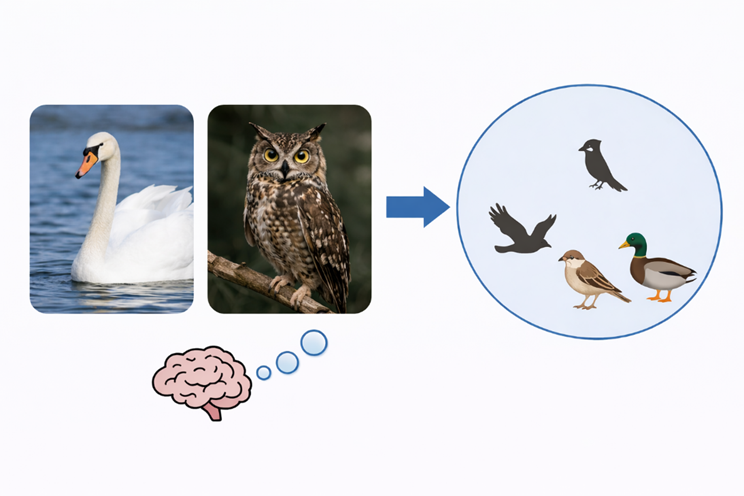

При обработке концепций человеческий мозг сначала формирует систему классификационных отношений. Лебедь и сова выглядят по-разному, но люди всё равно относят их к категории птиц. Далее, птицы и лошади могут быть объединены в более широкую категорию — животные. Когда человек сталкивается с чем-то новым, он обычно сначала думает, на что это похоже из того, что уже видел раньше, и к какой категории, вероятно, относится. Люди постоянно учатся новым концепциям, организуют свой опыт и используют эту систему отношений для распознавания новых вещей и адаптации к новым ситуациям.

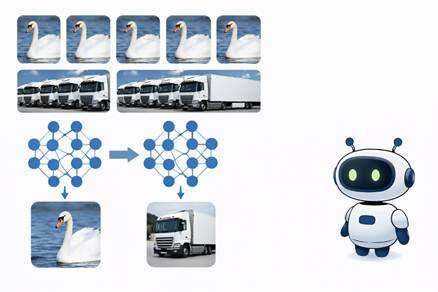

Модели также классифицируют, но делают это иным способом. Они в основном опираются на повторяющиеся формы в крупных объемах данных. Чем чаще встречается конкретный объект, тем легче модель его распознает. На уровне более крупных категорий модели испытывают больше трудностей. Им нужно выявить общие черты между несколькими объектами и отнести эти общие черты к одной категории. У существующих моделей здесь все еще есть явные недостатки. При дальнейшем увеличении параметров задачи, связанные с конкретными понятиями, улучшаются, а задачи, связанные с абстрактными понятиями, иногда ухудшаются.

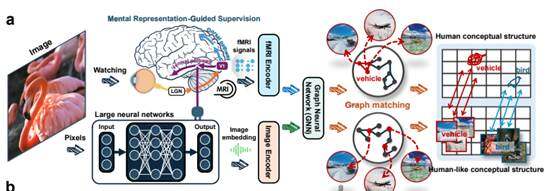

Мозг человека и модели имеют общее то, что внутри формируют систему классификационных отношений. Однако их акценты различаются: высшие визуальные области мозга человека естественно разделяют объекты на крупные категории, такие как живое и неживое, тогда как модель может различать конкретные объекты, но с трудом стабильно формирует такие более крупные классы. Это различие приводит к тому, что мозг человека легче переносит прошлый опыт на новые объекты, поэтому мы быстро классифицируем незнакомые вещи. В то время как модель больше полагается на существующие знания и при столкновении с новыми объектами склонна останавливаться на поверхностных признаках. Предложенный в статье метод основан именно на этой особенности: он использует сигналы мозга для ограничения внутренней структуры модели, чтобы сделать её классификационный подход более близким к человеческому.

Решение команды Цзяньдэ

Предложенное командой решение также уникально: вместо дальнейшего увеличения параметров используется небольшое количество сигналов мозга в качестве надзора. Эти сигналы мозга получены из записей активности мозга человека при просмотре изображений. В оригинале статьи говорится, что human conceptual structures передаются DNNs. Это означает, что модели максимально стараются передать, как человеческий мозг классифицирует, обобщает и группирует схожие понятия.

Команда провела эксперименты с 150 известными обучающими категориями и 50 новыми тестовыми категориями. Результаты показали, что по мере продвижения обучения расстояние между моделью и нейронными представлениями мозга постоянно сокращается. Это изменение наблюдалось в обоих категориях, что свидетельствует о том, что модель учится не отдельным образцам, а действительно начинает осваивать способ организации концепций, более близкий к тому, как это делает человеческий мозг.

После этой тренировки модель продемонстрировала более сильные способности к обучению при малом количестве примеров и лучшую производительность при столкновении с новыми ситуациями. В задаче, где модели давали лишь несколько примеров и требовалось различать абстрактные понятия, такие как живое и неживое, модель в среднем улучшила результат на 20,5% и превзошла контрольные модели с гораздо большим количеством параметров. Команда также провела еще 31 специализированную проверку, в которых все категории моделей показали повышение примерно на 10%.

В последние годы отрасль моделей следовала пути увеличения масштаба моделей. Команда Чжэцзянского университета выбрала другой путь — от «чем больше, тем лучше» к «чем структурированнее, тем умнее». Расширение масштаба действительно полезно, но в основном повышает производительность на знакомых задачах. Абстрактное понимание и способность к переносу, присущие человеку, также крайне важны для ИИ, и в будущем структура мышления ИИ должна стать более близкой к структуре человеческого мозга. Ценность этого направления заключается в том, что она возвращает внимание отрасли от простого расширения масштаба к самой когнитивной структуре.

Neosoul и будущее

Это открывает более широкую возможность: эволюция ИИ может происходить не только на этапе обучения модели. Обучение модели определяет, как ИИ организует концепции и формирует структуры более качественных суждений. Однако после выхода в реальный мир начинается другой уровень эволюции ИИ: как регистрируются, проверяются и постоянно совершенствуются суждения ИИ-агентов в условиях реальной конкуренции, подобно тому, как люди обучаются и эволюционируют самостоятельно. Именно этим и занимается Neosoul. Neosoul не просто заставляет ИИ-агентов генерировать ответы, а включает их в систему постоянного прогнозирования, проверки, расчета и отбора, чтобы они постоянно оптимизировали себя на основе прогнозов и результатов, сохраняя лучшие структуры и отбрасывая худшие. Команда Цзяньдаси и Neosoul на самом деле стремятся к одной и той же цели: заставить ИИ не просто решать задачи, а обладать всесторонними мыслительными способностями и постоянно эволюционировать.