Автор: Anita, руководитель Sentient в Азиатско-Тихоокеанском регионе

Война в Иране выбросила крупные модели из лаборатории прямо на поле боя.

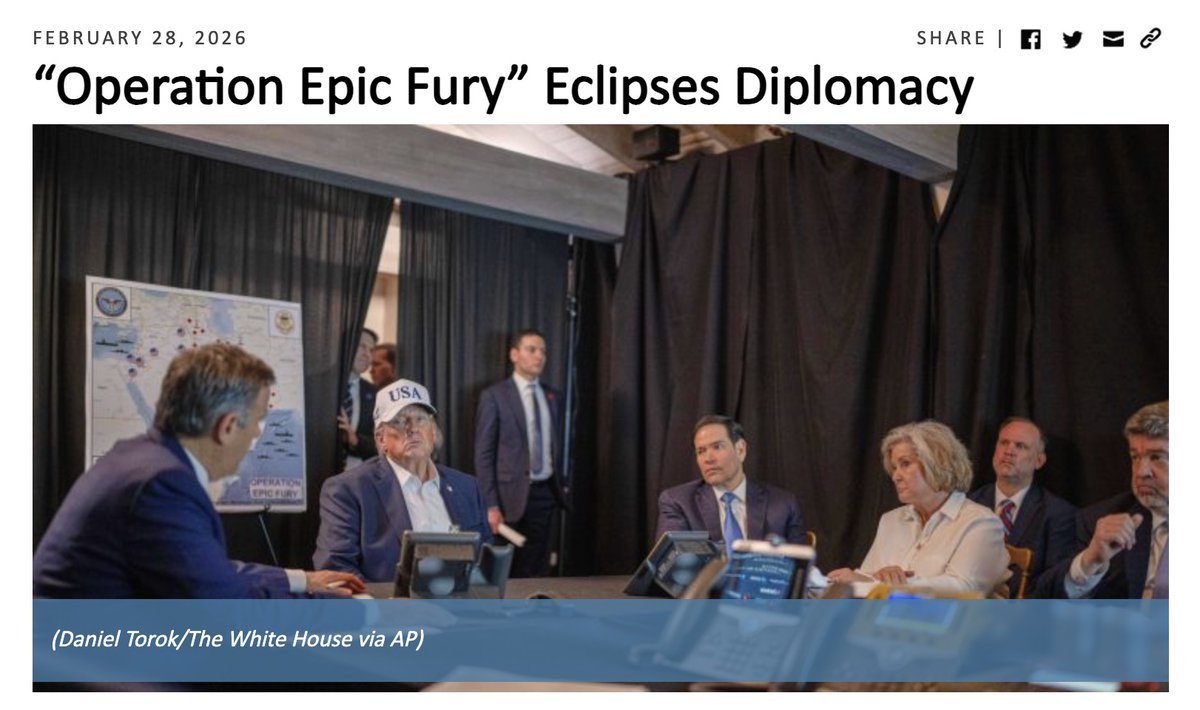

Операция «Epic Fury» в конце февраля 2026 года была не просто совместным авиаударом, а скорее тестом ИИ на реальном поле боя: тот, кто сможет сжать цепочку «сенсоры — принятие решения — стрелок» до минут или даже секунд, получит контроль над ценообразованием следующего раунда геополитики.

I. Epic Fury: Первая «AI-война полного стека»

В ходе этой операции американские и израильские официальные источники заявили, что целенаправленные удары по ключевым военным и ядерным объектам Ирана «достигли стратегического успеха» и неоднократно намекали, что верховный лидер Ирана Хаменеи, скорее всего, погиб в результате атаки на подземный командный центр на севере Тегерана — однако иранская сторона долгое время отказывается давать четкое подтверждение его смерти или выживания, превращая эту «декапитацию» в игру вокруг авторитетного нарратива.

С операционной точки зрения, особенность Epic Fury заключается не в продолжительности, а в плотности: интенсивные воздушные удары, атаки дронов-роями, специальные операции и кибервойна, чередующиеся в течение десяти дней, основаны на высоко программированной боевой стеке — платформе Palantir для онтологии поля боя и цифровых двойников, системе интеграции разведданных американских оборонных агентств, инструментах автоматической генерации целей Израиля, дополненных новой ролью передовых компаний крупных моделей, таких как OpenAI.

Эта война стала символическим переломным моментом: начиная с этого момента, «участие ИИ в военных решениях» больше не является модным словом из презентаций Пентагона, а стало реальным источником денежных потоков и политических рисков, которые невозможно игнорировать на рынке, в регулировании и в этических дебатах.

Два: OpenAI — от «Декларации этики» до самого дорогого SaaS-подписки в Министерстве обороны

За короткие два-три года публичная позиция OpenAI претерпела великолепный поворот.

От дистанцирования от «военных целей» до признания возможности поддержки проектов национальной безопасности и обороны при соблюдении принципов безопасности, а также получения, возможно, самого чувствительного клиентского контракта этого времени.

В феврале 2026 года, примерно 27-го числа, Сэм Альтман объявил, что компания заключила соглашение с Министерством обороны США о развертывании моделей серии GPT на секретной сети для использования в «оборонных сценариях», таких как анализ разведданных, перевод и военные учения. В некоторых публичных материалах и СМИ это традиционное Министерство обороны намеренно называлось «Department of War», символически возвращаясь к более агрессивной военной лексике, хотя юридически название учреждения остается Department of Defense.

Опубликованные материалы выделяют три основные «красные линии»:

Не участвуем в массовом наблюдении в пределах США;

Не использовать полностью автономные смертоносные системы оружия без прямого управления; применение силы должно оставаться под контролем человека;

Сохраняйте человеческий контроль и ответственность при принятии решений с высоким уровнем риска.

Эти принципы являются как этической позицией OpenAI перед общественностью, так и рычагом переговоров в контрактных обсуждениях — они передают Вашингтону сигнал: эта компания готова сотрудничать, но хочет сотрудничать «в контролируемых пределах». nytimes+1

Какую роль играют эти модели в таких реальных условиях, как Epic Fury? Публичная информация ограничится безопасными описаниями — помощь в обработке разведданных, анализ сложных данных, помощь принимающим решения быстрее формировать картину ситуации.

Но с точки зрения технических характеристик, подача огромного объема спутниковых изображений, сигналов разведки и потоков социальных сетей в крупные модели, а затем их сортировка, прогнозирование маршрутов и оценка рисков потенциальных «высокоценных целей», по сути, очень близка к « Battlefield Brain ».

Для Уолл-стрит значение этого соглашения очень очевидно.

После того как Anthropic была классифицирована Пентагоном как «риск для цепочки поставок» из-за соблюдения более жестких границ, OpenAI приняла этот многомиллиардный оборонный контракт, который крайне сложно оспорить конкурентам, сделав этически ограниченные уступки и получив огромную коммерческую выгоду.

Три: Anthropic — «принципиалист», колеблющийся на грани оборонного бюджета

В резком контрасте с «практичным» подходом OpenAI находится положение Anthropic: изначально она также считалась одним из самых ценных поставщиков передовых моделей для Пентагона, но из-за отказа отступать на красных линиях была исключена из всей системы крайне грубым образом.

Несколько СМИ сообщили, что Anthropic проявила жесткую позицию по двум пунктам в переговорах с Министерством обороны:

Клауд не участвует в полностью автономных системах вооружения;

Claude не участвует в массовом наблюдении и профилировании граждан США.

А требования Пентагона ближе к тому, чтобы никакие законные применения не должны заранее ограничиваться поставщиками моделей.

После провала переговоров министр обороны Пит Хегсетт объявил после истечения срока, что Anthropic включена в список «рисков цепочки поставок» для национальной безопасности, и потребовал от всех подрядчиков, сотрудничающих с вооруженными силами, завершить миграцию с Claude в течение шести месяцев. Такая маркировка ранее применялась преимущественно к компаниям из стран-соперников, таким как Huawei, и теперь впервые была применена к американской стартап-компании в области ИИ, что вызвало дискуссии о «эффекте молчания» в Силиконовой долине.

Внутренняя оценка Пентагона показывает, что полная замена крупных языковых моделей, встроенных в секретные системы, может занять несколько месяцев, что означает высокую степень перекрытия между сроком вступления в силу запрета и временным окном Epic Fury.

Исходя из технической реальности, Claude, скорее всего, до того, как был вынужден уйти под административным распоряжением, все еще участвовал в работе по национальной безопасности США, однако никто не захотел четко раскрыть эту связь на слушаниях — это типичная «серая зона» современного военно-промышленно-технологического комплекса.

На финансовых рынках читается простой, но опасный урок: когда «безопасные границы» вступают в конфликт с «максимизацией оборонных заказов», компания, которая готова идти на переговоры, часто оказывается более безопасным инвестиционным активом; в то время как компании, придерживающиеся принципов, могут за одну ночь получить ярлык «риска цепочки поставок» и столкнуться с пересмотром оценки инвесторами.

Четвертый: настоящий центральный нервный узел: Microsoft, Google и «военно-промышленный комплекс в облаке»

Если OpenAI и Anthropic — это «мозг» в войне, то Microsoft и Google — настоящая центральная нервная система этой системы:

Без их облака все крупные модели и локальные инструменты ИИ останутся лишь на уровне презентаций.

Microsoft Azure: от офисного облака до операционной системы цепочки поражения

AP и несколько организаций провели расследование, согласно которому с октября 2023 года масштаб использования израильской армией инструментов машинного обучения на Azure увеличился в десятки раз за несколько месяцев, достигнув максимума в 64 раза, а общее количество вызовов функций ИИ приблизилось к 200-кратному уровню.

Meanwhile, large-scale data storage has reached a scale equivalent to that of the Library of Congress.

Эти вычислительные мощности используются для транскрипции и перевода большого объема коммуникаций, обработки сигналов разведки из инфраструктуры наблюдения и взаимодействия с израильскими ИИ-системами (такими как Lavender и Gospel) для автоматической генерации списков целей и оценок рисков, что значительно повысило пропускную способность «линии производства целей».

Хотя Microsoft позже сократила услуги для некоторых израильских военных подразделений (особенно связанных с наблюдением) под давлением общественного мнения и сотрудников, основные контракты на облачные технологии и ИИ остаются в силе, что принесло компании крупные коммерческие заказы, но также нанесло значительный ущерб репутации.

Google Project Nimbus: самый политически рискованный военный облако

С 2021 года Google и Amazon через проект Nimbus предоставляют израильскому правительству и армии унифицированную облачную инфраструктуру на сумму около 1,2 млрд долларов США, включающую вычислительные ресурсы, хранилища и инструменты машинного обучения. Сотрудники, ученые и правозащитные организации продолжают предупреждать:

Универсальные облачные и ИИ-возможности Nimbus легко могут использоваться для наблюдения и выбора военных целей, несмотря на то, что Google официально подчеркивает, что контракт «не включает наступательные военные цели».

На этапе Epic Fury широкое мнение заключается в том, что облачные платформы типа Nimbus являются ключевой вычислительной базой, поддерживающей сложное планирование целей Израиля, моделирование боевых действий и интеграцию разведданных в реальном времени, однако конкретные пути вызова и детали боевых примеров остаются засекреченными.

С точки зрения рисков это означает, что Google обменивает стабильный доход от безопасных клиентов на Ближнем Востоке на «слегка повышенную политическую премию за риск», а волна протестов и уходов сотрудников внутри компании напоминает инвесторам: это не просто обычный корпоративный облачный контракт.

Пять: Израильская фабрика ИИ-убийц: Переносимость логики Lavender

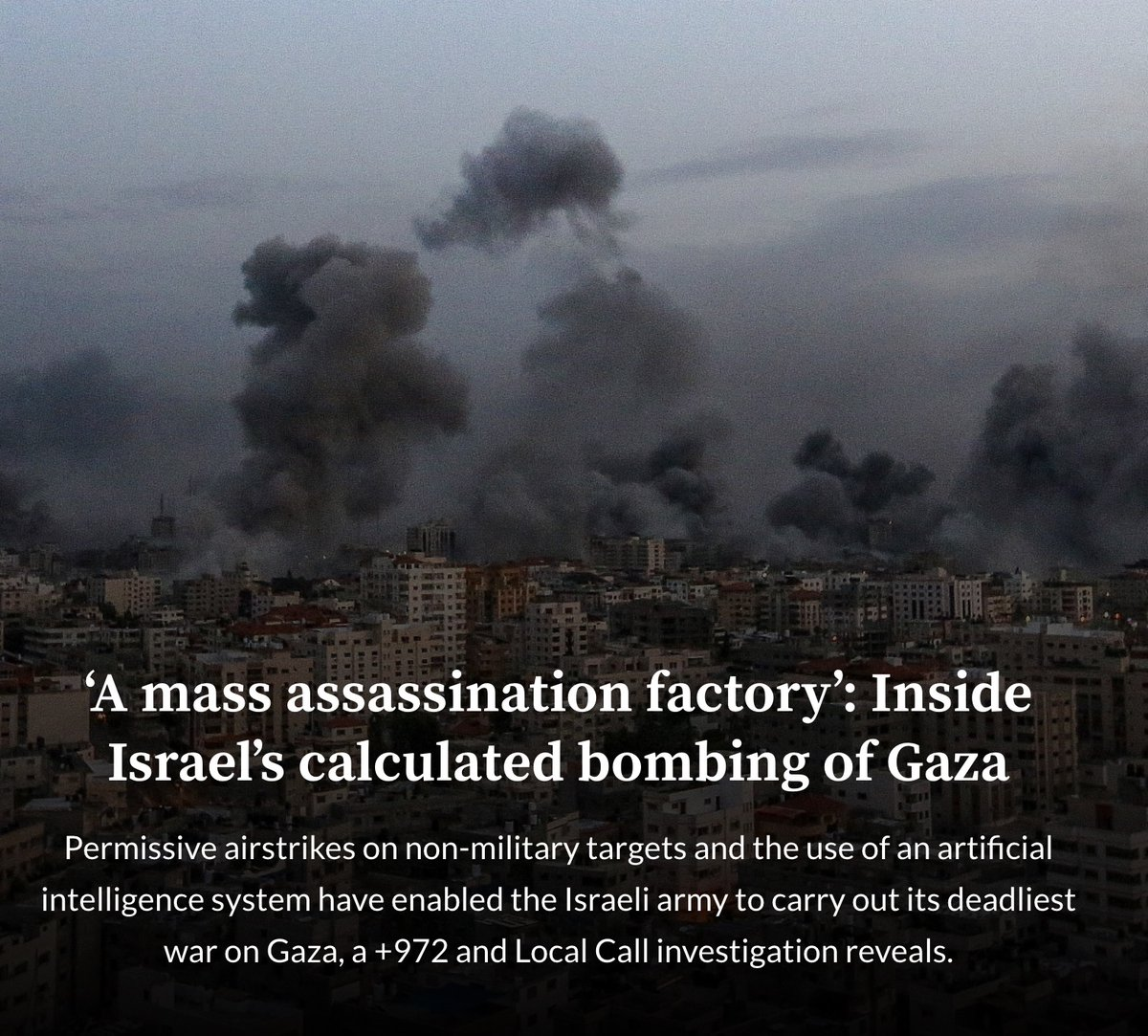

Чтобы понять, как ИИ меняет поле боя, стоит начать с одного из самых спорных израильских систем: Lavender, Gospel и Where’s Daddy.

Исследование +972 Magazine и Local Call показывает:

«Lavender» провела анализ поведения и связей почти всех взрослых мужчин в Газе, присвоив каждому «оценку подозрения в причастности к вооруженным формированиям» от 1 до 100 и за короткий срок выделив до 37 000 целей, подозреваемых в членстве в вооруженных организациях;

“Gospel” сосредоточен на зданиях и инфраструктуре, автоматически помечая здания, используемые для военных целей, формируя списки для массового бомбардирования ВВС;

“Where’s Daddy” отвечает за оптимизацию по временному измерению: отслеживает, когда цели, включенные в список, возвращаются домой, и инициирует удар, когда они находятся вместе с семьей в жилище — это значительно повышает вероятность «успешного устранения», одновременно подвергая семью и соседей высокой смертельной опасности.

Представитель израильских военных разведывательных служб на передовой признал, что человеческая проверка рекомендованных Lavender целей часто сводится к формальному подтверждению в течение нескольких десятков секунд;

Правозащитные организации и эксперты ООН описали эту систему как «высокотехнологичный завод по массовым убийствам», указав на ее структурные проблемы, связанные с усилением алгоритмических предвзятостей, сужением пространства для человеческого суждения и повышением риска жертв среди гражданского населения.

Следует подчеркнуть, что публичные сообщения более однозначно связывают эту систему с войной в Газе, тогда как официальные органы долгое время сохраняли молчание относительно ее конкретного применения на иранском фронте.

Однако с точки зрения технической переносимости, достаточно владеть достаточным объемом коммуникационных данных, траекторий местоположения и социальных графов внутри Ирана, чтобы «перевести» логику Lavender на элиты власти в Тегеране — это не кажется чем-то невозможным, именно поэтому многие аналитики считают, что Epic Fury скорее представляет собой эксперимент по экспорту «алгоритмической фабрики уничтожения в Газе» в столицу суверенного государства.

Шесть: Рынок и регулирование: право ценообразования комплекса ИИ–Облако–Оборона

Сложив эти фрагменты вместе, вы получите картину, очень не «Силиконовая долина»:

С одной стороны, компании крупных моделей, такие как OpenAI, готовые на ограниченные уступки на грани, быстро укрепили свои позиции в оборонном бюджете; reuters+2

С другой стороны, Anthropic, придерживающаяся более строгих принципов безопасности, была исключена министром обороны под предлогом «рисков в цепочке поставок», что стало для всей отрасли уроком о реальности: «не противостоять единственному покупателю»; axios+5

На нижнем уровне находятся гиганты облачных вычислений, такие как Microsoft и Google, которые с помощью кластеров GPU и конфиденциальных облачных сетей создают «операционную систему» современной войны, принимая на себя большую часть денежных потоков от военного ИИ, одновременно неся все возрастающие репутационные и регуляторные риски.

С точки зрения ценообразования активов, это больше не бинарное противостояние между «технологическими акциями» и «оборонными акциями», а новый комплекс AI–Cloud–Defense:

На тактическом уровне дешевые дроны-группы, автоматизированное производство целей и системы принятия решений на основе ИИ подрывают традиционное сдерживание крупных держав, делая дорогие истребители пятого поколения и авианосные ударные группы похожими на устаревшие капиталоемкие активы;

В отрасли крупные языковые модели и облачные провайдеры получили от военных крайне ограниченный поток контрциклических денежных средств, доступный лишь немногим участникам, и под предлогом «безопасности и конфиденциальности» вошли в прибыльную черную коробку, которую трудно полностью прозрачно регулировать;

В политическом плане, когда «кто более сотрудничает с национальной безопасностью» становится решающим фактором при получении ключевых контрактов, приверженность компаний этическим границам систематически ослабевает, и такая структура стимулов будет тихо запомнена будущими предпринимателями и инвесторами.

Поле боя в Иране может быть лишь введением. Независимо от того, где в следующий раз вспыхнет конфликт — на Тайваньском проливе, в Восточной Европе или на другом участке Ближнего Востока, темп войны теперь определяется не количеством танков и калибром орудий, а моделями, обученными на петабайтах секретных данных, и облаками, подключенными к стойкам GPU.

Проблема в том, что до того, как мы все больше и больше передаем цепочки поражения на аутсорсинг нескольким крупным компаниям, занимающимся крупными моделями и облачными технологиями, имеют ли глобальные регуляторы и демократическая политика время всерьез ответить на вопрос: кто несет ответственность за эти решения, когда рекомендации алгоритмов превращаются в координаты взрывов на практике.