Автор: Shenchao TechFlow

Статья в Google, заявляющая, что «объем памяти ИИ сокращен в шесть раз», на прошлой неделе вызвала падение капитализации мировых производителей чипов памяти, таких как Micron и SanDisk, более чем на 90 миллиардов долларов.

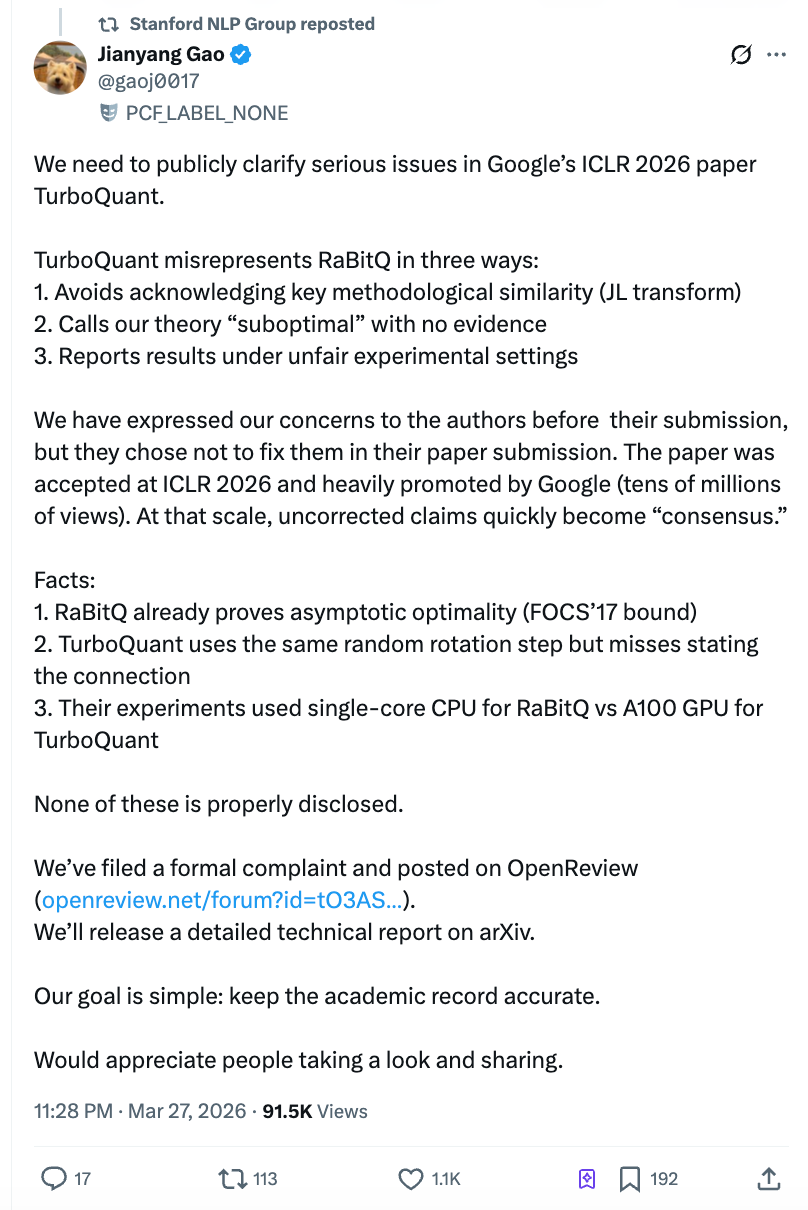

Однако всего через два дня после публикации статьи докторант Цюрихского федерального технологического института Гао Цзяньян, чей алгоритм был «подавлен» в исследовании, опубликовал открытое письмо объемом в десять тысяч слов, обвинив команду Google в том, что она тестировала конкурентов с помощью Python-скрипта на однорежимном CPU, но использовала GPU A100 для собственных тестов, и после того как ей уже сообщили об этой проблеме до подачи статьи, она отказалась внести исправления. Читаемость на Zhihu быстро превысила 4 миллиона, официальный аккаунт Stanford NLP сделал репост, и академическое сообщество и рынок были потрясены одновременно.

(См. также: статья, которая упала из-за хранения акций)

Суть спора несложна: была ли официально широко продвигаемая Google статья на ведущей конференции по ИИ, вызвавшая паническую продажу акций полупроводникового сектора, систематически искажена по отношению к ранее опубликованной работе и создала ложный нарратив о преимуществах производительности за счет преднамеренно несправедливых экспериментов?

TurboQuant сделал: сократил «черновик» ИИ до одной шестой от первоначального размера

При генерации ответов большие языковые модели должны постоянно пересматривать ранее вычисленные данные. Эти промежуточные результаты временно хранятся в видеопамяти и в отрасли называются «KV Cache» (кэш ключ-значение). Чем длиннее диалог, тем толще становится эта «черновая бумага», тем больше потребляется видеопамяти и тем выше стоимость.

Алгоритм TurboQuant, разработанный исследовательской командой Google, основное преимущество которого — сжатие этого черновика до 1/6 от исходного размера при утверждении нулевой потери точности и увеличении скорости вывода до 8 раз. Статья была впервые опубликована на академической платформе препринтов arXiv в апреле 2025 года, принята на ведущей конференции по ИИ ICLR 2026 в январе 2026 года и повторно представлена на официальном блоге Google 24 марта.

На техническом уровне подход TurboQuant можно просто понять так: сначала с помощью математического преобразования неупорядоченные данные «приводятся» к единому формату, затем по предварительно рассчитанной оптимальной таблице сжатия они поочередно сжимаются, и наконец, с помощью однобитового механизма коррекции ошибок исправляются вычислительные отклонения, возникшие в процессе сжатия. Независимая реализация сообществом подтвердила, что эффект сжатия в основном соответствует действительности, и математический вклад алгоритма является реальным.

Спор не в том, можно ли использовать TurboQuant, а в том, что сделал Google, чтобы доказать, что он «значительно превосходит конкурентов».

Открытое письмо Гао Цзяньяна: три обвинения, каждое из которых попадает в самое уязвимое место

27 марта в 22:00 Гао Цзяньян опубликовал длинную статью на Зhihu и одновременно подал официальный комментарий на платформе рецензирования ICLR OpenReview. Гао Цзяньян — первый автор алгоритма RaBitQ, опубликованного в 2024 году на ведущей конференции по базам данных SIGMOD и решающего ту же задачу — эффективное сжатие высокоразмерных векторов.

Его обвинения состоят из трех пунктов, каждый из которых подтвержден электронными письмами и хронологией событий.

Обвинение 1: Использован чужой основной метод, полностью не упомянут.

Ключевым общим шагом в технической основе TurboQuant и RaBitQ является «случайный поворот» данных перед их сжатием. Эта операция преобразует исходные неравномерно распределенные данные в предсказуемое равномерное распределение, значительно снижая сложность сжатия. Это наиболее существенная и близкая часть обоих алгоритмов.

Сам автор TurboQuant признал это в ответе на рецензию, однако ни разу прямо не указал связь этого метода с RaBitQ в полном тексте статьи. Более важный контекст: второй автор TurboQuant Маджид Далири в январе 2025 года самостоятельно связался с командой Гао Цзяньяна, попросив помочь отладить его Python-версию, написанную на основе исходного кода RaBitQ. В письме были подробно описаны шаги воспроизведения и сообщения об ошибках — другими словами, команда TurboQuant отлично знакома с техническими деталями RaBitQ.

Анонимный рецензент ICLR также независимо отметил, что обе команды использовали одну и ту же технологию, и потребовали подробного обсуждения. Однако в финальной версии статьи команда TurboQuant не только не добавила обсуждение, но и переместила из основного текста в приложение уже неполную информацию о RaBitQ.

Второе обвинение: безосновательно называть теорию противника «второстепенной».

Статья TurboQuant прямо называет RaBitQ «теоретически субоптимальным» из-за того, что математический анализ RaBitQ «достаточно груб». Однако Гао Цзяньян отмечает, что расширенная версия статьи RaBitQ строго доказала, что ошибка сжатия достигает математически оптимальной границы — этот вывод был опубликован на ведущей конференции по теоретической информатике.

В мае 2025 года команда Гао Цзяньяна подробно объяснила оптимальность теории RaBitQ в серии писем. Второй автор TurboQuant Далири подтвердил, что проинформировал всех соавторов. Однако в окончательной версии статьи осталась формулировка «субоптимальный», без каких-либо контраргументов.

Обвинение три: в экспериментальном сравнении «левая рука привязана к человеку, правая держит нож».

Это самый смертоносный пункт во всем тексте. Гао Цзяньян отмечает, что в экспериментах по сравнению скорости в статье TurboQuant были добавлены два несправедливых условия:

Во-первых, официальный сайт RaBitQ предоставил оптимизированный код на C++ (по умолчанию поддерживает многопоточность), но команда TurboQuant не использовала его, а вместо этого протестировала RaBitQ с помощью собственной переведенной версии на Python. Во-вторых, при тестировании RaBitQ использовался одноядерный CPU с отключенной многопоточностью, тогда как TurboQuant применял GPU NVIDIA A100.

Совместное воздействие этих двух условий приводит к тому, что читатели приходят к выводу, что «RaBitQ медленнее TurboQuant на несколько порядков», не зная при этом, что этот вывод основан на том, что команда Google связала противнику руки и ноги перед забегом. В статье недостаточно подробно раскрываются различия в этих экспериментальных условиях.

Ответ Google: «Случайное вращение — это универсальная технология, невозможно указывать источник для каждой статьи»

По словам Гао Цзяньяна, команда TurboQuant в ответе на электронное письмо от марта 2026 года заявила: «Использование случайного вращения и преобразования Джонсона-Линденштраусса уже является стандартной практикой в этой области, и мы не можем ссылаться на каждую статью, в которой применялись эти методы».

Команда Гао Цзяньяна считает, что это подмена понятий: вопрос не в том, нужно ли ссылаться на все статьи, использующие случайные вращения, а в том, что RaBitQ — первая работа, которая в тех же условиях применила этот метод вместе с векторной компрессией и доказала его оптимальность, и статья TurboQuant должна точно описать взаимосвязь между ними.

Официальный аккаунт Stanford NLP Group в X перепостил заявление Гао Цзяньяна. Команда Гао Цзяньяна опубликовала открытый комментарий на платформе ICLR OpenReview и подала официальную жалобу председателю конференции ICLR и этическому комитету, а также планирует опубликовать подробный технический отчет на arXiv.

Независимый технический блогер Дарио Сальвати дал относительно нейтральную оценку в своем анализе: TurboQuant действительно внес реальный вклад в математические методы, но его связь с RaBitQ гораздо теснее, чем указано в статье.

90 миллиардов долларов капитализации исчезли: споры о статье усилили рыночный панический настрой

Момент, когда разразился этот академический спор, был чрезвычайно тонким. После того как Google 24 марта опубликовал TurboQuant в официальном блоге, глобальный сектор чипов памяти столкнулся с мощной продажей. Согласно сообщениям таких СМИ, как CNBC, Micron Technology падала в течение шести торговых дней подряд, накопив падение более чем на 20%; SanDisk упала на 11% за один день; южнокорейская SK Hynix снизилась примерно на 6%, Samsung Electronics — почти на 5%, японская Kioxia — примерно на 6%. Логика рыночного панического настроения проста и груба: программное сжатие может снизить потребность в памяти для вывода ИИ в шесть раз, что приведет к структурному снижению перспектив спроса на чипы памяти.

Аналитик Morgan Stanley Джозеф Мур в отчете от 26 марта оспорил эту логику, сохранив рейтинги «покупать» для Micron и SanDisk. Мур отметил, что TurboQuant сжимает только определенный тип кэша — KV Cache, а не общий объем использования памяти, и классифицировал это как «нормальное повышение производительности». Аналогичным образом аналитик Wells Fargo Эндрю Роча сослался на парадокс Джевонса, утверждая, что повышение эффективности и снижение затрат могут стимулировать более масштабное развертывание ИИ, в конечном итоге увеличив спрос на память.

Старые исследования, новая упаковка: риски передачи от исследований ИИ к рыночным нарративам

Согласно анализу технического блогера Бена Пуладиана, статья TurboQuant была опубликована в апреле 2025 года и не является новым исследованием. 24 марта Google повторно представила её через официальный блог, но рынок оценил её как новое прорывное достижение. Такая маркетинговая стратегия — «старая статья, новый анонс» — в сочетании с возможными экспериментальными искажениями в самой статье, демонстрирует системные риски в цепочке передачи от академических публикаций к рыночным нарративам в области ИИ.

Для инвесторов в инфраструктуру ИИ, когда в статье утверждается достижение «нескольких порядков» повышения производительности, первым вопросом должно быть: были ли условия сравнения с эталоном справедливыми?

Команда Гао Цзяньяна четко заявила, что продолжит содействовать официальному решению проблемы. Со стороны Google официальный ответ на конкретные обвинения в открытом письме пока не дан.