Эти безумные тридцать дней, одиннадцать крупных моделей — словно шумное фейерверк-шоу.

Автор статьи, источник: 0x9999in1, ME News

Кратко

- Тридцать дней крайней конкуренции: с 26 марта по 24 апреля было выпущено 11 крупных языковых моделей, в среднем одна каждые 2,7 дня. Рынок столкнулся с серьезной «усталостью от параметров».

- «Хирургия по снижению веса» для Parameter Gourmand: общий параметр V4-Pro достигает 1,6 Т, но активировано только 49 млрд. Благодаря архитектуре CSA+HCA, FLOPs при контексте 1 М снижаются на 27%, а кэш KV — до крайне низких 10%.

- Отделение поколенческого разрыва в алхимии: первая в своем роде парадигма пост-обучения «сначала независимое усиление обучения, затем онлайн-дистилляция и объединение» — V4-Pro-Max приближается к пределу закрытых решений в задачах вывода и агентов.

- Голоса реальных денег: GPT-5.5 лишь спровоцировал однодневный рост NVIDIA на 4,2% перед пиком, тогда как V4, полностью открытый MIT, полностью разжег устойчивый рост локальных цепочек вычислительных мощностей в Китае и Гонконге.

- Глубокая логика игры: закрытые модели продают «налог», открытые крупные модели продают «железо». Появление V4 позволило наконец сбалансировать учет вычислительных мощностей для корпоративного частного развертывания по всему миру.

Апрель бури богов и усталость рынка от эстетики

Сошли с ума. Все сошли с ума.

Если вы наблюдатель, следящий за направлением ИИ, то последние тридцать дней, скорее всего, вызвали у вас физический дискомфорт. С 26 марта по 24 апреля 2026 года, за менее чем месяц, на рынок было выпущено как минимум 11 крупных моделей с заметным влиянием.

Список выглядит как меню: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

А также, в 4:00 утра 23 апреля, тихо вышел DeepSeek V4, как глубинная бомба.

В среднем новый модель появляется каждые 2,7 дня. Это скорость, с которой даже управляющие фондами не успевают прочитать пресс-релизы. Инвесторы только что услышали о «превышении параметров» компании A, как уже на столе лежит «превосходство в тестах» компании B. Рынок уже стал равнодушным. Так называемые «обновления рейтингов по Benchmark» в условиях жесткой конкуренции все больше похожи на цифровую игру для собственного удовольствия.

Но деньги умны. Или, другими словами, свечи никогда не лгут.

Проанализировав свечные графики активов ИИ в США, Китае и Гонконге за последние 30 дней, вы столкнетесь с крайне суровой реальностью: в этой «битве богов» на рынке остаются устойчивые следы только двух узлов.

Первое — 8 апреля на другом берегу океана OpenAI выпустила GPT-5.5. Этот неоспоримый лидер сразу же вызвал рост NVIDIA на 4,2% за один день. А потом? Больше ничего не последовало — пик достигнут,利好 исчерпаны. Люди поняли: даже самый великий закрытый гигант теперь вряд ли сможет так же легко сдвинуть с места тяжелую гору глобального капитала, как это было два года назад.

Второй узел — с 23 по 24 апреля. Предварительная версия DeepSeek V4 выпущена. Без пафосных презентаций, без впечатляющих рекламных роликов. Веса сразу размещены на Hugging Face и ModelScope под лицензией MIT.

Результат? Это спровоцировало серию скачков в китайско-гонконгской вычислительной цепочке.

Почему? Почему открытая модель смогла сделать то, что не смогли сделать множество закрытых лидеров?

Чтобы ответить на этот вопрос, нам нужно, как сказочникам, отбросить скучные пресс-релизы и открыть капот DeepSeek V4, чтобы посмотреть, что же там внутри.

Разбор V4: больше не верьте в силу параметров

Крупные модели. Очень дорогостоящие. Это всем известно.

За прошедший год производители крупных моделей оказались в плену «страха недостаточной мощности». Ты делаешь триллион — я сделаю два триллиона. Все считали, что если достаточно сильно надавить, появившийся интеллект решит все проблемы. Но вместе с этим возникли чрезвычайно высокие затраты на вычислительные ресурсы. Даже запасы землевладельца уже не справляются.

DeepSeek V4 представил две модели MoE (смешанные эксперты): V4-Pro и V4-Flash. Сначала рассмотрим несколько ключевых показателей.

V4-Pro: общее количество параметров 1,6 трлн (1,6 триллиона), но активируемых параметров на каждый токен — всего 49 млрд (49 миллиардов).

V4-Flash: общее количество параметров 284 млрд (284 000 000 000), активированных параметров всего 13 млрд (13 000 000 000).

Понял? Это крайняя сдержанность — «четыре унции смещают тысячу пудов». Суть архитектуры MoE заключается в том, чтобы не включать все сигналы тревоги каждый раз. Для задачи, требующей убить курицу, привлеките нескольких экспертов по убийству куриц; для задачи, требующей убить дракона, достаньте меч для убийства драконов. База в 1,6 триллиона гарантирует, что она «имеет опыт и обладает обширными знаниями»; активация в 490 миллиардов гарантирует, что она «реагирует быстро и ловка».

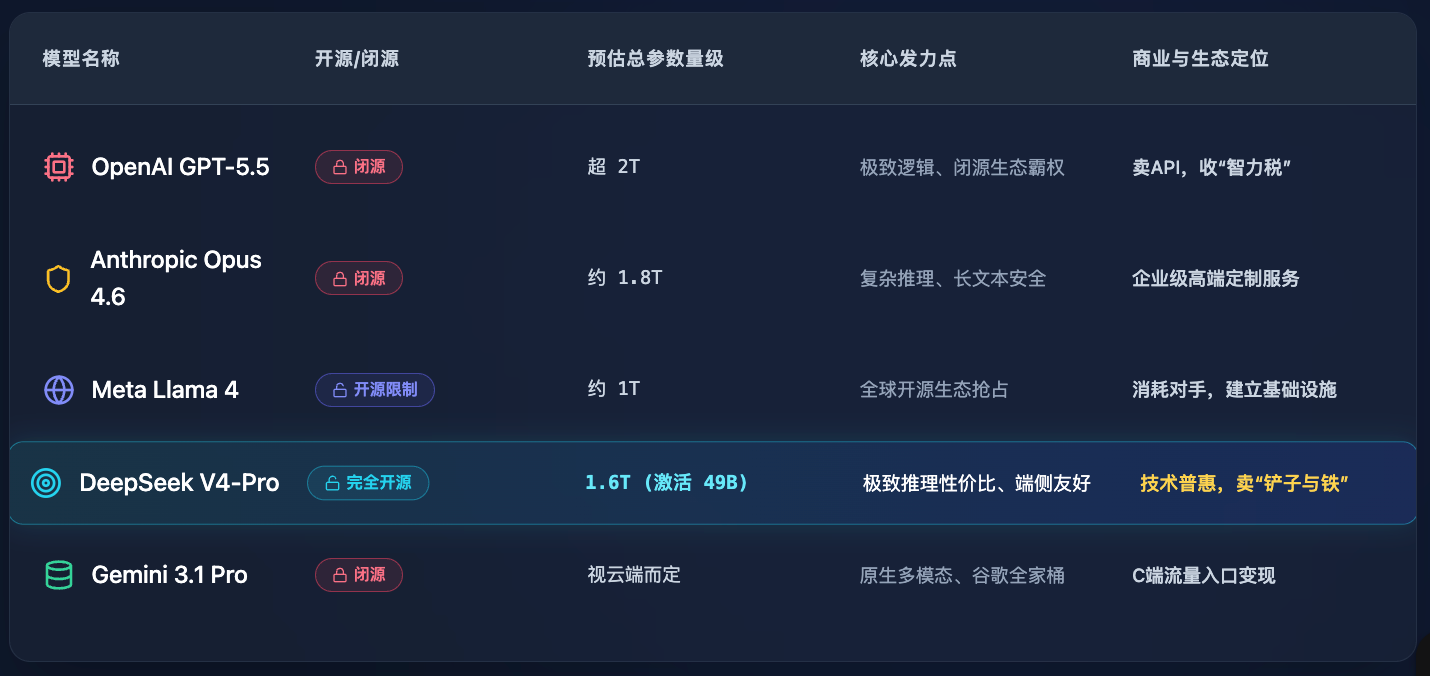

Чтобы наглядно понять эту разницу, составим таблицу, сравнивающую основные подходы на текущем рынке (данные основаны на открытых рыночных оценках и расчетах):

Как видно из таблицы, V4-Pro не стремится превзойти GPT-5.5 по общему количеству параметров, но сосредоточил все усилия на том, «как заставить этого гиганта есть меньше и бегать быстрее».

Но этого недостаточно. То, что заставило настоящих специалистов вздрогнуть, — это беспощадное уничтожение «убийц видеопамяти».

Конец майнеров с видеопамятью: три хирургических инструмента архитектуры

Что такое «убийца видеопамяти»? Это «длинный контекст».

Сейчас все хвастаются, что поддерживают контекст в 1 млн (миллион) токенов. Звучит круто — целая книга «Троецарствие» помещается внутрь, и она читается за несколько секунд. Но какова цена? При выводе длинные тексты создают огромные KV-кэши (занятая видеопамять для хранения исторической информации при выводе). Это как если бы, читая каждую страницу книги, вам приходилось переписывать содержание предыдущей страницы на огромную доску и держать её перед глазами. Когда вы дойдёте до миллионного слова, досок станет столько, что даже серверные помещения в Чжунгуаньчжуне не смогут их вместить.

Память дороже вычислительной мощности. Это скрытое правило в индустрии ИИ.

Как DeepSeek V4 решает эту проблему? Они провели «хирургическую операцию» на базовом механизме внимания. Это первый и самый решительный шаг в их архитектурном обновлении: гибридный механизм внимания (CSA + HCA).

CSA (сжатое разреженное внимание) плюс HCA (сильно сжатое внимание) — звучит как китайская аббревиатура, но по-человечески это означает: вместо зубрежки система научилась «выделять ключевое» и «делать краткие заметки».

Эффект чрезвычайно значительный: при контексте 1M FLOPs (количество операций с плавающей запятой) на один токен для V4-Pro составляют всего 27% от предыдущего поколения V3.2! Еще более впечатляет то, что кэш KV составляет всего 10% от V3.2!

Что это за концепция? Раньше для выполнения задачи с миллионом символов требовалось 10 серверов высшего класса, а теперь одна серверная машина справляется с этим без усилий. Стоимость вычислительных ресурсов снизилась в десять раз. Это оптимизация уровня полного переосмысления.

Еще два ножа.

Второй инструмент называется «многообразное ограничение сверхсвязи (mHC)». В прежних крупных моделях передача информации между слоями осуществлялась с помощью «традиционных остаточных соединений», что аналогично использованию старых ржавых железных труб для подачи воды — при высоком давлении трубы начинают протекать. При работе с объемом предварительной подготовки в 32T токенов старые трубы не справляются. mHC — это как замена на оптоволоконную сеть, которая повышает стабильность передачи сигналов между слоями. Без потерь и отклонений.

Третий нож — замена масла в двигателе. Откажитесь от традиционного подхода и перейдите на оптимизатор Muon. Он ускоряет сходимость. Пока другие тратят на приготовление одного зелья семь раз по семь дней, он может закончить за двадцать. Время — деньги, время на машине — доллары.

Эти три удара полностью вылечили «болезнь богатства» крупных моделей V4.

Секреты китайского котла для эликсиров: от изолированной работы к объединению всех методов

В отрасли все знают, что предварительное обучение превращает «неграмотного» в «человека, знающего многое, но не умеющего говорить». То, что превращает его в настоящего мастера, — это пост-обучение (Post-training).

DeepSeek V4 в пост-обучении применил чрезвычайно жесткую «стратегию двух этапов».

Раньше при обучении MoE было как будто несколько учителей одновременно обучают одного ученика — легко возникают конфликты. Как это делает V4?

Этап 1: «Каждый за себя». Он использует SFT (надзорная тонкая настройка) и GRPO (групповая относительная стратегическая оптимизация) для усиления обучения, разделяя отдельные «экспертные сети» внутри модели и обучая их по отдельности. Эксперт по написанию кода тренируется исключительно в написании кода, а эксперт по математике — исключительно в решении математических задач. Полная изоляция, никакого взаимодействия. Это называется доведением одноточечных способностей до максимума.

Второй этап: «Все методы возвращаются к источнику». С помощью технологии онлайн дообучения эти эксперты, уже овладевшие совершенным искусством, объединяются в единую целостную модель. Без внутренних потерь и задержек.

Давайте посмотрим на две «козыря», которые они вынудили выпустить.

Первое — режим V4-Pro-Max. Это режим с максимальной вычислительной мощностью. Это как будто разблокирована генетическая блокировка. По их утверждению (которое вскоре подтвердилось сообществом), в кодировочных тестах V4-Pro уже достиг верхнего уровня, а в сложных задачах на рассуждение и агенты (агенты) разрыв с передовыми закрытыми моделями (такими как GPT-5.5, Opus 4.6) значительно сократился.

Во-вторых, V4-Flash-Max. Это интереснее. Это всего лишь небольшая модель размером 284B, но после достаточного выделения вычислительного бюджета её результаты в выводе приближаются к Pro. Что это означает? Это означает, что «качество алгоритма» начинает побеждать «объем параметров». Если дать ей достаточно времени на размышление, даже маленький мозг может решить сложные задачи. Конечно, в чистом объеме знаний и при крайне сложных многоэтапных задачах для агентов она все еще ограничена размером параметров (ведь «желудок» у нее всего такой), но этого более чем достаточно для большинства корпоративных повседневных применений.

Наконец, хранение весов было реализовано с исключительной изобретательностью с использованием гибридной точности FP4+FP8 — сохранилась точность, а видеопамять сэкономлена. Всё это излучает привлекательность рационального, расчётливого научного подхода.

Для более наглядного сравнения повышения инженерной эффективности, вызванного этим пост-обучением, представим еще одну таблицу с жесткими показателями:

Интуиция капитала: почему V4 запустила цепочку вычислительных мощностей в Китае и Гонконге?

На этом технический разбор примерно завершен. Но мы еще не ответили на исходный главный вопрос:

Почему GPT-5.5 не смог обеспечить продолжительный ажиотаж на рынке вычислительных мощностей, а DeepSeek V4 — смог?

Это требует от нас выйти за рамки кода и взглянуть на эту игру с точки зрения капитала и бизнеса.

GPT-5.5 мощный, непобедимо мощный. Но он проприетарный. Что означает проприетарность? Это означает, что OpenAI — это огромная «черная дыра». Если вы хотите использовать его возможности, вам нужно купить его API. Это модель «налога». Прибыль поступает в Силиконовую долину, а вычислительные мощности сосредоточены в облачных центрах обработки данных Microsoft. Для глобальных производителей оборудования, локальных центров вычислительных мощностей и серверных агентов各国 — кроме как смотреть вверх, им достается лишь крохи. Насколько бы ни был силен GPT-5.5, это чужой праздник. Рост NVIDIA объясняется тем, что все считают, что OpenAI будет покупать еще больше чипов.

Но DeepSeek V4 отличается.

Он является открытым исходным кодом и распространяется по крайне либеральной лицензии MIT. Лицензия MIT — это самый щедрый подарок от сообщества с открытым исходным кодом, что означает, что коммерческие компании могут бесплатно использовать, изменять и продавать его, не опасаясь юридических рисков.

Еще более критично то, что мы ранее подробно аргументировали: V4 сократил стоимость вывода модели и использование видеопамяти до уровня щиколотки.

Соединив эти два момента, вы придете к выводу, который вызовет безумие на финансовых рынках: порог приватизации достигнут.

Раньше компании, желавшие самостоятельно развернуть крупную модель объемом более 1 ТБ,一看硬件报价单,默默合上,转身去买 API。现在,V4 告诉大家:你只需要很少的机器,就可以在本地跑起一个无限接近 GPT-4 甚至挑战 GPT-5.5 水平的超级大脑。数据不用出省,不用出国,绝对安全。

Теперь, когда все могут запустить это локально, что произойдет дальше?

Купите машины! Купите серверы! Купите оптические модули! Постройте центр искусственного интеллекта!

Закрытые крупные компании продают интеллектуальный налог, тогда как открытые крупные компании по сути продвигают продукцию для производителей оборудования отрасли в целом. DeepSeek V4 — это тот, кто бросил искру. Чем лучше и открытее он становится, тем больше взрывной рост спроса на локализованные вычислительные мощности в Китае, Гонконге, Тайване и других регионах. Компании, занимающиеся сборкой серверов, жидкостным охлаждением и эксплуатацией центров обработки данных, наконец-то увидели реальные деньги масштабного внедрения.

Вот почему после запуска V4 23 апреля цепочка вычислительных мощностей Китая и Гонконга непрерывно росла. Капитал платит не за эмоции, а заранее занимает позиции в преддверии предстоящей «волны частного развертывания в тысячах отраслей».

Это и есть основная коммерческая стратегия.

Заключение: Отлив и рифы

Эти безумные тридцать дней, одиннадцать крупных моделей — словно шумное фейерверк-шоу.

Крупные игроки на арене параметров размахивают деньгами, пытаясь сокрушить соперников ударами вычислительной мощности. Но после шума оставаться и изменить ландшафт отрасли часто удается не самому громкому.

Появление DeepSeek V4 напоминает спокойного наёмника. Оно не соревнуется с другими в том, кто тратит больше денег — оно атакует самое уязвимое место: устраняет ненужную видеопамять, снижает барьеры для развертывания и превращает премиум-уровень в доступный для всех.

В этой войне ИИ, известной как «Рагнарёк», эпоха слепого накопления параметров ускоренно подходит к концу. Будущее будет принадлежать тем, кто найдёт идеальный баланс между «максимальной производительностью» и «инженерной эффективностью».

Ветер рынка всегда отступает; только после отлива становится ясно, кто плавает нагишом, а кто — непоколебимая скала.

V4 уже раздал оружие всем. Теперь посмотрим, как каждая из фракций устроится на этом новом континенте.

Поняв это, вы сможете с большей легкостью и меньшим беспокойством слушать эти крики о «потрясающем запуске» и «переопределении».

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Источник:

- Предварительный обзор серии DeepSeek V4, официальный релиз, команда DeepSeek, GitHub/ModelScope/HuggingFace. (2026).

- Апрельский ралли ИИ: анализ 30-дневного цикла крупных моделей, ME News Market Observer. (2026).

- Законы масштабирования и смена парадигмы после обучения, Журнал искусственного интеллекта и экономики. (2026).

- Отчет о состоянии рынка глобальных цепочек поставок вычислительных ресурсов (апрель 2026 г.), Pan-Asia Financial Data Analytics. (2026).