Что делать, если ИИ внезапно объявит вас виновным, и все слепо поверят его суждению?

Это звучит как сцена из фильма «Минорити-репорт», когда преступление предсказывают, а затем на тебя навешивают, но абстрактно — в реальности уже разыгралась более грубая версия:

ИИ ошибочно опознал преступника, из-за чего невиновная женщина провела в тюрьме полгода и ее жизнь едва не завершилась.

Что значит, что полиция арестовала «Бистрого»?

Анджела Липпс из штата Теннесси, США, — эта несчастная женщина. В июле 2025 года группа вооруженных полицейских внезапно ворвалась в ее спокойную жизнь, направив на нее оружие и сообщив, что она арестована.

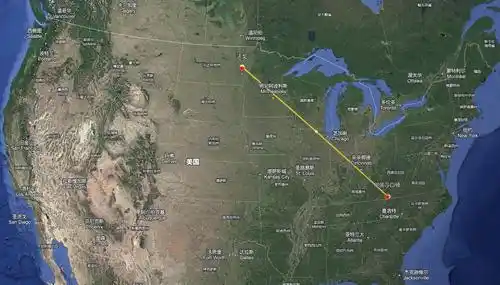

В тот момент она была в шоке, ведь совершенно не знала, в чем именно ее винят. Полиция сказала, что она подозревается в участии в банковском мошенничестве в Северной Дакоте, и по всем признакам казалось, что доказательства неоспоримы, и против нее выдан ордер на арест 5-го уровня, но听完 это объяснение она замерла на месте:

But I’ve never been to that state in my life.

С точки зрения карты, штат Теннесси в США и Северная Дакота действительно находятся на значительном расстоянии друг от друга, и именно ИИ связал её с подозреваемым.

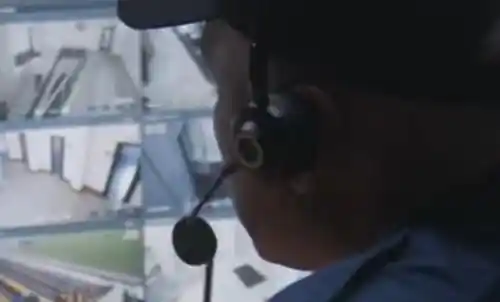

Когда полиция арестовала ее, ее оправдания были автоматически отклонены, и подробности дела стали известны только после заключения под стражу. Полиция Фарго, штат Северная Дакота, расследовала дело о мошенничестве, при котором подозреваемый, выдавая себя за военного, обманом получил десятки тысяч долларов из банка. Метод расследования полиции заключался в том, чтобы сначала проверить видеонаблюдение, затем обратиться к ИИ и в конце арестовать подозреваемого.

Вы могли подумать, что с помощью ИИ «переработали» Шерлока Холмса, и он превратился в великого детектива, раскрывающего дела с помощью строгой логики, но на самом деле всё не так «сложно». Полиция использовала систему ИИ для распознавания лиц на скриншотах с камер наблюдения, а затем отфильтровала подозреваемых в базе данных.

В результате ИИ на этот раз допустил серьезную ошибку и неверно сопоставил фотографию Анджелы Липпс. Эта информация была передана в полицейский участок, ведущий расследование, где сотрудники допустили еще большую ошибку: после ручной проверки ее водительских прав и социальных сетей они решили, что черты лица, телосложение и прическа совпадают, и признали ее подозреваемой.

Изображение из GoFundMe

Сестра после этого была в полном отчаянии, не стала искать другие улики — а вдруг совпадение? Но ещё большее отчаяние ожидало её дальше: после серии действий у неё не осталось шансов доказать свою невиновность.

Согласно местной процедуре, её не отправили напрямую в Северную Дакоту для дальнейшего расследования, а держали в местной тюрьме в Теннесси. Поскольку её признали «беженцем через штаты», ей не предоставили залог и не дали возможности быть допрошена полицией — она оказалась заключённой на 108 дней, с июля по конец октября, и трудно представить, насколько отчаянной она была в этот период.

Анджела Липпс продержалась до 30 октября, когда её наконец вывели из тюрьмы для перевозки в Северную Дакоту. Ей предъявили множество обвинений, и во время перемещения ей пришлось не только ходить в наручниках, но и иметь цепь, привязанную к талии — по её ощущениям, прохождение через аэропорт было похоже на публичное позорное шествие.

И это на самом деле ее первый полет в жизни.

Ее удивило то, что после прибытия в Северную Дакоту ей пришлось продолжать ждать. Только в декабре у нее появилась официальная возможность объяснить ситуацию: ее адвокат сразу же запросил ее банковские записи для сопоставления времени — в момент преступления она находилась в Теннесси, в 1900 километрах от места происшествия, где покупала пиццу, что означает, что, если бы она не была «Молнией», она не могла бы совершить преступление, перемещаясь во времени и пространстве.

Всего за пять минут адвокат помог ей прояснить этот вопрос.

К 24 декабря её обвинения были окончательно сняты, но она не могла радоваться, ведь «линия обрезки» уже достигла её лодыжек.

Анджела Липс отмечала свои 50-летие в тюрьме; во время заключения ей запрещали носить зубные протезы, она питалась исключительно нездоровой пищей и испытывала огромное психическое давление, из-за чего резко набрала вес. Перед тем как попасть в тюрьму, она была одета в летнюю одежду, а когда вышла — наступила зима, и у нее не было даже теплого пальто, так что даже согреться было проблемой, не говоря уже о возвращении домой. В тот момент полиция не предоставила ей ни копейки на дорогу; после освобождения она оказалась запертой в Северной Дакоте — и запертой в тот день, когда ее оправдали с помощью ИИ.

Хорошо, что нашлись добрые люди, которые ей помогли.

Ее адвокат организовал для нее временное проживание в отеле и помог получить еду, чтобы она пережила самые трудные моменты; местная некоммерческая организация оказала ей помощь и отправила обратно домой, в Теннесси.

Но вернуться домой и начать жизнь заново — это тоже адская задача. За время заключения её финансы рухнули: она потеряла снятую квартиру, домашнюю собаку, а также машину и всё, что хранилось в ней. Её личные вещи временно хранились на складе, но позже, не имея возможности оплатить аренду, всё имущество было утилизировано. Даже личные отношения оказались под угрозой, поскольку соседи видели, как её арестовали и «исчезла» на полгода, и все подумали, что она действительно совершила преступление.

В то же время эта абсурдная история быстро распространилась в сети и вызвала массу насмешек. Многие выразили недоумение: в США некоторые люди могут «получить бесплатно», но как только ты тронешь банк капиталиста — тебя мгновенно арестуют, даже если ты к этому не имеешь отношения.

Из-за того, что дело стало слишком громким, её отчаянное положение вновь изменилось, и она получила ещё больше помощи. Сейчас она уже собрала 80 000 долларов США на краудфандинге, чего вполне достаточно, чтобы начать новую жизнь.

Однако сейчас наибольшее ожидание интернет-пользователей заключается в том, что она наймет команду адвокатов и подаст на них иск, который перевернет все, и, возможно, выиграет процесс и получит дополнительную компенсацию.

Поскольку это не случайная ошибка полиции, ранее уже имели место массовые несправедливые приговоры, и у некоторых людей опыт был еще более тяжелым, чем у нее.

Второй: жуткие научно-фантастические моменты, вызванные «ошибками» ИИ

Опыт Анджелы Липпс уже неоднократно повторялся в разных регионах, а также происходил в других странах.

Например, Роберт Уильямс стал одним из первых жертв подобных инцидентов: в 2020 году полиция арестовала его при жене и дочери, удерживая в течение 30 часов, хотя он был на 20 сантиметров выше настоящего преступника.

Еще один Крис Гэтлин — тоже невероятно неудачливый человек: ИИ по расплывчатым видеозаписям с камер наблюдения определил его как потенциального подозреваемого в нападении в метро, и его держали под стражей целых 17 месяцев — теперь он самый долго задерживаемый невиновный человек. При этом до самого конца следователи не знали, что существует еще один видеорегистратор полицейского, который мог бы служить ключевым доказательством — но на нем подозреваемый вообще не похож на него.

В 2023 году Порча Вудрафф пережила ту же ситуацию: полиция обвинила её в причастности к краже автомобиля. Она рассмеялась в ответ, подумав, что полиция шутит, ведь на тот момент она была беременна на восьмом месяце и совершенно не выглядела способной на физическое насилие. Тем не менее, её забрали и держали в заключении более десяти часов, а позже она проиграла судебный процесс.

В этом году в Великобритании молодой человек по имени Альви Чоудхури также был арестован из-за похожей ситуации, его подозревали в «взломе и краже», однако, согласно доказательствам, преступление было совершено «на расстоянии». Такая сцена также описывалась в фильмах. ИИ распознал фотографию, сделанную во время его задержания в 2021 году; когда полиция увидела настоящего человека, они рассмеялись, потому что он выглядел как минимум на 10 лет старше подозреваемого.

Изображение из фильма «Переносчик»

В 2022 году индийский бизнесмен Правин Кумар был задержан в пути в Швейцарию, когда он делал пересадку в Абу-Даби и был ошибочно распознан ИИ как разыскиваемый преступник. Местные власти долго его допрашивали, но в итоге выяснили, что он не подозреваемый, и выслали его обратно в Индию, где он был задержан еще дважды в аэропорту.

В таких случаях самым абсурдным, пожалуй, является случай российского ученого Александра Цветкова: ИИ заявил, что он похож на убийцу, и его держали под стражей 10 месяцев.

Этот ученый, можно сказать, стал жертвой двойного ложного обвинения со стороны ИИ и человека. В феврале 2023 года он завершил научную экспедицию и вернулся в Россию, но сразу после приземления был арестован. Причиной стало то, что ИИ определил 55-процентное сходство между ним и портретом подозреваемого в серийном убийстве, произошедшем более чем двадцать лет назад. Кроме того, в этом деле был свидетель обвинения, который дал ложные показания, чтобы добиться смягчения наказания. К тому же полиция не провела тщательного расследования и просто арестовала его.

После ареста он сначала думал, что это небольшое недоразумение, но расследование затянулось, и под огромным психическим давлением и проблемами со здоровьем он временно дал признательные показания, а затем отказался от них. К счастью, его жена и коллеги из института неустанно боролись за него, собрав множество документов, подтверждающих, что в год инцидента он находился в командировке за пределами города. Благодаря освещению в СМИ дело получило широкую общественную огласку, и только в декабре появился переломный момент — обвинения были официально сняты в феврале 2024 года.

И такие дела, как вышеописанные, происходят все чаще с развитием ИИ, и кажется, что ИИ сам «управляет», а некоторые люди превращаются в исполнительные машины.

Третье: профессиональное заболевание «AI решает всё»

Абстрактное ощущение «обмена ролями» возникает потому, что и ИИ, и люди могут сбоить: даже самый мощный ИИ может ошибаться, а люди часто «лениваются» в любой момент.

Возьмем, к примеру, систему Clearview AI в США — именно она отправила женщину из начала статьи в тюрьму, но это далеко не какое-то подпольное программное обеспечение. Clearview AI утверждает, что обладает крупнейшей в мире базой изображений, незаконно собрав миллиарды фотографий несмотря на штрафы в нескольких странах. Более 3000 правоохранительных органов США используют эту систему, а в прошлом году она заключила контракт с ICE на 9,2 миллиона долларов.

Проще говоря, Clearview AI — это «поисковик по лицам»: вы загружаете изображение, система сопоставляет его с базой данных и выдает множество похожих фотографий, но окончательное решение, является ли это нужным вам человеком, остается за вами.

Хотя за последние годы прогресс в области ИИ был стремительным, «точность» по-прежнему вызывает споры, поскольку данные, используемые в экспериментальных тестах, всегда отличаются от реальных условий при использовании поиска по изображениям.

Например, чаще всего изображения с камер наблюдения, которые находит полиция, имеют качество, как будто сняты стационарным телефоном, плюс странный свет, неудобные углы съемки, закрытие лица и другие факторы, что действительно затрудняет идентификацию; в базе данных也可能 могут быть старые фотографии, и совпадение может быть просто случайным сходством двух людей.

Когда эти ошибки применяются к конкретным людям, им приходится страдать.

Это ворон или кошка?

По логике, если ИИ просто иногда сбоит, всё ещё есть надежда, потому что это всего лишь «подсказки», а окончательные «выводы» всё ещё должны проверяться человеком, но часто люди оказываются ещё более «странными», чем ИИ.

Еще несколько лет назад люди жаловались, что полиция США подчиняется ИИ и попадает в ловушку «автоматической предвзятости» — то есть чрезмерно полагается или даже слепо доверяет результатам, выданным ИИ. Как только ИИ говорит, что эти два человека совпадают, люди верят: если рост не совпадает — это не моя проблема; хотя у них есть алиби, но я отвечаю только за арест; все остальные доказательства пусть объясняют тюрьме. Таким образом, пропускаются базовые этапы расследования, а людям «пропускают жизнь».

На самом деле люди отлично осведомлены о недостатках ИИ. После того как полиция США понесла значительные финансовые потери, во многих регионах были установлены «ограничения»: например, при раскрытии преступлений помимо информации, полученной с помощью ИИ, требуется наличие независимых доказательств, а в некоторых местах использование ИИ для расследования преступлений полностью запрещено.

Но эти ограничения не могут противостоять невероятной полезности ИИ. Хотя есть вероятность сбоя, очевидно, что успешных случаев гораздо больше. Иногда следы, которые полиции пришлось упорно искать, — это всего лишь фотография с камеры наблюдения уровня «дверного замка», и полиция с большой вероятностью захочет попробовать ИИ на удачу. Еще в 2023 году сообщалось, что американские полицейские провели более миллиона поисков с помощью Clearview AI, а позже, когда использование стало официально запрещено, они продолжали применять его тайно — ведь можно просто заявить, что не использовали. Если одно программное обеспечение запрещено — берут другое; если запрещено локально — просят другую организацию помочь. Просто безумно увлеклись.

Так что, как только ИИ дает ненадежную подсказку, а человек ленится и пропускает расследование, Волк и Феникс применяют комбинацию, и несправедливое осуждение неизбежно.

За последние два года система Smart Sampa в Бразилии также столкнулась с похожими проблемами. В 2024 году в Сан-Паулу, Бразилия, была запущена крупнейшая в Латинской Америке полицейская система распознавания лиц на основе ИИ, которая, как утверждается, подключена к 40 000 камерам.

Хорошей новостью является то, что эффективность действительно высока: за несколько лет было задержано почти четыре тысячи преступников на месте преступления и возвращено более трех тысяч беглецов; ограбления в 2025 году снизились почти на 15%, что можно назвать «конвейером по поимке воров».

Плохая новость в том, что как минимум 59 человек были ошибочно опознаны.

Среди них есть и абстрактные случаи: например, психически больного человека в больнице приняли за преступника и увезли, но позже обнаружили, что ордер на его арест просрочен, и его отпустили. Еще один мужчина был арестован четыре раза за семь месяцев — ИИ перепутал его с разыскиваемым убийцей. Каждый раз его сразу отпускали после доставки в полицейский участок, но через несколько дней происходило то же самое — он уже был полностью обескуражен.

Раньше, когда говорили о том, какая работа не может быть заменена ИИ, все говорили, что ИИ не может сидеть за людей в тюрьме, но мы никогда не думали об обратной стороне этой проблемы — теперь он может заставить людей «сидеть в тюрьме».

Раньше это было шуткой, но сейчас это уже почти не новость. На самом деле, не только распознавание лиц, но и ИИ в распознавании объектов иногда тоже может удивить.

В прошлом году в американской старшей школе ИИ-система безопасности распознала упаковку чипсов в руках парня как «потенциальное оружие» и сразу сработала в режиме тревоги. Прибыло восемь полицейских машин, и парня немедленно задержали; только после досмотра в мусорном баке нашли пакет со сладостями — ситуация была крайне неловкой, и парень думал, что не выживет.

Не говори, да и не говори

Кто бы мог подумать, что чем сильнее ИИ, тем больше бед он может натворить. Раньше ИИ был слабым — ошибался при распознавании изображений, и весь интернет смеялся над этим. Теперь ИИ стал сильным — ошибается при распознавании человека, и человек садится в тюрьму на полгода. В будущем не стоит придумывать абстрактные вещи вроде ИИ-суда, ИИ-адвоката или «энергетического суда». В конечном счете, ИИ — это всего лишь инструмент, и главное — это способности и цели пользователя. Или, другими словами, чем сильнее ИИ, тем меньше человек может позволить себе лениться.

В целом, немного скучаешь по тому глупому ИИ.

Эта статья взята из официального аккаунта WeChat «CoolPlay Lab», автор: CoolPlay Lab