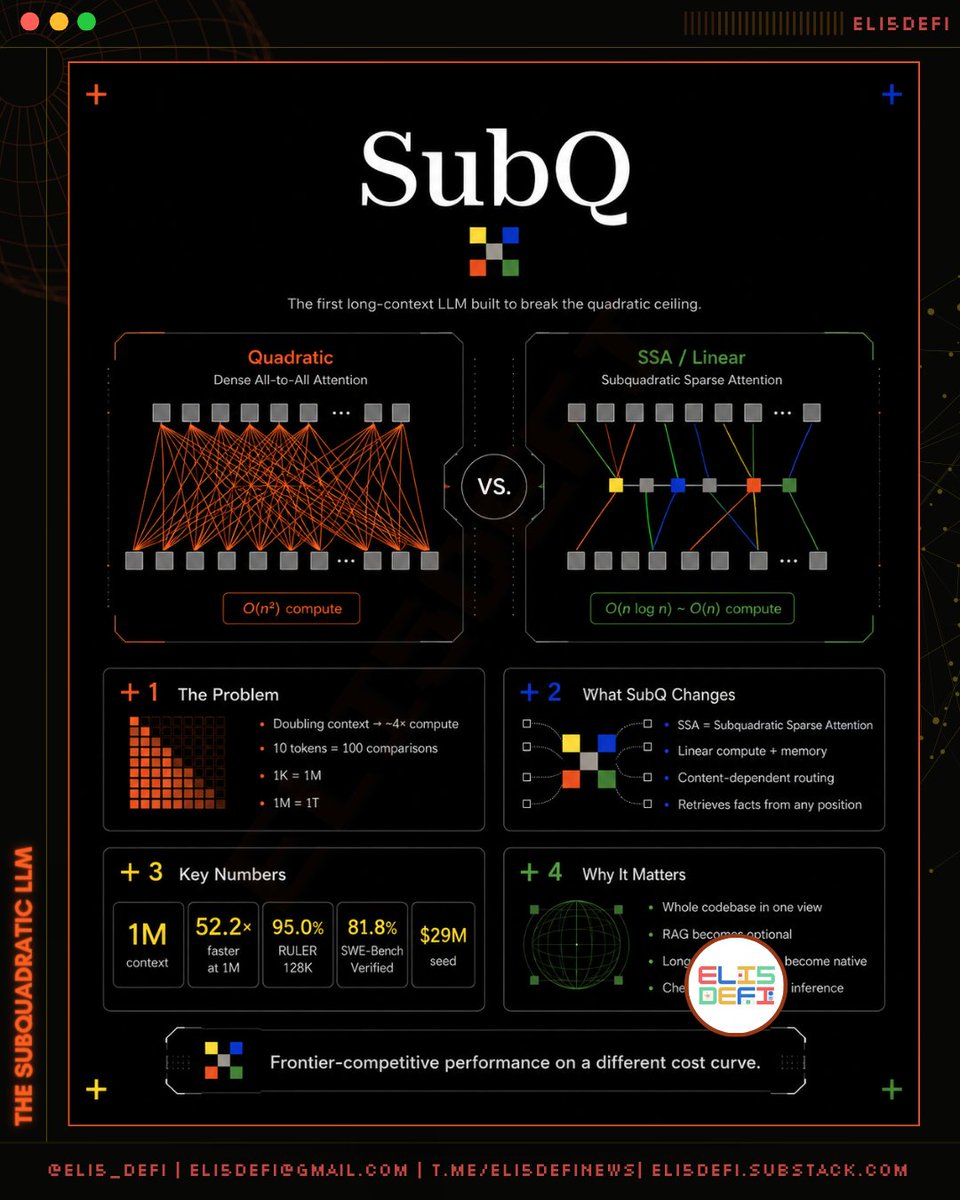

Uma nova empresa de IA chamada @subquadratic acaba de lançar um modelo que quebra um dos limites mais antigos da IA moderna. Para entender por que isso importa, você precisa compreender um único problema matemático que tem silenciosamente moldado cada chatbot que já usou. - ➠ O Problema: A IA Lê em Pares, e Pares Não Escalam Todo LLM moderno (ChatGPT, Claude, Gemini) lê texto verificando como cada palavra se relaciona com cada outra palavra. Isso parece bom até você fazer as contas: ▸ 10 palavras → 100 comparações ▸ 1.000 palavras → 1 milhão de comparações ▸ 1 milhão de palavras → 1 trilhão de comparações Dobrar a entrada não dobra o trabalho. Quadruplica. Isso é chamado de escalonamento quadrático, e está incorporado na IA desde 2017. O que isso significa para você: ▸ Documentos longos ficam caros rapidamente ▸ Modelos frequentemente perdem fatos enterrados profundamente em entradas longas ▸ Códigos inteiros ou bibliotecas de pesquisa não cabem Agora você sabe por que, quanto mais longo o contexto, mais lento e caro seus LLMs se tornam. - ➠ Como a IA Atual Esconde o Problema A indústria criou soluções alternativas em vez de corrigir a matemática: ▸ RAG: um mecanismo de busca pega alguns trechos relevantes e envia apenas esses ao modelo ▸ Chunking: documentos longos são cortados em pedaços pequenos ▸ Sistemas de agentes: múltiplas chamadas de IA lidam com partes diferentes, unidas por código ▸ FlashAttention: truques inteligentes de memória que fazem a mesma matemática cara rodar mais rápido Essas soluções funcionam, mas nenhuma delas corrige o problema real. Toda a pilha moderna de IA (bancos de dados vetoriais, pipelines de recuperação, engenharia de prompts) existe porque os modelos não conseguem simplesmente visualizar tudo de uma vez. — ➠ O Que o SubQ Faz Diferentemente SubQ usa uma nova abordagem chamada SSA (Atenção Esparsa Subquadrática). A ideia em uma frase: em vez de comparar cada palavra com cada outra palavra, o modelo identifica quais palavras realmente importam para a pergunta e ignora o resto. Isso muda a escala de quadrática para linear. Dobrar a entrada agora dobra o trabalho, em vez de quadruplicá-lo. A parte difícil não é a ideia — já se tentou isso antes. Toda tentativa anterior sacrificou algo: precisão, capacidade de encontrar fatos enterrados longe no texto ou eficiência em si. Subquadratic, cofundada por @alex_whedon, afirma que finalmente resolveu os três ao mesmo tempo. — ➠ As Provas Benchmarkes verificados por terceiros: ▸ Empata com o Claude Opus 4.6 no RULER 128K (um teste de raciocínio com contexto longo) ▸ Supera o Opus 4.7, GPT 5.4 e Gemini 3.1 Pro no MRCR v2 (recuperação multi-evidência), mas perde para o Opus 4.6 e GPT 5.5 ▸ Supera o Opus 4.6 e Gemini 3.1 Pro no SWE-Bench (tarefas reais de programação), mas fica atrás do Opus 4.7 ▸ 52× mais rápido que o FlashAttention com 1 milhão de tokens ▸ Uma versão de pesquisa lida com 12 milhões de tokens usando aproximadamente 1.000× menos cálculo de atenção do que outros modelos de ponta Para resumir: isso não é “o melhor modelo do mundo”. É precisão de nível fronteiriço com um custo fundamentalmente mais baixo. — ➠ Onde Sam Altman Entra Duas das maiores afirmações públicas de Altman apontam para o mesmo problema que o SubQ está resolvendo. Sobre custo: Em seu post de fevereiro de 2025 “Three Observations”, Altman escreveu que o custo de usar IA cai cerca de 10× a cada 12 meses. Ele chamou isso de “incrivelmente mais forte” que a Lei de Moore. Sua tese: inferência mais barata é a força dominante que molda o que a IA pode se tornar. Sobre tamanho: Voltando a 2023, Altman disse que a era de modelos cada vez maiores acabou, e a verdadeira competição é capacidade por dólar. Ele comparou a corrida por parâmetros à corrida por GHz nos chips da década de 1990. Eixo errado. SubQ leva essas duas apostas literalmente. Seu slogan é “Eficiência é inteligência”. O detalhe: O caminho declarado por Altman para IA mais barata é progresso em hardware, otimização de software e distilação de modelos. Ele não endossou publicamente redesenhar a matemática da atenção. Então, a proposta do SubQ alinha-se com sua economia, mas também é uma aposta de que os grandes laboratórios deixaram um dólar arquitetural na mesa. — ➠ Por Que Isso Importa Se o SubQ entregar em escala produtiva: ▸ Códigos como uma única conversa. Nenhum sistema multi-agente mais precisando gerenciar arquivos. O modelo mantém todo o repositório. ▸ RAG se torna opcional. Muita infraestrutura atual de IA existe para compensar o teto quadrático. Remova o teto, e a estrutura se torna peso morto. ▸ Agentes de longa duração deixam de ser um truque. Sessões de dias com memória persistente tornam-se nativas. ▸ Novos aplicativos tornam-se possíveis. Cargas de trabalho antes muito caras (revisão completa de documentos, busca exaustiva por código, varredura de conformidade) tornam-se rotineiras. — ➠ As Reservas Honestas ▸ Está em beta privado. A confiabilidade em cenários reais ainda não foi testada. Até lá, trate o anúncio como um teaser — muitos suspeitam que seja apenas um ato performático. ▸ A pontuação no MRCR v2 (65,9%) é boa, mas fica atrás do Opus 4.6 (78,3%) e GPT 5.5 (74%). SSA é mais eficiente, não estritamente mais capaz. ▸ Os benchmarks são auto-publicados com verificação por terceiros. A replicação acadêmica é o verdadeiro teste. ▸ O resultado com 12M tokens é um modelo de pesquisa, não o produto final (que é de 1M). — ➠ Conclusão Final Por nove anos, toda IA baseada em transformer pagou o mesmo imposto quadrático. Subquadratic afirma que finalmente descobriu como não pagar. Os benchmarks sugerem que estão pelo menos na direção certa. Altman vem dizendo à indústria há três anos que capacidade por dólar é o novo campo de batalha. SubQ é uma das primeiras empresas tentando vencer essa luta mudando a matemática subjacente em vez de empilhar soluções alternativas. Se conseguirão ou não é agora uma questão empírica pública.

Compartilhar

Fonte:Mostrar original

Aviso legal: as informações nesta página podem ter sido obtidas de terceiros e não refletem necessariamente os pontos de vista ou opiniões da KuCoin. Este conteúdo é fornecido apenas para fins informativos gerais, sem qualquer representação ou garantia de qualquer tipo, nem deve ser interpretado como aconselhamento financeiro ou de investimento. A KuCoin não é responsável por quaisquer erros ou omissões, ou por quaisquer resultados do uso destas informações.

Os investimentos em ativos digitais podem ser arriscados. Avalie cuidadosamente os riscos de um produto e a sua tolerância ao risco com base nas suas próprias circunstâncias financeiras. Para mais informações, consulte nossos termos de uso e divulgação de risco.