Ketika semua orang fokus pada pertarungan di lapisan model, tim yang menguasai standar nyata inferensi open-source, dengan deretan investor seed terkemuka dari Silicon Valley, secara resmi mengarahkan fokusnya pada infrastruktur AI era baru.

Penulis artikel, sumber: Machine Learning Indonesia

Pada 5 Mei, perusahaan rintisan infrastruktur AI, RadixArk, mengumumkan penyelesaian pembiayaan seed senilai $100 juta, dengan valuasi pasca-investasi sebesar $400 juta. Baik dari segi jumlah, valuasi, maupun daftar investor, ini merupakan investasi awal terbesar hingga saat ini di lintasan AI Infra tahun 2026.

Putaran ini dipimpin oleh Accel, dengan Spark Capital sebagai co-leader. Investor institusional mencakup NVentures milik NVIDIA, AMD, MediaTek, Databricks, serta lembaga terkemuka seperti Salience Capital, HOF Capital, Walden Catalyst, A&E Investment, LDVP, dan WTT Fubon Family. Dari GPU hingga CPU, dari chip edge hingga platform data, hampir semua pemain kunci di tingkat perangkat keras inti dan lapisan sistem telah hadir.

Di luar kalangan institusi top, sejumlah pemimpin teknologi global dengan latar belakang Intel, Broadcom, OpenAI, xAI, PyTorch, juga berpartisipasi dalam putaran investasi ini sebagai malaikat investor.

CEO tiga raksasa perangkat keras + pendiri laboratorium model terkemuka + pencipta PyTorch, mengumpulkan kombinasi ini dalam satu putaran seed saja sangat jarang terjadi dalam sejarah AI Infra. Investor yang mengerti bidang ini secara langsung mengatakan: Ini adalah taruhan pada "standar fakta infrastruktur generasi berikutnya".

Mesin inferensi terbaik di dunia, di tangan mereka

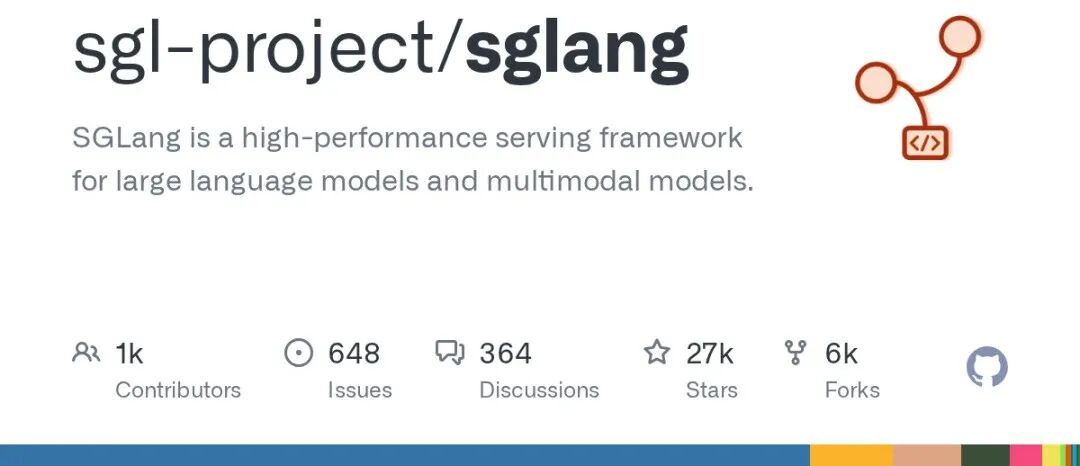

Cerita RadixArk harus dimulai dari proyek open source bernama SGLang.

Sejak diluncurkan pada 2023, SGLang dalam waktu dua tahun menjadi salah satu standar faktual untuk inferensi model besar open-source dengan kecepatan iterasi yang luar biasa, mengumpulkan lebih dari 27K bintang di GitHub dan telah dideploy pada lebih dari 400K GPU. Setiap hari, triliunan token lalu lintas produksi berjalan di atas SGLang, dengan penggunanya meliputi Google, Microsoft, NVIDIA, Oracle, AMD, LinkedIn, xAI, dan Thinking Machines Lab.

Dalam dua tahun terakhir, arsitektur model mengalami serangkaian perubahan besar, termasuk MoE, konteks panjang, model penalaran, dan integrasi multimodal. Setiap重塑 arsitektur, SGLang selalu menyediakan kompatibilitas Day-0—mekanisme pertama di dunia open-source yang mendukung model segera setelah rilis, dengan kinerja yang mendekati batas fisik mesin. Salah satu evaluasi yang sering disebut oleh investor adalah bahwa kecepatan iterasi SGLang dan gaya disiplin teknisnya merupakan yang terbaik di antara proyek open-source.

Di balik disiplin dasar ini, terdapat tim pendiri yang memiliki pengalaman mendalam di bidang sistem dan algoritma.

CEO Sheng Ying lulusan sarjana dari kelas ACM, Shanghai Jiao Tong University, dan meraih gelar doktor dari Stanford University. Ia adalah pendiri LMSYS Org dan salah satu pendiri utama SGLang. Selama masa doktoral, ia pernah menjadi peneliti tamu di UC Berkeley Sky Lab, dan sebelumnya bekerja di Databricks dan xAI, di mana ia pernah menjabat sebagai pemimpin tim inferensi xAI. Karya Sheng Ying dalam bidang sparsifikasi perhatian dan pemanfaatan ulang cache KV mendapat perhatian besar dari industri; mekanisme RadixAttention pada tahap awal SGLang merupakan salah satu karyanya yang paling terkenal.

CTO Zhu Banghua lulusan sarjana dari Departemen Teknik Elektronik, Tsinghua University, dan meraih gelar doktor dari UC Berkeley, di bawah bimbingan para ahli machine learning Michael I. Jordan dan Jiantao Jiao. Selama masa doktoral, ia bersama-sama mendirikan Nexusflow, yang kemudian diakuisisi oleh NVIDIA, dan menjabat sebagai Principal Research Scientist di NVIDIA. Proyek-proyek yang ia tangani mencakup pembangunan sistem pelatihan tingkat industri hingga optimasi sistem dasar internal NVIDIA dan pengalaman panjang dalam pelatihan berskala besar.

Seorang pemimpin teknis dari produsen perangkat keras inti menilai, ini adalah tim pendiri paling berharga dalam startup AI Infra tahun 2026: di satu sisi, seorang entrepreneur peneliti yang menguasai standar faktual inferensi open-source, di sisi lain, seorang ahli algoritma model besar dari lapisan penelitian paling inti pabrikan GPU.

Memegang mesin inferensi SGLang yang mampu memproses triliunan token per hari—ini sendiri sudah menjadi titik awal impian dalam bisnis AI Infra. Namun, kartu yang dimiliki tim ini tidak hanya satu ini saja.

Hari-0 Menaklukkan DeepSeek V4 Reinforcement Learning

Selain mesin inferensi, RadixArk juga mencapai terobosan di sisi pelatihan.

Pada November 2025, tim merilis kerangka kerja reinforcement learning bernama Miles, yang berfokus pada stabilitas dan efisiensi pelatihan RL berskala besar, dan kini telah digunakan oleh lebih dari 20 tim untuk pelatihan RL pada model MoE.

Pada tahun 2025–2026, persaingan dalam kemampuan Reasoning, Penggunaan Alat, dan Agentic meningkat secara komprehensif, dan setiap kemajuan di belakangnya memerlukan sistem yang mampu menangani RL terdistribusi berskala sangat besar. Para pengamat industri menyoroti titik nyeri yang sering disebut namun belum terpecahkan dalam jangka panjang: yang paling menyakitkan bagi tim model besar saat ini jauh melampaui setiap optimasi titik tunggal. Gesekan batas di sepanjang rantai lengkap dari pelatihan hingga RL hingga inferensi produksi, meskipun masing-masing bagian secara terpisah mendekati optimal, ketika digabungkan justru menurunkan efisiensi di mana-mana.

Kombinasi Miles dan SGLang berusaha menutup kesenjangan efisiensi yang dihadapi tim model besar di sepanjang rantai lengkap "pelatihan-RL-inferensi".

Kemampuan model baru Day-0 merupakan gambaran langsung dari keahlian teknis tim Infra.

Pada 25 April, DeepSeek-V4 yang memiliki arsitektur kompleks dirilis. Pada hari yang sama, SGLang dan Miles berhasil mendukung inferensi dan pelatihan RL untuk DeepSeek-V4 secara bersamaan. Ini dimungkinkan berkat optimasi sistem tingkat dasar tim, termasuk ShadowRadix prefix cache yang dirancang untuk perhatian hibrida, Flash Compressor yang melakukan kompresi dalam satu chip, Lightning TopK yang mengompres latensi Top-K menjadi 15 mikrodetik, serta integrasi lengkap jalur RL dari inferensi FP8 hingga pelatihan BF16.

Dukungan konsensus penuh:

Para raksasa masuk secara bersama-sama, apa yang mereka khawatirkan?

NVIDIA, AMD, MediaTek, Broadcom, Intel—perusahaan-perusahaan paling krusial di lapisan perangkat keras yang muncul bersamaan di putaran benih, hampir tidak mungkin terbayangkan dalam industri ini. Faktanya, produsen perangkat keras lebih memahami daripada siapa pun bahwa daya komputasi saat ini masih mahal dan langka, dan tidak mungkin berkelanjutan hanya dengan menambah perangkat keras. Sistem inferensi open-source yang benar-benar terpisah dari perangkat keras dan mampu memaksimalkan kinerja chip di platform heterogen adalah kebutuhan paling mendesak yang mereka cari.

Keterlibatan para tokoh utama dari Databricks, PyTorch, OpenAI/Thinking Machines/xAI secara bersamaan menandakan harapan kuat terhadap infrastruktur terpadu pelatihan-inferensi. Setiap nama dalam jajaran malaikat ini berarti sudut pandang taruhan yang sangat tepat:

- Chen Liwu, CEO Intel, tokoh legendaris dengan pengalaman puluhan tahun di industri semikonduktor.

- John Schulman adalah co-founder pendiri OpenAI, co-founder Thinking Machines Lab, dan salah satu perintis reinforcement learning.

- Soumith Chintala—ko-founder PyTorch, penjaga framework pembelajaran mendalam global.

- Igor Babuschkin, mantan co-founder xAI, secara langsung membangun sistem pelatihan dan platform perangkat keras paling kompleks di industri.

- Lilian Weng, co-founder of Thinking Machines Lab, memiliki wawasan paling langsung tentang penerapan industri sistem AI.

Ketika orang-orang yang mampu menggerakkan pendanaan sendiri di mana pun mereka berada memilih muncul secara kolektif di cap table yang sama, itulah taruhan masa depan yang penuh semangat.

Infrastruktur untuk semua: Memastikan hak membangun AI tidak lagi dimonopoli oleh segelintir orang

Visi RadixArk, dapat diringkas dalam satu kalimat: menjadikan infrastruktur AI sebagai barang publik yang sepopuler dan seandal listrik, serta tidak dimonopoli oleh siapa pun. Ini terdengar seperti deklarasi idealis, tetapi dari segi implementasi nyata, mereka sedang mengubah kalimat ini menjadi kenyataan:

- Akademik

Tiga tahun lalu, seorang mahasiswa doktoral yang fokus pada optimasi inferensi LLM biasanya hanya memiliki dua pilihan: satu adalah API OpenAI, yang dibayar berdasarkan token dan tidak memperlihatkan struktur internal apa pun; yang lainnya adalah kode sumber terbuka lawas, dengan README yang menyatakan “berjalan pada satu GPU”, jauh dari skenario distribusi nyata yang diinginkan dalam paper, dengan jarak puluhan tahun upaya teknis.

SGLang mengakhiri pilihan biner ini—throughput harian tingkat industri, kode sepenuhnya terbuka, grup penelitian sistem dari Stanford, Berkeley, CMU, dan UW secara default menjadikannya baseline. Bagi peneliti agent, prefix cache RadixAttention mengorganisasi awalan bersama menjadi struktur pohon, sehingga KV yang sama hanya dihitung sekali; eksperimen yang sebelumnya memakan waktu dua hari kini bisa selesai dalam setengah hari, dan mengutip SGLang dalam paper lokal hampir menjadi tindakan default.

- Startup

Sekelompok insinyur yang meninggalkan perusahaan besar, memulai startup dengan pemahaman mendalam tentang sebuah skenario vertikal. Mereka tidak memiliki anggaran komputasi jutaan dolar, tidak memiliki tim Infra khusus, hanya memiliki intuisi kuat terhadap produk.

Dulu, membangun pipeline inferensi tingkat produksi dan mempertahankan beban teknis kompatibilitas lintas perangkat keras seringkali melebihi batas kemampuan perusahaan tahap seed, sehingga banyak waktu terbuang untuk membuat ulang hal yang sama. Sekarang, mereka dapat langsung membangun layanan inferensi dengan performa mendekati terkini di atas SGLang, serta melatih model khusus domain menggunakan Miles—infrastructure bukan lagi hambatan, waktu dan biaya yang dihemat dapat sepenuhnya dialokasikan untuk membangun hal-hal yang benar-benar ingin mereka ciptakan.

- Raksasa teknologi

Mengapa perusahaan raksasa dengan infrastruktur internal terkuat di dunia seperti Google, Microsoft, dan NVIDIA juga muncul dalam daftar pengguna SGLang? Jawabannya tersembunyi dalam struktur investor putaran ini—lima produsen perangkat keras inti, yaitu NVIDIA, AMD, MediaTek, Broadcom, dan Intel, secara bersama-sama masuk. Mereka lebih tahu daripada siapa pun betapa pentingnya sebuah sistem inferensi open-source yang independen dari perangkat keras dan tidak terikat pada pesaing mana pun bagi seluruh ekosistem. Menggunakan sistem open-source yang dipelihara bersama oleh komunitas dan didukung secara bersama oleh beberapa produsen perangkat keras, pada dasarnya merupakan strategi infrastruktur pada tingkat yang lebih tinggi.

Pernyataan resmi RadixArk tidak bersifat emosional, tetapi cukup tajam:

AI generasi berikutnya seharusnya tidak dibatasi oleh akses terhadap infrastruktur pribadi. Lebih banyak tim seharusnya mampu memiliki model mereka sendiri, sistem mereka sendiri, masa depan mereka sendiri.

Seed round senilai 100 juta dolar AS ini bertujuan untuk mewujudkan pernyataan ini menjadi kenyataan teknis: menjadikan SGLang sebagai standar produksi Day-0 untuk setiap model baru; menjadikan Miles sebagai kerangka kerja tingkat infrastruktur untuk pelatihan skala besar dan RL; kemudian, membangun platform terkelola yang tidak mengunci model atau memikat pelanggan, tetapi menyediakan kemampuan infrastruktur tingkat atas di atas inti open-source.

Visi RadixArk bukanlah untuk menggantikan siapa pun. Tetapi untuk memastikan bahwa sebuah laboratorium akademis, sebuah tim tiga orang, sebuah startup yang baru mendapatkan pendanaan seed, dan raksasa dengan kapitalisasi pasar triliunan—semuanya berada di garis start infrastruktur yang sama.

Jika Anthropic tahun 2023, Mistral tahun 2024, dan Thinking Machines Lab tahun 2025 masing-masing mewakili taruhan strategis pada lapisan model AI, maka RadixArk tahun 2026 bertaruh pada sesuatu yang lebih mendasar dan lebih panjang: memastikan bahwa hak untuk membangun AI mutakhir benar-benar kembali ke tangan cukup banyak orang.

Setelah pendanaan selesai, tim memulai inisiatif pengembalian kepada komunitas open source: ikut mendaftar di platform dan membagikan tweet, maka Anda akan mendapatkan poin penggunaan gratis setelah platform RadixArk secara resmi diluncurkan. Bagi tim yang tumbuh dari komunitas open source, ini adalah bentuk terima kasih nyata dalam bentuk daya komputasi nyata kepada mereka yang telah mendukung SGLang hingga hari ini.

- Tautan: platform.radixark.com