Penulis: Deep潮 TechFlow

Sebuah makalah yang mengklaim "mengompresi penggunaan memori AI hingga 1/6" minggu lalu menyebabkan kapitalisasi pasar lebih dari 90 miliar dolar AS menguap pada saham chip penyimpanan global seperti Micron dan SanDisk.

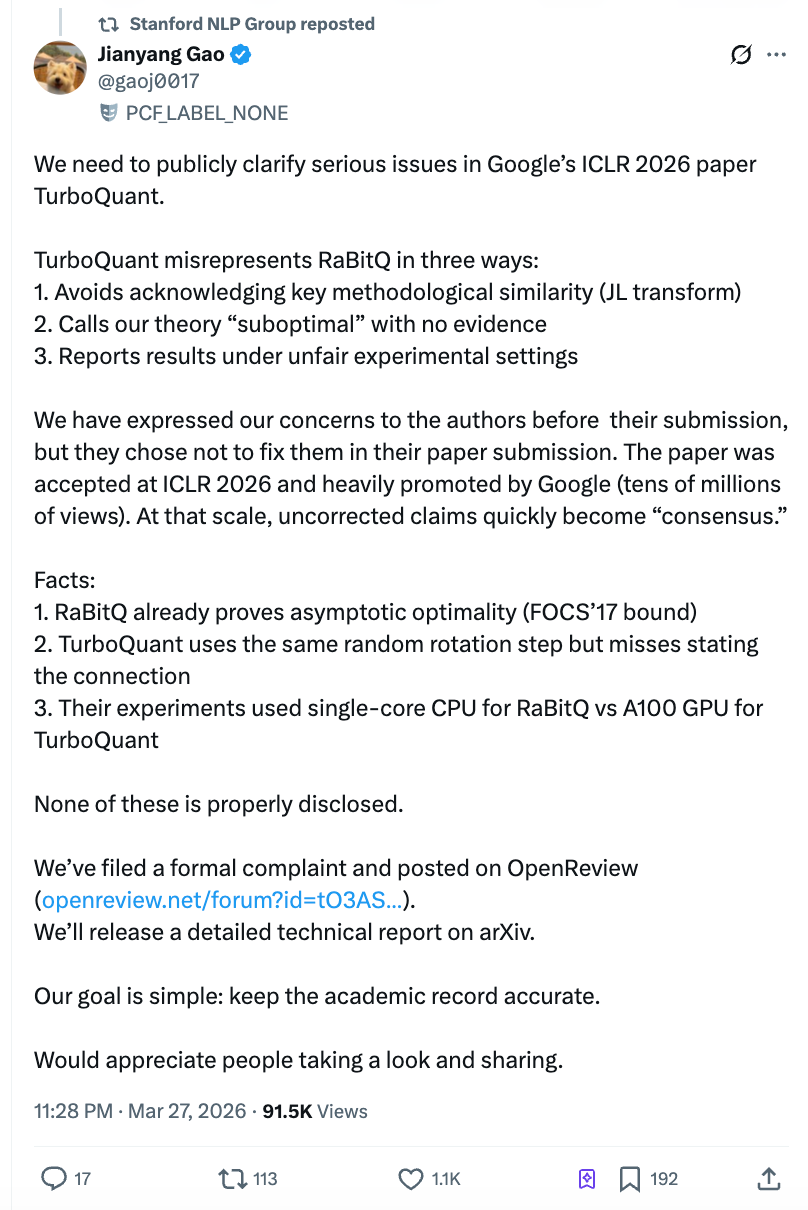

Namun, hanya dua hari setelah makalah diterbitkan, peneliti pascadoktoral dari ETH Zurich, Gao Jianyang, yang menjadi pihak yang "dihancurkan" oleh algoritma tersebut, menerbitkan surat terbuka beribu-ribu kata, menuduh tim Google menguji lawan mereka menggunakan skrip Python berjalan di CPU inti tunggal, sementara menggunakan GPU A100 untuk menguji diri mereka sendiri, dan tetap menolak memperbaiki masalah tersebut meskipun telah diberi tahu sebelum pengiriman. Jumlah pembaca di Zhihu segera melebihi 4 juta, akun resmi Stanford NLP membagikannya, dan dunia akademik serta pasar berguncang secara bersamaan.

(Bacaan referensi: sebuah makalah yang menurunkan saham penyimpanan)

Masalah inti dalam kontroversi ini tidak rumit: Apakah makalah konferensi AI yang secara massal didorong oleh Google resmi dan langsung memicu penjualan panik di sektor chip, secara sistematis melemahkan karya pendahulu yang telah dipublikasikan, dan menciptakan narasi keunggulan kinerja yang salah melalui eksperimen yang sengaja tidak adil?

Apa yang dilakukan TurboQuant: menipiskan "kertas coretan" AI menjadi seperenam dari ukuran semula

Saat model bahasa besar menghasilkan jawaban, ia perlu menulis sambil terus memeriksa kembali konten yang telah dihitung sebelumnya. Hasil sementara ini disimpan sementara di memori GPU, yang dalam industri disebut sebagai «KV Cache». Semakin panjang percakapan, semakin tebal «kertas kerja» ini, semakin besar konsumsi memori GPU, dan semakin tinggi biayanya.

Algoritma TurboQuant yang dikembangkan oleh tim peneliti Google, fitur utamanya adalah memampatkan lembaran draf ini menjadi 1/6 dari ukuran aslinya, sekaligus mengklaim tidak ada kehilangan akurasi dan kecepatan inferensi meningkat hingga 8 kali lipat. Makalah ini pertama kali dipublikasikan di platform preprint akademik arXiv pada April 2025, diterima oleh konferensi top bidang AI, ICLR 2026, pada Januari 2026, dan pada 24 Maret diangkat kembali oleh blog resmi Google untuk promosi.

Secara teknis, pendekatan TurboQuant dapat dipahami secara sederhana sebagai berikut: pertama, menggunakan transformasi matematis untuk membersihkan data yang kacau menjadi format yang seragam, kemudian mengompresinya satu per satu menggunakan tabel kompresi optimal yang telah dihitung sebelumnya, dan akhirnya memperbaiki bias komputasi yang diakibatkan oleh kompresi dengan mekanisme koreksi kesalahan 1 bit. Implementasi independen oleh komunitas telah memverifikasi bahwa efek kompresinya pada dasarnya nyata, dan kontribusi matematis pada tingkat algoritma adalah nyata.

Masalahnya bukan apakah TurboQuant bisa digunakan, tetapi apa yang dilakukan Google untuk membuktikan bahwa ia “jauh melampaui pesaing”.

Surat Terbuka Gao Jianyang: Tiga Tuduhan, Semuanya Mengena pada Intinya

Pada 27 Maret pukul 22:00, Gao Jianyang memposting artikel panjang di Zhihu, sekaligus mengirimkan komentar resmi di platform tinjauan resmi ICLR, OpenReview. Gao Jianyang adalah penulis pertama algoritma RaBitQ, yang diterbitkan pada tahun 2024 di konferensi top bidang database SIGMOD, dan menyelesaikan masalah yang sama—kompresi efisien vektor berdimensi tinggi.

Klaimnya terdiri dari tiga poin, masing-masing didukung oleh catatan email dan garis waktu.

Tuduhan satu: Menggunakan metode inti orang lain, tanpa menyebutkan sama sekali.

Langkah kunci bersama dalam inti teknis TurboQuant dan RaBitQ adalah melakukan "rotasi acak" pada data sebelum dikompresi. Operasi ini berfungsi untuk mengubah data yang distribusinya tidak teratur menjadi distribusi seragam yang dapat diprediksi, sehingga secara signifikan mengurangi kesulitan kompresi. Ini adalah bagian paling inti dan paling mirip antara kedua algoritma tersebut.

Penulis TurboQuant sendiri mengakui hal ini dalam tanggapan tinjauan, namun tidak pernah secara terbuka menjelaskan hubungan metode ini dengan RaBitQ dalam seluruh isi paper. Latar belakang yang lebih penting adalah: co-penulis TurboQuant, Majid Daliri, secara aktif menghubungi tim Gao Jianyang pada Januari 2025 untuk meminta bantuan dalam memperbaiki versi Python yang dimodifikasi dari kode sumber RaBitQ. Email tersebut menjelaskan langkah-langkah replikasi dan informasi kesalahan secara rinci—dengan kata lain, tim TurboQuant sangat memahami detail teknis RaBitQ.

Seorang reviewer anonim ICLR juga secara independen menunjukkan bahwa keduanya menggunakan teknologi yang sama, dan meminta diskusi yang memadai. Namun, dalam versi akhir makalah, tim TurboQuant tidak hanya tidak menambahkan diskusi, tetapi juga memindahkan deskripsi RaBitQ yang (sudah tidak lengkap) dari tubuh utama ke lampiran.

Klaim kedua: Menyatakan teori pihak lain sebagai "suboptimal" tanpa dasar.

Paper TurboQuant secara langsung memberi label pada RaBitQ sebagai "suboptimal secara teoretis" dengan alasan bahwa analisis matematis RaBitQ "cukup kasar". Namun, Gao Jianyang menunjukkan bahwa paper versi ekstensi RaBitQ telah membuktikan secara ketat bahwa kesalahan kompresinya mencapai batas optimal secara matematis—kesimpulan ini telah dipublikasikan di konferensi terkemuka dalam ilmu komputer teoretis.

Pada Mei 2025, tim Gao Jianyang pernah menjelaskan secara rinci melalui serangkaian email mengenai optimalitas teori RaBitQ. Daliri, penulis kedua TurboQuant, mengonfirmasi telah memberitahu seluruh penulis. Namun, artikel tersebut tetap mempertahankan formulasi "suboptimal" tanpa memberikan argumen pembantah apa pun.

Tuduhan ketiga: Dalam perbandingan eksperimen, «tangan kiri mengikat orang, tangan kanan memegang pisau».

Ini adalah poin paling mematikan dalam seluruh teks. Gao Jianyang menunjukkan bahwa paper TurboQuant menambahkan dua lapis kondisi tidak adil dalam eksperimen perbandingan kecepatan:

Pertama, RaBitQ resmi menyediakan kode C++ yang dioptimasi (secara default mendukung paralelisasi multithread), tetapi tim TurboQuant tidak menggunakannya, melainkan menggunakan versi Python hasil terjemahan sendiri untuk menguji RaBitQ. Kedua, saat menguji RaBitQ digunakan CPU single-core dengan multithread dinonaktifkan, sedangkan TurboQuant menggunakan GPU NVIDIA A100.

Efek dari dua kondisi ini adalah: pembaca menyimpulkan bahwa "RaBitQ lebih lambat beberapa orde daripada TurboQuant", tetapi tidak tahu bahwa kesimpulan ini didasarkan pada asumsi bahwa tim Google mengikat tangan dan kaki lawan sebelum berlomba. Perbedaan kondisi eksperimen ini tidak diungkapkan secara memadai dalam makalah.

Respons Google: "Pemutaran acak adalah teknologi umum, tidak mungkin menyertakan referensi untuk setiap artikel."

Menurut Gao Jianyang, tim TurboQuant dalam balasan email bulan Maret 2026 menyatakan: "Penggunaan rotasi acak dan transformasi Johnson-Lindenstrauss sudah menjadi teknik standar di bidang ini, dan kami tidak mungkin mengutip setiap makalah yang menggunakan metode-metode ini."

Tim Gao Jianyang percaya ini adalah perubahan konsep: masalahnya bukan apakah semua paper yang menggunakan rotasi acak harus dirujuk, tetapi bahwa RaBitQ adalah karya pertama yang menggabungkan metode ini dengan kompresi vektor dan membuktikan optimalitasnya dalam pengaturan masalah yang persis sama, sehingga paper TurboQuant seharusnya menggambarkan hubungan keduanya secara akurat.

Akun X resmi Stanford NLP Group membagikan pernyataan dari Gao Jianyang. Tim Gao Jianyang telah menerbitkan komentar publik di platform ICLR OpenReview dan mengajukan keluhan resmi kepada ketua konferensi ICLR serta komite etika, serta akan merilis laporan teknis rinci di arXiv selanjutnya.

Bloger teknis independen Dario Salvati memberikan evaluasi yang relatif netral dalam analisisnya: TurboQuant memang memiliki kontribusi nyata dalam metode matematis, tetapi hubungannya dengan RaBitQ jauh lebih erat daripada yang dinyatakan dalam makalah.

Nilai pasar senilai $90 miliar menguap: kontroversi makalah ditambah kepanikan pasar

Titik waktu terjadinya perdebatan akademis ini sangat sensitif. Setelah Google merilis TurboQuant melalui blog resmi pada 24 Maret, sektor chip penyimpanan global mengalami penjualan massal. Menurut laporan dari CNBC dan media lainnya, Micron Technology mengalami penurunan selama enam hari perdagangan berturut-turut, dengan total penurunan lebih dari 20%; SanDisk anjlok 11% dalam satu hari; SK Hynix dari Korea turun sekitar 6%, Samsung Electronics turun hampir 5%, dan Kioxia dari Jepang turun sekitar 6%. Logika kepanikan pasar sangat sederhana dan langsung: kompresi perangkat lunak dapat mengurangi kebutuhan memori untuk inferensi AI hingga 6 kali lipat, sehingga prospek permintaan chip penyimpanan akan mengalami penurunan struktural.

Analyst Joseph Moore dari Morgan Stanley membantah logika ini dalam laporan riset pada 26 Maret, mempertahankan peringkat "Beli" untuk Micron dan SanDisk. Moore menunjukkan bahwa TurboQuant hanya mengompresi jenis cache tertentu, yaitu KV Cache, bukan penggunaan memori secara keseluruhan, dan menggolongkannya sebagai "peningkatan produktivitas normal". Analis dari Wells Fargo, Andrew Rocha, juga mengutip Paradox Jevons, berpendapat bahwa peningkatan efisiensi yang menurunkan biaya justru dapat merangsang penerapan AI dalam skala lebih besar, pada akhirnya meningkatkan permintaan memori.

Kertas lama, kemasan baru: Risiko rantai transmisi dari penelitian AI ke narasi pasar

Menurut analisis teknis dari Ben Pouladian, makalah TurboQuant telah dirilis secara publik pada April 2025, bukan penelitian baru. Pada 24 Maret, Google kembali mempromosikannya melalui blog resmi, namun pasar menilainya sebagai terobosan baru. Strategi pemasaran "makalah lama, rilis baru" ini, ditambah kemungkinan bias eksperimen dalam makalah tersebut, mencerminkan risiko sistemik dalam rantai transmisi dari penelitian AI ke narasi pasar.

Bagi investor infrastruktur AI, ketika sebuah makalah menyatakan pencapaian peningkatan kinerja «beberapa orde besar», hal pertama yang perlu ditanyakan adalah apakah kondisi pembandingan baseline adil.

Tim Gao Jianyang telah menyatakan dengan jelas akan terus mendorong penyelesaian resmi terhadap masalah ini. Pihak Google belum memberikan tanggapan resmi terhadap tuduhan spesifik dalam surat terbuka tersebut.