Tiga puluh hari gila ini, sebelas model besar, seperti pertunjukan kembang api yang ramai.

Penulis artikel, sumber: 0x9999in1, ME News

TL;DR

- Tiga puluh hari penuh persaingan sengit: Dari 26 Maret hingga 24 April, diluncurkan 11 model besar penting secara global, rata-rata satu model setiap 2,7 hari. Pasar mengalami "kelelahan parameter" yang serius.

- Operasi pelangsingan untuk Parameter Gourmet: Total parameter V4-Pro mencapai 1,6T, tetapi hanya 49B yang diaktifkan. Melalui arsitektur CSA+HCA, FLOPs turun menjadi 27% pada konteks 1M, dan cache KV turun hingga 10% yang sangat menakjubkan.

- Pemisahan generasi alkimia: Memperkenalkan paradigma pasca-pelatihan pertama “pembelajaran penguatan independen terlebih dahulu, lalu penggabungan distilasi daring”, V4-Pro-Max mendekati batas tertinggi closed-source dalam inferensi dan tugas Agent.

- Suara nyata yang berharga: GPT-5.5 hanya mendorong Nvidia naik 4,2% dalam satu hari sebelum mencapai puncaknya, sementara V4 yang sepenuhnya open source dari MIT benar-benar memicu kenaikan berkelanjutan pada rantai komputasi lokal Tiongkok dan Hong Kong.

- Logika permainan mendalam: Model tertutup menjual "pajak", model terbuka besar menjual "besi". Munculnya V4 membuat buku catatan kekuatan komputasi untuk penerapan privat perusahaan global akhirnya seimbang.

April yang penuh gejolak para dewa, bersama kelelahan estetika pasar

Gila. Semuanya gila.

Jika Anda adalah pengamat yang fokus pada sektor AI, tiga puluh hari terakhir ini kemungkinan besar akan membuat Anda merasa tidak nyaman secara fisik. Dari 26 Maret 2026 hingga 24 April, dalam waktu kurang dari sebulan, setidaknya 11 model besar dengan dampak signifikan telah diluncurkan ke pasar.

Daftar panjang seperti sedang membacakan menu: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

Serta, pada dini hari 23 April, DeepSeek V4 secara diam-diam diluncurkan seperti sebuah bom dalam.

Rata-rata, satu model baru muncul setiap 2,7 hari. Ini adalah kecepatan yang bahkan manajer dana tidak sempat membaca rilisnya. Investor baru saja mendengar "melebihi parameter" dari perusahaan A, dan "mengalahkan skor" dari perusahaan B sudah sampai di meja mereka. Pasar sebenarnya sudah mati rasa. Yang disebut "brankas Benchmark" di era persaingan ketat saat ini semakin terasa seperti permainan angka yang bersifat hiburan sendiri.

Tapi uang itu cerdas. Atau, candlestick tidak pernah berbohong.

Telusuri kembali k-line aset AI Tiongkok, Amerika Serikat, dan Hong Kong selama 30 hari terakhir, Anda akan menemukan kenyataan yang sangat kejam: Dalam perang "pertarungan para dewa" ini, hanya dua titik yang mampu meninggalkan jejak berkelanjutan di chart.

Pertama, pada 8 April, OpenAI di seberang lautan merilis GPT-5.5. Sang raja yang tak terbantahkan ini langsung mendorong Nvidia naik 4,2% dalam satu hari. Lalu? Tidak ada lagi, harga mencapai puncaknya dalam sehari, kabar baik sudah habis. Orang-orang menyadari, sehebat apa pun raja closed-source sekalipun, sulit lagi untuk menggerakkan gunung modal global yang berat seperti dua tahun lalu.

Node kedua, yaitu 23 hingga 24 April. Versi pratinjau DeepSeek V4 dirilis. Tidak ada peluncuran megah, tidak ada video promosi yang mengesankan. Bobot langsung diunggah ke Hugging Face dan ModelScope, dengan lisensi MIT.

Hasilnya? Itu mendorong rantai daya komputasi Tiongkok-Hong Kong keluar dari kenaikan lompatan berturut-turut.

Mengapa hal yang tidak bisa dicapai oleh sejumlah besar model tertutup berhasil dicapai oleh sebuah model terbuka?

Untuk menjawab pertanyaan ini, kita harus seperti seorang pencerita, meninggalkan siaran pers yang membosankan, membuka kap mesin DeepSeek V4, dan melihat apa monster yang tersembunyi di dalamnya.

Menganalisis V4: Tidak Lagi Percaya pada Estetika Kekerasan Parameter

Model besar. Sangat boros biaya. Hal ini sudah diketahui semua orang.

Tahun lalu, produsen model besar terjebak dalam "fobia kurangnya daya tembak". Anda membuat satu triliun, saya membuat dua triliun. Semua orang percaya bahwa semakin besar daya, semakin banyak kecerdasan yang muncul dan dapat menyelesaikan semua masalah. Namun, hal ini membawa biaya komputasi yang sangat menakutkan. Persediaan biji-bijian tuan tanah pun tidak cukup untuk dibakar.

DeepSeek V4 kali ini meluncurkan dua model MoE (Mixture of Experts): V4-Pro dan V4-Flash. Mari kita lihat beberapa data inti terlebih dahulu.

V4-Pro: Total parameter 1.6T (1.6 trillion), but only 49B (49 billion) parameters activated per token.

V4-Flash: Total parameter 284B (284 miliar), hanya 13B (13 miliar) parameter yang diaktifkan.

Mengerti? Ini adalah pendekatan sangat terkendali yang "menggerakkan seribu pon dengan empat ons." Inti dari arsitektur MoE adalah tidak perlu mengaktifkan semua alarm setiap saat. Untuk tugas yang hanya membutuhkan ayam, gunakan beberapa ahli ayam; untuk tugas yang membutuhkan naga, baru panggil pedang pembunuh naga. Dasar 1,6 triliun menjamin bahwa ia "berpengalaman dan berpengetahuan luas"; aktivasi 49 miliar menjamin bahwa ia "bereaksi cepat dan lincah."

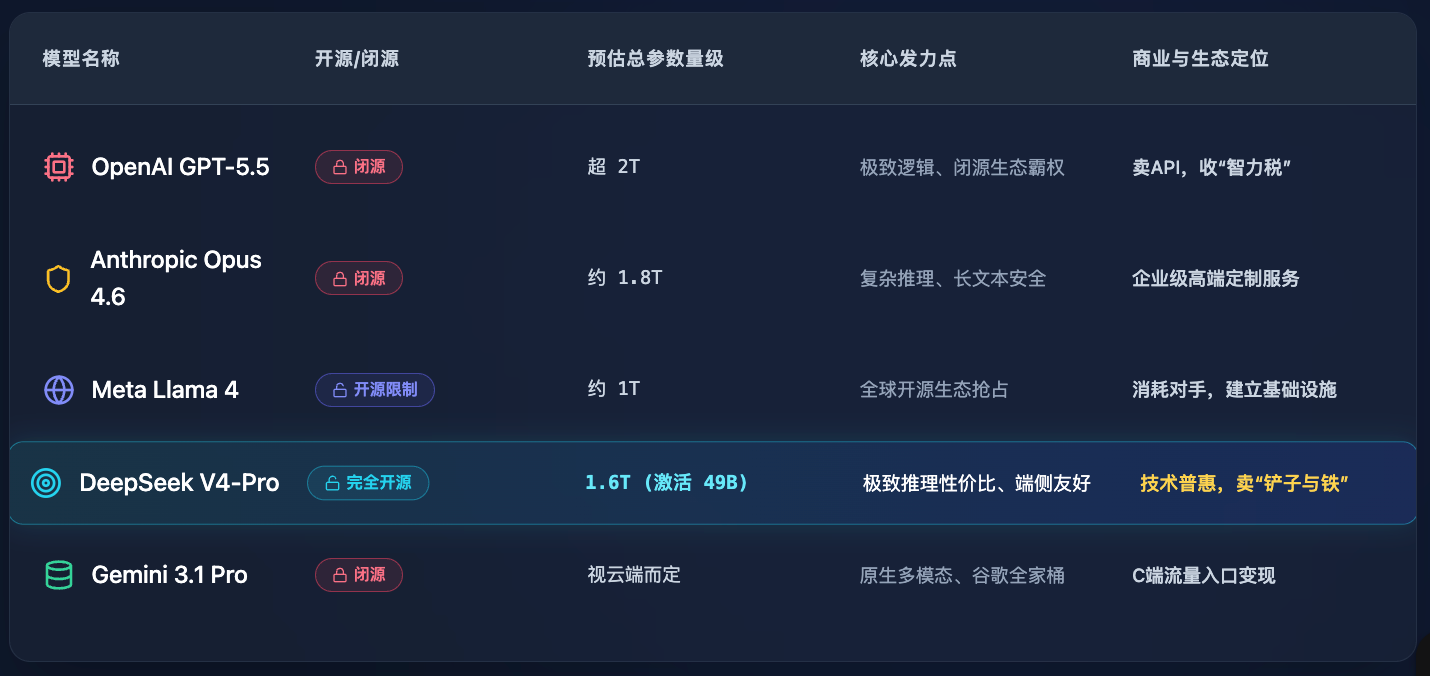

Untuk memahami perbedaan ini secara lebih intuitif, kami menyajikan tabel yang membandingkan jalur utama di pasar saat ini (data merupakan estimasi dan perhitungan publik pasar):

Dari tabel dapat dilihat, V4-Pro tidak semata-mata mengejar melebihi GPT-5.5 dalam total parameter, tetapi seluruh upayanya difokuskan pada "bagaimana membuat raksasa ini makan lebih sedikit dan berlari lebih cepat".

Tetapi itu belum cukup. Yang membuat para ahli terkejut adalah pembantaian tanpa ampun terhadap "pembunuh VRAM".

Hari Kiamat bagi Memory Assassin: Tiga Pisau Pembedah Arsitektur

Apa itu "memory killer"? Itu adalah "konteks panjang (Long Context)".

Sekarang semua pihak mempromosikan dukungan mereka terhadap 1M (seratus ribu) konteks token. Terdengar sangat menarik—seluruh buku "Tiga Kerajaan" bisa dimasukkan, dan ia bisa membacanya dalam beberapa detik. Tapi apa harganya? Saat inferensi, teks panjang menghasilkan cache KV yang sangat besar (penggunaan memori GPU untuk menyimpan informasi historis). Ini seperti setiap kali Anda membaca satu halaman buku, Anda harus menyalin isi halaman sebelumnya ke papan hitam besar dan meletakkannya di depan Anda. Ketika Anda sampai pada kata ke seratus ribu, papan hitamnya begitu banyak hingga tidak muat di ruang server Zhongguancun.

Memori, lebih mahal daripada daya komputasi. Ini adalah aturan tak tertulis di industri AI.

Bagaimana DeepSeek V4 memecahkan masalah ini? Mereka langsung melakukan "operasi bedah" pada mekanisme perhatian dasar. Ini adalah pisau pertama, sekaligus paling tajam, dalam peningkatan arsitektur mereka: mekanisme perhatian hibrida (CSA + HCA).

CSA (Compressed Sparse Attention) ditambah HCA (Heavy Compressed Attention), terdengar seperti bahasa Mars, tapi jika diterjemahkan ke bahasa sehari-hari: itu tidak lagi menghafal secara membabi buta, melainkan belajar untuk "menandai poin penting" dan "membuat catatan ringkas".

Efeknya sangat drastis: di bawah konteks 1M, FLOPs (jumlah operasi titik mengambang) untuk inferensi satu token V4-Pro hanya 27% dari generasi sebelumnya V3.2! Yang lebih menakutkan lagi, cache KV hanya 10% dari V3.2!

Apa konsep ini? Sebelumnya, tugas teks panjang seratus ribu kata yang memerlukan 10 server kelas atas untuk menjalankannya sepenuhnya, sekarang bisa diselesaikan dengan mudah oleh hanya satu server. Biaya komputasi langsung turun menjadi sepertiganya. Ini adalah optimasi yang revolusioner.

Masih ada dua pisau.

Pisau kedua disebut "manifold-constrained hyperconnection (mHC)". Pada model besar sebelumnya, transmisi informasi antar lapisan menggunakan "residual connection tradisional", seperti menggunakan pipa besi tua yang berkarat untuk mengalirkan air—tekanan tinggi akan menyebabkan kebocoran. Menghadapi data pelatihan awal sebesar 32T token, pipa lama tidak mampu menahan beban. mHC ibarat mengganti dengan jaringan serat optik, meningkatkan stabilitas propagasi sinyal lintas lapisan. Tidak ada packet loss, tidak ada penyimpangan.

Pisau ketiga, ganti oli mesin. Tinggalkan tradisi, gunakan optimizer Muon. Alat ini berfungsi mempercepat konvergensi. Sementara orang lain membutuhkan tujuh tujuh empat puluh sembilan hari untuk menyempurnakan satu resep obat, ini mungkin sudah siap dalam dua puluh hari. Waktu adalah uang, waktu komputasi adalah dolar.

Tiga potongan pisau ini benar-benar menyembuhkan "penyakit kaya" pada model besar V4.

Rahasia di dalam Tongue Pemurnian: Dari Perjuangan Sendiri-sendiri Menuju Satu Kebenaran Tunggal

Orang dalam industri model besar tahu bahwa pre-training hanya mengubah seorang "buta huruf" menjadi "orang yang tahu banyak hal tapi tidak bisa berbicara". Yang benar-benar menjadikannya seorang ahli luar biasa adalah post-training.

DeepSeek V4 dalam pelatihan lanjutan, menerapkan strategi "dua tahap" yang sangat intensif.

Dulu, orang-orang melatih MoE seperti sekelompok guru mengajar satu siswa, mudah sekali bertengkar. V4 bagaimana melakukannya?

Tahap pertama: "Bertanding sendiri-sendiri". Ini memanfaatkan pembelajaran penguatan SFT (supervised fine-tuning) dan GRPO (group relative policy optimization) untuk memisahkan masing-masing "jaringan ahli" dalam model dan melatihnya secara terpisah. Ahli pemrograman berlatih menulis kode setiap hari, sementara ahli matematika terus mengerjakan soal-soal matematika. Tidak saling terkait, tidak saling mengganggu. Ini disebut mendorong kemampuan titik tunggal hingga maksimal.

Tahap kedua: “Sepuluh Ribu Metode Kembali ke Satu Sumber”. Melalui teknik distilasi online, para ahli yang telah menguasai seni bela diri luar biasa ini digabungkan menjadi satu model yang utuh dan seragam. Tanpa pemborosan internal, tanpa lag.

Mari kita lihat dua "senjata andalan" yang mereka paksa keluar.

Pertama adalah mode V4-Pro-Max. Ini adalah mode dengan daya inferensi tertinggi. Ini seperti melepaskan kunci genetik. Menurut klaim mereka (dan segera diverifikasi oleh komunitas), dalam pengujian benchmark pemrograman, V4-Pro telah mencapai tingkat teratas, sementara kesenjangan dengan model tertutup terdepan (seperti GPT-5.5, Opus 4.6) dalam tugas inferensi kompleks dan Agent (agen) secara signifikan menyempit.

Kedua adalah V4-Flash-Max. Ini lebih menarik. Ia hanyalah model kecil berukuran 284B, tetapi setelah diberi cukup anggaran pemikiran, kinerja inferensinya bisa mendekati Pro. Apa artinya ini? Artinya "kualitas algoritma" mulai mengalahkan "jumlah parameter". Selama Anda memberinya waktu cukup untuk berpikir, otak kecil pun bisa menyelesaikan masalah besar. Tentu saja, dalam hal penyimpanan pengetahuan murni dan tugas Agent multi-langkah yang sangat kompleks, ia masih terbatas oleh ukuran parameter (toh perutnya hanya sebesar itu), tetapi ini sudah lebih dari cukup untuk sebagian besar aplikasi sehari-hari tingkat perusahaan.

Terakhir, penyimpanan bobot secara sangat cerdas menggunakan penyimpanan presisi campuran FP4+FP8. Sekaligus menjaga presisi dan menghemat memori GPU. Setiap aspeknya memancarkan daya tarik ilmuwan teknik yang hemat.

Untuk membandingkan peningkatan efisiensi teknis yang dihasilkan dari pelatihan pasca ini dengan lebih jelas, kami menyajikan tabel perbandingan indikator teknis:

Naluri modal: Mengapa V4 memicu rantai daya komputasi Tiongkok-Hong Kong?

Sampai di sini, analisis teknis hampir selesai. Tetapi kita belum menjawab pertanyaan mendasar yang diajukan di awal:

Mengapa GPT-5.5 tidak membuat sektor komputasi terus bergairah, sementara DeepSeek V4 mampu melakukannya?

Ini memerlukan kita untuk keluar dari kode dan melihat permainan ini dari sudut pandang modal dan bisnis.

GPT-5.5 sangat kuat, tak terkalahkan kuatnya. Tetapi itu bersifat tertutup. Apa artinya tertutup? Artinya OpenAI adalah "lubang hitam" raksasa. Jika Anda ingin menggunakan kemampuannya, Anda harus membeli API-nya. Ini adalah model "pemungutan pajak". Keuntungan mengalir ke Silicon Valley, dan permintaan komputasi terkonsentrasi di pusat data cloud Microsoft. Bagi produsen perangkat keras global, pusat komputasi lokal, dan agen server di berbagai negara, selain melihat dari jauh, mereka tidak mendapat banyak bagian. Seberapa kuat pun GPT-5.5, itu tetap menjadi pesta orang lain. NVIDIA naik karena orang-orang percaya OpenAI akan membeli lebih banyak kartu lagi.

Namun DeepSeek V4 berbeda.

Ini bersifat open source. Dan merupakan lisensi MIT yang sangat ketat. Lisensi MIT adalah sumbangan paling murah hati di dunia open source, yang berarti perusahaan komersial dapat menggunakannya, memodifikasinya, dan menjualnya secara gratis tanpa khawatir akan risiko hukum.

Yang lebih mematikan, kami sebelumnya telah menghabiskan banyak ruang untuk membuktikan bahwa V4 memangkas biaya inferensi model dan penggunaan memori GPU hingga ke pergelangan kaki.

Menggabungkan kedua poin ini, Anda akan sampai pada kesimpulan yang membuat pasar modal gila: titik kritis untuk pelaksanaan privat telah benar-benar tiba.

Dulu, perusahaan yang ingin mengimplementasikan model besar lebih dari 1T melihat daftar harga perangkat keras, diam-diam menutupnya, dan beralih membeli API. Sekarang, V4 memberi tahu semua orang: Anda hanya memerlukan sedikit mesin untuk menjalankan otak super di lokasi yang hampir setara dengan GPT-4 atau bahkan menantang level GPT-5.5. Data tidak perlu keluar provinsi, apalagi keluar negeri, benar-benar aman.

Karena semua orang sekarang bisa menjalankannya secara lokal, apa yang akan terjadi selanjutnya?

Beli mesin! Beli server! Beli modul optik! Bangun pusat komputasi cerdas!

Perusahaan tertutup menjual pajak kecerdasan, sementara perusahaan open-source pada dasarnya sedang mempromosikan produk kepada produsen perangkat keras seluruh industri. DeepSeek V4 adalah orang yang melemparkan api permulaan. Semakin mudah digunakan dan semakin terbuka sumbernya, semakin meledak permintaan daya komputasi lokal di wilayah seperti Tiongkok Daratan, Hong Kong, dan Taiwan. Perusahaan-perusahaan yang membuat perakitan server, pendingin cair, dan operasional pusat data akhirnya melihat uang sungguhan dari penerapan skala besar.

Inilah mengapa pada 23 April, setelah V4 dirilis, rantai daya komputasi Tiongkok-Hong Kong langsung melonjak. Modal bukan membayar untuk emosi, tetapi modal sedang memposisikan diri lebih awal untuk “gelombang besar deploy pribadi di ribuan industri” yang akan datang.

Ini, adalah strategi bisnis mendasar yang terbuka.

Penutup: Pasang surut dan karang

Tiga puluh hari gila ini, sebelas model besar, seperti pertunjukan kembang api yang ramai.

Para raksasa saling mengayunkan dana besar di atas panggung parameter, berusaha menghancurkan lawan dengan pukulan kekuatan komputasi. Namun, setelah keributan berlalu, yang sering kali bertahan dan mengubah peta industri bukanlah yang paling berisik.

Munculnya DeepSeek V4 seperti seorang pembunuh bayaran yang tenang. Ia tidak berlomba-lomba dalam hal berapa banyak uang yang dihabiskan, tetapi hanya menyerang titik lemah paling kritis: memotong penggunaan memori GPU yang tidak perlu, menurunkan hambatan dalam peluncuran, dan mengubah pertandingan elit menjadi pertandingan untuk semua orang.

Dalam pertarungan AI yang disebut "Ragnarok" ini, era pengumpulan parameter secara sembarangan sedang berakhir dengan cepat. Medan pertempuran masa depan akan menjadi milik mereka yang dapat menemukan keseimbangan sempurna antara "kinerja ekstrem" dan "efisiensi teknis".

Pasang akan surut suatu hari, dan setelah surut, baru terlihat siapa yang berenang telanjang dan siapa yang menjadi karang tak tergoyahkan.

V4 telah mendistribusikan senjata ke semua orang. Selanjutnya, mari kita lihat bagaimana para penguasa wilayah akan mendirikan perkemahan di daratan baru ini.

Setelah memahami lapisan ini, ketika Anda mendengar keributan tentang "peluncuran menggemparkan" atau "mendefinisikan ulang", mungkin Anda akan merasa lebih tenang dan kurang cemas.

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Sumber kutipan:

- Pratinjau Seri DeepSeek V4 Rilis Resmi, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Relai AI April: Menganalisis Siklus 30 Hari Model Besar, ME News Market Observer. (2026).

- Hukum Skalabilitas dan Perubahan Paradigma Pasca-Pelatihan, Jurnal Ekonomi Kecerdasan Buatan. (2026).

- Laporan Nadi Pasar Rantai Pasok Komputasi Global (April 2026), Analitik Data Keuangan Pan-Asia. (2026).