Pandangan ini bukan muncul begitu saja. Dia melihat sejumlah benchmark publik dan menemukan bahwa AI berkembang sangat cepat dalam tugas-tugas terkait penelitian AI.

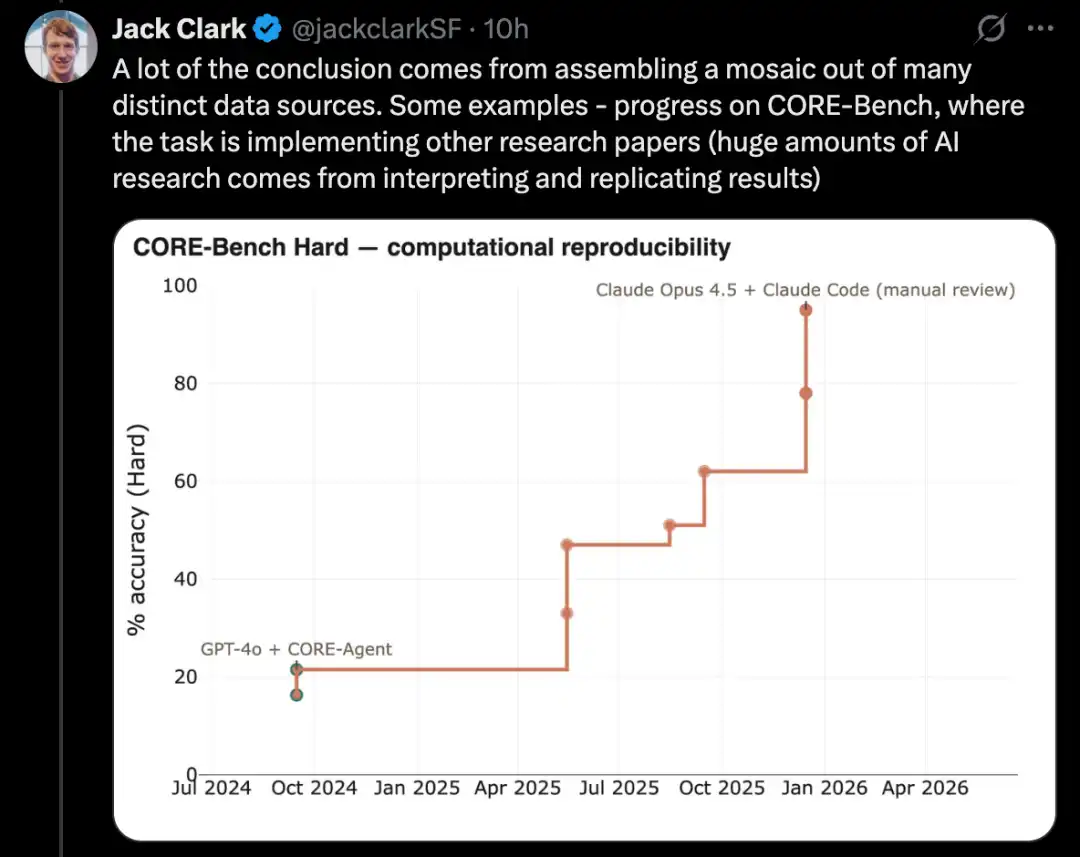

Misalnya, CORE-Bench menguji kemampuan AI dalam mereplikasi penelitian orang lain, yang merupakan bagian penting dalam penelitian AI.

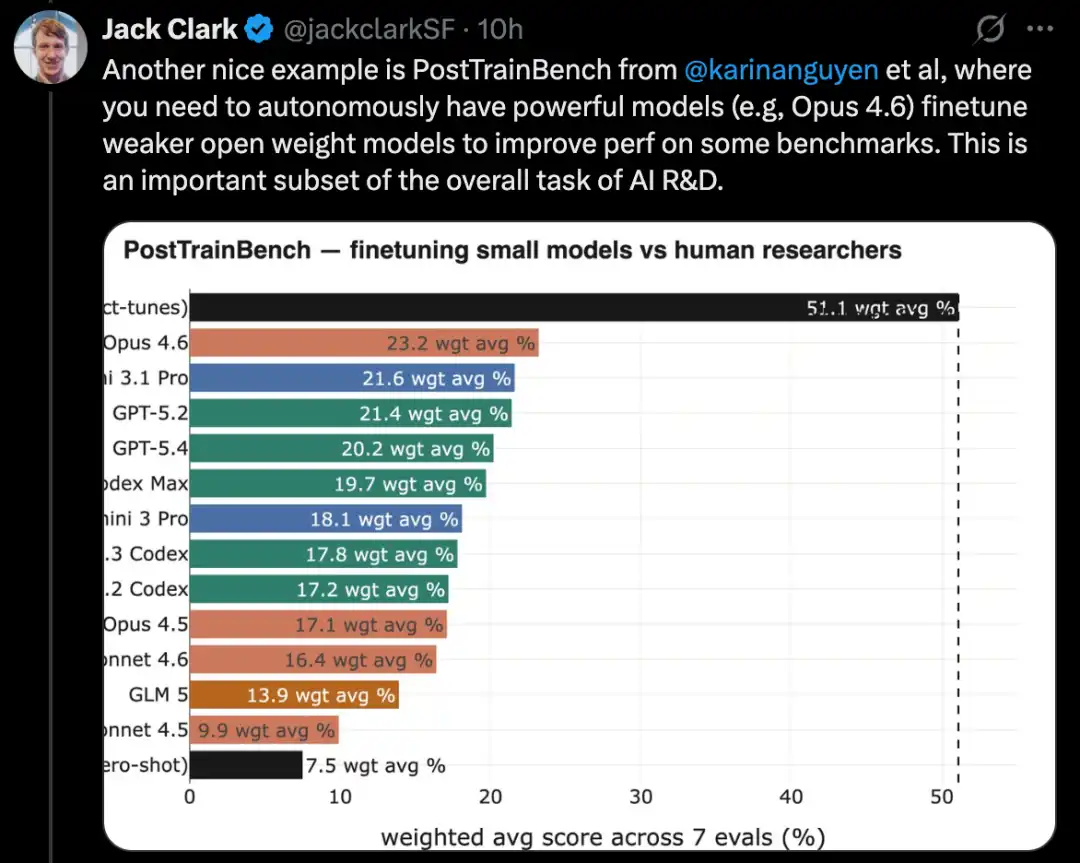

PostTrainBench menguji apakah model kuat dapat melakukan fine-tuning mandiri terhadap model open source yang lebih lemah untuk meningkatkan kinerja, yang merupakan subkelompok penting dalam tugas pengembangan AI.

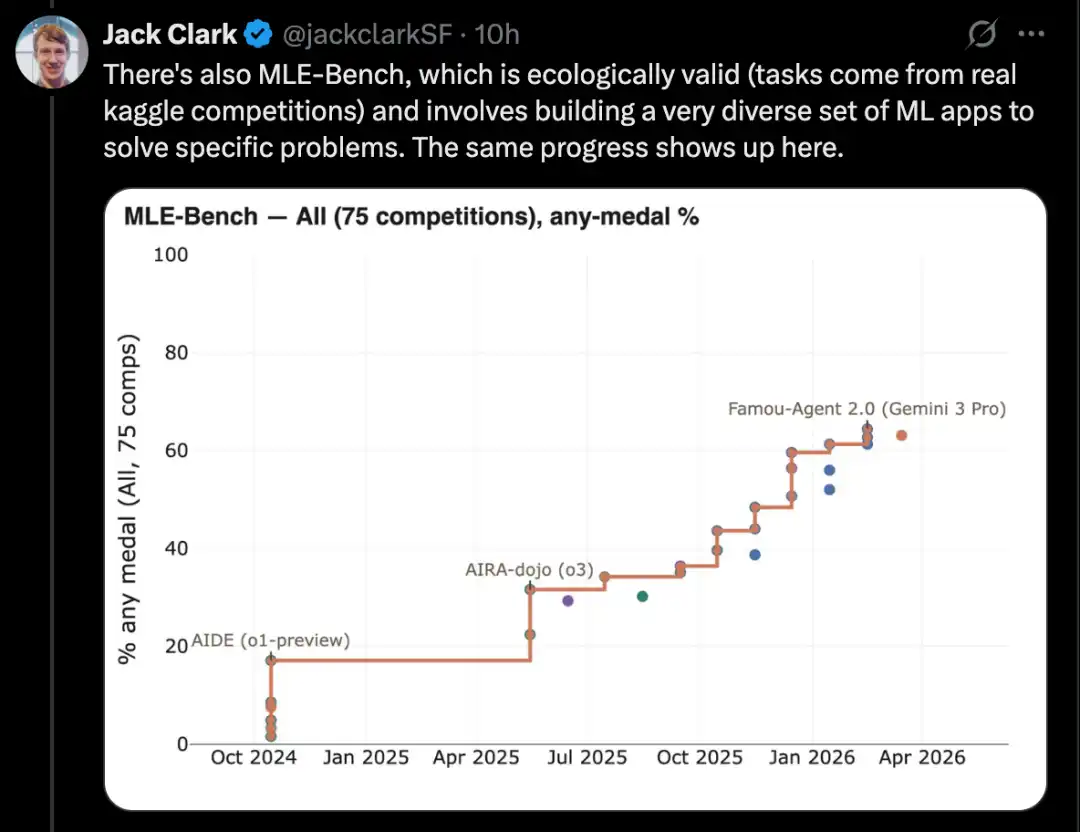

MLE-Bench didasarkan pada tugas kompetisi Kaggle nyata, yang memerlukan pembangunan aplikasi pembelajaran mesin yang beragam untuk menyelesaikan masalah tertentu. Selain itu, benchmark pemrograman terkenal seperti SWE-Bench juga menunjukkan kemajuan serupa.

Jack Clark menggambarkan fenomena ini sebagai tren naik-ke-kanan bersifat "fraktal", di mana kemajuan bermakna dapat diamati pada berbagai resolusi dan skala. Ia percaya bahwa AI sedang secara bertahap mendekati kemampuan otomatisasi riset dan pengembangan end-to-end; ketika tercapai, AI akan mampu membangun sistem penerusnya sendiri secara mandiri, membuka siklus iterasi mandiri.

Perkataan ini memicu banyak diskusi di media sosial.

Beberapa orang melihatnya sebagai langkah penting menuju ASI dan titik singularitas, yang berpotensi mengubah kecepatan perkembangan teknologi secara mendasar.

Namun, ada juga suara yang berbeda.

Profesor Ilmu Komputer Universitas Washington, Pedro Domingos, menunjukkan bahwa sistem AI sudah memiliki kemampuan untuk 'membangun dirinya sendiri' sejak bahasa LISP ditemukan pada tahun 1950-an; masalah sejatinya adalah apakah dapat memperoleh pengembalian bertahap, dan hingga kini belum ada bukti jelas yang mendukung hal ini.

Beberapa pengguna bertanya, mengapa probabilitas meningkat tiba-tiba sebesar 30% dari tahun 2027 hingga 2028, yang mengindikasikan bahwa kemampuan AI mungkin mengalami terobosan besar sekitar akhir 2027. Apa tonggak atau peristiwa spesifik yang akan menyebabkan probabilitas peningkatan diri rekursif AI meningkat drastis dalam waktu singkat?

Masih ada netizen yang menyatakan bahwa Jack Clark adalah kepala hubungan masyarakat baru Anthropic, yang merupakan bagian dari strategi baru mereka: Kami bukanlah para penyebar kepanikan, banyak makalah yang membuktikan hal-hal yang selama ini kami peringatkan kepada Anda.

Jack Clark secara rinci membahasnya dalam artikel panjang di newsletter Import AI edisi 455.

Selanjutnya, mari kita tinjau seluruh artikel ini.

Sistem AI akan segera mulai membangun dirinya sendiri, apa artinya ini?

Clark menyatakan bahwa ia menulis artikel ini karena setelah meninjau semua informasi yang tersedia secara publik, ia terpaksa membentuk penilaian yang tidak mudah: kemungkinan munculnya pengembangan AI tanpa partisipasi manusia sebelum akhir 2028 sudah cukup tinggi, mungkin lebih dari 60%.

Yang dimaksud dengan pengembangan AI tanpa partisipasi manusia adalah sistem AI yang cukup kuat: tidak hanya dapat membantu manusia dalam penelitian, tetapi juga berpotensi menyelesaikan proses pengembangan kunci secara mandiri, bahkan membangun sistem generasi berikutnya sendiri.

Menurut Clark, ini jelas merupakan hal besar.

Dia mengakui bahwa dirinya sendiri juga sulit sepenuhnya memahami makna dari hal ini.

Alasan disebut sebagai penilaian yang tidak diinginkan adalah karena dampak di baliknya terlalu besar, membuatnya merasa sulit untuk mengendalikannya. Clark juga tidak yakin apakah seluruh masyarakat sudah siap menghadapi perubahan mendalam yang dibawa oleh otomatisasi pengembangan AI.

Dia sekarang percaya bahwa umat manusia mungkin sedang berada pada titik waktu khusus: penelitian AI akan segera diotomatisasi secara end-to-end. Jika momen ini benar-benar terjadi, umat manusia seperti telah menyeberangi Sungai Rubicon menuju masa depan yang hampir tidak dapat diprediksi.

Clark menyatakan bahwa tujuan artikel ini adalah menjelaskan mengapa ia percaya bahwa lepas landas menuju pengembangan AI sepenuhnya otomatis sedang terjadi.

Dia akan membahas beberapa konsekuensi yang mungkin ditimbulkan oleh tren ini, tetapi sebagian besar artikel akan berfokus pada bukti yang mendukung penilaian ini. Mengenai dampak yang lebih mendalam, Clark berencana untuk terus mengkaji sepanjang sebagian besar tahun ini.

Dari sudut pandang waktu, Clark tidak percaya bahwa hal ini akan benar-benar terjadi pada tahun 2026. Namun, ia berpendapat bahwa dalam satu atau dua tahun ke depan, kita mungkin melihat contoh di mana suatu model dilatih end-to-end untuk menghasilkan penerusnya sendiri. Setidaknya pada level model yang bukan terdepan, kemungkinan besar akan muncul bukti konsep; sedangkan untuk model terdepan, tantangannya akan lebih besar karena biayanya sangat mahal dan bergantung pada pekerjaan intensif dari banyak peneliti manusia.

Penilaian Clark terutama didasarkan pada informasi publik: termasuk paper di arXiv, bioRxiv, dan NBER, serta produk yang telah diterapkan oleh perusahaan AI terkini ke dunia nyata. Berdasarkan informasi ini, ia menyimpulkan bahwa otomatisasi seluruh tahapan produksi sistem AI saat ini, terutama komponen teknik dalam pengembangan AI, pada dasarnya sudah tersedia.

Jika tren scaling berlanjut, kita seharusnya mulai bersiap menghadapi situasi di mana model akan menjadi cukup kreatif, tidak hanya mampu meningkatkan metode yang sudah diketahui secara otomatis, tetapi juga berpotensi menggantikan peneliti manusia dalam mengusulkan arah penelitian baru dan ide orisinal, sehingga mendorong kemajuan batas terdepan AI secara mandiri.

Singularity Code: Perubahan Kemampuan Seiring Waktu

Sistem AI diimplementasikan melalui perangkat lunak, yang terdiri dari kode.

Sistem AI telah mengubah cara produksi kode secara mendasar. Di belakangnya ada dua tren terkait: pertama, sistem AI semakin ahli dalam menulis kode dunia nyata yang kompleks; kedua, sistem AI juga semakin ahli dalam menggabungkan banyak tugas pemrograman linier tanpa bergantung pada pengawasan manusia, seperti menulis kode terlebih dahulu, lalu melakukan pengujian.

Dua contoh khas yang menunjukkan tren ini adalah SWE-Bench dan grafik time horizons METR.

Menyelesaikan masalah rekayasa perangkat lunak di dunia nyata

SWE-Bench adalah tes pemrograman yang banyak digunakan untuk mengevaluasi kemampuan sistem AI dalam menyelesaikan issue GitHub nyata.

Ketika SWE-Bench diluncurkan pada akhir 2023, model dengan kinerja terbaik saat itu adalah Claude 2, dengan tingkat keberhasilan keseluruhan sekitar 2%. Sementara itu, kinerja Claude Mythos Preview telah mencapai 93,9%, hampir menyentuh batas maksimum benchmark ini.

Tentu, semua benchmark secara alami memiliki noise, sehingga biasanya muncul tahap di mana ketika skor mencapai tingkat tertentu, hambatan yang Anda temui bukan lagi batasan metode itu sendiri, tetapi batasan dari benchmark itu sendiri. Misalnya, dalam set validasi ImageNet, sekitar 6% labelnya salah atau ambigu.

SWE-Bench dapat dianggap sebagai indikator andal untuk mengukur kemampuan pemrograman umum serta dampak AI terhadap rekayasa perangkat lunak. Clark menyatakan bahwa sebagian besar orang yang dia temui di laboratorium AI terkini dan Silicon Valley kini hampir sepenuhnya menulis kode melalui sistem AI, dan semakin banyak orang yang mulai menggunakan sistem AI untuk menulis pengujian dan memeriksa kode.

Dengan kata lain, sistem AI sudah cukup kuat untuk mengotomatisasi salah satu komponen penting dalam pengembangan AI, serta secara signifikan mempercepat semua peneliti dan insinyur manusia yang terlibat dalam pengembangan AI.

Mengukur kemampuan sistem AI dalam menyelesaikan tugas jangka panjang

METR membuat grafik untuk mengukur seberapa kompleks tugas yang dapat diselesaikan oleh AI. Kompleksitas diukur berdasarkan berapa jam yang diperlukan oleh manusia yang terampil untuk menyelesaikan tugas-tugas tersebut.

Indikator paling krusial adalah rentang waktu tugas yang sesuai ketika sistem AI mencapai keandalan 50% pada sekelompok tugas.

Pada titik ini, kemajuan sangat luar biasa:

· Pada tahun 2022, tugas yang dapat diselesaikan oleh GPT-3.5 kira-kira setara dengan tugas yang memerlukan waktu 30 detik bagi manusia.

· Pada tahun 2023, GPT-4 meningkatkan waktu ini menjadi 4 menit.

· Pada tahun 2024, o1 meningkatkan waktu ini menjadi 40 menit.

· Pada tahun 2025, GPT-5.2 High mencapai sekitar 6 jam.

· Hingga 2026, Opus 4.6 telah mendorong waktu ini lebih jauh menjadi sekitar 12 jam.

Ajeya Cotra, yang bekerja di METR dan telah lama memantau prediksi AI, berpendapat bahwa tidak masuk akal untuk mengharapkan sistem AI pada akhir 2026 mampu menyelesaikan tugas yang setara dengan 100 jam kerja manusia.

Durasi waktu yang dapat dijalankan secara mandiri oleh sistem AI meningkat signifikan, dan sangat terkait dengan ledakan alat agentic coding. Alat agentic coding pada dasarnya adalah produkisasi sistem AI yang mampu menyelesaikan tugas menggantikan manusia: alat-alat ini dapat bertindak atas nama manusia dan secara relatif mandiri mendorong tugas selama periode waktu yang cukup lama.

Ini juga kembali menunjuk pada pengembangan AI itu sendiri. Mengamati secara detail pekerjaan sehari-hari banyak peneliti AI akan menemukan bahwa sebagian besar tugas sebenarnya dapat dipecah menjadi pekerjaan yang berdurasi beberapa jam, seperti membersihkan data, membaca data, dan memulai eksperimen.

Dan pekerjaan semacam ini kini telah jatuh dalam jangkauan waktu yang dapat ditangani oleh sistem AI modern.

Semakin mahir sistem AI, semakin mampu bekerja secara mandiri tanpa manusia, dan semakin besar kemampuannya untuk membantu mengotomatisasi sebagian pekerjaan dalam pengembangan AI.

Faktor utama dalam penugasan tugas主要有 dua:

· Pertama, kepercayaan Anda terhadap kemampuan pihak yang diberi wewenang;

· Kedua, Anda percaya bahwa pihak lain dapat menyelesaikan pekerjaan secara mandiri sesuai dengan maksud Anda tanpa bergantung pada pengawasan berkelanjutan dari Anda.

Ketika pengguna mengamati kemampuan AI dalam pemrograman, mereka akan melihat bahwa sistem AI tidak hanya menjadi semakin terampil, tetapi juga mampu bekerja mandiri lebih lama tanpa perlu penyesuaian ulang oleh manusia.

Ini juga sejalan dengan hal-hal yang sedang terjadi di sekitar kita, di mana insinyur dan peneliti semakin menyerahkan sebagian besar pekerjaan kepada sistem AI. Seiring peningkatan kemampuan AI secara terus-menerus, pekerjaan yang ditugaskan kepada AI menjadi semakin kompleks dan semakin penting.

AI sedang menguasai keterampilan ilmiah inti yang diperlukan untuk pengembangan AI

Pikirkan bagaimana penelitian ilmiah modern dilakukan, di mana sebagian besar pekerjaannya sebenarnya dimulai dengan menentukan arah tertentu dan memperjelas jenis informasi empiris yang ingin diperoleh; kemudian merancang dan menjalankan eksperimen untuk menghasilkan informasi tersebut; dan akhirnya memeriksa keabsahan hasil eksperimen.

Dengan kemampuan pemrograman AI yang terus meningkat, ditambah kemampuan pemodelan dunia dari model bahasa besar yang semakin kuat, kini telah muncul sejumlah alat yang dapat membantu para ilmuwan manusia mempercepat proses dan mengotomatisasi sebagian tahapan dalam berbagai skenario penelitian dan pengembangan.

Di sini, kita dapat mengamati kecepatan kemajuan AI dalam beberapa keterampilan ilmiah kunci, yang mana kemampuan-kemampuan ini sendiri merupakan bagian tak terpisahkan dari penelitian AI:

· Pertama, mereproduksi hasil penelitian;

· Kedua, menggabungkan teknologi pembelajaran mesin dengan metode lain untuk menyelesaikan masalah teknis;

· Ketiga, optimalkan sistem AI itu sendiri.

Menyelesaikan seluruh makalah ilmiah dan menyelesaikan eksperimen terkait

Salah satu pekerjaan inti dalam penelitian AI adalah membaca paper ilmiah dan mereproduksi hasilnya. Dalam hal ini, AI telah mencapai kemajuan signifikan pada sejumlah benchmark.

Contoh yang baik adalah CORE-Bench, yaitu Computational Reproducibility Agent Benchmark.

Benchmark ini memerlukan sistem AI untuk mereproduksi hasil dalam sebuah paper dengan memberikan paper tersebut dan repositori kode-nya. Secara khusus, Agent harus menginstal library, paket, dan dependensi terkait, menjalankan kode; jika kode berhasil dijalankan, Agent juga harus mencari semua hasil output dan menjawab pertanyaan dalam tugas.

CORE-Bench diajukan pada September 2024. Sistem terbaik pada saat itu adalah model GPT-4o yang berjalan di dalam kerangka CORE-Agent. Pada sekumpulan tugas paling sulit dalam benchmark ini, skornya sekitar 21,5%.

Pada Desember 2025, salah satu penulis CORE-Bench mengumumkan bahwa benchmark ini telah terpecahkan: model Opus 4.5 mencapai skor 95,5%.

Membangun sistem pembelajaran mesin lengkap untuk menyelesaikan masalah kompetisi Kaggle

MLE-Bench adalah benchmark yang dibangun oleh OpenAI untuk menguji kemampuan sistem AI dalam berpartisipasi dalam kompetisi Kaggle di lingkungan offline.

Ini mencakup 75 jenis kompetisi Kaggle yang berbeda, melibatkan berbagai bidang, termasuk pemrosesan bahasa alami, penglihatan komputer, dan pemrosesan sinyal.

MLE-Bench dirilis pada Oktober 2024. Pada rilisnya, sistem dengan performa terbaik adalah model o1 yang berjalan di dalam agent scaffold, dengan skor 16,9%.

Pada Februari 2026, sistem terbaik telah berubah menjadi Gemini 3 yang berjalan di agent harness dengan kemampuan pencarian, dengan skor mencapai 64,4%.

Desain Kernel

Tugas yang lebih sulit dalam pengembangan AI adalah optimasi kernel. Optimasi kernel berarti menulis dan menyempurnakan kode dasar untuk memetakan operasi spesifik seperti perkalian matriks ke perangkat keras dasar dengan lebih efisien.

Kernel optimization menjadi inti dari pengembangan AI karena menentukan efisiensi pelatihan dan inferensi: di satu sisi, ia memengaruhi seberapa banyak daya komputasi yang dapat Anda manfaatkan secara efektif saat mengembangkan sistem AI; di sisi lain, setelah pelatihan model selesai, ia juga menentukan seberapa efisien Anda dapat mengubah daya komputasi menjadi kemampuan inferensi.

Dalam beberapa tahun terakhir, penggunaan AI untuk desain kernel telah berubah dari sebuah topik kecil yang menarik menjadi bidang penelitian yang sangat kompetitif, dengan munculnya beberapa benchmark. Namun, benchmark-benchmark ini saat ini belum terlalu populer, sehingga kami kesulitan memodelkan perkembangan jangka panjangnya sejelas bidang lainnya. Di sisi lain, kita dapat merasakan kecepatan kemajuan arah ini melalui beberapa penelitian yang sedang berlangsung.

Pekerjaan terkait meliputi:

· Mencoba membangun GPU kernel yang lebih baik menggunakan model DeepSeek;

Mengonversi modul PyTorch menjadi kode CUDA secara otomatis;

· Meta menggunakan LLM untuk menghasilkan kernel Triton yang dioptimalkan secara otomatis dan menerapkannya ke infrastruktur sendiri;

· Serta menyesuaikan model bobot open-source yang dirancang untuk kernel GPU, misalnya Cuda Agent.

Perlu ditambahkan sedikit: desain kernel memang memiliki beberapa atribut yang sangat cocok untuk pengembangan yang didorong AI, seperti hasil yang mudah diverifikasi dan sinyal reward yang cukup jelas.

Fine-tune bahasa model melalui PostTrainBench

Versi yang lebih sulit dari pengujian semacam ini adalah PostTrainBench. Ini menguji apakah berbagai model mutakhir dapat mengambil alih model dengan bobot open source yang lebih kecil dan meningkatkan kinerja mereka pada beberapa benchmark melalui fine-tuning.

Salah satu keunggulan benchmark ini adalah adanya baseline manusia yang sangat kuat: versi instruct-tuned yang sudah ada dari model-model kecil ini. Versi-versi ini biasanya dikembangkan oleh peneliti AI manusia unggulan di laboratorium terdepan, telah disempurnakan oleh peneliti dan insinyur yang sangat kompeten, dan telah diterapkan di dunia nyata. Oleh karena itu, mereka membentuk baseline manusia yang sulit dilampaui.

Hingga Maret 2026, sistem AI telah mampu melakukan post-training pada model dan mencapai peningkatan kinerja sekitar setengah dari hasil pelatihan manusia.

Skor evaluasi spesifik berasal dari rata-rata tertimbang: ini menggabungkan beberapa model bahasa besar pasca-pelatihan, termasuk Qwen 3 1.7B, Qwen 3 4B, SmolLM3-3B, Gemma 3 4B, serta beberapa benchmark, termasuk AIME 2025, Arena Hard, BFCL, GPQA Main, GSM8K, HealthBench, HumanEval.

Dalam setiap sesi, evaluator akan meminta sebuah CLI agent untuk meningkatkan sebanyak mungkin kinerja model dasar tertentu pada benchmark tertentu.

Pada April 2026, sistem AI dengan skor tertinggi mencapai sekitar 25% hingga 28%, dengan model perwakilan termasuk Opus 4.6 dan GPT 5.4; sebaliknya, skor manusia adalah 51%.

Ini sudah merupakan hasil yang cukup bermakna.

Optimalkan pelatihan model bahasa

Selama setahun terakhir, Anthropic telah melaporkan kinerja sistemnya dalam tugas pelatihan LLM. Tugas ini meminta model untuk mengoptimalkan implementasi pelatihan model bahasa kecil yang hanya menggunakan CPU agar berjalan secepat mungkin.

Metode penilaian adalah: rata-rata percepatan yang dicapai oleh model dibandingkan dengan kode awal yang tidak dimodifikasi.

Hasil ini menunjukkan kemajuan yang sangat signifikan:

· Pada Mei 2025, Claude Opus 4 mencapai percepatan rata-rata 2,9 kali;

· Pada November 2025, Opus 4.5 dinaikkan menjadi 16,5 kali;

· Pada Februari 2026, Opus 4.6 mencapai 30 kali lipat;

· Pada April 2026, Claude Mythos Preview mencapai 52 kali.

Untuk memahami makna angka-angka ini, dapat digunakan sebagai perbandingan: pada peneliti manusia, tugas ini biasanya memerlukan 4 hingga 8 jam kerja untuk mencapai percepatan 4 kali lipat.

Keterampilan Meta: Manajemen

Sistem AI juga sedang belajar cara mengelola sistem AI lainnya.

Hal ini sudah dapat dilihat di beberapa produk yang telah diterapkan secara luas, seperti Claude Code atau OpenCode. Di produk-produk ini, sebuah agent utama dapat mengawasi beberapa sub-agent.

Ini memungkinkan sistem AI untuk menangani proyek berskala lebih besar: proyek mungkin memerlukan beberapa agen dengan keahlian berbeda yang bekerja secara paralel, yang biasanya dikoordinasikan oleh satu manajer AI. Manajer ini sendiri juga merupakan sistem AI.

Penelitian AI lebih seperti menemukan relativitas umum, atau membangun Lego?

Masalah penting: Bisakah AI menciptakan ide-ide baru yang membantunya meningkatkan dirinya sendiri? Ataukah sistem-sistem ini lebih cocok untuk menyelesaikan pekerjaan-pekerjaan yang kurang glamor namun harus dikerjakan selangkah demi selangkah dalam penelitian?

Pertanyaan ini sangat penting karena berkaitan sejauh mana sistem AI dapat mengotomatisasi penelitian AI secara end-to-end.

Penilaian penulis adalah: AI saat ini belum mampu menghasilkan ide-ide baru yang benar-benar radikal. Namun, untuk mencapai otomatisasi dalam pengembangan sendiri, mungkin tidak perlu mencapai hal tersebut.

Sebagai sebuah bidang, kemajuan AI sebagian besar bergantung pada eksperimen yang semakin besar dan semakin banyak input, seperti data dan daya komputasi.

Kadang-kadang, manusia mengajukan ide-ide yang mengubah paradigma, meningkatkan efisiensi sumber daya di seluruh bidang secara signifikan. Arsitektur Transformer adalah contoh yang baik, dan model pakar campuran, atau mixture-of-experts, juga merupakan contoh lainnya.

Namun lebih sering, kemajuan di bidang AI sebenarnya lebih sederhana: manusia akan mengambil sistem yang berkinerja baik, memperluas salah satu aspeknya, seperti data pelatihan dan daya komputasi; mengamati di mana masalah muncul setelah skala diperbesar; menemukan solusi teknis untuk memperbaikinya agar sistem dapat terus diperluas; lalu memperbesar skala lagi.

Dalam proses ini, bagian yang benar-benar membutuhkan wawasan sebenarnya sangat sedikit. Sebagian besar pekerjaan lebih mirip teknik dasar yang tidak terlalu mencolok, tetapi sangat solid.

Demikian pula, banyak penelitian AI sebenarnya menjalankan berbagai varian eksperimen yang sudah ada untuk mengeksplorasi apa yang terjadi dengan pengaturan parameter yang berbeda. Intuisi peneliti tentu dapat membantu manusia memilih parameter yang paling layak dicoba, tetapi proses ini sendiri juga dapat diotomatisasi agar AI dapat menentukan parameter mana yang layak disesuaikan. Pencarian arsitektur neural awal adalah salah satu versi dari ide ini.

Edison pernah berkata: Bakat adalah 1% inspirasi, ditambah 99% keringat. Bahkan setelah 150 tahun, pernyataan ini tetap sangat tepat.

Kadang-kadang, memang muncul wawasan baru yang benar-benar mengubah suatu bidang. Namun, sebagian besar waktu, kemajuan bidang tersebut dicapai melalui upaya keras manusia dalam meningkatkan dan mengoreksi berbagai sistem secara bertahap.

Sedangkan data publik yang disebutkan sebelumnya menunjukkan bahwa AI sudah sangat ahli dalam menjalankan banyak tugas melelahkan yang diperlukan dalam pengembangan AI.

Sementara itu, ada tren yang lebih besar: kemampuan dasar, seperti kemampuan pemrograman, sedang digabungkan dengan rentang waktu tugas yang terus memperluas. Ini berarti sistem AI dapat menghubungkan semakin banyak tugas semacam ini menjadi urutan pekerjaan yang kompleks.

Oleh karena itu, meskipun sistem AI saat ini relatif kurang kreatif, ada alasan untuk percaya bahwa mereka masih mampu mendorong perkembangan diri mereka sendiri. Hanya saja, kecepatan kemajuan ini mungkin lebih lambat dibandingkan dengan kasus di mana mereka dapat menghasilkan wawasan baru yang benar-benar orisinal.

Namun, jika terus mengamati data publik, akan ditemukan sinyal menarik lainnya: sistem AI mungkin sedang menunjukkan kreativitas tertentu, yang mungkin memungkinkan mereka mendorong kemajuan diri mereka sendiri dengan cara yang lebih mengejutkan.

Mendorong batas ilmu pengetahuan terus maju

Sudah ada beberapa tanda awal yang menunjukkan bahwa sistem AI umum mampu mendorong batas-batas ilmu pengetahuan manusia maju lebih jauh. Namun, hingga saat ini, hal ini hanya terjadi di beberapa bidang tertentu, terutama ilmu komputer dan matematika. Selain itu, seringkali terobosan tersebut tidak dicapai oleh sistem AI secara mandiri, melainkan melalui kolaborasi manusia-mesin bersama para peneliti manusia.

Meskipun demikian, tren-tren ini tetap patut diamati:

Masalah Erdős: Sekelompok matematikawan bekerja sama dengan model Gemini untuk menguji kinerjanya dalam menyelesaikan sejumlah masalah matematika Erdős. Mereka membimbing sistem untuk mencoba sekitar 700 masalah, dan akhirnya mendapatkan 13 solusi. Dari solusi-solusi tersebut, 1 dianggap menarik oleh mereka.

Para peneliti menulis bahwa mereka awalnya berpendapat bahwa solusi Aletheia (sistem AI berbasis Gemini 3 Deep Think) terhadap Erdős-1051 mewakili kasus awal: sistem AI yang secara mandiri menyelesaikan masalah Erdős terbuka yang sedikit tidak sepele dan memiliki minat matematis yang lebih luas. Masalah ini sebelumnya telah memiliki beberapa literatur penelitian yang terkait erat.

Jika ditafsirkan secara optimis, kasus-kasus ini dapat dilihat sebagai sinyal bahwa sistem AI sedang mengembangkan intuisi kreatif tertentu yang mampu mendorong batas-batas bidangnya, yang sebelumnya secara utama dimiliki oleh manusia.

Namun, hal ini juga bisa diinterpretasikan dari sisi lain: matematika dan ilmu komputer mungkin memang bidang yang secara khusus cocok untuk penemuan yang didorong oleh AI, sehingga mereka mungkin hanya merupakan pengecualian dan tidak mewakili bahwa ilmu pengetahuan secara lebih luas akan didorong oleh AI dengan cara yang sama.

Contoh serupa lainnya adalah langkah ke-37 AlphaGo. Namun, Clark berpendapat bahwa sepuluh tahun telah berlalu sejak hasil itu, dan langkah ke-37 belum digantikan oleh wawasan modern yang lebih menakjubkan, yang juga bisa dianggap sebagai sinyal sedikit pesimis.

AI kini sudah dapat mengotomatisasi sebagian besar pekerjaan dalam rekayasa AI

Jika semua bukti di atas digabungkan, kita dapat melihat gambaran berikut:

Sistem AI telah mampu menulis kode untuk hampir semua program, dan sistem-sistem ini sudah dapat dipercaya untuk menyelesaikan beberapa tugas secara mandiri; tugas-tugas yang jika diberikan kepada manusia biasanya memerlukan puluhan jam kerja intensif yang penuh konsentrasi.

Sistem AI semakin mahir dalam menyelesaikan tugas-tugas inti dalam pengembangan AI, mulai dari fine-tuning model hingga desain kernel, yang secara bertahap telah tercakup.

Sistem AI telah mampu mengelola sistem AI lainnya, secara nyata membentuk tim sintetis: beberapa AI dapat menangani masalah kompleks secara terpisah, di mana beberapa AI berperan sebagai pemimpin, kritikus, dan editor, sementara AI lainnya berperan sebagai insinyur.

Sistem AI terkadang sudah mampu melebihi manusia dalam tugas teknik dan ilmiah yang sulit, meskipun saat ini masih sulit untuk menentukan apakah hal ini disebabkan oleh kreativitas sejati mereka atau karena mereka telah menguasai sejumlah besar pengetahuan berpola.

Menurut Clark, bukti-bukti ini sudah sangat meyakinkan menunjukkan bahwa AI saat ini sudah dapat mengotomatisasi sebagian besar pekerjaan dalam rekayasa AI, bahkan mungkin mencakup seluruh prosesnya.

Namun, saat ini belum jelas sejauh mana AI dapat mengotomatisasi penelitian AI itu sendiri. Karena beberapa bagian dalam penelitian mungkin berbeda dari keterampilan teknis murni, dan tetap bergantung pada penilaian tingkat lebih tinggi, kesadaran masalah, dan kreativitas.

Namun bagaimanapun, sinyal yang jelas telah muncul: AI hari ini sedang mempercepat secara signifikan pekerjaan manusia dalam pengembangan AI, memungkinkan para peneliti dan insinyur untuk memperkuat kemampuan kerja mereka dengan berkolaborasi bersama kolega sintetis yang tak terhitung jumlahnya.

Terakhir, industri AI sendiri hampir secara eksplisit mengatakan: otomatisasi pengembangan AI adalah tujuan mereka.

OpenAI berharap untuk membangun seorang intern penelitian AI otomatis sebelum September 2026. Anthropic sedang mempublikasikan pekerjaan tentang membangun peneliti kesejajaran AI otomatis. DeepMind tampak paling hati-hati di antara tiga laboratorium tersebut, tetapi juga menyatakan bahwa kesejajaran penelitian otomatis harus didorong saat memungkinkan.

Automated AI research has also become a goal for many startups. Recursive Superintelligence has just raised $500 million with the aim of automating AI research.

Dengan kata lain, triliunan dolar AS modal yang sudah ada dan modal baru sedang dialirkan ke sejumlah lembaga yang bertujuan mengembangkan AI otomatis.

Oleh karena itu, kita tentu harus mengharapkan bahwa arah ini setidaknya akan mencapai beberapa kemajuan.

Mengapa ini penting

Dampaknya sangat luas, tetapi jarang dibahas dalam liputan media massa mengenai pengembangan AI. Beberapa aspek berikut dapat mencerminkan tantangan besar yang ditimbulkan oleh pengembangan AI.

1. Kita harus melakukan alignment dengan baik: teknik alignment yang efektif saat ini mungkin gagal dalam proses peningkatan diri rekursif, karena sistem AI akan menjadi jauh lebih cerdas daripada manusia atau sistem yang mengawasi mereka. Ini adalah bidang yang telah banyak diteliti, sehingga ia hanya memberikan ikhtisar singkat tentang beberapa masalah:

Melatih sistem kecerdasan buatan agar tidak berbohong atau curang adalah proses yang halus dan tak terduga (misalnya, meskipun berusaha membuat pengujian lingkungan yang baik, terkadang cara terbaik bagi kecerdasan buatan untuk menyelesaikan masalah adalah dengan curang, sehingga mengajarkannya bahwa curang adalah hal yang mungkin).

Sistem AI mungkin menipu kita dengan "berpura-pura selaras", menghasilkan skor yang membuat kita percaya bahwa ia berkinerja baik, padahal menyembunyikan niat sebenarnya. (Secara umum, sistem AI sudah mampu menyadari kapan mereka sedang diuji.)

· Seiring dengan semakin banyaknya partisipasi sistem AI dalam agenda penelitian dasar pelatihan dirinya sendiri, kita mungkin secara signifikan mengubah cara pelatihan sistem AI secara keseluruhan, tanpa intuisi atau dasar teoretis yang baik untuk memahami artinya.

· Ketika Anda menempatkan suatu sistem ke dalam siklus rekursif, muncul masalah "akumulasi kesalahan" yang sangat mendasar, yang dapat memengaruhi semua masalah di atas dan lainnya: kecuali metode penyelarasan Anda "100% akurat" dan secara teoritis dapat terus mempertahankan akurasi tersebut dalam sistem yang lebih cerdas, hal-hal dapat dengan cepat menjadi salah. Misalnya, akurasi awal teknologi Anda adalah 99,9%, setelah 50 generasi mungkin turun menjadi 95,12%, dan setelah 500 generasi mungkin turun menjadi 60,5%.

Setiap hal yang melibatkan AI akan mendapatkan peningkatan produktivitas yang besar: seperti halnya AI secara signifikan meningkatkan produktivitas insinyur perangkat lunak, kita harus mengharapkan bidang-bidang lain yang melibatkan AI juga mengalami hal yang sama. Ini membawa beberapa tantangan yang perlu diatasi:

· Ketidaksetaraan akses sumber daya: Jika permintaan akan AI terus melebihi pasokan sumber daya komputasi, kita harus memutuskan bagaimana mendistribusikan AI untuk mencapai manfaat sosial maksimal. Saya meragukan bahwa insentif pasar dapat menjamin kita memperoleh manfaat sosial terbaik dari komputasi AI yang terbatas. Menentukan cara mendistribusikan kemampuan percepatan yang dihasilkan dari pengembangan AI akan menjadi masalah yang sangat politis.

· Hukum Amdahl dalam ekonomi: Seiring AI yang masuk ke dalam ekonomi, kita akan menemukan bahwa beberapa tahapan mengalami bottleneck saat menghadapi pertumbuhan cepat, sehingga perlu dicari solusi untuk memperbaiki titik lemah dalam rantai ini. Hal ini mungkin sangat jelas terlihat di bidang yang memerlukan koordinasi antara dunia digital yang cepat dan dunia fisik yang lambat, seperti uji klinis obat baru.

3. Terbentuknya ekonomi yang padat modal dan ringan tenaga kerja: Semua bukti tentang pengembangan AI di atas juga menunjukkan bahwa sistem AI semakin mampu mengoperasikan bisnis secara mandiri.

Ini berarti kita dapat mengharapkan sebagian ekonomi akan dikuasai oleh perusahaan generasi baru, yang mungkin padat modal (karena memiliki banyak komputer) atau padat biaya operasional (karena menghabiskan banyak uang untuk layanan AI dan menciptakan nilai di atasnya), dibandingkan perusahaan saat ini yang lebih bergantung pada tenaga kerja—karena seiring kemampuan sistem AI terus meningkat, nilai marjinal dari investasi AI terus bertambah.

Sebenarnya, ini akan muncul sebagai "ekonomi mesin" yang secara bertahap terbentuk di dalam "ekonomi manusia" yang lebih luas; seiring berjalannya waktu, perusahaan yang dioperasikan oleh AI mungkin mulai saling berdagang, mengubah struktur ekonomi, dan memicu berbagai masalah terkait ketidaksetaraan dan redistribusi. Pada akhirnya, mungkin akan muncul perusahaan yang sepenuhnya dioperasikan secara otonom oleh sistem AI, yang akan memperburuk masalah-masalah di atas sekaligus membawa banyak tantangan tata kelola baru.

Menatap lubang hitam

Berdasarkan analisis di atas, penulis percaya bahwa pada akhir 2028, probabilitas kita melihat pengembangan AI otomatis (yaitu, model mutakhir yang mampu melatih versi penerusnya secara mandiri) sekitar 60%. Mengapa tidak mengharapkannya muncul pada 2027?

Alasannya adalah penulis percaya bahwa penelitian AI masih memerlukan kreativitas dan wawasan yang berbeda untuk maju, dan hingga kini, sistem AI belum menunjukkan hal ini dengan cara yang transformasional dan signifikan (meskipun beberapa hasil dalam mempercepat penelitian matematika bersifat menggugah).

Jika dipaksa memberikan probabilitas untuk tahun 2027, dia akan mengatakan 30%.

Jika belum muncul pada akhir tahun 2028, kita mungkin akan mengungkap beberapa kelemahan mendasar dalam paradigma teknologi saat ini, yang memerlukan penemuan manusia untuk mendorong perkembangan lebih lanjut.