Amerika Serikat telah berusaha memutus saluran China untuk memperoleh chip AI canggih selama tiga tahun, dengan menerapkan empat putaran pembatasan ekspor, mencakup 24 jenis peralatan semikonduktor dan lebih dari 140 entitas dalam daftar sanksi. Namun, menurut laporan yang dirilis oleh Komite Pemeriksaan Keamanan Ekonomi AS-Tiongkok (USCC) pada 24 Maret, 80% perusahaan rintisan AI Amerika Serikat sedang menggunakan model open-source Tiongkok.

Dinding dibangun di lapisan perangkat keras. Pintu dibuka di lapisan perangkat lunak.

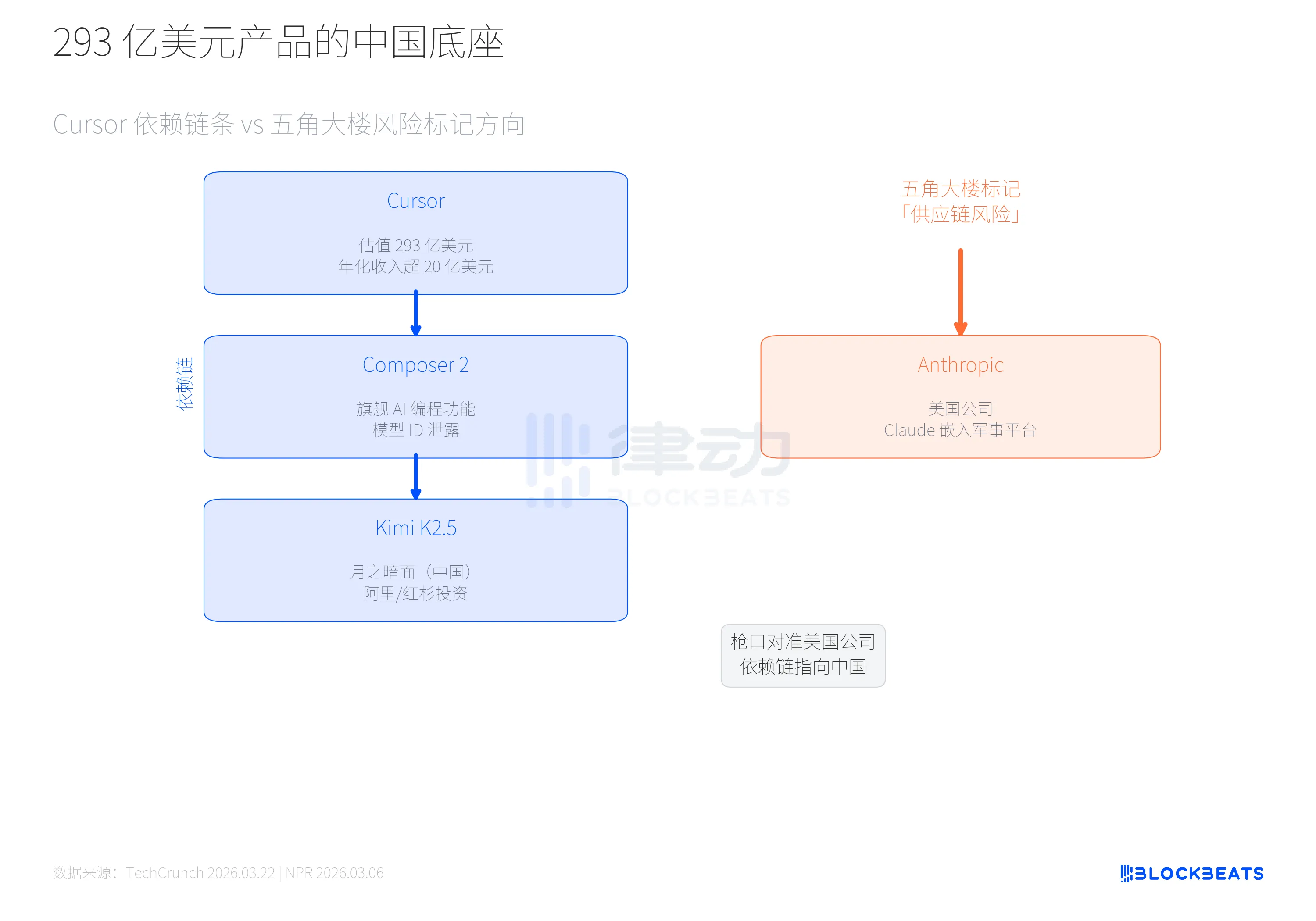

Kontradiksi ini bukan diskusi kebijakan abstrak. Pekan lalu, alat pemrograman AI bernilai $29,3 miliar, Cursor, ditemukan menggunakan model dasar dari Kimi K2.5 dari Yueju Anmian sebagai fondasi fitur andalannya, Composer 2. Model dari perusahaan Tiongkok sedang menggerakkan alat pengembangan AI paling top di Amerika.

Meanwhile, the Pentagon labeled Anthropic, a U.S. company, with the "supply chain risk" tag.

Arah regulasi dan arah ketergantungan aktual benar-benar berlawanan.

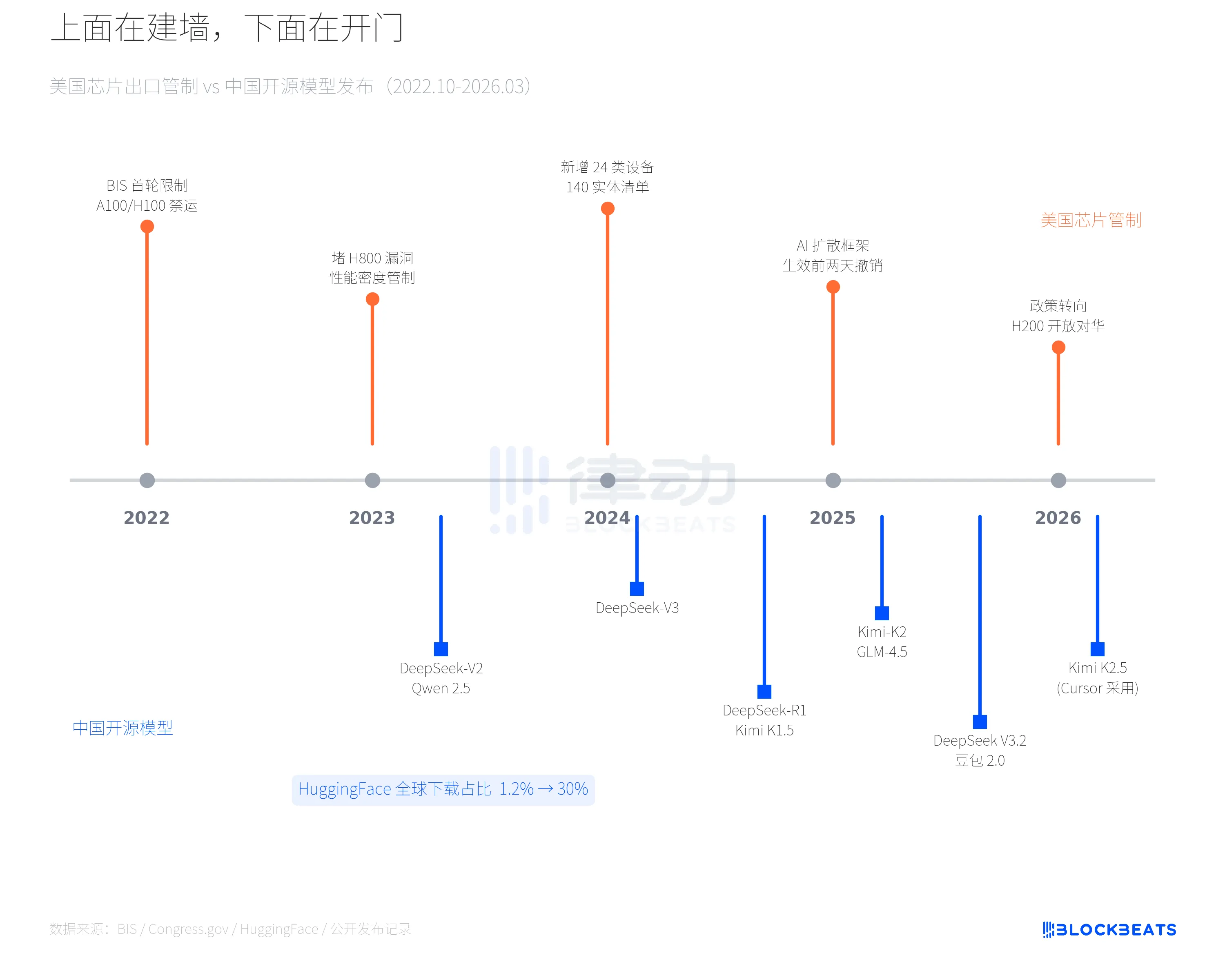

Sejak Oktober 2022, ketika BIS mulai membatasi ekspor chip kelas A100/H100, pembatasan chip Amerika terus diperketat. Pada 2023, celah H800 ditutup dan indikator pembatasan kepadatan kinerja diperluas. Pada Desember 2024, langkah tambahan diterapkan dengan menambahkan 24 kategori peralatan semikonduktor ke dalam daftar pembatasan dan memasukkan 140 entitas Tiongkok ke dalam daftar hitam, bahkan memasukkan high-bandwidth memory (HBM) dan DRAM ke dalam cakupan pembatasan. Pada Januari 2025, Departemen Perdagangan bahkan mengumumkan "kerangka penyebaran AI" yang bertujuan membangun sistem pembatasan global pada tingkat model, tetapi kerangka ini dicabut sendiri dua hari sebelum mulai berlaku. Pada Desember 2025, Trump malah berbalik arah, mengizinkan ekspor chip H200 ke pelanggan Tiongkok yang telah disetujui.

Di separuh bawah garis waktu regulasi ini, kecepatan peluncuran model open-source Tiongkok terus mempercepat. Pada 2024, DeepSeek-V2 dan seri Qwen 2.5 secara berturut-turut dirilis sebagai open-source. Pada 20 Januari 2025, DeepSeek-R1 dan Kimi K1.5 diluncurkan pada hari yang sama, dengan DeepSeek-R1 sementara menduduki peringkat pertama dalam daftar unduhan App Store Amerika, mengalahkan ChatGPT. Pada paruh kedua 2025, Kimi-K2 dan GLM-4.5 menyusul. Pada awal 2026, DouBao 2.0 dari ByteDance telah memiliki 155 juta pengguna aktif mingguan, sementara Kimi K2.5 secara langsung diadopsi oleh Cursor. Semakin ketat regulasinya, semakin banyak model yang muncul.

Menurut data resmi HuggingFace, persentase model open-source Tiongkok dalam unduhan global meningkat dari sekitar 1,2% pada akhir 2024 menjadi sekitar 30% pada awal 2026. Jumlah unduhan kumulatif seri Qwen Alibaba mencapai lebih dari 700 juta pada Januari 2026, secara resmi melewati Llama dari Meta. Pembatasan chip tidak menghentikan output perangkat lunak AI Tiongkok, malah kemungkinan mempercepat peralihan strategis ke jalur open-source.

Ini bukan kebetulan data. Laporan USCC menggunakan kerangka yang tepat untuk menggambarkan fenomena ini: "siklus ganda". Dalam siklus perangkat keras, Tiongkok terbatas oleh hambatan pasokan chip. Dalam siklus perangkat lunak, Tiongkok menembus balik infrastruktur AI global melalui model open-source, menciptakan ketergantungan hilir. Kedua siklus ini memiliki arah kekuatan yang berlawanan, tetapi saling memperkuat. Pembatasan membatasi kemampuan kita untuk mengakses daya komputasi teratas, tetapi juga mendorong munculnya jalur teknologi yang melakukan lebih banyak dengan lebih sedikit daya komputasi. DeepSeek-R1, yang mencapai kinerja terdepan dengan biaya inferensi jauh lebih rendah daripada GPT-4o, adalah produk dari jalur ini.

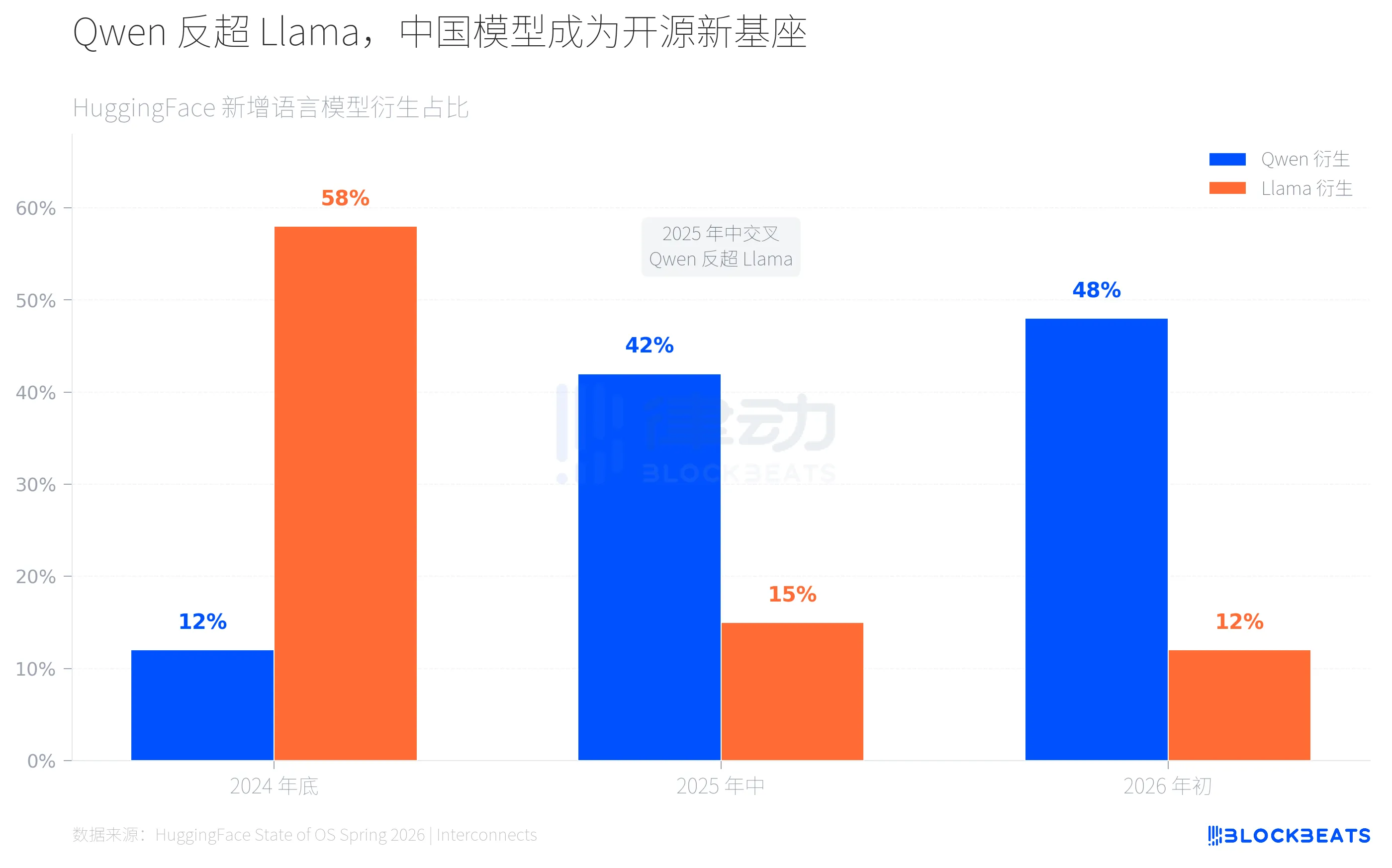

Perubahan di HuggingFace terlihat jelas. Menurut data platform, pada akhir 2024, model turunan Llama menyumbang sekitar enam puluh persen dari model bahasa baru, sementara Qwen hanya menyumbang lebih dari sepuluh persen. Pada pertengahan 2025, titik balik muncul; menurut blog resmi HuggingFace, persentase turunan Qwen melonjak menjadi lebih dari 40 persen, sementara Llama turun menjadi sekitar 15 persen. Pada awal 2026, turunan Qwen mendekati setengahnya, sementara Llama terus menyusut menjadi sekitar 12 persen.

Kecepatan silang ini melebihi ekspektasi sebagian besar orang. Dua tahun lalu, AI open-source hampir setara dengan ekosistem Llama dari Meta. Pengembang global melakukan fine-tuning, deployment, dan pengembangan produk berbasis Llama. Sekarang, hal yang sama sedang terulang di ekosistem Qwen, hanya saja dengan kecepatan lebih cepat dan cakupan yang lebih luas.

Ini berarti pengembang global semakin memilih model China sebagai dasar utama dalam membangun aplikasi AI, bukan karena sikap politik, tetapi karena kinerja dan tingkat keterbukaannya. Seri Qwen 2.5 mencakup parameter dari 0,5B hingga 72B, memungkinkan pengembang untuk melakukan fine-tuning dan deployment di perangkat keras mereka sendiri tanpa perlu membayar untuk memanggil API ke OpenAI atau Anthropic. Sumber terbuka menghilangkan ketergantungan pada pemasok, sekaligus menghilangkan batas negara.

Satu detail yang patut diperhatikan adalah, menurut laporan MIT Technology Review pada Februari, perusahaan AI Tiongkok sedang membentuk persaingan diferensiasi dalam strategi open-source. DeepSeek mengejar jalur efisiensi biaya ekstrem, Kimi fokus pada konteks panjang dan kemampuan kode, sementara Qwen mengejar cakupan parameter penuh. Tren maju secara paralel ini membuat pilihan bagi pengembang global semakin beragam. Model open-source kami sedang menggunakan kekuatan nyata untuk mendefinisikan ulang rantai pasokan AI global.

Tetapi seperti apa ujung rantai pasokan ini?

Pada 19 Maret, pengembang @fynnso menemukan ID model accounts/anysphere/models/kimi-k2p5-rl-0317-s515-fast dalam kode Cursor. Aman Sanger, salah satu pendiri bersama Cursor, kemudian mengakui bahwa Composer 2 dibangun berdasarkan Kimi K2.5. Menurut Lee Robinson, VP Cursor, "Model dasar hanya menyumbang sekitar seperempat dari jumlah komputasi, sisanya berasal dari pelatihan kami sendiri." Namun, model dasar tetaplah model dasar. Produk dengan valuasi 29,3 miliar dolar AS ini menggunakan model dasar dari Moonshot, perusahaan Tiongkok yang didanai oleh Alibaba dan Sequoia (HongShan).

Melihat rantai ketergantungan ini bersama dengan tindakan Pentagon, sensasi absurdnya menjadi lebih jelas. Pada 5 Maret, Pentagon secara resmi menandai Anthropic sebagai “risiko rantai pasokan”. Menurut laporan NPR, alasannya adalah CEO Anthropic, Dario Amodei, menolak untuk mengorbankan dua garis merah, yaitu penggunaan AI untuk senjata otonom dan pengawasan massal terhadap warga negara Amerika. Trump memberi militer enam bulan untuk menghilangkan Claude, sementara Claude telah tertanam mendalam di platform militer dan keamanan nasional. Anthropic kemudian menggugat Pentagon pada 9 Maret.

Di satu sisi, pemerintah AS memberi label "risiko rantai pasok" pada perusahaan domestiknya, di sisi lain, 80% startup AS menjalankan model Tiongkok. Yang pertama adalah permainan politik, yang kedua adalah kenyataan teknis. Keduanya tidak saling berhubungan.

80% perusahaan rintisan AS menjalankan model Tiongkok, label risiko Pentagon ditempelkan pada sebuah perusahaan AS. Regulasi bertumpuk di lapisan perangkat keras, ketergantungan tumbuh diam-diam di lapisan perangkat lunak. Di sisi lain tembok chip selama tiga tahun, muncul fakta baru yang sedang terbentuk: AI open-source Tiongkok sudah bukan lagi «pengejar», melainkan pemasok infrastruktur AI global.

Klik untuk mengetahui posisi yang sedang dibuka oleh BlockBeats

Selamat bergabung dengan komunitas resmi BlockBeats:

Grup langganan Telegram: https://t.me/theblockbeats

Grup Telegram: https://t.me/BlockBeats_App

Akun resmi Twitter: https://twitter.com/BlockBeatsAsia