SN24 lance l'architecture Quasar-3B : Comment Bittensor TAO défie OpenAI dans l'IA à long contexte

2026/04/21 15:00:03

Introduction

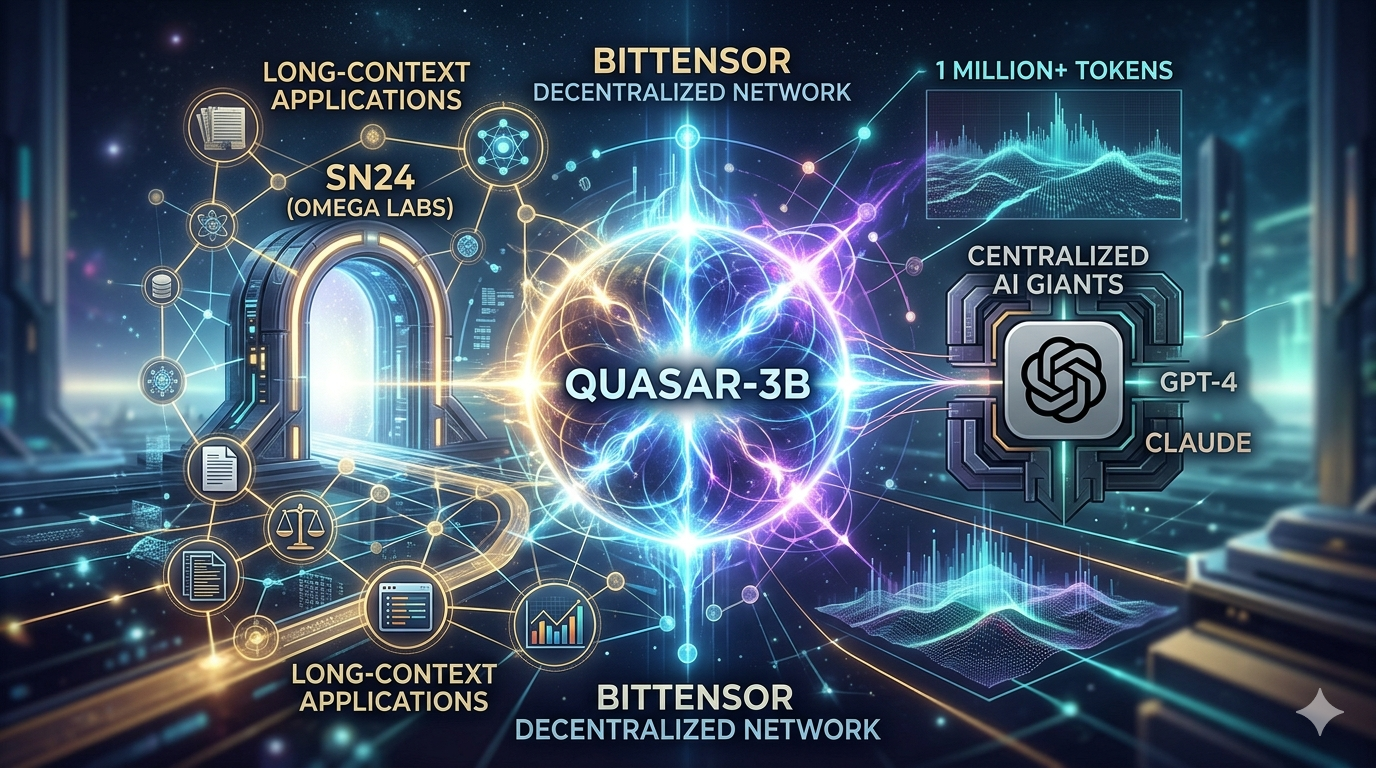

Le paysage de l'intelligence artificielle a connu un développement majeur en avril 2026, lorsque SN24 (OMEGA Labs) a annoncé le lancement de Quasar-3B, un transformateur à temps continu en boucle spécialement conçu pour l'intelligence à long contexte.

Cette annonce représente bien plus qu'un jalon technique — elle signale l'intention sérieuse de Bittensor de concurrencer directement les géants de l'IA centralisée comme OpenAI dans l'une des dimensions de capacité les plus critiques : la capacité à traiter et raisonner sur des contextes étendus. Alors que le paysage de l'IA à long contexte évolue rapidement, la compétition pour construire des modèles capables de traiter efficacement des millions de jetons est devenue l'une des batailles les plus décisives dans le développement de l'IA. L'approche décentralisée de Bittensor via Quasar-3B de SN24 entre désormais dans cette arène, en remettant en question l'idée selon laquelle seules les grandes entreprises centralisées peuvent repousser les limites de ce que les modèles d'IA peuvent accomplir. La question n'est plus de savoir si l'IA décentralisée peut concurrencer — mais à quelle vitesse elle peut rattraper les acteurs établis.

Cet article de fond explore la place de Quasar-3B dans le contexte plus large de l'écosystème de Bittensor. Pour les lecteurs nouveaux dans cet espace, trois sujets fondamentaux offrent un contexte essentiel :

-

comprendre What Is SN24 et son rôle dans le réseau Bittensor,

-

explorer Why Is Long-Context AI Important et ses applications transformantes à travers les industries ;

-

et comparez Comment l'approche décentralisée de Bittensor fonctionne par rapport au développement centralisé traditionnel de l'IA.

Qu'est-ce que Quasar-3B : la réponse de SN24 aux défis liés aux longs contextes

Quasar-3B représente la solution d'OMEGA Labs à l'une des limitations les plus persistantes de l'IA : la dégradation de la fenêtre de contexte. Lorsque la plupart des modèles traitent des documents dépassant leur longueur de contexte d'entraînement, la précision chute considérablement. Des recherches suggèrent que Claude perd plus de 30 % de sa précision après 1 million de jetons. Cette limitation contraint fondamentalement ce que les systèmes d'IA peuvent accomplir dans des applications pratiques.

Le nom d'architecture « Quasar » évoque le phénomène astronomique — des objets d'une luminosité immense visibles à de grandes distances. De même, Quasar-3B vise à éclairer des contextes vastes, permettant à l'IA de « voir » à travers des millions de jetons tout en conservant une précision constante. La désignation « 3B » fait référence au nombre de paramètres du modèle, avec « 1B Active » indiquant qu'un milliard de paramètres restent activement impliqués pendant le traitement.

Des innovations architecturales clés distinguent Quasar-3B des transformeurs classiques. La conception de transformateur à temps continu en boucle permet au modèle de maintenir le flux d'informations sur des séquences étendues sans la dégradation typique qui se produit lorsque les modèles traitent un contexte dépassant leur plage optimisée. Ce choix architectural résout la limitation fondamentale qui a limité la concurrence entre Bittensor et OpenAI dans les applications à long contexte.

Pour comprendre le positionnement stratégique de SN24 au sein de l'écosystème plus vaste, il est utile d'examiner ce que le sous-réseau accomplit, en tant qu'une des unités spécialisées de Bittensor axée sur le développement des capacités de contexte long du réseau tout en contribuant au plus grand jeu de données multimodal décentralisé au monde.

L'architecture technique : comment Quasar-3B atteint un contexte étendu

Comprendre l'architecture technique de Quasar-3B nécessite d'examiner pourquoi le traitement de contextes longs s'est révélé si difficile pour les systèmes d'IA. Les modèles transformer traditionnels utilisent des mécanismes d'attention qui évoluent de manière quadratique avec la longueur de la séquence — doubler la longueur du contexte quadruple les exigences computationnelles. Cette réalité mathématique a rendu le traitement de contextes étendus prohibitivement coûteux pour la plupart des applications.

L'approche de transformer à temps continu en boucle de Quasar-3B répond à ce défi d'échelle grâce à des innovations architecturales qui maintiennent l'efficacité computationnelle même lorsque la longueur du contexte s'allonge. Le modèle y parvient grâce à plusieurs mécanismes. Tout d'abord, la modélisation à temps continu permet au système de traiter l'information comme un flux continu plutôt que des blocs discrets, réduisant ainsi la surcharge liée au découpage. Deuxièmement, l'architecture en boucle crée des chemins de rétroaction qui permettent à l'information de persister sur des séquences étendues sans augmentation proportionnelle de la charge computationnelle. Troisièmement, les pipelines d'inférence optimisés garantissent que cette capacité étendue se traduit par des applications pratiques.

Les résultats de référence ont attiré une attention significative au sein de la communauté de la recherche en IA. Selon l'annonce sur X de l'équipe Quasar, le modèle affiche des performances compétitives sur les évaluations LongBench – le référentiel standard pour les capacités IA à long contexte. Alors que les chiffres détaillés des benchmarks continuent d'émerger pendant que le modèle est testé par la communauté, les premiers indicateurs suggèrent des progrès significatifs vers l'objectif de maintenir la précision à travers des millions de jetons.

Le déploiement via l'infrastructure de sous-réseau de Bittensor offre des avantages supplémentaires. Les 128 sous-réseaux actifs du réseau permettent une optimisation spécialisée pour différents aspects du traitement de contextes longs. Les sous-réseaux axés sur la récupération, le traitement et la validation peuvent travailler en concert avec Quasar-3B pour offrir des capacités qui exigeraient un effort d'ingénierie important pour être reproduites dans des systèmes centralisés.

Pourquoi l'IA à contexte long est essentielle dans la course à l'IA

La signification de l'IA à long contexte va bien au-delà d'une réalisation technique — elle représente un changement fondamental de capacité qui permet de nouvelles catégories d'applications. Pour les entreprises et les chercheurs travaillant avec de grands jeux de documents, des procédures juridiques, des bases de code ou des archives de recherche, la capacité de traiter des jeux de données entiers dans leur contexte transforme ce qui devient possible.

Les approches traditionnelles de l'IA exigeaient de diviser de grands documents en morceaux plus petits, perdant ainsi la capacité de repérer des motifs qui s'étendent sur l'ensemble du jeu de données. Une équipe juridique examinant une fusion avec des milliers de documents ne pouvait pas poser de questions nécessitant une compréhension des relations entre tous les documents. Un développeur analysant une base de code d'un million de lignes ne pouvait pas obtenir d'aide de l'IA qui comprenne le contexte complet du système. L'IA à long contexte supprime ces contraintes, permettant des applications dans les domaines du droit, de la santé, de la finance et de la recherche qui étaient auparavant impraticables.

Le paysage concurrentiel s'est intensifié à mesure que les acteurs majeurs reconnaissent cette dynamique. GPT-4.5 d'OpenAI et Claude Opus 4.6 d'Anthropic ont poussé les fenêtres de contexte à 1 million de jetons, tandis que Gemini atteint 2 millions. Ces évolutions valident la direction du marché tout en élevant le niveau pour les concurrents. L'entrée de Bittensor via Quasar-3B représente le défi décentralisé le plus sérieux à ce domaine.

Pour ceux qui cherchent une compréhension plus approfondie de l'importance de ces capacités et des secteurs qui en tirent le plus grand bénéfice, l'analyse de l'IA à long contexte révèle un potentiel transformateur dans le diagnostic médical, l'examen de documents juridiques, l'analyse de portefeuilles financiers et la synthèse de littérature académique.

Comment le modèle décentralisé de Bittensor concurrence l'IA centralisée

La comparaison entre l'approche décentralisée de Bittensor et le modèle de développement centralisé d'OpenAI prend de nouvelles dimensions avec le lancement de Quasar-3B. Comprendre comment la concurrence entre Bittensor et OpenAI se manifeste dans les IA à long contexte nécessite d'examiner plusieurs dimensions de cette rivalité.

Du point de vue des ressources, OpenAI bénéficie d'avantages significatifs. Le partenariat de l'entreprise avec Microsoft lui permet d'accéder à une infrastructure de calcul massive. Les entraînements de GPT-4 coûteraient plus de 100 millions de dollars. Cette intensité en capital crée des barrières que les réseaux décentralisés peinent à égaler directement. Toutefois, le modèle distribué de Bittensor exploite le capital de milliers de participants plutôt que de nécessiter un investissement unique. Le développement de Quasar-3B démontre qu'une capacité d'IA significative peut émerger de ce modèle distribué.

Les structures d'incitation diffèrent fondamentalement. Les avantages du développement d'OpenAI profitent principalement à l'entreprise et à ses investisseurs. Les employés et les chercheurs reçoivent une rémunération, mais ne participent pas à la création de valeur à long terme. Le modèle crypto-économique de Bittensor signifie que les contributeurs au développement de Quasar-3B gagnent des jetons TAO qui augmentent en valeur à mesure que le réseau se développe. Cette alignement crée des schémas de motivation différents qui peuvent stimuler l'innovation par la concurrence.

L'architecture démontre comment les réseaux décentralisés peuvent se spécialiser efficacement. Plutôt que de développer des capacités généralistes visant à répondre à tous les besoins, les sous-réseaux peuvent se concentrer sur des défis spécifiques. Quasar-3B se concentre exclusivement sur le traitement de contextes longs, en optimisant profondément cette capacité plutôt que de répartir les ressources sur des améliorations générales.

Pour les lecteurs intéressés par les compromis en matière d'évolutivité entre ces approches, la comparaison détaillée montre que chaque modèle présente des avantages distincts selon les exigences du cas d'utilisation.

Les comparaisons de performance continuent d'évoluer à mesure que les deux approches mûrissent. Les modèles d'OpenAI sont actuellement en tête sur les benchmarks de capacité générale. Les sous-réseaux de Bittensor ont démontré des performances compétitives sur des tâches spécifiques. La dimension des contextes longs représente un domaine où Bittensor peut potentiellement lider plutôt que suivre, compte tenu des innovations architecturales comme la conception de transformateur à temps continu de Quasar-3B.

L'importance stratégique pour TAO et l'écosystème Bittensor

Le lancement de Quasar-3B a des implications importantes pour l'écosystème Bittensor dans son ensemble et pour le token TAO en particulier. Comprendre ces implications nécessite d'examiner la manière dont le système de subnet crée de la valeur pour l'ensemble du réseau.

Les sous-réseaux au sein de Bittensor fonctionnent comme des marchés spécialisés, chacun se concentrant sur différentes capacités d'IA. Le succès des sous-réseaux individuels contribue à la valeur globale du réseau par plusieurs mécanismes. Tout d'abord, les sous-réseaux utiles attirent des requêtes qui génèrent des émissions TAO. Deuxièmement, les sous-réseaux réussis démontrent la capacité du réseau, attirant ainsi davantage de participants. Troisièmement, le système dTAO signifie que l'appréciation des tokens de sous-réseau profite aux détenteurs de TAO grâce au mécanisme de market maker automatique.

Le lancement de Quasar-3B renforce le réseau de plusieurs manières. Le modèle offre une capacité auparavant indisponible dans le paysage de l'IA décentralisée, attirant les utilisateurs ayant besoin d'un traitement de contexte long. L'innovation technique démontre que Bittensor peut produire des recherches en IA de pointe. L'attention suscitée par ce lancement valide l'approche subnet pour le développement de l'IA.

La position concurrentielle devient plus attrayante avec Quasar-3B en production. Les utilisateurs professionnels évaluant les options d'IA disposent désormais d'une alternative décentralisée capable de correspondre à certaines capacités des fournisseurs centralisés. Cette concurrence bénéficie à l'ensemble du marché tout en pouvant générer de la valeur pour l'écosystème Bittensor.

Pour les investisseurs évaluant TAO, le lancement de Quasar-3B constitue un point de preuve pour la thèse d'investissement. La capacité à développer des modèles d'IA compétitifs grâce à une coordination décentralisée valide l'approche fondamentale. Les futurs lancements de sous-réseaux peuvent s'appuyer sur Quasar-3B comme preuve que le réseau peut rivaliser avec le développement centralisé de l'IA.

Applications du monde réel rendues possibles par la capacité de contexte long de Quasar-3B

Les applications pratiques de la capacité de contexte étendu de Quasar-3B s'étendent à des industries et des cas d'utilisation qui étaient auparavant impraticables pour l'assistance par IA. Comprendre ces applications démontre pourquoi la course au contexte long dépasse la simple réalisation technique.

Les applications dans le secteur juridique évoluent lorsque l'ensemble des dossiers d'affaires peut être traité dans son contexte. Plutôt que d'examiner des documents individuels isolément, les avocats peuvent interroger l'historique complet des litiges, en identifiant des schémas et des précédents à travers l'ensemble des documents. L'analyse des contrats peut suivre les obligations et les dépendances à travers l'ensemble des bibliothèques d'accords. La diligence raisonnable peut intégrer la documentation complète de l'entreprise dans une seule analyse.

Le développement logiciel bénéficie de la compréhension de l'ensemble des bases de code dans leur contexte. Les audits de sécurité peuvent analyser des dépôts complets, en identifiant des vulnérabilités qui traversent plusieurs fichiers. La revue de code peut comprendre le contexte complet des modifications, et non seulement les différences isolées. La génération de documentation peut intégrer une compréhension exhaustive de l'architecture du système.

L'analyse financière atteint une nouvelle sophistication avec un contexte historique complet. L'analyse du portefeuille peut intégrer des décennies de données de marché. L'évaluation des risques peut évaluer les positions sur l'ensemble des portefeuilles simultanément. La recherche peut synthétiser l'ensemble des historiques de résultats et des documents réglementaires.

Les applications de soins de santé permettent une analyse complète des patients. Le diagnostic peut prendre en compte des antécédents médicaux complets couvrant plusieurs années. La recherche peut analyser des ensembles de données complets d'essais cliniques. La conformité réglementaire peut traiter des cadres de politiques complets.

La recherche académique se transforme lorsque l'on peut s'engager avec l'ensemble des corpus littéraires. La revue de littérature peut synthétiser les résultats à travers des décennies de publications. La recherche interdisciplinaire peut relier les insights entre les domaines. L'analyse des subventions peut évaluer l'ensemble des historiques de propositions.

L'industrie de la blockchain bénéficie spécifiquement de ces fonctionnalités. L'audit de contrats intelligents peut analyser des implémentations de protocoles entières. L'analyse DeFi peut évaluer de manière exhaustive les interactions au sein de l'écosystème. L'analyse on-chain peut intégrer des historiques de transactions complets.

Feuille de route future : quoi de neuf pour SN24 et Quasar

Le lancement de Quasar-3B représente une étape importante plutôt qu'une destination finale. Selon les informations provenant de la documentation du sous-réseau, la feuille de route s'étend jusqu'en 2026 et au-delà, avec plusieurs phases de développement.

Le Q4 2025 a vu le lancement initial du sous-réseau sur la testnet de Bittensor, la mise en œuvre de l'évaluation LongBench, le déploiement du mode mock et l'intégration de la surveillance WandB. Ces éléments fondamentaux ont établi l'infrastructure pour le développement continu.

Le Q1 2026 s'est concentré sur l'expansion des capacités de contexte long et l'amélioration des métriques d'évaluation. L'annonce de Quasar-3B en avril 2026 représente le résultat de ces efforts, mais une amélioration continue reste la priorité.

Les développements prévus pour le reste de 2026 incluent des variantes de modèle supplémentaires optimisées pour différents cas d'utilisation, des longueurs de contexte étendues au-delà des capacités actuelles, l'intégration avec d'autres subnets Bittensor pour une meilleure livraison des capacités, et des améliorations pilotées par la communauté grâce au mécanisme d'incitation.

La pression concurrentielle des fournisseurs centralisés d'IA garantit une innovation continue dans l'ensemble de l'industrie. Alors qu'OpenAI, Anthropic et Google poussent les fenêtres de contexte plus loin, les concurrents décentralisés doivent suivre cette progression tout en démontrant des avantages distinctifs. L'approche de Bittensor, consistant à se spécialiser à travers des subnets, fournit un cadre pour cette concurrence continue.

Pour le mouvement plus large de l'IA décentralisée, Quasar-3B constitue une preuve concrète. La démonstration selon laquelle des capacités d'IA compétitives peuvent émerger de réseaux décentralisés valide la thèse fondamentale. Les projets futurs pourront s'appuyer sur cette base, accélérant potentiellement le développement d'alternatives décentralisées à l'IA.

Dois-je investir dans TAO sur KuCoin ?

Pour les traders évaluant leur exposition à l'écosystème Bittensor, le lancement de Quasar-3B apporte un contexte supplémentaire pour les décisions d'investissement.

Considérations haussières

-

Validation compétitive : Quasar-3B démontre que Bittensor peut développer des capacités d'IA de pointe, validant l'approche décentralisée

-

Opportunité de marché à long contexte : le marché de l'IA à contexte étendu représente une opportunité importante et en croissance d'une valeur de plusieurs milliards

-

Force de l'écosystème de sous-réseau : le succès de Quasar-3B de SN24 renforce l'écosystème de sous-réseau plus large

-

Différenciation technique : Des innovations architecturales comme les transformateurs à temps continu offrent des capacités distinctives

Facteurs de risque

-

Concurrence centralisée : Les grandes entreprises technologiques continuent d'investir des milliards dans l'IA à long contexte, ce qui pourrait les distancer par rapport aux alternatives décentralisées

-

Incertitude d'exécution : Traduire les innovations architecturales en applications pratiques nécessite une exécution continue

-

Environnement réglementaire : Les cryptomonnaies et l'IA font face à des cadres réglementaires en évolution à l'échelle mondiale

-

Volatilité du marché crypto : TAO reste très volatile par rapport aux actifs traditionnels

Cadre stratégique

Le lancement de Quasar-3B représente un développement significatif pour l'écosystème Bittensor, mais doit être évalué dans le contexte global du portefeuille. Prenez en compte la taille des positions en fonction de votre conviction dans la thèse de l'IA décentralisée, tout en maintenant une gestion des risques appropriée compte tenu de la volatilité du marché crypto.

Comment trader TAO sur KuCoin

Étape 1 : Créez votre compte KuCoin

Si vous êtes prêt à trader TAO, la première étape consiste à créer votre KuCoin account. Les nouveaux utilisateurs peuvent s'inscrire sur KuCoin et obtenir jusqu'à 11 000 USDT de récompenses pour nouveaux utilisateurs – une prime substantielle qui peut augmenter votre capital de départ. Il suffit de visiter le site web de KuCoin ou de télécharger l'application mobile, de compléter le processus d'inscription avec votre adresse e-mail ou votre numéro de téléphone, et de vérifier votre identité pour débloquer ces récompenses. Le processus d'inscription ne prend que quelques minutes, et la prime de bienvenue offre un excellent point de départ pour explorer les opportunités de trading TAO.

Étape 2 : Exécutez votre transaction

Une fois votre compte configuré, recherchez "TAO/USDT" dans l'interface de trading de KuCoin. TAO offre généralement une forte liquidité pour la plupart des tailles de position, bien que la liquidité puisse varier selon les conditions du marché. Pendant les périodes de forte volatilité autour d'annonces majeures comme le lancement de Quasar-3B, privilégiez les ordres Limit plutôt que les ordres Market pour gérer le slippage. Évaluez votre point d'entrée en fonction des conditions actuelles du marché et de votre tolérance au risque avant d'exécuter votre trade.

Étape 3 : Gestion de la position

Étant donné la volatilité inhérente aux crypto-actifs liés à l'IA, établissez des objectifs de profit et des niveaux de stop-loss clairs avant d'entrer en position. Surveillez les développements provenant de SN24, des lancements plus larges de sous-réseaux Bittensor et du paysage concurrentiel entre l'IA décentralisée et centralisée. Ajustez votre position en fonction de l'évaluation continue de la thèse, et non en réponse émotionnelle aux mouvements de prix.

Conclusion

Le lancement de Quasar-3B par SN24 représente un moment charnière pour l'IA décentralisée. En démontrant que Bittensor peut développer des capacités compétitives en IA à long contexte grâce à son réseau distribué, le projet remet en question les idées reçues sur qui peut repousser les limites de l'intelligence artificielle. Les innovations architecturales du transformateur à temps continu en boucle de Quasar-3B constituent une base pour des avancées continues.

Les dynamiques concurrentielles entre l'IA décentralisée et centralisée continuent d'évoluer. OpenAI conserve des avantages en termes de capital et d'échelle. Toutefois, l'alignement des incitations de Bittensor, sa spécialisation via des subnets et sa participation mondiale créent des avantages distincts. La concurrence entre Bittensor et OpenAI est devenue plus intéressante avec ce développement.

Pour l'industrie de l'IA dans son ensemble, la coexistence de plusieurs approches profite à tous. La concurrence stimule l'innovation, tandis que la diversité assure la résilience. La démonstration selon laquelle les réseaux décentralisés peuvent rivaliser valide des structures de développement alternatives.

Pour les investisseurs, le lancement de Quasar-3B fournit des éléments soutenant la thèse d'investissement sur Bittensor. Toutefois, la taille des positions doit refléter l'adoption de technologies en phase précoce et la volatilité du marché crypto.

FAQ

Q : Qu'est-ce que Quasar-3B ?

A : Quasar-3B est un modèle IA à long contexte lancé par SN24 (OMEGA Labs) sur le réseau Bittensor en avril 2026. Il utilise une architecture transformer à temps continu en boucle conçue pour un raisonnement efficace sur des millions de jetons. Le « 3B » fait référence à 3 milliards de paramètres, dont 1 milliard actifs pendant le traitement.

Q : Comment Quasar-3B se compare-t-il aux modèles à long contexte d'OpenAI ?

A : Quasar-3B cible spécifiquement le défi des longs contextes grâce à des innovations architecturales qui maintiennent la précision sur des séquences étendues. Bien que des comparaisons détaillées sur les benchmarks continuent d'émerger, le modèle démontre des performances compétitives sur les évaluations LongBench. Le modèle de développement décentralisé offre des avantages différents de l'approche centralisée d'OpenAI.

Q: Qu'est-ce qui rend l'architecture Quasar différente des transformeurs traditionnels ?

A : Quasar utilise une architecture de transformateur à temps continu en boucle qui permet à l'information de circuler sur des séquences étendues sans augmentation proportionnelle du coût computationnel. Cela résout le problème de mise à l'échelle quadratique qui rend l'extension du contexte des transformateurs traditionnels coûteuse.

Q : Comment SN24 s'intègre-t-il dans l'écosystème plus vaste de Bittensor ?

A : SN24 (OMEGA Labs) est l'un des 128 sous-réseaux actifs de Bittensor, axé sur la création du plus grand jeu de données multimodal décentralisé au monde. Ce sous-réseau contribue à l'écosystème à la fois par son infrastructure de données et par des capacités d'IA telles que Quasar-3B.

Q : Quelles sont les applications concrètes de Quasar-3B ?

A : Les applications incluent l'analyse de documents juridiques sur l'ensemble des dossiers d'affaires, la vérification de la sécurité logicielle sur l'ensemble des bases de code, l'analyse financière intégrant des décennies de données de marché, l'analyse sanitaire sur l'ensemble des historiques de patients et la synthèse de recherches académiques sur l'ensemble des corpus littéraires.

Avertissement : Pour votre confort, cette page a été traduite à l'aide de la technologie IA (GPT). Pour obtenir les informations à la source, consultez la version anglaise originale.