Los modelos grandes continúan creciendo, y la opinión dominante sostiene que cuantos más parámetros tenga un modelo, más se acercará al modo de pensamiento humano. Sin embargo, un artículo publicado por el equipo de la Universidad de Zhejiang el 1 de abril en Nature Communications plantea una visión diferente (enlace al artículo original: https://www.nature.com/articles/s41467-026-71267-5). Descubrieron que, aunque la capacidad de identificar objetos concretos sigue mejorando a medida que los modelos (principalmente SimCLR, CLIP y DINOv2) aumentan su tamaño, la capacidad de comprender conceptos abstractos no solo no mejora, sino que incluso disminuye. Cuando los parámetros aumentaron de 22,06 millones a 304,37 millones, las tareas de conceptos concretos pasaron del 74,94% al 85,87%, mientras que las tareas de conceptos abstractos descendieron del 54,37% al 52,82%.

Diferencias entre el modo de pensamiento humano y el de los modelos

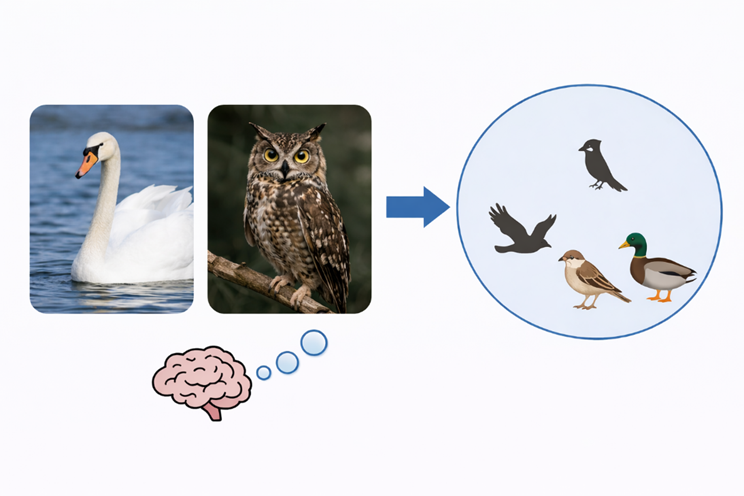

Cuando el cerebro humano procesa conceptos, primero establece una jerarquía de clasificación. Aunque los cisnes y las lechuzas se ven diferentes, las personas las clasifican ambas como aves. Por encima de eso, tanto las aves como los caballos pueden incluirse dentro de la categoría más amplia de animales. Al ver algo nuevo, las personas suelen preguntarse primero: ¿a qué cosa conocida anteriormente se parece? ¿A qué categoría pertenece aproximadamente? Las personas continúan aprendiendo nuevos conceptos y organizan sus experiencias mediante esta red de relaciones para identificar nuevas cosas y adaptarse a nuevas situaciones.

Los modelos también clasifican, pero lo hacen de manera diferente. Se basan principalmente en patrones que se repiten en grandes volúmenes de datos. Cuanto más frecuentemente aparece un objeto específico, más fácil es para el modelo reconocerlo. Sin embargo, al llegar a categorías más amplias, el modelo tiene más dificultades. Debe identificar los puntos en común entre múltiples objetos y agruparlos en la misma categoría. Los modelos actuales aún presentan deficiencias evidentes en este aspecto. A medida que los parámetros aumentan, el rendimiento en tareas de conceptos concretos mejora, pero en ocasiones el rendimiento en tareas de conceptos abstractos disminuye.

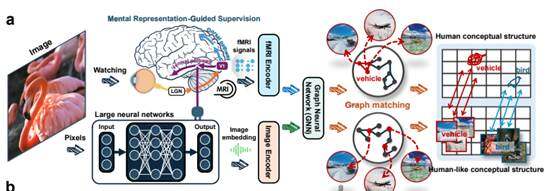

Una similitud entre el cerebro humano y los modelos es que ambos desarrollan internamente un sistema de relaciones de clasificación. Sin embargo, ambos enfatizan aspectos diferentes: las regiones visuales de alto nivel del cerebro humano naturalmente dividen los estímulos en categorías amplias como biológicas y no biológicas, mientras que los modelos pueden distinguir objetos específicos, pero tienen dificultades para formar de manera estable estas categorías más amplias. Esta diferencia hace que el cerebro humano sea más capaz de aplicar experiencias previas a nuevos objetos, permitiéndonos clasificar rápidamente cosas que nunca hemos visto antes. En cambio, los modelos dependen más del conocimiento existente, por lo que, al enfrentarse a objetos nuevos, tienden a quedarse en características superficiales. El método propuesto en el artículo se centra en esta característica, utilizando señales cerebrales para restringir la estructura interna del modelo y hacer que su forma de clasificación se acerque más a la del cerebro humano.

La solución del equipo de la Universidad de Zhejiang

La solución propuesta por el equipo también es única: en lugar de seguir agregando parámetros, utiliza pocas señales cerebrales como supervisión. Estas señales cerebrales provienen de registros de la actividad cerebral humana mientras observa imágenes. El artículo original menciona que se transfiere las estructuras conceptuales humanas a las DNNs. Esto significa enseñar al modelo cómo el cerebro humano clasifica, generaliza y agrupa conceptos similares.

El equipo realizó experimentos con 150 categorías de entrenamiento conocidas y 50 categorías de prueba desconocidas. Los resultados mostraron que, a medida que avanzaba el entrenamiento, la distancia entre el modelo y las representaciones cerebrales se redujo continuamente. Este cambio ocurrió simultáneamente en ambas categorías, lo que indica que el modelo no aprende muestras individuales, sino que realmente comienza a adquirir una forma de organización conceptual más cercana a la del cerebro humano.

Después de este entrenamiento, el modelo muestra una mayor capacidad de aprendizaje con pocos ejemplos y un mejor desempeño ante nuevas situaciones. En una tarea que requiere al modelo distinguir entre conceptos abstractos como seres vivos y no vivos, con solo unos pocos ejemplos, el modelo mejoró en promedio un 20,5 %, superando a modelos de control con mucho más parámetros. El equipo también realizó 31 pruebas adicionales específicas, en las que todos los tipos de modelos mostraron mejoras cercanas al 10 %.

En los últimos años, la ruta familiar para la industria de modelos ha sido aumentar el tamaño de los modelos. El equipo de la Universidad de Zhejiang eligió una dirección diferente, pasando de “bigger is better” a “structured is smarter”. Aumentar la escala ciertamente es útil, pero principalmente mejora el rendimiento en tareas familiares. La capacidad humana de comprensión abstracta y transferencia es igualmente crucial para la IA, y esto requiere que en el futuro la estructura de pensamiento de la IA se acerque más al cerebro humano. El valor de esta dirección radica en que redirige la atención de la industria desde la simple expansión de escala hacia la estructura cognitiva misma.

Neosoul y el futuro

Esto abre la posibilidad de que la evolución de la IA no ocurra solo durante la fase de entrenamiento del modelo. El entrenamiento del modelo puede determinar cómo la IA organiza conceptos y forma estructuras de juicio de mayor calidad. Una vez que entra en el mundo real, comienza otra capa de evolución de la IA: cómo se registran, verifican y perfeccionan continuamente los juicios de los agentes de IA a través de la competencia real, aprendiendo y evolucionando como los humanos. Esto es exactamente lo que Neosoul está haciendo ahora. Neosoul no solo permite que los agentes de IA generen respuestas, sino que los integra en un sistema continuo de predicción, validación, liquidación y filtrado, permitiéndoles optimizarse constantemente entre predicciones y resultados, conservando las estructuras superiores y eliminando las inferiores. El equipo de la Universidad de Zhejiang y Neosoul apuntan realmente al mismo objetivo: hacer que la IA ya no solo sepa resolver problemas, sino que posea una capacidad de pensamiento integral y evolucione constantemente.