¿La IA realmente rescató a una empresa de inodoros?

La empresa japonesa de inodoros inteligentes de gama alta TOTO ha visto un aumento significativo en su precio de acciones en los últimos meses debido a la IA, no porque haya vendido más inodoros, sino porque TOTO tiene un negocio oculto: discos electrostáticos de cerámica de alta pureza, un consumible clave utilizado en la fabricación de chips para fijar obleas. TOTO ha logrado una precisión de 1/80 del grosor de un cabello y la pureza más alta de la industria.

En medio de la explosión de la demanda de chips de almacenamiento y la expansión desenfrenada de los proveedores de la cadena de suministro, este negocio se ha convertido en una necesidad absoluta. Esto ha llevado a bancos de inversión como Goldman Sachs a elevar repetidamente la calificación de las acciones de TOTO, por una razón sencilla: los pedidos de electrostáticos ya están comprometidos hasta 2027. Actualmente, este negocio representa más del 40% del beneficio operativo de TOTO.

Cuando una empresa de inodoros se convierte en una acción relacionada con IA, se puede ver cuán caliente es actualmente el sector de almacenamiento de IA. Detrás del auge de las acciones de jugadores clave del sector de almacenamiento como Samsung, SK Hynix, Micron y SanDisk, se encuentra un desequilibrio sin precedentes en la oferta y la demanda de chips de almacenamiento a nivel mundial, el más grave en cuarenta años.

En este artículo, analizaremos este "super ciclo" de almacenamiento y, con expertos de Samsung e inversores de Wall Street, examinaremos: ¿por qué este ciclo es diferente a los anteriores, por qué el almacenamiento es tan crucial para la industria de la IA, cómo empresas como Google están reduciendo su dependencia del almacenamiento, y cuánto tiempo durará esta escasez y cómo afectará a nosotros?

01 Aumento superior al 1800%: HBM, más caro que el oro

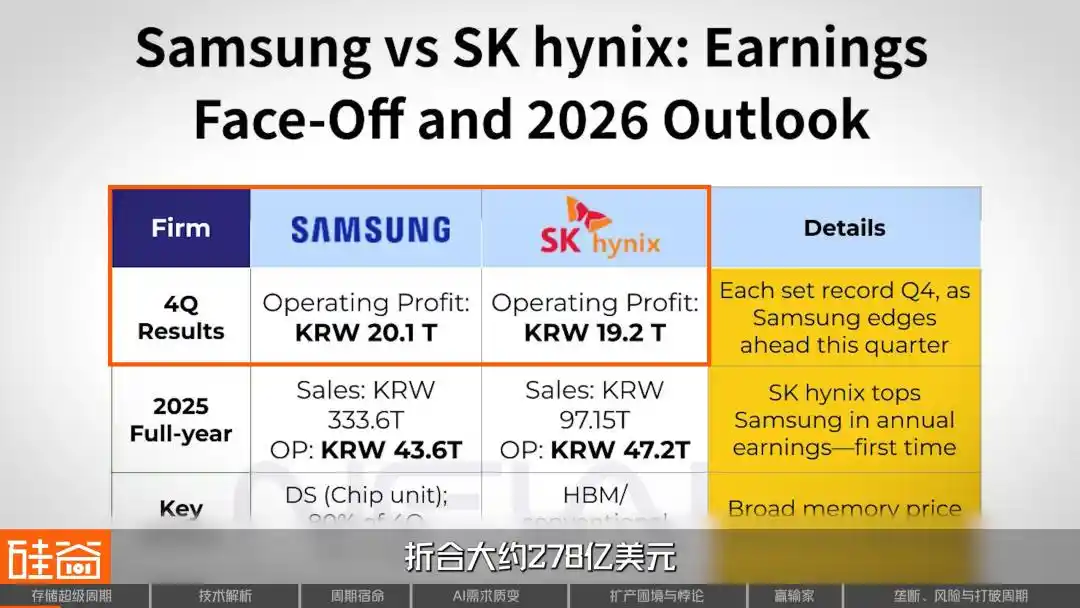

A finales de enero de 2026, los dos gigantes coreanos del almacenamiento, Samsung Electronics y SK Hynix, publicaron simultáneamente sus estados financieros del cuarto trimestre del año anterior. ¿Qué tan extremos fueron los números? La utilidad operativa combinada de ambas empresas alcanzó casi 40 billones de wons coreanos, lo que equivale a aproximadamente 27.8 mil millones de dólares estadounidenses, o unos 300 millones de dólares diarios de ganancia neta. Bajo estos récords históricos de ganancias, la prima anual de SK Hynix alcanzó un promedio de 640.000 yuanes chinos por empleado, superando el récord histórico de la empresa.

El producto central que impulsa todo esto es el chip HBM (High Bandwidth Memory). Un chip HBM del tamaño de una uña cuesta entre 400 y 500 dólares, lo que lo hace más caro que su peso en oro. Solo tres empresas en el mundo pueden fabricarlo: SK Hynix posee aproximadamente el 60%, y Samsung y Micron comparten el 20% restante cada una.

Pero HBM es solo la punta del iceberg; lo que realmente ha puesto en alerta a toda la industria es la crisis generalizada, desde los productos de gama alta hasta los de gama baja, desde DRAM hasta NAND.

Desde finales de 2024 hasta diciembre de 2025, el precio promedio al contado del DDR5 (16 GB) aumentó de 4,6 dólares a 28 dólares, un incremento de más del 500%; el DDR4 más antiguo subió de 3,2 dólares a más de 62 dólares, con un aumento acumulado de casi el 1800%; los módulos de memoria de servidor de 64 GB para centros de datos aumentaron de 255 dólares a 700 dólares en solo seis meses del año pasado, un alza de casi el 175%.

La capacidad de SK Hynix para 2026 ya está completamente vendida, y Samsung aumentó el precio de suministro de la memoria NAND en un 100% en el primer trimestre de 2026, duplicándolo.

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Actualmente, vemos que el precio al contado de la DRAM ya ha superado el máximo precio al contado registrado durante el período nube de 2016-2018. La escasez actual es tal que ya hemos vendido todo lo programado para 2026, y es muy probable que también se agote casi por completo en 2027. Por ejemplo, los precios que ofrecemos a proveedores clave de GPU para nuestros SSD son extremadamente altos, duplicándose en una sola semana.

Al mismo tiempo, surgió una señal más significativa. SanDisk informó a Wall Street en el CES de principios de 2026 que estaba firmando con sus clientes un nuevo tipo de acuerdo de suministro a largo plazo —LTA (long term agreement)—, y esta vez los clientes debían realizar pagos anticipados, los cuales no se reembolsarían en caso de incumplimiento. Esto nunca había ocurrido en la historia de la industria del almacenamiento durante décadas.

Rob Li

Socio gerente de Amont Partners en Nueva York

Los acuerdos a largo plazo (LTA, acuerdos de suministro a largo plazo) no han sido inusuales en la historia, pero en las últimas décadas, los LTA nunca han tenido ningún efecto ejecutable. Cuando el mercado entra en un ciclo bajista, si el cliente dice que no reconoce el acuerdo, no tienes absolutamente ningún recurso contra él.

Y esta vez, el enfoque cambió. Los proveedores de almacenamiento dominantes establecieron nuevas reglas.

Rob Li

Socio gerente de Amont Partners en Nueva York

SanDisk le dice a Wall Street o al mercado: ahora nuestros acuerdos de largo plazo con los clientes son muy diferentes a los anteriores. Estos acuerdos tienen validez legal, y los clientes nos pagan por adelantado; si pagas por adelantado y luego decides retirarte, no recuperarás tu pago anticipado si no pagas al precio acordado.

La evaluación de Rob es que si SanDisk puede lograr esto, no hay razón para que los otros tres gigantes, SK Hynix, Samsung y Micron, no puedan hacerlo. En este escenario, todo el superciclo probablemente se extienda hasta 2027.

02 Desglose integral de la cadena de valor: ¿Cómo funciona la industria del almacenamiento?

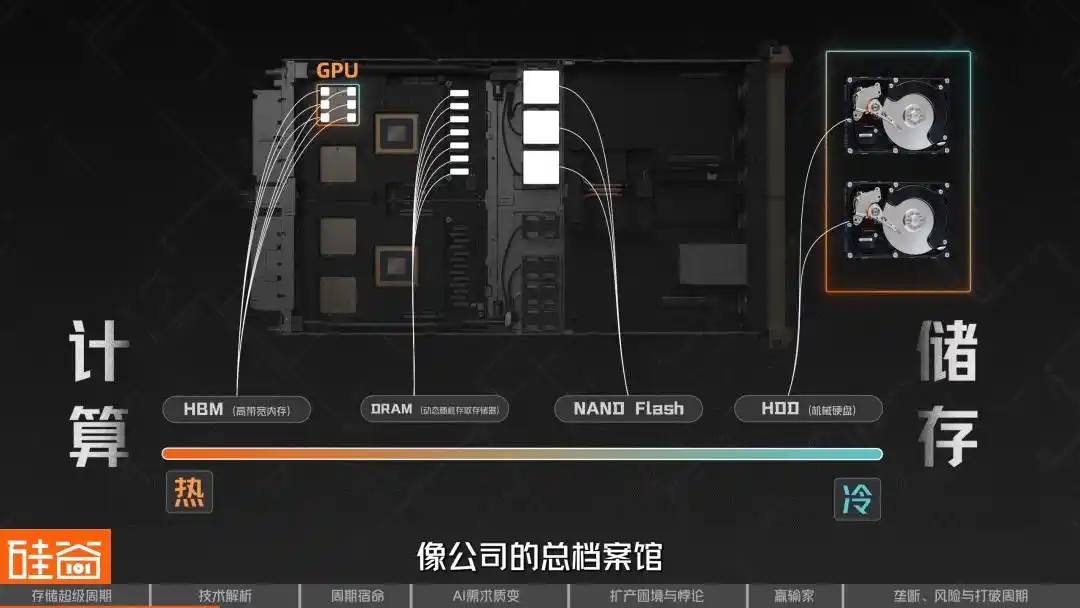

En la industria del almacenamiento, podemos clasificarlo en caliente y frío: cuanto más cerca esté del cálculo, más caliente será; cuanto más se enfoque en su atributo puramente de almacenamiento, más frío será.

Por lo tanto, el más "caliente" es el DRAM (memoria de acceso aleatorio dinámica), el almacenamiento más cercano al cálculo, que se puede entender como la "memoria de operación" de las computadoras y los teléfonos móviles; cuando el chip está funcionando, los datos deben cargarse primero en el DRAM para ser procesados. Su característica es una velocidad extremadamente rápida, pero pierde los datos al apagarse, lo que lo clasifica como "memoria a corto plazo".

Entre ellos, HBM (High Bandwidth Memory) es una forma especial evolucionada de DRAM. Apila verticalmente múltiples capas de chips DRAM mediante la tecnología de vias de silicio (TSV) y los integra en la misma placa base junto con la GPU, lo que aumenta enormemente el ancho de banda.

Por eso, todos los chips de última generación utilizados para el entrenamiento de IA, ya sea la GPU de NVIDIA o el TPU de Google, dependen del HBM, el producto más destacado y escaso de este superciclo.

Dentro de la familia DRAM, en realidad hay una gran variedad de productos, como GDDR (utilizado en tarjetas gráficas), Low-Power DDR (LPDDR, utilizado en teléfonos y portátiles), entre otros. Cada escenario de aplicación corresponde a productos distintos. No es posible que un solo chip DRAM sirva para todos los dispositivos; el HBM utilizado en las GPU de NVIDIA y el LPDDR en tu teléfono, aunque ambos son DRAM, tienen diferencias completamente distintas en términos de proceso de fabricación, método de empaquetado y especificaciones de rendimiento.

En el extremo "frío", está el NAND. Si la DRAM es la memoria a corto plazo, el NAND Flash es la memoria a largo plazo. Conserva los datos incluso sin alimentación eléctrica y es el componente fundamental de los discos de estado sólido (SSD), el almacenamiento de los teléfonos móviles y las unidades USB que usamos diariamente. Las fotos que guardas en tu teléfono y los juegos que instalas en tu computadora descansan todos sobre el NAND.

El papel de NAND en la era de la IA también está evolucionando rápidamente. Anteriormente, era simplemente un "almacén" encargado de almacenar datos a largo plazo, pero ahora NAND está pasando de ser un almacén en segundo plano a convertirse en un depósito de munición en la primera línea.

Más allá de lo "frío", se encuentran los discos duros mecánicos tradicionales (HDD), que leen y escriben datos mediante la rotación de discos magnéticos; son más lentos, pero económicos y con gran capacidad, y actualmente se utilizan principalmente en escenarios de almacenamiento en frío y archivado en centros de datos.

A medida que la demanda de inferencia de IA sobre la jerarquía de almacenamiento se vuelve más refinada, ahora se asemeja cada vez más a un sistema de almacenamiento por capas. Los datos más urgentes se colocan en HBM, como si estuvieran al alcance de la mano; los datos utilizados con frecuencia pero menos urgentes se almacenan en DRAM, como en un cajón del escritorio; los datos menos utilizados, solo como respaldo, se guardan en NAND/SSD, como en un armario de oficina; y los grandes volúmenes de información acumulada a largo plazo, que requieren acceso compartido por múltiples usuarios, se almacenan en el almacenamiento compartido posterior, como el archivo central de la empresa.

Rob Li

Socio gerente de Amont Partners en Nueva York

La inteligencia artificial favorece más a lo que es intensivo en recursos, y por supuesto, también es necesaria para el almacenamiento. He utilizado IA para crear muchas imágenes y muchos videos; según las regulaciones de diversos países, esto no se puede eliminar y debe conservarse, lo que sin duda ha aumentado significativamente la demanda de almacenamiento. Pero su primera manifestación más directa seguramente estará relacionada con el cálculo: quienes estén más cerca del cálculo obtendrán beneficios más evidentes a corto plazo.

A continuación, hagamos un recuento de los actores en toda la cadena de suministro de almacenamiento.

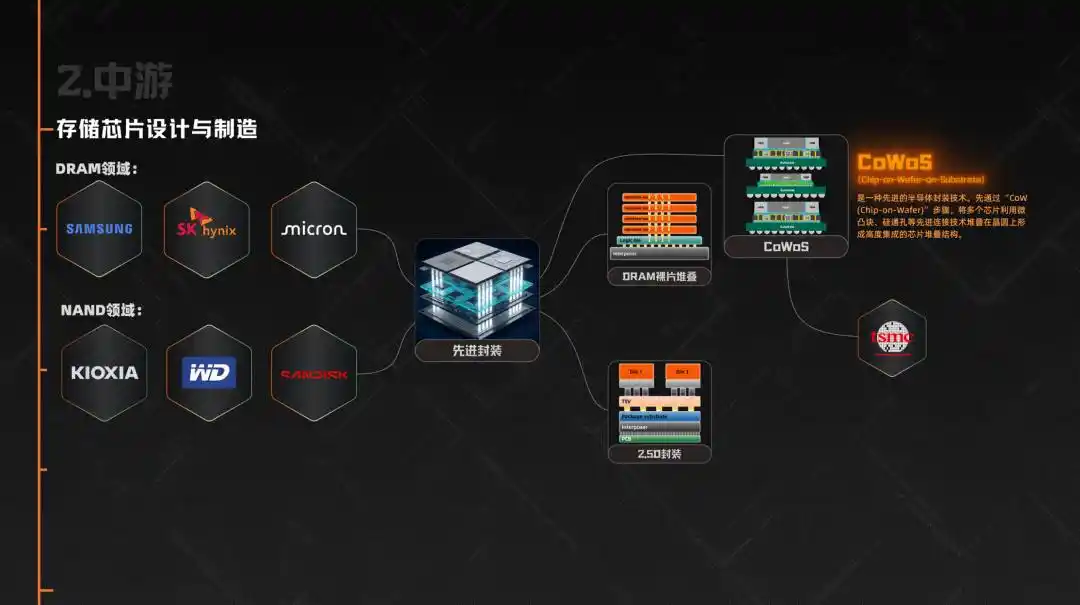

La etapa más aguas arriba son los materiales y obleas de silicio, como SUMCO de Japón, uno de los proveedores más importantes de obleas de silicio para semiconductores a nivel mundial. En la etapa de fabricación, los fabricantes de equipos clave incluyen a ASML, líder en litografía, y empresas como Tokyo Electron, que cubren múltiples procesos como recubrimiento y revelado, deposición, grabado y limpieza.

Al mismo tiempo, en la capa de diseño de chips antes de la fabricación, empresas como Cadence y Synopsys, que se especializan en EDA, verificación e IP de diseño, son igualmente indispensables; mientras que fabricantes de IP de interfaz como Rambus desempeñan un papel clave en arquitecturas de memoria de alta velocidad como HBM. Aunque no son tan visibles como las GPU, en este superciclo impulsado por la IA, todas son superesenciales.

La etapa intermedia consiste en el diseño y fabricación de chips de memoria. En el ámbito de la DRAM, Samsung, SK Hynix y Micron juntas representan el 95% del mercado global. En el ámbito de la NAND, además de estas tres empresas, también se encuentran Kioxia, Western Digital y SanDisk.

Luego está la etapa que se volvió especialmente crítica en este ciclo: el empaquetado avanzado. Porque HBM no termina simplemente con la fabricación de DRAM; primero se deben apilar múltiples裸片 (die) de DRAM y luego integrarlos con GPU u otros aceleradores de IA mediante empaquetado 2.5D. Precisamente por esto, la tecnología de empaquetado semiconductora CoWoS se convirtió en uno de los cuellos de botella más críticos en la cadena de suministro de chips de IA, limitando directamente la entrega real de HBM, y la capacidad de producción de CoWoS está principalmente a cargo de TSMC.

A continuación se encuentran diversas aplicaciones finales, incluidos centros de datos y proveedores de nube, como Microsoft, Google, Amazon y ByteDance, que actualmente son los mayores inversores; luego siguen los fabricantes de teléfonos móviles (Apple, Samsung, Xiaomi, OPPO), fabricantes de PC (Lenovo, Dell, HP), fabricantes de automóviles (Tesla, Li Auto, NIO), así como consolas de juegos y equipos industriales, entre otros.

Entonces puedes ver que, aunque toda la cadena es muy larga, el verdadero poder de fijación de precios está altamente concentrado en las tres empresas del sector intermedio: Samsung, SK Hynix y Micron. Ellas deciden qué productos fabricar, a quién suministrar y a qué precio vender. Y en este mercado, donde la oferta es mucho menor que la demanda, su poder de negociación es sin precedentes.

03 ¿Por qué siempre hay aumentos y caídas bruscas: el ciclo natural de la industria del almacenamiento

Otra característica muy importante del sector de almacenamiento es su ciclicidad. Históricamente, siempre ha oscilado entre "grandes aumentos" y "grandes caídas". Detrás de esto hay dos razones: una física y otra económica.

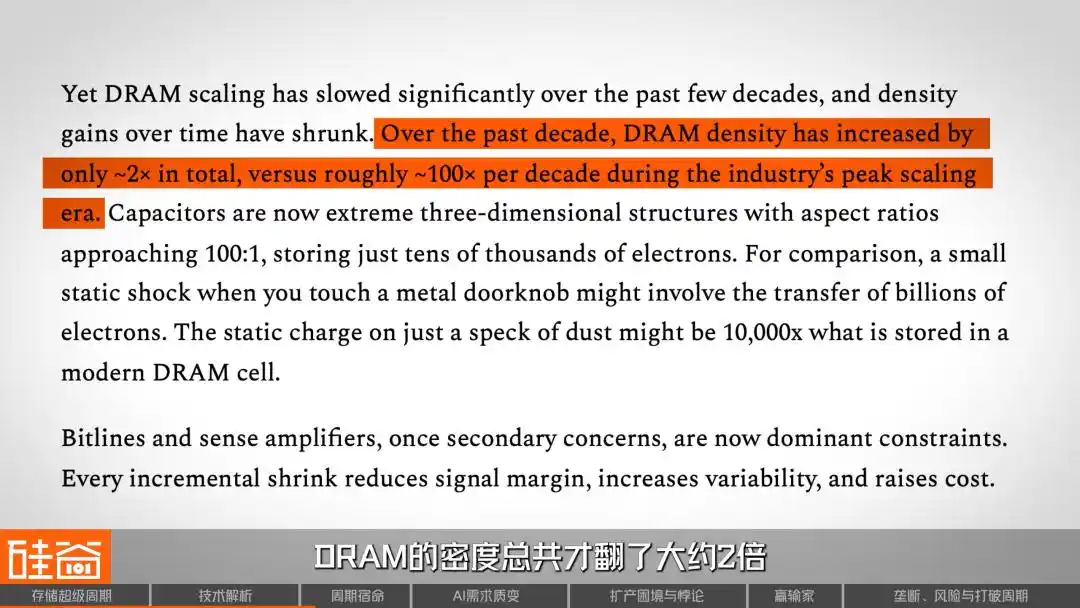

Primero, la física. La DRAM, que es la "memoria de operación" en teléfonos y computadoras, almacena datos mediante la acumulación de carga eléctrica. Durante décadas, los ingenieros han estado reduciendo y aumentando la cantidad de unidades de almacenamiento para mejorar la densidad. En su punto más alto, la densidad de la DRAM se duplicaba cien veces cada década.

Pero hoy en día ya no es así: el informe de SemiAnalysis indica que, en la última década, la densidad de DRAM solo se ha duplicado aproximadamente dos veces, mientras que antes era de 100 veces cada década; la reducción ha disminuido significativamente. Esto significa que la caída de los costos de los chips de memoria ya no se logra “automáticamente” gracias al progreso tecnológico, como antes, sino que depende más de los cambios en la capacidad productiva y del equilibrio entre oferta y demanda.

Hablemos ahora de economía. La fabricación de chips de almacenamiento es una de las industrias más intensivas en capital del mundo; construir una fábrica de obleas avanzada requiere decenas o incluso cientos de miles de millones de dólares, con un período de construcción de dos a tres años. Una vez invertido ese dinero, se convierte en un costo hundido, por lo que, incluso cuando la demanda es baja, los fabricantes tienden a seguir produciendo, ya que detener la producción les causaría mayores pérdidas.

Lo que es aún más crítico es que el modelo de la industria de almacenamiento es “construir primero, vender después”, lo cual es completamente diferente a la lógica de TSMC de “recibir pedidos primero, luego expandir la producción”. Los fabricantes de almacenamiento deben adivinar por sí mismos cuál será la demanda futura y anticipar la capacidad de producción dos o tres años antes. Si aciertan, todos ganan; si se equivocan, es un desastre.

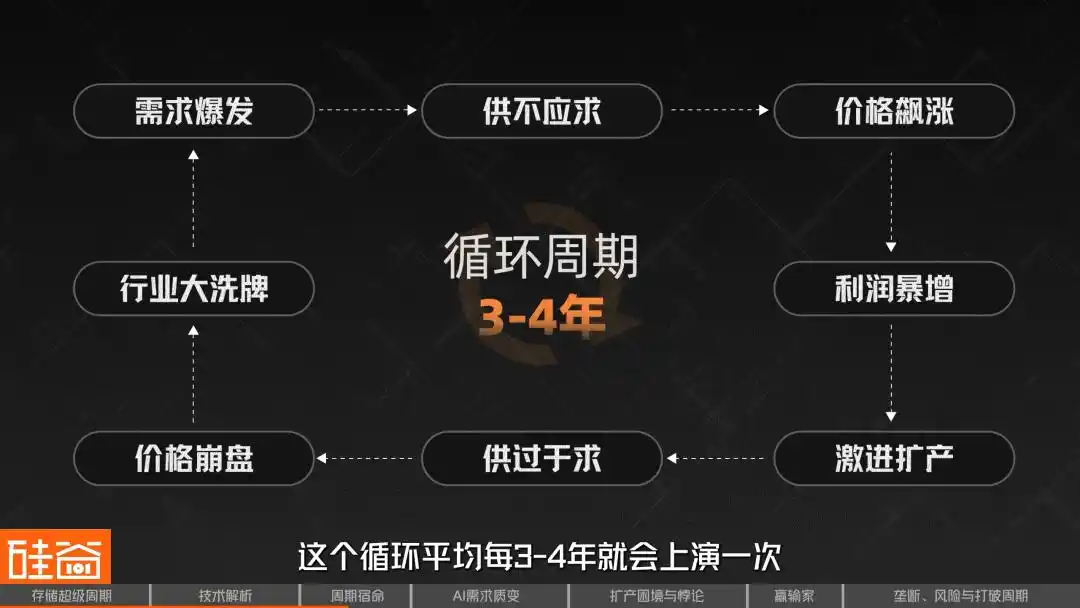

Esta contradicción estructural ha generado el clásico ciclo que se repite una y otra vez en la industria del almacenamiento: explosión de la demanda → escasez de oferta → aumento vertiginoso de precios → ganancias exponenciales → expansión agresiva de la producción → exceso de oferta → colapso de precios → reestructuración masiva de la industria. Durante los últimos treinta años, este ciclo se ha repetido cada 3 a 4 años, sin excepción.

Como resultado, los proveedores globales de DRAM se redujeron de más de 20 en la década de 1990 a solo tres gigantes y aspirantes como CXMT en China. En cada ciclo, algunos fueron eliminados, como Infineon Technologies en Alemania, que quebró, y Elpida Memory en Japón, que se retiró. Estas lecciones sangrientas han hecho que toda la industria sienta un profundo respeto por la palabra "ciclo".

En la historia de la industria del almacenamiento de las últimas décadas, han ocurrido cuatro ciclos.

La primera vez fue en 1993, al comienzo de Windows PC. La popularización de la interfaz gráfica provocó un aumento masivo en la demanda de memoria, mientras que la oferta sufrió una grave escasez de capacidad productiva, lo que hizo que los precios se dispararan. Como resultado, se construyeron aproximadamente 50 nuevas fábricas en todo el mundo; tras el exceso de capacidad, los precios se desplomaron y muchos jugadores salieron del mercado.

La segunda fue en 2010, con la era de los smartphones y la nube. El iPhone y Android generaron un crecimiento explosivo, y la DRAM de servidores pasó de unos pocos GB a decenas de GB. Pero la estandarización aceleró la comercialización, lo que dificultó a los proveedores diferenciarse, resultando en un ciclo más corto de lo esperado.

La tercera fue entre 2017 y 2018. Los proveedores de nube actualizaron sus centros de datos, incorporando más DRAM en cada servidor, y como la memoria de servidor es más cara y más rentable que la de consumo, las margenes brutas de los tres grandes fabricantes alcanzaron máximos históricos. Sin embargo, la alta rentabilidad estimuló la expansión de la producción; una vez que la demanda superó su pico, la industria volvió a caer en una fase bajista a finales de 2018.

La cuarta fue de 2020 a 2021, un auge inesperado impulsado por la pandemia. El trabajo desde casa y el aumento masivo del uso en la nube generaron una demanda falsa creada por compras compulsivas duplicadas; tras la marea baja, hubo un exceso grave de inventario, seguido por un fuerte descenso entre 2022 y 2023. Desde entonces, la capacidad productiva se redujo drásticamente, pero precisamente este período conservador sentó las bases para la escasez actual. Al entrar en 2025, la capacidad productiva de toda la industria vuelve a estar gravemente insuficiente.

Entonces, ¿cuál es la lección fundamental que la historia nos enseña? Los llamados superciclos pasados nunca han durado más de dos años; siempre han seguido el patrón de “altos beneficios → expansión desenfrenada → exceso → colapso”, una ley de hierro de las últimas cuatro décadas. Tras tantos ciclos, inversores y profesionales han desarrollado un reflejo condicionado profundamente arraigado: cuanto más fuerte sube, más rápido cae.

But this time, increasing evidence suggests that historical patterns may be broken.

04 Por qué esta vez es diferente: el cambio cualitativo en la demanda desde el entrenamiento hasta la inferencia

4.1 Comencemos con una intuición más sencilla

Antes de explicar modelos complejos de oferta y demanda, primero establezcamos la lógica más simple. Cada día abres ChatGPT o Gemini, subes archivos, guardas conversaciones y haces que la IA recuerde tus preferencias; es posible que no te des cuenta de que cada interacción consume recursos de almacenamiento. No solo cálculos en el servidor, sino también una enorme cantidad de memoria y memoria flash.

Actualmente, la mayoría de los usuarios de IA no tienen lealtad; usan a quien tenga un modelo más útil y más barato. Pero imagina que un día tu asistente de IA realmente te "entienda", recuerde tus hábitos de trabajo, tus preferencias de expresión y los detalles de proyectos discutidos hace tres meses: ¿aún cambiarías de plataforma tan fácilmente?

Esta "adhesión de la memoria" es el arma central que las empresas de modelos grandes utilizan para construir su ventaja competitiva, y la infraestructura de hardware que sustenta esta adhesión es el almacenamiento: almacenamiento masivo y multinivel.

Otra lógica igualmente intuitiva: los modelos de video se vuelven cada vez más potentes, y la generación de video por IA se acerca a la utilidad práctica. Dado que la cantidad de datos de video es decenas o incluso cientos de veces mayor que la de texto, la demanda de almacenamiento experimentará un aumento exponencial.

Rob Li

Socio gerente de Amont Partners en Nueva York

La memoria es como una pizarra pequeña. Antes, calculábamos 1+1=2, así que no necesitabas una pizarra enorme; una pizarra normal era suficiente. Pero ahora, en la era de la IA, la intensidad y la complejidad de los cálculos son mucho mayores y constan de muchos pasos. Si yo fuera una pizarra pequeña, cada vez que escribieras, borraras, volvieras a escribir y volvieras a borrar, con 100 pasos de cálculo, tendrías que borrar 100 veces, lo que consumiría mucho de tu tiempo. Por eso, ahora necesitamos crear una pizarra enormemente grande, en la que pueda escribir los 100 pasos de cálculo de una sola vez y borrarlos también de una sola vez, ahorrándote tiempo.

Entonces, una pizarra cada vez más grande, así es la demanda de almacenamiento en la era de la IA.

4.2 De entrenamiento a inferencia: la demanda de almacenamiento experimenta un cambio cualitativo

En las etapas iniciales de la IA generativa, la potencia de cómputo y el dinero se invirtieron principalmente en el entrenamiento de modelos; el sistema de almacenamiento durante la fase de entrenamiento se encargaba principalmente de alimentar eficientemente datos a miles de GPU y realizar puntos de control del modelo periódicamente para evitar que se perdiera todo el trabajo en caso de interrupción.

Pero hoy en día, la inferencia está convirtiéndose rápidamente en el campo de batalla principal, y el patrón de demanda de almacenamiento para la inferencia es mucho más complejo que el de entrenamiento.

Debe cargar el modelo desde el nivel de almacenamiento al nivel de memoria: los pesos activos residen principalmente en HBM, mientras que parte del estado y la caché se mantienen en DRAM; cuando el KV Cache (caché de clave-valor) no cabe en la memoria superior, una parte se descarga en SSD/NAND y se recupera cuando sea necesario; y el conocimiento externo del que dependen las consultas RAG generalmente se almacena en almacenamiento compartido o en un data lake más posterior, accesado en tiempo real por el sistema de recuperación.

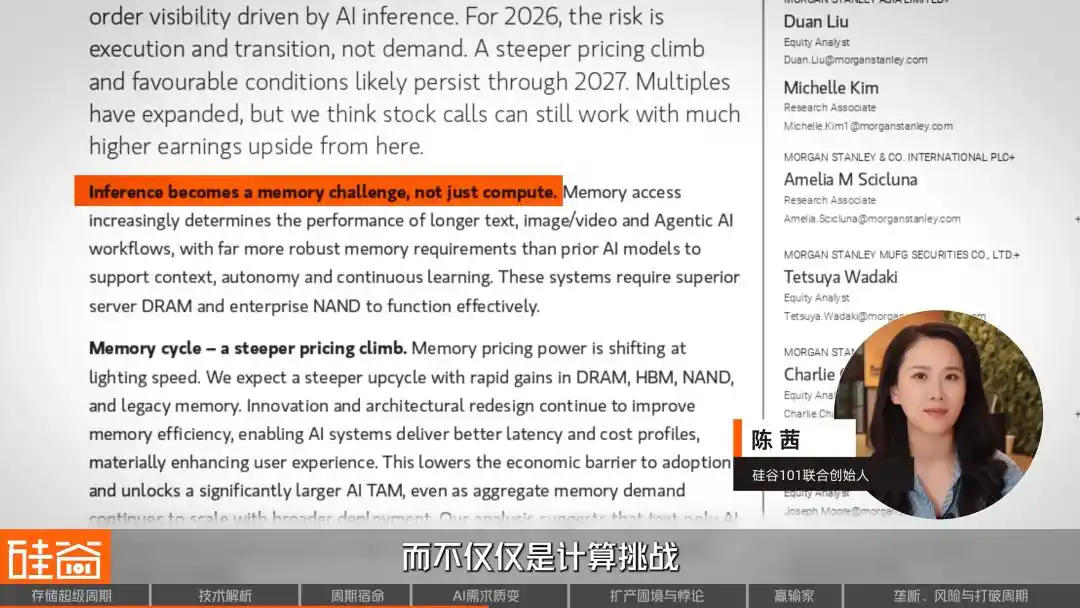

Sin embargo, la variable más grande es el auge de los agentes de IA. En su último informe de investigación, Morgan Stanley señala que 2026 será el año en que la IA pase de experimentos a convertirse en infraestructura fundamental, ya que estos agentes serán más confiables, tendrán mejor memoria, generarán menos ilusiones y podrán aprender continuamente. El informe afirma: “El razonamiento se está convirtiendo en un desafío de memoria, y no solo en un desafío de cálculo”.

Pero para que los agentes funcionen, es necesario mantener múltiples capas de memoria: memoria de trabajo a corto plazo (diálogo actual), memoria a largo plazo (historial del usuario entre sesiones), base de conocimientos preentrenada, registro de llamadas a herramientas... y cada capa requiere soporte de almacenamiento en distintos niveles: desde los "datos calientes" en HBM, hasta los "datos tibios" en DRAM y los "datos fríos" en SSD NAND.

Entonces la tendencia es clara: la próxima ola de avances en IA no vendrá de una capacidad de razonamiento más fuerte, sino de un mejor manejo del contexto. Un asistente de IA que puede recordar todo es mucho más útil que un modelo más grande pero que no recuerda nada. ¿Qué significa esto para el almacenamiento?

4.3 Hacer cuentas: ¿Cuánto almacenamiento consumirá realmente la IA?

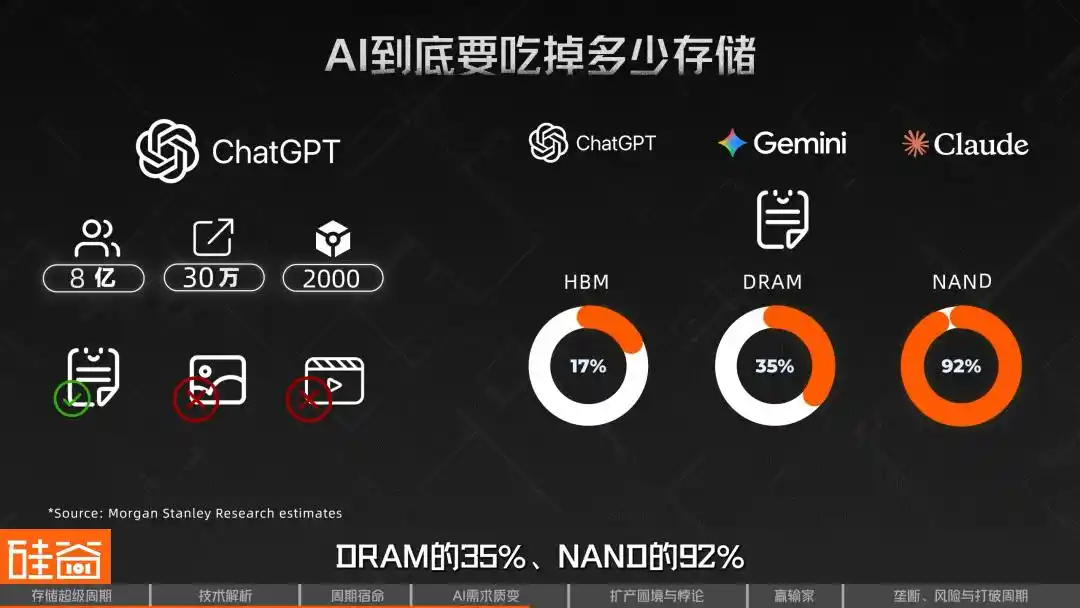

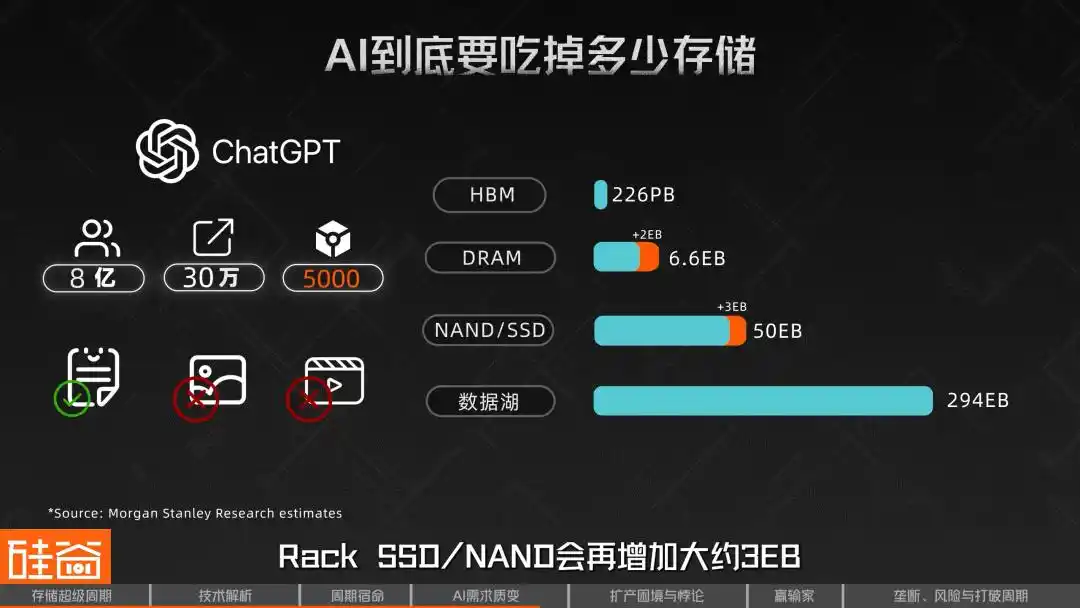

Morgan Stanley realizó un cálculo detallado por capas. Basándose en un modelo del tamaño de ChatGPT, asumieron aproximadamente 800 millones de usuarios activos semanales, un pico de 300.000 solicitudes por segundo, 2.000 tokens de entrada por solicitud, y supusieron solo texto, excluyendo imágenes y videos. Según este desglose detallado, dicho sistema requeriría aproximadamente 226 PB de HBM, 4,6 EB de DRAM, 47 EB de NAND/SSD y un data lake de aproximadamente 294 EB.

Estos números significan que si existieran tres modelos de este tamaño a nivel mundial, como ChatGPT + Gemini + Claude, solo la demanda de inferencia de texto puro representaría el 17% de la oferta global de HBM, el 35% de la de DRAM y el 92% de la de NAND en 2026. Esto aún no incluye las demandas multimodales como imágenes y videos.

Más importante aún, este cálculo es muy sensible a la longitud del contexto. El análisis de sensibilidad de Morgan Stanley muestra que, si se aumenta la entrada de 2.000 tokens por vez a 5.000 tokens, manteniendo otros factores constantes, la demanda de DRAM por modelo aumentará aproximadamente 2 EB, y el SSD/NAND por rack aumentará aproximadamente 3 EB. Es decir, a medida que contextos más largos y cadenas de pensamiento más extensas se vuelvan normales, la presión sobre el almacenamiento se amplificará rápidamente.

SemiAnalysis llama a esto la "Ley de Parkinson de la memoria": cada vez que aumenta la capacidad de HBM, los desarrolladores inmediatamente construyen modelos más grandes para llenarla. Las diversas técnicas anteriores utilizadas para comprimir modelos se relajan tan pronto como hay nuevo espacio disponible, hasta que nuevamente se choca contra un límite, lo que significa que el almacenamiento siempre será el siguiente cuello de botella.

Por eso, en la industria hay voces que consideran que los fabricantes de chips de almacenamiento podrían haber subestimado colectivamente la demanda generada por el aumento de tokens en modelos de lenguaje grandes.

Rob Li

Socio gerente de Amont Partners en Nueva York

Los ciclos anteriores podrían haber durado solo de uno y medio a dos años; este ciclo podría extenderse durante un período mucho más largo, o dicho de otra manera, cuando una industria cíclica se convierte en una industria de crecimiento estructural, ya no es un ciclo.

Otro factor determinante de este ciclo es la expansión de la oferta de capacidad; la pregunta es, ¿por qué resulta tan desafiante aumentar la producción?

05 Cuanto más se produce, más escasez: La dificultad y la disputa del HBM-DRAM

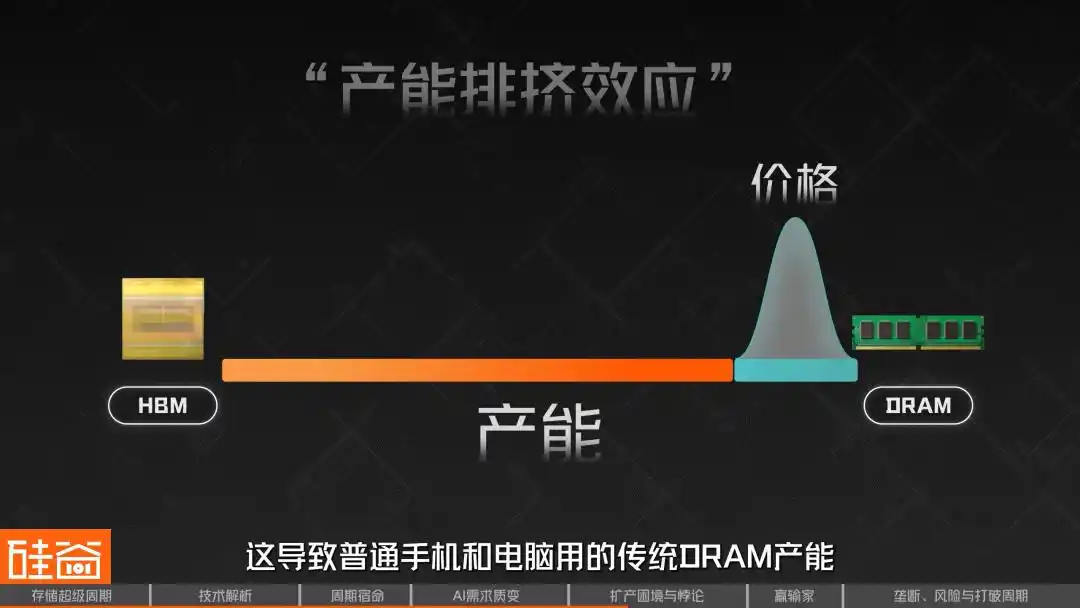

Comprender este superciclo tiene otra clave esencial: entender un fenómeno que parece contradictorio: la expansión a gran escala de HBM no ha aliviado la escasez de DRAM, sino que la ha empeorado.

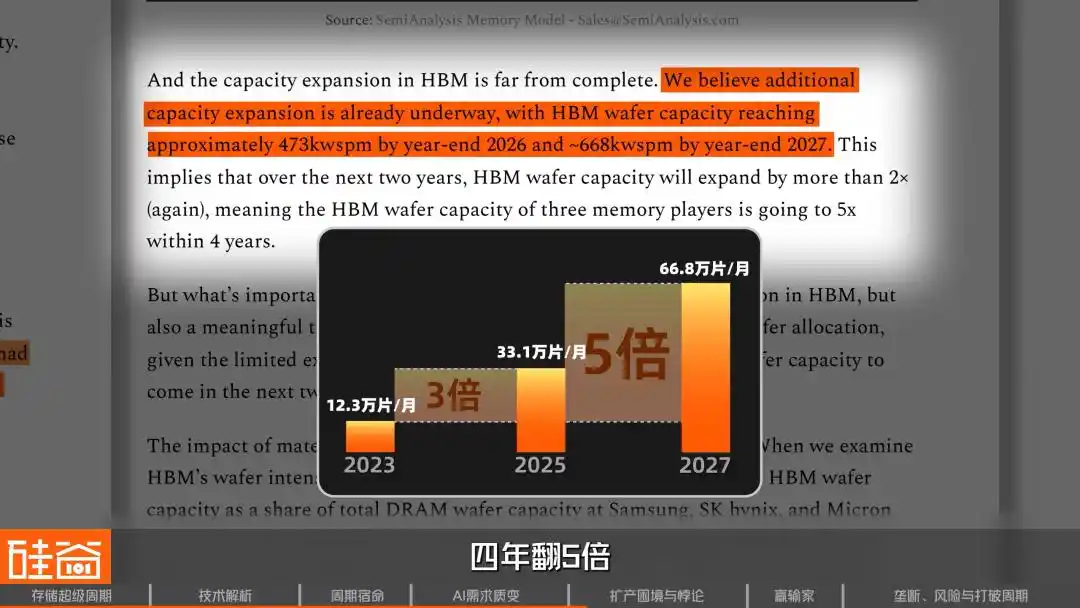

Los datos de seguimiento de SemiAnalysis muestran que a finales de 2023, los tres principales fabricantes de almacenamiento asignaron aproximadamente 123.000 obleas/mes a HBM. Para finales de 2025, esta cifra aumentó a 331.000 obleas/mes, casi triplicándose en dos años. Se espera que para finales de 2027 alcance aún más los 668.000 obleas/mes, quintuplicándose en cuatro años.

¿Por qué aún hay escasez de DRAM si se ha ampliado tanto? La clave está en que la producción de HBM consume una gran cantidad de capacidad de DRAM común, y lo hace con una eficiencia extremadamente baja.

HBM es una arquitectura que consume enormemente obleas. Una oblea utilizada para una pila de 12 capas de HBM3E produce aproximadamente un tercio de la capacidad de almacenamiento de una oblea de DRAM convencional; en el caso de HBM4, esta proporción podría empeorar aún más hasta un cuarto.

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

En comparación con la DRAM tradicional, al producir HBM, nuestra producción por oblea es solo un tercio de la de la DRAM común.

Esto significa que por cada 1 GB adicional de HBM que el fabricante produce, el mercado pierde la oportunidad de producir 3-4 GB de DRAM convencional.

¿Por qué la eficiencia es tan baja? Porque la complejidad de fabricación de HBM es mucho mayor que la de DRAM convencional; procesos como TSV (vías de silicio), adelgazamiento de obleas y procesamiento en la parte trasera generan pérdidas adicionales de rendimiento. Al realizar apilamientos de 8 o 12 capas, si un solo die (chip) está defectuoso, todo el stack (apilamiento) puede quedar inutilizado.

Todos estos problemas combinados hacen que el HBM sea un producto de “escalado inverso”: cuanto más se produce, mayor es el consumo de capacidad.

Esto ha generado el "dilema del HBM-DRAM", conocido en la industria como el "efecto de desplazamiento de capacidad". Debido a que el HBM tiene mayores beneficios y está reservado por los gigantes de la IA, los fabricantes priorizan asignar su capacidad limitada de obleas a las líneas de producción de HBM. Esto ha comprimido severamente la capacidad de DRAM tradicional utilizada en teléfonos móviles y computadoras comunes, provocando un aumento explosivo y compensatorio en los precios.

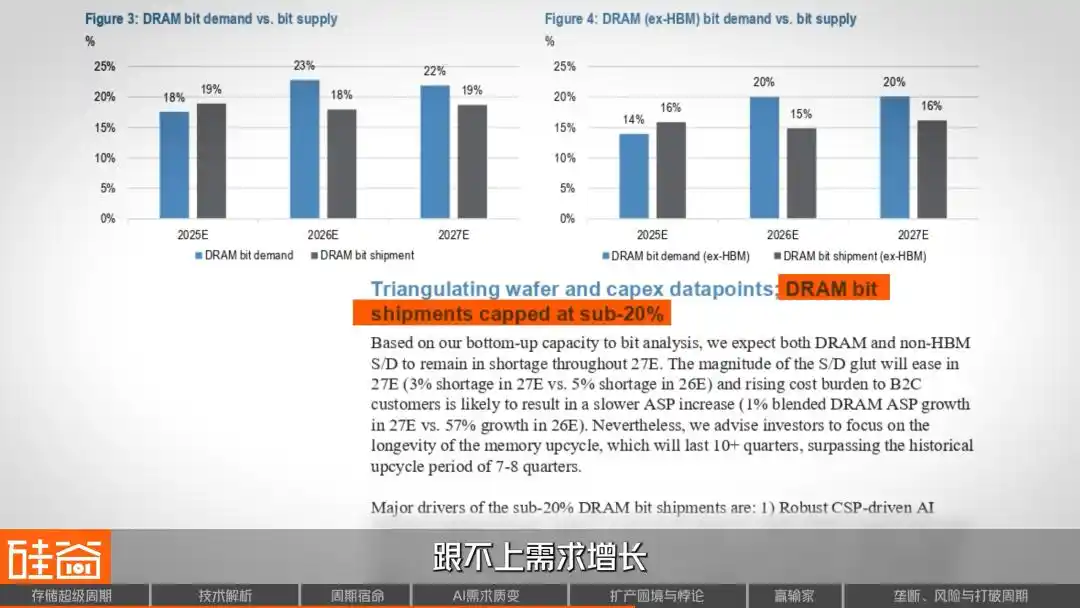

El modelo de oferta y demanda del informe de J.P.Morgan también llega a una conclusión similar: el crecimiento de la oferta de DRAM se mantendrá por debajo del 20% en los próximos dos años, no acompañando el crecimiento de la demanda.

Por lo tanto, surgió otro fenómeno sorprendente: aunque el proceso de DRAM convencional es más sencillo que el de HBM, debido a la limitación de capacidad y al aumento vertiginoso de los precios, su margen de beneficio alcanzó, en el cuarto trimestre de 2025, niveles iguales e incluso superiores a los de HBM. Esto se debe a que la mayoría de los precios de HBM están fijados mediante contratos a largo plazo, mientras que los precios al contado del DRAM convencional reflejan rápidamente la tensión entre oferta y demanda. Esto plantea un dilema a los fabricantes: ¿continuar expandiendo agresivamente HBM o reservar parte de la capacidad para el DRAM convencional, que también genera beneficios extraordinarios?

06 Las tres grandes montañas para la expansión: escasez de salas limpias, conservadurismo de los proveedores de equipos y fricciones en el proceso

La demanda ya es lo suficientemente loca, y las restricciones en el lado de la oferta son aún más asfixiantes.

Primer cuello de botella: falta de recursos de producción como salas limpias. La fabricación de chips requiere salas limpias, pero tras la pandemia, debido a la caída en el ciclo de producción, los fabricantes de almacenamiento adoptaron una postura conservadora y redujeron sus inversiones, lo que provocará una grave escasez de salas limpias en 2025 y 2026.

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Debido a que la producción de chips requiere condiciones ambientales extremadamente estrictas, lo que más nos preocupa es si tenemos suficientes clean rooms y suficiente energía eléctrica. Podríamos fabricar suficientes chips, pero si no tenemos suficiente power para hacerlos funcionar, no serviría de nada.

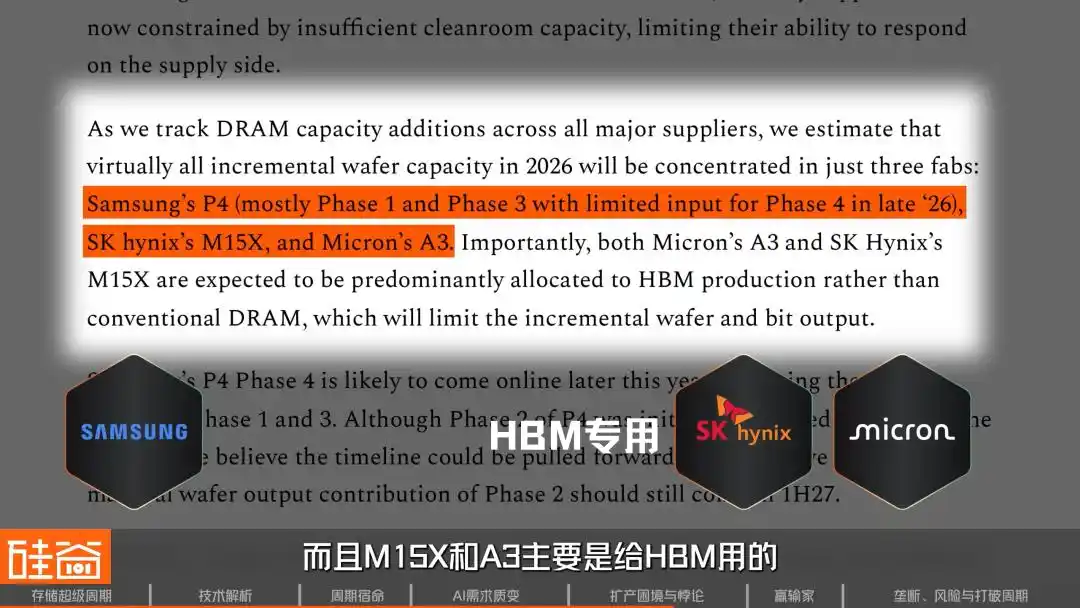

El seguimiento de SemiAnalysis muestra que casi toda la nueva capacidad de obleas del sector en 2026 se concentrará en tres fábricas: P4 de Samsung, M15X de SK Hynix y A3 de Micron. Además, M15X y A3 están principalmente destinadas a HBM, con una contribución limitada al DRAM convencional.

¿Qué nueva capacidad significativa hay? La fábrica de SK Hynix en Yongin no entrará en funcionamiento hasta febrero de 2027 como muy pronto; la fábrica de Micron en Idaho apunta a mediados de 2027. Es decir, durante los próximos más de un año, la oferta no tendrá prácticamente ningún aumento.

Segundo cuello de botella: los proveedores de equipos aguas arriba no están dispuestos a aumentar la producción.

Rob Li

Socio gerente de Amont Partners en Nueva York

Muchos fabricantes de equipos, como muchos proveedores japoneses, tienen una gran empresa llamada Tokyo Electron que no quiere expandir su producción, es muy conservadora. Debido a que ha atravesado muchos ciclos en las últimas décadas, ampliar la capacidad de producción también requiere varios años; cuando la capacidad ampliada esté disponible, es posible que el ciclo de IA ya haya terminado. Por lo tanto, prefiere no expandirse: en lugar de intentar ganar 500 yuanes, se conforma con ganar 100 yuanes, y vive muy bien con eso.

Fuente de la imagen: TEL

Este es un ejemplo clásico del "efecto del barril de madera": incluso si los fabricantes de almacenamiento tienen dinero y determinación para aumentar la producción, las limitaciones en el suministro de equipos de la cadena de suministro retrasarán significativamente la puesta en marcha de la capacidad.

Tercer cuello de botella: la fricción asociada a la migración de los nodos avanzados. Para maximizar la producción de bits de memoria bajo la limitada capacidad de obleas, los tres principales fabricantes están acelerando la transición hacia los nodos avanzados 1b (el nodo de producción más avanzado actual) y 1c (el próximo nodo que pronto entrará en producción masiva), ya que cuanto más avanzado es el proceso, más fina es la litografía del circuito; en una oblea del mismo tamaño, el nodo 1c permite obtener más chips de memoria que el nodo 1b.

Pero el proceso de migración de esta línea de producción requiere detener las máquinas y realizar una nueva calibración e instalación que puede durar semanas e incluso meses, lo que también provocará fluctuaciones en la tasa de rendimiento y pérdidas de capacidad durante varios trimestres. En el momento crucial de la explosión de la demanda de IA en 2026, esto resulta demasiado tardío para satisfacer las necesidades inmediatas.

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Desde que se toma la decisión de aumentar la capacidad hasta que se construye un Fab (fábrica de semiconductores), y luego hasta que la etapa de back-end pueda producir chips DRAM o NAND, se necesitan tres años. En este momento, aparece un chip difícil de fabricar como el HBM; como mencioné antes, en comparación con el DRAM convencional, el HBM tiene solo un tercio de la capacidad de producción. Originalmente, se necesitaban dos o tres años para aumentar la capacidad, pero ahora la salida se reduce en un tercio, por lo que la oferta y la demanda siguen siendo bastante ajustadas en este ciclo.

La insuficiencia de recursos de producción como salas limpias, la falta de expansión por parte de los proveedores de equipos y las fricciones inherentes a la transición a nodos avanzados: la superposición de estos tres cuellos de botella explica por qué, incluso aunque todos sepamos que los chips de almacenamiento están aumentando descontroladamente, la oferta no puede responder.

07 Reasignación de beneficios en la cadena de valor: ¿Quién disfruta de la fiesta y quién enfrenta el invierno?

El auge de los precios de los chips de almacenamiento, por supuesto, no es sin costo; está reasignando las ganancias de toda la cadena de valor electrónica.

Primero, los grandes ganadores de esta cadena de beneficios: además de las ganancias astronómicas de los dos gigantes coreanos, los fabricantes chinos de almacenamiento también se han disparado. Biwin Storage espera un crecimiento anual de las ganancias entre 427% y 520% para 2025, mientras que Demingli prevé un crecimiento del 85% al 128%.

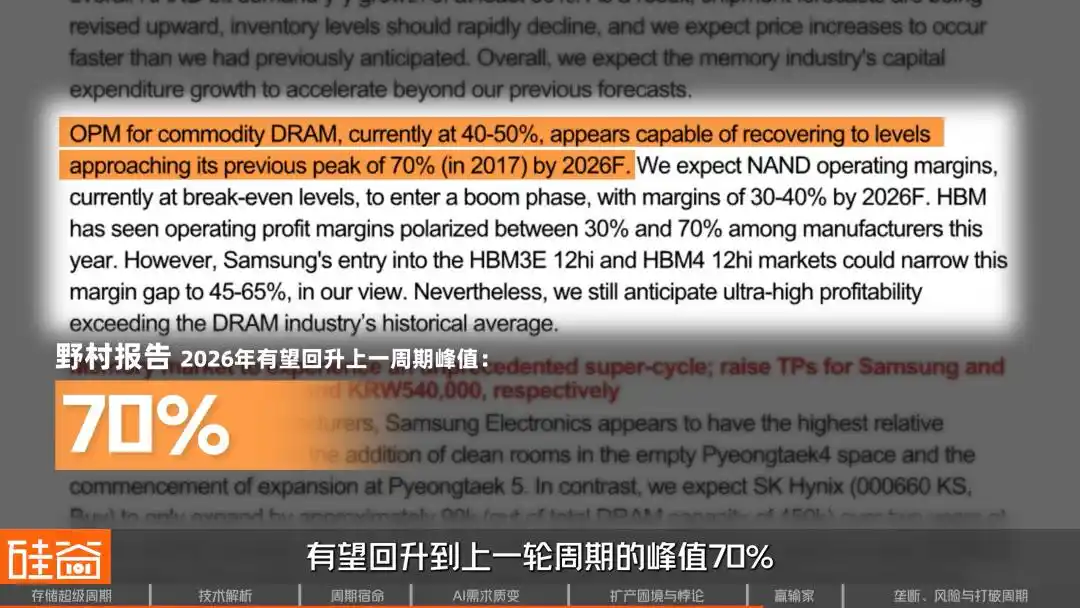

En cuanto a los márgenes de beneficio de la industria, Nomura estima que para el ejercicio fiscal 2026, los márgenes brutos de los fabricantes de DRAM genéricos podrían recuperarse hasta el pico del ciclo anterior del 70%. Por su parte, J.P. Morgan es más optimista, afirmando que para 2027, el margen operativo podría superar el 80%, e incluso superar el pico del ciclo anterior.

Los perdedores en esta cadena de suministro son los fabricantes de hardware. Morgan Stanley calculó que por cada aumento del 10% en los precios de los chips de almacenamiento, la margen bruta de los OEM de hardware disminuye entre 45 y 150 puntos básicos.

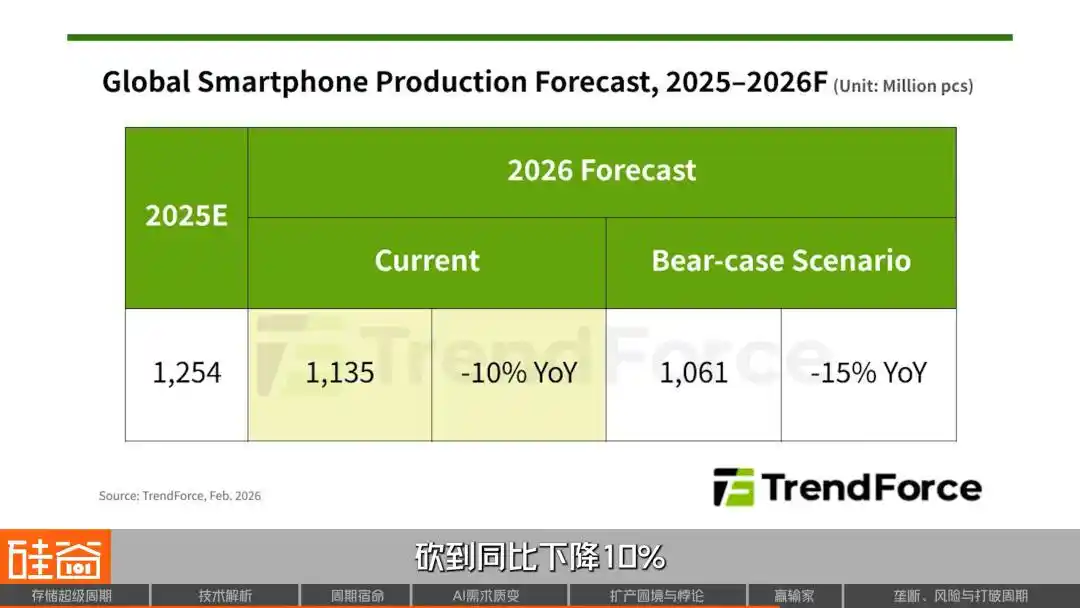

El mercado móvil fue el primero en sufrir; las previsiones de envíos de Xiaomi y OPPO se redujeron en más del 20%, y las de vivo en casi un 15%. TrendForce recortó directamente la predicción total de producción mundial de smartphones para 2026 hasta una caída del 10% interanual. Meizu anunció la cancelación del lanzamiento del Meizu 22 Air debido a que no puede soportar los costos. El CEO de Nothing, Pei Yu, comentó en redes sociales: "Las pequeñas empresas deben buscar otras vías".

El mercado de PC también es brutal: Lenovo aumentó los precios de algunos modelos en 500 a 1500 yuanes, y Dell y HP ya han anunciado claramente aumentos de precios, cuyo aumento se debe principalmente al traslado de los costos de almacenamiento. El COO de Dell, Clark, afirmó directamente: "Nunca he visto un aumento de costos tan rápido", y el CEO de HP incluso considera "reducir la cantidad de memoria utilizada en los productos".

La industria automotriz tampoco se ha salvado; el vicepresidente de la cadena de suministro de Li Auto advirtió públicamente que la tasa de cumplimiento del almacenamiento automotriz en 2026 podría ser inferior al 50%. Li Bin de NIO dijo: "La mayor presión de costos este año es la memoria". Lei Jun admitió en directo: "Solo la memoria para automóviles aumentará los costos en miles de yuanes".

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Ahora, fabricantes como PC y teléfonos móviles, incluso si tienen nombres muy reconocidos, no tienen mucho poder de fijación de precios, ya que ya no son tan demandados, porque para nosotros, sus márgenes son más bajos que los de los proveedores de nube. Por ejemplo, recientemente escuchamos que un fabricante automotriz nacional podría eliminar el sistema de entretenimiento en los asientos traseros debido a la escasez de memoria.

Rob Li

Socio gerente de Amont Partners en Nueva York

El teléfono y la PC seguramente caerán al menos un 5% este año, posiblemente más, pero a nadie le importará este asunto. Porque esos tres (los gigantes), especialmente Micron, dicen que ahora no harán esto, y que el mercado pueda volverse 0 no les importa.

En el otro extremo de la demanda, los proveedores de nube (Microsoft, Google, Amazon AWS) muestran una sorprendente insensibilidad a los precios.

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Ahora, los proveedores de nube tienen un costo marginal de 0 para su software. Su dinero y su narrativa están vinculados al precio de sus acciones, por lo que son extremadamente insensibles al precio, es decir, no les importa mucho cuánto cuesta la memoria.

Para los proveedores de nube, incluso si los mercados de teléfonos y PCs se redujeran a cero, los fabricantes de almacenamiento no se preocupan, porque las perspectivas de los centros de datos de IA son demasiado atractivas. Entonces, la pregunta final es: ¿cuánto tiempo más podrá durar este superciclo? ¿Esta vez es realmente diferente?

08 2026: ¿Qué viene a continuación?

Actualmente, el panorama competitivo de la cadena de suministro de almacenamiento sigue siendo estable. Actualmente, el HBM tiene una estructura aproximada de "6:2:2", con SK Hynix liderando el mercado, mientras que Samsung y Micron mantienen sus respectivas cuotas. Por supuesto, algunos inversores consideran que, en este mercado vendedor donde la oferta es mucho menor que la demanda, discutir quién tiene mayor cuota de mercado no tiene mucho sentido.

Rob Li

Socio gerente de Amont Partners en Nueva York

Como las tres grandes empresas tienen su producción limitada, quién capture más cuota de mercado dependerá únicamente de quién pueda aumentar su capacidad de producción; quien logre expandirla podrá vender más, y quien tenga mayor oferta podrá absorber cuota de mercado. Sin embargo, esto tiene poco que ver con quién tenga mejor tecnología, ya que actualmente se trata de un mercado donde la oferta es mucho menor que la demanda. Por lo tanto, en este momento discutir cuotas de mercado, por ejemplo, que SK Hynix tenga la mitad, mayor que las otras dos, no tiene ningún sentido, ya que las tres no pueden aumentar su capacidad.

La realidad es que los tres grandes fabricantes de almacenamiento ya han agotado su producción; quien pueda liberar un poco más de capacidad, se llevará un poco más de beneficios. Sin embargo, lo interesante es que los grandes fabricantes de almacenamiento podrían no buscar la "monopolización".

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

Creo que ningún jugador de almacenamiento desea monopolizar; Samsung teme el monopolio, y nuestros clientes tampoco desean que nosotros lo hagamos. Una vez que existe una escasez, como ahora, cuando los clientes otorgan al 100% de la cuota de mercado a cualquier proveedor de memoria, esto representa una gran presión para los jugadores de almacenamiento. Por lo tanto, romper el monopolio es precisamente lo que los jugadores de almacenamiento preferimos ver.

Generalmente, la gente asocia el monopolio con una prima elevada, pero en una industria como el almacenamiento, con fluctuaciones cíclicas extremas, un 100% de cuota de mercado significa un 100% de riesgo de demanda: si un cliente cancela un pedido, el proveedor queda en una posición muy vulnerable. Por eso, los fabricantes de almacenamiento prefieren mantener un equilibrio de competencia entre tres actores.

Then, how long will this cycle last?

Candice Hu

Gerente de marketing de productos de almacenamiento de Samsung

En 2026 se venderá al 100%, y la diferencia entre la oferta y la demanda alcanzará un 30%, incluso un 50%. En 2027 seguirá habiendo escasez, y es posible que no haya una verdadera mejora hasta 2028, por lo que se trata de una situación de escasez para los próximos dos a tres años.

Al mismo tiempo, la demanda no muestra señales de desaceleración. A continuación, el auge de la inferencia de IA y los agentes, seguido de la demanda de robots y IA física, también provocará un salto exponencial en la capacidad y el rendimiento de almacenamiento.

SemiAnalysis considera que en 2026, la oferta total de DRAM seguirá siendo aproximadamente un 7% inferior a la demanda. En el segmento de HBM, la brecha entre oferta y demanda seguirá ampliándose hasta 2027. En cuanto a la nueva oferta, la capacidad realmente significativa probablemente no comenzará a aparecer hasta el segundo semestre de 2027. Si se sigue el criterio de Nomura Securities, el aumento real en la producción incluso no se materializará hasta 2028.

Pero lo que merece más atención es una pregunta más grande: ¿esta industria dejará de tener ciclos para siempre? Desde la perspectiva de Wall Street, Rob ofreció en la entrevista un enfoque de reflexión muy profundo:

Rob Li

Socio gerente de Amont Partners en Nueva York

Este ciclo podría durar un período muy largo, o incluso transformar una industria cíclica en una industria de crecimiento estructural, dejando de ser cíclica. Si actualmente la industria experimenta un gran cambio y pasa de ser cíclica a convertirse en una industria no cíclica, con un crecimiento estructural estable, entonces el mercado podría experimentar un cambio cualitativo en su percepción de esta industria.

En industrias cíclicas, incluso un múltiplo de beneficios de 10 veces se considera alto, pero si se convierten en industrias de crecimiento estructural y mantienen esa tendencia durante muchos años, sus múltiplos de beneficios podrían duplicarse.

¿Entonces, en qué posición nos encontramos en este superciclo actual?

En esta gráfica, el eje horizontal representa una línea de tiempo con los últimos cinco ciclos, donde el mínimo de cada ciclo se establece en cero, y el eje vertical muestra el porcentaje de aumento del mercado. Se puede observar que cada ciclo atraviesa cuatro fases: pesimismo, escepticismo, optimismo y euforia, antes de volver al pesimismo. En el presente ciclo representado por la línea roja, ya hemos ingresado a la fase de "optimismo", y el aumento ha sido significativamente mayor que en cualquier ciclo anterior.

Esto corresponde a lo que Rob acaba de decir: ¿y si la IA realmente rompe este ciclo? Esto significaría que, incluso sin crecimiento de ganancias, simplemente reevaluar la valoración de una acción cíclica a una de crecimiento podría duplicar su precio. Así como nadie diría que Apple ha estado en una industria cíclica durante los últimos 20 años por vender teléfonos. Si el almacenamiento pudiera llegar a este punto, sería una transformación paradigmática en todo el marco de inversión en semiconductores.

Sin embargo, la demanda del sector de almacenamiento también presenta incertidumbre; las variables en el lado de la demanda no solo provienen del nivel macroeconómico, sino que la tecnología misma también puede reescribir la relación entre oferta y demanda.

Por ejemplo, a finales de marzo, Google lanzó un nuevo algoritmo llamado TurboQuant, que se promocionó como un algoritmo eficiente de compresión de memoria basado en IA. Tras su lanzamiento, causó un gran revuelo en el círculo tecnológico de Silicon Valley y desencadenó una caída generalizada en el sector de almacenamiento.

Pero pronto, voces dentro de la industria refutaron que este colapso fue un error. En primer lugar, este artículo se publicó hace un año y en sí mismo presenta ciertas controversias académicas. Además, este algoritmo solo se ha validado hasta ahora en modelos pequeños como Gemma y Mistral, y no se ha probado en modelos superiores a 70B, arquitecturas MoE ni contextos de millones de tokens, que son los escenarios donde realmente se dispara la demanda de memoria de IA. También expertos técnicos señalaron que, técnicamente, TurboQuant solo comprime la caché KV en la memoria GPU durante la inferencia, que es una de las tres fuentes principales de demanda de memoria de IA, pero no afecta en absoluto el proceso de entrenamiento.

En cualquier caso, este artículo y algoritmo han sido ampliamente criticados. Pero esto es interesante: ¿no demuestra precisamente este antiguo artículo controvertido que el mercado de capitales puede sufrir una caída tan brusca? ¿No sugiere esto que la confianza en el sector de almacenamiento ha alcanzado un nivel extremadamente frágil? Hay que recordar que, antes de este desplome, SanDisk había aumentado un 200% desde 2026, y Micron había subido más del 80%.

Algunos fondos vendedores a corto señalaron directamente que SanDisk, con una capitalización de mercado de 92 mil millones de dólares y una ganancia neta esperada de solo 6 mil millones de dólares para 2026, tiene una valoración difícil de justificar. Micron también enfrenta cuestionamientos: a pesar de registrar su mejor desempeño histórico, sus gastos de capital de 20 mil millones de dólares para el año fiscal 2026 representan un aumento del 68% interanual, lo que equivale a una apuesta audaz por el crecimiento continuo de la demanda de memoria.

En última instancia, el artículo de TurboQuant fue solo una chispa; el verdadero barril de pólvora fueron las valoraciones extremas acumuladas durante los últimos dos años, y cualquier señal de que la demanda podría no ser tan alta fue suficiente para desencadenar una fuga masiva.

Estos avances a nivel de algoritmo son precisamente los riesgos más difíciles de precificar anticipadamente en la narrativa del "super ciclo", y Rob también ofreció con claridad una advertencia final sobre el riesgo.

Rob Li

Socio gerente de Amont Partners en Nueva York

Las preocupaciones sobre la industria del almacenamiento persistirán hasta que finalmente se demuestre que este negocio se convierte en una operación estable y de crecimiento constante, tipo "Apple". La primera preocupación es que la IA colapse, lo que provocaría la caída de todos, ya que actualmente el principal crecimiento proviene de la IA. Si algún día la IA deja de funcionar y la gente se da cuenta de que no tiene utilidad, entonces todo lo que se ha dicho sobre el futuro se convertirá en pura fantasía y se reducirá a cero.

Por lo tanto, las predicciones optimistas actuales sobre el "super ciclo" se basan en una premisa: la demanda de IA es real y sostenible. Si algún día se produce una burbuja en la IA, la industria del almacenamiento no podrá escapar impune. Esta espada de Damocles seguirá colgando hasta que la industria demuestre realmente que se ha convertido en un negocio de crecimiento estable a la manera de Apple.

SemiAnalysis define este ciclo como una "escasez que ocurre una vez cada cuarenta años". Sin embargo, la dirección más valiosa podría ser: la industria de chips de almacenamiento se encuentra en una encrucijada, donde bien podría caer, como ha hecho durante las últimas cuatro décadas, en otro ciclo de declive tras los picos de precios; o bien, impulsada por la demanda estructural de la IA, romper realmente su destino cíclico y convertirse en una industria de crecimiento continuo.

Al menos hasta 2026, la respuesta parece inclinarse hacia el último caso. La capacidad de los tres principales fabricantes de almacenamiento se ha agotado por completo, los pedidos a los proveedores de equipos de la cadena de suministro se extienden hasta 2027, los clientes comenzaron a pagar adelantos y firmar contratos a largo plazo con validez legal, e incluso una empresa japonesa fabricante de inodoros ha cambiado su destino por ello.

Pero la historia nunca ha faltado en burlarse de "esta vez es diferente". Lo único cierto es que, independientemente de si esta vez se rompe o no el ciclo, ya ha reconfigurado irrevocablemente el mapa de poder de la industria tecnológica global. En este juego de supervivencia por los chips de almacenamiento, quien controle la oferta, controlará la voz en la era de la IA.