El 27 de marzo, se celebró con gran éxito en Cyberport de Hong Kong el primer Foro de Innovación y Seguridad en Agentic AI y la primera Cumbre Internacional Web 4.0 de Hong Kong, organizado conjuntamente por Cyberport de Hong Kong, ME Group e iPollo. Bajo el tema “Aplicaciones innovadoras de Agentic AI: Transformación tecnológica e integración industrial en la era Web 4.0”, la cumbre reunió a destacadas figuras del sector público, académico y empresarial, incluyendo al Secretario de Finanzas del Gobierno de la Región Administrativa Especial de Hong Kong, Chan Man-po; el presidente de Cyberport de Hong Kong, Chan Sai-ming; el director de Cyberport de Hong Kong y fundador de Nano Labs, Kong Jianping; y el famoso inversionista ángel Cai Wensheng, para explorar conjuntamente las oportunidades y desafíos en la nueva era en la que la IA avanza desde la “conversación” hacia la “acción”.

En el contexto actual, donde la inteligencia artificial agente (Agentic AI) llama mucho la atención, los temas de seguridad que plantea son especialmente cruciales. Yu Xian, fundador de SlowMist, fue invitado a participar en esta cumbre y pronunció una conferencia titulada “Desafíos y innovaciones en la defensa de la seguridad en la IA y el mundo cripto”, compartiendo con líderes industriales globales las últimas observaciones y prácticas de SlowMist en el ámbito de la seguridad de la IA.

Enfócate en lo前沿: Análisis profundo de las amenazas de seguridad de OpenClaw y AI Agent

A medida que la tecnología de IA continúa penetrando el mundo cripto, las aplicaciones de AI Agent, como OpenClaw ("养龙虾"), han ganado popularidad rápidamente. Pero detrás de esta ola de entusiasmo, surge una pregunta más profunda: aún no se ha establecido verdaderamente el límite de seguridad de los AI Agent.

En su discurso, Yu Sheng desglosó en profundidad OpenClaw y planteó un juicio clave: “El texto es una instrucción”. Explicó que, en el contexto de funcionamiento de un AI Agent, todas las entradas ya no son simplemente “información”, sino instrucciones potencialmente ejecutables. Esto significa que cualquier información externa recibida por el modelo —ya sea proveniente de la entrada del usuario, documentación o Skill de terceros— puede ser interpretada y ejecutada directamente, ampliando así la superficie de ataque desde el nivel de código hasta el “nivel cognitivo”. Bajo este mecanismo, las rutas de ataque se simplifican enormemente. Los atacantes no necesitan superar las defensas de seguridad tradicionales; con solo crear contenido de texto cuidadosamente diseñado, pueden inducir al Agent a realizar operaciones no previstas, como transferencias de activos, filtración de información sensible o incluso ejecución remota de comandos. La naturaleza oculta y el bajo costo de esta ruta de ataque la convierten en una amenaza real y significativa.

Bajo este mecanismo, las rutas de ataque se simplifican enormemente. Los atacantes no necesitan superar las defensas de seguridad tradicionales; con solo crear contenido de texto cuidadosamente diseñado, pueden inducir al Agent a realizar operaciones no previstas, como transferencias de activos, filtración de información sensible o incluso ejecución remota de comandos. La naturaleza oculta y el bajo costo de esta ruta de ataque la convierten en una amenaza real y significativa.

Sobre la base del mecanismo anterior, Cosine resume tres categorías de riesgos clave que enfrenta actualmente OpenClaw:

- Entrada e manipulación de intención (capa de interacción con el usuario): Los atacantes pueden engañar al agente para que realice operaciones de alto riesgo mediante “inyección directa de indicaciones”. Es especialmente preocupante la contaminación indirecta de la cadena de suministro: los atacantes insertan instrucciones maliciosas en los documentos Markdown de la Skill. Dado que Markdown a menudo desempeña el papel de “punto de instalación”, el texto original de “instrucciones” puede convertirse fácilmente en un script de ejecución malicioso (por ejemplo, curl | bash), lo que lleva a la robo de datos.

- Riesgo de la capa de decisión y orquestación (capa de lógica de aplicación): Este error no proviene del modelo en sí, sino de una “lógica de ejecución incorrecta”. Los atacantes pueden interferir en el razonamiento lógico del Agente para alterar direcciones de recepción en procesos de negocio como transferencias de criptomonedas, causando pérdidas financieras directas.

- Riesgo de la capa del modelo (cerebro central): incluye las “alucinaciones” generadas por el modelo que provocan la ejecución de comandos del sistema que no existen o son peligrosos, así como los patrones de operaciones inseguras aprendidos incorrectamente a partir de los datos de entrenamiento.

Yuxian señaló: "Los problemas expuestos por OpenClaw no son un fenómeno aislado, sino un desafío estructural que enfrenta el ecosistema actual de AI Agent". En otras palabras, los problemas de seguridad ya no son un "caso aislado" de un solo proyecto, sino un riesgo sistémico que toda la industria debe afrontar.

Ataque y defensa: Construir un ecosistema abierto y seguro para agentes de IA

Ante la evolución constante de las formas de amenaza, Yu Xian propuso en su discurso el enfoque de seguridad "ofensivo y defensivo" de SlowMist: no solo comprender las rutas de ataque, sino también integrar la capacidad de defensa en los mecanismos de funcionamiento de los Agentes, logrando seguridad incorporada.

Mostró a los invitados una serie de herramientas y soluciones de código abierto construidas por SlowMist alrededor de AI Agent, con el objetivo de impulsar la formación de un ecosistema de seguridad transparente, verificable y reutilizable:

- Guía de prácticas de seguridad minimalistas de OpenClaw: Un manual integral de implementación de seguridad, desde el nivel cognitivo hasta el nivel de infraestructura, que proporciona un “sello de seguridad sistemático” para la implementación de Agentes de IA con altos privilegios en entornos productivos reales.

- SlowMist Agent Security Skill: Un marco integral de revisión de seguridad que añade una “mirada inteligente” a agentes como OpenClaw. No solo puede detectar riesgos de envenenamiento en Skills comunes, sino también identificar riesgos en direcciones de billeteras en la cadena, repositorios de código y URLs.

- MistTrack Skills: Un paquete de habilidades plug-and-play para Agentes de IA que proporciona capacidades profesionales de cumplimiento AML y análisis de riesgo de direcciones en criptomonedas, útil para la evaluación de riesgos de direcciones en la cadena y la evaluación de riesgos antes de las transacciones.

- MCP Security Checklist: Una lista de verificación de seguridad estructurada para auditar y fortalecer rápidamente los servicios de Agent, ayudando al equipo a evitar omisiones de puntos clave de defensa al implementar MCPs/Skills y cadenas de herramientas de IA relacionadas.

- Demo de MCP malicioso: Un ejemplo de servidor MCP malicioso de código abierto para reproducir escenarios de ataque reales y probar la robustez de los sistemas de defensa, útil para investigación de seguridad y validación de defensas.

A través de esta serie de prácticas, Yu Cheng enfatiza: "Las capacidades de seguridad deben estar integradas en el Agente, no depender únicamente de la protección periférica." Solo al vincular profundamente los mecanismos de defensa con la lógica de funcionamiento del Agente, el Agente de IA podrá operar de forma continua y segura en el complejo ecosistema Web3 e IA.

Seguridad sistematizada: ADSS ofrece protección integral para el ecosistema AI + Web3

Al final de la charla, Yu Sheng presentó la ADSS (AI Development Security Solution) propuesta por SlowMist.

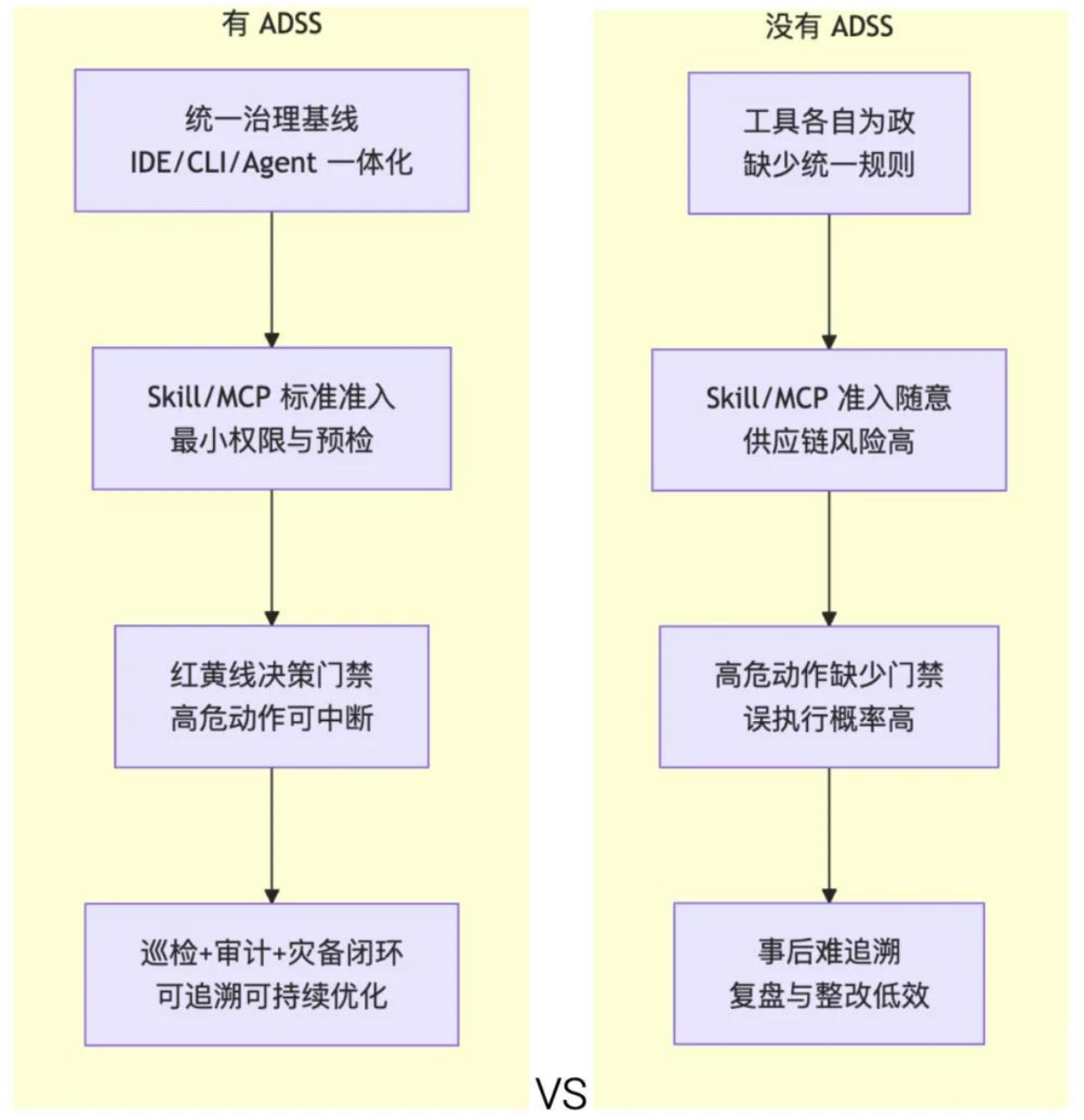

Si las herramientas mencionadas anteriormente pertenecen a la "capacidad táctica", entonces ADSS es más bien un marco de seguridad a nivel de sistema. Su idea central es: elevar las acciones de seguridad dispersas a un mecanismo de operación de seguridad sistematizado, ejecutable, auditables y sostenible.

ADSS construye capacidades de gobernanza segura de AI + Web3 desde múltiples niveles:

- Gobernanza de seguridad L1 (línea base de desarrollo): Establecer estándares unificados de desarrollo y uso seguro, cubriendo herramientas de desarrollo, marcos de Agent, ecosistema de plugins y entornos de ejecución, para proporcionar a los equipos una fuente unificada de estrategias y estándares de auditoría.

- Permisos y restricciones de operación L2: al limitar el ámbito de permisos del agente, minimizar los permisos para llamar a herramientas e introducir mecanismos de confirmación humano-máquina para operaciones críticas, se controla eficazmente el alcance de las acciones de alto riesgo.

- Protección contra interacciones externas L3: Introducir percepción de amenazas en tiempo real a nivel de recursos externos como URLs, repositorios de dependencias y fuentes de plugins, reduciendo la probabilidad de que contenido malicioso o envenenamiento de cadena de suministro ingrese a la cadena de ejecución.

- Aislamiento de activos en la cadena L4: Para operaciones que involucran transacciones en la cadena, combina análisis de riesgos en la cadena y un mecanismo de firma independiente para permitir que el Agente construya transacciones sin acceder directamente a la clave privada, reduciendo el riesgo sistémico asociado con operaciones de activos de alto valor.

- L5 Inspección y revisión continuas: mediante auditoría de registros, revisiones de seguridad periódicas y mecanismos operativos, se logra una capacidad de seguridad cerrada que permite “verificar antes de la ejecución, restringir durante la ejecución y revisar después de la ejecución”.

Yuxian señaló que ADSS no es una sola herramienta, sino un sistema de operaciones de seguridad sostenible y evolutivo. Tiene como objetivo ayudar a los equipos a construir un sistema de seguridad para Agentes auditables y actualizables, mediante estrategias sistemáticas, auditorías continuas y联动 de capacidades, sin reducir significativamente la eficiencia de desarrollo ni la capacidad de automatización, para hacer frente a las amenazas de seguridad en constante evolución en el contexto de la profunda integración de IA y Web3.

Conclusión

El primer Foro de Innovación y Seguridad de Agentic AI reunió a los principales actores de la industria y ofreció perspectivas prospectivas sobre la seguridad de los AI Agentes. Con la profunda integración de Agentic AI y Web3, los desafíos de seguridad continuarán aumentando. Como empresa líder mundial en seguridad blockchain, SlowMist continuará impulsando la implementación de una gobernanza de seguridad sistematizada, mediante ADSS, herramientas de código abierto y prácticas, para construir capacidades de seguridad internas en los AI Agentes y apoyar el desarrollo sostenible y controlado de la industria en la ola de innovación.