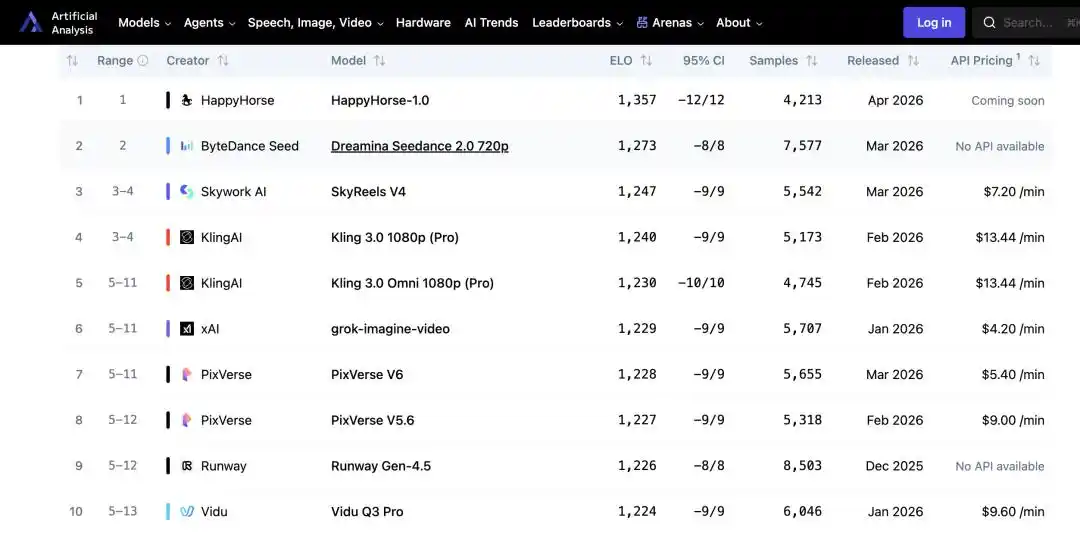

Sin lanzamiento, sin blog técnico, sin respaldo de ninguna empresa: un modelo de conversión de texto a video llamado HappyHorse-1.0 ha ascendido silenciosamente al primer lugar en la clasificación AI Video Arena de la plataforma de evaluación de IA Artificial Analysis, superando a Seedance 2.0 con una puntuación Elo más alta y dejando atrás a actores principales como Keling y Tiangong, desatando de inmediato una “competencia de desentrañamiento” en la comunidad técnica.

La clasificación de Artificial Analysis no es una evaluación de parámetros técnicos, sino un puntaje Elo derivado de resultados de pruebas ciegas realizadas por usuarios reales, que refleja la percepción real de personas comunes tras verlos. Esto hace que esta clasificación sea más difícil de cuestionar que las listas de puntuaciones típicas, y convierte la pregunta “¿Quién realmente hizo esto?” en un asunto imposible de ignorar.

"Happy Horse" asciende silenciosamente al primer lugar, desatando una competencia de adivinanzas en el mundo de la tecnología

Las especulaciones en X llegaron rápidamente. Lo primero en llamar la atención fue el orden de los idiomas en el sitio web: el mandarín y el cantonés aparecían antes que el inglés. Para un producto dirigido a usuarios globales, este orden es inusual: si el equipo principal fuera estadounidense, el inglés casi seguramente estaría en primer lugar. Se puede confirmar básicamente que el equipo detrás proviene de China.

El nombre en sí también es una pista. El año 2026 es el Año del Caballo en el calendario lunar, y el nombre "HappyHorse" esconde un juego de palabras poco sutil sobre el Año del Caballo; anteriormente este año, "Pony Alpha" ya utilizó una estrategia similar. Por lo tanto, la lista de sospechosos se alargó rápidamente: los fundadores de Tencent y Alibaba también tienen el apellido "Ma", lo que los incluye naturalmente; algunos apuestan por Xiaomi, creyendo que Lei Jun es habitualmente reservado y le gusta sorprender con revelaciones inesperadas; otros piensan que tiene más el estilo de DeepSeek, ya que DS anteriormente había lanzado discretamente un modelo visual y luego lo retiró silenciosamente. Las especulaciones están muy animadas, pero ninguna ha presentado pruebas concluyentes.

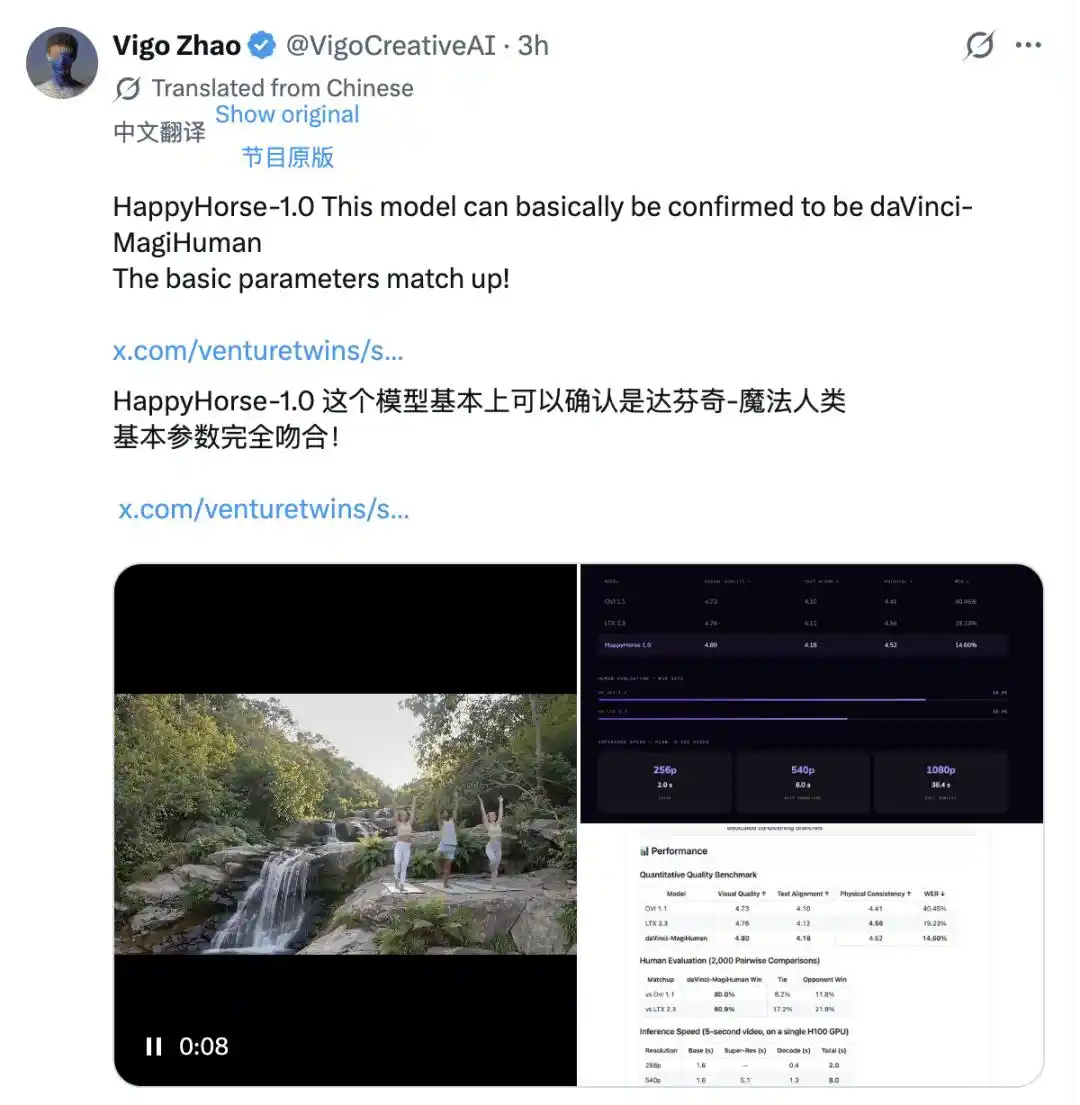

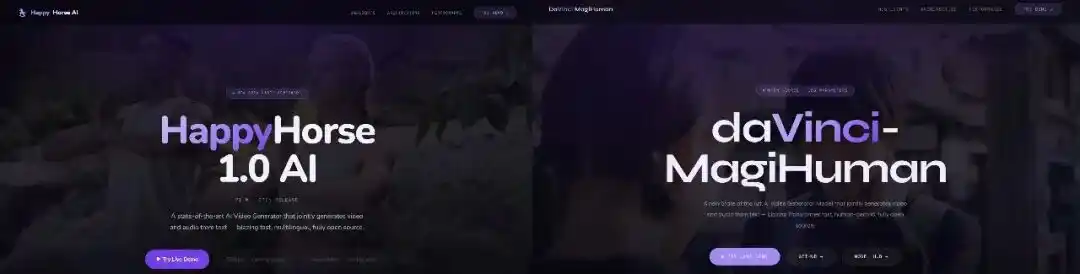

Lo que realmente identificó el objetivo fue una comparación técnica punto por punto. El usuario de X, Vigo Zhao, comparó los datos de referencia públicos de HappyHorse-1.0 con modelos conocidos uno por uno y encontró un objeto con alta coincidencia: daVinci-MagiHuman, el modelo de código abierto "DaVinci Magic Human" lanzado en GitHub en marzo.

Calidad visual 4.80, alineación de texto 4.18, coherencia física 4.52, tasa de errores de voz y subtítulos 14.60%: ambos conjuntos de datos coinciden punto por punto. La estructura del sitio web también es casi idéntica: el estilo de presentación de la descripción arquitectónica, la tabla de rendimiento y el video de demostración parece provenir de la misma plantilla. Ambos utilizan la misma arquitectura Transformer de flujo único, generan audio y video conjuntamente y admiten la misma lista de idiomas. Este nivel de coincidencia es difícil de explicar como una casualidad.

La conclusión más reconocida en el círculo técnico actual es que HappyHorse es una versión iterativa optimizada por Sand.ai, uno de los socios de desarrollo conjuntos de daVinci-MagiHuman, con el objetivo principal de validar el límite de rendimiento del modelo bajo las preferencias reales de los usuarios, sentando las bases para su posterior implementación comercial.

daVinci-MagiHuman se lanzará como código abierto el 23 de marzo de 2026, y es el resultado de la colaboración de dos equipos jóvenes. Uno proviene del Laboratorio de Investigación de Inteligencia Artificial Generativa (GAIR) de la Academia de Innovación Creativa de Shanghái (SII), liderado por el académico Liu Pengfei; el otro es Sand.ai (San Dai Technology) de Beijing, fundada por Cao Yue, quien también tiene antecedentes académicos y cuya dirección es la modelación del mundo autoregresivo.

El modelo utiliza un Transformer de flujo único puramente basado en atención propia con 15 mil millones de parámetros, que incorpora todos los tokens de texto, video y audio en una misma secuencia para modelado conjunto: nadie en la comunidad de código abierto había realizado previamente un preentrenamiento conjunto de audio y video desde cero; la mayoría solo combina modelos de un solo módulo.

¿Cómo logró un modelo de video de código abierto una recuperación en dos semanas?

Una vez aclarada la identidad, otra pregunta resulta aún más difícil de responder: ¿cómo es posible que HappyHorse-1.0 haya obtenido en solo dos semanas una puntuación Elo superior a la de Seedance 2.0, si daVinci-MagiHuman solo se abrió al público a finales de marzo?

Según la información revelada en el sitio web oficial, HappyHorse no ha modificado la arquitectura subyacente; la suposición más razonable es que ajustó específicamente la estrategia de generación predeterminada para escenarios de evaluación.

El sistema Elo es esencialmente una acumulación de preferencias de los usuarios; en aspectos perceptivos sensibles como la estabilidad de las expresiones faciales, la sincronización entre audio y video, y si la imagen es agradable a la vista, mejorar ligeramente en estos puntos aumenta la probabilidad de ser seleccionado en pruebas ciegas. La capacidad máxima del modelo no cambia, pero el "rendimiento en evaluación" puede ser pulido.

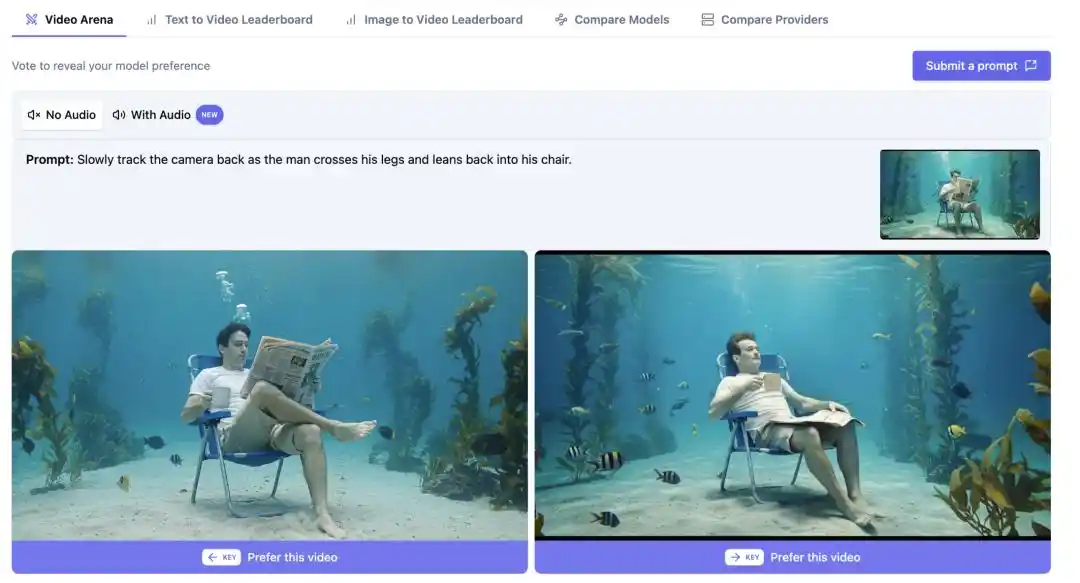

De hecho, en las muestras de prueba ciega de Artificial Analysis, los contenidos generados de retratos y narraciones orales representan más del 60%, y daVinci-MagiHuman se enfocó desde la fase de entrenamiento en la interpretación de retratos, lo que le confiere una ventaja natural en este tipo de escenarios; esta es la razón principal por la que su tasa de victoria en pruebas ciegas es superior. Si las muestras de prueba ciega se centran principalmente en primeros planos de rostros, los modelos especializados en retratos obtendrán una ventaja sistemática, lo cual no tiene relación directa con su desempeño real en escenarios complejos como múltiples personajes, movimientos de cámara complejos o narrativas de larga duración.

Como resultado, hubo una clara discrepancia entre los números del ranking y la experiencia práctica, y los discutientes en X se dividieron en dos bandos. Los escépticos, tras realizar las pruebas, consideraron que HappyHorse-1.0 y Seedance 2.0 aún presentan diferencias visibles en los detalles de los personajes y la coherencia dinámica, y por ello cuestionan la representatividad de la puntuación Elo.

Los partidarios tienen grandes expectativas sobre el potencial de HappyHorse, esperando que resuelva el problema del sector de la consistencia de calidad visual en secuencias de múltiples tomas, ya que este es un problema que los modelos de video principales aún no han resuelto bien; si daVinci-MagiHuman logra realmente avanzar en este aspecto, podría ser más importante que un ranking en una lista.

Las limitaciones del modelo tampoco deben ocultarse detrás de los números. El influencer de Xiaohongshu @JACK's AI Vision implementó y probó de inmediato daVinci-MagiHuman, descubriendo que requiere una H100; las tarjetas gráficas de consumo común prácticamente no son viables. Aunque la comunidad está investigando soluciones de cuantización, para los usuarios individuales resulta aún difícil desplegarlo localmente en el corto plazo.

En términos de escenario, actualmente se destaca principalmente en imágenes de una sola persona; cuando aparecen múltiples personas o el escenario se vuelve más complejo, la calidad disminuye: este no es un problema que se pueda resolver con ajustes, ya que está directamente relacionado con su diseño orientado hacia retratos. La duración de generación suele ser de unos 10 segundos; si es más larga, tiende a volverse desordenada, y la salida en alta definición aún requiere complementos de superresolución para mejorarla.

La conclusión de la visión de IA de @JACK es que daVinci-MagiHuman tiene una usabilidad integral inferior a LTX 2.3 y que es necesario esperar a que la comunidad optimice la cuantificación antes de que sea adecuado para uso diario.

¿Llegó el verdadero “bagre” para el sector de generación de videos?

Por supuesto, liderar una lista una sola vez no dice mucho. A continuación, HappyHorse debe someterse a una evaluación más exhaustiva en términos de estabilidad, velocidad de acceso de alta concurrencia, consistencia entre escenarios, precisión en el control de roles y capacidad de generalización más allá de los conjuntos de evaluación. Estos son los indicadores clave que determinan si un modelo puede integrarse realmente en el flujo de trabajo de los creadores.

Pero si se amplía la perspectiva al panorama general de la industria, la señal que transmite este evento es ya lo suficientemente clara.

Los modelos de video de código abierto no son nada nuevo. Pero siempre ha existido una brecha visible en términos de calidad entre los modelos de código abierto y los cerrados: en escenarios donde se requiere entregar resultados a clientes, la calidad de generación de los modelos de código abierto no ha logrado superar durante mucho tiempo la barrera entre “utilizable” y “entregable”. El poder de fijación de precios de productos cerrados como Keling y Seedance se basa en gran medida en esta brecha.

La importancia de esta ocasión radica en que un producto basado en un modelo de código abierto ha igualado por primera vez, en una clasificación de pruebas ciegas basadas en la percepción real de los usuarios, a sus principales competidores cerrados actuales. Sin importar cuánta optimización haya habido para el escenario de evaluación, para los fabricantes cerrados que construyen su poder de fijación de precios sobre esta brecha, al menos se trata de una señal que merece ser tomada en serio.

Para los desarrolladores, este punto de inflexión tiene un significado más concreto. En escenarios verticales como retratos, avatares digitales y streamers virtuales, una vez que la calidad de generación de los modelos base de código abierto alcance el umbral de “entregable”, la estructura de costos de despliegue autónomo experimentará un cambio sustancial: no solo se reducirán los costos de llamadas a API, sino que, lo más importante, se podrá integrar completamente el control sobre los datos, los modelos y la cadena de inferencia, obteniendo una flexibilidad en personalización profunda y cumplimiento de privacidad que las soluciones cerradas no pueden ofrecer.

HappyHorse-1.0 no desafiará temporalmente la posición de mercado de Seedance 2.0 o Ke Ling, pero una vez establecida la percepción de que los modelos abiertos pueden igualar a los cerrados, la optimización cuantitativa, el ajuste fino vertical y la aceleración de inferencia serán impulsadas continuamente por la comunidad a una velocidad mucho mayor que la de los productos cerrados.

En este Año del Caballo, lo que realmente merece atención tal vez no sea qué caballo corre más rápido, sino que la pista misma se está ampliando.

Este artículo proviene del número de WeChat "AI Value Officer", autor: Xingye, editor: Meiqi