Estos treinta días locos, once modelos grandes, como un espectáculo de fuegos artificiales ruidoso.

Autor del artículo, fuente: 0x9999in1, ME News

TL;DR

- Treinta días de competencia extrema: del 26 de marzo al 24 de abril, se lanzaron 11 modelos de inteligencia artificial destacados a nivel mundial, uno cada 2.7 días promedio. El mercado enfrenta una grave “fatiga de parámetros”.

- La "cirugía de pérdida de peso" del parámetro gigante: el parámetro total de V4-Pro alcanza 1.6T, pero solo se activan 49B. A través de la reestructuración de la arquitectura CSA+HCA, los FLOPs se reducen al 27% con un contexto de 1M y la caché KV se reduce a un asombroso 10%.

- La separación de la brecha generacional en la alquimia: introduce por primera vez el paradigma de postentrenamiento “reforzamiento independiente primero, luego fusión por destilación en línea”; V4-Pro-Max se acerca al límite de las soluciones cerradas en inferencia y tareas de Agentes.

- Votos con dinero real: GPT-5.5 solo impulsó a NVIDIA a un aumento del 4.2% en un día antes de alcanzar su punto máximo, mientras que V4, completamente abierto por el MIT, encendió por completo el continuo auge de la cadena de capacidad de cómputo local en China y Hong Kong.

- Lógica de juego profundo: los modelos cerrados venden "impuestos", los grandes modelos abiertos venden "hierro". La aparición de V4 finalmente equilibra el libro de cálculo de capacidad para implementaciones privadas empresariales a nivel mundial.

La locura de los dioses en abril, junto con la fatiga estética del mercado

Se volvieron locos. Todos se volvieron locos.

Si eres un observador atento al sector de la IA, los últimos treinta días probablemente te hayan causado malestar fisiológico. Entre el 26 de marzo y el 24 de abril de 2026, en menos de un mes, al menos once grandes modelos con influencia significativa se lanzaron al mercado.

La lista parece un menú: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

Además, en la madrugada del 23 de abril, DeepSeek V4 se lanzó silenciosamente como una bomba de profundidad.

En promedio, surge un nuevo modelo cada 2.7 días. Es una velocidad a la que incluso los gestores de fondos no logran leer los comunicados. Los inversores apenas han escuchado el “superior en parámetros” de la empresa A, cuando ya les llega el “dominio en puntuación” de la empresa B. El mercado ya está麻木. Lo que se llama “posicionamiento en Benchmark” se está volviendo, en este contexto de intensa competencia, cada vez más como un juego numérico de autoentretenimiento.

Pero el dinero es inteligente. O, dicho de otro modo, las velas japonesas nunca mienten.

Al revisar las velas de los activos de IA de EE.UU., China y Hong Kong de los últimos 30 días, descubrirás una realidad extremadamente fría: en esta "guerra de dioses", solo dos nodos han dejado una huella sostenible en el gráfico.

Primero, el 8 de abril, OpenAI al otro lado del océano lanzó GPT-5.5. Este rey indiscutible impulsó directamente un aumento del 4.2% en un solo día para NVIDIA. ¿Y luego? No hay nada más, alcanzó su pico en un día y el beneficio se agotó. Todos descubrieron que incluso el más grande de los reyes cerrados tiene dificultades para mover la pesada montaña del capital global como lo hacía hace dos años.

El segundo nodo es del 23 al 24 de abril. Se lanzó la versión preliminar de DeepSeek V4. Sin lanzamientos elaborados, sin videos promocionales impactantes. Los pesos se subieron directamente a Hugging Face y ModelScope, con licencia MIT.

Resultado? Impulsó a la cadena de poder de cálculo de China y Hong Kong a salir de una serie de saltos alcistas.

¿Por qué? ¿Por qué un modelo de código abierto logró lo que numerosos expertos de código cerrado no pudieron hacer?

Para responder a esta pregunta, debemos actuar como narradores, dejando de lado los comunicados de prensa aburridos y abriendo el capó del motor de DeepSeek V4 para ver qué criatura hay dentro.

Desglosando V4: Ya no hay fe en la estética de la fuerza bruta de los parámetros

Los modelos grandes. Muy costosos. Esto es de conocimiento general.

El año pasado, los fabricantes de modelos grandes cayeron en una especie de “fobia a la insuficiencia de potencia”. Tú haces un billón, yo hago dos billones. Todos creían que, con suficiente fuerza, la inteligencia emergente resolvería todos los problemas. Pero surgió un costo de cómputo extremadamente aterrador. Ni siquiera el excedente de grano del terrateniente era suficiente para quemar.

DeepSeek V4 presenta esta vez dos modelos MoE (Mixture of Experts): V4-Pro y V4-Flash. Primero, veamos algunos datos clave.

V4-Pro: parámetros totales de 1.6T (1.6 billones), pero solo 49B (49 mil millones) de parámetros activados por token.

V4-Flash: parámetros totales 284B (284 mil millones), parámetros activados solo 13B (13 mil millones).

¿Lo entendiste? Es una “palanca de cuatro onzas para mover mil libras” extremadamente contenida. La esencia de la arquitectura MoE es no activar siempre todas las alarmas. Para tareas sencillas, moviliza a algunos expertos especializados; para tareas complejas, saca la espada para matar dragones. La base de 1.6 billones garantiza que “ha visto el mundo y es muy conocedora”; los 490 mil millones activados aseguran que “reacciona rápidamente y es ágil”.

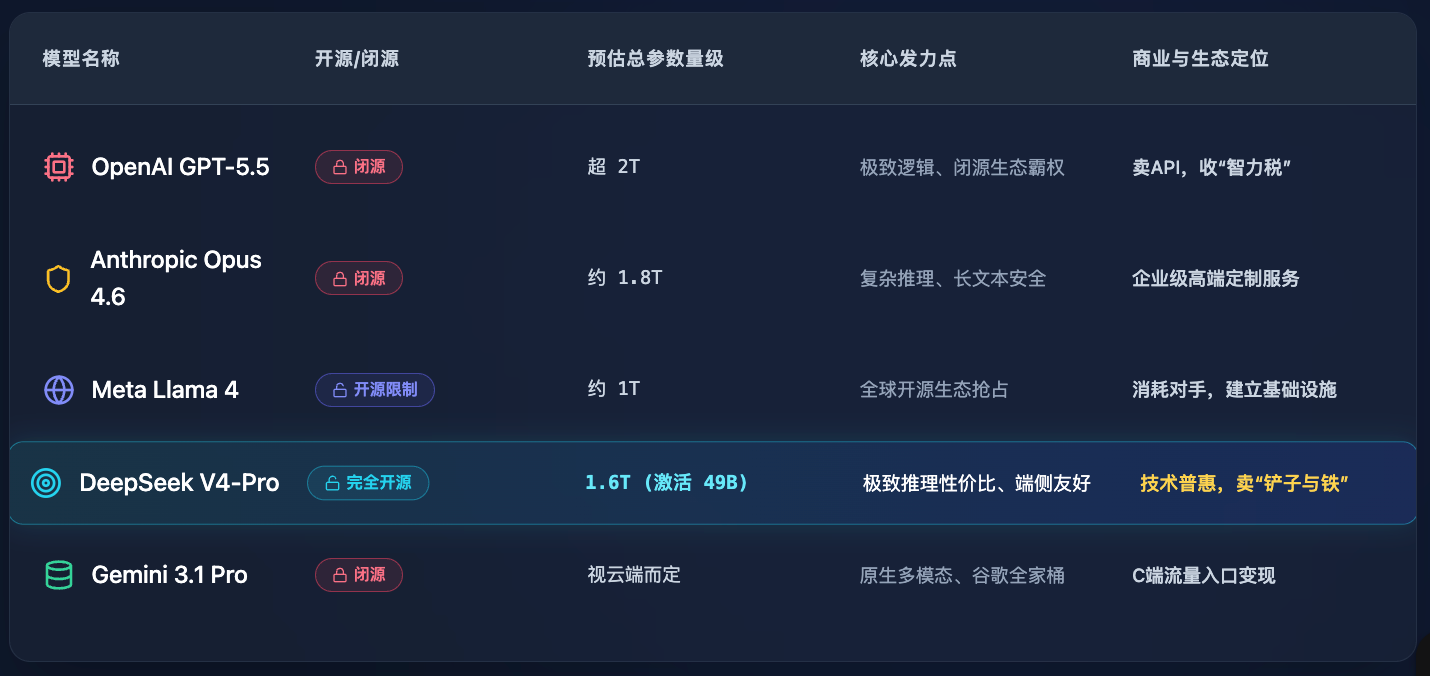

Para comprender más claramente esta brecha, creamos una tabla que compara las principales tendencias actuales del mercado (los datos son estimaciones y cálculos públicos del mercado):

Al observar la tabla, se puede ver que V4-Pro no busca en absoluto superar a GPT-5.5 en parámetros totales, sino que concentra todos sus esfuerzos en "cómo hacer que esta bestia consuma menos y corra más rápido".

Pero esto no es suficiente. Lo que realmente deja sin aliento a los expertos es su eliminación implacable de los "asesinos de VRAM".

El fin del memory assassin: tres cuchillos de raspado arquitectónicos

¿Qué es un asesino de memoria gráfica? Es “contexto largo (Long Context)”.

Ahora todos se jactan de que respaldan 1M (un millón) de tokens de contexto. Suena genial: puedes meter toda la novela "Romance de los Tres Reinos" y lo leerá en unos segundos. Pero ¿cuál es el costo? Durante la inferencia, los textos largos generan un caché KV enorme (el uso de memoria GPU para almacenar información histórica). Es como si, al leer cada página de un libro, tuvieras que copiar en una pizarra grande el contenido de la página anterior y tenerlo frente a ti. Cuando llegues al millón de palabras, tendrás tantas pizarras que ni siquiera cabrían en los centros de datos de Zhongguancun.

La memoria es más cara que el poder de cómputo. Esta es la regla no escrita de la industria de la IA.

¿Cómo resuelve DeepSeek V4 este problema? Realizaron una "cirugía" directa sobre el mecanismo de atención subyacente. Esta es la primera y más contundente herramienta de su actualización de arquitectura: el mecanismo de atención híbrido (CSA + HCA).

CSA (Sparse Attention) más HCA (Heavy Compression Attention) suena como lenguaje de marcianos; traducido al lenguaje común: ya no memoriza de memoria, sino que aprendió a "resaltar lo importante" y a "tomar notas minimalistas".

El efecto es extremadamente drástico: con un contexto de 1M, los FLOPs (operaciones de punto flotante) por token para la inferencia de V4-Pro son solo el 27% de los de la generación anterior V3.2. ¡Lo más aterrador es que la caché KV es solo el 10% de la de V3.2!

¿Qué significa esto? Anteriormente, se necesitaban 10 servidores de gama alta para completar una tarea de texto de un millón de caracteres; ahora, un solo servidor lo logra con facilidad. El costo de cómputo se redujo directamente a una décima parte. Esta es una optimización de nivel revolucionario.

Aún hay dos cuchillos.

La segunda herramienta se llama "Hiperconexión con restricción de manifold (mHC)". En los modelos anteriores, la transmisión de información entre capas utilizaba "conexiones residuales tradicionales", como usar viejos tubos de hierro oxidados para transportar agua: cuando la presión aumenta, tienden a filtrarse. Frente a los enormes datos de preentrenamiento de 32T tokens, estos tubos antiguos no resisten. mHC es como reemplazarlos con una red de fibra óptica, mejorando la estabilidad de la propagación de señales entre capas. Sin pérdida de paquetes, sin desviaciones.

Tercer corte: cambiar el aceite del motor. Abandona lo tradicional y usa el optimizador Muon. Esto acelera la convergencia. Mientras que otros necesitan cuarenta y nueve días para refinar un lote de píldoras, él podría tenerlo listo en veinte días. El tiempo es dinero, el tiempo de máquina es dólares.

These three cuts completely cured the large model's "affluenza."

El secreto del horno de alquimia: de la lucha individual a la unificación de todos los métodos

Todos en la industria saben que el preentrenamiento solo convierte a un "analfabeto" en un "idiota que sabe mucho pero no puede hablar". Lo que realmente lo convierte en un maestro absoluto es el postentrenamiento (Post-training).

DeepSeek V4, en el entrenamiento posterior, aplicó una estrategia extremadamente avanzada de "dos fases".

Antes, entrenar MoE era como un grupo de profesores enseñando a un solo estudiante, lo que fácilmente llevaba a peleas. ¿Cómo lo hace V4?

Fase uno: "Lucha individual". Utiliza el aprendizaje por refuerzo SFT (entrenamiento fino supervisado) y GRPO (optimización de políticas relativas de grupo) para separar y entrenar por separado cada "red de expertos" dentro del modelo. El experto en programación practica codificar todos los días, y el experto en matemáticas resuelve problemas matemáticos todos los días. Totalmente independientes, sin interferencias mutuas. Esto se llama llevar la capacidad puntual al límite.

Fase dos: “Todos los métodos regresan a la fuente”. A través de la técnica de destilación en línea, se unifican y combinan estos expertos, ya maestros en artes marciales supremas, en un solo modelo coherente y fluido. Sin desperdicio interno, sin interrupciones.

Veamos las dos "cartas maestras" que forzaron.

Primero, el modo V4-Pro-Max. Este es el modo de mayor potencia de inferencia. Es como desbloquear la cerradura genética. Según ellos mismos (y rápidamente verificado por la comunidad), en pruebas de codificación, V4-Pro ya ha alcanzado un nivel de primera línea, y en tareas complejas de inferencia y Agentes, la brecha con los modelos cerrados de vanguardia (como GPT-5.5, Opus 4.6) se ha reducido significativamente.

En segundo lugar, tenemos V4-Flash-Max. Esto es aún más interesante. Es un modelo pequeño de solo 284B, pero tras recibir un presupuesto de pensamiento suficiente, su rendimiento de inferencia puede acercarse al de Pro. ¿Qué nos indica esto? Que la calidad del algoritmo está comenzando a superar al volumen de parámetros. Si le das suficiente tiempo para pensar, incluso un cerebro pequeño puede resolver problemas complejos. Por supuesto, en cuanto al conocimiento puro y tareas de Agent extremadamente complejas y multietapa, aún se ve limitado por su tamaño de parámetros (después de todo, el estómago es tan pequeño), pero esto ya es un exceso de rendimiento para la mayoría de las aplicaciones empresariales cotidianas.

Finalmente, el almacenamiento de pesos adopta inteligentemente un almacenamiento de precisión mixta FP4+FP8, conservando la precisión y ahorrando memoria GPU. Todo transmite un atractivo de estudiante de ciencias meticuloso.

Para comparar más claramente el aumento de eficiencia de ingeniería traído por este post-entrenamiento, volvemos a presentar una tabla de comparación de métricas técnicas:

El olfato del capital: ¿Por qué V4 encendió la cadena de poder de cálculo de China y Hong Kong?

Hasta aquí, el desglose técnico está casi completo. Pero aún no hemos respondido a esa pregunta fundamental del inicio:

¿Por qué GPT-5.5 no logró que el sector de la potencia de cómputo continuara su euforia, mientras que DeepSeek V4 sí lo hizo?

Esto requiere que salgamos del código y veamos este juego desde una perspectiva de capital y negocios.

GPT-5.5 es muy potente, invenciblemente fuerte. Pero es de código cerrado. ¿Qué significa código cerrado? Significa que OpenAI es un "agujero negro" enorme. Si quieres usar su capacidad, debes comprar su API. Es un modelo de "cobro de impuestos". Las ganancias fluyen hacia Silicon Valley, y la demanda de potencia de cómputo se concentra en los centros de datos en la nube de Microsoft. Para los fabricantes de hardware globales, los centros locales de cómputo y los agentes de servidores de cada país, aparte de mirar hacia arriba, no les queda casi nada. Por muy potente que sea GPT-5.5, esa es la fiesta de otros. NVIDIA sube porque la gente cree que OpenAI comprará más tarjetas.

Pero DeepSeek V4 es diferente.

Es de código abierto y está bajo la licencia MIT, que es extremadamente permisiva. La licencia MIT es el regalo más generoso del mundo del código abierto, lo que significa que las empresas comerciales pueden usarlo, modificarlo y venderlo libremente sin preocuparse por riesgos legales.

Lo más grave es que, en secciones anteriores, dedicamos gran cantidad de espacio a argumentar que V4 redujo el costo de inferencia del modelo y el uso de memoria GPU hasta los tobillos.

Al combinar estos dos puntos, llegas a una conclusión que hará enloquecer a los mercados de capitales: el punto crítico para la implementación privada ha llegado realmente.

Antes, las empresas que querían implementar un modelo grande de más de 1 TB veían la tabla de precios del hardware, cerraban silenciosamente la pantalla y se iban a comprar una API. Ahora, V4 les dice a todos: solo necesitas pocas máquinas para ejecutar localmente un supercerebro que se acerca infinitamente al nivel de GPT-4 e incluso desafía al GPT-5.5. Tus datos no necesitan salir de la provincia ni del país, son absolutamente seguros.

既然大家都能在本地跑得起了,那接下来会发生什么?

¡Compra máquinas! ¡Compra servidores! ¡Compra módulos ópticos! ¡Construye un centro de computación inteligente!

Las empresas de código cerrado venden un impuesto intelectual, mientras que las empresas de código abierto, en esencia, están promoviendo productos para fabricantes de hardware de toda la industria. DeepSeek V4 es quien lanzó la chispa. Cuanto más útil sea y más abierto sea, más explosivamente crecerá la demanda local de capacidad de cómputo en regiones como China continental, Hong Kong y Taiwán. Las empresas dedicadas a la ensamblaje de servidores, la refrigeración líquida y el mantenimiento de centros de datos finalmente ven el dinero real detrás de una implementación a gran escala.

Por eso, desde el lanzamiento de V4 el 23 de abril, la cadena de poder de cálculo de China y Hong Kong experimentó saltos consecutivos. El capital no paga por emociones, sino que se posiciona anticipadamente ante la inminente “ola de despliegue privado en miles de industrias”.

Esto es el plan comercial subyacente.

Conclusión: La marea baja y las rocas

Estos treinta días locos, once modelos grandes, como un espectáculo de fuegos artificiales ruidoso.

Los gigantes agitan sus fondos en el ring de los parámetros, tratando de derribar a sus rivales con puños de poder de cómputo. Pero tras el alboroto, los que suelen quedar para cambiar el paisaje de la industria no son siempre los más ruidosos.

La aparición de DeepSeek V4 es como un asesino sereno. No compite contigo en quién gasta más dinero; solo ataca en el punto más débil: elimina la memoria gráfica innecesaria, reduce las barreras de implementación y convierte las competencias de alto nivel en un juego para todos.

En esta batalla de IA conocida como "Ragnarök", la era de acumular parámetros ciegamente se está acelerando hacia su fin. El campo de batalla del futuro pertenecerá a quienes encuentren el equilibrio perfecto entre "rendimiento extremo" y "eficiencia de ingeniería".

Las corrientes siempre retroceden; después de la retirada, se sabe quién estaba nadando desnudo y quién era la roca inquebrantable.

V4 ya ha entregado las armas a todos. Ahora, depende de cada señor feudal cómo establecer sus campamentos en este nuevo continente.

Al comprender esta capa, al escuchar esos anuncios ruidosos que hablan de “lanzamientos impactantes” o “redefinirlo todo”, quizás puedas sentirte más tranquilo y menos ansioso.

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Fuente de referencia:

- Previsualización de la serie DeepSeek V4, lanzamiento oficial, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- El auge de la IA de abril: Análisis del ciclo de 30 días de los modelos grandes, ME News Market Observer. (2026).

- Leyes de escalado y el cambio de paradigma post-entrenamiento, Journal of Artificial Intelligence Economics. (2026).

- Informe de tendencias del mercado de la cadena de suministro de cómputo global (abril de 2026), Análisis de datos financieros de Pan-Asia. (2026).