DeepSeek V4 finalmente ha sido lanzado. Este es un momento esperado durante casi cinco meses. El modelo principal MoE de 1T parámetros + la versión Flash de 285B parámetros, seguida de cerca por la versión Pro completa de 1.6T, está completamente abierto en GitHub bajo la licencia Apache 2.0, con pesos y código de despliegue liberados simultáneamente.

En cuanto salió el modelo, los mercados financieros respondieron con tres formas independientes pero interconectadas.

Diferentes reacciones del mercado de capitales

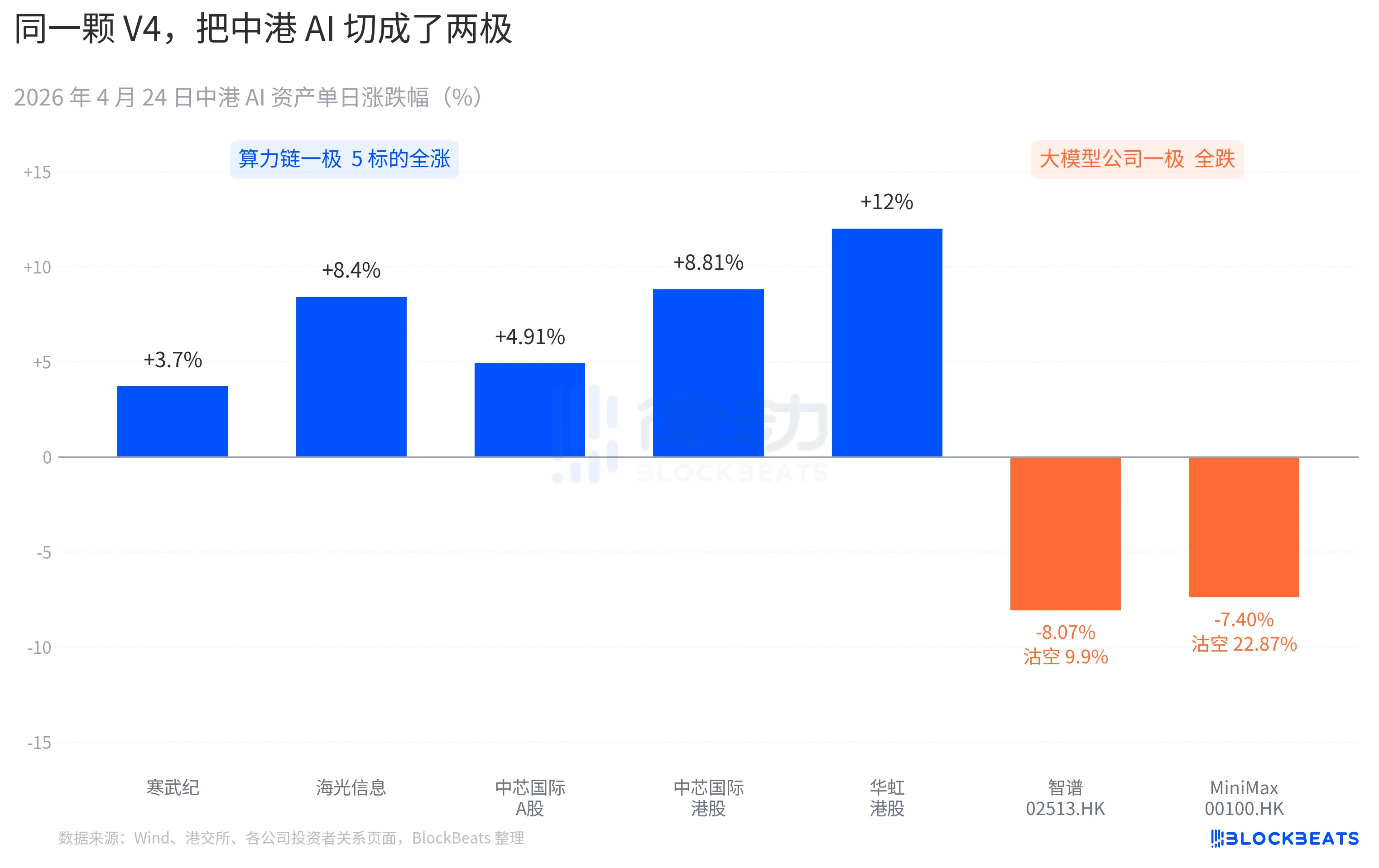

Prácticamente todos los activos de la cadena de poder de cálculo A subieron en salto. Cambricon logró 11 días consecutivos de alzas, con un aumento diario del 3,7% y un rendimiento acumulado en el mes que supera el 60%. Higon Information tocó el límite alcista del 10% durante la sesión y cerró con un aumento del 8,4%. SMIC en acciones A subió un 4,91% y en Hong Kong un 8,81%. Hua Hong en Hong Kong alcanzó un máximo de +18% y cerró con un aumento del 12%. El ETF nacional de chips de ciencia y tecnología CSRC atrajo 2.400 millones de yuanes en un solo día, alcanzando un nivel récord histórico.

Esta cabeza de la empresa de modelos grandes de Hong Kong tiene otro color. Zhipu (02513.HK) bajó un 8,07% con un porcentaje de venta en corto del 9,9%. MiniMax (00100.HK) cayó un 7,40% y el porcentaje de venta en corto se disparó hasta el 22,87%. Este último registró el mayor volumen diario de venta en corto del sector AI de Hong Kong en los últimos tres meses. Ambas empresas son representantes de la ola de IPOs de AI en Hong Kong a finales de 2025, y en sus prospectos de oferta pública inicial se menciona como ventaja competitiva clave la misma frase: «modelo base desarrollado internamente».

La reacción al otro lado del Pacífico fue igualmente específica. NVIDIA abrió con una caída del 1.8% el 24 de abril, descendiendo hasta un -2.6% durante la sesión, y cerró sin cambios. La evaluación rápida de mercado de Bloomberg comparó este ajuste con el "momento DeepSeek V3" del 27 de enero. La diferencia radica en que, en enero, se trató de una venta masiva por pánico que borró 600 mil millones de dólares en capitalización de mercado en un solo día. Esta vez, se asemeja más a una revalorización, con volumen moderado pero dirección clara. En los resúmenes de investigación de instituciones compradoras apareció una nueva frase: "La demanda de inferencia de IA en China comienza a desvincularse de la demanda de inferencia de IA en Norteamérica".

Apilar estos tres mercados es la primera sentencia escrita por el mercado en las 24 horas posteriores al lanzamiento de V4. Tras la victoria del código abierto, el dinero comenzó a reorganizarse; ya no es el modelo en sí lo que determina el precio, sino en qué tipo de tarjeta se ejecuta el modelo y en qué cadena de valor está integrado.

30 días, 11 nuevos modelos; V4 enciende la comunidad de código abierto

La ventana de tiempo de lanzamiento de la V4 fue parte de la razón por la que esta reacción se amplificó.

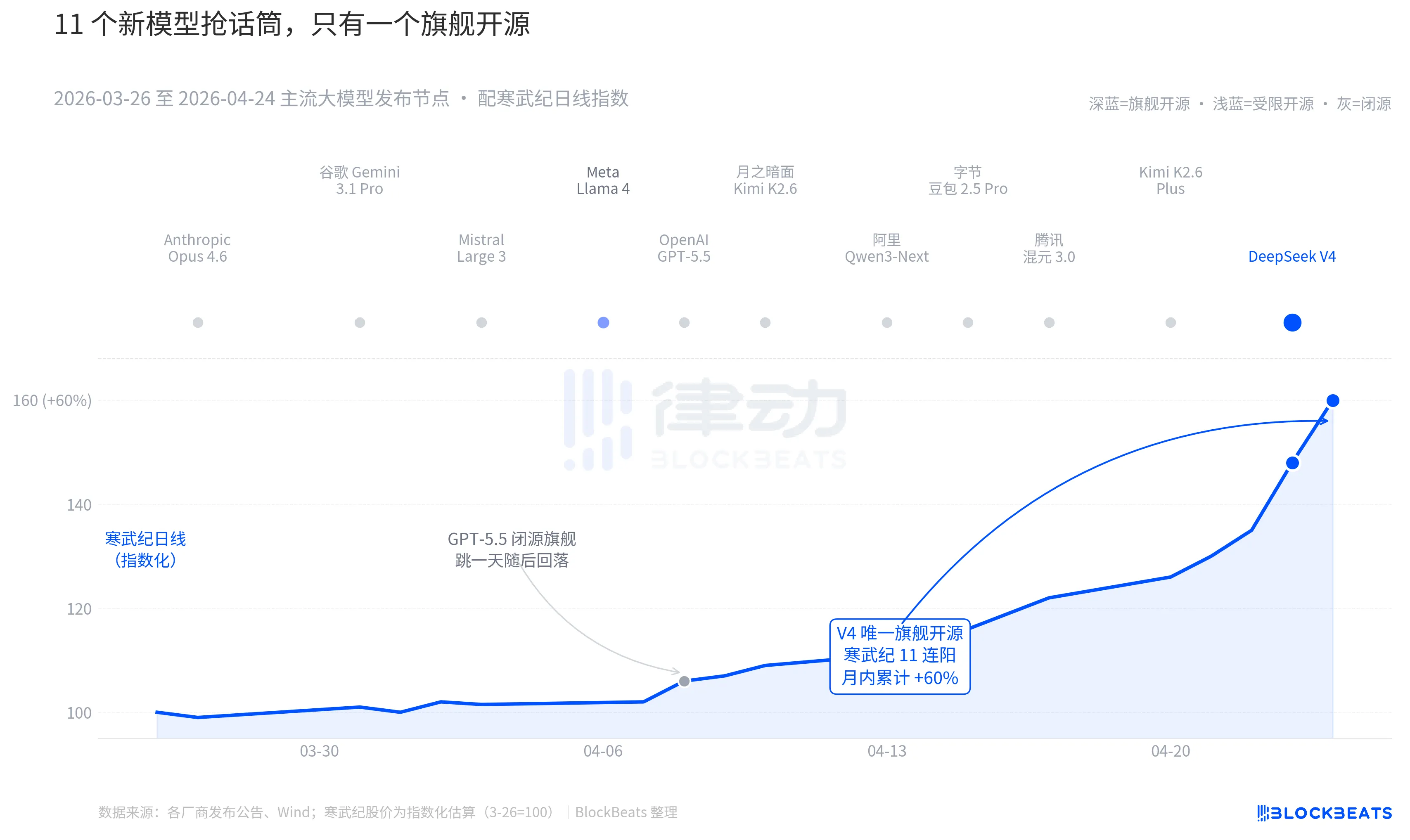

Aleja la cámara hacia los últimos 30 días. Entre el 26 de marzo y el 24 de abril, al menos 11 modelos de gran impacto global fueron lanzados o actualizados significativamente, cubriendo a casi todos los principales actores. Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus, y finalmente DeepSeek V4, lanzado la madrugada del 23 de abril.

En promedio, surge un nuevo modelo cada 2.7 días. Es una velocidad a la que incluso los gestores de fondos no logran leer los comunicados de lanzamiento. Pero al revisar la gráfica K de los activos de IA en China y Hong Kong durante estos 30 días, solo un nombre dejó una huella sostenible en el gráfico. El 8 de abril, GPT-5.5 impulsó a NVIDIA a subir un 4.2% en un solo día, alcanzando su pico. Luego, del 23 al 24 de abril, DeepSeek V4 impulsó a la cadena de capacidad de cómputo en China y Hong Kong a realizar saltos consecutivos.

La diferencia no radica en las capacidades mismas de los modelos. La brecha entre estos 11 modelos en la clasificación de LMArena, en la mayoría de los casos, no supera los 50 puntos, y se encuentra dentro de un rango estrecho de «misma categoría». La diferencia radica en la combinación de dos factores.

Lo primero es el código abierto. De los primeros 10 modelos, solo Llama 4 es de código abierto, pero su licencia de pesos incluye una larga lista de restricciones comerciales, lo que generó una respuesta fría en la comunidad de desarrolladores de EE. UU. y Europa, y cayó fuera del top 10 en OpenRouter al tercer día. La licencia de V4 es Apache 2.0, sin restricciones para los pesos, sin límites comerciales y con el código de inferencia liberado simultáneamente. Es el primer modelo de código abierto de élite en los últimos seis meses en ejercer presión simultánea sobre el campamento cerrado en los tres aspectos: rendimiento, precio y apertura.

Lo segundo es el momento. En un contexto en el que el bando cerrado ha lanzado una serie de movimientos contundentes, la narrativa de código abierto ha sido reiteradamente presionada. Opus 4.6 elevó el rendimiento en la tarea de código SWE-Bench a un nuevo récord, mientras que GPT-5.5 estableció un punto de anclaje inferior de 1,25 dólares por millón de tokens. La discusión sobre si el código abierto puede alcanzar al cerrado ha persistido en Silicon Valley durante dos años. El modelo V4, con una estimación de usuarios activos mensuales de 90 millones, puso en pausa esta discusión.

Según un gestor de fondos importante del país durante una ronda de presentaciones: “Antes de V4, aplicábamos un descuento en la valoración de los modelos grandes de código abierto; después de V4, este descuento comenzó a invertirse”.

DeepSeek cambió la tabla de precios de la cadena de suministro de capacidad de cómputo

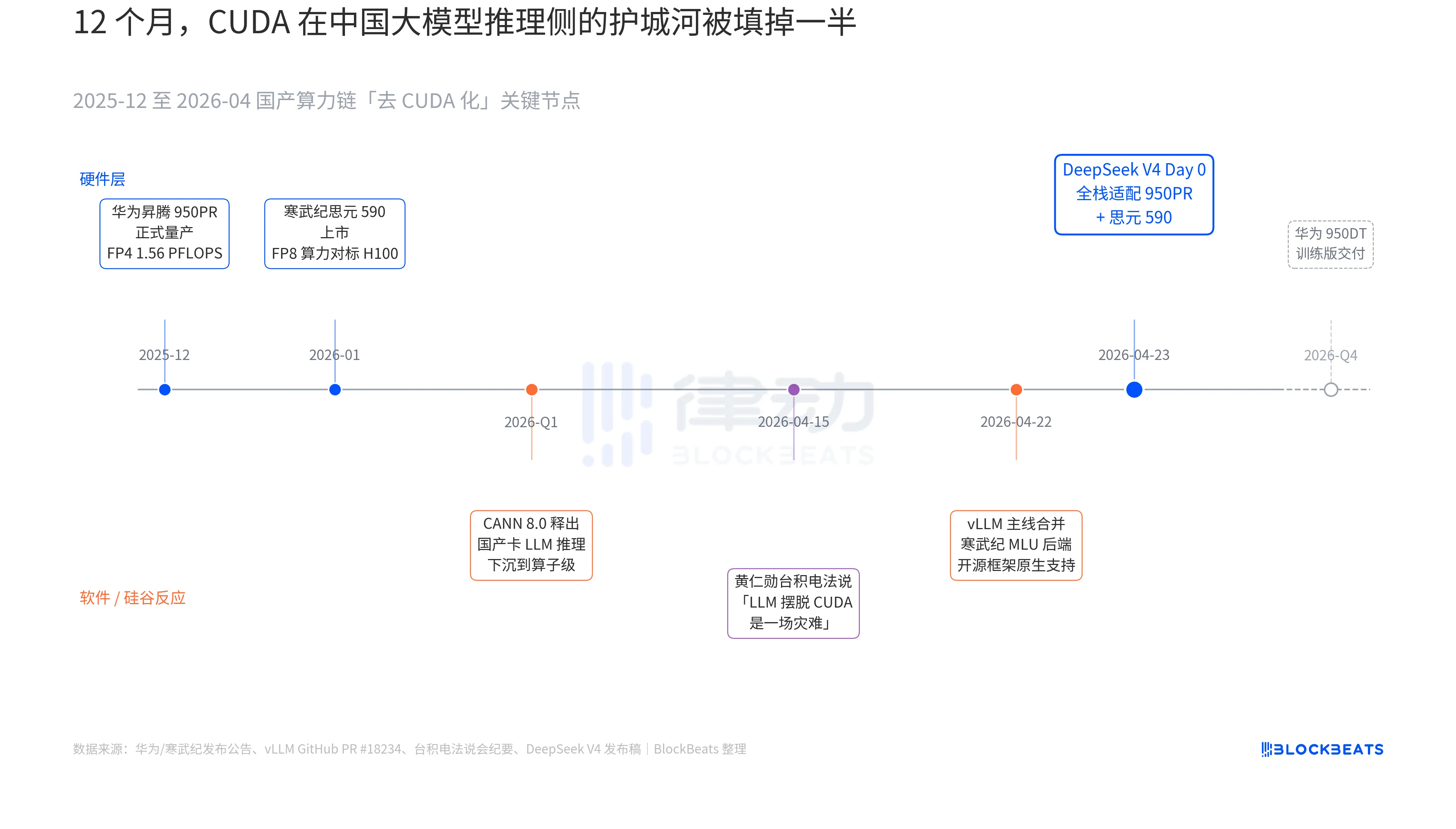

En el lanzamiento de V4, hay una línea que nunca antes había aparecido en ningún documento oficial de modelos grandes chinos: «Día 0: adaptación completa a la Cambricon MLU590 y la Huawei Ascend 950PR, código de despliegue liberado simultáneamente como código abierto». El peso de esta línea solo se comprende al conectar las tres líneas paralelas que se desarrollaron durante los últimos 12 meses: corresponden al hardware, el software y la reacción de Silicon Valley.

La primera línea oculta está en el lado del chip. El chip Ascend 950PR de Huawei entró en producción masiva en diciembre de 2025, con una capacidad de cálculo FP4 de 1.56 PFLOPS y una capacidad HBM de 112 GB, marcando la primera vez que un chip AI nacional iguala en métricas técnicas a la serie B de NVIDIA. En tareas de inferencia MoE con 1T parámetros como V4, el rendimiento por tarjeta aumenta 2.87 veces en comparación con la H20. La pila de software CANN 8.0 optimiza los marcos de inferencia LLM hasta el nivel de operadores; los benchmarks publicados por DeepSeek muestran que la latencia de inferencia extremo a extremo de V4 en un supernodo Ascend (8 tarjetas 950PR) es un 35% menor que la de un clúster H100 de tamaño equivalente. Los datos del chip Cambricon MLU590 son aún más agresivos: su capacidad de cálculo FP8 por chip se compara con la H100, a un precio inferior a la mitad.

La segunda línea oculta está en el lado del software. El 22 de abril, vLLM integró el PR del backend MLU de Cambricon, marcando la primera vez que un marco de inferencia de código abierto soporta nativamente GPUs nacionales no NVIDIA. El DCU de Hygon sigue otro camino a través del ecosistema ROCm, pero puede ejecutar completamente la capa de enrutamiento MoE de V4. Esto significa que la implementación de V4 ya no es «solo posible en una tarjeta nacional específica», sino que ahora se puede «elegir entre varias tarjetas nacionales». Se rompe la dependencia del ecosistema de un proveedor único, lo que representa un punto de inflexión clave para producción.

La tercera línea oculta proviene de Silicon Valley. El 15 de abril, Huang Renxun fue presionado por analistas en la reunión de resultados de TSMC sobre el progreso de la capacidad de cómputo nacional china; sus palabras fueron frías y específicas: «Si realmente logran liberar a los LLM de CUDA, para nosotros sería un desastre». Nueve días después, DeepSeek dio la respuesta con un anuncio de Day 0.

Las cuatro palabras «sustitución nacional» se han usado tanto en los últimos tres años que han perdido su significado. Pero después de la mañana del 24 de abril, por primera vez, hubo datos concretos que el mercado de capitales pudo valorar: rendimiento por tarjeta, latencia de inferencia de extremo a extremo, costo de inferencia y código de despliegue listo para uso comercial; silenciosamente, llevaron esta larga batalla de discursos al umbral de la producción.

La lógica detrás de los 11 días consecutivos de alza en el precio de las acciones de Cambricon se encuentra aquí. Ya no es simplemente una «acción de concepto de GPU nacional», sino un «proveedor de infraestructura de inferencia para DeepSeek V4». La misma lógica explica el aumento del 12% en las acciones de Hua Hong en Hong Kong, ya que fabrica el proceso equivalente a 7 nm para el 950PR. Cada token V4 ejecutado en las aceleradoras Ascend nacionales significa una parte de la capacidad que antes fluía hacia NVIDIA y TSMC que ahora se retiene parcialmente en el Delta del Río Perla.

El siguiente paso ya está preparado. En la hoja de ruta de Huawei, la 950DT (versión de entrenamiento) está planificada para su entrega en el cuarto trimestre de 2026, con el objetivo de «entrenar completamente pilas de modelos V5 o de igual nivel en clústeres de 10 000 tarjetas». Si este camino se logra, el muro de protección de CUDA en el entrenamiento de modelos grandes en China se reducirá de «necesario» a «opcional».

Fuente:律动 BlockBeats