Artículo | Sleepy.txt

Ocho años atrás, Zhongxing sufrió una parada cardíaca.

El 16 de abril de 2018, una orden de prohibición emitida por la Oficina de Industria y Seguridad del Departamento de Comercio de Estados Unidos dejó sin funcionar, en una sola noche, a ZTE, un proveedor global de equipos de comunicación con 80.000 empleados y ingresos anuales superiores a mil millones de dólares. El contenido de la prohibición era sencillo: durante los próximos siete años, se prohibía a cualquier empresa estadounidense vender componentes, productos, software y tecnología a ZTE.

Sin los chips de Qualcomm, las estaciones base se detuvieron. Sin la autorización de Android de Google, los teléfonos no tenían un sistema operativo funcional. 23 días después, ZTE emitió un comunicado indicando que sus actividades comerciales principales ya no podían llevarse a cabo.

Pero ZTE finalmente sobrevivió, pero a un costo de 1.400 millones de dólares.

Multa de 1.000 millones de dólares, pagadera de inmediato; 400 millones de dólares como garantía, depositados en una cuenta de custodia en un banco estadounidense. Además, se reemplazará a todo el equipo directivo y se permitirá la entrada de un equipo de supervisión de cumplimiento estadounidense. En todo el año 2018, ZTE registró una pérdida neta de 7.000 millones de yuanes chinos, con una caída del 21,4% en los ingresos respecto al año anterior.

El entonces presidente de ZTE, Yin Yimin, escribió en una carta interna: «Estamos en una industria compleja, altamente dependiente de la cadena de suministro global». En ese momento, esa frase sonaba como una reflexión, y también como una resignación.

Ocho años después, el 26 de febrero de 2026, la campeona china de IA DeepSeek anunció que su próximo modelo multimodal V4 colaborará en profundidad con fabricantes chinos de chips, logrando por primera vez una solución completamente no NVIDIA desde el preentrenamiento hasta el ajuste fino.

Ya no usamos NVIDIA.

Al anunciarse la noticia, la primera reacción del mercado fue la duda. ¿Es comercialmente razonable renunciar a NVIDIA, que tiene más del 90% de cuota de mercado en chips de entrenamiento de IA a nivel mundial?

Pero detrás de la elección de DeepSeek se esconde un problema más grande que la lógica comercial: ¿qué tipo de independencia en capacidad de cómputo necesita la IA china?

¿Qué es realmente lo que está siendo estrangulado?

Mucha gente cree que la prohibición de chips afecta el hardware. Pero lo que realmente asfixia a las empresas chinas de IA es algo llamado CUDA.

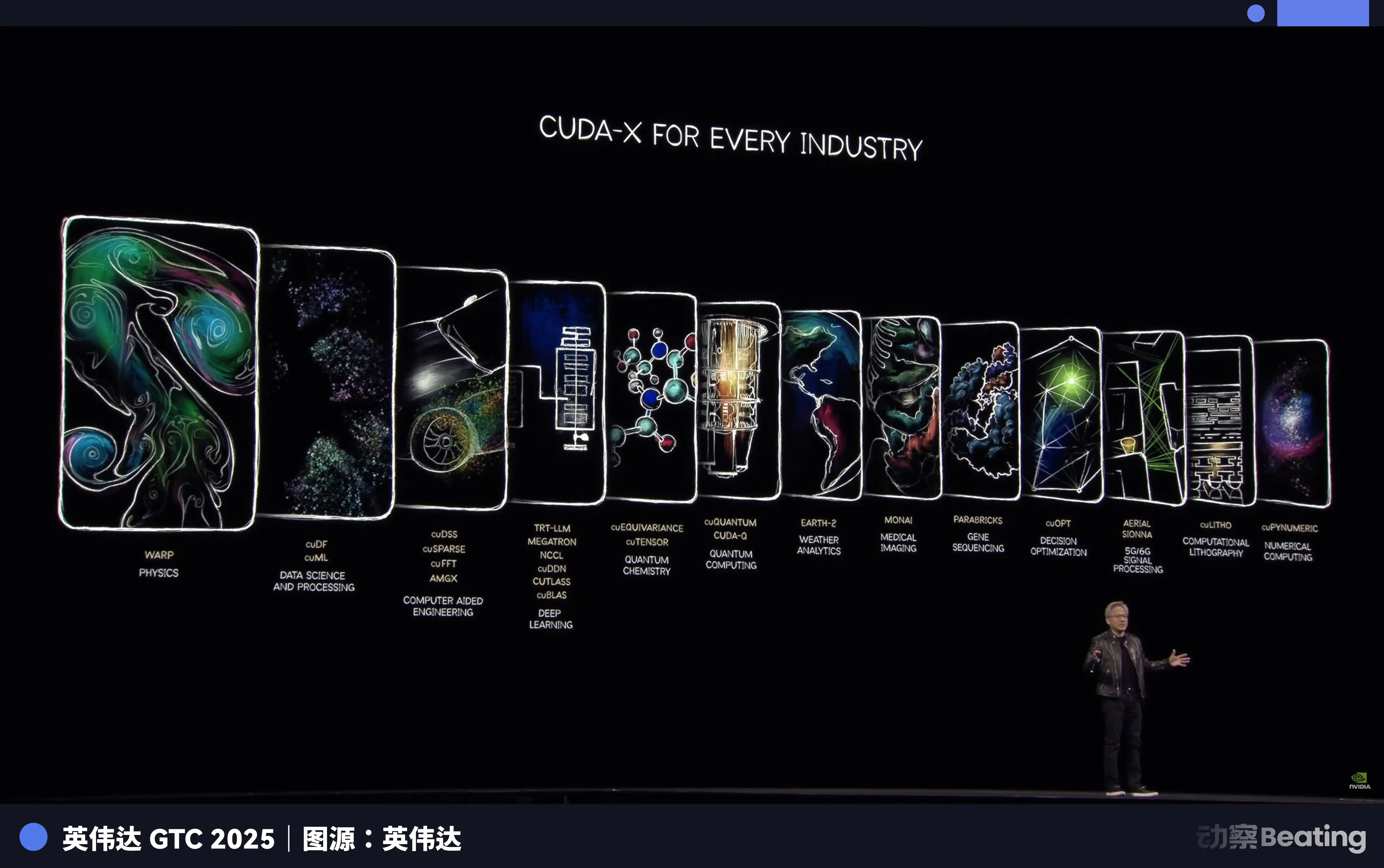

CUDA, cuyo nombre completo es Compute Unified Device Architecture, es una plataforma de cálculo paralelo y un modelo de programación lanzados por NVIDIA en 2006. Permite a los desarrolladores acceder directamente a la potencia de cálculo de las GPU de NVIDIA para acelerar diversas tareas de cálculo complejas.

Antes de la llegada de la era de la IA, esto era solo una herramienta para unos pocos entusiastas. Pero cuando llegó la ola del aprendizaje profundo, CUDA se convirtió en la base de toda la industria de la IA.

El entrenamiento de grandes modelos de IA es, en esencia, una gran cantidad de operaciones matriciales. Y esto es exactamente lo que mejor hace la GPU.

NVIDIA, con su estrategia de planificación anticipada de más de una década, ha construido una cadena de herramientas completa que abarca desde el hardware de base hasta las aplicaciones superiores para desarrolladores de IA en todo el mundo mediante CUDA. Hoy en día, todos los marcos de IA principales del mundo, desde TensorFlow de Google hasta PyTorch de Meta, están profundamente integrados con CUDA en su nivel inferior.

Un estudiante de doctorado en IA ha estado aprendiendo, programando y realizando experimentos en un entorno CUDA desde el primer día de su ingreso. Cada línea de código que escribe refuerza el foso defensivo de NVIDIA.

Hasta 2025, el ecosistema CUDA cuenta con más de 4,5 millones de desarrolladores, abarcando más de 3.000 aplicaciones aceleradas por GPU, y más de 40.000 empresas en todo el mundo utilizan CUDA. Este número significa que más del 90% de los desarrolladores de IA en el mundo están vinculados al ecosistema de NVIDIA.

Lo aterrador de CUDA es que es un volante de inercia. Cuantos más desarrolladores lo usen, más herramientas, bibliotecas y código se generarán, y más próspero se volverá el ecosistema; cuanto más próspero sea el ecosistema, más desarrolladores atraerá. Una vez que este volante empieza a girar, es casi imposible de desplazar.

El resultado es que NVIDIA te vende la pala más cara y define la única postura de minería. ¿Quieres cambiar de pala? Claro. Pero primero tendrás que reescribir todo el conocimiento, herramientas y código acumulados durante los últimos quince años por decenas de miles de las mentes más inteligentes del mundo en esa postura.

¿Quién paga este costo?

Entonces, el 7 de octubre de 2022, cuando entró en vigor la primera ronda de restricciones del BIS, limitando la exportación a China de las A100 y H100 de NVIDIA, las empresas chinas de IA sintieron por primera vez una sensación asfixiante similar a la de ZTE. NVIDIA lanzó posteriormente las versiones «especiales para China», A800 y H800, reduciendo el ancho de banda de interconexión entre los chips y manteniendo así el suministro a duras penas.

Pero apenas un año después, el 17 de octubre de 2023, se volvieron a restringir las regulaciones de la segunda ronda, prohibiéndose también los A800 y H800, y se incluyeron 13 empresas chinas en la lista de entidades. NVIDIA tuvo que lanzar nuevamente una versión aún más limitada, el H20. Para diciembre de 2024, la última ronda de regulaciones durante el mandato del gobierno de Biden entró en vigor, restringiendo estrictamente la exportación del H20.

Tres rondas de regulaciones, cada vez más estrictas.

Pero esta vez, el curso de la historia es completamente diferente al de ZTE en su momento.

Una ruptura asimétrica

Bajo la prohibición, todos pensaron que el sueño de China con los modelos grandes de IA terminaría aquí.

Todos se equivocaron. Frente al bloqueo, las empresas chinas no optaron por un enfrentamiento directo, sino que iniciaron una突围. El primer campo de batalla de esta突围 no está en los chips, sino en los algoritmos.

De finales de 2024 a 2025, las empresas chinas de IA se orientaron colectivamente hacia una dirección tecnológica: modelos de expertos mixtos.

En pocas palabras, se trata de dividir un modelo enorme en muchos pequeños expertos, y al procesar una tarea, solo se activan los más relevantes, en lugar de hacer funcionar todo el modelo.

DeepSeek V3 es un ejemplo típico de este enfoque. Cuenta con 671 mil millones de parámetros, pero durante cada inferencia solo activa 37 mil millones, lo que representa solo el 5.5% del total. En términos de costos de entrenamiento, utilizó 2048 GPU NVIDIA H800 durante 58 días, con un gasto total de 5,576 millones de dólares. Como comparación, las estimaciones externas sobre el costo de entrenamiento de GPT-4 rondan los 78 millones de dólares. Una diferencia de un orden de magnitud.

La optimización extrema en el algoritmo se refleja directamente en el precio. El precio de la API de DeepSeek es de solo $0.028 a $0.28 por millón de tokens de entrada y $0.42 para la salida. En comparación, GPT-4o cuesta $5 por entrada y $15 por salida. Claude Opus es aún más caro, con $15 por entrada y $75 por salida. En términos relativos, DeepSeek es entre 25 y 75 veces más económico que Claude.

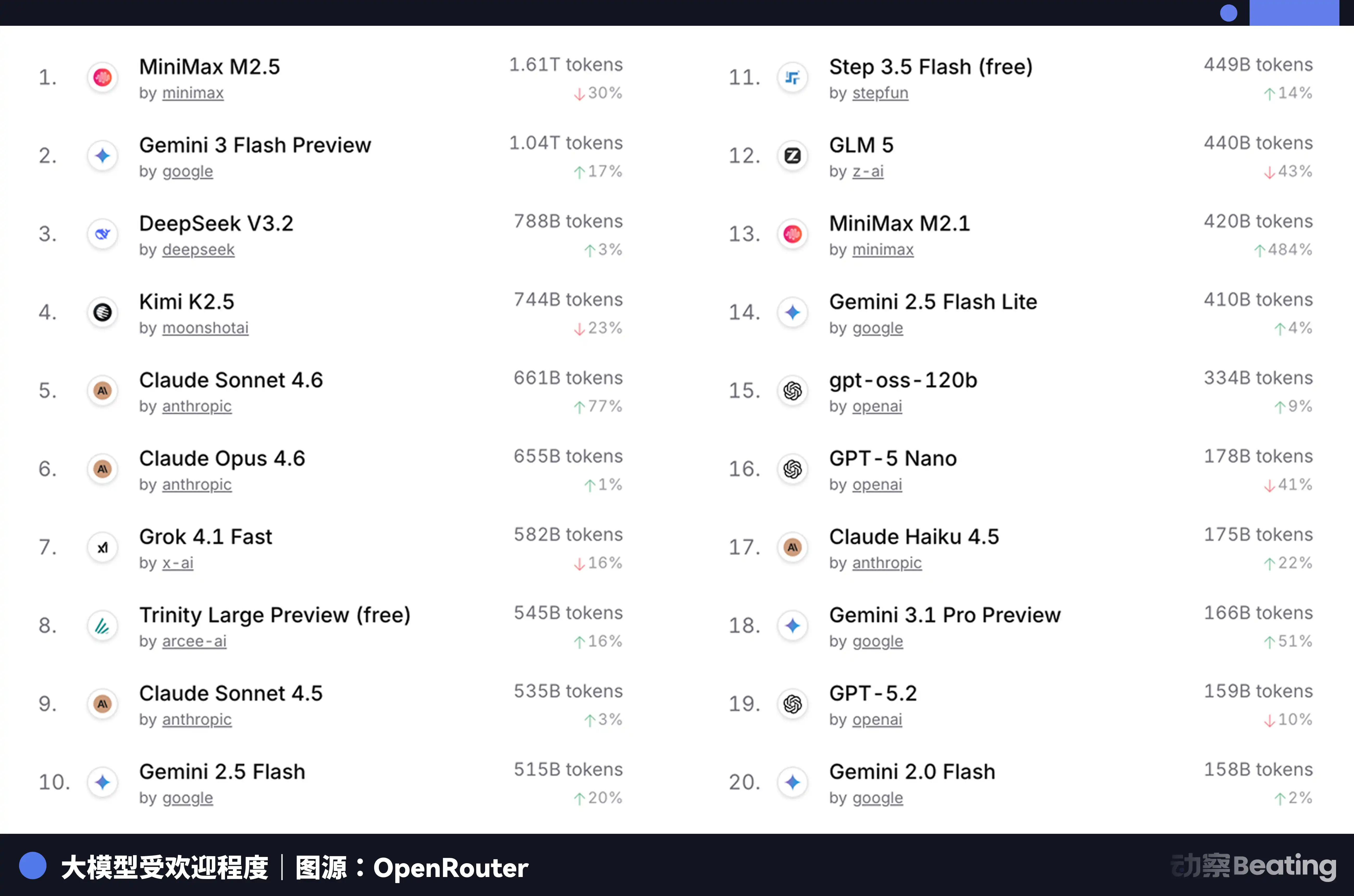

Esta diferencia de precios generó una gran respuesta en el mercado global de desarrolladores. En febrero de 2026, en OpenRouter, la plataforma de agregación de API de modelos de IA más grande del mundo, el volumen semanal de llamadas a modelos de IA chinos aumentó un 127% en tres semanas, superando por primera vez a Estados Unidos. Hace un año, la cuota de los modelos chinos en OpenRouter era inferior al 2%. Un año después, creció un 421%, acercándose al 60%.

Detrás de estos datos hay un cambio estructural fácilmente pasado por alto. A partir del segundo semestre de 2025, el escenario principal de las aplicaciones de IA pasó de chat a Agent. En el escenario de Agent, el consumo de tokens por tarea es de 10 a 100 veces mayor que en un chat simple. Cuando el consumo de tokens crece exponencialmente, el precio se convierte en un factor determinante. La extraordinaria relación calidad-precio de los modelos chinos coincide precisamente con esta ventana.

Pero el problema es que la reducción del costo de inferencia no resuelve el problema fundamental del entrenamiento. Si un modelo grande no puede entrenarse y iterar continuamente sobre los datos más recientes, su capacidad se degradará rápidamente. Y el entrenamiento sigue siendo ese agujero negro de poder computacional que no se puede evitar.

Entonces, ¿de dónde proviene la «pala» entrenada?

La promoción del respaldo

Jiangsu Xinghua, una pequeña ciudad en el sur de Jiangsu, conocida por su acero inoxidable y alimentos saludables, anteriormente no tenía relación con la IA. Pero en 2025, aquí se construyó y puso en funcionamiento una línea de producción nacional de servidores de capacidad de cómputo de 148 metros de longitud, desde la firma del acuerdo hasta la puesta en marcha, solo se tardaron 180 días.

El núcleo de esta línea de producción son dos chips completamente nacionales: el procesador Loongson 3C6000 y la tarjeta de aceleración AI TaiChu YuanQi T100. El Loongson 3C6000 tiene su conjunto de instrucciones y microarquitectura desarrollados completamente por cuenta propia. La TaiChu YuanQi proviene del Centro Nacional de Supercomputación de Wuxi y del equipo de la Universidad Tsinghua, y utiliza una arquitectura heterogénea de múltiples núcleos.

Cuando la línea de producción opera a máxima capacidad, se produce un servidor cada 5 minutos. La inversión total en esta línea de producción es de 1.100 millones de yuanes, con una producción anual prevista de 100.000 unidades.

Más importante aún, el clúster de diez mil chips nacionales basados en estos chips domésticos ya ha comenzado a asumir tareas reales de entrenamiento de modelos grandes.

En enero de 2026, Zhipu AI, en colaboración con Huawei, lanzó GLM-Image, el primer modelo SOTA de generación de imágenes entrenado completamente con chips nacionales. En febrero, el modelo grande «Xingchen» de Telecom China, de mil millones de parámetros, completó su entrenamiento completo en el pool de capacidad de cómputo nacional de diez mil tarjetas en Lingang, Shanghai.

El significado de estos casos es que demuestran un hecho: los chips nacionales han pasado de «ser capaces de inferencia» a «ser capaces de entrenamiento». Esto es un cambio cualitativo. La inferencia solo requiere ejecutar modelos ya entrenados, lo que impone requisitos relativamente bajos para los chips; en cambio, el entrenamiento requiere procesar cantidades masivas de datos, realizar cálculos complejos de gradientes y actualizaciones de parámetros, lo que eleva en un orden de magnitud los requisitos de potencia de cómputo, ancho de banda de interconexión y ecosistema de software de los chips.

La fuerza central detrás de estas tareas son los chips Ascend de Huawei. Hasta finales de 2025, el ecosistema Ascend cuenta con más de 4 millones de desarrolladores y más de 3.000 socios, con 43 modelos grandes líderes de la industria que completaron su preentrenamiento sobre Ascend y más de 200 modelos de código abierto adaptados. En el MWC del 2 de marzo de 2026, Huawei lanzó en los mercados internacionales su nueva infraestructura de poder de cómputo, SuperPoD.

La capacidad de cálculo FP16 del Ascend 910B ya se ha equiparado con la NVIDIA A100. Aunque aún existe una brecha, ya ha pasado de ser inutilizable a utilizable, y de utilizable a cada vez más fácil de usar. La construcción del ecosistema no puede esperar hasta que el chip sea perfecto; debe iniciarse a gran escala en la etapa en que sea suficiente, utilizando necesidades comerciales reales para impulsar la iteración del chip y el software. Los objetivos de adopción de servidores de capacidad de cómputo nacional por parte de ByteDance, Tencent y Baidu para 2026 generalmente se duplicarán en comparación con el año anterior. Según los datos del Ministerio de Industria y Tecnología de la Información, la escala de cómputo inteligente en China ya alcanza los 1590 EFLOPS. El año 2026 está convirtiéndose en el año inaugural de la implementación a gran escala de la capacidad de cómputo nacional.

Apagones en Estados Unidos y la expansión de China al extranjero

A principios de 2026, Virginia, que soporta una gran cantidad del tráfico de los centros de datos globales, suspendió la aprobación de nuevos proyectos de centros de datos. Georgia siguió el ejemplo, extendiendo la suspensión de aprobaciones hasta 2027. Illinois y Michigan también implementaron restricciones consecutivamente.

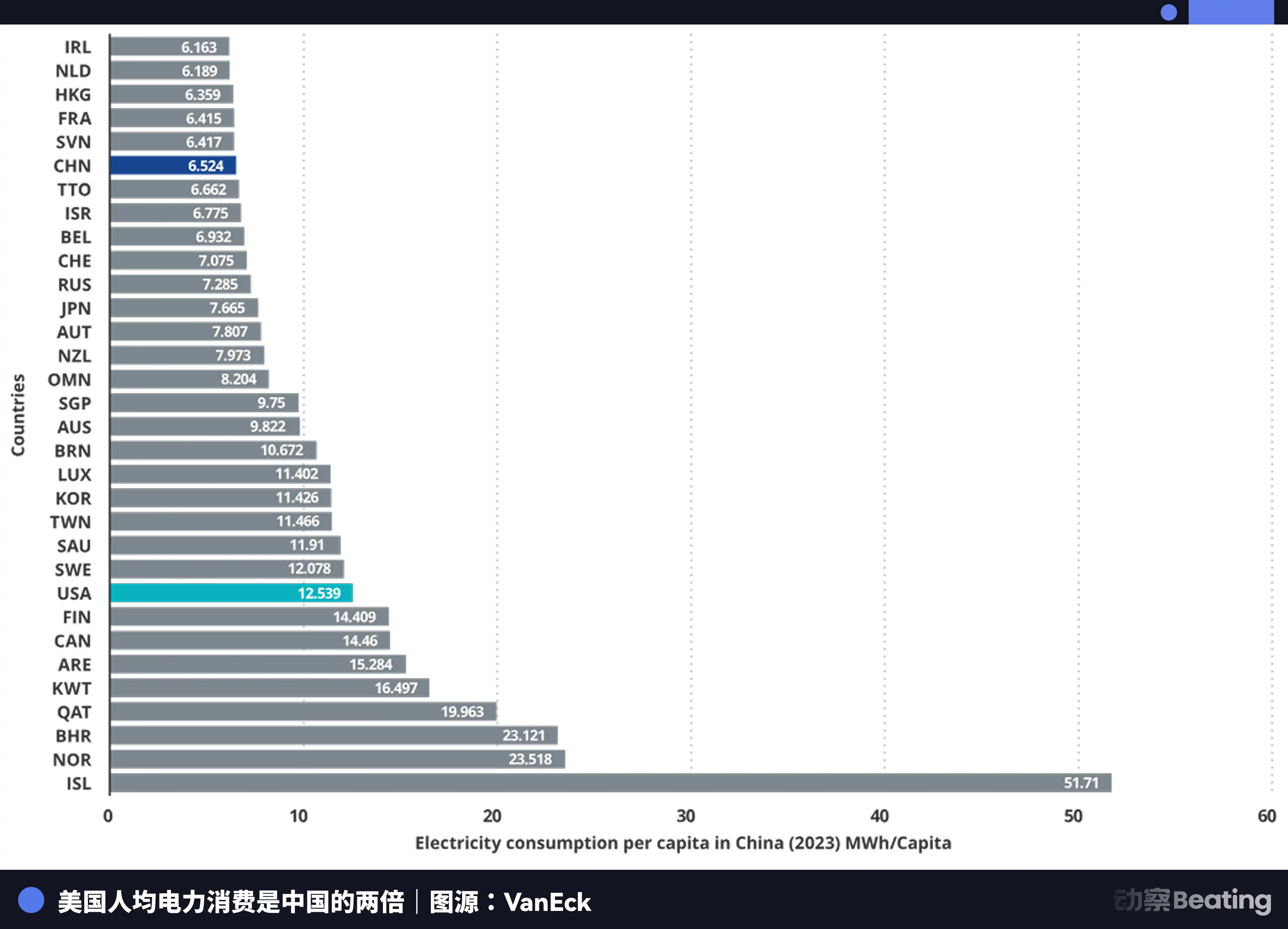

Según datos de la Agencia Internacional de la Energía, en 2024 el consumo de electricidad de los centros de datos de EE.UU. alcanzó 183 TWh, aproximadamente el 4% del consumo eléctrico nacional. Para 2030, se espera que esta cifra se duplique hasta 426 TWh, con una proporción que podría superar el 12%. El CEO de Arm predijo aún más que, para 2030, los centros de datos de IA consumirán entre el 20% y el 25% de la electricidad de EE.UU.

La red eléctrica de Estados Unidos ya está sobrecargada. La red PJM, que cubre 13 estados del este de EE.UU., enfrenta una escasez de capacidad de 6 GW. Para 2033, EE.UU. en su conjunto enfrentará una brecha de capacidad eléctrica de 175 GW, equivalente al consumo de 130 millones de hogares. Los costos mayoristas de electricidad en las regiones con alta concentración de centros de datos han aumentado un 267% en comparación con hace cinco años.

El límite del poder de cómputo es la energía. Y en este aspecto de la energía, la brecha entre China y Estados Unidos es aún mayor que la de los chips, solo que en dirección opuesta.

La generación anual de electricidad en China es de 10.4 billones de kilovatios-hora, mientras que en Estados Unidos es de 4.2 billones de kilovatios-hora, lo que significa que China es 2.5 veces mayor. Más importante aún, el consumo residencial en China representa solo el 15% del consumo total de electricidad, mientras que en Estados Unidos esta proporción es del 36%. Esto implica que China tiene un margen mucho mayor de electricidad industrial disponible para invertir en la construcción de capacidad de cómputo.

En cuanto a los precios de la electricidad, las regiones de EE.UU. donde se concentran las empresas de IA tienen tarifas de entre 0,12 y 0,15 dólares por kilovatio-hora, mientras que en el oeste de China, la tarifa industrial es de aproximadamente 0,03 dólares, solo una cuarta parte a una quinta parte de la de EE.UU.

El aumento de la generación de electricidad en China ha alcanzado siete veces el de Estados Unidos.

Mientras Estados Unidos se preocupa por la electricidad, la IA de China está saliendo silenciosamente al extranjero. Pero esta vez, lo que sale no es un producto ni una fábrica, sino un Token.

Token, la unidad mínima de información procesada por modelos de IA, está convirtiéndose en un nuevo bien digital. Se produce en fábricas de capacidad de cómputo de China y se transmite globalmente a través de cables submarinos.

Los datos de distribución de usuarios de DeepSeek son muy reveladores: 30,7% en China, 13,6% en la India, 6,9% en Indonesia, 4,3% en Estados Unidos y 3,2% en Francia. Admite 37 idiomas y es muy popular en mercados emergentes como Brasil. Más de 26.000 empresas globales han abierto cuentas, y 3.200 instituciones han implementado la versión empresarial.

En 2025, el 58% de las nuevas empresas de IA incorporaron DeepSeek en su pila tecnológica. En China, DeepSeek capturó el 89% del mercado. En otros países bajo sanciones, la cuota de mercado oscila entre el 40% y el 60%.

Esta escena recuerda mucho a otra guerra sobre la autonomía industrial hace cuarenta años.

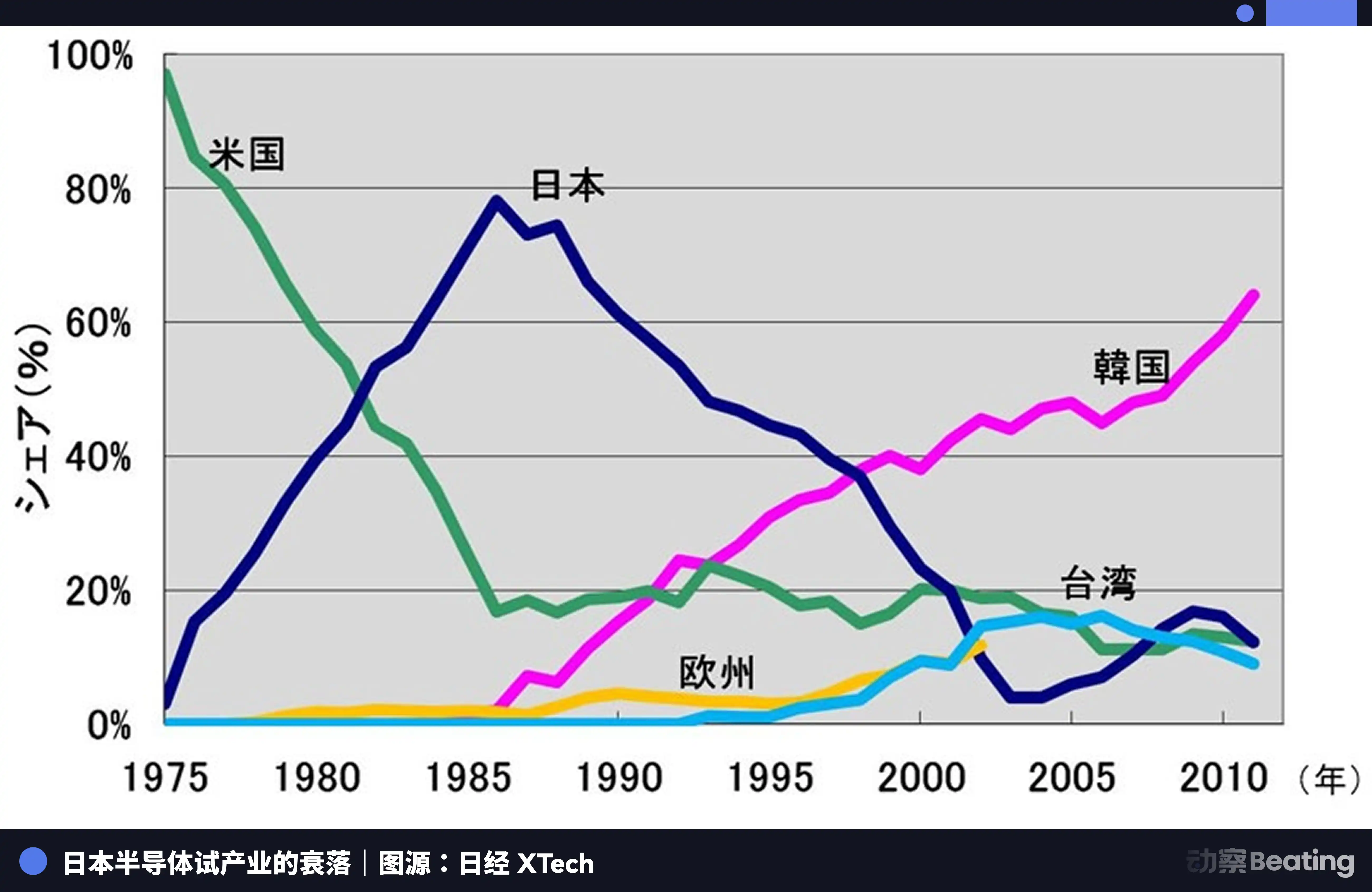

En Tokio en 1986, bajo fuerte presión de Estados Unidos, el gobierno japonés firmó el Acuerdo Semiconductores EE.UU.-Japón. Los tres puntos principales del acuerdo eran: exigir que Japón abriera su mercado de semiconductores, asegurar que la cuota de mercado de los chips estadounidenses en Japón superara el 20%; prohibir que los semiconductores japoneses se exportaran por debajo del costo; y aplicar un arancel punitivo del 100% a 300 millones de dólares en chips exportados por Japón. Al mismo tiempo, Estados Unidos rechazó la adquisición de Fairchild Semiconductor por parte de Fujitsu.

Ese año, la industria japonesa de semiconductores estaba en su apogeo. En 1988, Japón controlaba el 51% del mercado mundial de semiconductores, mientras que Estados Unidos tenía solo el 36,8%. De las diez principales empresas de semiconductores a nivel mundial, seis eran japonesas: NEC en el segundo lugar, Toshiba en el tercero, Hitachi en el quinto, Fujitsu en el séptimo, Mitsubishi en el octavo y Panasonic en el noveno. En 1985, Intel sufrió una pérdida de 173 millones de dólares estadounidenses en la batalla semiconductor entre EE.UU. y Japón, al borde de la quiebra.

Pero después de firmar el协议, todo cambió.

Estados Unidos lanzó una represión integral contra las empresas japonesas de semiconductores mediante herramientas como la investigación 301, mientras promovía a Samsung y SK Hynix de Corea del Sur para invadir el mercado japonés con precios más bajos. La cuota de DRAM de Japón cayó del 80% al 10%. Para 2017, la participación de mercado japonesa en circuitos integrados apenas alcanzaba el 7%. Los gigantes que antes parecían invencibles fueron divididos, adquiridos o se retiraron en silencio tras pérdidas interminables.

La tragedia de la semiconductora japonesa radica en que se conformó con ser el mejor productor en un sistema de división global dominado por una única fuerza externa, sin nunca aspirar a construir su propio ecosistema independiente. Cuando la marea se retiró, descubrió que, además de la producción, no tenía nada.

La industria china de IA de hoy se encuentra en una encrucijada similar, pero completamente diferente.

De manera similar, también enfrentamos una gran presión externa. Tres rondas de restricciones sobre chips, cada vez más estrictas, y las barreras del ecosistema CUDA siguen siendo altas.

Lo diferente es que, esta vez, hemos elegido un camino más difícil: desde la optimización extrema a nivel de algoritmo, hasta el salto de los chips nacionales desde inferencia hasta entrenamiento, pasando por la acumulación de 4 millones de desarrolladores en el ecosistema Ascend, hasta la penetración de los tokens en los mercados globales. Cada paso en este camino está construyendo un ecosistema industrial independiente que Japón nunca tuvo.

Epílogo

El 27 de febrero de 2026, tres informes de resultados de empresas locales de chips de IA se publicaron el mismo día.

Cambricon, ingresos aumentaron un 453%, logrando por primera vez utilidad anual. Moore Threads, ingresos crecieron un 243%, pero con una pérdida neta de 1.000 millones. Muxi, ingresos aumentaron un 121%, con una pérdida neta de casi 800 millones.

La mitad es fuego, la mitad es agua.

El fuego es la extrema codicia del mercado. El 95% de espacio dejado por Huang Renxun está siendo llenado poco a poco por los números de ingresos de estas empresas locales. Sin importar el rendimiento ni el ecosistema, el mercado necesita una segunda opción además de NVIDIA. Esta es una oportunidad estructural sin precedentes abierta por la geopolítica.

El agua de mar es un costo enorme para la construcción ecológica. Cada pérdida es dinero real pagado para alcanzar el ecosistema CUDA. Son inversiones en investigación y desarrollo, subsidios para software, y costos de mano de obra de ingenieros enviados a sitios de clientes para resolver uno por uno los problemas de compilación. Estas pérdidas no son resultado de mala gestión, sino el impuesto de guerra necesario para construir un ecosistema independiente.

Estos tres informes financieros registran con más honestidad que cualquier informe de la industria la verdadera cara de esta guerra de hash power. No es una victoria cantada, sino una batalla de posiciones sangrienta y feroz, avanzando mientras se sangra.

Pero la forma de la guerra realmente ha cambiado. Ocho años atrás, discutíamos el problema de «si podíamos sobrevivir». Hoy, discutimos el problema de «cuánto costará sobrevivir».

El costo en sí mismo es progreso.

Haz clic para conocer los puestos disponibles en BlockBeats

¡Bienvenido al grupo oficial de律动 BlockBeats!

Grupo de suscripción de Telegram: https://t.me/theblockbeats

Grupo de Telegram: https://t.me/BlockBeats_App

Cuenta oficial de Twitter: https://twitter.com/BlockBeatsAsia