¿Cómo te defenderías si la IA de repente te declarara culpable y todos creyeran ciegamente su juicio?

Esto suena como una escena de la película Minority Report, donde se predice un crimen y luego se te inculpa, pero de forma abstracta, en la vida real ya ha ocurrido una versión aún más descuidada:

La IA identificó erróneamente a un criminal, lo que llevó a una mujer inocente a pasar seis meses en la cárcel, casi arruinando su vida.

¿Qué significa que la policía arrestó al Flash?

Angela Lipps, de Tennessee, EE. UU., es esta desafortunada mujer. En julio de 2025, un equipo de policías completamente armados irrumpió de repente en su vida tranquila, le apuntaron con armas y le dijeron que estaba arrestada.

En ese momento, ella se quedó aturdida, ya que simplemente no sabía qué había hecho mal. La policía dijo que ella era sospechosa de participar en un caso de fraude bancario en Dakota del Norte, y el aspecto sugería que las pruebas eran contundentes, además de que se había emitido una orden de captura de cinco estrellas; pero al escuchar esa razón, ella se quedó paralizada:

Pero yo, en toda mi vida, nunca he ido a ese estado.

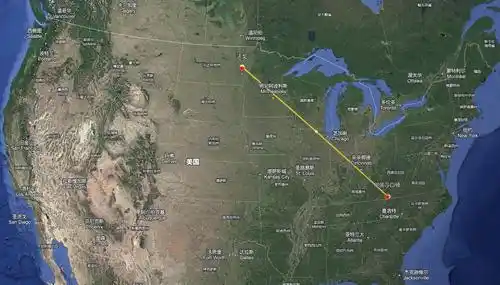

Desde el mapa, realmente hay una distancia entre Tennessee, EE. UU., y Dakota del Norte, y es la IA la que la vincula con el sospechoso.

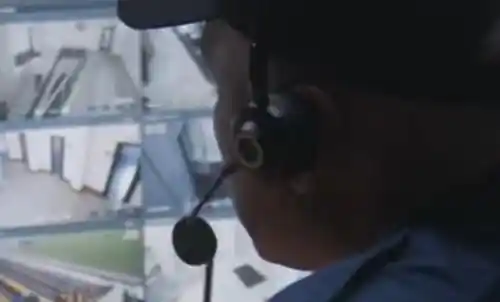

Cuando la arrestaron, se bloquearon automáticamente sus explicaciones; los detalles específicos del caso solo se conocieron después de que entrara en prisión. La policía de Fargo, Dakota del Norte, investigaba un caso de fraude en el que el sospechoso había engañado a un banco y robado decenas de miles de dólares usando una identidad falsa de militar. El método de investigación de la policía consistió primero en revisar las cámaras de seguridad, luego consultar a la IA y finalmente arrestar al sospechoso.

Quizás pensaste que se utilizó IA para "refinar" a Sherlock Holmes y que este se convirtió en un detective divino que resolvió el caso mediante un razonamiento lógico riguroso, pero en realidad no es tan "complejo". La policía utilizó un sistema de IA para realizar reconocimiento facial en capturas de video de vigilancia y luego filtró sospechosos en una base de datos.

El resultado fue que la IA这一次误匹配到了Angela Lipps的照片. Luego, esta información se transfirió a la policía que estaba investigando el caso, y el personal cometió un error aún mayor: tras revisar manualmente su licencia de conducir y sus redes sociales, consideraron que las características faciales, la complexión y el peinado eran similares, y por lo tanto la identificaron como sospechosa.

Imagen de GoFundMe

La hermana mayor se sintió completamente desmoronada tras escucharlo y no investigó más pistas, ¿y si hubiera coincidido? Pero lo que venía después fue aún más devastador: tras una secuencia de acciones, no tuvo oportunidad de demostrar su inocencia.

Según los procedimientos locales, no fue llevada directamente a Dakota del Norte para una investigación adicional, sino que esperó en una prisión local en Tennessee. Al ser clasificada como "fugitiva interestatal", no tuvo derecho a fianza ni oportunidad de ser interrogada por la policía, y permaneció encarcelada durante 108 días, desde julio hasta finales de octubre; es difícil imaginar cuán desesperada debió sentirse durante ese tiempo.

Angela Lipps esperó hasta el 30 de octubre, momento en que la llevaron fuera de la prisión para ser trasladada a Dakota del Norte; en ese momento enfrentaba múltiples cargos, y durante el viaje tuvo que llevar esposas y una cadena alrededor de la cintura, lo que, para ella, fue como un desfile público al atravesar el aeropuerto.

Y en realidad, era la primera vez en su vida que volaba en avión.

Lo que no esperaba era que, al llegar a Dakota del Norte, aún tuviera que esperar más. Hasta diciembre no tuvo la oportunidad oficial de explicar el caso; su abogado solicitó directamente sus registros bancarios para comparar las horas, y demostró que en el momento del delito ella estaba comprando pizza en Tennessee, a 1900 kilómetros de distancia, lo que significaba que, a menos que fuera "The Flash", no podía haber cometido el crimen atravesando el tiempo y el espacio.

Solo tardó cinco minutos en aclararle este asunto.

Hasta el 24 de diciembre, sus acusaciones finalmente fueron retiradas, pero no tenía ninguna razón para alegrarse, ya que para entonces la "línea de corte" ya le llegaba a los tobillos.

Angela Lipps pasó su cumpleaños número 50 en la cárcel; durante su encarcelamiento no le permitieron usar sus dentaduras postizas, comía alimentos procesados y sufrió grandes presiones psicológicas, lo que provocó un aumento de peso considerable. Antes de ingresar a la prisión, llevaba ropa de verano; al salir, ya era invierno y no tenía ni un abrigo grueso, lo que hacía difícil incluso mantenerse caliente, por no hablar de regresar a casa. En ese momento, la policía no le proporcionó ningún dinero para el viaje; tras su liberación, quedó atrapada en Dakota del Norte, así como en el día en que fue injustamente acusada por una IA.

Pero afortunadamente, hubo alguien amable que la ayudó.

Su abogado le organizó una estancia temporal en un hotel y le consiguió algo de comida para superar los momentos más difíciles; una organización sin fines de lucro local la rescató y la devolvió a su hogar en Tennessee.

Pero volver a casa y reiniciar la vida fue igual de difícil que el infierno. Durante su tiempo en la prisión, su situación económica se desmoronó: perdió el apartamento alquilado, su perro murió, e incluso su auto y todo lo que guardaba dentro desapareció. Sus pertenencias personales habían sido almacenadas temporalmente en un depósito, pero más tarde, al no poder pagar el alquiler, todos sus artículos domésticos fueron retirados. Incluso sus relaciones personales estuvieron en peligro, ya que los vecinos la vieron ser arrestada y “desaparecer” durante seis meses, creyendo que realmente había cometido un delito.

Al mismo tiempo, su increíble experiencia se propagó rápidamente por la red y generó una ola de críticas. Muchas personas expresaron su incredulidad, señalando que en Estados Unidos algunos pueden realizar “compras gratuitas”, pero tan pronto como toques los bancos de los capitalistas, serás arrestado al instante, incluso si no fuiste tú quien lo hizo.

Debido a que el asunto se volvió demasiado grande, su situación desesperada volvió a tener una oportunidad y recibió más ayuda; actualmente ya ha recaudado 80,000 dólares en donaciones mediante crowdfunding, lo cual es suficiente para reiniciar su vida y negocio.

Pero ahora la mayor expectativa de los internautas es que contrate un equipo de abogados y los demande con todo su poder, posiblemente ganando el juicio y obteniendo otra compensación.

Ya que esto no fue un error fortuito de la policía, antes ya se habían producido numerosos casos de injusticia, algunos de los cuales fueron aún peores que el de ella.

II. Momentos de ciencia ficción aterradores causados por "errores" de IA

La experiencia de Angela Lipps ya se ha repetido más de diez veces en diferentes regiones, e incluso ha ocurrido en otros países.

Por ejemplo, Robert Williams fue uno de los primeros víctimas de este tipo de eventos; en 2020, la policía lo arrestó frente a su esposa e hija, y lo mantuvo detenido durante 30 horas, a pesar de que era 20 centímetros más alto que el verdadero culpable.

Otro Chris Gatlin también es una de las personas más desafortunadas; la IA lo identificó como sospechoso potencial en el caso de agresión en el metro basándose en imágenes borrosas de vigilancia, y así fue encarcelado sin juicio durante 17 meses, convirtiéndose en la persona inocente con el período de detención más largo hasta la fecha. Lo absurdo es que, hasta el final, los investigadores descubrieron que existía un dispositivo de grabación de la policía que podría haber servido como evidencia clave, pero el sospechoso en las grabaciones no tenía ninguna similitud con él.

En 2023, Porcha Woodruff experimentó la misma situación; la policía la acusó de supuestamente cometer el delito de robo de vehículo. Al escucharlo, se rió con ira, pensando que la policía bromeaba, ya que en ese momento estaba embarazada de ocho meses y no parecía en absoluto capaz de cometer el acto. Sin embargo, fue arrestada y mantenida en custodia durante más de diez horas, y posteriormente perdió el juicio.

Este año, un joven británico llamado Alvi Choudhury también fue arrestado por una situación similar, acusado de "robo con allanamiento de morada"; sin embargo, según las pruebas, el delito se cometió "a distancia", un escenario también documentado en películas. La IA identificó una foto suya tomada cuando fue detenido en 2021; cuando la policía vio al hombre en persona, se rieron, ya que parecía al menos 10 años más viejo que el sospechoso.

Imagen de The Mind Transmitter

En 2022, el empresario indio Praveen Kumar fue detenido mientras viajaba a Suiza, tras una escala en Abu Dhabi, donde una IA lo emparejó con un delincuente buscado. Las autoridades locales lo interrogaron extensamente, pero finalmente determinaron que no era el sospechoso y lo deportaron de regreso a la India, donde fue detenido dos veces consecutivas en el aeropuerto.

En este tipo de eventos, el más absurdo fue sin duda el caso del científico ruso Alexander Tsvetkov, quien fue arrestado y mantenido en prisión durante 10 meses porque una IA dijo que se parecía a un asesino.

Este científico podría decirse que sufrió una doble acusación falsa por parte de la IA y los humanos. En febrero de 2023, al finalizar su investigación científica y regresar a Rusia, fue arrestado apenas bajó del avión. La razón fue que la IA mostró un 55% de similitud entre su rostro y el retrato robot del sospechoso de un caso de asesinatos en serie ocurrido hace más de veinte años; además, en este caso había un testigo colaborador que dio testimonio falso intencionalmente para reducir su pena y lo acusó. Lo grave es que la policía no realizó una investigación detallada y lo arrestó así como así.

Después de ser detenido, al principio creyó que se trataba de un malentendido pequeño, pero la investigación no logró cerrarse durante mucho tiempo. Bajo una enorme presión psicológica y problemas de salud, llegó a confesar falsamente, y luego retiró su confesión. Afortunadamente, su esposa y sus colegas del instituto siempre lucharon por él, reuniendo innumerables documentos que demostraban que, en el año del incidente, él estaba realizando una investigación en otra ciudad. Con la cobertura mediática, el caso fue ampliamente discutido por el público, y recién en diciembre surgieron signos de cambio; los cargos fueron formalmente retirados en febrero de 2024.

Y estos tipos de casos, a medida que la IA evoluciona, ocurren con mayor frecuencia, pareciendo más bien que la IA está "dirigiendo", mientras que algunas personas se convierten en máquinas ejecutoras.

Tres: La enfermedad profesional de "lo que dice la IA es lo que cuenta"

La sensación abstracta de "intercambio de roles" surge porque tanto la IA como los humanos pueden fallar; incluso la IA más poderosa puede cometer errores, y los humanos siempre están dispuestos a "echarse atrás".

Tomemos el sistema Clearview AI de Estados Unidos: fue precisamente él quien envió a la mujer del inicio del artículo a la cárcel, pero no es un software de baja calidad. Clearview AI afirma poseer la base de datos de imágenes más grande del mundo, recolectando frenéticamente miles de millones de imágenes a pesar de las multas en múltiples países; más de 3,000 agencias de aplicación de la ley en Estados Unidos lo utilizan, y el año pasado firmó un contrato de 9.2 millones de dólares con ICE.

Pero, en términos sencillos, Clearview AI es un "motor de búsqueda de rostros": al usarlo, subes una imagen, se empareja con su base de datos y te devuelve una serie de imágenes similares; finalmente, tú debes determinar si se trata de la persona que buscas.

Aunque el avance de la IA en estos años ha sido rápido, la "precisión" sigue siendo controvertida, ya que siempre existen diferencias entre los datos de prueba de experimentos y las condiciones reales al usar búsqueda de imágenes.

Por ejemplo, en la mayoría de los casos, las imágenes de vigilancia encontradas por la policía tienen una calidad similar a las tomadas con un teléfono fijo, además de factores como iluminación extraña, ángulos difíciles y obstrucciones en la cara, lo que hace que el reconocimiento sea realmente difícil; las imágenes en la base de datos podrían ser antiguas, y el resultado de coincidencia podría ser simplemente que dos personas se parecen físicamente.

Y cuando estos errores se aplican a personas reales, naturalmente sufren.

¿Es un cuervo o un gato?

En teoría, si solo es el AI el que de vez en cuando tiene un fallo, aún hay esperanza, porque estos son solo “clues”, y las “conclusiones” finales aún requieren supervisión humana, pero muchas veces las personas son aún más “extravagantes” que el AI.

Hace unos años, ya había quien criticaba que la policía estadounidense se dejaba guiar por la IA, cayendo en el sesgo de automatización, es decir, confiando excesivamente en los resultados proporcionados por la IA. Si la IA decía que ambas personas coincidían, los humanos lo aceptaban; que la estatura no coincidiera no era problema mío, aunque hubiera un alibi, mi única tarea era arrestar; cualquier otra evidencia que se discuta con la prisión, omitiendo los pasos básicos de investigación y haciendo que otros “se salten la vida”.

En realidad, los humanos conocen muy bien las deficiencias de la IA; después de pagar una gran cantidad de dinero, muchas regiones de Estados Unidos han establecido “líneas de defensa”, como requerir evidencia independiente además de las pistas proporcionadas por la IA en las investigaciones, e incluso algunas áreas han prohibido directamente el uso de tecnologías de IA para resolver crímenes.

Pero estas restricciones no pueden resistir lo extremadamente útil que es la IA. Aunque existe la posibilidad de fallar, claramente los éxitos son más frecuentes. A veces, las pistas que la policía encuentra con gran esfuerzo son simplemente una foto de vigilancia de nivel "cerradura", y con gran probabilidad intentarán usar la IA para probar suerte. Ya en 2023 se informó que la policía estadounidense realizó más de un millón de búsquedas con Clearview AI, e incluso después de que se prohibiera oficialmente su uso, lo seguían utilizando en secreto; de todos modos, podían decir que no lo habían usado. Si no podían usar ese software, cambiaban por otro; si estaba prohibido localmente, pedían a otras instituciones que lo usaran por ellos, simplemente se volvieron adictos.

Entonces, una vez que la IA proporciona una pista poco confiable y luego el ser humano se ahorra el esfuerzo de investigar, la combinación de ambos genera inevitablemente un error judicial.

En los últimos años, sistemas como el Smart Sampa en Brasil también han enfrentado problemas similares. En 2024, São Paulo, Brasil, lanzó el sistema policial de reconocimiento facial con IA más grande de América Latina, que supuestamente está conectado a 40,000 cámaras.

La buena noticia es que el efecto es realmente potente: en los últimos años, se han capturado al instante a casi cuatro mil delincuentes y se han recuperado a más de tres mil fugitivos; los robos disminuyeron casi un 15% en 2025, convirtiéndose en una “línea de producción para capturar ladrones”.

La mala noticia es que al menos 59 personas fueron confundidas.

Entre ellos hay casos abstractos, como un paciente psiquiátrico que fue llevado como un criminal desde el hospital, y luego fue liberado al descubrirse que su orden de arresto había expirado. También hubo un hombre que fue arrestado cuatro veces en siete meses porque la IA lo confundió con un asesino prófugo. Cada vez era llevado de vuelta a la comisaría y liberado inmediatamente, pero unos días después volvía a ocurrir; ya estaba tan asustado que se había acostumbrado.

Antes, cuando hablábamos sobre qué trabajos no podrían ser reemplazados por la IA, decíamos que la IA no podía ir a la cárcel en lugar de una persona, pero nunca habíamos pensado en el otro lado de esta pregunta: ahora puede hacer que las personas "vayan a la cárcel".

Antes, esta frase era un chiste, pero ahora ya casi no es noticia. De hecho, no solo el reconocimiento facial, sino también la IA en el reconocimiento de objetos a veces puede sorprender.

El año pasado, un sistema de seguridad con IA en una escuela secundaria de Estados Unidos identificó incorrectamente el paquete de papas fritas que un joven llevaba en la mano como una “arma potencial”, activando una alarma. Llegaron ocho patrullas y inmediatamente lo controlaron; después de registrarlo, encontraron la bolsa de snacks en la basura. La situación fue muy incómoda, y el joven creyó que no sobreviviría.

No digas que no lo digas

¿Quién hubiera pensado que cuanto más fuerte sea la IA, más grandes serán los problemas que algunas personas causan con ella? Antes, la IA era torpe, confundía imágenes y todo el mundo se reía de ello. Ahora, la IA es poderosa, se equivoca al identificar a una persona y hace que un humano pase seis meses en la cárcel. En el futuro, por favor, no inventen cosas abstractas como juicios de IA, abogados de IA o tribunales de energía renovable. En última instancia, la IA es solo una herramienta; lo crucial sigue siendo la capacidad y el propósito del usuario, o dicho de otro modo: cuanto más fuerte sea la IA, menos podemos permitirnos ser perezosos.

En resumen, al principio uno extraña un poco a esa IA torpe.

Este artículo proviene del canal de WeChat "CoolPlay Lab", autor: CoolPlay Lab