SN24 lanza la arquitectura Quasar-3B: Cómo Bittensor TAO desafía a OpenAI en IA de contexto largo

2026/04/21 07:00:03

Introducción

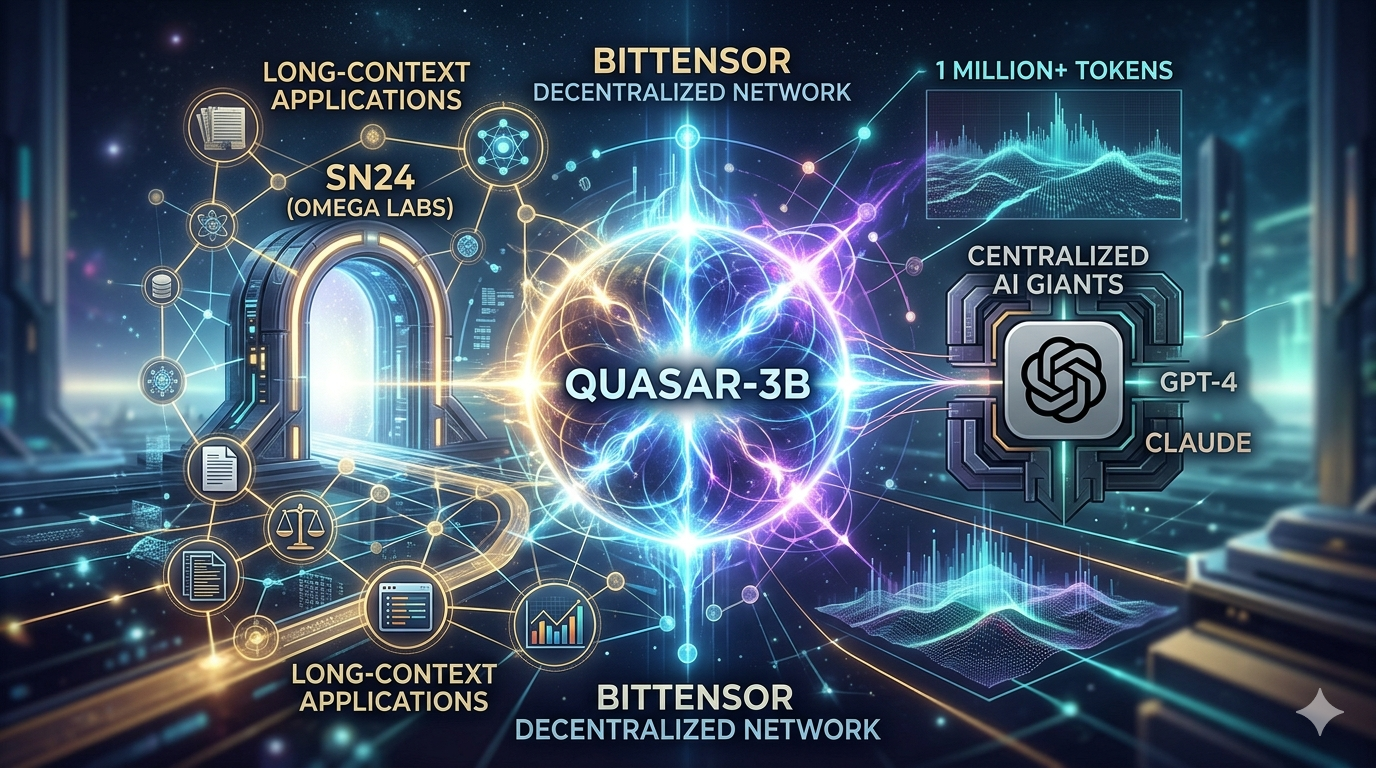

El panorama de la inteligencia artificial presenció un desarrollo significativo en abril de 2026 cuando SN24 (OMEGA Labs) anunció el lanzamiento de Quasar-3B, un transformador de tiempo continuo con bucle específicamente diseñado para inteligencia de contexto largo.

Este anuncio representa más que un hito técnico: señala la seria intención de Bittensor de competir directamente con gigantes de IA centralizados como OpenAI en una de las dimensiones de capacidad más críticas: la capacidad de procesar y razonar a través de contextos extendidos. Con el panorama de IA de contexto largo evolucionando rápidamente, la competencia por construir modelos que puedan procesar eficazmente millones de tokens se ha convertido en una de las batallas más consecuentes en el desarrollo de la IA. El enfoque descentralizado de Bittensor a través de Quasar-3B de SN24 ahora ingresa a este ámbito, desafiando la suposición de que solo las corporaciones centralizadas masivas pueden empujar los límites de lo que los modelos de IA pueden lograr. La pregunta ya no es si la IA descentralizada puede competir, sino cuán rápido puede cerrar la brecha con los jugadores establecidos.

Este artículo de pilar explora cómo encaja Quasar-3B en el contexto más amplio del ecosistema de Bittensor. Para lectores nuevos en este ámbito, tres temas fundamentales proporcionan el contexto esencial:

-

comprender What Is SN24 y su papel en la red Bittensor,

-

explorando Why Is Long-Context AI Important y sus aplicaciones transformadoras en diversas industrias;

-

y comparando How Does Bittensor's Decentralized Approach con el desarrollo de IA centralizado tradicional.

¿Qué es Quasar-3B: la respuesta de SN24 a los desafíos de contexto largo

Quasar-3B representa la solución de OMEGA Labs a una de las limitaciones más persistentes de la IA: la degradación de la ventana de contexto. Cuando la mayoría de los modelos procesan documentos que exceden su longitud de contexto de entrenamiento, la precisión disminuye significativamente. La investigación sugiere que Claude pierde más del 30% de su precisión después de 1 millón de tokens. Esta limitación restringe fundamentalmente lo que los sistemas de IA pueden lograr en aplicaciones prácticas.

El nombre de la arquitectura "Quasar" evoca el fenómeno astronómico: objetos de inmensa brillantez visibles a través de vastas distancias. De manera similar, Quasar-3B busca iluminar contextos extensos, permitiendo que la IA "vea" a través de millones de tokens con precisión mantenida. La designación "3B" se refiere al número de parámetros del modelo, con "1B Active" que indica que mil millones de parámetros permanecen activamente involucrados durante el procesamiento.

Innovaciones arquitectónicas clave distinguen a Quasar-3B de los transformadores convencionales. El diseño de transformador de tiempo continuo con bucle permite que el modelo mantenga el flujo de información a través de secuencias extendidas sin la degradación típica que ocurre cuando los modelos procesan contexto más allá de su rango optimizado. Esta elección arquitectónica aborda la limitación fundamental que ha restringido la competencia entre Bittensor y OpenAI en aplicaciones de contexto largo.

Para comprender la posición estratégica de SN24 dentro del ecosistema más amplio, es útil examinar lo que logra la subred, operando como una de las unidades especializadas de Bittensor enfocadas en avanzar las capacidades de contexto largo de la red, mientras contribuye al conjunto de datos multimodal descentralizado más grande del mundo.

La arquitectura técnica: cómo Quasar-3B logra contexto extendido

Comprender la arquitectura técnica de Quasar-3B requiere examinar por qué el procesamiento de contextos largos ha resultado tan desafiante para los sistemas de IA. Los modelos transformer tradicionales utilizan mecanismos de atención que escalan cuadráticamente con la longitud de la secuencia: duplicar la longitud del contexto cuadruplica los requisitos computacionales. Esta realidad matemática ha hecho que el procesamiento de contextos extendidos sea prohibitivamente costoso para la mayoría de las aplicaciones.

El enfoque de transformador de tiempo continuo con bucle de Quasar-3B aborda este desafío de escalado mediante innovaciones arquitectónicas que mantienen la eficiencia computacional incluso cuando la longitud del contexto se extiende. El modelo logra esto a través de varios mecanismos. En primer lugar, la modelización de tiempo continuo permite al sistema procesar la información como un flujo continuo en lugar de bloques discretos, reduciendo la sobrecarga asociada con el fragmentado. En segundo lugar, la arquitectura con bucle crea rutas de retroalimentación que permiten que la información persista a través de secuencias extendidas sin un aumento proporcional en el cómputo. En tercer lugar, las tuberías de inferencia optimizadas aseguran que esta capacidad extendida se traduzca en aplicaciones prácticas.

Los resultados de la prueba de referencia han atraído una atención significativa dentro de la comunidad de investigación en IA. Según el anuncio en X del equipo Quasar, el modelo demuestra un rendimiento competitivo en las evaluaciones de LongBench, la prueba de referencia estándar para las capacidades de IA con contexto largo. Mientras los números detallados de las pruebas de referencia siguen surgiendo a medida que el modelo pasa por pruebas comunitarias, los indicadores iniciales sugieren un progreso significativo hacia el objetivo de mantener la precisión a través de millones de tokens.

La implementación a través de la infraestructura de subredes de Bittensor ofrece ventajas adicionales. Las 128 subredes activas de la red permiten una optimización especializada para distintos aspectos del procesamiento de contextos largos. Las subredes enfocadas en recuperación, procesamiento y validación pueden trabajar en conjunto con Quasar-3B para ofrecer capacidades que requerirían un esfuerzo de ingeniería significativo para replicar en sistemas centralizados.

Por qué importa la IA de contexto largo para la carrera de la IA

La importancia de la IA de contexto largo va mucho más allá de un logro técnico: representa un cambio fundamental en las capacidades que permite categorías completamente nuevas de aplicaciones. Para empresas e investigadores que trabajan con grandes conjuntos de documentos, procedimientos legales, bases de código o archivos de investigación, la capacidad de procesar conjuntos de datos completos en contexto transforma lo que se vuelve posible.

Los enfoques tradicionales de IA requerían dividir documentos grandes en fragmentos más pequeños, perdiendo la capacidad de detectar patrones que abarcan todo el conjunto de datos. Un equipo jurídico que revisa una fusión con miles de documentos no podía hacer preguntas que requieran comprender las relaciones entre todos los materiales. Un desarrollador que analiza una base de código de un millón de líneas no podía obtener asistencia de IA que comprenda el contexto completo del sistema. La IA de contexto largo elimina estas limitaciones, permitiendo aplicaciones en jurídico, salud, finanzas e investigación que antes eran impracticables.

El panorama competitivo se ha intensificado a medida que los principales actores reconocen esta dinámica. GPT-4.5 de OpenAI y Claude Opus 4.6 de Anthropic han llevado las ventanas de contexto a 1 millón de tokens, con Gemini alcanzando 2 millones. Estos avances validan la dirección del mercado mientras elevan el nivel para los competidores. La entrada de Bittensor a través de Quasar-3B representa el desafío descentralizado más serio a este espacio.

Para quienes buscan una comprensión más profunda de por qué estas capacidades son importantes y qué industrias se benefician más, el análisis de la IA de contexto largo revela un potencial transformador en el diagnóstico médico, la revisión de documentos legales, el análisis de carteras financieras y la síntesis de literatura académica.

Cómo el modelo descentralizado de Bittensor compite con la IA centralizada

La comparación entre el enfoque descentralizado de Bittensor y el modelo de desarrollo centralizado de OpenAI adquiere nuevas dimensiones con el lanzamiento de Quasar-3B. Comprender cómo se manifiesta la competencia entre Bittensor y OpenAI en la IA de contexto largo requiere examinar múltiples dimensiones de la rivalidad.

Desde una perspectiva de recursos, OpenAI disfruta de ventajas significativas. La asociación de la empresa con Microsoft proporciona acceso a una infraestructura de cómputo masiva. Se informa que los entrenamientos para GPT-4 costaron más de $100 millones. Esta intensidad de capital crea barreras que las redes descentralizadas tienen dificultades para igualar directamente. Sin embargo, el modelo distribuido de Bittensor aprovecha el capital de miles de participantes en lugar de requerir inversión de una sola entidad. El desarrollo de Quasar-3B demuestra que una capacidad de IA significativa puede surgir de este modelo distribuido.

Las estructuras de incentivos difieren fundamentalmente. Los beneficios del desarrollo de OpenAI fluyen principalmente a la empresa y sus inversores. Los empleados e investigadores reciben compensación, pero no participan en la creación de valor a largo plazo. El modelo cripto-económico de Bittensor significa que los contribuyentes al desarrollo de Quasar-3B ganan tokens TAO que aumentan su valor a medida que crece la red. Esta alineación crea patrones de motivación diferentes que pueden impulsar la innovación a través de la competencia.

La arquitectura demuestra cómo las redes descentralizadas pueden especializarse de manera efectiva. En lugar de desarrollar capacidades de propósito general que intentan serlo todo para todos, las subredes pueden centrarse en desafíos específicos. Quasar-3B se enfoca exclusivamente en el procesamiento de contextos largos, optimizando profundamente esta capacidad en lugar de distribuir recursos en mejoras generales.

Para los lectores interesados en comprender los compromisos de escalabilidad entre estos enfoques, la comparación detallada muestra que cada modelo presenta ventajas distintas según los requisitos del caso de uso.

Las comparaciones de rendimiento siguen evolucionando a medida que ambos enfoques maduran. Los modelos de OpenAI actualmente lideran en los benchmarks de capacidad general. Las subredes de Bittensor han demostrado un rendimiento competitivo en tareas específicas. La dimensión de contexto largo representa un ámbito donde Bittensor potencialmente puede liderar en lugar de seguir, dadas las innovaciones arquitectónicas como el diseño de transformador de tiempo continuo de Quasar-3B.

La importancia estratégica para TAO y el ecosistema Bittensor

El lanzamiento de Quasar-3B tiene implicaciones significativas para el ecosistema de Bittensor en su conjunto y especialmente para el token TAO. Comprender estas implicaciones requiere examinar cómo el sistema de subred crea valor para toda la red.

Las subredes dentro de Bittensor operan como mercados especializados, cada una enfocada en diferentes capacidades de IA. El éxito de las subredes individuales contribuye al valor general de la red a través de varios mecanismos. Primero, las subredes útiles atraen consultas que generan emisiones de TAO. Segundo, las subredes exitosas demuestran la capacidad de la red, atrayendo a más participantes. Tercero, el sistema dTAO significa que la apreciación de los tokens de la subred beneficia a los titulares de TAO a través del mecanismo de maker automático.

El lanzamiento de Quasar-3B fortalece la red de múltiples maneras. El modelo proporciona una capacidad que anteriormente no estaba disponible en el ecosistema de IA descentralizada, atrayendo a usuarios que necesitan procesamiento de contexto largo. La innovación técnica demuestra que Bittensor puede producir investigación de IA de vanguardia. La atención generada por el lanzamiento valida el enfoque de subred para el desarrollo de IA.

La posición competitiva se vuelve más atractiva con Quasar-3B en producción. Los usuarios empresariales que evalúan opciones de IA ahora tienen una alternativa descentralizada que puede igualar ciertas capacidades de proveedores centralizados. Esta competencia beneficia a todo el mercado mientras potencialmente capta valor para el ecosistema Bittensor.

Para los inversores que evalúan TAO, el lanzamiento de Quasar-3B representa un punto de prueba para la tesis de inversión. La capacidad de desarrollar modelos de IA competitivos mediante coordinación descentralizada valida el enfoque fundamental. Futuros lanzamientos de subredes pueden señalar a Quasar-3B como evidencia de que la red puede competir con el desarrollo centralizado de IA.

Aplicaciones del mundo real habilitadas por la capacidad de contexto largo de Quasar-3B

Las aplicaciones prácticas de la capacidad de contexto extendido de Quasar-3B abarcan industrias y casos de uso que anteriormente eran impracticables para la asistencia de IA. Comprender estas aplicaciones demuestra por qué la carrera por el contexto largo importa más allá del logro técnico.

Las aplicaciones en la industria legal cambian cuando se pueden procesar archivos de caso completos en contexto. En lugar de revisar documentos individuales de forma aislada, los abogados pueden consultar historiales de litigio completos, identificando patrones y precedentes en todos los materiales. El análisis de contratos puede rastrear obligaciones y dependencias a través de bibliotecas enteras de acuerdos. La debida diligencia puede incorporar documentación empresarial completa en un solo análisis.

El desarrollo de software se beneficia de comprender bases de código completas en su contexto. Las auditorías de seguridad pueden analizar repositorios completos, identificando vulnerabilidades que abarcan múltiples archivos. La revisión de código puede comprender el contexto completo de los cambios, no solo los diffs en aislamiento. La generación de documentación puede incorporar una comprensión integral de la arquitectura del sistema.

El análisis financiero alcanza una nueva sofisticación con contexto histórico completo. El análisis de cartera puede incorporar décadas de datos del mercado. La evaluación de riesgos puede analizar posiciones en carteras completas simultáneamente. La investigación puede sintetizar historiales completos de ganancias y presentaciones regulatorias.

Las aplicaciones de salud permiten un análisis exhaustivo del paciente. El diagnóstico puede considerar historias médicas completas que abarcan años. La investigación puede analizar conjuntos de datos completos de ensayos clínicos. El cumplimiento normativo puede procesar marcos de políticas integrales.

La investigación académica se transforma cuando se pueden abordar cuerpos completos de literatura. La revisión de la literatura puede sintetizar hallazgos a lo largo de décadas de publicaciones. La investigación interdisciplinaria puede conectar ideas entre campos. El análisis de becas puede evaluar historiales completos de propuestas.

La industria de la cadena de bloques se beneficia específicamente de estas capacidades. La auditoría de contratos inteligentes puede analizar implementaciones completas de protocolos. El análisis DeFi puede evaluar interacciones del ecosistema de manera integral. El análisis on-chain puede incorporar historiales de transacciones completos.

Hoja de ruta futura: ¿Qué viene después para SN24 y Quasar?

El lanzamiento de Quasar-3B representa un hito más que un destino final. Según la información de la documentación de la subred, la hoja de ruta se extiende hasta 2026 y más allá con múltiples fases de desarrollo.

El Q4 2025 vio el lanzamiento inicial del subnet en la testnet de Bittensor, la implementación de la evaluación LongBench, el despliegue del modo mock y la integración del monitoreo de WandB. Estos elementos fundamentales establecieron la infraestructura para el desarrollo continuo.

El Q1 2026 se centró en expandir las capacidades de contexto largo y mejorar las métricas de evaluación. El anuncio de Quasar-3B en abril de 2026 representa el resultado de estos esfuerzos, pero la mejora continua sigue siendo el foco.

Los desarrollos esperados para el resto de 2026 incluyen variantes adicionales del modelo optimizadas para distintos casos de uso, longitudes de contexto ampliadas más allá de las capacidades actuales, la integración con otras subredes de Bittensor para una entrega de capacidades mejorada, y mejoras impulsadas por la comunidad a través del mecanismo de incentivos.

La presión competitiva de los proveedores centralizados de IA garantiza la innovación continua en toda la industria. A medida que OpenAI, Anthropic y Google amplían las ventanas de contexto, los competidores descentralizados deben igualar este progreso y demostrar ventajas distintivas. El enfoque de Bittensor de especialización a través de subredes proporciona un marco para esta competencia continua.

Para el movimiento más amplio de inteligencia artificial descentralizada, Quasar-3B representa un punto de prueba. La demostración de que capacidades de IA competitivas pueden surgir de redes descentralizadas valida la tesis fundamental. Proyectos futuros pueden construir sobre esta base, acelerando potencialmente el desarrollo de alternativas de IA descentralizadas.

¿Debería invertir en TAO en KuCoin?

Para los operadores que evalúan la exposición al ecosistema de Bittensor, el lanzamiento de Quasar-3B proporciona contexto adicional para las decisiones de inversión.

Consideraciones alcistas

-

Validación competitiva: Quasar-3B demuestra que Bittensor puede desarrollar capacidades de IA de vanguardia, validando el enfoque descentralizado

-

Oportunidad de mercado de largo contexto: El mercado de IA de contexto extendido representa una oportunidad significativa y en crecimiento valorada en miles de millones

-

Fuerza del ecosistema de subred: El éxito de Quasar-3B de SN24 fortalece el ecosistema de subredes en general

-

Diferenciación técnica: Innovaciones arquitectónicas como transformadores de tiempo continuo ofrecen capacidades distintivas

Factores de riesgo

-

Competencia centralizada: Las principales empresas tecnológicas continúan invirtiendo miles de millones en IA de contexto largo, posiblemente superando a las alternativas descentralizadas

-

Incertidumbre en la ejecución: Traducir innovaciones arquitectónicas en aplicaciones prácticas requiere una ejecución continua

-

Entorno regulatorio: Tanto las criptomonedas como la IA enfrentan marcos regulatorios en evolución a nivel global

-

Volatilidad del mercado de criptomonedas: TAO sigue siendo altamente volátil en comparación con los activos tradicionales

Marco Estratégico

El lanzamiento de Quasar-3B representa un desarrollo significativo para el ecosistema de Bittensor, pero debe evaluarse dentro del contexto general de la cartera. Considere el tamaño de la posición basándose en la convicción en la tesis de IA descentralizada, manteniendo una gestión de riesgo adecuada dada la volatilidad del mercado de criptomonedas.

Cómo operar con TAO en KuCoin

Paso 1: Crea tu cuenta KuCoin

Si estás listo para operar con TAO, el primer paso es crear tu cuenta de KuCoin. Los nuevos usuarios pueden registrarse en KuCoin y obtener hasta 11.000 USDT en recompensas para nuevos usuarios: un bono sustancial que puede aumentar tu capital inicial para operar. Simplemente visita el sitio web de KuCoin o descarga la aplicación móvil, completa el proceso de registro con tu correo electrónico o número de teléfono y verifica tu identidad para activar estas recompensas. El proceso de registro tarda solo unos minutos, y el bono de bienvenida ofrece un excelente punto de partida para explorar oportunidades de operación con TAO.

Paso 2: Ejecuta tu operación

Una vez que tu cuenta esté configurada, busca "TAO/USDT" en la interfaz de operaciones de KuCoin. TAO generalmente ofrece buena liquidez para la mayoría de los tamaños de posición, aunque la liquidez puede variar según las condiciones del mercado. Durante períodos de alta volatilidad alrededor de anuncios importantes, como el lanzamiento de Quasar-3B, considera usar órdenes de límite en lugar de órdenes de mercado para gestionar el deslizamiento. Evalúa tu punto de entrada según las condiciones actuales del mercado y tu tolerancia al riesgo antes de ejecutar la operación.

Paso 3: Gestión de posición

Dada la volatilidad inherente a los activos cripto de IA, establezca objetivos de ganancias claros y niveles de stop-loss antes de entrar en una posición. Monitoree los desarrollos de SN24, los lanzamientos más amplios de subredes de Bittensor y el panorama competitivo entre la IA descentralizada y centralizada. Ajuste su posición según la evaluación continua de la tesis, no según respuestas emocionales a los movimientos de precios.

Conclusión

El lanzamiento de Quasar-3B por SN24 representa un momento decisivo para la inteligencia artificial descentralizada. Al demostrar que Bittensor puede desarrollar capacidades competitivas de IA con contexto prolongado a través de su red distribuida, el proyecto desafía las suposiciones sobre quién puede empujar los límites de la inteligencia artificial. Las innovaciones arquitectónicas en el transformador de tiempo continuo con bucle de Quasar-3B proporcionan una base para el avance continuo.

La dinámica competitiva entre la inteligencia artificial descentralizada y centralizada sigue evolucionando. OpenAI conserva ventajas en capital y escala. Sin embargo, la alineación de incentivos de Bittensor, su especialización a través de subredes y la participación global generan ventajas distintas. La competencia entre Bittensor y OpenAI se ha vuelto más interesante con este desarrollo.

Para la industria de la IA en general, la coexistencia de múltiples enfoques beneficia a todos. La competencia impulsa la innovación, mientras que la diversidad aporta resiliencia. La demostración de que las redes descentralizadas pueden competir valida estructuras de desarrollo alternativas.

Para los inversores, el lanzamiento de Quasar-3B proporciona evidencia que respalda la tesis de inversión en Bittensor. Sin embargo, el tamaño de la posición debe reflejar la adopción de tecnología en etapas iniciales y la volatilidad del mercado de criptomonedas.

Preguntas frecuentes

¿Qué es Quasar-3B?

A: Quasar-3B es un modelo de IA de contexto largo lanzado por SN24 (OMEGA Labs) en la red Bittensor en abril de 2026. Utiliza una arquitectura de transformador de tiempo continuo con bucle diseñada para un razonamiento eficiente a través de millones de tokens. El "3B" se refiere a 3 mil millones de parámetros, con 1 mil millones activos durante el procesamiento.

P: ¿Cómo se compara Quasar-3B con los modelos de contexto largo de OpenAI?

A: Quasar-3B está específicamente diseñado para abordar el desafío del contexto largo mediante innovaciones arquitectónicas que mantienen la precisión en secuencias extendidas. Aunque continúan surgiendo comparaciones detalladas de benchmarks, el modelo demuestra un rendimiento competitivo en las evaluaciones de LongBench. El modelo de desarrollo descentralizado ofrece ventajas diferentes a la aproximación centralizada de OpenAI.

Q: ¿Qué hace que la arquitectura Quasar sea diferente de los transformadores tradicionales?

A: Quasar utiliza un diseño de transformador de tiempo continuo con bucle que permite que la información fluya a través de secuencias extendidas sin un aumento proporcional en el cómputo. Esto resuelve el problema de escalado cuadrático que hace que la extensión del contexto en transformadores tradicionales sea costosa.

P: ¿Cómo se integra SN24 en el ecosistema más amplio de Bittensor?

A: SN24 (OMEGA Labs) es una de las 128 subredes activas de Bittensor, enfocada en crear el mayor conjunto de datos multimodal descentralizado del mundo. La subred contribuye al ecosistema tanto a través de la infraestructura de datos como a través de capacidades de IA como Quasar-3B.

¿Cuáles son las aplicaciones del mundo real para Quasar-3B?

A: Las aplicaciones incluyen análisis de documentos legales en archivos de casos completos, auditoría de seguridad de software en bases de código completas, análisis financiero que incorpora décadas de datos de mercado, análisis sanitario en historias clínicas completas de pacientes y síntesis de investigación académica en cuerpos completos de literatura.

Aviso: Esta página fue traducida utilizando tecnología de IA (impulsada por GPT) para tu conveniencia. Para obtener la información más precisa, consulta la versión original en inglés.