¿Cómo se diferencian los agentes de IA de autoaprendizaje de los modelos tradicionales de aprendizaje automático y de los agentes basados en LLM actuales?

2026/05/02 07:21:02

Introducción

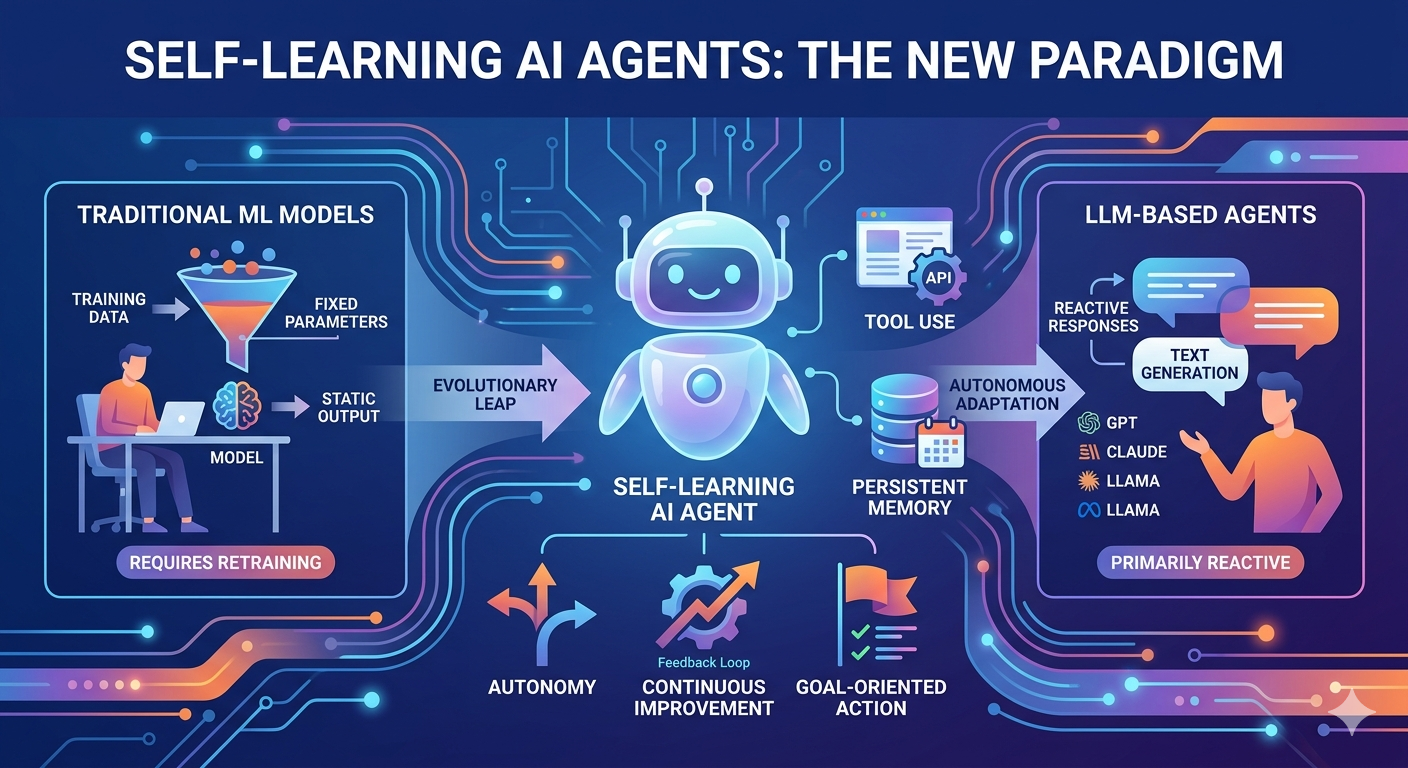

El panorama de la inteligencia artificial está experimentando una transformación profunda. Si bien los modelos tradicionales de aprendizaje automático dominaron la última década y los modelos de lenguaje grandes captaron la atención del mundo desde 2022, está surgiendo un nuevo paradigma que cambia fundamentalmente cómo operan los sistemas de IA. Los agentes de IA de autoaprendizaje representan el siguiente salto evolutivo, combinando autonomía, razonamiento adaptativo y mejora continua de maneras que los distinguen claramente tanto de sus predecesores como de los sistemas actuales basados en LLM. Comprender estas diferencias es esencial para cualquiera que busque navegar el ecosistema de IA en rápida evolución.

¿Qué son los agentes de IA de autoaprendizaje?

Los agentes de IA de autoaprendizaje son entidades computacionales autónomas capaces de percibir su entorno, analizar información, formular decisiones y ejecutar acciones para lograr objetivos específicos. A diferencia de los sistemas de IA convencionales que requieren indicaciones humanas en cada paso, los agentes de autoaprendizaje pueden recibir un objetivo de alto nivel y determinar independientemente cómo lograrlo. Estos agentes combinan capacidades de percepción, razonamiento, aprendizaje y acción para simular un comportamiento inteligente anteriormente visto solo en sistemas biológicos.

Las características definitorias de los agentes de IA de autoaprendizaje incluyen autonomía, reactividad, proactividad y capacidad social. La autonomía permite que los agentes operen de forma independiente sin intervención humana continua. La reactividad les permite percibir cambios en el entorno y responder adecuadamente. La proactividad significa que no solo reaccionan a estímulos, sino que persiguen activamente objetivos mediante planificación. La capacidad social permite la colaboración con otros agentes en sistemas multiagente para completar tareas complejas.

Según las predicciones de IA de Microsoft para 2025, los agentes impulsados por IA están ganando mayor autonomía para ejecutar más tareas, mejorando así la calidad de vida en múltiples dominios. La diferencia clave radica en cómo estos agentes manejan los objetivos: mientras que un modelo de lenguaje grande requiere una solicitud detallada y bien elaborada para producir una salida de calidad, un agente de IA necesita solo un objetivo, y pensará e implementará independientemente las acciones necesarias.

Modelos de aprendizaje automático tradicionales: estructura y limitaciones

Los modelos tradicionales de aprendizaje automático representan un enfoque fundamentalmente diferente de la inteligencia artificial. Estos modelos suelen entrenarse en conjuntos de datos específicos para realizar tareas estrechas y bien definidas, como clasificación, regresión o agrupamiento. Una vez implementados, operan dentro de parámetros fijos y no pueden modificar su comportamiento basándose en nuevas experiencias sin un reentrenamiento explícito.

La arquitectura de los modelos de ML tradicionales se centra en el aprendizaje estadístico a partir de datos históricos. Un modelo aprende patrones durante el entrenamiento y aplica estos patrones aprendidos a nuevas entradas en tiempo de inferencia. Este enfoque funciona excepcionalmente bien para tareas con patrones claros y entradas consistentes, como la detección de spam, la clasificación de imágenes o los sistemas de recomendación. Sin embargo, la naturaleza estática de estos modelos crea limitaciones significativas en entornos dinámicos e impredecibles.

Los modelos tradicionales de ML requieren que ingenieros humanos definan características, seleccionen algoritmos y ajusten hiperparámetros. Cuando la distribución de los datos cambia o los requisitos de la tarea varían, los modelos pueden degradar su rendimiento y requerir un nuevo entrenamiento. El proceso de aprendizaje está esencialmente congelado después del despliegue, lo que significa que estos sistemas no pueden mejorar con la experiencia ni adaptarse a situaciones nuevas sin intervención explícita.

Los equipos de seguridad y cumplimiento suelen utilizar ML tradicional para reconocer patrones en datos estructurados, pero estos sistemas tienen dificultades cuando se enfrentan a tareas que requieren comprensión contextual o razonamiento multietapa. Carecen de la capacidad para planificar, razonar sobre causalidad o descomponer problemas complejos en subtareas más pequeñas y manejables.

Agentes basados en LLM: Capacidades y limitaciones actuales

Los agentes basados en LLM actuales representan un avance significativo respecto al aprendizaje automático tradicional. Construidos sobre modelos de lenguaje grandes con miles de millones de parámetros, estos sistemas pueden comprender el lenguaje natural, generar texto similar al humano y realizar tareas de razonamiento que anteriormente eran imposibles para la IA. Empresas como OpenAI, Anthropic y Google han desarrollado modelos cada vez más capaces que sirven como base para muchas aplicaciones de IA hoy en día.

Los agentes basados en LLM destacan en la comprensión y generación del lenguaje natural. Pueden mantener conversaciones significativas, resumir documentos, escribir código y explicar conceptos complejos. El modelo o1 de OpenAI, por ejemplo, demuestra capacidades avanzadas de razonamiento que le permiten resolver problemas complejos mediante pasos lógicos similares al análisis humano antes de responder preguntas difíciles.

Sin embargo, la mayoría de los agentes basados en LLM actuales son sistemas fundamentalmente reactivos. Responden a los mensajes del usuario, pero no persiguen activamente objetivos ni ejecutan acciones en el mundo. Cuando interactúas con un chatbot, el sistema genera una respuesta basada en tu entrada y sus datos de entrenamiento, pero no toma por sí solo pasos para lograr un objetivo más amplio sin la guía continua del usuario.

Las limitaciones de los agentes basados en LLM se vuelven evidentes cuando las tareas requieren esfuerzo sostenido a través de múltiples pasos, integración con herramientas externas o adaptación basada en retroalimentación. Aunque estos modelos pueden razonar problemas en un solo exchange, a menudo carecen de la capacidad para mantener el estado entre interacciones, ejecutar acciones en sistemas externos o aprender de los resultados de sus decisiones.

Diferencias clave: Agentes de IA de autoaprendizaje vs ML tradicional

Las diferencias entre agentes de IA de autoaprendizaje y modelos tradicionales de aprendizaje automático abarcan arquitectura, capacidad y filosofía operativa. Comprender estas distinciones aclara por qué muchos expertos consideran a los agentes como la próxima frontera en el desarrollo de la IA.

-

Aprendizaje y adaptación

Los modelos tradicionales de ML aprenden durante una fase de entrenamiento fija y luego operan de manera estática. Un modelo de detección de fraude entrenado con datos históricos de transacciones aplicará los mismos patrones indefinidamente a menos que se vuelva a entrenar. En cambio, los agentes de autoaprendizaje pueden aprender continuamente a partir de sus interacciones con el entorno. Observan los resultados de sus acciones, analizan qué funcionó y qué no, y modifican sus estrategias en consecuencia.

-

Autonomía y comportamiento orientado a metas

Los modelos tradicionales de ML son herramientas que los humanos utilizan para realizar tareas específicas. No persiguen objetivos de forma independiente; simplemente procesan entradas y producen salidas según patrones aprendidos. Los agentes de autoaprendizaje son sistemas orientados a objetivos que pueden recibir objetivos de alto nivel y determinar el mejor curso de acción para lograrlos. Descomponen objetivos complejos en subtareas, ejecutan esas subtareas y ajustan su enfoque según el progreso.

-

Uso de herramientas e interacción con el entorno

Los agentes de autoaprendizaje pueden interactuar con herramientas externas, API y sistemas de software. Pueden navegar por internet, manipular archivos, ejecutar código e interactuar con bases de datos. Los modelos tradicionales de ML generalmente no pueden hacer esto; están limitados a las entradas que reciben y las salidas que generan dentro de su propio grafo de cómputo.

-

Comprensión y planificación contextuales

Mientras que el ML tradicional se destaca en el reconocimiento de patrones en datos estructurados, los agentes de autoaprendizaje demuestran capacidades superiores para comprender el contexto y planificar soluciones de múltiples pasos. Un agente con el objetivo de planificar un viaje investigará destinos, comparará precios, verificará disponibilidad y reservará los arreglos: comportamientos imposibles para un modelo de clasificación estático.

Diferencias clave: Agentes de IA de autoaprendizaje frente a agentes basados en LLM

La distinción entre agentes de IA de autoaprendizaje y los agentes basados en LLM actuales es sutil pero consecuente. Ambos pueden utilizar modelos de lenguaje grandes como componentes centrales, pero sus arquitecturas y modos de operación difieren significativamente.

-

Operación reactiva frente a operación proactiva

Los agentes basados en LLM más actuales son sistemas reactivos que generan respuestas a indicaciones. Un usuario hace una pregunta y el modelo proporciona una respuesta. Sin embargo, los agentes de autoaprendizaje pueden operar de forma proactiva. Dado un objetivo, tomarán la iniciativa para recopilar información, elaborar planes y ejecutar acciones sin esperar la entrada humana en cada paso.

-

Gestión de estado y memoria

Los LLM tradicionales tratan cada conversación como sin estado, aunque algunas implementaciones añaden ventanas de contexto. Los agentes de autoaprendizaje incorporan sistemas de memoria sofisticados que mantienen la información entre sesiones, rastrean el progreso hacia los objetivos y permiten aprender de experiencias pasadas. Esta memoria persistente permite a los agentes construir sobre trabajos anteriores en lugar de comenzar desde cero en cada interacción.

-

Integración de herramientas y ejecución de acciones

Los agentes basados en LLM generan principalmente texto, incluso cuando ese texto representa código o comandos. Los agentes de autoaprendizaje están diseñados para ejecutar realmente esos comandos e interactuar con sistemas externos. Operator de OpenAI y Computer Use de Claude representan los primeros pasos en esta dirección, permitiendo que la IA controle navegadores, interfaces de línea de comandos y aplicaciones de software.

-

Adaptación dinámica del flujo de trabajo

Cuando un agente basado en un LLM se encuentra con un obstáculo, generalmente falla o produce un mensaje de error. Un agente de autoaprendizaje puede reconocer cuando su enfoque inicial no está funcionando, analizar por qué y ajustar dinámicamente su estrategia. Esta capacidad para iterar y adaptarse es crucial para manejar tareas complejas del mundo real que rara vez avanzan exactamente como se planeó.

La arquitectura de agentes de autoaprendizaje

Comprender lo que hace diferentes a los agentes de autoaprendizaje requiere examinar su arquitectura subyacente. Estos sistemas combinan múltiples componentes que trabajan juntos para permitir un comportamiento autónomo y adaptativo.

-

Motor de planificación y razonamiento

En el núcleo de un agente de autoaprendizaje se encuentra un motor de razonamiento, generalmente impulsado por un modelo de lenguaje grande, que puede descomponer metas complejas en pasos accionables. Este motor permite al agente planificar, razonar sobre causalidad y evaluar los resultados de acciones potenciales. La investigación de Microsoft indica que los métodos de entrenamiento y las capacidades del agente pueden crear efectos sinérgicos, con modelos mejorados que permiten agentes más efectivos.

-

Sistemas de memoria

Los agentes de autoaprendizaje mantienen varios tipos de memoria: memoria de trabajo a corto plazo para tareas actuales, memoria a largo plazo para conocimientos persistentes y memoria episódica para experiencias pasadas. Estos sistemas de memoria permiten a los agentes aprender a partir de retroalimentación, recordar estrategias exitosas y evitar repetir errores. La sofisticación de estos sistemas de memoria distingue a los agentes verdaderamente de autoaprendizaje de sistemas reactivos más simples.

-

Uso de herramientas e integración de API

Los agentes están equipados con la capacidad de llamar herramientas externas, acceder a bases de datos, navegar por la web e interactuar con aplicaciones de software. Esta capacidad de uso de herramientas extiende el alcance del agente más allá de la generación pura de texto hacia acciones del mundo real. El agente puede seleccionar las herramientas adecuadas según la tarea, ejecutar llamadas a herramientas e incorporar los resultados en su razonamiento.

-

Mecanismos de retroalimentación y aprendizaje

Quizás la característica más distintiva de los agentes de autoaprendizaje sea su capacidad para aprender de la experiencia. Cuando un agente intenta una tarea, puede evaluar el resultado, identificar qué salió mal y modificar su enfoque para futuros intentos. Este aprendizaje puede ocurrir a través de diversos mecanismos, incluyendo el aprendizaje por refuerzo, la autoevaluación y el refinamiento iterativo.

Aplicaciones e implicaciones del mundo real

Las capacidades únicas de los agentes de IA de autoaprendizaje están permitiendo nuevas aplicaciones en diversas industrias. Microsoft informa que casi el 70% de los empleados de las Fortune 500 ya utilizan agentes de Microsoft 365 Copilot para manejar tareas diarias repetitivas, como filtrar correos electrónicos y tomar notas en reuniones durante conferencias de Teams.

En la gestión de la cadena de suministro, los agentes pueden predecir cambios en la demanda de inventario basándose en datos históricos e información en tiempo real, ajustando los planes de adquisición y producción para evitar faltantes o excesos de stock. En el sector de la salud, los agentes pueden analizar casos de pacientes, ofrecer sugerencias de diagnóstico y asistir en la planificación del tratamiento al procesar grandes cantidades de literatura médica y registros de pacientes.

Las implicaciones van más allá de los aumentos de eficiencia. Los agentes de autoaprendizaje están transformando la forma en que se realiza el trabajo basado en conocimiento. En lugar de que los humanos aprendan a usar herramientas de IA, el paradigma está cambiando hacia agentes de IA que aprenden a asistir a los humanos de manera más efectiva. Esto representa un cambio fundamental en la relación humano-IA, pasando de humanos que operan herramientas a humanos que supervisan y colaboran con agentes autónomos.

¿Cómo pueden las organizaciones prepararse para la era de los agentes?

Las organizaciones que buscan aprovechar agentes de IA de autoaprendizaje deben comenzar identificando casos de uso de alto valor donde las capacidades de los agentes puedan ofrecer ventajas significativas sobre enfoques tradicionales. Las tareas que involucran procesos de múltiples pasos, integración con sistemas externos o entornos dinámicos son candidatos ideales para la implementación de agentes.

La infraestructura técnica debe evolucionar para respaldar el funcionamiento de los agentes. Esto incluye integraciones API sólidas, acceso seguro a herramientas y sistemas de monitoreo que puedan rastrear el rendimiento de los agentes y detectar problemas. Las organizaciones también deben establecer marcos de gobernanza que definan límites adecuados para la autonomía de los agentes, asegurando al mismo tiempo el cumplimiento de las regulaciones relevantes.

Invertir en la alfabetización de agentes en toda la organización se vuelve esencial a medida que estos sistemas se vuelven más prevalentes. Los empleados necesitan comprender cómo funcionan los agentes, cómo brindar orientación efectiva y cómo evaluar y mejorar los resultados de los agentes. El cambio requiere no solo una inversión técnica, sino también una adaptación cultural.

Conclusión

Los agentes de IA de autoaprendizaje representan un avance fundamental en las capacidades de la inteligencia artificial. A diferencia de los modelos tradicionales de aprendizaje automático, que son estáticos y específicos para una tarea, los agentes pueden adaptarse, planificar y ejecutar flujos de trabajo complejos de forma autónoma. En comparación con los sistemas actuales basados en LLM, los agentes añaden operación proactiva, memoria persistente y la capacidad de realizar acciones en el mundo real mediante integración de herramientas.

La transición de la IA reactiva a los agentes autónomos marca un cambio de paradigma comparable al paso de la IA estrecha a la comprensión general del lenguaje. Las organizaciones que comprendan estas diferencias y se preparen en consecuencia estarán mejor posicionadas para aprovechar el potencial transformador de los agentes de autoaprendizaje. La era de los agentes no se acerca: ya está aquí, redefiniendo cómo se realiza el trabajo y lo que la IA puede lograr.

Preguntas frecuentes

¿Cuál es la principal diferencia entre agentes de IA y modelos tradicionales de aprendizaje automático?

Los modelos tradicionales de ML aprenden patrones durante el entrenamiento y los aplican de forma estática a nuevas entradas, requiriendo reentrenamiento para adaptarse. Los agentes de IA autodidactas pueden aprender continuamente a partir de la experiencia, adaptarse a nuevas situaciones y operar de forma autónoma sin intervención humana constante ni reentrenamiento.

¿Pueden los agentes de IA de autoaprendizaje reemplazar a los chatbots basados en LLM actuales?

Los agentes de IA y los LLM cumplen propósitos diferentes y a menudo son complementarios en lugar de competitivos. Los LLM destacan en la comprensión y generación del lenguaje, mientras que los agentes añaden autonomía, capacidades de acción y aprendizaje adaptativo. Muchos agentes utilizan realmente a los LLM como su motor de razonamiento, añadiendo capas para planificación, memoria y uso de herramientas.

¿Requieren los agentes de IA de autoaprendizaje más recursos computacionales que los modelos de ML tradicionales?

Los agentes de autoaprendizaje suelen requerir más recursos computacionales debido a su complejidad, la gestión de estado persistente y a menudo modelos subyacentes más grandes. Sin embargo, las ganancias de eficiencia derivadas de la operación autónoma y la reducción de la necesidad de supervisión humana pueden compensar estos costos en muchas aplicaciones.

¿Cómo manejan los errores y fallos los agentes de autoaprendizaje?

Los agentes de autoaprendizaje pueden reconocer cuando su enfoque no está funcionando, analizar las razones del fracaso y ajustar dinámicamente su estrategia. Esta capacidad de refinamiento iterativo les permite manejar mejor situaciones impredecibles que los sistemas estáticos, aunque el manejo robusto de errores y la supervisión humana siguen siendo importantes.

¿Son seguros los agentes de IA autodidactas para su uso empresarial?

Cuando se diseñan adecuadamente con controles apropiados, los agentes de autoaprendizaje pueden implementarse con seguridad en entornos empresariales. Las organizaciones deben establecer límites claros para la autonomía de los agentes, implementar sistemas de monitoreo y mantener supervisión humana para decisiones críticas. La clave es equilibrar las capacidades de los agentes con marcos de gobernanza adecuados.

Aviso: Esta página fue traducida utilizando tecnología de IA (impulsada por GPT) para tu conveniencia. Para obtener la información más precisa, consulta la versión original en inglés.