এই পাগলামির তিন দিন, এগারোটি বড় মডেল, যেন একটি শোরগোলের প্রজ্জ্বলিত ফায়ারওয়ার্কস।

লেখক, উৎস: 0x9999in1, ME News

TL;DR

- তিন দিনের মধ্যে একটি বড় মডেল: 26 মার্চ থেকে 24 এপ্রিল পর্যন্ত, বিশ্বব্যাপী 11টি প্রমুখ বড় মডেল প্রকাশিত হয়েছে, গড়ে 2.7 দিনে একটি। বাজার গুরুতর “প্যারামিটার থকাম”-এর সম্মুখীন হয়েছে।

- প্যারামিটার গ্রাসীর “ওজন কমানোর অপারেশন”: V4-Pro-এর মোট প্যারামিটার 1.6T, কিন্তু কেবল 49B সক্রিয়। CSA+HCA আর্কিটেকচারের পুনঃগঠনের মাধ্যমে, 1M কনটেক্সটে FLOPs 27% এ কমে যায়, KV ক্যাশ 10% এ কমে যায়—অত্যন্ত ভয়ঙ্কর।

- অ্যালকেমির প্রজন্মগত বিচ্ছিন্নতা: প্রথমবারের মতো "প্রথমে স্বাধীন শিক্ষা, তারপর অনলাইন ডিসিলেশন এবং একীভূতকরণ" পদ্ধতি চালু করে, V4-Pro-Max যুক্তি এবং এজেন্ট কাজে বন্ধ সীমানার কাছাকাছি পৌঁছেছে।

- বাস্তব অর্থের ভোট: GPT-5.5 শুধুমাত্র নভেডা কে একদিনে 4.2% বাড়ানোর পর শীর্ষে পৌঁছেছিল, কিন্তু V4 MIT-এর সম্পূর্ণ ওপেন-সোর্স হওয়ার কারণে চীন ও হংকংয়ের স্থানীয় ক্যালকুলেশন চেইনকে পুরোপুরি জ্বালিয়ে দিয়েছে।

- গভীর গেম থিওরি: বন্ধ মডেলগুলি "ট্যাক্স" বিক্রি করে, ওপেন সোর্স বড় মডেলগুলি "লোহা" বিক্রি করে। V4-এর উত্থানের মাধ্যমে, বিশ্বব্যাপী এন্টারপ্রাইজ-লেভেলের প্রাইভেট ডিপ্লয়মেন্টের ক্যালকুলেশন বইটি শেষপর্যন্ত ভারসাম্যপূর্ণ হয়েছে।

ঈশ্বরদের দ্রুতগতির এপ্রিল, বাজারের রুচির ক্লান্তির সাথে

পাগল। সবাই পাগল।

যদি আপনি এআই সেক্টরকে কঠোরভাবে পর্যবেক্ষণ করেন, তবে গত ত্রিশ দিনটি আপনার জন্য শারীরিকভাবে অসহনীয় হয়ে উঠেছিল। ২০২৬ সালের ২৬ মার্চ থেকে ২৪ এপ্রিল পর্যন্ত, মাত্র এক মাসেরও কম সময়ের মধ্যে, বিশ্বজুড়ে কমপক্ষে ১১টি উল্লেখযোগ্য প্রভাবশালী মডেল বাজারে প্রবেশ করেছে।

তালিকাটি মনে হচ্ছে একটি মেনু পড়া হচ্ছে: Anthropic Opus 4.6, গুগল Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, মুন অফ দ্য ডার্ক কিমি K2.6, আলিবাবা Qwen3-Next, বাইটডান্স ডোউবাও 2.5 Pro, টেনসেন্ট হুনয়ুন 3.0, Kimi K2.6 Plus.

এবং ২৩ এপ্রিলের রাতের মধ্যে, একটি গভীর জলের বোমার মতো চুপচাপ চালু হয়েছিল DeepSeek V4।

গড়ে প্রতি 2.7 দিনে একটি নতুন মডেল প্রকাশিত হচ্ছে। এটি এমন এক গতি যে ফান্ড ম্যানেজারদেরও প্রকাশনা পড়ার সময় হয় না। বিনিয়োগকারীরা ঠিক A কোম্পানির “প্যারামিটার সুপিরিওরিটি” শুনছেন, B কোম্পানির “পারফরম্যান্স ড্রাশ” ইতিমধ্যেই তাদের টেবিলে চলে এসেছে। বাজার আসলে অচেনা হয়ে গেছে। উচ্চ প্রতিযোগিতার এই যুগে, “বেঞ্চমার্ক (বেঞ্চমার্ক)” বুকমার্কিং ক্রমশঃ একটি নিজেদের জন্যই চলা ডিজিটাল গেমের মতো মনে হচ্ছে।

কিন্তু টাকা বুদ্ধিমান। অথবা, ক্যান্ডলস্টিক কখনও মিথ্যা বলে না।

এই ৩০ দিনের মার্কিন যুক্তরাষ্ট্র-চীন-হংকং AI সম্পদের ক্যান্ডলস্টিক বিশ্লেষণ করুন, আপনি একটি অত্যন্ত নির্মম বাস্তবতা দেখতে পাবেন: এই “দেবতাদের যুদ্ধ”-এ, বাজারে দীর্ঘস্থায়ী ছাপ রাখতে সক্ষম শুধুমাত্র দুটি নোড।

প্রথমত, ৮ এপ্রিলে অন্য মহাদেশের ওপেনএআই জি পি টি-৫.৫ প্রকাশ করে। এই অবিসংবাদিত রাজা সরাসরি নভেডা কে একদিনে ৪.২% বৃদ্ধি করে। তারপর? আর কিছুই নেই, একদিনেই শীর্ষে পৌঁছে গেল, সুসংবাদ শেষ হয়ে গেল। মানুষ বুঝতে পারল, যতই মহান বন্ধ সোর্সের রাজা হোক, দুই বছর আগের মতো সহজেই বিশ্বব্যাপী মূলধনের ভারী পাহাড়কে নড়ানো কঠিন।

দ্বিতীয় নোড, যা এপ্রিল ২৩ থেকে ২৪ তারিখ। DeepSeek V4 প্রিভিউ প্রকাশিত হয়েছে। কোনও সুন্দর প্রকাশ অনুষ্ঠান নেই, কোনও আকর্ষণীয় প্রচার ভিডিও নেই। ওজন সরাসরি Hugging Face এবং ModelScope-এ আপলোড করা হয়েছে, MIT লাইসেন্সে।

ফলাফল? এটি চীন-হংকং ক্যালকুলেশন চেইনকে ক্রমাগত লাফিয়ে উঠতে উৎসাহিত করেছে।

কেন? কেন একাধিক বন্ধ সোর্স বড়দের কাজ করতে অক্ষম ছিল, কিন্তু একটি ওপেন সোর্স মডেল এটি করে ফেলল?

এই প্রশ্নের উত্তর দিতে, আমাদের একজন গল্পকারের মতো কাজ করতে হবে, একচেটিয়া প্রেস রিলিজগুলি বাদ দিয়ে, DeepSeek V4-এর ইঞ্জিনের কভার খুলে দেখতে হবে যে ভিতরে কী রাক্ষস লুকিয়ে আছে।

V4 বিশ্লেষণ: প্যারামিটারের বলপ্রয়োগের সৌন্দর্যে আর বিশ্বাস করবেন না

বড় মডেল। খুব ব্যয়বহুল। এটি সবাই জানে।

গত বছর, বড় মডেল প্রস্তুতকারকরা একটি "শক্তির অভাবের ভয়" এ পড়েছিল। তুমি এক ট্রিলিয়ন করছ, আমি দুই ট্রিলিয়ন করব। সবাই মনে করছিল, যদি শক্তি যথেষ্ট হয়, তবে উদ্ভূত বুদ্ধিমত্তা সবকিছুর সমাধান করে দেবে। কিন্তু এরপর আসলো অত্যন্ত ভয়ঙ্কর কম্পিউটিং খরচ। জমিদারেরও অবশিষ্ট শস্য শেষ হয়ে গেল।

DeepSeek V4 এই বার দুটি MoE (মিশ্র বিশেষজ্ঞ) মডেল প্রকাশ করেছে: V4-Pro এবং V4-Flash। আসুন প্রথমে কিছু কী ডেটা দেখি।

V4-Pro: মোট প্যারামিটার 1.6T (1.6 ট্রিলিয়ন), কিন্তু প্রতি টোকেন সক্রিয় প্যারামিটার মাত্র 49B (490 বিলিয়ন)।

V4-Flash: মোট প্যারামিটার 284B (2840 বিলিয়ন), সক্রিয় প্যারামিটার মাত্র 13B (130 বিলিয়ন)।

বুঝতে পেরেছেন? এটি একটি অত্যন্ত সংযত “চার ওজন হাজার ওজন সরিয়ে ফেলা”। MoE আর্কিটেকচারের মূল বিষয় হল প্রতিবার সব সতর্কবার্তা চালু করা এড়ানো। একটি মুরগি মারার কাজের জন্য, কয়েকজন মুরগি মারার বিশেষজ্ঞকে নিয়োগ করুন; একটি ড্রাগন হত্যার কাজের জন্য, ড্রাগন-কিলিং স্বর্ণধারী তলোয়ারটি আনুন। 1.6 ট্রিলিয়নের বেস, এটিকে “অভিজ্ঞ এবং জ্ঞানী” করে তোলে; 490 বিলিয়নের সক্রিয়করণ, এটিকে “দ্রুত প্রতিক্রিয়াশীল এবং দক্ষ” করে তোলে।

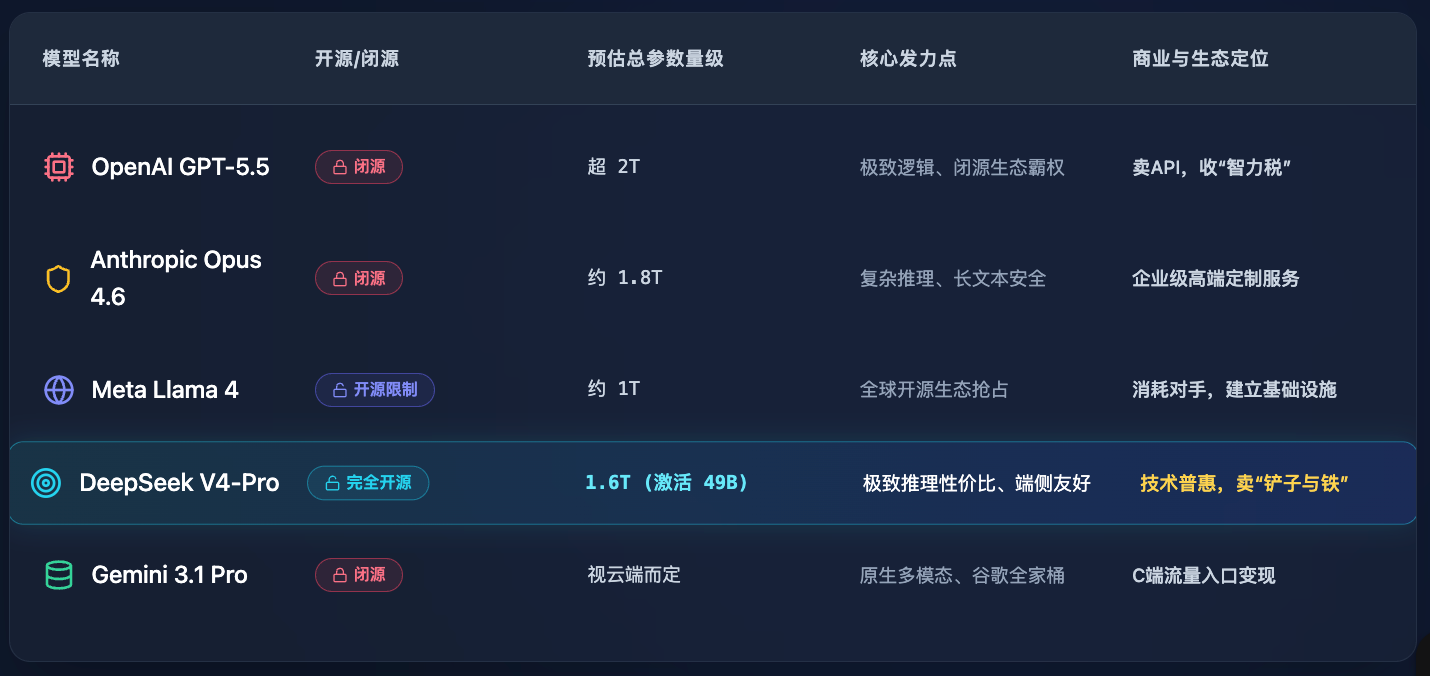

এই পার্থক্যটি আরও সহজে বুঝতে, আমরা বর্তমান বাজারের প্রধান পথগুলির একটি টেবিল তৈরি করি, যেখানে বাজারের প্রকাশ্যে অনুমান এবং গণনা অনুযায়ী তুলনা করা হয়েছে:

টেবিলটি দেখলে বোঝা যায় যে V4-Pro সমগ্র প্যারামিটারে GPT-5.5 কে অতিক্রম করার জন্য শুধুমাত্র চেষ্টা করেনি, বরং এই বিশাল প্রাণীটিকে কম খাওয়ানো এবং দ্রুত দৌড়ানোর উপর সমস্ত শক্তি ব্যয় করেছে।

কিন্তু এটাই যথেষ্ট নয়। বিশেষজ্ঞদের হৃদয়কে কাঁপিয়ে তোলে এটির “গ্রাফিক্স মেমোরি অ্যাসাসিন”-এর নির্মম ধ্বংস।

গ্রাফিক্স মেমোরি হত্যাকারীর শেষ: আর্কিটেকচারের তিনটি ক্ষত পরিষ্কার করার ছুরি

কী হল ভিডিও মেমোরি অ্যাসাসিন? এটি হল “দীর্ঘ কনটেক্সট (Long Context)”。

এখন সব প্ল্যাটফর্ম তাদের 1M (এক মিলিয়ন) টোকেনের কনটেক্সট সমর্থনের কথা জানাচ্ছে। শুনতে খুব ভালো লাগে, একটা পুরো সানগো চুয়ান জিয়ান ঢুকিয়ে দিলে এটি কয়েক সেকেন্ডেই পড়ে ফেলবে। কিন্তু এর দাম কী? দীর্ঘ টেক্সটের ইনফারেন্সের সময়, KV ক্যাশ (ইনফারেন্সের সময় ইতিহাসের তথ্য সংরক্ষণের জন্য GPU-এর মেমোরি ব্যবহার) অসীমভাবে বড় হয়ে যায়। এটা ঠিক যেন আপনি প্রতিটি পৃষ্ঠা পড়তে পড়তে, আগের পৃষ্ঠার সবকিছু একটা বড় ব্ল্যাকবোর্ডে নকল করে সামনে রাখছেন। যখন আপনি একদম একটি মিলিয়নতম শব্দের দিকে পৌঁছাবেন, তখন ব্ল্যাকবোর্ডগুলোতে জিংচুয়ান-এর ডেটা সেন্টারও ভরে যাবে।

মেমোরি, ক্যালকুলেশন পাওয়ারের চেয়ে বেশি দামি। এটিই এআই শিল্পের একটি অপ্রকাশিত নিয়ম।

DeepSeek V4 এই সমস্যার সমাধান করে কীভাবে? তারা সরাসরি মূল মনোযোগ কাঠামোতে “সার্জারি” করেছে। এটিই তাদের আর্কিটেকচার আপগ্রেডের প্রথম এবং সবচেয়ে কঠোর ছুরি: মিশ্র মনোযোগ কাঠামো (CSA + HCA)।

CSA (কম্প্রেসড স্পার্স অ্যাটেনশন) এবং HCA (হাইলি কম্প্রেসড অ্যাটেনশন) শুনতে মার্সিয়ান ভাষার মতো, কিন্তু মানুষের ভাষায় বললে: এটি আর মুখস্থ করে না, বরং “গুরুত্বপূর্ণ বিষয়গুলি চিহ্নিত করা” এবং “অত্যন্ত সংক্ষিপ্ত নোট তৈরি করা” শিখেছে।

এটি অত্যন্ত প্রভাবশালী: 1M কনটেক্সটে, V4-Pro-এর একটি টোকেন ইনফারেন্সের FLOPs (ফ্লোটিং-পয়েন্ট অপারেশন) শুধুমাত্র পূর্ববর্তী প্রজন্ম V3.2-এর 27% ছিল! আরও ভয়ঙ্কর বিষয় হলো, KV ক্যাশ শুধুমাত্র V3.2-এর 10% ছিল!

এটি কী ধরনের ধারণা? আগে যে এক মিলিয়ন শব্দের দীর্ঘ টাস্কটি চালানোর জন্য 10টি শীর্ষস্থানীয় সার্ভারের প্রয়োজন হত, এখন শুধুমাত্র 1টি সার্ভারেই সহজেই সেটি সম্পন্ন হচ্ছে। ক্যালকুলেশন খরচ সরাসরি 10% এ নেমে এসেছে। এটি টেবিল উল্টিয়ে দেওয়ার মতো অপ্টিমাইজেশন।

আরও দুটি চাকু আছে।

দ্বিতীয় কাটা, যার নাম "ম্যানিফোল্ড কনস্ট্রেইন্ট হাইপারকানেকশন (mHC)"। গতকালের বড় মডেলগুলিতে, স্তরের মধ্যে তথ্য প্রেরণের জন্য "প্রচলিত রেসিডুয়াল কানেকশন" ব্যবহার করা হত, যা একটি পুরনো, জংগলি লোহার পাইপের মতো, যেখানে জলের চাপ বেশি হলে সহজেই রিসিং হয়। 32T token-এর প্রচুর প্রি-ট্রেনিং ডেটার সামনে, পুরনো পাইপগুলি সহ্য করতে পারেনি। mHC হলো ফাইবার-অপটিক নেটওয়ার্কের সাথে প্রতিস্থাপন, যা স্তরগুলির মধ্যে সংকেত প্রচারের স্থিতিশীলতা বাড়িয়েছে। কোনো প্যাকেট হারায়না, কোনো বিচ্যুতি হয়না।

তৃতীয় কৌশল, ইঞ্জিনের তেল পরিবর্তন করুন। প্রাচীন পদ্ধতি ত্যাগ করুন এবং Muon অপ্টিমাইজার ব্যবহার করুন। এটি অভিসরণকে ত্বরান্বিত করে। অন্যরা যদি সাত্তর চার দিন ধরে ঔষধ প্রস্তুত করে, তবে এটি মাত্র বিশ দিনেই প্রস্তুত হয়ে যায়। সময়ই টাকা, কম্পিউটিং সময়ই ডলার।

এই তিনটি কুঁচি মারার পর, V4 বড় মডেলের “সমৃদ্ধির রোগ” সম্পূর্ণরূপে সারিয়ে ফেলেছে।

ড্রাগন ফার্নেসের গোপন কথা: একক প্রচেষ্টা থেকে সমস্ত পদ্ধতির একত্রীকরণ

বড় মডেলের ক্ষেত্রে সবাই জানে, প্রি-ট্রেনিং শুধু একটি "অক্ষরজ্ঞ" কে "অনেক জ্ঞান রাখে কিন্তু কথা বলতে পারে না এমন একজন মূর্খ" এ পরিণত করে। এটিকে সত্যিকারের একজন মহান বিশেষজ্ঞে পরিণত করে, পোস্ট-ট্রেনিং (Post-training)।

DeepSeek V4 পোস্ট-ট্রেনিংয়ে একটি অত্যন্ত কঠোর "দুই পর্যায়ের যুদ্ধকৌশল" খেলেছে।

গতকাল মানুষ MoE ট্রেন করত, যেমন একজন শিক্ষার্থীকে নিয়ে অনেক শিক্ষক একসাথে পড়াচ্ছিল, যার ফলে খুব সহজেই ঝগড়া হত। V4 কীভাবে করে?

প্রথম পর্যায়: “পৃথকভাবে লড়াই করা”। এটি SFT (সুপারভাইজড ফাইন-টিউনিং) এবং GRPO (গ্রুপ-ভিত্তিক রিলেটিভ পলিসি অপ্টিমাইজেশন) শিক্ষার মাধ্যমে মডেলের বিভিন্ন “এক্সপার্ট নেটওয়ার্ক” কে আলাদাভাবে প্রশিক্ষণ দেয়। কোডিংয়ের এক্সপার্ট শুধুমাত্র কোডিংয়ের অনুশীলন করে, গণিতের এক্সপার্ট শুধুমাত্র গণিতের সমস্যা সমাধান করে। এগুলো পরস্পরের সঙ্গে সম্পূর্ণভাবে অসংশ্লিষ্ট। এটিকে একক দক্ষতা সর্বোচ্চ মাত্রায় নিয়ে যাওয়া বলা হয়।

দ্বিতীয় পর্যায়: “সকল পদ্ধতির একত্রীকরণ।” অনলাইন ডিস্টিলেশন প্রযুক্তির মাধ্যমে, এই সকল প্রখর কৌশলে দক্ষ বিশেষজ্ঞদের একটি একক, সমন্বিত মডেলে একত্রিত করা হয়। অভ্যন্তরীণ সংঘর্ষ বা বিলম্ব ছাড়া।

আসুন আমরা তাদের বের করা দুটি "বড় হাতিয়ার" দেখি।

প্রথমত, V4-Pro-Max মোড। এটি সর্বোচ্চ যুক্তিসঙ্গত ক্ষমতা মোড। এটি যেন জিন লক খুলে গেছে। তারা দাবি করে (এবং শীঘ্রই সম্প্রদায় দ্বারা যাচাই করা হয়েছে), কোডিং বেঞ্চমার্কে V4-Pro শীর্ষস্থানীয় পর্যায়ে পৌঁছেছে, এবং জটিল যুক্তিসঙ্গত এবং Agent (বুদ্ধিমান) কাজে, অগ্রণী বন্ধ মডেলগুলির (যেমন GPT-5.5, Opus 4.6) সাথে ব্যবধান উল্লেখযোগ্যভাবে কমেছে।

দ্বিতীয়টি হল V4-Flash-Max। এটি আরও আকর্ষণীয়। এটি শুধুমাত্র 284B আকারের একটি ছোট জিনিস, কিন্তু “পর্যাপ্ত চিন্তার বাজেট” দেওয়ার পরে, এর যুক্তিসঙ্গত পারফরম্যান্স প্রো-এর কাছাকাছি চলে আসে। এটি কী বোঝায়? এটি বোঝায় যে “অ্যালগরিদমের গুণগত মান” শুরু করেছে “প্যারামিটারের পরিমাণ”কে পরাজিত করতে। যদি আপনি এটিকে চিন্তা করার জন্য যথেষ্ট সময় দেন, তবে ছোট মস্তিষ্কও বড় সমস্যা সমাধান করতে পারে। অবশ্যই, শুধুমাত্র জ্ঞানের ভাণ্ডার এবং অত্যন্ত জটিল বহু-পদক্ষেপ Agent কাজগুলিতে, এটি এখনও প্যারামিটারের আকারের (যেহেতু পেটটি এতটাই ছোট) সীমাবদ্ধ, কিন্তু বেশিরভাগ এন্টারপ্রাইজ-লেভেলের দৈনন্দিন অ্যাপ্লিকেশনের জন্য, এটি 이미 অতিরিক্ত পারফরম্যান্স।

শেষে, ওজন সংরক্ষণে FP4+FP8 মিশ্র প্রেসিশন সংরক্ষণ অত্যন্ত চালাকির সাথে ব্যবহার করা হয়েছে। প্রেসিশন বজায় রাখা হয়েছে এবং জিপিইউ মেমোরি সাশ্রয় করা হয়েছে। সবকিছুতেই একটি হিসাবী বিজ্ঞানীর আকর্ষণ ফুটে উঠেছে।

এই পোস্ট-ট্রেনিং দ্বারা প্রকৌশল দক্ষতার উন্নতি স্পষ্টভাবে তুলনা করার জন্য, আমরা একটি কঠোর মাপদণ্ডের তুলনামূলক টেবিল তৈরি করছি:

প্রতিনিধির সংবেদনশীলতা: কেন V4 মধ্য চীন ক্যালকুলেশন চেইনকে জ্বালিয়ে দিয়েছে?

এখানে প্রযুক্তিগত বিশ্লেষণ প্রায় শেষ। কিন্তু আমরা শুরুর সেই আত্মার প্রশ্নটির উত্তর দিইনি:

কেন GPT-5.5 ক্যালকুলেশন সেক্টরকে দীর্ঘস্থায়ী উৎসবে পরিণত করতে পারেনি, কিন্তু DeepSeek V4 করেছে?

এটি আমাদের কোড থেকে বেরিয়ে আসে এবং এই গেমটিকে মূলধন এবং ব্যবসায়িক দৃষ্টিকোণ থেকে দেখতে হবে।

GPT-5.5 অত্যন্ত শক্তিশালী, অজেয় শক্তিশালী। কিন্তু এটি বন্ধ সোর্স। বন্ধ সোর্সের অর্থ কী? অর্থাৎ OpenAI একটি বিশাল “কৃষ্ণবিবর”। আপনি যদি এর ক্ষমতা ব্যবহার করতে চান, তাহলে আপনাকে এর API কিনতে হবে। এটি একটি “কর আদায়” মডেল। লাভ সিলিকন ভ্যালির দিকে প্রবাহিত হচ্ছে, এবং ক্যালকুলেশনের চাহিদা মাইক্রোসফটের ক্লাউড ডেটা সেন্টারগুলিতে কেন্দ্রীভূত হচ্ছে। বিশ্বব্যাপী হার্ডওয়্যার প্রস্তুতকারকদের, স্থানীয় ক্যালকুলেশন সেন্টারগুলির, এবং বিভিন্ন দেশের সার্ভার এজেন্টদের জন্য, এটির থেকে শুধুমাত্র দূরে থেকে দেখা ছাড়া কিছুই পাওয়া যাচ্ছে না। GPT-5.5 যতই শক্তিশালী হোক, এটি অন্যের উৎসব। NVIDIA-এর মূল্যবৃদ্ধির কারণ, কারণ মনে করা হচ্ছে OpenAI-এর আরও বেশি GPU-এর প্রয়োজন।

কিন্তু DeepSeek V4 ভিন্ন।

এটি ওপেন সোর্স। এবং এটি অত্যন্ত বিস্তৃত MIT লাইসেন্স। MIT চুক্তিটি ওপেন সোর্স সম্প্রদায়ের সবচেয়ে উদার উপহার, যার অর্থ ব্যবসায়িক কোম্পানিগুলি আইনি ঝুঁকির চিন্তা ছাড়াই এটি বিনামূল্যে ব্যবহার, পরিবর্তন এবং বিক্রি করতে পারে।

আরও মারাত্মক বিষয় হলো, আমরা আগের অংশে যুক্তি দিয়েছি যে V4 মডেলের উপসংহার খরচ এবং জিপিইউ মেমোরি ব্যবহারকে পায়ের মুঠোয় কমিয়েছে।

এই দুটি বিষয়কে একত্রিত করলে, আপনি একটি এমন উপসংহারে পৌঁছাবেন যা বিনিয়োগকারীদের জন্য অত্যন্ত উত্তেজনাপূর্ণ: ব্যক্তিগতকরণের সীমান্ত বিন্দু প্রকৃতপক্ষে এসে গেছে।

অতীতে, কোম্পানিগুলি যখন 1T-এর বেশি মডেল স্থানীয়ভাবে ডিপ্লয় করতে চাইত, তখন হার্ডওয়্যার মূল্য তালিকা দেখে চুপচাপ বন্ধ করে দিত এবং API কিনত। এখন, V4 বলছে: আপনার কাছে খুব কম মেশিন থাকলেই আপনি স্থানীয়ভাবে GPT-4-এর সমান বা GPT-5.5-এর প্রতিযোগিতা করতে পারেন এমন একটি সুপারব্রেইন চালাতে পারবেন। ডেটা প্রদেশের বাইরে বা দেশের বাইরে যাওয়ার দরকার নেই, এটি সম্পূর্ণরূপে নিরাপদ।

যেহেতু সবাই এখন স্থানীয়ভাবে চালাতে পারছে, তাহলে এরপর কী ঘটবে?

মেশিন কিনুন! সার্ভার কিনুন! অপটিক্যাল মডুল কিনুন! স্মার্ট কম্পিউটিং সেন্টার তৈরি করুন!

বন্ধ সোর্স বড় কোম্পানিগুলি বুদ্ধিবৃত্তিক কর বিক্রি করে, যেখানে ওপেন সোর্স বড় কোম্পানিগুলি মূলত সম্পূর্ণ শিল্পের হার্ডওয়্যার প্রস্তুতকারকদের জন্য "পণ্য বিক্রি" করছে। DeepSeek V4 হল সেই আগুনের বীজ ফেলে দেওয়া ব্যক্তি। এটি যতই ব্যবহারকারীবান্ধব এবং ওপেন-সোর্স হবে, চীন, হংকং, তাইওয়ান ইত্যাদি স্থানীয় ক্যালকুলেশন চাহিদা ততই বিস্ফোরিত হবে। সার্ভার অ্যাসেম্বলি, লিকুইড কুলিং, ডেটা সেন্টার অপারেশনসের সাথে জড়িত কোম্পানিগুলির জন্য এখন বড়পরিসরে বাস্তবায়নের প্রকৃত আর্থিক সুযোগ দেখা দিয়েছে।

এই কারণে ২৩ এপ্রিল V4 প্রকাশের সাথে সাথে চীন-হংকং ক্যালকুলেশন চেইন ক্রমাগত বাড়তে শুরু করে। মূলধন আবেগের জন্য পেমেন্ট করছে না, মূলধন আসন্ন “হাজার হাজার শিল্পের ব্যক্তিগত ডিপ্লয়মেন্ট বুম”-এর জন্য আগাম অবস্থান নিচ্ছে।

এটাই মূল ব্যবসায়িক কৌশল।

উপসংহার: প্রবাহ ও পাথর

এই পাগলামির তিন দিন, এগারোটি বড় মডেল, যেন একটি শোরগোলের প্রজ্জ্বলিত ফায়ারওয়ার্কস।

বড় বড় প্রতিযোগীরা প্যারামিটারের মঞ্চে প্রচুর পরিমাণে ধন নিয়ে হাতি দিচ্ছে, তাদের প্রতিদ্বন্দ্বীদের ক্যালকুলেশনের ভারী হাতাঘাতে ভেঙে ফেলার চেষ্টা করছে। কিন্তু শোরগোলের পর, যারা আসলেই শিল্পের ভূমিরূপ পরিবর্তন করতে পারবে, সেগুলো সবচেয়ে বেশি শব্দ করা ব্যক্তি নয়।

ডিপসিক V4-এর আবির্ভাব একজন শান্ত হত্যাকারীর মতো। এটি আপনার সাথে কে বেশি টাকা খরচ করে তা নিয়ে প্রতিযোগিতা করে না, এটি শুধুমাত্র সবচেয়ে বেশি ব্যথিত দুর্বলতার উপর হামলা চালায়: অপ্রয়োজনীয় VRAM কে কেটে ফেলে, বাস্তবায়নের বাধা কমিয়ে উচ্চস্তরের খেলাকে সাধারণদের জন্য পরিণত করে।

যে এআই যুদ্ধকে "রগনারোক" বলা হচ্ছে, সেই যুদ্ধে অন্ধভাবে প্যারামিটার জমা করার যুগ দ্রুত শেষ হয়ে যাচ্ছে। ভবিষ্যতের যুদ্ধক্ষেত্র হবে যাদের সকলের চেয়ে ভালোভাবে "অত্যন্ত কর্মক্ষমতা" এবং "প্রকৌশলগত দক্ষতা"এর মধ্যে ভারসাম্য বজায় রাখতে পারবে।

প্রবাহ সবসময় প্রত্যাহার হয়ে যায়, প্রত্যাহারের পরেই বোঝা যায় কে নগ্নভাবে সাঁতার কাটছে এবং কে অটুট পাথর।

V4 সকলের হাতে অস্ত্র বিতরণ করে দিয়েছে। এখন, প্রতিটি সেনাপতির উপর নির্ভর করছে যে এই নতুন ভূমিতে কীভাবে তাদের শিবির স্থাপন করা হবে।

এই স্তরটি বুঝে নিলে, আপনি যখন “অসাধারণ প্রকাশ”, “পুনর্বিন্যাস” ইত্যাদি শব্দে ভরা আওয়াজ শুনবেন, তখন আপনি কিছুটা অধৈর্য কমিয়ে আরও শান্তভাবে শুনতে পারবেন।

কারণ, যতই উজ্জ্বল জাদু হোক না কেন, শেষ পর্যন্ত এটি হিসাবের বইয়ে নেমে আসতে হবে, কয়েকটি ছোট চাঁদির হিসাব ঠিক করতে হবে।

উৎস উদ্ধৃত:

- DeepSeek V4 সিরিজের প্রাক-প্রকাশ অফিসিয়াল প্রকাশ, DeepSeek টিম, GitHub/ModelScope/HuggingFace. (2026).

- এপ্রিলের এআই র্যালি: ৩০-দিনের বড় মডেল চক্র বিশ্লেষণ, এমই নিউজ মার্কেট অবজারভার। (২০২৬)।

- স্কেলিং আইন এবং পোস্ট-ট্রেইনিং প্যারাডাইম শিফট, আর্টিফিশিয়াল ইন্টেলিজেন্স ইকোনমিক্স জার্নাল। (2026)।

- গ্লোবাল কম্পিউট সাপ্লাই চেইন মার্কেট পাল্স রিপোর্ট (এপ্রিল 2026), প্যান-এশিয়ান ফাইন্যান্সিয়াল ডেটা অ্যানালিটিক্স। (2026)।