الكاتب الأصلي: كوري، شينتشاو TechFlow

قبل بضعة أيام، كانت هناك صورة انتشرت بشكل واسع على الإنترنت.

أقامت الهند قمة للذكاء الاصطناعي، حيث وقف رئيس الوزراء مودي على المسرح، وبحلوله جانباً مجموعة من كبار مسؤولي سيليكون فالي. خلال لحظة التصوير الجماعي، رفع مودي يد الشخص بجانبه فوق رأسه، فتبعه الآخرون بربط أيديهم معًا، في مشهد يعكس الوحدة.

لكن فقط شخصين لم يتشابكا.

رئيس تنفيذي لـ OpenAI ورئيس تنفيذي لـ Anthropic، أي مالكي الشركتين وراء ChatGPT وClaude، يقفان جنبًا إلى جنب، وكل منهما يرفع قبضة يده.

لا يمسكان أيديهما، ولا ينظران في عيون بعضهما البعض، كأنهما عدوان تم تعيينهما للجلوس على نفس المكتب من قبل المعلم.

على مدار السنوات القليلة الماضية، كانت هاتان الشركتان في صراع شديد، حيث طور فريق غادر OpenAI Claude، وتنافستا على المستخدمين وعملاء الشركات والتمويل، وفي فترة السوبر بول هذا العام، أنفقت Anthropic مالاً على إعلانات ساخرة تهدف إلى التقليل من ChatGPT بسبب دخوله عالم الإعلانات.

لذلك عدم التمسك باليد، طبيعي.

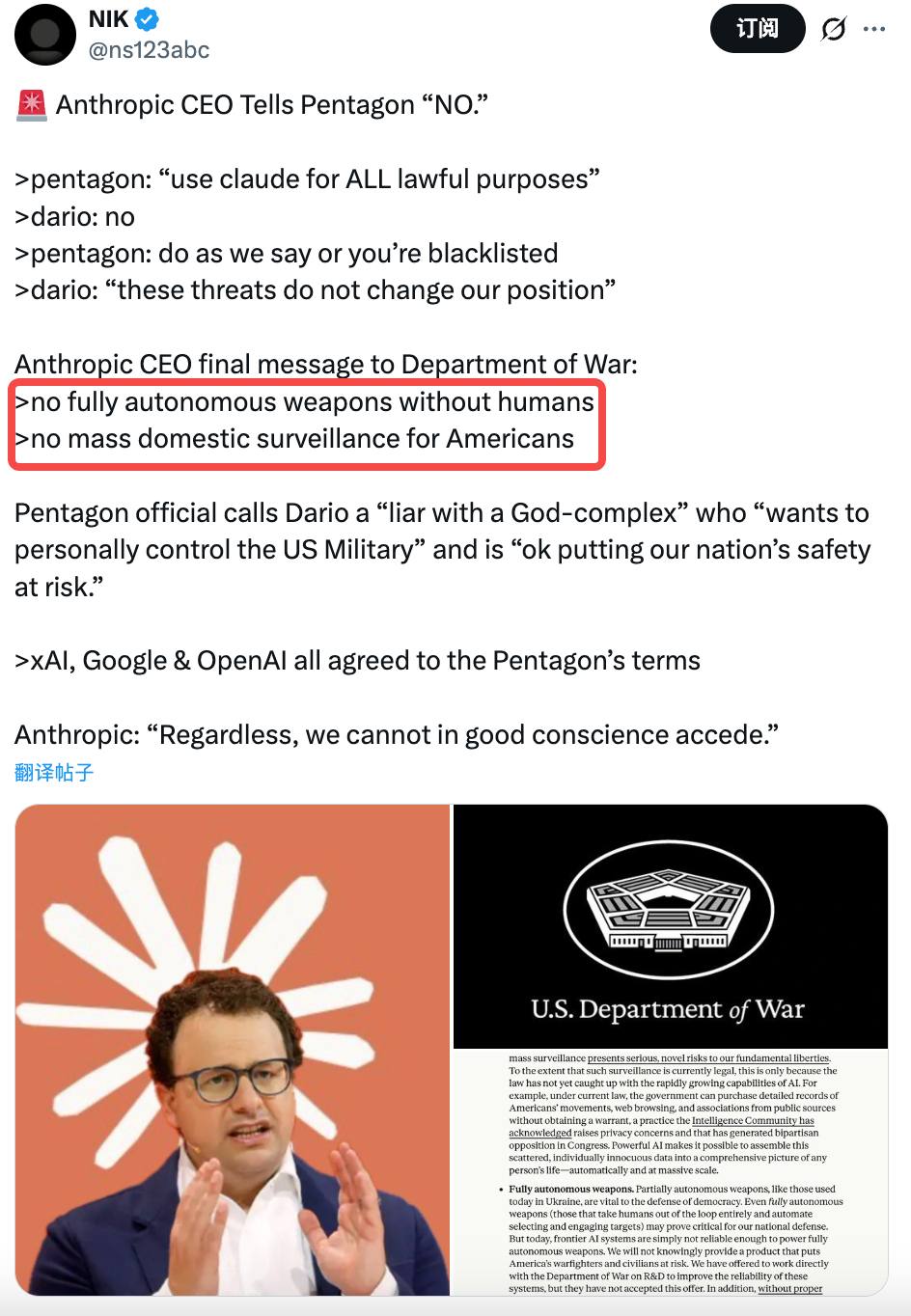

لكنهم اليوم تعاونوا. بسبب البنتاغون.

هكذا هي الأمور.

أنثروبيك، الشركة وراء كلاود، وقعت العام الماضي عقدًا مع وزارة الدفاع الأمريكية بقيمة تصل إلى 200 مليون دولار. وكان كلاود أول نموذج ذكاء اصطناعي يتم نشره على الشبكات السرية للجيش الأمريكي لمساعدته في معالجة تحليل الاستخبارات وتخطيط المهام.

لكن أنثروبيك رسم خطين أحمرين في العقد:

لا يمكن استخدام Claude لمراقبة جماهيرية للمواطنين الأمريكيين، ولا يمكن استخدامه في أسلحة ذاتية تعمل دون مشاركة بشرية. (انظر القراءة المرجعية: Anthropic 身份危机的七十二小时)

لكن البنتاغون لا يقبل.

طلبهم أربعة أحرف: غير مقيد. بمجرد شراء الأداة، يجب أن تستخدمها بحرية، فلماذا تخبرك شركة تكنولوجيا واحدة الجيش الأمريكي بما يمكنه فعله أو لا يمكنه فعله؟

في الثلاثاء الماضي، قدم وزير الدفاع هيجست هدفًا نهائيًا مباشرةً لرئيس تنفيذي أنثروبيك: قبوله بحلول الساعة 5:01 مساءً يوم الجمعة، وإلا فسيتحمل العواقب.

أنثروبيك لم توافق.

أصدر رئيسهم التنفيذي بيانًا عامًا يفيد بأننا ندرك أهمية الذكاء الاصطناعي للدفاع الأمريكي، لكن في حالات نادرة، قد يضر الذكاء الاصطناعي بقيم الديمقراطية بدلاً من دعمها. لا يمكننا قبول هذا الطلب بضميرنا.

بعد ذلك، اتهم ممثل المفاوضات في البنتاغون، نائب وزير الدفاع إميل مايكل، على وسائل التواصل الاجتماعي أنه كاذب، وقال إنه يعاني من شعور بالربوبية ويستهين بأمن الدولة.

ممسكة قصيرة

ثم حدث شيء غير متوقع.

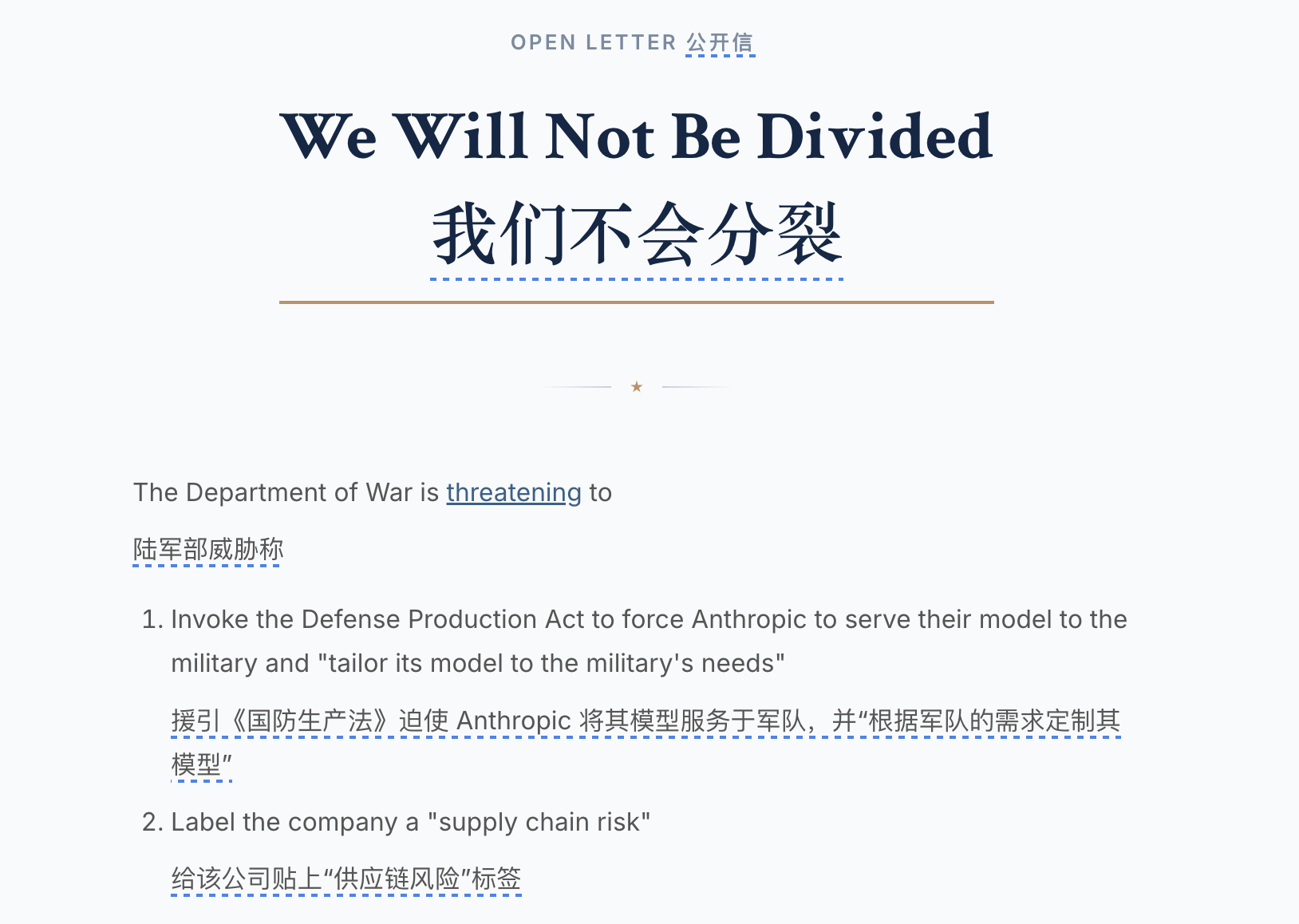

أكثر من 400 موظف من OpenAI وGoogle وقعوا رسالة مفتوحة مشتركة بعنوان "لن نُقسَّم".

الرسالة تقول إن البنتاغون يتواصل مع شركات الذكاء الاصطناعي واحدة تلو الأخرى، ويسعى لإقناع الآخرين بالموافقة على شروط لم توافق عليها Anthropic، باستخدام الخوف لتقسيم كل شركة.

أرسل رئيس تنفيذي OpenAI رسالة داخلية إلى جميع الموظفين، قائلاً إن OpenAI لديها نفس الخطوط الحمراء مثل Anthropic:

لا تمارس المراقبة الواسعة النطاق، ولا تطور أسلحة قاتلة ذاتية التشغيل.

قبل بضعة أيام فقط، كانت شركتان ترفضان التحالف، لكنهما فجأة وجدتا أنفسهما على نفس الجانب بسبب البنتاغون.

لكن هذا التضامن قد يستمر لبضع ساعات فقط.

At 5:01 PM Friday, the Pentagon's ultimatum expired. Anthropic did not sign.

شركة تكنولوجيا أمريكية بقيمة 380 مليار دولار، رفضت وزارة الدفاع الأمريكية رغم مخاطر إلغاء عقد بقيمة 2 مليار دولار. في الماضي، كان مثل هذا الأمر لا يتجاوز إلغاء العقد واستبدال المورد. لكن رد فعل واشنطن هذا المرة لم يكن على الإطلاق مستوى تجاري.

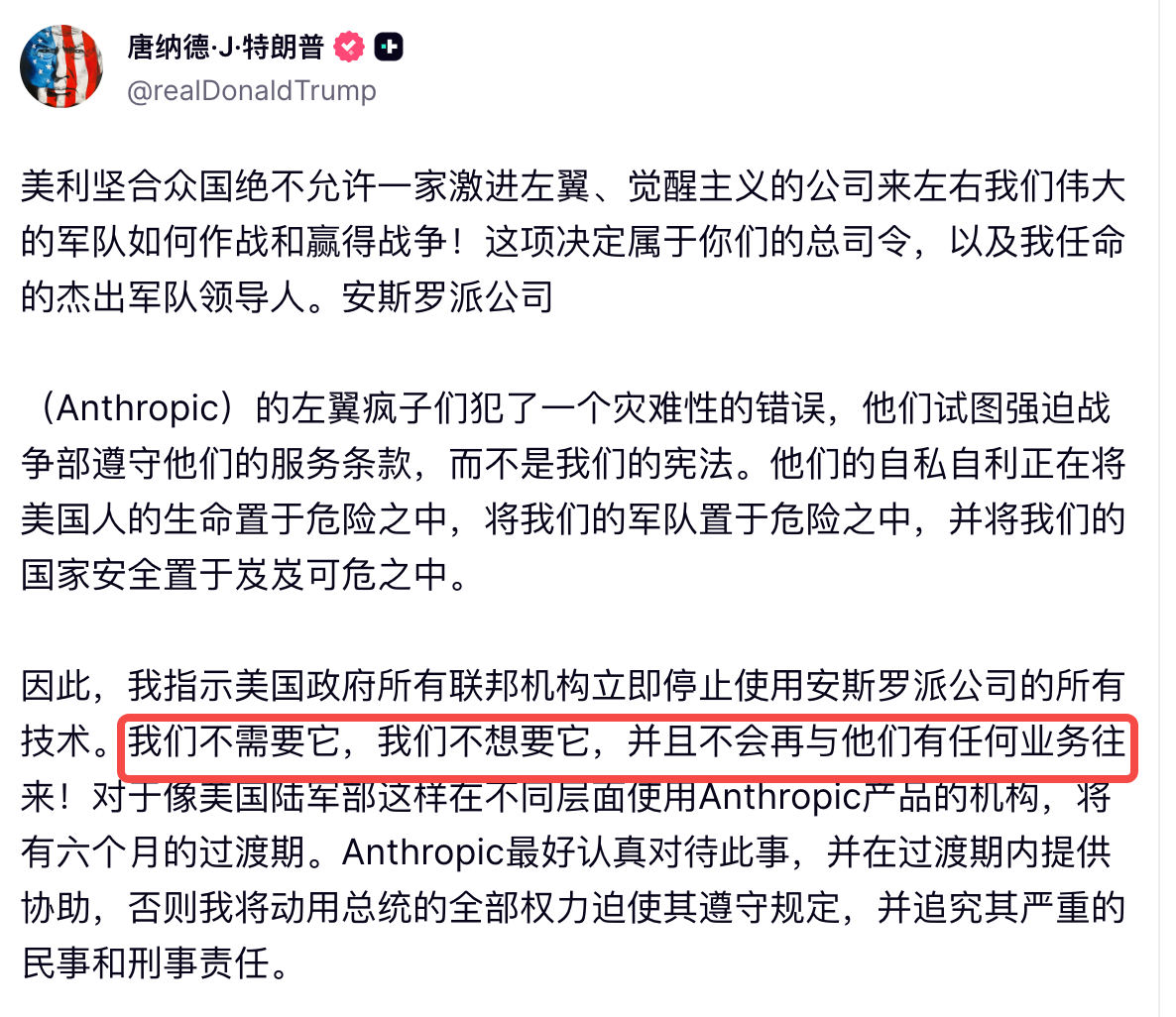

نشر ترامب منشورًا على Truth Social بعد حوالي ساعة، ووصف Anthropic بـ"المتطرفين اليساريين"، وقال إنهم يحاولون التفوق على الدستور ويستهينون بحياة الجنود الأمريكيين.

لقد طالب جميع الوكالات الفيدرالية بوقف استخدام تقنيات Anthropic فورًا.

ثم أعلنت وزيرة الدفاع الأمريكية هيغسيث أن أنثروبيك تُصنف كـ"مُخاطر أمنية في سلسلة التوريد". هذا التصنيف عادةً ما يُستخدم للشركات مثل هواوي. والمعنى واضح: لا يمكن لأي متعهد يعمل مع الجيش الأمريكي استخدام منتجات أنثروبيك.

يقول Anthropic أنه سيقوم برفع دعوى قضائية.

لكن في نفس الليلة، وقّعت OpenAI، التي كانت سابقًا تتمسك بنفس الموقف، اتفاقًا مع البنتاغون.

قضايا أيديولوجية

ما الذي حصلت عليه OpenAI؟

المكان الذي شغله كلاود بعد طرده: مزود الذكاء الاصطناعي لشبكة美军 السرية. لكن OpenAI قدمت ثلاث شروط للبنتاغون: لا مراقبة جماعية، لا أسلحة ذاتية، يجب أن يكون هناك تدخل بشري في القرارات عالية المخاطر.

البنتاغون يقول، حسنًا.

أنت لم تخطئ. الشروط التي لم تقبلها Anthropic على مدار أسابيع، تمت الموافقة عليها في غضون أيام عندما طرحتها شركة أخرى؟

Of course, the two solutions are not exactly the same.

أضاف Anthropic طبقة إضافية: إنهم يعتقدون أن القوانين الحالية لا تواكب قدرات الذكاء الاصطناعي، فمثلاً يمكن للذكاء الاصطناعي شراء ودمج بيانات موقعك وسجل تصفحك ومعلومات وسائل التواصل الاجتماعي بشكل قانوني، مما يؤدي إلى نتيجة تكافئ المراقبة، لكن كل خطوة على حدة ليست غير قانونية.

يقول Anthropic أن كتابتك فقط "لا تراقب" لا تكفي، يجب إغلاق هذه الثغرة. لم تتمسك OpenAI بهذه النقطة، بل قبلت رأي البنتاغون بأن القانون الحالي كافٍ.

لكن إذا اعتقدت أن هذا مجرد خلاف على الشروط، فأنت مُبَرَّم. هذه المفاوضات لم تكن منذ البداية مجرد مفاوضات على الشروط.

لقد انتقد ديفيد ساكس، صاحب الذكاء الاصطناعي في البيت الأبيض، Anthropic علنًا منذ فترة طويلة لقيامها بـ"ذكاء اصطناعي ووكي" (الأولوية لل Ideology، وتطبيق المعايير السياسية الصحيحة)؛ وقال مسؤول رفيع المستوى في البنتاغون للإعلام إن مشكلة داريو هي مُحَرَّكة من قبل Ideology، "نحن نعرف من نتعامل معه".

إيلون ماسك من xAI، وهو منافس مباشر لـ Anthropic، هاجم Anthropic مرارًا وتكرارًا على X هذا الأسبوع، قائلاً إن هذه الشركة "تكره الحضارة الغربية".

لكن مدير تنفيذي Anthropic لم يذهب إلى حفل تنصيب ترامب العام الماضي. ذهب المدير التنفيذي لـ OpenAI.

قتل الدجاج لتخويف القرود

فلنُرتب ما حدث.

بنفس المبدأ، بنفس الخط الأحمر، تم تصنيف Anthropic كتهديد لأمن الولايات المتحدة على مستوى هواوي بسبب إضافتها طبقة حماية إضافية، ووقوفها في المكان الخاطئ، واتخاذها الموقف الخاطئ.

أخطأ OpenAI في طبقة واحدة، وعندما كانت العلاقة جيدة، حصلوا على العقد. أتقول إن هذا انتصار للمبدأ، أم تسعيرًا للمبدأ؟

لم يكن هذا أول مرة تُرفض فيها عقود البنتاغون.

في عام 2018، وقّع أكثر من 4000 موظف في جوجل على عريضة، واستقال عشرات الأشخاص احتجاجًا على مشاركة الشركة في مشروع يُدعى Project Maven التابع لوزارة الدفاع الأمريكية. كان هذا المشروع يستخدم الذكاء الاصطناعي لتحليل مقاطع الفيديو التي تُلتقط بواسطة الطائرات المسيرة، بهدف مساعدة الجيش على تحديد الأهداف بشكل أسرع.

غُoogle انسحبت أخيرًا. لم تجدد العقد وغادرت. الموظفون فازوا.

مرّ ثماني سنوات، وعاد الجدل نفسه من جديد. لكن هذه المرة تغيرت القواعد تمامًا. قالت شركة أمريكية إن بإمكاني التعامل مع الجيش، لكن هناك شيئين لا يمكنني فعلهما. كان رد فعل الحكومة الأمريكية هو طردها من النظام الفيدرالي بأكمله.

وإن تأثير وسم "مخاطر أمن سلسلة التوريد" يتجاوز بكثير فقدان عقد بقيمة 200 مليون دولار.

إيرادات Anthropic هذا العام تقدر بحوالي 14 مليار دولار أمريكي، و200 مليون دولار في العقود لا تُعدّ حتى جزءًا صغيرًا. لكن هذا الوسم يعني أن أي شركة لديها تعاملات مع الجيش الأمريكي لا يمكنها استخدام Claude.

لا تحتاج هذه الشركات إلى تبني موقف البنتاغون، بل تحتاج فقط إلى إجراء تقييم مخاطر: الاستمرار في استخدام Claude قد يؤدي إلى فقدان العقود الحكومية؛ بينما التبديل إلى نموذج آخر لن يسبب أي مشكلة.

الاختيار سهل. هذا هو الإشارة الحقيقية لهذا الأمر.

لا يهم ما إذا كان Anthropic يستطيع التحمل أم لا، المهم هو ما إذا كانت الشركة التالية ستجرؤ على التحمل. ستُقيّم النتيجة، وتُقيّم تكلفة التمسك بالمبادئ، ثم تتخذ قرارًا عقلانيًا جدًا.

عندما ننظر مرة أخرى إلى الصورة الهندية، كان الجميع يمسكون بأيدي بعضهم البعض ويرفعونها فوق رؤوسهم، لكنهما فقط كانا يمسكان بقبضتيهما.

ربما هذا هو الوضع الطبيعي.

يمكن أن تكون مبادئ شركات الذكاء الاصطناعي متشابهة، لكن الأيدي قد لا تتماسك.