المؤلف: شينتشاو TechFlow

ورقة بحثية زعمت أنّها "خفضت استخدام ذاكرة الذكاء الاصطناعي إلى 1/6" تسببت الأسبوع الماضي في تبخر أكثر من 90 مليار دولار من القيمة السوقية لأسهم شركات رقائق التخزين العالمية مثل ميكرون وسانديسك.

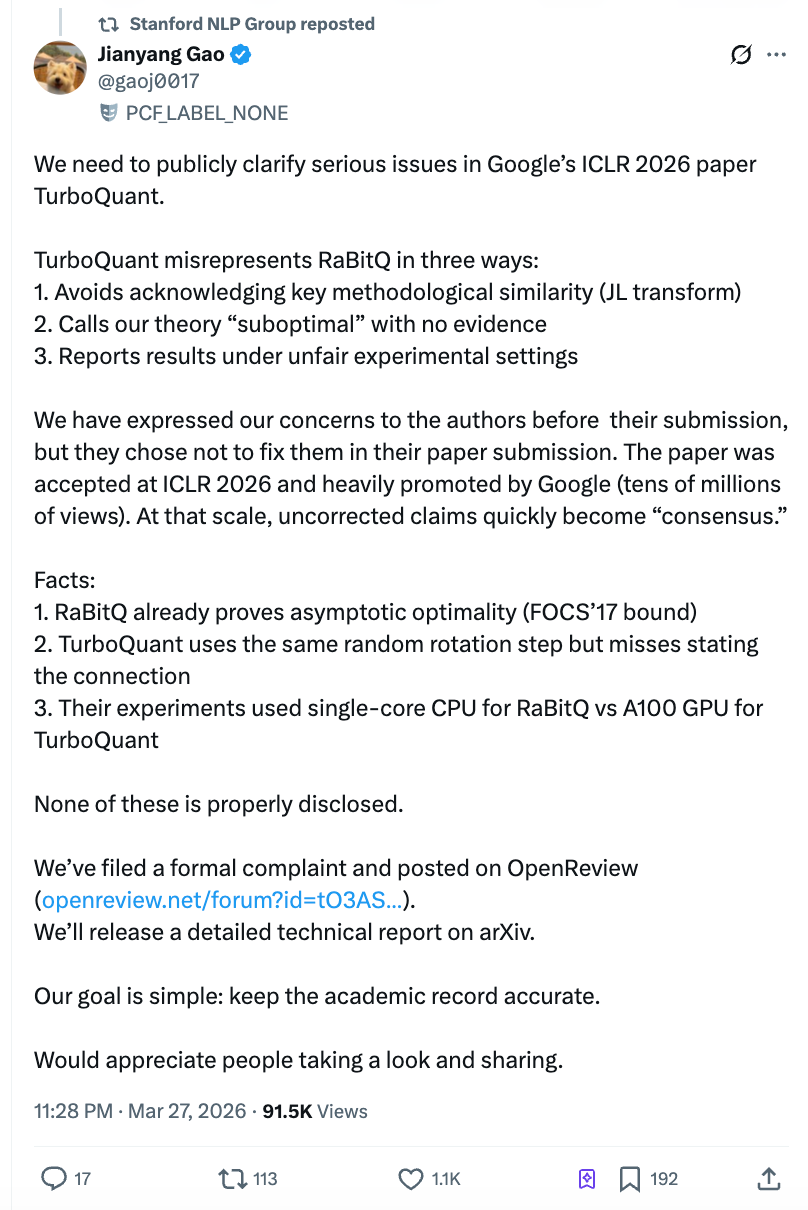

لكن بعد نشر الورقة بيومين فقط، نشر باحث ما بعد الدكتوراه من المعهد الفيدرالي السويسري للتكنولوجيا في زيوريخ، غاو جيانيانغ، رسالة مفتوحة بطول عشرة آلاف كلمة يدّعي فيها أن فريق جوجل استخدم سكريبت بايثون على وحدة معالجة مركزية أحادية النواة لاختبار الخصم، بينما استخدم بطاقة A100 GPU لاختبار نفسه، ورفض تصحيح المشكلة رغم إبلاغه بها قبل تقديم الورقة. وتجاوز عدد القراءات على Zhihu 4 ملايين، ونشر الحساب الرسمي لـ Stanford NLP التغريدة، مما أثار صدمة في الأوساط الأكاديمية والسوق معًا.

(اقرأ المرجع: ورقة بحثية أثرت سلبًا على أسهم التخزين)

لا تكمن المشكلة الأساسية في هذه الجدلية في تعقيد كبير: هل وُزِّعت ورقة بحثية من مؤتمر ذكاء اصطناعي عالمي بشكل كبير من قبل جوجل الرسمية، وأثارت بيعًا جماعيًا مذعورًا في قطاع الرقائق، وشوَّهت منهجيًا عملًا سابقًا تم نشره مسبقًا، من خلال تجارب غير عادلة متعمدة، لخلق سرد زائف عن ميزة أداء؟

ما فعله TurboQuant: تقليل "ورقة مسودة" الذكاء الاصطناعي إلى سدس حجمها الأصلي

عندما تُنشئ نماذج اللغة الكبيرة إجابات، تحتاج إلى الكتابة مع العودة المستمرة لمراجعة المحتوى الذي تم حسابه مسبقًا. تُخزن هذه النتائج الوسيطة مؤقتًا في ذاكرة GPU، ويُطلق عليها في الصناعة "KV Cache" (ذاكرة التخزين المؤقت للمفاتيح والقيم). كلما طال الحوار، زاد سمك هذه "ورقة المسودة"، وزاد استهلاك ذاكرة GPU والتكلفة أيضًا.

طور فريق البحث في جوجل خوارزمية TurboQuant، التي تتمثل نقطة بيعها الأساسية في ضغط هذه الورقة المسودة إلى 1/6 من حجمها الأصلي، مع ادعاء دقة لا تفقد أي معلومات وزيادة في سرعة الاستنتاج تصل إلى 8 مرات. نُشرت الورقة لأول مرة في أبريل 2025 على منصة المطبوعات الأكاديمية arXiv، وتم قبولها في يناير 2026 من قبل مؤتمر ICLR 2026 الرائد في مجال الذكاء الاصطناعي، ثم أعادت مدونة جوجل الرسمية الترويج لها في 24 مارس.

من الناحية التقنية، يمكن فهم فكرة TurboQuant ببساطة على النحو التالي: أولاً، يتم استخدام تحويل رياضي لتحويل البيانات الفوضوية إلى تنسيق موحد، ثم يتم ضغطها فرديًا باستخدام جدول ضغط محسوب مسبقًا، وأخيرًا يتم تصحيح الانحرافات الحسابية الناتجة عن الضغط باستخدام آلية تصحيح خطأ مكونة من بت واحد. لقد تحقق المجتمع المستقل من أن تأثير الضغط حقيقي إلى حد كبير، والمساهمة الرياضية من الناحية الخوارزمية حقيقية.

الجدل ليس حول ما إذا كان TurboQuant يمكن استخدامه، بل حول ما فعلته جوجل لإثبات أنه "أبعد بكثير من المنافسين".

رسالة مفتوحة من غاو جيان يانغ: ثلاث اتهامات، كل منها يصيب في الصميم

في 27 مارس، الساعة 10 مساءً، نشر غاو جيان يانغ مقالًا طويلًا على Zhihu، وقدم تعليقًا رسميًا في منصة مراجعة ICLR الرسمية OpenReview. غاو جيان يانغ هو المؤلف الأول لخوارزمية RaBitQ، التي نُشرت عام 2024 في مؤتمر SIGMOD الرائد في مجال قواعد البيانات، وتحل نفس نوع المشكلة — الضغط الفعال للمتجهات عالية الأبعاد.

اتهاماته ثلاثة، وكل منها مدعوم بسجلات بريد إلكتروني وخط زمني.

الادعاء الأول: استخدام الطريقة الأساسية لشخص آخر دون ذكرها في النص بأكمله.

الخطوة الأساسية المشتركة بين TurboQuant و RaBitQ هي: إجراء "دوران عشوائي" على البيانات قبل ضغطها. تهدف هذه العملية إلى تحويل البيانات ذات التوزيع غير المنتظم إلى توزيع موحد قابل للتنبؤ، مما يقلل بشكل كبير من صعوبة الضغط. هذه هي أكثر النقاط جوهرية وتشابهًا بين الخوارزميتين.

أقر مؤلفو TurboQuant بهذا في ردودهم على مراجعة الأوراق، لكنهم لم يذكروا أبدًا في نص الورقة بأكملها العلاقة بين هذه الطريقة وRaBitQ. والمعلومة الأساسية الأهم هي: أن مُؤلف TurboQuant الثاني، ماجيد داليري، اتصل بفريق غاو جيانيانغ في يناير 2025 طلبًا للمساعدة في تصحيح إصدار Python الذي قام بتعديله بناءً على كود RaBitQ. وقد وصف في البريد الإلكتروني خطوات إعادة الإنتاج ومعلومات الخطأ بالتفصيل — أي أن فريق TurboQuant على دراية تامة بالتفاصيل التقنية لـ RaBitQ.

أشار مراجع مجهول في ICLR أيضًا بشكل مستقل إلى أن كلا الجانبين استخدمَا نفس التقنية، وطلب مناقشة كافية. لكن في النسخة النهائية من الورقة، لم يُضف فريق TurboQuant أي مناقشة إضافية، بل نقل وصف RaBitQ (الذي كان غير كامل بالفعل) من نص المقال إلى الملاحق.

الادعاء الثاني: الادعاء دون دليل أن نظرية الطرف الآخر "غير المثلى".

ورقة TurboQuant وضعت علامة "نظرية غير مثلى" (suboptimal) على RaBitQ بحجة أن التحليل الرياضي لـ RaBitQ "خشن نسبيًا". لكن غاو جيان يانغ أشار إلى أن ورقة RaBitQ الموسعة أثبتت بشكل صارم أن خطأ الضغط تحقق الحد الأمثل رياضيًا — وهذه النتيجة نُشرت في مؤتمر رائد في علوم الحوسبة النظرية.

في مايو 2025، شرح فريق غاو جيان يانغ بالتفصيل عبر سلسلة من البريد الإلكتروني تفوق نظرية RaBitQ. وأكد داليري، المؤلف الثاني لـ TurboQuant، أنه أبلغ جميع المؤلفين. ومع ذلك، ظل النص النهائي للورقة يحتفظ بعبارة "شبه مثالي" دون تقديم أي حجج داحضة.

الادعاء الثالث: في المقارنة التجريبية، "ربط اليد اليسرى وحمل السكين باليد اليمنى".

هذا هو الأكثر تأثيرًا في النص الكامل. أشار غاو جيان يانغ إلى أن ورقة TurboQuant أضافت شرطين غير عادلين في تجارب المقارنة السريعة:

أولاً، قدم فريق RaBitQ رموز C++ مُحسّنة (تدعم افتراضياً التوازي متعدد الخيوط)، لكن فريق TurboQuant لم يستخدمها، بل استخدم نسخة Python التي قاموا بترجمتها لاختبار RaBitQ. ثانياً، تم اختبار RaBitQ باستخدام معالج نواة واحدة مع تعطيل التوازي متعدد الخيوط، بينما استخدم TurboQuant وحدة معالجة رسوميات NVIDIA A100.

التأثير الناتج عن تراكُم هذين الشرطين هو أن القارئ يرى الاستنتاج القائل بأن "RaBitQ أبطأ ببضعة أبعاد من TurboQuant"، دون أن يكون لديه أي وسيلة لمعرفة أن هذا الاستنتاج يعتمد على افتراض أن فريق جوجل قيّد خصمَه قبل بدء السباق. لم تُكشف في الورقة الأكاديمية بشكل كافٍ الفروق في شروط التجربة هذه.

رد جوجل: "الدوران العشوائي تقنية عامة، ولا يمكن الإشارة إليها في كل مقال"

وفقًا لما أكده غاو جيان يانغ، أفاد فريق TurboQuant في ردّهم عبر البريد الإلكتروني في مارس 2026: "استخدام التحويل العشوائي وتحويل جونسون-ليندنستراوس هو بالفعل تقنية قياسية في هذا المجال، ولا يمكننا الاستشهاد بكل ورقة بحثية استخدمت هذه الطرق."

يعتقد فريق غاو جيان يانغ أن هذا تغيير مفهومي: المشكلة ليست ما إذا كان يجب الاستشهاد بجميع الأوراق التي استخدمت الدوران العشوائي، بل أن RaBitQ هي أول عمل يجمع بين هذه الطريقة وضغط المتجهات في نفس الإعداد الدقيق للمسألة، ويجب أن تصف ورقة TurboQuant العلاقة بينهما بدقة.

قامت مجموعة Stanford NLP الرسمية على X بإعادة تغريدة بيان غاو جيان يانغ. وقد نشر فريق غاو جيان يانغ تعليقًا عامًا على منصة ICLR OpenReview، وقدم شكوى رسمية إلى رئيس مؤتمر ICLR ولجنة الأخلاقيات، وسيقومون لاحقًا بنشر تقرير تقني مفصل على arXiv.

قدم المدون التقني المستقل داريو سالفاتي تقييمًا محايدًا نسبيًا: إن TurboQuant تقدم مساهمات حقيقية من حيث المنهجية الرياضية، لكن علاقتها بـ RaBitQ أوثق بكثير مما تشير إليه الورقة.

تبخر قيمتها السوقية بقيمة 90 مليار دولار: ازدياد الجدل حول الورقة البحثية مع تفاقم الذعر في السوق

حدثت هذه الجدل الأكاديمي في لحظة دقيقة للغاية. بعد أن أصدرت جوجل TurboQuant عبر مدونتها الرسمية في 24 مارس، تعرض قطاع شرائح التخزين العالمية لبيع هائل. وفقًا لتقارير من多家 وسائل إعلام مثل CNBC، تراجعت ميموريكست لستة أيام تداولية متتالية، بخسارة تراكمية تزيد عن 20٪؛ وهبطت سانديسك بنسبة 11٪ في يوم واحد؛ وهبطت إس كي هايليس الكورية الجنوبية حوالي 6٪، و三星 إلكترونيكس حوالي 5٪، وهبطت كايشيا اليابانية حوالي 6٪. منطق الذعر في السوق بسيط وقاسي: يمكن للضغط البرمجي تقليل متطلبات الذاكرة لاستنتاج الذكاء الاصطناعي بمقدار 6 مرات، مما سيؤدي إلى تخفيض هيكلية في آفاق طلب شرائح التخزين.

حلل جوزيف مور من مورغان ستانلي هذا المنطق في تقرير صادر في 26 مارس، وحافظ على تقييم "الشراء" لشركة ميموريك وسانديسك. وأشار مور إلى أن ضغط TurboQuant يقتصر فقط على نوع معين من الذاكرة المؤقتة، وهو KV Cache، وليس على استخدام الذاكرة الكلي، ووصفه بأنه "تحسين إنتاجية طبيعي". كما استشهد المحلل من بنك ويلز فارجو، أندرو روشيا، بمعضلة جيفونز، معتبرًا أن تحسين الكفاءة الذي يخفض التكاليف قد يحفز في النهاية نشرًا أوسع للذكاء الاصطناعي، مما يزيد الطلب على الذاكرة.

أوراق قديمة، تغليف جديد: مخاطر سلسلة نقل البحث إلى السرد السوقى للذكاء الاصطناعي

وفقًا لتحليل الكاتب التقني بن بولاديان، تم نشر ورقة TurboQuant في أبريل 2025، وليس هي بحثًا جديدًا. وفي 24 مارس، أعادت جوجل الترويج لها من خلال مدونتها الرسمية، لكن السوق قام بتسعيرها كإنجاز جديد. إن استراتيجية التسويق هذه "ورقة قديمة، إصدار جديد"، جنبًا إلى جنب مع التحيزات التجريبية المحتملة في الورقة، تعكس المخاطر النظامية في سلسلة نقل الأبحاث الذكية الاصطناعية من الأوراق الأكاديمية إلى السرد السوقي.

للمستثمرين في بنية تحتية الذكاء الاصطناعي، عندما تدّعي ورقة بحثية تحقيق تحسن في الأداء "بعدة درجات من الحجم"، فإن أول سؤال يجب طرحه هو ما إذا كانت شروط المقارنة المرجعية عادلة.

فريق غاو جيان يانغ قد أوضح صراحة أنه سيستمر في دفع الحل الرسمي للمشكلة. لم تقدم جوجل أي رد رسمي على الادعاءات الواردة في الرسالة المفتوحة.