هذه الثلاثون يومًا المجنونة، وعشرة نماذج كبيرة، كأنها عرض ألعاب نارية صاخب.

مؤلف المقال والمصدر: 0x9999in1، ME News

ملخص

- ثلاثون يومًا من التنافس الشديد: من 26 مارس إلى 24 أبريل، تم الإطلاق العالمي لـ 11 نموذجًا كبيرًا رئيسيًا، بمتوسط نموذج واحد كل 2.7 يوم. يواجه السوق إرهاقًا حادًا في المعلمات.

- عملية تقليل وزن "المُتَّخِذ للكميات الكبيرة" للمعلمات: يصل إجمالي معلمات V4-Pro إلى 1.6 تريليون، لكن المُفعّلة فقط 49 مليار. من خلال إعادة تصميم هندسة CSA+HCA، انخفضت FLOPs إلى 27% تحت سياق 1M، وانخفض ذاكرة التخزين المؤقت KV إلى 10% فقط، وهي نسبة مخيفة للغاية.

- فصل التفاضل في علم التحويل: اعتماد نموذج تدريب ما بعد التدريب الجديد "التعلم المعزز المستقل أولاً، ثم التبخير عبر الإنترنت للدمج"، حيث يقترب V4-Pro-Max من الحد الأقصى للحلول المغلقة في المهام الاستدلالية والوكيلية.

- أصوات ملموسة بالذهب والفضة: بعد أن دفع GPT-5.5 نيفيديا للارتفاع بنسبة 4.2% في يوم واحد ثم بلغ ذروته، أشعل V4، بفضل انفتاحه الكامل من قبل MIT، ارتفاعًا مستمرًا في سلسلة قوة الحوسبة المحلية في الصين وهونغ كونغ.

- منطق اللعبة العميقة: النماذج المغلقة تبيع "الضريبة"، بينما النماذج الكبيرة المفتوحة المصدر تبيع "الحديد". ظهور V4 جعل دفتر حسابات قوة الحوسبة الخاصة بالشركات على مستوى العالم يصبح متوازنًا أخيرًا.

شهر أبريل المليء بالفوضى الإلهية، مع إرهاق السوق من الجماليات

مجنون. كلهم مجانين.

إذا كنت مراقبًا مُتَّصِلًا بقطاع الذكاء الاصطناعي، فمن المرجح أنك شعرت بعدم ارتياح جسدي خلال الثلاثين يومًا الماضية. من 26 مارس 2026 إلى 24 أبريل، وفي فترة قصيرة لا تتجاوز شهرًا واحدًا، تم طرح ما لا يقل عن 11 نماذج كبيرة ذات تأثير ملحوظ في السوق عالميًا.

القائمة تبدو وكأنها قائمة أطباق: Anthropic Opus 4.6 و Google Gemini 3.1 Pro و OpenAI GPT-5.5 و Mistral Large 3 و Meta Llama 4 و Moonshot Kimi K2.6 و Alibaba Qwen3-Next و ByteDance Doubao 2.5 Pro و Tencent Hunyuan 3.0 و Kimi K2.6 Plus.

كما تم إطلاق DeepSeek V4 في منتصف ليلة 23 أبريل، كقنبلة غواصة هادئة.

بمتوسط، يُطلق نموذج جديد كل 2.7 يوم. هذا أسرع من أن ي успевают قراءة الإعلانات حتى صنّاع الصناديق الاستثمارية. بينما يستمع المستثمرون إلى "تفوق المعلمات" من الشركة A، تصل بالفعل إلى مكاتبهم "تفوق الأداء" من الشركة B. السوق أصبح في الواقع مُتعَبًا. ما يُسمى بـ"التصنيف عبر اختبارات المعيار" أصبح في ظل التنافس الشديد اليوم أكثر شبهاً ب لعبة رقمية ترفيهية ذاتية.

لكن المال ذكي. أو بمعنى آخر، شموع الكي لا تكذب أبداً.

عندما تحلل شموع K لـ 30 يومًا من الأصول الذكية في الولايات المتحدة والصين وهونغ كونغ، ستجد واقعًا قاسيًا للغاية: في هذه "حرب الآلهة"، هناك عقدان فقط هما اللذان تركا أثرًا مستمرًا على الرسم البياني.

أولاً، في 8 أبريل، أطلقت OpenAI من الجانب الآخر من المحيط GPT-5.5. هذا الملك غير المتنازع عليه، أدى مباشرة إلى ارتفاع نيفيديا بنسبة 4.2% في يوم واحد. ثم؟ لا شيء بعد ذلك، وصل إلى ذروته في يوم واحد، وانقضت المكاسب الإيجابية. اكتشف الجميع أن حتى أعظم الملوك المغلقين يصعب عليهم الآن، كما كان قبل عامين، تحريك جبل رأس المال العالمي الثقيل.

العقد الثاني، من 23 إلى 24 أبريل. إصدار تجريبي لـ DeepSeek V4. لا حفل إصدار مبهر، ولا إعلانات ترويجية مذهلة. تم رفع الأوزان مباشرة على Hugging Face و ModelScope، برخصة MIT.

النتيجة؟ لقد دفع ذلك سلسلة قوة الحوسبة في الصين وهونغ كونغ للخروج من موجة ارتفاع متتالية.

لماذا تمكّن نموذج مفتوح المصدر من فعل ما لم يستطعه كبار المطورين المغلقين؟

للاجابة على هذا السؤال، علينا أن نتصرف كقاصّ، نتجاهل التصريحات الرسمية الجافة، ونفتح غطاء محرك DeepSeek V4 لنرى ماذا يوجد بداخله بالضبط.

تحليل V4: التخلي عن الإيمان الجامد بجمالية القوة في المعلمات

النماذج الكبيرة. مكلفة جدًا. هذا أمر معروف للجميع.

في العام الماضي، وقع مصنعو النماذج الكبيرة في حالة من "خوف نقص القوة النارية". أنت تصنع تريليون، وأنا أصنع تريليونين. كان الجميع يعتقدون أنه كلما زادت القوة، زادت الذكاء الناتج، ويمكنه حل كل المشكلات. لكن هذا أدى إلى تكاليف حوسبة مخيفة للغاية. حتى احتياطي الحبوب لدى الأرستقراطيين لم يعد كافيًا للحرق.

يقدم DeepSeek V4两款 نماذج MoE (الخبراء المختلطون): V4-Pro و V4-Flash. دعونا نلقي نظرة على بعض البيانات الأساسية أولاً.

V4-Pro: إجمالي المعلمات 1.6 تريليون (1.6 تريليون)، ولكن كل معلمة مُفعّلة لكل رمز تبلغ فقط 49 مليار (49 مليار).

V4-Flash: المعلمات الإجمالية 284B (284 مليار)، المعلمات المُفعَّلة فقط 13B (13 مليار).

فهمت؟ هذا نوع من "تحريك كمية صغيرة لتحريك كمية كبيرة" بدرجة كبيرة من الضبط. جوهر بنية MoE هو ألا تُفعّل جميع الإنذارات في كل مرة. عند مواجهة مهمة تشبه قتل دجاجة، قم ب调动 خبراء قتل الدجاج؛ وعند مواجهة مهمة تشبه قتل تنين، اجلب سيف قتل التنين. القاعدة البالغة 1.6 تريليون تضمن أنها "لقد رأت العالم وذكية"؛ والتفعيل البالغ 49 مليار يضمن أنها "سريعة الاستجابة ورشيقة".

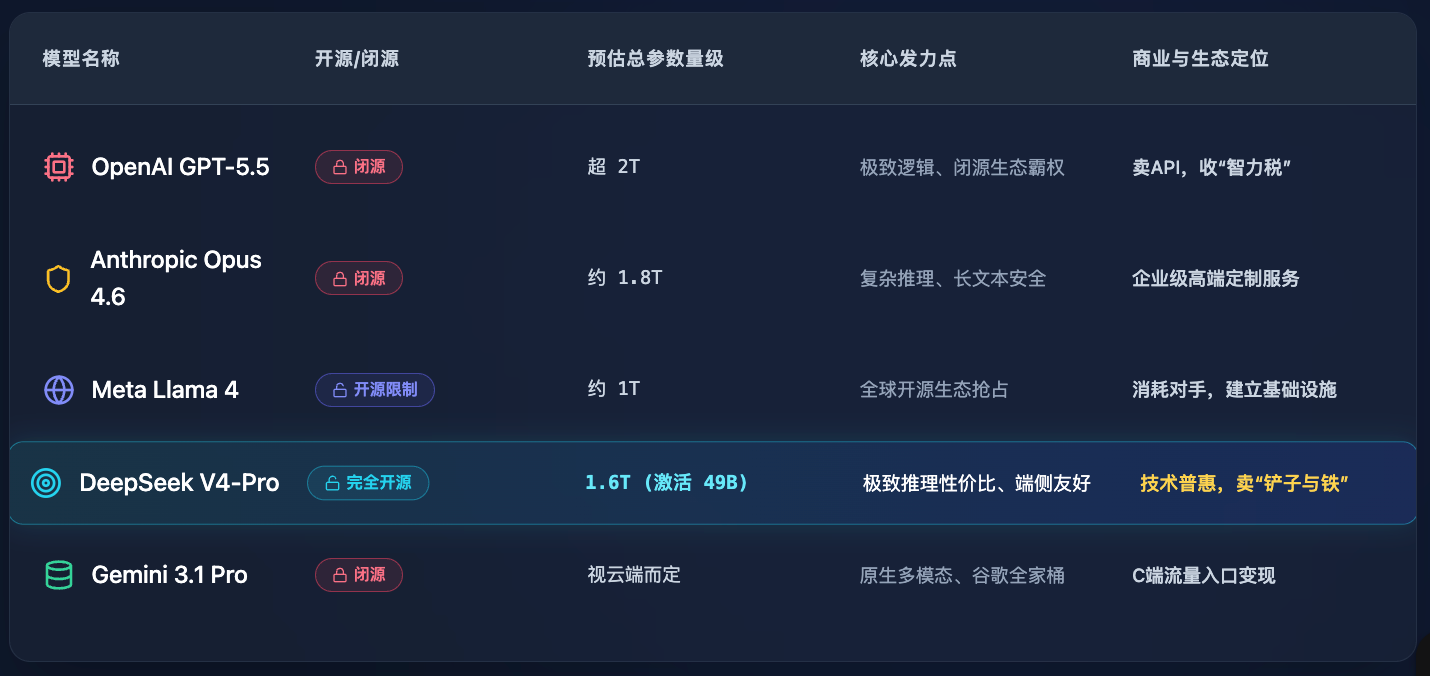

للفهم الأوضح لهذه الفجوة، نقوم بإنشاء جدول يقارن بين المسارات الرئيسية الحالية في السوق (البيانات هي تقديرات وحسابات معلنة من السوق):

من خلال النظر إلى الجدول، يمكن ملاحظة أن V4-Pro لم يسعَ بشكل مفرط لتجاوز GPT-5.5 من حيث إجمالي المعلمات، بل ركّز كل جهوده على "كيفية جعل هذا العملاق يستهلك طاقة أقل ويعمل بسرعة أكبر".

لكن هذا ليس كافيًا. ما جعل الخبراء يشفقون حقًا هو القضاء اللامع على "قتلة الذاكرة العرضية".

يوم نهاية عصابات ذاكرة العرض: ثلاث سكاكين تُجرح العظم من الناحية المعمارية

ما هو "قاتل ذاكرة العرض"؟ إنه "السياق الطويل (Long Context)".

الآن جميع الأطراف تتباهى بدعمها لـ 1M (مليون) مُدخلات سياقية. يبدو الأمر ممتعًا، فبإدخال كتاب كامل "ثلاثية الممالك"، يمكنه قراءته في بضع ثوانٍ. لكن ما هي التكلفة؟ عند الاستدلال، تُنتج النصوص الطويلة ذاكرة KV ضخمة (استخدام ذاكرة GPU لتخزين المعلومات السابقة). هذا يشبه أنك عندما تقرأ صفحة من كتاب، يجب أن تنسخ محتوى الصفحة السابقة على لوح أسود كبير وتضعه أمامك. عندما تصل إلى المليون كلمة، سيكون هناك عدد هائل من اللوحات السوداء لا يكفي حتى لتخزينها في مراكز بيانات تشونغتشيان.

الذاكرة أكثر تكلفة من قوة الحوسبة. هذه قاعدة غير معلنة في صناعة الذكاء الاصطناعي.

كيف يحل DeepSeek V4 هذه المشكلة؟ لقد أجرى "جراحة" مباشرة على آلية الانتباه الأساسية. هذه هي أول وأكثر سكينتهم قسوة في ترقيتهم المعمارية: آلية الانتباه المختلطة (CSA + HCA).

CSA (الانتباه المضغوط المتناثر) بالإضافة إلى HCA (الانتباه المضغوط بشدة)، يبدو وكأنه لغة من المريخ، لكن الترجمة البشرية هي: لم يعد يحفظ عن ظهر قلب، بل تعلم "تحديد النقاط المهمة" و"أخذ ملاحظات موجزة جدًا".

النتيجة هائلة: تحت سياق 1M، لا تتجاوز FLOPs (عدد العمليات العائمة) لـ V4-Pro في استدلال وحدة واحدة 27% من نسخة الجيل السابق V3.2! وأكثر إثارة للرعب أن ذاكرة KV لا تتجاوز 10% من V3.2!

ما هذا المفهوم؟ إنه مثل مهمة نص طويل بمليون حرف كانت تتطلب سابقًا 10 خوادم رائدة لتشغيلها بالكامل، والآن يتم إنجازها بسهولة بواسطة خادم واحد فقط. تراجعت تكلفة قوة الحوسبة إلى عُشرها. هذه تحسينات على مستوى إعادة تشكيل اللعبة.

Still two more knives.

السكين الثانية تُسمى "الوصلات الفائقة المقيدة بالتنوع (mHC)". في النماذج الكبيرة السابقة، كانت نقل المعلومات بين الطبقات يُستخدم فيه "الوصلات المتبقية التقليدية"، مثل استخدام أنابيب حديدية قديمة ومُصَدَّأة لنقل المياه، حيث تتسرب بسهولة عند ارتفاع الضغط. وعند مواجهة كمية هائلة من بيانات التدريب المسبق البالغة 32T رمزًا، لم تكن الأنابيب القديمة قادرة على التحمل. إن mHC تشبه استبدال الشبكة بشبكة الألياف البصرية، مما يعزز استقرار انتشار الإشارات عبر الطبقات. بدون فقدان الحزم، ولا انحراف.

السكين الثالثة: تغيير زيت محرك الـ optimizer. تخلّص من التقليدي واستخدم مُحسّن Muon. وظيفته تسريع التقارب. أثناء صنع دواء واحد، يحتاج الآخرون سبعة أسابيع وسبعة أيام، لكنه قد يُنهي العملية في عشرين يومًا. الوقت هو المال، ووقت التشغيل هو دولارات.

هذه الضربات الثلاثة عالجت تمامًا "مرض الثراء" في النماذج الكبيرة V4.

السر داخل فرن التحويل: من العمل المنفصل إلى التوحيد الشامل

الجميع في الصناعة يعلمون أن التدريب المسبق يحول "الأمي" فقط إلى "شخص يملك الكثير من المعرفة لكنه لا يستطيع التحدث". ما يجعله فنانًا استثنائيًا حقًا هو التدريب اللاحق (Post-training).

DeepSeek V4 لعبت في التدريب اللاحق لعبة شديدة الصرامة من "فن الحرب على مرحلتين".

في الماضي، كان الناس يدرّبون MoE كما لو أن مجموعة من المعلمين يعلمون طالبًا واحدًا، وكان من السهل أن يحدث خلاف بينهم. كيف يفعل V4 ذلك؟

المرحلة الأولى: "القتال منفصلًا". تستخدم هذه الطريقة التFINE المراقب (SFT) وتحسين الاستراتيجية النسبية للمجموعة (GRPO) للتعلم المعزز، لفصل "شبكات الخبراء" المختلفة داخل النموذج وتدريبها بشكل منفصل. يتدرب خبير البرمجة يوميًا على كتابة الكود، بينما يتدرب خبير الرياضيات يوميًا على حل مسائل الرياضيات. لا علاقة بينهما، ولا تداخل. هذا يُعرف بدفع القدرة الفردية إلى أقصى حد.

المرحلة الثانية: "جميع الطرق تعود إلى جوهر واحد". باستخدام تقنية التقطير عبر الإنترنت، يتم دمج هؤلاء الخبراء الذين تمكنوا من إتقان فنون قتالية ممتازة في نموذج واحد متماسك. بدون هدر داخلي أو توقف.

لنلقِ نظرة على الحيلتين الكبيرتين اللتين أجبروهما على استخدامهما.

أولاً، وضع V4-Pro-Max. هذا هو أقوى وضع استدلال. إنه مثل فتح قفل الجينات. وفقًا لما يدّعونه (وتم التحقق منه بسرعة من قبل المجتمع)، فقد وصل V4-Pro بالفعل إلى مستوى رائد في اختبارات البرمجة، بينما تقلص الفرق بشكل ملحوظ مع نماذج مغلقة متقدمة (مثل GPT-5.5 و Opus 4.6) في مهام الاستدلال المعقدة وAgent (الوكلاء).

ثانيًا V4-Flash-Max. هذا أكثر إثارة للاهتمام. إنه صغير بحجم 284B فقط، لكنه بعد تزويده بميزانية تفكير كافية، يحقق أداء استدلالًا يقارب Pro. ما الذي يوضحه هذا؟ أنه يوضح أن "جودة الخوارزمية" بدأت تتفوق على "حجم المعلمات". طالما أعطيته وقتًا كافيًا للتفكير، يمكن لدماغ صغير أن يحل مشكلات كبيرة. بالطبع، في تخزين المعرفة البحتة ومهام Agent متعددة الخطوات المعقدة جدًا، لا يزال محدودًا بحجم المعلمات (فالأمعاء ليست كبيرة جدًا)، لكن هذا يكفي لأداء مفرط في معظم التطبيقات اليومية للشركات.

في النهاية، تم تخزين الأوزان بذكاء شديد باستخدام تخزين دقة مختلطة FP4+FP8، مما حافظ على الدقة ووفر ذاكرة العرض. كل شيء ينضح بجاذبية طالب علوم دقيق.

للمقارنة الأوضح لتحسين كفاءة الهندسة الناتج عن التدريب اللاحق، نقوم بعرض جدول مقارنة للمؤشرات الصلبة:

رائحة رأس المال: لماذا أشعل V4 سلسلة قوة الحوسبة في الصين وهونغ كونغ؟

هنا، تم تحليل الجوانب التقنية تقريبًا. لكننا لم نجب بعد على السؤال الجوهري الذي طرحناه في البداية:

لماذا لم تُحدث GPT-5.5 طفرة مستمرة في قطاع القوة الحسابية، بينما نجح DeepSeek V4 في ذلك؟

هذا يتطلب منا الخروج من الكود، ورؤية هذه المعركة من منظور رأس المال والأعمال.

GPT-5.5 قوي جدًا، لا يُهزم. لكنه مغلق المصدر. ماذا يعني مغلق المصدر؟ يعني أن OpenAI هي "ثقب أسود" ضخم. إذا أردت استخدام قدراته، فعليك شراء واجهة برمجة التطبيقات الخاصة به. إنها نموذج "فرض ضرائب". تتدفق الأرباح إلى سيليكون فالي، وتركز متطلبات الحوسبة على مراكز بيانات مايكروسوفت السحابية. بالنسبة لشركات الأجهزة العالمية، ومراكز الحوسبة المحلية، ووكلاء الخوادم في مختلف الدول، لا يحصلون على سوى القليل جدًا من هذه الأرباح، ولا يمكنهم سوى النظر من بعيد. حتى لو كان GPT-5.5 قويًا جدًا، فهو احتفال لآخرين. ارتفعت أسهم نفيديا لأن الناس يعتقدون أن OpenAI ستطلب المزيد من البطاقات.

لكن DeepSeek V4 مختلف.

إنه مفتوح المصدر. وهو ترخيص MIT شديد الشمول. إن بروتوكول MIT هو أكثر الهبات سخاءً في عالم مفتوح المصدر، مما يعني أن الشركات التجارية يمكنها استخدامه وتعديله وبيعه مجانًا دون القلق من المخاطر القانونية.

الأكثر فتكًا أننا خصصنا قسمًا كبيرًا من المقدمة لمناقشة أن V4 خفّض تكلفة الاستدلال والنماذج واستهلاك الذاكرة إلى الكاحل.

عند دمج هذين العنصرين، تصل إلى استنتاج يُجنّ الأسواق المالية: لقد وصلت نقطة الحرج للنشر الخاص.

في الماضي، عندما أرادت الشركات نشر نموذج كبير بحجم أكثر من 1 تيرابايت، كانت تنظر إلى قائمة أسعار الأجهزة، وتُغلقها بصمت، ثم تتحول لشراء واجهة برمجة التطبيقات. الآن، يخبرنا V4 الجميع: يمكنك تشغيل عقل فائق يقترب بشكل لا يُصدق من GPT-4 أو حتى يتحدى مستوى GPT-5.5 باستخدام عدد قليل جدًا من الآلات محليًا. البيانات لا تحتاج إلى مغادرة المحافظة أو الدولة، وهي آمنة تمامًا.

بما أن الجميع يمكنهم الآن تشغيله محليًا، فماذا سيحدث بعد ذلك؟

اشترِ الماكينات! اشترِ الخوادم! اشترِ وحدات الضوئية! أنشئ مركز حوسبة ذكي!

الشركات ذات الكود المغلق تبيع ضريبة الذكاء، بينما الشركات ذات الكود المفتوح تُساعِد في تسويق المنتجات للشركات المصنعة للعتاد في الصناعة بأكملها. DeepSeek V4 هو من ألقى شرارة ذلك. كلما كان أكثر فعالية وأكثر انفتاحًا، زاد الطلب المتصاعد على قدرات الحوسبة المحلية في مناطق مثل الصين القارية وهونغ كونغ وتايوان. الشركات التي تقوم بتركيب الخوادم، وتطوير التبريد السائل، وصيانة مراكز البيانات، بدأت أخيرًا في رؤية الأرباح الحقيقية من التبني الواسع النطاق.

هذا هو السبب في أن سلسلة قوة الحوسبة في الصين وهونغ كونغ ارتفعت بشكل متواصل فور إطلاق الإصدار V4 في 23 أبريل. فالرأسمال لا يدفع مقابل العاطفة، بل يتخذ موقفًا مسبقًا استعدادًا لـ "الموجة الهائلة للنشر الخاص في آلاف الصناعات" القادمة.

هذا هو المخطط التجاري الأساسي.

الخاتمة: انحسار المد والصخور

هذه الثلاثون يومًا المجنونة، وعشرة نماذج كبيرة، كأنها عرض ألعاب نارية صاخب.

يُلوح الأضخمون في حلبة المعلمات بعملاتهم الرقمية، محاولين كسر خصومهم بقبضة الحوسبة. لكن بعد هدوء الضجيج، غالبًا ما لا يكون الأكثر ضجيجًا هو من يبقى ليغير خريطة الصناعة.

ظهور DeepSeek V4 يشبه قاتلًا هادئًا. إنه لا يقارن معك في من ينفق أكثر، بل يهاجم فقط أضعف نقطة: إزالة ذاكرة العرض غير الضرورية، وخفض عتبة النشر، وتحويل المباريات الراقية إلى مباريات شعبية.

في معركة الذكاء الاصطناعي المعروفة باسم "راغناروك"، يقترب عصر التراكم العشوائي للمعلمات من نهايته المتسارعة. ستنتمي ساحة المعركة المستقبلية إلى أولئك الذين يستطيعون إيجاد توازن مثالي بين "الأداء الفائق" و"الكفاءة الهندسية".

ستنحسر الموجة دائمًا، وبعد انسحابها، ستعرف من كان يسبح عاريًا ومن هو الصخرة غير القابلة للكسر.

V4 قد وزّع الأسلحة على الجميع. الآن، ينتظر لرؤية كيف سيقيم كل أمراء الحرب مخيماتهم على هذه الأرض الجديدة.

بمجرد أن تفهم هذا المستوى، عندما تستمع إلى تلك الضجيج التي تتحدث عن "إطلاق مذهل" أو "إعادة تعريف"، ربما تشعر بمزيد من الهدوء وأقل قلقًا.

في النهاية، حتى السحر الأكثر روعة يجب أن يُسجّل في الدفاتر ويُحسب بدقة على قطع الفضة القليلة.

المصدر:

- مقدمة سلسلة DeepSeek V4 الإصدار الرسمي، فريق DeepSeek، GitHub/ModelScope/HuggingFace. (2026).

- حالة الذكاء الاصطناعي في أبريل: تحليل دورة النموذج الكبير لمدة 30 يومًا, ME News Market Observer. (2026).

- قوانين التوسع والتحول في نموذج ما بعد التدريب, مجلة اقتصاد الذكاء الاصطناعي. (2026).

- تقرير نبض سوق سلسلة توريد الحوسبة العالمي (أبريل 2026)، تحليل البيانات المالية عبر آسيا. (2026).