یہ پاگلپن بھرے تیس دن، ایک گیارہ بڑے ماڈلز، جیسے ایک شورشی آتش بازی کا مظاہرہ ہے۔

مضمون کے مصنف، ماخذ: 0x9999in1، ME News

ٹی ایل؛ ڈی آر

- تیس دن کی شدید مقابلہ: 26 مارچ سے 24 اپریل تک، دنیا بھر میں 11 اہم بڑے ماڈلز جاری کیے گئے، اوسطاً ہر 2.7 دن پر ایک۔ مارکیٹ کو شدید "پیرامیٹر تھکاوٹ" کا سامنا ہے۔

- پیرامیٹر گڈی کا “وزن کم کرنے کا آپریشن”: V4-Pro کے کل پیرامیٹرز 1.6T ہیں، لیکن صرف 49B فعال ہیں۔ CSA+HCA آرکیٹیکچر کے ری شیپنگ کے ذریعے، 1M کنٹیکسٹ میں FLOPs 27% تک کم ہو گئے اور KV کیش صرف 10% تک کم ہو گئی۔

- ڈین جیو کی تکنیک کا ڈیفیس کاٹنا: "پہلے انڈیپینڈنٹ رینفورسمنٹ لرننگ، پھر آن لائن ڈسٹلیشن اور ادغام" کا نئے بعد کی تربیت کا طریقہ متعارف کرایا گیا، V4-Pro-Max تجزیہ اور ایجنٹ کے کاموں میں بند ذرائع کی حد تک پہنچ گیا ہے۔

- سچی کرنسی کے ووٹ: GPT-5.5 نے نیوڈا کو صرف ایک دن کے 4.2% کے اضافے کے ساتھ چوٹی پر پہنچایا، جبکہ V4 نے MIT کے مکمل اوپن سورس ہونے کے باعث چین اور ہانگ کانگ کی مقامی کمپوٹنگ چین کو مکمل طور پر جلایا۔

- گہری گیم کا منطق: بند ماڈلز "ٹیکس" بیچ رہے ہیں، جبکہ اوپن سورس بڑے ماڈلز "آئرن" بیچ رہے ہیں۔ V4 کے ظہور سے عالمی کاروباری خفیہ ڈپلویمنٹ کے کمپوٹنگ لیجر کو بالآخر برابر کیا جا سکا ہے۔

خداوند کے جنون کا اپریل، اور بازار کی سائے کی تھکن

پاگل ہو گئے۔ سب پاگل ہو گئے۔

اگر آپ AI کے شعبے پر نظر رکھنے والے ہیں، تو گزشتہ تیس دن آپ کو جسمانی طور پر ناراض کرنے والے ثابت ہوئے ہوں گے۔ 26 مارچ 2026 سے 24 اپریل تک، صرف ایک ماہ سے کم کے اندر، دنیا بھر میں کم از کم 11 بڑے ماڈلز جو قابلِ ذکر اثر رکھتے ہیں، بازار میں آ گئے۔

فہرست ایسی لگ رہی ہے جیسے کھانے کے نام پڑھے جا رہے ہوں: Anthropic Opus 4.6، گوگل Gemini 3.1 Pro، OpenAI GPT-5.5، Mistral Large 3، Meta Llama 4، مہینے کا اندھیرا جانب Kimi K2.6، علی بابا Qwen3-Next، بائٹڈانس DouBao 2.5 Pro، تینگن ہون یوان 3.0، Kimi K2.6 Plus۔

اور 23 اپریل کی رات کو، ڈیپ سیک V4 ایک گہرے پانی کے بم کی طرح خاموشی سے لانچ ہوا۔

سراسر میں، ہر 2.7 دن میں ایک نیا ماڈل جاری ہوتا ہے۔ یہ ایسا رفتار ہے کہ فنڈ مینیجر بھی اس کی ریلیز نوٹس پڑھنے کے قابل نہیں ہوتے۔ سرمایہ کار ابھی تک A کمپنی کے "پیرامیٹر سپرسیڈ" کو سن رہے ہوتے ہیں کہ B کمپنی کا "اسکور کا دباو" پہلے ہی ان کے ڈیسک پر آ چکا ہوتا ہے۔ مارکیٹ اصل میں بے حس ہو چکی ہے۔ اب "بینچ مارک" کا ٹاپ پر چڑھنا، شدید مقابلے کے دور میں، ایک ایسی ڈیجیٹل گیم بن چکا ہے جو صرف خود کے لیے ہے۔

لیکن پیسہ اچھا سمجھتا ہے۔ یا کہو، کی ایکس پر کبھی جھوٹ نہیں بولتی۔

ان 30 دن کے چین، امریکہ اور ہانگ کانگ کے AI اثاثوں کے کیل فن کو دیکھ کر، آپ ایک بہت ہی سرد حقیقت پر آ جائیں گے: اس "خداوں کے جنگ" میں، جو صرف دو نوڈس ہی ٹریڈنگ پلیٹ فارم پر مستقل نشان چھوڑ پائے ہیں۔

پہلا، 8 اپریل کو امریکہ میں OpenAI نے GPT-5.5 جاری کیا۔ یہ بے شک بادشاہ تھا، جس نے نیوڈیا کو ایک دن میں 4.2% تک بڑھا دیا۔ پھر؟ کچھ نہیں ہوا، ایک دن کے بعد چوٹی پر پہنچ گیا، مثبت خبریں ختم ہو گئیں۔ لوگوں نے محسوس کیا کہ کوئی بھی اتنا عظیم بند ماڈل، دو سال پہلے کی طرح دنیا بھر کے سرمایہ کے اس بھاری پہاڑ کو آسانی سے نہیں ہلا سکتا۔

دوسرا نوڈ، 23 سے 24 اپریل تک۔ DeepSeek V4 پریویو ورژن جاری۔ کوئی شاندار متعارف کرائی نہیں، کوئی حیرت انگیز ویڈیو نہیں۔ وزن فوراً Hugging Face اور ModelScope پر ڈال دیا گیا، MIT لائسنس کے تحت۔

نتیجہ؟ اس نے چین اور ہانگ کانگ کی کمپیوٹنگ طاقت کی سلسلہ وار اچانک اضافہ کو بڑھایا۔

کیوں؟ کیوں ایک اوپن سورس ماڈل نے وہ کام کر لیا جو بہت سے بند سورس بڑوں نے نہیں کیا؟

اس سوال کا جواب دینے کے لیے، ہمیں ایک کہانی سنانے والے کی طرح، تھکا دینے والی پریس ریلیزز کو چھوڑ کر، DeepSeek V4 کے انجن کا کور کھولنا ہوگا اور دیکھنا ہوگا کہ اس کے اندر کیا جانور ہے۔

وی 4 کا تجزیہ: پیرامیٹرز کی تشدد کی خوبصورتی پر اعتماد نہ کریں

بڑا ماڈل۔ بہت پیسہ خرچ ہوتا ہے۔ یہ بات سب جانتے ہیں۔

گزشتہ سال، بڑے ماڈل فراہم کنندگان ایک "طاقت کی کمی کے خوف" میں پھنس گئے۔ تم نے ٹریلین کیا، تو میں نے دو ٹریلین کیا۔ سب کو لگا کہ صرف طاقت سے، نمٹنے والی ذہانت تمام مسائل حل کر دے گی۔ لیکن اس کے ساتھ بہت خوفناک کمپوٹیشنل لاگت آ گئی۔ زمیندار کے پاس بھی اتنی زیادہ دانہ نہیں رہا جتنا جلانے کے لیے درکار ہے۔

ڈیپسیک V4 نے اس بار دو MoE (مکسڈ ایکسپرٹس) ماڈلز جاری کیے ہیں: V4-Pro اور V4-Flash۔ آئیے پہلے کچھ مرکزی ڈیٹا دیکھتے ہیں۔

V4-Pro: کل پیرامیٹرز 1.6T (1.6 ٹریلین)، لیکن ہر ٹوکن کے لیے فعال پیرامیٹرز صرف 49B (490 ارب)۔

V4-Flash: کل پیرامیٹرز 284B (2840 ارب)، فعال پیرامیٹرز صرف 13B (130 ارب)۔

کیا آپ سمجھ گئے؟ یہ انتہائی پابندی والی “چھوٹی سی کوشش سے بڑا اثر” ہے۔ MoE آرکیٹیکچر کا اصل مطلب یہ ہے کہ ہر بار تمام ایلارمز نہ چلائیں۔ اگر مرغی مارنے کا کام ہو تو صرف کچھ مرغی مارنے والے ماہرین کو متحرک کریں؛ اگر درندہ مارنے کا کام ہو تو درندہ مارنے والی تلوار کو بلائیں۔ 1.6 ٹریلین کی بنیاد اسے “دنیا دیکھ چکا، علم و حکمت والا” بناتی ہے؛ 490 بلین کی فعال صلاحیت اسے “تیز رفتار، لچکدار” بناتی ہے۔

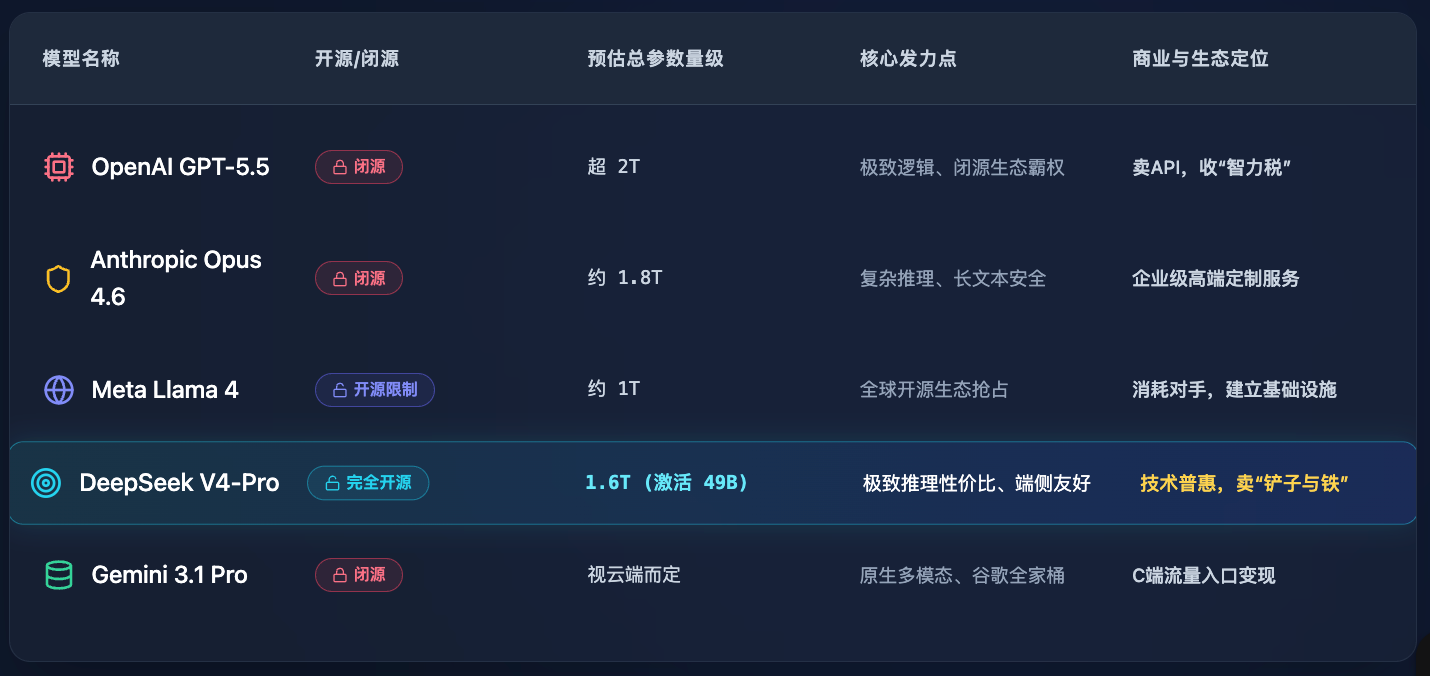

اس فرق کو زیادہ واضح طور پر سمجھنے کے لیے، ہم موجودہ مارکیٹ پر مبنی مقبول راستوں کا موازنہ کرتے ہوئے ایک جدول بناتے ہیں (ڈیٹا مارکیٹ کے علیحدہ اندازوں اور حسابات پر مبنی ہے):

جدول دیکھ کر واضح ہوتا ہے کہ V4-Pro نے کل پیرامیٹرز میں GPT-5.5 کو پیچھے چھوڑنے پر زور نہیں دیا، لیکن اس نے پوری کوشش اس بات پر مرکوز کی کہ "اس بھاری جانور کو کم کھلانا اور تیز دوڑانا" کیسے ہو۔

لیکن یہ کافی نہیں ہے۔ جاننے والوں کو سچ مچ جھٹکا دینے والا بات یہ ہے کہ اس نے "显存刺客" کو بے رحمی سے ختم کر دیا۔

گرافک میموری کے قاتل کا دن ختم ہو گیا: آرکیٹیکچر کی تین کھرچنیاں

显存刺客 کیا ہے؟ یہیں "لمبا متن (Long Context)" ہے۔

اب سب اپنی حمایت کے بارے میں 1M (ایک ملین) ٹوکن کے حوالے سے دعوے کر رہے ہیں۔ یہ سن کر اچھا لگتا ہے، ایک پوری کتاب "تھری کنگڈمز" کو اندر ڈال دیں، اور یہ کچھ سیکنڈوں میں اسے پڑھ لے گا۔ لیکن قیمت کیا ہے؟ لمبے متن کے استدلال کے دوران، KV کیش (تاریخی معلومات کو ذخیرہ کرنے کے لیے گرافکس میموری کا استعمال) بہت بڑا ہوتا ہے۔ یہ اس طرح ہے جیسے آپ ہر صفحہ پڑھتے ہوئے، پچھلا صفحہ اپنے سامنے رکھنے کے لیے ایک بڑا بورڈ پر اس کا نقل کر دیں۔ جب آپ ایک ملینویں الفاظ تک پہنچ جائیں، تو بورڈ اتنے زیادہ ہو جائیں گے کہ زونگگوان کا ڈیٹا سینٹر بھی انہیں سنبھال نہ پائے۔

میموری، کمپوٹیشنل پاور سے زیادہ مہنگی ہے۔ یہ AI صنعت کا ایک خفیہ قاعده ہے۔

ڈیپ سیک V4 اس صورتحال کو کیسے حل کرتا ہے؟ وہ براہ راست بنیادی توجہ مکینیزم پر "جراحی" کرتے ہیں۔ یہ ان کے آرکیٹیکچر اپگریڈ کا پہلا اور سب سے زیادہ طاقتور ڈھاکا ہے: مکسڈ توجہ مکینیزم (CSA + HCA)۔

CSA (Compressed Sparse Attention) اور HCA (Heavy Compression Attention) کا مطلب یہ ہے کہ یہ اب حفظ کرنے کی بجائے "اہم نکات پر توجہ دینا" اور "بہت مختصر نوٹس بنانا" سیکھ گیا ہے۔

اس کا اثر بہت شدید ہے: 1M کنٹیکس کے تحت، V4-Pro کا ایک ٹوکن استدلال کا FLOPs (فلاٹنگ پوائنٹ آپریشنز) صرف پچھلی نسل V3.2 کا 27% ہے! اور زیادہ خوفناک بات یہ ہے کہ KV کیش صرف V3.2 کا 10% ہے!

یہ کیا تصور ہے؟ اس کا مطلب یہ ہے کہ جو لاکھوں الفاظ پر مشتمل طویل متن کا کام پہلے مکمل طور پر چلانے کے لیے 10 اعلیٰ درجے کے سرورز درکار ہوتے تھے، اب وہی کام صرف 1 سرور آرام سے سنبھال لیتا ہے۔ کمپیوٹنگ پاور کی لاگت براہِ راست ایک تہائی رہ گئی ہے۔ یہ میز اُلٹ دینے کے درجے کی آپٹیمائزیشن ہے۔

اور دو چاقو۔

دوسرا چاقو، "مینیفولڈ کنسٹرینٹ سپر کنکشن (mHC)" کہلاتا ہے۔ پچھلے بڑے ماڈلز میں، لیئرز کے درمیان معلومات کا انتقال "روایتی ریزیڈوئل کنکشن" کے ذریعے ہوتا تھا، جیسے پرانی، زنگ لگی ہوئی لوہے کی پائپ سے پانی بہایا جائے، جب دباؤ زیادہ ہو تو وہ آسانی سے لیک ہو جاتی ہے۔ 32T ٹوکن کے بڑے پیمانے پر پری ٹریننگ ڈیٹا کے سامنے، پرانی پائپس برداشت نہیں کر سکتیں۔ mHC ایک فائبر آپٹک نیٹ ورک میں تبدیل ہو جاتا ہے، جو لیئرز کے درمیان سگنل پروپیگیشن کی استحکام کو بڑھاتا ہے۔ کوئی پیکٹ نہیں گھٹتا، کوئی انحراف نہیں ہوتا۔

تیسری چھری، انجن کا تیل بدل دیں۔ روایتی طریقے چھوڑ دیں اور Muon آپٹیمائزر استعمال کریں۔ اس کا کام تیزی سے مسلسل ہونا ہے۔ جب کہ دوسرے سات سات چودہ دن لگاتے ہیں، تو یہ شاید صرف بیس دن میں تیار ہو جائے۔ وقت پیسہ ہے، انجن کا وقت امریکی ڈالر ہے۔

ان تین چھریوں کے زور سے، V4 نے بڑے ماڈل کی "امیری کی بیماری" کو بالکل ٹھیک کر دیا۔

ڈان کے بوری میں راز: ایک دوسرے سے الگ کام کرنے سے لے کر سب کچھ ایک ہو جانا

بڑے ماڈلز کے لیے صنعت کے لوگ جانتے ہیں کہ پری ٹریننگ صرف ایک "بیکار" کو "بہت سی باتیں جاننے والا مگر بولنے والا نہیں" بناتی ہے۔ اسے حقیقی ماہر بنانے کا راز پوسٹ ٹریننگ ہے۔

ڈیپ سیک V4 نے پوسٹ-ٹریننگ میں انتہائی سخت "دو مراحل کی فن" اپنائی۔

پہلے لوگ MoE کو ٹرین کرتے تھے، جیسے کہ کئی اساتذہ ایک طالب علم کو سکھا رہے ہوں، جس سے آسانی سے لڑائی ہو جاتی تھی۔ V4 کیسے کرتا ہے؟

مرحلہ اول: "ہر کوئی اپنی طرف سے کام کرے"۔ یہ SFT ( supervised fine-tuning ) اور GRPO ( Group Relative Policy Optimization ) کے طور پر تقویتی سیکھنے کا استعمال کرتا ہے، جس سے ماڈل کے مختلف "ایکسپرٹ نیٹ ورکس" کو الگ الگ تربیت دی جاتی ہے۔ کوڈ لکھنے والے ایکسپرٹ صرف کوڈ لکھنے پر تربیت لیتے ہیں، اور ریاضی کے ایکسپرٹ صرف ریاضی کے مسائل پر کام کرتے ہیں۔ وہ ایک دوسرے سے بالکل بے ربط ہوتے ہیں۔ اسے ایک نقطہ کی صلاحیت کو بہترین سطح تک لے جانے کہا جاتا ہے۔

مرحلہ دوم: “سب کچھ ایک ہو جائے”。 آن لائن ڈسٹلیشن ٹیکنالوجی کے ذریعے، ان پہلے سے عالی شان مہارت حاصل کر چکے ماہرین کو ایک یکجا، مکمل ماڈل میں ضم کر دیا جائے۔ اندر کا تنازع نہیں، کوئی تھام نہیں۔

آئیے ان کے دو "بڑے ہتھیاروں" پر نظر ڈالتے ہیں۔

پہلا V4-Pro-Max موڈ ہے۔ یہ سب سے زیادہ استدلال طاقت والی موڈ ہے۔ اس کا مطلب ہے کہ جینیٹک لک کھل گیا ہے۔ ان کا دعویٰ ہے (جو جلد ہی کمیونٹی نے تصدیق کر دیا) کہ کوڈنگ بینچ مارکس پر V4-Pro پہلے سے بہتر ہو چکا ہے، اور پیچیدہ استدلال اور ایجنٹ (ایجینٹ) کے کاموں پر اگلے سطح کے بند ماڈلز (جیسے GPT-5.5، Opus 4.6) کے ساتھ فرق کافی کم ہو گیا ہے۔

دوسرا V4-Flash-Max ہے۔ یہ زیادہ دلچسپ ہے۔ یہ صرف 284B کا ایک چھوٹا سا ماڈل ہے، لیکن "کافی سوچنے کا بجٹ" دینے کے بعد، اس کی استدلال کی صلاحیت Pro کے قریب پہنچ جاتی ہے۔ اس سے کیا ظاہر ہوتا ہے؟ یہ ظاہر کرتا ہے کہ "الگورتھم کی معیار" اب "پیرامیٹرز کے حجم" پر غالب آ رہا ہے۔ اگر آپ اسے سوچنے کے لیے کافی وقت دیں، تو چھوٹا دماغ بھی بڑی مشکلات حل کر سکتا ہے۔ بالکل، صرف علم کے ذخیرہ اور بہت پیچیدہ متعدد مرحلہ Agent کاموں میں، یہ اپنے پیرامیٹرز کے سائز سے محدود رہتا ہے (کیونکہ اس کا پیٹ اتنा ہی بڑا ہے)، لیکن زیادہ تر کاروباری روزمرہ کے استعمالات کے لیے، یہ پرفارمنس زیادہ ہے۔

آخر میں، وزن ذخیرہ کرنے کے لیے FP4+FP8 مکسڈ پریسیژن اسٹوریج کا بہت ہوشیارانہ استعمال کیا گیا ہے۔ درستگی برقرار رکھی گئی اور GPU میموری بچائی گئی۔ یہ سب جگہ ایک منطقی اور حسابی طالب علم کی خوبصورتی کا اظہار کرتا ہے۔

اس بعد کی تربیت کے نتیجے میں ہونے والی انجینئرنگ کی کارکردگی میں بہتری کو زیادہ واضح طور پر موازنہ کرنے کے لیے، ہم ایک سخت اعداد و شمار کا موازنہ جدول پیش کرتے ہیں:

سرمایہ کی سونگھنے کی صلاحیت: V4 نے چین اور ہانگ کانگ کی کمپوٹنگ پاور چین کو کیوں جلا دیا؟

تکنیکی تفصیل اب تک کافی ہو چکی ہے۔ لیکن ہم نے ابھی تک اپنے آغاز کے اس جان لیوا سوال کا جواب نہیں دیا:

کیوں GPT-5.5 نے کمپیوٹنگ پاور سیکٹر کو مستقل خوشی نہیں دی، جبکہ DeepSeek V4 نے کیا؟

اس کے لیے ہمیں کوڈ سے باہر نکل کر سرمایہ اور کاروبار کی نگاہ سے اس گیم کو دیکھنا ہوگا۔

GPT-5.5 بہت طاقتور ہے، لا لگام طاقتور۔ لیکن یہ بند ذرائع والا ہے۔ بند ذرائع کا کیا مطلب ہے؟ مطلب یہ ہے کہ OpenAI ایک وسیع "بھورا" ہے۔ اگر آپ اس کی صلاحیتوں کا استعمال کرنا چاہتے ہیں، تو آپ کو اس کا API خریدنا ہوگا۔ یہ ایک "ٹیکس وصولی" ماڈل ہے۔ منافع سیلیکون ویلی میں جاتا ہے، اور کمپوٹنگ کی ضرورت مائیکروسافٹ کے کلاؤڈ ڈیٹا سینٹرز پر مرکوز ہوتی ہے۔ عالمی سطح پر ہارڈویئر فرنڈز، مقامی کمپوٹنگ سینٹرز، اور مختلف ممالک کے سرور ایجنسٹس کے لیے، صرف دیکھنا ہے، انہیں کچھ حصہ نہیں ملتا۔ GPT-5.5 جتنا بھی طاقتور ہو، وہ دوسروں کا تہوار ہے۔ نوویدیا کے شیئرز میں اضافہ اس لیے ہوا کیونکہ لوگ سمجھتے ہیں کہ OpenAI مزید چپس خریدے گا۔

لیکن DeepSeek V4 الگ ہے۔

یہ اوپن سورس ہے۔ اور یہ بہت مکمل MIT لائسنس ہے۔ MIT معاہدہ اوپن سورس دنیا کا سب سے سخی عطیہ ہے، جس کا مطلب ہے کہ کوئی بھی تجارتی کمپنی اسے مفت میں استعمال، تبدیل یا فروخت کر سکتی ہے، بنا کسی قانونی خطرے کے۔

زیادہ مہلک بات یہ ہے کہ ہم نے پہلے بڑی تفصیل سے ثابت کیا تھا کہ V4 نے ماڈل کی استدلال لاگت اور ویڈیو میموری کے استعمال کو گھٹا دیا ہے۔

ان دو نکات کو ملا کر، آپ ایک ایسا نتیجہ نکالتے ہیں جو سرمایہ کاری کے بازار کو پاگل کر دے گا: انفرادی ڈپلویمنٹ کا انتہائی نقطہ، اب آ گیا ہے۔

گزشتہ زمانے میں، کوئی بھی کمپنی اپنے 1 ٹیرا بائٹ سے زیادہ کے مڈل کو خود ڈیپلوی کرنا چاہتی تھی، جب وہ ہارڈویئر کی قیمت کی فہرست دیکھتی تو خاموشی سے بند کر دیتی اور API خریدنے کے لیے چلی جاتی۔ اب، V4 ہمیں بتاتا ہے: آپ کو صرف کچھ مشینوں کی ضرورت ہے تاکہ آپ اپنے مقامی طور پر GPT-4 کے قریب ترین یا حتیٰ کہ GPT-5.5 کے لیول تک چلینج کرنے والا ایک سوپر براین چلا سکیں۔ آپ کا ڈیٹا صوبے یا ملک سے باہر نہیں جائے گا، مکمل طور پر محفوظ۔

چونکہ اب سب لوگ اپنے مقامی پلیٹ فارم پر چلا سکتے ہیں، تو اب کیا ہوگا؟

مشینیں خریدیں! سرورز خریدیں! آپٹیکل مڈیولز خریدیں! سمارٹ کمپیوٹنگ سنٹر بنائیں!

بند سورس بڑی کمپنیاں ذہنی ٹیکس بیچ رہی ہیں، جبکہ کھلے سورس بڑی کمپنیاں بنیادی طور پر پورے صنعت کے ہارڈویئر فرنڈز کے لیے مصنوعات فروخت کر رہی ہیں۔ DeepSeek V4 وہ شخص ہے جس نے آگ کا بیج ڈال دیا۔ جتنا اس کا استعمال آسان ہوگا اور جتنا زیادہ اسے کھلا کیا جائے گا، اتنے ہی زیادہ چین، ہانگ کانگ، تائیوان سمیت دیگر مقامی کمپوٹنگ طاقت کی مانگ بڑھے گی۔ سرور اسیمبلي، لکوڈنگ، اور ڈیٹا سنٹر کے آپریشنز میں مصروف کمپنیاں اب بڑے پیمانے پر لاگو کرنے کا اصل سونا دیکھ رہی ہیں۔

اسی لیے 23 اپریل کو V4 کے فوری جاری ہونے پر چائنا-ہانگ کانگ کی کمپیوٹنگ پاور چین نے لگاتار کود کا مظاہرہ کیا۔ سرمایہ کار نہ تو جذبات کے لیے ادائیگی کر رہے ہیں، بلکہ قریب آنے والی “ہزاروں صنعتوں کی نجی تنصیب کی لہر” کے لیے پہلے سے ہی اپنا مقام تیار کر رہے ہیں۔

یہی بنیادی کاروباری سازش ہے۔

اختتام: مد کی واپسی اور پتھر

یہ پاگلپن بھرے تیس دن، ایک گیارہ بڑے ماڈلز، جیسے ایک شورشی آتش بازی کا مظاہرہ ہے۔

ٹھوس لوگ اپنے پیرامیٹرز کے رنگ میں ایک دوسرے کو بڑے پیمانے پر ہلا رہے ہیں، اور اپنی کمپیوٹنگ طاقت کی تیز ترین پٹھوں سے اپنے مقابلہ کرنے والوں کو گرا دینے کی کوشش کر رہے ہیں۔ لیکن شور و شوق کے بعد، صرف وہی باقی رہتے ہیں جو صنعت کے منظر کو بدل دیتے ہیں، اور وہ عام طور پر سب سے زیادہ شور مچانے والے نہیں ہوتے۔

ڈیپسیک V4 کا ظہور ایک پُرسکون قاتل کی طرح ہے۔ یہ آپ سے نہیں بھاگتا کہ کون زیادہ پیسہ خرچ کرتا ہے، یہ صرف اپنے سب سے زیادہ دردناک کمزور نقطے پر چھری چلاتا ہے: بے کار ویڈیو میموری کو ختم کرنا، ڈیپلومنٹ کی رکاوٹوں کو کم کرنا، اور اعلیٰ سطح کے مقابلے کو عام لوگوں کے لیے ممکن بنانا۔

اس "ڈیگروراک" AI جنگ میں، بے نقاب پیرامیٹرز کا دور تیزی سے ختم ہو رہا ہے۔ مستقبل کا میدان ان لوگوں کے لیے ہوگا جو "بہترین پرفارمنس" اور "انجینئرنگ کی کارکردگی" کے درمیان بہترین توازن تلاش کر سکیں۔

ہر طوفان کے بعد پانی کم ہو جاتا ہے، اور صرف اس وقت پتہ چلتا ہے کہ کون ننگا تیر رہا ہے اور کون ایک ناپیدھ کنارہ ہے۔

V4 نے ہر کسی کو ہتھیار دے دیے ہیں۔ اب، دیکھیں گئے کہ مختلف سردار اس نئے براعظم پر کیسے کیمپ لگاتے ہیں۔

اس لیyer کو سمجھنے کے بعد، جب آپ اس قسم کی ہنگامہ خیز اعلانات جیسے "حیرت انگیز لانچ" یا "دوبارہ تعریف" سنیں گے، تو شاید آپ زیادہ آزاد محسوس کریں گے اور کم پریشان ہوں گے۔

کیونکہ، کسی بھی خوبصورت جادو کا آخری نتیجہ اکاؤنٹس پر ہی ہوتا ہے، اور وہ کچھ چھوٹے سکے گنتے جانے چاہئیں۔

حوالہ جات:

- DeepSeek V4 سیریز کا پیش خدمت علیحدہ جاری, DeepSeek ٹیم، GitHub/ModelScope/HuggingFace. (2026).

- اپریل کا AI رلی: 30 دن کے بڑے ماڈل سائکل کا تجزیہ, ME News مارکیٹ آبزروور۔ (2026)۔

- سکیلنگ قوانین اور پوسٹ ٹریننگ پیراڈائم شفٹ، آرٹیفیشل انٹیلی جنس اقتصادیات کا جرنل۔ (2026)۔

- گلوبل کمپیوٹ سپلائی چین مارکیٹ پلس رپورٹ (اپریل 2026)، پین-ایشیا فنانشل ڈیٹا اینالٹکس۔ (2026)۔