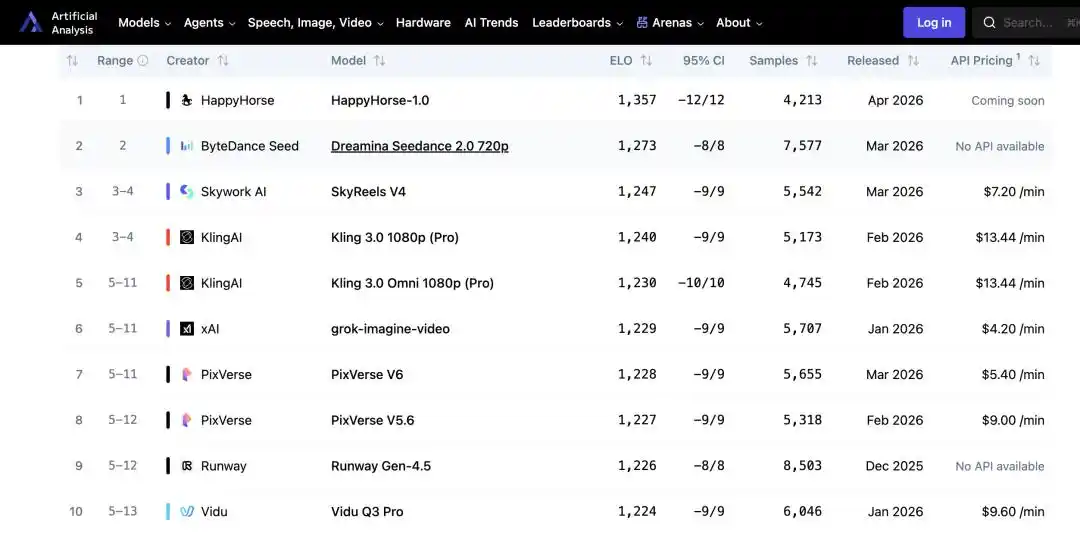

Без прес-релізу, без технічного блогу, без підтримки будь-якої компанії — текстовий модуль перетворення у відео під назвою HappyHorse-1.0 тихо вийшов на перше місце в рейтингу AI Video Arena авторитетної платформи оцінки штучного інтелекту Artificial Analysis, набравши вищий Elo-бал, ніж Seedance 2.0, і залишивши позаду таких головних гравців, як Ke Ling та Tian Gong, що спричинило «гонку розшифровки» у технічному середовищі.

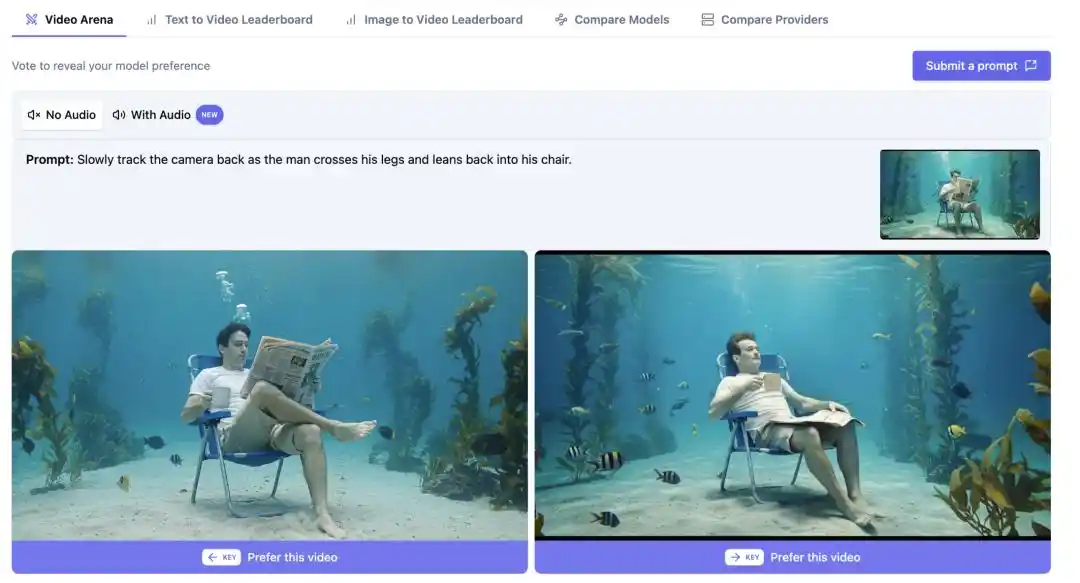

Рейтинг Artificial Analysis не є оцінкою технічних параметрів, а заснований на зведених Elo-баллах, отриманих у результаті сліпих тестів реальних користувачів, що відображає справжнє сприйняття звичайними людьми. Це робить цей рейтинг складнішим для критики порівняно зі звичайними рейтингами за балами, а також робить питання «Хто насправді створив цей продукт?» неможливим проігнорувати.

«Щасливий кінь» тихо вийшов на перше місце, спонукавши технологічне середовище до гри в загадки

Припущення на X з’явилися швидко. Першим, що привернуло увагу, був порядок мов на офіційному сайті: китайська мандаринська та кантонська мови розташовані перед англійською. Для продукту, спрямованого на глобальну аудиторію, такий порядок є незвичним — якби командою керували з США, англійська майже ніколи не була б не на першому місці. Можна майже певно стверджувати, що команда походить з Китаю.

Саме ім’я також є підказкою. 2026 рік — рік Коня за китайським календарем, і назва «HappyHorse» містить досить прямий відсилання до року Коня — раніше цього року «Pony Alpha» вже використовувала подібну гру. Тому список підозрюваних швидко збільшився: засновники Tencent та Alibaba мають прізвище «Ма» — вони природньо потрапили до списку; хтось припустив, що це Xiaomi, оскільки Лей Цзюнь зазвичай залишається скромним і любить раптово показувати свої карти; інші вважають, що це схоже на DeepSeek, адже DS раніше таємно запустив візуальну модель, а потім так само таємно її прибрав. Усі припущення розгорталися з великою енергією, але жодне з них не мали чітких доказів.

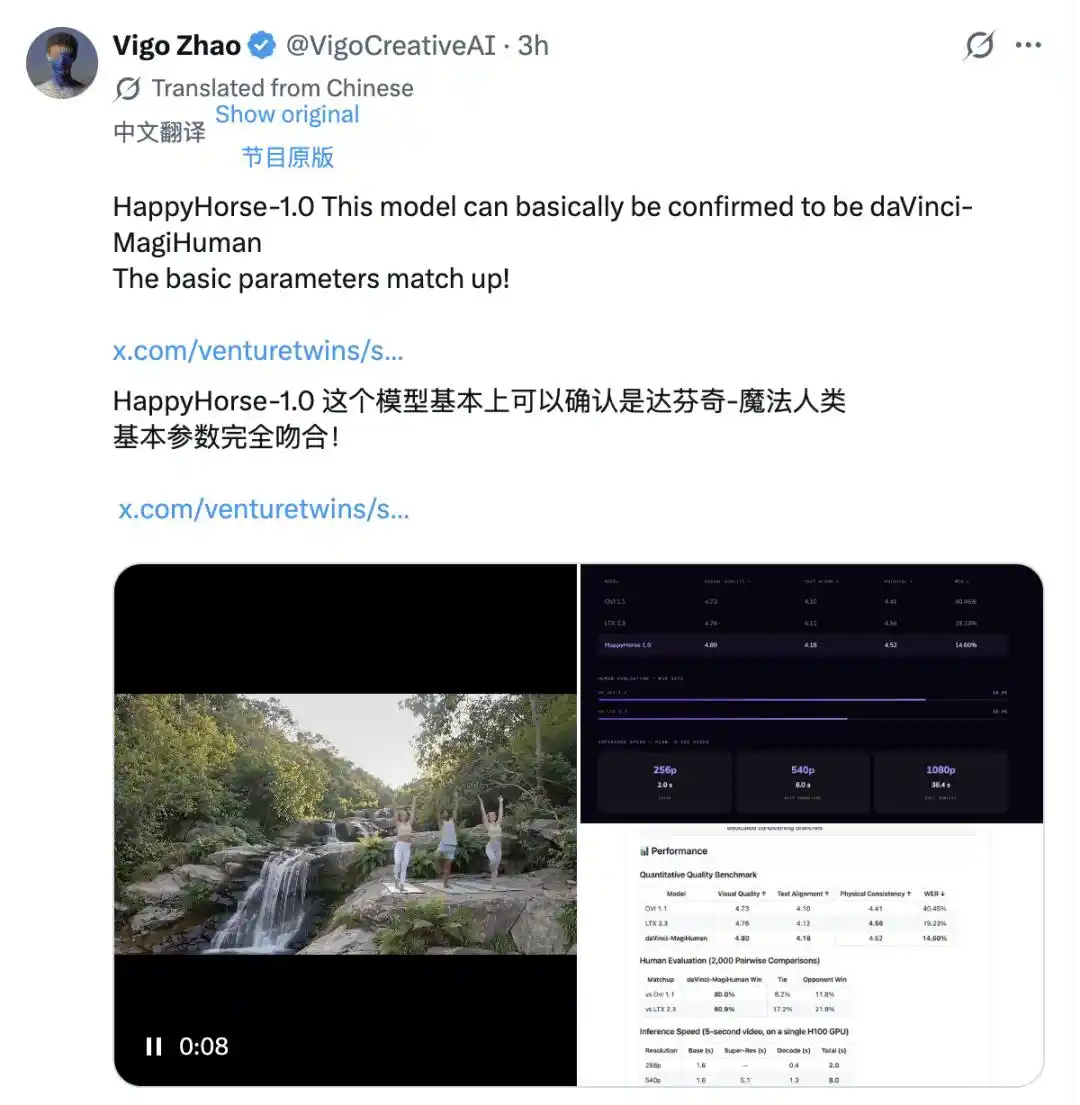

Насправді метою є поетапне порівняння на технічному рівні. Користувач X Vigo Zhao порівняв публічні базові дані HappyHorse-1.0 з відомими моделями і знайшов високоступіньовий збіг: daVinci-MagiHuman — відкриту модель «Да Вінчі Магічна Людина», яка була опублікована на GitHub у березні.

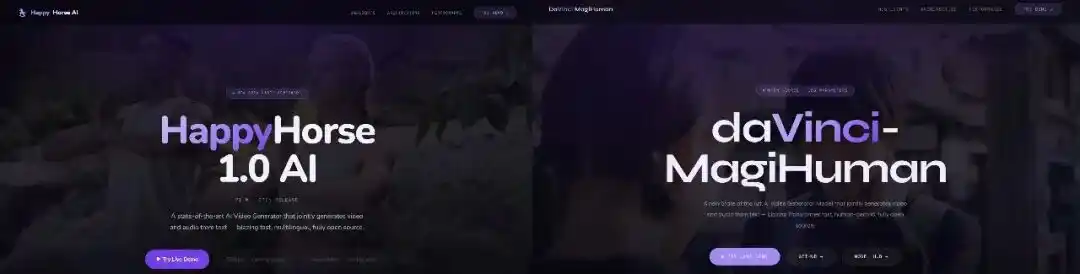

Якість візуального відтворення 4,80, вирівнювання тексту 4,18, фізична узгодженість 4,52, частота помилок у синхронізації голосу та тексту 14,60% — обидва набори даних збігаються по кожному показнику. Структура веб-сайту також майже ідентична: стиль подання опису архітектури, таблиці продуктивності та демонстраційного відео схожий на використання однієї й тієї ж шаблонної системи. Обидві системи використовують однопотокову архітектуру Transformer, одночасно генерують аудіо та відео та підтримують однаковий список мов. Такий ступінь збігу важко пояснити випадковістю.

На даний момент найбільш визнаним в технічному середовищі висновком є те, що HappyHorse — це ітераційна версія, розроблена Sand.ai, одним із співрозробників daVinci-MagiHuman, на основі відкритого коду, з основною метою перевірити межі продуктивності моделі при реальних уподобаннях користувачів та підготувати ґрунт для подальшої комерціалізації.

daVinci-MagiHuman офіційно відкрив свої джерела 23 березня 2026 року — це результат спільної роботи двох молодих команд. Одна з них — лабораторія генеративного штучного інтелекту (GAIR) Шанхайської академії творчих інновацій (SII), керівником якої є вчений Лю Пенфей; інша — Sand.ai (San Dai Technology) з Пекіна, засновником якої є Цао Юе, який також має академічний бекграунд, а напрямок компанії — авторегресивні світові моделі.

Модель використовує чистий однопотоковий Transformer з 15 мільярдами параметрів, об’єднуючи токени тексту, відео та аудіо в єдину послідовність для спільного моделювання — раніше в відкритому коді ніхто не розробляв справжнього спільного попереднього навчання аудіо-відео з нуля, більшість підходів базувалися на простому поєднанні однорежимних моделей.

Як відкритий відеомодель зміг досягти зворотного розвитку за два тижні?

Після того як було з’ясовано особистість, інше питання виявилося ще складнішим: чому HappyHorse-1.0 зміг за короткий тиждень отримати вищий рейтинг Elo, ніж Seedance 2.0, якщо daVinci-MagiHuman був відкритий лише наприкінці березня?

Згідно з інформацією, опублікованою на офіційному сайті, HappyHorse не вносив змін до базової архітектури; більш раціональним припущенням є те, що він спеціально налаштував стратегію за замовчуванням для сценаріїв оцінки.

Система Elo є накопиченням користувацьких переваг: трохи краще виконання таких чутливих аспектів, як стабільність виразів обличчя, синхронізація звуку та зображення, чи приємність візуального сприйняття, робить модель більш схильною до вибору в сліпих тестах. Межа можливостей моделі не змінилася, але «результати оцінки» можна вдосконалити.

Фактично, у сліпих тестах Artificial Analysis образи людей та відео з голосовим супроводом становлять понад 60%, а daVinci-MagiHuman з самого початку навчання зосереджувався на відтворенні людей, що надає йому природну перевагу в таких сценах — це й є ключовою причиною його вищого рейтингу у сліпих тестах; якщо зразки сліпих тестів переважно містять крупні плані людини, моделі, що добре працюють з людськими образами, отримують системну перевагу, що не має безпосереднього відношення до їхньої реальної продуктивності у складних сценах з кількома персонажами, складними камера-рухами та довгими нарративами.

Як результат, між цифрами в рейтингу та реальним досвідом виникла помітна різниця, і користувачі на X розділилися на дві групи. Скептики, після тестування, вважають, що HappyHorse-1.0 та Seedance 2.0 все ще мають помітну різницю в деталях персонажів та динамічній послідовності, і на цій основі ставлять під сумнів репрезентативність оцінки Elo.

Прихильники ж покладають великі надії на потенціал HappyHorse, сподіваючись, що він зможе вирішити галузеву проблему «консистентності якості зображення в багатокадрових послідовностях», оскільки це питання досі не було успішно вирішено жодною з сучасних відеомоделей. Якщо daVinci-MagiHuman справді зробить прорив саме в цій області, це може бути важливішим, ніж будь-яке місце в рейтингу.

Обмеження самої моделі не повинні приховуватися цифрами. Блогер з Xiaohongshu @JACK’s AI World першим впровадив і протестував daVinci-MagiHuman. Виявив, що для її роботи потрібен H100, а звичайні споживчі відеокарти майже не підходять. Хоча спільнота досліджує квантові рішення, особистим користувачам ще складно здійснити локальне розгортання в короткостроковій перспективі.

На практиці він добре справляється лише з однією особою; як тільки з’являються кілька осіб або сцена стає складнішою, якість погіршується — це не проблема, яку можна вирішити налаштуванням, а прямий наслідок його дизайну, спрямованого на портрети. Тривалість генерації зазвичай становить близько 10 секунд; при більш тривалому виводі з’являються артефакти, а висока чіткість виводу вимагає використання плагінів супер-розширення.

Висновок AI-візії @JACK: комплексна зручність daVinci-MagiHuman нижча, ніж у LTX 2.3, і вона підходить для повсякденного використання лише після того, як спільнота вдосконали квантифікацію.

Сектор генерації відео чекає на справжній «сом»?

Звичайно, лідерство в одному рейтингу не говорить багато. Далі HappyHorse повинен пройти більш повну перевірку щодо стабільності, швидкості обробки високих навантажень, узгодженості між різними сценаріями, точності керування ролями та здатності до узагальнення за межами тестових наборів. Саме ці показники визначають, чи зможе модель справді увійти до робочого процесу творців.

Але якщо розглянути це в більш широкому контексті галузі, сигнал, який це передає, досить чіткий.

Відкрите відеомоделі — це не щось нове. Але завжди існувала помітна різниця в якості між відкритими та закритими моделями — у сценаріях, де потрібно надавати результат клієнту, якість генерації відкритих моделей довгий час не могла подолати межу між «прийнятною» та «готовою до передачі». Ця різниця лежить в основі ціноутворення закритих продуктів, таких як Ke Ling та Seedance.

Значення цього полягає в тому, що продукт на основі відкритого коду вперше прямо порівнявся з поточними основними закритими конкурентами за результатами сліпих тестів, що базуються на реальному сприйнятті користувачів. Незалежно від того, яка частка оптимізації була здійснена під конкретні умови тестування, для закритих компаній, які будували свою ціноутворюючу владу на цій різниці, це щонайменше сигнал, який варто серйозно сприйняти.

Для розробників цей переломний момент має більш конкретне значення. У вертикальних сценах, таких як портрети, цифрові люди та віртуальні стрімери, як тільки якість генерації відкритих базових моделей досягає порогу «придатності до поставки», структура витрат на автономне розгортання зазнає суттєвих змін — не лише через зменшення витрат на виклики API, але й через повний контроль над даними, моделями та ланцюжком висновків, що надає гнучкість у глибині кастомізації та відповідності до норм щодо конфіденційності, недоступну для закритих рішень.

HappyHorse-1.0 не пошатне позиції Seedance 2.0 чи KeLing у короткостроковій перспективі, але з моменту, коли визнається, що відкриті моделі мають якість, що зрівняється з пропрієтарними, подальша квантифікаційна оптимізація, вертикальна доналаштування та прискорення висновків будуть безперервно розвиватися спільнотою з набагато більшою швидкістю, ніж у пропрієтарних продуктів.

У цей рік Коня, справжньою уваги заслуговує, можливо, не те, яка кінь біжить найшвидше, а те, що сама траса стає ширшою.

Цей матеріал надійшов зі сторінки WeChat «AI Value Officer», автор: Сіньє, редактор: Мейці