Ці дізні тридцять днів, одинадцять великих моделей — наче шумний фейерверк.

Автор статті, джерело: 0x9999in1, ME News

Коротко

- Тридцять днів крайньої конкуренції: з 26 березня по 24 квітня було запущено 11 потужних великих моделей по всьому світу, у середньому одна кожні 2,7 дні. Ринок стикається з серйозною «втомою від параметрів».

- «Операція з зменшення» параметрів Big Eater: загальна кількість параметрів V4-Pro становить 1,6 Т, але активовано лише 49 Б. За допомогою архітектури CSA+HCA кількість FLOPs у контексті 1 М зменшена до 27%, а кеш KV — до надзвичайно низьких 10%.

- Відокремлення поколіннь алхімії: перший підхід до післятренування зі схемою «спочатку незалежне підсилене навчання, потім онлайн-дистиляція та об’єднання» — V4-Pro-Max наближається до межі закритих рішень у висновках та завданнях агентів.

- Голоси реальними грошима: GPT-5.5 лише спричинив зростання NVIDIA на 4,2% за день, після чого досяг піку, тоді як V4, повністю відкритий MIT, повністю розпалив тривалий стрімкий ріст ланцюжка обчислювальних потужностей у Китаї та Гонконзі.

- Глибока гра логіки: закриті моделі продають «податок», відкриті великі моделі продають «залізо». З’явлення V4 дозволило врівноважити розрахунки обчислювальних ресурсів для корпоративного приватного розгортання по всьому світу.

Божественний шторм у квітні та втома ринку від естетики

Збожеволіли. Всі збожеволіли.

Якщо ви — спостерігач, що стежить за AI-сектором, то минулий місяць, ймовірно, викликав у вас фізичну незручність. З 26 березня 2026 року по 24 квітня — за менше ніж місяць — на ринок було запущено щонайменше 11 великих моделей із значним впливом.

Список виглядає як меню: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

Також уночі 23 квітня тихо запущений DeepSeek V4, як глибоководна бомба.

У середньому кожні 2,7 дні з’являється нова модель. Це швидкість, з якою навіть фундаментальні інвестори не встигають прочитати прес-релізи. Інвестори щойно прослухали про «перевищення параметрів» компанії A, як уже на столі лежить «перевага в бенчмарках» компанії B. Ринок вже втратив чутливість. Так зване «обходження бенчмарків» у сьогоднішніх умовах жорсткої конкуренції все більше схоже на самотню цифрову гру.

Але гроші розумні. Або, іншими словами, свічки ніколи не брешуть.

Проглядівши 30-денний свічковий графік AI-активів США, Китаю та Гонконгу, ви побачите надзвичайно сувору реальність: у цій «війні богів» на ринковій діаграмі залишають постійний слід лише два вузли.

Перше, 8 квітня на іншому боці океану OpenAI випустила GPT-5.5. Цей неперевершений лідер безумовно спричинив стрибок NVIDIA на 4,2% за один день. А потім? Нічого більше — пік досягнуто, користь вичерпана. Люди зрозуміли, що навіть найвеличніший закритий гігант важко знову так легко підняти тяжку гірську масу глобального капіталу, як це було два роки тому.

Другий етап — з 23 по 24 квітня. Випущено попередню версію DeepSeek V4. Без пафосних презентацій, без вражаючих відео. Ваги безпосередньо розміщені на Hugging Face і ModelScope за ліцензією MIT.

Результат? Це сприяло безперервному стрибку потужності хай-чінського ланцюга.

Чому це вдалося开源-моделі, а не ряду закритих проєктів?

Щоб відповісти на це питання, нам потрібно вести себе як сказочник — відкинути висушені прес-релізи, відкрити капот DeepSeek V4 і подивитися, що ж там усередині.

Аналіз V4: більше не вірте в брутальну естетику параметрів

Великі моделі. Дуже витратно. Про це всі знають.

За минулий рік виробники великих моделей потрапили у стан «страху недостатньої потужності». Ти робиш трильйон — я роблю два трильйони. Усі вважали, що якщо достатньо сильно натиснути, з’явився інтелект вирішить усі проблеми. Але це призвело до надзвичайно жахливих витрат на обчислювальну потужність. Навіть запаси зерна у багатія вже не вистачає.

DeepSeek V4 представив дві моделі MoE (мішані експерти): V4-Pro та V4-Flash. Спочатку розглянемо кілька ключових даних.

V4-Pro: загальна кількість параметрів 1,6 Т (1,6 трильйона), але активовано параметрів на кожен токен лише 49 млрд (490 мільярдів).

V4-Flash: загальна кількість параметрів 284 млрд (284 000 000 000), активовано лише 13 млрд (13 000 000 000).

Зрозуміли? Це надзвичайно стриманий підхід — «чотири унції зміщують тисячу фунтів». Суть архітектури MoE полягає в тому, що не потрібно завжди включати всі сигнали. Для задачі, як вбити курку, залучайте лише кількох експертів з вбивства курок; а для завдання, як вбити дракона, використовуйте меч для вбивства драконів. Базова модель на 1,6 трильйона параметрів забезпечує її «досвід і глибокі знання»; активовані 490 мільярдів параметрів забезпечують її «швидку реакцію та спритність».

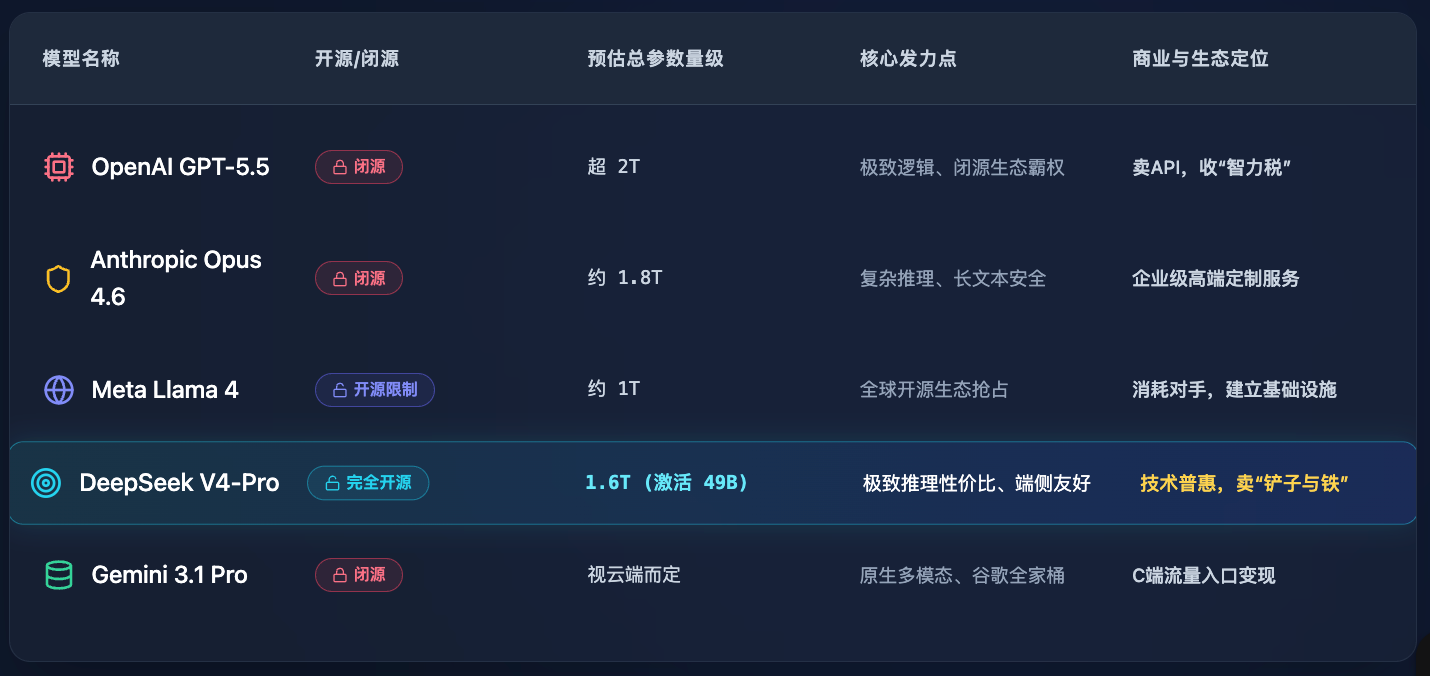

Щоб більш наочне розуміння цієї різниці, ми створимо таблицю, яка порівнює основні напрямки на поточному ринку (дані є публічними оцінками та розрахунками ринку):

З таблиці видно, що V4-Pro не прагне безумно перевершити GPT-5.5 за загальною кількістю параметрів, але всі зусилля зосереджені на тому, «як зробити, щоб цей велетень їв менше і біг швидше».

Але цього недостатньо. Справжньо, що заставило розуміючих вдихнути зі стогоном, — це безпощадне знищення «вбивць відеопам’яті».

Кінець вбивць відеопам’яті: три скальпелі архітектури

Що таке «вбивця відеопам’яті»? Це «довгий контекст».

Зараз усі хваляться, що підтримують контекст у 1M (мільйон) токенів. Звучить чудово — усе «Трьох царств» можна втиснути, і він прочитає його за кілька секунд. Але яка ціна? Під час висновку довгі тексти створюють величезний KV-кеш (використання пам’яті GPU для зберігання історії). Це наче кожну сторінку книги треба переписувати на велику дошку і тримати перед собою. Коли ви дійдете до мільйонного слова, дошок буде настільки багато, що їх не вмістити навіть у серверній кімнаті Чжунгяньцзянь.

Пам’ять дорожча за обчислювальну потужність. Це приховане правило AI-індустрії.

Як DeepSeek V4 вирішує цю проблему? Вони прямо провели «хірургічну операцію» над базовим механізмом уваги. Це перший і найбільш потужний інструмент їхнього архітектурного оновлення: гібридний механізм уваги (CSA + HCA).

CSA (стиснута розріджена увага) разом із HCA (інтенсивно стиснута увага) — звучить як марсіанська мова, але простіше кажучи: він більше не зазубрює, а навчився “виділяти головне” і “робити мінімальні конспекти”.

Ефект надзвичайно вражаючий: при контексті 1M FLOPs (операції з рухомою комою) на один токен для V4-Pro становлять лише 27% від попереднього покоління V3.2! Ще більш дивовижним є те, що кеш KV становить лише 10% від V3.2!

Що це за концепція? Раніше для виконання завдання з мільйоном символів потрібно було 10 найкращих серверів, а зараз це легко робить один сервер. Витрати на обчислювальну потужність зменшилися в десять разів. Це оптимізація рівня «перевернутий стіл».

Ще два ножі.

Другий інструмент називається «множинне обмеження гіперз’єднання (mHC)». У минулих великих моделях передача інформації між шарами здійснювалася за допомогою «традиційних залишкових з’єднань», що подібно до використання застарілих, заржавілих залізних труб для подачі води — при високому тиску вони легко протікають. Зі збільшенням обсягу навчальних даних до 32T токенів старі труби не витримують. mHC — це як заміна на оптичну мережу, що підвищує стабільність передачі сигналів між шарами. Без втрат і відхилень.

Третій інструмент — заміна моторного масла. Відмовтеся від традиційного підходу і використовуйте оптимізатор Muon. Він прискорює збіжність. Поки іншим потрібно сім разів по сім днів, щоб виготовити одну партію еліксиру, цей інструмент зробить це за двадцять днів. Час — це гроші, час обчислень — це долари.

Ці три удари повністю вилікували «хворобу багатства» великих моделей V4.

Таємниці каструлі для варіння елексирів: від окремих зусиль до об’єднання всіх методів

У галузі великих моделей всі знають, що попереднє навчання перетворює «неграмотного» на «знатока багатьох знань, але не вміє говорити». Саме післянавчання (Post-training) робить його справжнім майстром.

DeepSeek V4 у післятренуванні застосував надзвичайно складну «двофазову стратегію».

Раніше люди навчали MoE, як навколишні вчителі одного учня — легко виникали сутички. Як V4 це робить?

Перший етап: «Кожен сам за себе». Він використовує SFT (наглядова доналаштування) та GRPO (групова відносна оптимізація стратегій) для підсиленого навчання, розбиваючи різні «експертні мережі» у моделі та навчаючи їх окремо. Експерт з написання коду щодня тренується писати код, а експерт з математики щодня розв’язує математичні задачі. Вони не мають нічого спільного та не впливають один на одного. Це називається досягненням максимального рівня окремих здібностей.

Другий етап: «Всі методи повертаються до єдиного джерела». За допомогою технології онлайн дистиляції цих експертів, які вже здобули вишукані навички, об’єднуються в єдину, гладку модель. Без внутрішніх витрат, без зупинок.

Давайте розглянемо два «великі ходи», які вони використали.

Перше — режим V4-Pro-Max. Це найпотужніший режим міркувань. Це як розблокування генетичного замку. За їхніми заявами (які швидко підтвердила спільнота), у кодових тестах V4-Pro вже досяг верхнього рівня, а у складних завданнях міркувань та агентів розрив з передовими закритими моделями (наприклад, GPT-5.5, Opus 4.6) значно скоротився.

Друге — V4-Flash-Max. Це цікавіше. Це маленький модуль розміром лише 284B, але після надання достатнього часу на міркування його результати виведення наближаються до Pro. Що це означає? Це означає, що «якість алгоритму» починає переважати над «кількістю параметрів». Якщо надати йому достатньо часу на думання, навіть малий мозок зможе вирішити велику проблему. Звичайно, у чистому зберіганні знань та надзвичайно складних багатокрокових завданнях Agent він все ще обмежений розміром параметрів (бо «живіт» у нього такий малий), але цього достатньо для більшості корпоративних повсякденних застосувань — продуктивність надлишкова.

Нарешті, зберігання ваг дуже розумно використовує мішану точність FP4+FP8. Це зберігає точність та економить пам’ять GPU. Усе проникнене сексуальністю економного техніка.

Щоб більш наочno порівняти підвищення інженерної ефективності завдяки цьому післятренуванню, ми знову створимо таблицю з конкретними показниками:

Чутка капіталу: чому V4 запалила ланцюжок обчислювальних потужностей Китаю та Гонконгу?

На цьому технічний розбір майже завершено. Але ми ще не відповіли на початкове душевне питання:

Чому GPT-5.5 не зміг забезпечити тривалий підйом сектору обчислювальних потужностей, а DeepSeek V4 — зміг?

Це вимагає від нас вийти за межі коду та розглядати цю гру з погляду капіталу та бізнесу.

GPT-5.5 дуже потужний, непереможний. Але він є закритим. Що означає закритий? Це означає, що OpenAI — це величезна «чорна діра». Щоб скористатися її можливостями, вам потрібно купити її API. Це модель «оподаткування». Прибутки йдуть до Сіліконової долини, а потреби у обчислювальних потужностях зосереджуються в хмарних центрах обробки даних Microsoft. Для глобальних виробників обладнання, місцевих центрів обчислювальних потужностей та серверних агентів у різних країнах, крім того, щоб дивитися вгору, вони не отримують нічого. Наскільки б сильним не був GPT-5.5, це чуже святкування. Ріст NVIDIA відбувається тому, що всі вважають, що OpenAI збирається купити ще більше карт.

Але DeepSeek V4 інший.

Це відкрите програмне забезпечення. І воно випущено за дуже щедрою ліцензією MIT. Ліцензія MIT — це найщедріший подарунок від спільноти відкритого коду, що означає, що комерційні компанії можуть безкоштовно використовувати, змінювати та продавати його, не хвилюючись про правові ризики.

Ще більш критичною є та обставина, що ми раніше детально аргументували: V4 знизив витрати на висновки моделі та використання пам’яті GPU до щиколотки.

Поєднавши ці два пункти, ви отримаєте висновок, який зробить ринки капіталу безумними: критична точка приватизації справді настала.

Раніше, коли компанії хотіли самостійно розгорнути велику модель об’ємом понад 1 ТБ, вони дивилися на ціни на обладнання, мовчки закривали таблицю і йшли купувати API. Зараз V4 повідомляє всім: вам потрібно лише кілька машин, щоб запустити локально супермозок, який майже не відрізняється від GPT-4 і навіть може конкурувати з GPT-5.5. Дані не потрібно вивозити за межі провінції чи країни — абсолютно безпечно.

Оскільки всі тепер можуть запускати це локально, що відбудеться далі?

Купуйте обладнання! Купуйте сервери! Купуйте оптичні модулі! Будуйте центри штучного інтелекту!

Закриті великі компанії продають інтелектуальну податкову ставку, тоді як відкриті великі компанії суттєво сприяють продажам обладнання для всієї галузі. DeepSeek V4 — це той, хто кинув іскру. Чим краще він працює і чим більше він відкритий, тим більшою хвилею стає попит на локалізовані обчислювальні потужності в Китаї, Гонконгу, Тайвані та інших місцях. Компанії, які займаються збиранням серверів, розробкою рідкісного охолодження та обслуговуванням центрів обробки даних, нарешті бачать реальні гроші в масштабному впровадженні.

Ось чому з моменту запуску V4 23 квітня ланцюг обчислювальних потужностей Китаю та Гонконгу безперервно стрибав. Капітал платить не за ностальгію, а передчасно займає позиції перед майбутньою «хвилею приватизації в тисячах галузей».

Це і є базова комерційна стратегія.

Закінчення: Відплив і скелі

Ці дізні тридцять днів, одинадцять великих моделей — наче шумний фейерверк.

Великаны на арені параметрів обмінюються океанами капіталу, намагаючись розбити суперників кулаками обчислювальної потужності. Але після шуму залишаються не ті, хто найбільше кричить, а ті, хто справді змінює ландшафт галузі.

З’явлення DeepSeek V4 нагадує спокійного кіллера. Він не змагається з вами у тому, хто витрачає більше грошей — він атакує саме найбільш болісний слабкий місце: видаляє зайве відео-пам’ять, знижує бар’єри для розгортання і перетворює елітний рівень на рівень для всіх.

У цій битві під назвою «Рагнарёк» ера сліпої накопичення параметрів швидко наближається до кінця. Майбутнє поле битви належатиме тим, хто зможе знайти ідеальний баланс між «екстремальною продуктивністю» та «інженерною ефективністю».

Приплив завжди відступає, і лише після відпливу стає зрозуміло, хто плаває голий, а хто — незламна скеля.

V4 вже розподілив зброю всім. Тепер подивимося, як кожен володар встановить табір на цій новій землі.

Після того як ви розумієте цей аспект, коли будете слухати ті вигуки про «захоплююче випускання» або «перевизначення», ви, можливо, почуватиметеся спокійніше і менше тривожитиметеся.

В кінці кінців, будь-яка найбільш вражаюча магія зрештою має знайти своє відображення в бухгалтерській книзі — треба вирівняти ті кілька монет.

Джерело:

- Попередній огляд серії DeepSeek V4, офіційний реліз, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Апрельський підйом штучного інтелекту: аналіз 30-денного циклу великих моделей, ME News Market Observer. (2026).

- Закони масштабування та зміна парадигми після навчання, Журнал штучного інтелекту та економіки. (2026).

- Звіт про стан ринку глобальних ланцюгів постачання обчислювальних ресурсів (квітень 2026), Пан-Азійський аналіз фінансових даних. (2026).