Якщо ШІ раптово оголосить вас винним, і всі сліпо вірять його висновкам, як вам довести свою невинність?

Це звучить як сцена з фільму «Звіт меншості», де передбачають злочини, а потім підкидають провину, але абстрактно — у реальності вже відбулася більш непродумана версія:

Штучний інтелект помилився зі злочинцем, через що невинна жінка провела у в’язниці шість місяців, і її життя майже знищилось.

Що означає, що поліція арештувала «Блискавку»?

Анжела Ліппс з Теннессі, США — ця нещасна жінка. У липні 2025 року група озброєних поліцейських раптово ворвалася до її звичайного життя, націлила на неї зброю і повідомила, що вона арештована.

Тоді вона була в шоці, адже зовсім не знала, що саме зробила не так. Поліція сказала, що вона підозрюється у участь у банківському мошенництві в Північній Дакоті, і виглядало, ніби докази є, і ще видали 5-зірковий ордер на арешт, але коли вона почула цю причину, вона залишилася нерухомою:

Але я ніколи не був у тому штаті.

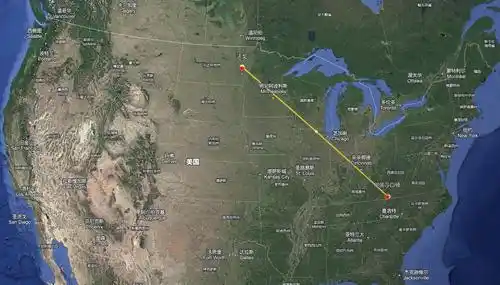

З карти видно, що штат Теннессі в США і Північна Дакота знаходяться на відстані один від одного, і саме ШІ зв’язав її з підозрюваним.

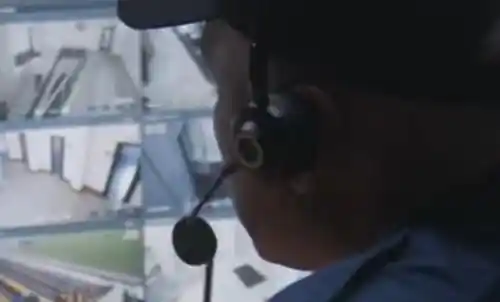

Під час арешту поліція автоматично відключила її пояснення, і деталі справи стали відомі лише після ув’язнення. Поліція міста Фарго, Північна Дакота, розслідувала справу про шахрайство, підозрюваний використовував фальшиву військову особистість, щоб обманом отримати кілька десятків тисяч доларів з банку, а метод розслідування поліції полягав у спочатку перевірці відеоспостереження, потім запиті до ШІ і нарешті арешті.

Ви, можливо, думали, що шляхом використання ШІ було «перетворено» Шерлока Холмса, і він став божественним детективом, який розкриває справи за допомогою строгих логічних міркувань, але насправді це не таке «складне» вирішення. Поліція використовувала систему ШІ для розпізнавання обличчя на знімках з камер спостереження, а потім відфільтрувала підозрюваних у базі даних.

В результаті штучний інтелект на цей раз припустився великої помилки, неправильно зіставивши фотографію Анджели Ліпс. Цю інформацію передали поліції, яка розслідує справу, а працівники зробили ще більшу помилку: після ручного перевірки її водійських прав та соціальних мереж вони вважали, що риси обличчя, тіло та зачіска схожі, і визначили її як підозрювану.

Зображення з GoFundMe

Сестра після цього була в шоці, не перевірила додаткових підказок — а що, якби вони виглядали однаково? Але ще більш розгубленою її зробила наступна серія подій — після серії дій у неї не залишилося можливості довести свою невинність.

Згідно з місцевою процедурою, її не перевезли безпосередньо до Північної Дакоти для додаткового розслідування, а тримали у місцевій в’язниці у Теннессі. Оскільки її було визнано «втікачем між штатами», їй не надали поруки та не дозволили отримати допит від поліції — вона була ув’язнена на 108 днів, від липня до кінця жовтня, і важко уявити, як вона відчувала безнадію протягом цього періоду.

Анджела Ліпс чекала до 30 жовтня, коли її остаточно вивезли з в’язниці для перевезення до Північної Дакоти. Під час переміщення їй довелося носити наручники та ланцюг на талії, і вона вважала, що прохід через аеропорт схожий на публічне урочисте висвітлення.

А це було її перше в житті польот на літаку.

Що вона не очікувала, так це те, що після прибуття до Північної Дакоти їй довелося чекати далі. Лише у грудні вона отримала офіційну можливість пояснити цю ситуацію: її адвокат безпосередньо зіставив її банківські записи з часом — в момент злочину вона перебувала за 1900 кілометрів у Теннессі, де купувала піцу, що означає, що, якщо вона не «Блискавка», то не могла здійснити злочин у іншому часі та місці.

На це пішло лише 5 хвилин, і адвокат допоміг їй чітко пояснити цю справу.

До 24 грудня її звинувачення були зняті, але вона не могла радіти, оскільки на цей момент «лінія вбивства» вже досягла щиколоток.

Анджела Ліпс святкувала свої 50-річчя в ув’язненні; під час ув’язнення їй заборонили носити протези, вона їла лише швидку їжу, переживала великий психічний стрес і різко набрала вагу. Перед ув’язненням вона була в літній одязі, а коли вийшла — був зима, і в неї не було навіть теплого пальта, щоб зберегти тепло, не кажучи вже про те, щоб повернутися додому. Поліція не надала їй навіть коштів на дорогу; після звільнення вона опинилася в ловушці в Північній Дакоті, залишившись у ловушці дня, коли її несправедливо звинуватили за допомогою ШІ.

Проте на щастя, їй на допомогу прийшли доброзичливі люди.

Її адвокат організував для неї тимчасове розміщення в готелі та забезпечив їжу, щоб вона змогла пережити найскладніший період, місцева некомерційна організація надала їй допомогу та повернула її додому, до Теннессі.

Але повернутися додому і відновити життя — це також адсько складно. За часи ув’язнення її фінанси зруйнувалися: вона втратила орендоване житло, домашнього улюбленця, навіть її автомобіль і все, що було в ньому. Її особисті речі тимчасово зберігалися на складі, але пізніше, через неможливість сплатити орендну плату, все побутове майно було вилучено. Навіть стосунки з людьми були під загрозою, бо сусіди бачили, як її арештували, і вважали, що вона «зникла» на півроку, тому думали, що вона справді злочинець.

Тим часом її дивовижна історія швидко розійшлася в мережі й викликала безліч критичних коментарів. Наприклад, багато людей висловили здивування: у США деякі люди можуть отримати товари «безкоштовно», але як тільки ви торкнетеся банку капіталіста — вас миттєво арештують, навіть якщо ви до цього не маєте ніякого відношення.

Оскільки справа набула великих розмірів, її безвихідна ситуація знову виявилася зворотною, і вона отримала більше допомоги. Зараз вона зібрала 80 000 доларів США на краудфандингу, чого цілком достатньо, щоб почати нове життя.

Але зараз найбільшою сподіванням користувачів інтернету є те, що вона залучить команду адвокатів і подасть на них позов, який може принести їй ще одну винагороду.

Оскільки це не випадкова помилка поліції, раніше вже мали місце масові несправедливі вироки, і досвід деяких людей був ще гіршим, ніж у неї.

Друге: жахливі науково-фантастичні моменти, спричинені «помилками» ШІ

Досвід Анджели Ліпс вже неодноразово відбувався в різних регіонах, навіть в інших країнах.

Наприклад, Роберт Вільямс був одним із перших постраждалих у таких випадках: у 2020 році поліція арештувала його перед очима дружини та дочок і утримувала 30 годин, хоча він був вищим за справжнього злочинця на 20 сантиметрів.

Інший Кріс Гетлін — теж надзвичайно нещасливий. Штучний інтелект за допомогою нечіткого відеозапису з камер спостереження визначив його як потенційного підозрюваного у справі про побиття в метрополітені, і його утримували без суду цілих 17 місяців — найтриваліший термін утримання невинної особи на даний момент. Неймовірно, але до самого кінця слідчі не звернули уваги на інший запис з камери тіла офіцера, який міг би стати ключовим доказом — але людина на відео ніяк не схожа на нього.

У 2023 році Порча Вудрафф пережила те саме: поліція звинуватила її у крадіжці автомобіля. Вона почула це і засміялася з гніву, вважаючи, що поліцейські жартують, бо на той момент вона була вагітна восьмим місяцем і виглядала абсолютно не здатною до фізичного насильства. Проте її все одно забрали і утримували понад десять годин, а пізніше вона програла судовий процес.

Цього року в Англії хлопця на ім’я Алві Чоудхурі також було затримано через подібну ситуацію, йому висунули звинувачення у «вступі до будинку», проте з доказів видно, що це було здійснено «на відстані» — така сцена також згадується у фільмах. Штучний інтелект визначив фотографію, зроблену під час його затримання у 2021 році; коли поліція побачила його в живу, вони розсміялися, бо він виглядав принаймні на 10 років старшим за підозрюваного.

Зображення з фільму «Переносник думок»

У 2022 році індійського бізнесмена Правіна Кумара затримали під час подорожі до Швейцарії, коли він здійснював пересадку в Абу-Дабі, де його ідентифікували як розшукану особу за допомогою ШІ. Місцеві органи довго його допитували, але з’ясували, що він не є підозрюваним, і вислали його назад до Індії, де він був затриманий ще двічі в аеропорту.

У цьому типі подій найбільш абсурдною була історія російського вченого Олександра Цвєткова: штучний інтелект сказав, що він схожий на вбивцю, і його ув’язнили на 10 місяців.

Цей вчений, можна сказати, став жертвою подвійного звинувачення з боку ШІ та людини. У лютому 2023 року, після завершення наукової експедиції, він повернувся до Росії, і його арештували відразу після виходу з літака. Причиною було те, що ШІ визначив 55-відсоткову схожість між ним та малюнком підозрюваного у серії вбивств, що відбулася понад двадцять років тому, а також у справі був свідок обвинувачення, який навмисно дав хибні показання, щоб отримати зниження покарання. Найгірше — поліція не провела детального розслідування і просто арештувала його.

Після арешту він спочатку вважав, що це невелике непорозуміння, але слідство затягувалося, і під впливом величезного психічного тиску та проблем зі здоров’ям він тимчасово дав признання, а потім відмінив його. На щастя, його дружина та колеги з інституту постійно боролися за нього, зібрали безліч документів, що підтверджували, що в день інциденту він перебував у відрядженні за межами міста. Завдяки освітленню в ЗМІ справа стала предметом широких суспільних обговорень, і лише у грудні з’явилася зміна — обвинувачення було офіційно скасоване у лютому 2024 року.

Такі випадки з кожним кроком розвитку ШІ стають все частішими, і здається, що саме ШІ «керує», а деякі люди перетворюються на машини, що виконують накази.

Третє: Професійне захворювання «AI вирішує все»

Абстрактне відчуття «взаємної заміни ролей» виникає тому, що і ШІ, і люди можуть зробити помилку: навіть найпотужніший ШІ може помилятися, а люди постійно «лінивляться».

Наприклад, система Clearview AI з США саме її відправила бабусю з початку статті до в’язниці, але це не якийсь підлітковий софт. Clearview AI стверджує, що має найбільшу у світі базу зображень, збираючи сотні мільярдів зображень незважаючи на штрафи з багатьох країн; понад 3000 правоохоронних органів США використовують її, а минулого року вона уклала контракт з ICE на 9,2 мільйона доларів США.

Але простіше кажучи, Clearview AI — це «пошуковик облич», коли ви завантажуєте зображення, він шукає збіги у своїй базі даних, а потім виводить велику кількість схожих зображень — вже вам потрібно визначити, чи це саме та людина, яку ви шукаєте.

Хоча за останні роки досягнення в галузі ШІ були швидкими, «точність» все ще залишається суперечливою, оскільки дані для експериментальних тестів завжди відрізняються від умов реального використання пошуку за зображеннями.

Наприклад, більшість часу зображення з камер спостереження, які знаходять поліція, мають якість, як з телефону старого зразка, плюс дивне освітлення, незвичні кути знімання, обличчя, прикрите чимось тощо — визначити особу дійсно складно, а в базі даних може бути старе зображення, і результат співпадіння може бути просто випадковим схожістю двох людей.

А коли ці похибки стосуються конкретних людей, то їм, звісно, доводиться страждати.

Це ворона чи кіт?

За логікою, якщо AI лише іноді дає збій, це ще виправимо, бо це лише «підказки», а остаточні «висновки» все ще мають перевіряти люди, але часто люди ще «дивніші», ніж AI.

Ще кілька років тому люди скаржилися, що поліція США підкоряється ШІ, потрапляючи у «автоматичну упередженість» — надмірну залежність або довіру до результатів, що надає ШІ. Якщо ШІ каже, що ці двоє збігаються, люди вірять — різниця у зрості — не моя проблема, хоча альбібі є, але я відповідаю лише за арешт, інші докази розкажіть вже тюрмі. Це не лише минує базові етапи розслідування, а й «пропускає життя» інших.

Люди добре розуміють недоліки ШІ: після того як поліція США виплатила велику кількість компенсацій, багато регіонів встановили «захисні межі» — наприклад, для розкриття злочинів крім підказок від ШІ потрібні незалежні докази, а деякі місцевості взагалі заборонили використання ШІ для розслідувань.

Але ці обмеження не зупиняють AI, бо він надто корисний. Хоча є ймовірність невдачі, очевидно, що успішних випадків більше. Іноді поліція, витративши багато зусиль, знаходить підказку у вигляді фотографії з камери спостереження «рівня замка», і велика ймовірність того, що вони спробують скористатися AI на випадок. Ще у 2023 році повідомлялося, що американська поліція використовувала Clearview AI для мільйонів пошуків, а потім, навіть коли використання було офіційно заборонено, продовжували користуватися ним у тайному порядку — адже можна просто сказати, що не використовували. Якщо цю програму заборонили — замініть її іншою, якщо заборонили на місцевому рівні — попросіть іншу організацію скористатися нею. Просто безумно захопилися.

Тож, коли штучний інтелект спочатку дає ненадійну підказку, а потім людина ліниво пропускає розслідування, Волонг і Фенчжу використовують комбінований прийом — і несправедливі справи не уникнені.

Наприклад, система Smart Sampa у Бразилії протягом останніх двох років також стикалася з подібними проблемами. У 2024 році в Сан-Паулу, Бразилія, було запущено найбільшу в Латинській Америці поліцейську систему штучного інтелекту для розпізнавання обличчя, яка, як стверджують, підключена до 40 000 камер.

Доброю новиною є те, що ефект справді величезний: за кілька років було заарештовано майже чотири тисячі злочинців на місці та повернуто понад три тисячі втікачів; кількість розбійних нападів у 2025 році зменшилася майже на 15%, що можна назвати «лінією зловлення злочинців».

Погана новина в тому, що принаймні 59 осіб були неправильно визнані.

Серед них є абстрактні випадки, наприклад, психічно хворого в лікарні відвели як злочинця, а потім випустили, коли виявилося, що ордер на арешт минув. Ще один чоловік був затриманий 4 рази за 7 місяців — AI сплутав його з розшуковим вбивцею. Кожного разу його відвозили до поліції і негайно відпускали, а через кілька днів все повторювалося — він вже був настільки зляканий, що звик.

Раніше, коли обговорювали, які роботи не можна замінити штучним інтелектом, казали, що ШІ не може сидіти за людину в тюрмі, але ми ніколи не думали про інший бік цього питання — зараз він може змусити людину «сидіти в тюрмі».

Раніше це було жартом, але зараз це майже не новина. Насправді, крім розпізнавання обличчя, ІШ іноді може продемонструвати справжній потенціал у розпізнаванні предметів.

Рік тому в американській середній школі штучний інтелект системи безпеки визначив пакет чіпсів, які хлопець тримав у руці, як «потенційну зброю» і активував тривогу. Прибуло 8 поліцейських машин, і хлопця миттєво придушили; лише після огляду тіла поліція знайшла пакет із закусками у сміттєвому контейнері — сцена була дуже незручною, і хлопець думав, що не виживе.

Не кажи, але не кажи

Хто б подумав, що чим сильнішою стає ШІ, тим більші неприємності деякі люди з її допомогою викликають. Раніше ШІ була неспроможна — помилялася при розпізнаванні зображень, і весь інтернет глузував з цього. Зараз, коли ШІ стала сильнішою, одна помилка у визначенні людини може призвести до шестимісячного ув’язнення. У майбутньому, будь ласка, не вигадуйте абстрактних речей на кшталт ШІ-суду, ШІ-адвоката чи «екологічного суду». У кінцевому підсумку, ШІ — це лише інструмент, і головне — це здатність та мета користувача. Іншими словами, чим сильніша ШІ, тим менше люди мають право лінуватися.

Загалом, трохи сумно за тим дурнуватим ІІ.

Цей текст походить із微信-каналу «CoolPlay Lab», автор: CoolPlay Lab