เมื่อวันที่ 27 มีนาคม การประชุมสุดยอดนานาชาติครั้งแรกของฮ่องกงเกี่ยวกับ Web 4.0 และเวทีการประชุมด้านนวัตกรรมและความปลอดภัยของ Agentic AI ซึ่งจัดร่วมกันโดย Hong Kong Science and Technology Parks Corporation, ME Group และ iPollo ได้จัดขึ้นอย่างยิ่งใหญ่ที่ Hong Kong Science Park การประชุมสุดยอดครั้งนี้มีธีมว่า “การประยุกต์ใช้นวัตกรรม Agentic AI: การเปลี่ยนแปลงทางเทคโนโลยีและการบูรณาการอุตสาหกรรมในยุค Web 4.0” โดยมีผู้นำชั้นนำจากภาครัฐ ภาคอุตสาหกรรม ภาคการศึกษา และภาควิชาการ เช่น รัฐมนตรีว่าการกระทรวงการคลังของรัฐบาลพิเศษฮ่องกง ชิน โม่ปอ ประธาน Hong Kong Science and Technology Parks Corporation เจิ้น ซีหมิง กรรมการ Hong Kong Science and Technology Parks Corporation และผู้ก่อตั้ง Nano Labs คอง เจี้ยนผิง และนักลงทุนแองเจิลชื่อดัง ไช่ เหวินเชิง มาร่วมอภิปรายเกี่ยวกับโอกาสและความท้าทายในยุคใหม่ที่ AI ก้าวข้ามจาก “การสนทนา” สู่ “การกระทำ”

ในยุคที่ปัญญาประดิษฐ์แบบตัวแทน (Agentic AI) ได้รับความสนใจอย่างมาก ประเด็นด้านความปลอดภัยที่เกี่ยวข้องจึงมีความสำคัญเป็นพิเศษ ยู ชวี่ ผู้ก่อตั้ง SlowMist ได้รับเชิญเข้าร่วมการประชุมสุดยอดครั้งนี้ และได้บรรยายหัวข้อ “ความท้าทายด้านความปลอดภัยของ AI และนวัตกรรมการป้องกันในโลกคริปโต” แบ่งปันการสังเกตและการปฏิบัติล่าสุดของ SlowMist ในด้านความปลอดภัยของ AI กับผู้นำอุตสาหกรรมทั่วโลก

โฟกัสที่แนวหน้า: วิเคราะห์เชิงลึกเกี่ยวกับภัยคุกคามของ OpenClaw และ AI Agent

พร้อมกับเทคโนโลยี AI ที่ค่อยๆ เข้ามาสู่โลกของสกุลเงินดิจิทัล แอปพลิเคชัน AI Agent อย่าง OpenClaw ที่มีแนวคิด “เลี้ยงกุ้งมังกร” กำลังได้รับความนิยมอย่างรวดเร็ว แต่เบื้องหลังความนิยมนี้ ปัญหาที่ลึกซึ้งกว่ากำลังปรากฏขึ้น: ขอบเขตความปลอดภัยของ AI Agent ยังไม่ได้รับการสร้างขึ้นอย่างแท้จริง

ในการบรรยาย ยูชิงได้วิเคราะห์อย่างลึกซึ้งจาก OpenClaw และเสนอข้อสรุปสำคัญว่า “ข้อความคือคำสั่ง” เขาอธิบายว่าในบริบทการทำงานของ AI Agent ข้อมูลทั้งหมดที่ป้อนเข้ามาไม่ใช่แค่ “ข้อมูล” อีกต่อไป แต่เป็นคำสั่งที่สามารถดำเนินการได้ หมายความว่าข้อมูลภายนอกใดๆ ที่โมเดลรับเข้ามา—ไม่ว่าจะมาจากอินพุตของผู้ใช้ คำอธิบายเอกสาร หรือ Skill ของบุคคลที่สาม—อาจถูกตีความและดำเนินการโดยตรง ทำให้พื้นที่โจมตีขยายจากระดับโค้ดไปสู่ระดับ “การรับรู้” ภายใต้กลไกนี้ เส้นทางการโจมตีถูกทำให้เรียบง่ายอย่างมาก ผู้โจมตีไม่จำเป็นต้องเจาะระบบป้องกันแบบดั้งเดิม แต่เพียงสร้างเนื้อหาข้อความที่ออกแบบมาอย่างรอบคอบ ก็สามารถหลอกให้ Agent ดำเนินการที่ไม่คาดคิด เช่น การโอนทรัพย์สิน การรั่วไหลของข้อมูลที่ละเอียดอ่อน หรือแม้แต่การรันคำสั่งระยะไกล เส้นทางการโจมตีที่ซ่อนเร้นและต้นทุนต่ำนี้จึงมีภัยคุกคามที่สูงมากในทางปฏิบัติ

ภายใต้กลไกนี้ เส้นทางการโจมตีถูกทำให้เรียบง่ายอย่างมาก ผู้โจมตีไม่จำเป็นต้องเจาะระบบป้องกันแบบดั้งเดิม แต่เพียงสร้างเนื้อหาข้อความที่ออกแบบมาอย่างรอบคอบ ก็สามารถหลอกให้ Agent ดำเนินการที่ไม่คาดคิด เช่น การโอนทรัพย์สิน การรั่วไหลของข้อมูลที่ละเอียดอ่อน หรือแม้แต่การรันคำสั่งระยะไกล เส้นทางการโจมตีที่ซ่อนเร้นและต้นทุนต่ำนี้จึงมีภัยคุกคามที่สูงมากในทางปฏิบัติ

ตามกลไกดังกล่าว ไคซินสรุปเพิ่มเติมถึงความเสี่ยงหลักสามประเภทที่ OpenClaw กำลังเผชิญอยู่:

- การป้อนข้อมูลและการควบคุมเจตนา (ชั้นการโต้ตอบของผู้ใช้): ผู้โจมตีสามารถหลอกลวง Agent ให้ดำเนินการที่อันตรายผ่าน “การฉีดคำสั่งโดยตรง” โดยเฉพาะอย่างยิ่งการปล่อยมัลแวร์ผ่านห่วงโซ่อุปทานแบบอ้อม—ผู้โจมตีฝังคำสั่งอันตรายไว้ในเอกสาร Markdown ของ Skill เนื่องจาก Markdown มักทำหน้าที่เป็น “จุดเริ่มต้นการติดตั้ง” ข้อความคำอธิบายเดิมจึงอาจเปลี่ยนเป็นสคริปต์ที่ดำเนินการอันตรายได้ง่าย (เช่น curl | bash) ซึ่งนำไปสู่การขโมยข้อมูล

- ความเสี่ยงของชั้นการตัดสินใจและการจัดเรียง (ชั้นตรรกะการประยุกต์ใช้งาน): ข้อผิดพลาดนี้ไม่ได้เกิดจากตัวแบบเอง แต่เกิดจาก “ตรรกะการดำเนินการที่ผิดพลาด” ผู้โจมตีสามารถรบกวนการให้เหตุผลเชิงตรรกะของเอเจนต์ ทำให้เปลี่ยนแปลงที่อยู่รับเงินในกระบวนการธุรกรรม เช่น การโอนสกุลเงินดิจิทัล ซึ่งก่อให้เกิดการสูญเสียเงินทุนโดยตรง

- ความเสี่ยงระดับโมเดล (สมองหลัก): รวมถึงภาพลวงตาที่โมเดลสร้างขึ้นซึ่งทำให้มันดำเนินการคำสั่งระบบที่ไม่มีอยู่หรืออันตราย รวมถึงรูปแบบการดำเนินการที่ไม่ปลอดภัยที่โมเดลเรียนรู้ผิดจากข้อมูลการฝึกอบรม

Yu Xian ชี้ว่า “ปัญหาที่ OpenClaw เปิดเผยไม่ใช่ปรากฏการณ์ที่เกิดขึ้นแบบแยกจากกัน แต่เป็นความท้าทายเชิงโครงสร้างที่ระบบนิเวศ AI Agent ทั้งหมดกำลังเผชิญอยู่” พูดอีกแบบคือ ปัญหาด้านความปลอดภัยไม่ใช่เรื่องของโครงการใดโครงการหนึ่งอีกต่อไป แต่เป็นความเสี่ยงเชิงระบบที่ทั้งอุตสาหกรรมต้องรับมือ

ป้องกันและรุกพร้อมกัน: สร้างระบบนิเวศโอเพนซอร์สที่ปลอดภัยสำหรับ AI Agent

ในการพูดของเขา ยูชี่ได้เสนอแนวทางด้านความปลอดภัยแบบ “ทั้งรุกและรับ” ของ SlowMist เพื่อรับมือกับรูปแบบภัยคุกคามที่เปลี่ยนแปลงอย่างต่อเนื่อง: ไม่เพียงแต่ต้องเข้าใจเส้นทางการโจมตี แต่ยังต้องฝังความสามารถในการป้องกันไว้ในกลไกการทำงานของ Agent เพื่อสร้างความปลอดภัยจากภายใน

เขาได้แสดงเครื่องมือและแนวทางปฏิบัติแบบโอเพ่นซอร์สทั้งหมดที่ SlowMist สร้างขึ้นรอบๆ AI Agent เพื่อส่งเสริมการสร้างระบบนิเวศด้านความปลอดภัยที่โปร่งใส ตรวจสอบได้ และสามารถนำกลับมาใช้ใหม่ได้:

- OpenClaw แนวทางปฏิบัติด้านความปลอดภัยแบบเรียบง่าย:คู่มือการติดตั้งความปลอดภัยแบบครบวงจรตั้งแต่ระดับการรับรู้ถึงระดับโครงสร้างพื้นฐาน ให้ “ตราประทับความคิดด้านความปลอดภัย” แบบมีระบบสำหรับการติดตั้ง AI Agent ที่มีสิทธิ์สูงในสภาพแวดล้อมการผลิตจริง

- ทักษะความปลอดภัยของ SlowMist Agent:กรอบการตรวจสอบความปลอดภัยแบบรวม ที่เพิ่ม “สายตาอันเฉียบแหลม” ให้กับตัวแทนเช่น OpenClaw ไม่เพียงแต่สามารถตรวจจับความเสี่ยงจากการปนเปื้อนของ Skills ทั่วไป แต่ยังสามารถระบุความเสี่ยงของที่อยู่กระเป๋าเงินบนโซ่ คลังรหัส และ URL

- MistTrack Skills:一个即插即用的 Agent 技能包,为 AI Agent 提供专业的加密货币 AML 合规与地址风险分析能力,可用于链上地址风险评估与交易前风险判断。

- MCP Security Checklist: รายการตรวจสอบความปลอดภัยแบบเป็นระบบ ใช้สำหรับการตรวจสอบและเสริมความปลอดภัยบริการ Agent อย่างรวดเร็ว เพื่อช่วยทีมหลีกเลี่ยงการละเลยจุดป้องกันที่สำคัญขณะปรับใช้ MCPs/Skills และชุดเครื่องมือ AI ที่เกี่ยวข้อง

- การสาธิต MCP ที่เป็นอันตราย: ตัวอย่างเซิร์ฟเวอร์ MCP ที่เป็นอันตรายแบบโอเพนซอร์ส ใช้สำหรับจำลองสถานการณ์การโจมตีจริงและทดสอบความแข็งแกร่งของระบบป้องกัน สามารถใช้ในการวิจัยด้านความปลอดภัยและการยืนยันการป้องกัน

ผ่านชุดการปฏิบัติเหล่านี้ ยูชี่เน้นว่า: “ความสามารถด้านความปลอดภัยต้องถูกสร้างขึ้นภายใน Agent โดยไม่ควรพึ่งพาการป้องกันจากภายนอกเท่านั้น” การผสานกลไกการป้องกันเข้ากับตรรกะการทำงานของ Agent เท่านั้นที่จะทำให้ AI Agent สามารถทำงานได้อย่างต่อเนื่องและปลอดภัยในระบบนิเวศ Web3 และ AI ที่ซับซ้อน

ระบบความปลอดภัยแบบมีระบบ: ADSS ป้องกันแบบครบวงจรสำหรับ AI และระบบนิเวศ Web3

ในตอนท้ายของการพูด ยูชิงได้แนะนำ ADSS (AI Development Security Solution) ที่ SlowMist นำเสนอ

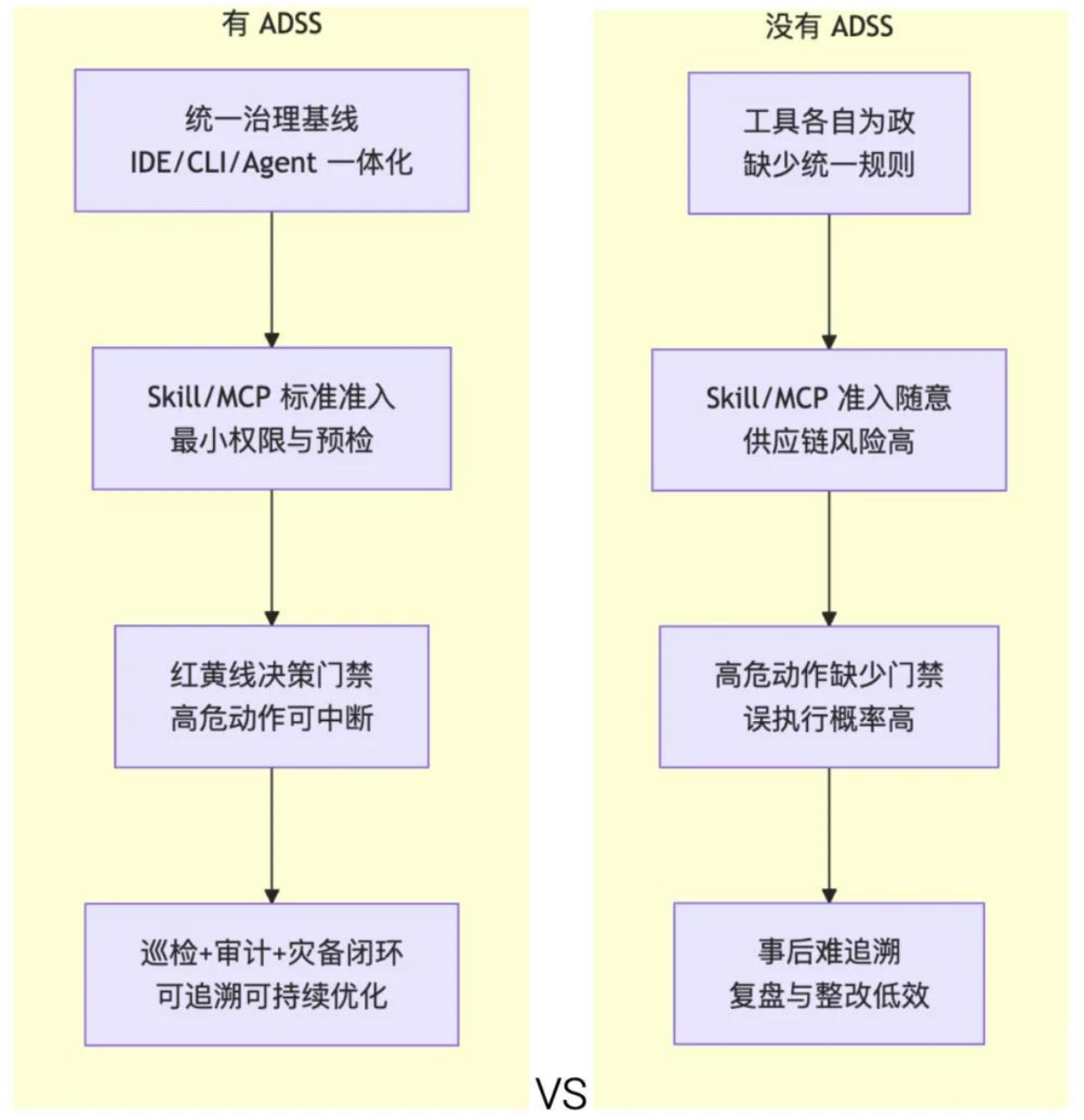

หากเครื่องมือที่กล่าวถึงข้างต้นจัดอยู่ในหมวด “ความสามารถเชิงกลยุทธ์” ADSS จึงดูเหมือนกรอบความปลอดภัยระดับระบบ โดยแนวคิดหลักคือ การยกระดับการดำเนินการด้านความปลอดภัยที่กระจัดกระจายให้กลายเป็นกลไกการดำเนินงานด้านความปลอดภัยแบบระบบซึ่งสามารถดำเนินการ ตรวจสอบ และยั่งยืนได้

ADSS สร้างความสามารถด้านการกำกับดูแลความปลอดภัยของ AI + Web3 จากหลายระดับ:

- การกำกับดูแลความปลอดภัยระดับ L1 (พื้นฐานการพัฒนา): สร้างมาตรฐานความปลอดภัยสำหรับการพัฒนาและการใช้งานที่เป็นมาตรฐานเดียวกัน ครอบคลุมเครื่องมือการพัฒนา โครงร่าง Agent ระบบนิเวศของปลั๊กอิน และสภาพแวดล้อมการดำเนินงาน เพื่อให้ทีมมีแหล่งที่มาของกลยุทธ์และการตรวจสอบมาตรฐานที่เป็นเอกภาพ

- สิทธิ์และข้อจำกัดการดำเนินการระดับ L2: ควบคุมขอบเขตการดำเนินการพฤติกรรมที่มีความเสี่ยงสูง โดยการรวมขอบเขตสิทธิ์ของเอเจนต์ ลดสิทธิ์ในการเรียกใช้เครื่องมือ และนำกลไกการยืนยันจากมนุษย์มาใช้สำหรับการดำเนินการที่สำคัญ

- การป้องกันการโต้ตอบจากภายนอกระดับ L3: นำการรับรู้ภัยคุกคามแบบเรียลไทม์มาใช้ในระดับทรัพยากรภายนอก เช่น URL คลังการพึ่งพา และแหล่งปลั๊กอิน เพื่อลดความเป็นไปได้ที่เนื้อหาที่เป็นอันตรายหรือการปลอมปนในห่วงโซ่อุปทานจะเข้าสู่กระบวนการดำเนินการ

- การแยกทรัพย์สินบนโซ่ระดับ L4: สำหรับการดำเนินการที่เกี่ยวข้องกับธุรกรรมบนโซ่ รวมการวิเคราะห์ความเสี่ยงบนโซ่และกลไกการลงนามแบบอิสระ เพื่อให้ Agent สามารถสร้างธุรกรรมได้โดยไม่ต้องสัมผัสกับกุญแจส่วนตัวโดยตรง ลดความเสี่ยงเชิงระบบจากการดำเนินการทรัพย์สินมูลค่าสูง

- การตรวจสอบและทบทวนอย่างต่อเนื่องระดับ L5: ผ่านการตรวจสอบบันทึก การทบทวนความปลอดภัยตามช่วงเวลา และกลไกการดำเนินงาน เพื่อสร้างความสามารถด้านความปลอดภัยแบบปิดที่สามารถตรวจสอบก่อนดำเนินการ ควบคุมระหว่างดำเนินการ และทบทวนหลังดำเนินการ

Yu Chien ชี้ให้เห็นว่า ADSS ไม่ใช่เครื่องมือเดียว แต่เป็นระบบการดำเนินงานด้านความปลอดภัยที่ยั่งยืนและสามารถพัฒนาต่อได้ มันมีเป้าหมายเพื่อช่วยทีมสร้างระบบความปลอดภัยของ Agent ที่สามารถตรวจสอบได้และอัปเกรดได้ โดยใช้กลยุทธ์เชิงระบบ การตรวจสอบอย่างต่อเนื่อง และการเชื่อมโยงความสามารถ ทั้งนี้โดยไม่ลดประสิทธิภาพการพัฒนาและความสามารถในการอัตโนมัติอย่างมีนัยสำคัญ เพื่อรับมือกับภัยคุกคามด้านความปลอดภัยที่เปลี่ยนแปลงอย่างต่อเนื่องในบริบทที่ AI และ Web3 ผสานกันอย่างลึกซึ้ง

ข้อสรุป

การประชุมระดับแรกเกี่ยวกับนวัตกรรมและความปลอดภัยของ Agentic AI ไม่เพียงแต่รวมพลังชั้นนำของอุตสาหกรรม แต่ยังเสนอแนวทางเชิงรุกสำหรับความปลอดภัยของ AI Agent เมื่อ Agentic AI และ Web3 ผสานรวมกันอย่างลึกซึ้ง ความท้าทายด้านความปลอดภัยจะยังคงเพิ่มขึ้น ในฐานะบริษัทด้านความปลอดภัยบล็อกเชนชั้นนำระดับโลก SlowMist จะยังคงผลักดันการดำเนินการด้านการจัดการความปลอดภัยแบบระบบผ่าน ADSS เครื่องมือแบบเปิดแหล่งที่มา และการปฏิบัติจริง เพื่อสร้างความสามารถด้านความปลอดภัยภายในตัวของ AI Agent และสนับสนุนอุตสาหกรรมให้เติบโตอย่างปลอดภัยและยั่งยืนในคลื่นนวัตกรรม