ขณะที่ทุกคนจับตาการต่อสู้ในชั้นโมเดล ทีมที่ครอบครองมาตรฐานการให้บริการแบบโอเพ่นซอร์สอย่างแท้จริง พร้อมด้วยนักลงทุนซีดีรุ่นแรกที่มีชื่อเสียงที่สุดจากซิลิคอนแวลลีย์ ได้เปิดตัวอย่างเป็นทางการเพื่อเล็งเป้าไปที่โครงสร้างพื้นฐานของ AI ในยุคใหม่

ผู้เขียนบทความ แหล่งที่มา: Machine Learning News

วันที่ 5 พฤษภาคม บริษัทสตาร์ทอัพด้านโครงสร้างพื้นฐาน AI ชื่อ RadixArk ประกาศปิดการระดมทุนแบบซีดีรุ่นแรกมูลค่า 100 ล้านดอลลาร์สหรัฐ โดยมีมูลค่าบริษัทหลังการระดมทุนอยู่ที่ 400 ล้านดอลลาร์สหรัฐ ไม่ว่าจะพิจารณาจากมูลค่าการระดมทุน มูลค่าบริษัท หรือรายชื่อนักลงทุน นี่คือการลงทุนระยะเริ่มต้นที่ใหญ่ที่สุดในเส้นทาง AI Infra ของปี 2026 จนถึงปัจจุบัน

รอบนี้ได้รับการนำโดย Accel และร่วมนำโดย Spark Capital นักลงทุนสถาบันครอบคลุม NVentures ของ NVIDIA, AMD, MediaTek, Databricks รวมถึง Salience Capital, HOF Capital, Walden Catalyst, A&E Investment, LDVP และ WTT Fubon Family ฯลฯ ผู้เล่นหลักในด้านฮาร์ดแวร์และชั้นระบบตั้งแต่ GPU ถึง CPU รวมถึงชิปขอบและแพลตฟอร์มข้อมูลเกือบทั้งหมดได้เข้าร่วมแล้ว

นอกเหนือจากกลุ่มสถาบันชั้นนำ ผู้นำด้านเทคโนโลยีระดับโลกจากบริษัทต่างๆ เช่น Intel, Broadcom, OpenAI, xAI และ PyTorch ยังมีส่วนร่วมในการระดมทุนครั้งนี้ในบทบาทของนักลงทุนแองเจิล

“ซีอีโอของสามผู้ผลิตฮาร์ดแวร์ชั้นนำ ร่วมกับผู้ก่อตั้งห้องปฏิบัติการโมเดลระดับท็อป และผู้สร้าง PyTorch” การรวมตัวกันของกลุ่มคนเหล่านี้ในรอบการระดมทุนเมล็ดพันธุ์เดียวเป็นเรื่องที่พบได้ยากมากในประวัติศาสตร์ของ AI Infra นักลงทุนที่คุ้นเคยกับพื้นที่นี้กล่าวตรงไปตรงมาว่า: นี่คือการเดิมพันบน “มาตรฐานที่แท้จริงของโครงสร้างพื้นฐานรุ่นถัดไป”

เครื่องมือวิเคราะห์ที่ดีที่สุดในโลก อยู่ในมือของพวกเขา

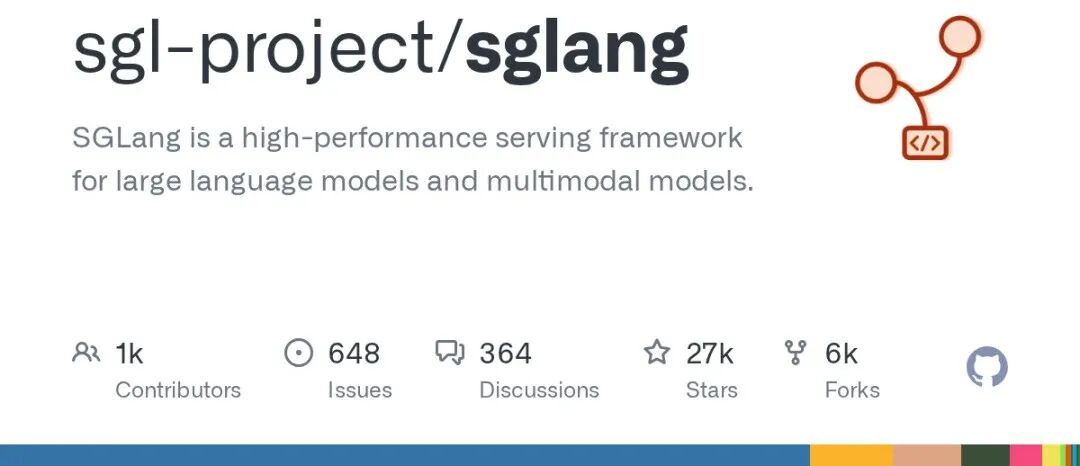

เรื่องราวของ RadixArk ต้องเริ่มต้นจากโครงการโอเพ่นซอร์สที่ชื่อว่า SGLang

ตั้งแต่เกิดขึ้นในปี 2023 SGLang ได้กลายเป็นหนึ่งในมาตรฐานอุตสาหกรรมสำหรับการให้บริการโมเดลขนาดใหญ่แบบโอเพ่นซอร์สด้วยความเร็วในการพัฒนาที่น่าทึ่งภายในสองปี โดยมีดาวมากกว่า 27K ดวงบน GitHub และถูกนำไปใช้งานบน GPU มากกว่า 400K ตัว ทุกวันมีปริมาณการใช้งานผลิตภัณฑ์หลายล้านล้านโทเค็นวิ่งผ่าน SGLang โดยผู้ใช้งานรวมถึง Google, Microsoft, NVIDIA, Oracle, AMD, LinkedIn, xAI และ Thinking Machines Lab

ในสองปีที่ผ่านมา สถาปัตยกรรมโมเดลได้ผ่านการเปลี่ยนแปลงครั้งใหญ่หลายประการ เช่น MoE, บริบทยาว, โมเดลการให้เหตุผล และการรวมหลายรูปแบบ ทุกครั้งที่มีการปรับโครงสร้างใหม่ SGLang สามารถรองรับได้ตั้งแต่วันแรก—ด้วยกลไกที่เป็นแนวคิดแรกของโลกในการรองรับโมเดลโอเพนซอร์สทันทีที่เปิดตัว ประสิทธิภาพใกล้เคียงกับขีดจำกัดทางกายภาพของเครื่อง ผู้ลงทุนหลายรายมักพูดถึงว่า ความเร็วในการพัฒนาของ SGLang ร่วมกับวินัยทางวิศวกรรม เป็นสิ่งที่ดีที่สุดในโครงการโอเพนซอร์ส

เบื้องหลังวินัยพื้นฐานคือทีมผู้ก่อตั้งที่มีความเชี่ยวชาญลึกซึ้งในด้านระบบและอัลกอริทึม

ซ่ง อิง (Ying Sheng) สำเร็จการศึกษาปริญญาตรีจากโปรแกรม ACM ของมหาวิทยาลัยเจียวตงแห่งเซี่ยงไฮ้ และปริญญาเอกจากมหาวิทยาลัยสแตนฟอร์ด เป็นผู้ก่อตั้ง LMSYS Org และหนึ่งในผู้ก่อตั้งหลักของ SGLang ในช่วงปริญญาเอก เธอเคยเป็นนักวิจัยเยี่ยมที่ห้องปฏิบัติการ Sky Lab ของ UC Berkeley และเคยทำงานที่ Databricks และ xAI โดยเคยดำรงตำแหน่งหัวหน้าทีมการประมวลผลของ xAI งานของซ่ง อิง ในด้านการลดความหนาแน่นของความสนใจและการใช้ซ้ำหน่วยความจำ KV ได้รับความสนใจอย่างมากจากอุตสาหกรรม โดยกลไก RadixAttention ในช่วงเริ่มต้นของ SGLang เป็นหนึ่งในผลงานที่โดดเด่นของเธอ

CTO จู ปังฮัว (Banghua Zhu) สำเร็จการศึกษาด้านวิศวกรรมอิเล็กทรอนิกส์จากมหาวิทยาลัยชิงหัว และได้รับปริญญาเอกจาก UC Berkeley โดยศึกษาภายใต้การดูแลของผู้เชี่ยวชาญด้านการเรียนรู้ของเครื่อง Michael I. Jordan และ Jiantao Jiao ในระหว่างการศึกษาระดับปริญญาเอก เขาได้ร่วมก่อตั้ง Nexusflow ซึ่งต่อมาถูก NVIDIA ซื้อไป และเขาได้รับตำแหน่ง Principal Research Scientist ที่ NVIDIA ในโครงการที่เขาดูแล มีทั้งการสร้างระบบการฝึกอบรมระดับอุตสาหกรรมอย่างสมบูรณ์ รวมถึงการปรับปรุงระบบพื้นฐานภายใน NVIDIA และการสะสมประสบการณ์ระยะยาวในการฝึกอบรมขนาดใหญ่

หัวหน้าเทคโนโลยีของผู้ผลิตฮาร์ดแวร์หลักประเมินว่า นี่คือทีมผู้ก่อตั้งที่มีคุณค่าที่สุดในการเริ่มต้นธุรกิจ AI Infra ปี 2026: ด้านหนึ่งคือผู้ประกอบการเชิงวิจัยที่ควบคุมมาตรฐานการให้บริการแบบโอเพนซอร์ส ส่วนอีกด้านคือผู้เชี่ยวชาญด้านอัลกอริทึมแบบโมเดลขนาดใหญ่จากชั้นการวิจัยหลักของผู้ผลิต GPU

ถือครองเครื่องประมวลผล SGLang ที่สามารถจัดการกับโทเค็นระดับล้านล้านต่อวัน—นี่เองคือจุดเริ่มต้นในฝันสำหรับการเริ่มต้นธุรกิจด้าน AI Infra และนี่ยังไม่ใช่ไพ่ทั้งหมดของทีมนี้

วันที่ 0 การฝึกฝน DeepSeek V4 ด้วยการเรียนรู้แบบเสริมแรง

นอกจากเครื่องยนต์การให้เหตุผลแล้ว RadixArk ยังมีความก้าวหน้าในด้านการฝึกอบรมเช่นกัน

ในเดือนพฤศจิกายน 2025 ทีมได้เปิดแหล่งที่มาของกรอบงานการเรียนรู้แบบเสริมแรง Miles ซึ่งมุ่งเน้นที่ความเสถียรภาพและประสิทธิภาพในการฝึก RL ขนาดใหญ่ ปัจจุบันถูกใช้งานโดยทีมมากกว่า 20 ทีมในการฝึกโมเดล MoE ด้วยการเรียนรู้แบบเสริมแรง

ในปี 2025–2026 การแข่งขันด้านความสามารถในการให้เหตุผล การใช้เครื่องมือ และความสามารถแบบ Agentic จะเพิ่มระดับขึ้นอย่างครอบคลุม และทุกก้าวของความก้าวหน้าล้วนต้องการระบบรองรับ RL แบบกระจายขนาดใหญ่พิเศษ ผู้สังเกตการณ์ในอุตสาหกรรมชี้ให้เห็นถึงจุดปวดหัวที่ถูกกล่าวถึงซ้ำแล้วซ้ำเล่าแต่ยังแก้ไม่ได้มาโดยตลอด: สิ่งที่ทีมโมเดลขนาดใหญ่รู้สึกทรมานที่สุดตอนนี้ ไกลเกินกว่าการปรับแต่งจุดใดจุดหนึ่งเพียงอย่างเดียว ความเสียดทานที่เกิดขึ้นระหว่างขอบเขตของกระบวนการทั้งหมดตั้งแต่การฝึกอบรม ไปจนถึง RL และการให้บริการแบบอินเฟอเรนซ์ แต่ละขั้นตอนเมื่อพิจารณาแยกกันดูเหมือนจะใกล้เคียงกับประสิทธิภาพสูงสุด แต่เมื่อนำมารวมกันกลับลดประสิทธิภาพในทุกจุด

การรวมกันของ Miles และ SGLang กำลังพยายามเติมช่องว่างด้านประสิทธิภาพที่ทีมโมเดลขนาดใหญ่เผชิญอยู่ในกระบวนการครบวงจรของ «การฝึกอบรม-RL-การให้เหตุผล»

ความสามารถของโมเดลใหม่ Day-0 เป็นการแสดงออกที่ชัดเจนถึงความเชี่ยวชาญทางวิศวกรรมของทีม Infra

วันที่ 25 เมษายน มีการเปิดตัว DeepSeek-V4 ที่มีสถาปัตยกรรมซับซ้อน ในวันเดียวกัน SGLang และ Miles ได้บรรลุการสนับสนุนการอนุมานและการฝึก RL ของ DeepSeek-V4 พร้อมกัน ซึ่งเป็นผลมาจากการปรับแต่งระดับระบบของทีม รวมถึง ShadowRadix prefix cache ที่ออกแบบมาสำหรับการให้ความสนใจแบบผสม, Flash Compressor ที่สามารถบีบอัดได้ภายในชิปเดียว และ Lightning TopK ที่ลดความล่าช้าของ Top-K ลงเหลือ 15 ไมโครวินาที พร้อมเชื่อมต่อสายการผลิต RL แบบครบวงจรตั้งแต่การอนุมาน FP8 ถึงการฝึก BF16

การรับรองโดยความเห็นพ้องต้องกันแบบครบวงจร:

ผู้เล่นรายใหญ่ร่วมกันเข้าสู่ตลาด พวกเขากังวลอะไรกันแน่?

NVIDIA, AMD, MediaTek, Broadcom, Intel—บริษัทที่สำคัญที่สุดในระดับฮาร์ดแวร์ ซึ่งปรากฏร่วมกันในรอบ Seed Round นั้นแทบจะเป็นไปไม่ได้ในอุตสาหกรรมนี้ ความจริงแล้ว ผู้ผลิตฮาร์ดแวร์เข้าใจดีกว่าใครๆ ว่าพลังการประมวลผลในปัจจุบันยังคงมีราคาสูงและขาดแคลน การเพิ่มฮาร์ดแวร์เพียงอย่างเดียวไม่สามารถยั่งยืนได้ ระบบการอนุมานแบบเปิดแหล่งที่มาที่สามารถแยกฮาร์ดแวร์ออกจากกันอย่างแท้จริงและดึงประสิทธิภาพของชิปให้สูงสุดบนแพลตฟอร์มแบบไฮบริด คือความต้องการที่เร่งด่วนที่สุดของพวกเขา

การที่ผู้สร้าง Databricks, PyTorch และบุคคลชั้นนำจาก OpenAI / Thinking Machines / xAI เข้าร่วมพร้อมกัน แสดงถึงความคาดหวังอย่างแข็งแกร่งต่อโครงสร้างพื้นฐานแบบ "การฝึกอบรมและการอนุมานแบบบูรณาการ" ชื่อแต่ละชื่อในทีมผู้สนับสนุนเริ่มต้น หมายถึงมุมมองการเดิมพันที่แม่นยำยิ่ง:

- เจิ้นลี่อู ซีอีโอของอินเทล ผู้เชี่ยวชาญระดับตำนานที่มีประสบการณ์หลายทศวรรษในอุตสาหกรรมเซมิคอนดักเตอร์

- จอห์น ชูลแมน เป็นผู้ร่วมก่อตั้งรายก่อนหน้าของ OpenAI ผู้ร่วมก่อตั้ง Thinking Machines Lab และหนึ่งในผู้ก่อตั้งการเรียนรู้แบบเสริมแรง

- Soumith Chintala — ผู้ร่วมก่อตั้ง PyTorch ผู้ดูแลกรอบงานการเรียนรู้เชิงลึกทั่วโลก

- Igor Babuschkin ผู้ร่วมก่อตั้งคนก่อนหน้าของ xAI ผู้สร้างระบบการฝึกอบรมและแพลตฟอร์มฮาร์ดแวร์ที่ซับซ้อนที่สุดในอุตสาหกรรม

- ลิเลียน เวิง ผู้ร่วมก่อตั้ง Thinking Machines Lab มีมุมมองเชิงลึกจากแนวหน้าเกี่ยวกับการนำระบบ AI ไปใช้งานในระดับอุตสาหกรรม

เมื่อบุคคลที่สามารถรองรับการระดมทุนได้ด้วยตัวเองในทุกสถานการณ์ ตัดสินใจปรากฏตัวร่วมกันบน cap table เดียวกัน นั่นคือการเดิมพันอย่างเต็มใจต่ออนาคต

โครงสร้างพื้นฐานสำหรับทุกคน: ทำให้สิทธิ์ในการสร้าง AI ไม่ถูกผู้น้อยกลุ่มเดียวผูกขาด

วิสัยทัศน์ของ RadixArk สามารถสรุปด้วยประโยคเดียว: ทำให้โครงสร้างพื้นฐานของ AI เป็นสินค้าสาธารณะที่แพร่หลายและเชื่อถือได้เหมือนไฟฟ้า ไม่ถูกผู้ใดผูกขาด ดูเหมือนเป็นคำประกาศอุดมการณ์ แต่จากผลการดำเนินงานจริง พวกเขากำลังเปลี่ยนประโยคนี้ให้เป็นความจริง:

- academia

สามปีก่อน นักศึกษาปริญญาเอกที่ทำงานเกี่ยวกับการปรับปรุงการประมวลผล LLM มักมีตัวเลือกเพียงสองข้อ: หนึ่งคือ API ของ OpenAI ที่คิดค่าบริการตาม token และไม่สามารถมองเห็นโครงสร้างภายในได้ อีกข้อคือโค้ดโอเพ่นซอร์สแบบเก่าๆ ที่ในไฟล์ README เขียนว่า “works on a single GPU” ซึ่งยังห่างไกลจากสถานการณ์การกระจายแบบจริงที่ระบุในบทความวิจัยหลายปีของการพัฒนาทางวิศวกรรม

SGLang ทำลายการเลือกเพียงสองทางนี้—ผ่านการรองรับปริมาณการประมวลผลรายวันในระดับอุตสาหกรรมและโค้ดที่เปิดให้ทุกคนเข้าถึงได้อย่างสมบูรณ์ กลุ่มวิจัยระบบจากสแตนฟอร์ด แบร์กลีย์ CMU และ UW ต่างใช้มันเป็นฐานมาตรฐานโดยปริยาย สำหรับนักวิจัยที่ทำงานด้านเอเจนต์ RadixAttention ด้วยการแคชแบบ prefix ที่จัดโครงสร้างคำนำหน้าที่ใช้ร่วมกันในรูปแบบต้นไม้ โดยคำนวณค่า KV ที่เหมือนกันเพียงครั้งเดียว ทำให้การทดลองที่เคยใช้เวลาสองวันสามารถเสร็จสิ้นภายในครึ่งวันเท่านั้น การอ้างอิง SGLang ในงานวิจัยที่ดำเนินการบนอุปกรณ์ท้องถิ่นแทบจะกลายเป็นการกระทำมาตรฐาน

- สตาร์ทอัพ

กลุ่มวิศวกรที่ออกจากบริษัทขนาดใหญ่ นำความเข้าใจลึกซึ้งเกี่ยวกับบริบทเฉพาะทางมาเริ่มต้นธุรกิจของตนเอง พวกเขาไม่มีงบประมาณการประมวลผลหลายล้านดอลลาร์สหรัฐ ไม่มีทีม Infra ที่เฉพาะทาง แต่มีสัญชาตญาณที่แข็งแกร่งต่อผลิตภัณฑ์

ในอดีต การสร้างสายการผลิตการให้บริการเชิงผลิตภัณฑ์และการรักษาความเข้ากันได้ข้ามฮาร์ดแวร์มักเกินขีดจำกัดของบริษัทในรอบ种子 ทำให้ต้องใช้เวลาจำนวนมากไปกับการสร้างสิ่งเดิมซ้ำๆ ตอนนี้ พวกเขาสามารถเริ่มต้นบริการการให้บริการที่มีประสิทธิภาพใกล้เคียงกับระดับชั้นนำได้โดยตรงบน SGLang และใช้ Miles ฝึกโมเดลเฉพาะโดเมน—โครงสร้างพื้นฐานไม่ใช่อุปสรรคอีกต่อไป เวลาและเงินที่ประหยัดได้สามารถนำไปลงทุนทั้งหมดในสิ่งที่พวกเขาต้องการสร้างจริงๆ

- เทคโนโลยียักษ์ใหญ่

ทำไมบริษัทยักษ์ใหญ่ที่มีโครงสร้างพื้นฐานภายในที่แข็งแกร่งที่สุดในโลกอย่าง Google, Microsoft และ NVIDIA ถึงปรากฏอยู่ในรายการผู้ใช้ SGLang? คำตอบซ่อนอยู่ในโครงสร้างนักลงทุนรอบนี้—ผู้ผลิตฮาร์ดแวร์หลักห้าราย ได้แก่ NVIDIA, AMD, MediaTek, Broadcom และ Intel ต่างเข้าร่วมพร้อมกัน พวกเขาเข้าใจดีกว่าใครๆ ว่าระบบการให้บริการแบบเปิดแหล่งที่มา ไม่ขึ้นกับฮาร์ดแวร์ใดๆ และไม่ถูกผู้แข่งขันผูกขาด มีความหมายอย่างไรต่อระบบนิเวศทั้งหมด การใช้ระบบเปิดแหล่งที่มาที่ชุมชนร่วมกันดูแลและผู้ผลิตฮาร์ดแวร์หลายรายร่วมสนับสนุน คือกลยุทธ์โครงสร้างพื้นฐานในระดับที่สูงกว่า

การแถลงอย่างเป็นทางการของ RadixArk ไม่มีการเน้นอารมณ์ แต่เพียงพอที่จะเฉียบคม:

AI รุ่นถัดไป不应受限于对私有基础设施的访问权。更多团队应能拥有自己的模型、自己的系统、自己的未来。

การระดมทุน Seed Round มูลค่า 100 ล้านดอลลาร์สหรัฐนี้ มีเป้าหมายเพื่อทำให้ประโยคนี้กลายเป็นความเป็นจริงทางวิศวกรรม: ทำให้ SGLang เป็นมาตรฐานการผลิตในวันแรกสำหรับโมเดลใหม่ทุกตัว; สร้าง Miles ให้เป็นเฟรมเวิร์กระดับโครงสร้างพื้นฐานสำหรับการฝึกอบรมขนาดใหญ่และ RL; จากนั้น สร้างแพลตฟอร์มให้บริการบนแกนโอเพ่นซอร์ส ที่ไม่ผูกมัดโมเดล ไม่บังคับลูกค้า แต่ยังคงมอบความสามารถด้านโครงสร้างพื้นฐานระดับสูงสุด

วิสัยทัศน์ของ RadixArk ไม่เคยมีจุดมุ่งหมายเพื่อแทนที่ใคร แต่เพื่อให้ห้องปฏิบัติการทางวิชาการ ทีมงานสามคน หรือสตาร์ทอัพที่เพิ่งได้รับการลงทุนรอบ Seed และบริษัทขนาดใหญ่ที่มีมูลค่าตลาดล้านล้าน — สามารถเริ่มต้นบนโครงสร้างพื้นฐานเดียวกัน

หาก Anthropic ในปี 2023, Mistral ในปี 2024 และ Thinking Machines Lab ในปี 2025 แต่ละรายเป็นการเดิมพันในทิศทางของชั้นโมเดล AI แล้ว RadixArk ในปี 2026 กำลังเดิมพันในสิ่งที่ลึกกว่าและยั่งยืนกว่า: การมอบสิทธิ์ในการสร้าง AI ชั้นนำกลับไปยังผู้คนจำนวนมากพอสมควร

หลังจากเสร็จสิ้นการระดมทุน ทีมได้เริ่มโครงการตอบแทนชุมชนโอเพ่นซอร์ส: ลงทะเบียนบนแพลตฟอร์มและแชร์ทวีต เพื่อรับคะแนนการใช้งานฟรีเมื่อแพลตฟอร์ม RadixArk อย่างเป็นทางการเปิดตัว สำหรับทีมที่เติบโตมาจากชุมชนโอเพ่นซอร์สนี้ นี่คือการขอบคุณด้วยพลังการประมวลผลจริงๆ ต่อผู้ที่สนับสนุน SGLang มาจนถึงวันนี้

- ลิงก์: platform.radixark.com