ผู้เขียนต้นฉบับ: คูรี่, Shenchao TechFlow

เมื่อไม่กี่วันก่อน มีรูปภาพหนึ่งที่เป็นที่นิยมบนอินเทอร์เน็ต

อินเดียจัดการประชุมสุดยอด AI โดยนายกรัฐมนตรีโมดียืนอยู่บนเวที ขนาบข้างด้วยผู้บริหารระดับสูงจากซิลิคอนแวลลีย์ ระหว่างถ่ายรูปรวมกลุ่ม โมดีจับมือคนข้างๆ ยกขึ้นเหนือศีรษะ ผู้อื่นก็ตามจับมือกัน บรรยากาศเต็มไปด้วยความสามัคคี

แต่มีสองคนที่ไม่ได้จับมือ

ซีอีโอของ OpenAI และซีอีโอของ Anthropic ผู้เป็นเจ้าของบริษัทที่อยู่เบื้องหลัง ChatGPT และ Claude ยืนอยู่ข้างๆ กัน โดยแต่ละคนยกกำปั้นขึ้น

ไม่จับมือ ไม่มองหน้า ก็เหมือนสองคนที่ครูจับให้นั่งโต๊ะเดียวกัน

ในช่วงไม่กี่ปีที่ผ่านมา บริษัททั้งสองแห่งนี้แข่งขันกันอย่างดุเดือด Claude ถูกพัฒนาโดยทีมที่แยกตัวออกจาก OpenAI ทั้งสองฝ่ายแย่งชิงผู้ใช้ ลูกค้าองค์กร และการระดมทุน ในช่วงซูเปอร์โบวล์ปีนี้ Anthropic ยังใช้เงินซื้อโฆษณาเพื่อหยอกล้อว่า ChatGPT จะขึ้นโฆษณา

ดังนั้นจึงไม่จับมือกัน ปกติ

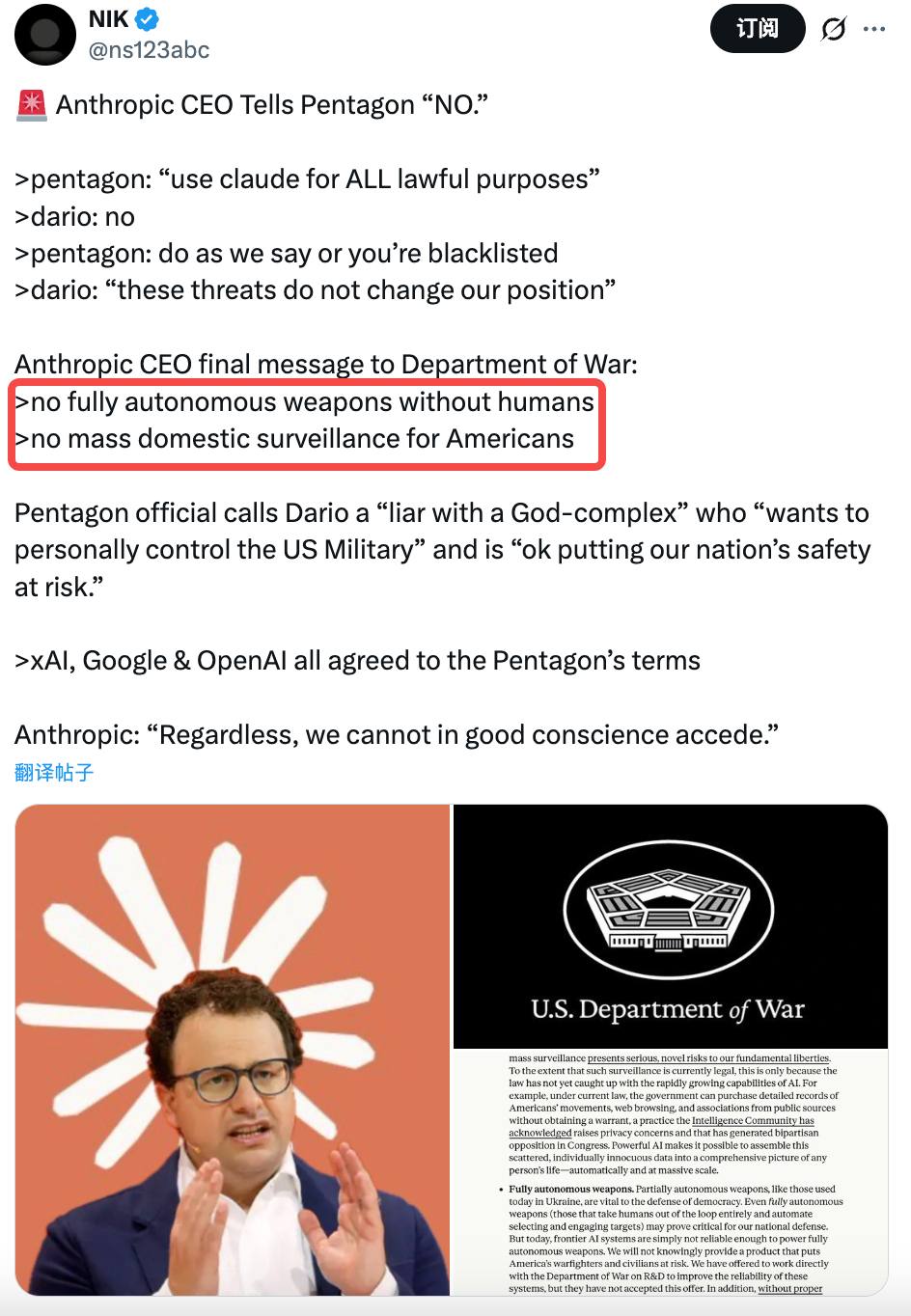

แต่วันนี้พวกเขาจับมือกันแล้ว เพราะกระทรวงกลาโหม

เรื่องมีอยู่ว่า

Anthropic ซึ่งเป็นบริษัทที่อยู่เบื้องหลัง Claude ได้ลงนามในสัญญาสูงสุด 200 ล้านดอลลาร์สหรัฐกับกระทรวงกลาโหมสหรัฐเมื่อปีที่แล้ว Claude เป็นโมเดล AI ตัวแรกที่ถูกนำไปใช้งานบนเครือข่ายลับของกองทัพสหรัฐ เพื่อช่วยจัดการงานวิเคราะห์ข่าวกรองและการวางแผนภารกิจ

แต่ Anthropic ได้วาดเส้นสีแดงสองเส้นไว้ในสัญญา:

Claude ไม่สามารถใช้ในการติดตามเฝ้าระวังประชาชนอเมริกันในระดับใหญ่ หรือใช้ในอาวุธอัตโนมัติที่ไม่มีการมีส่วนร่วมของมนุษย์ (อ่านเพิ่มเติม:Anthropic 身份危机的七十二小时)

แต่กระทรวงกลาโหมไม่ยอมรับ

คำขอของพวกเขาคือสี่คำ: ไม่มีข้อจำกัด ซื้อเครื่องมือแล้วก็ควรใช้ตามใจ บริษัทเทคโนโลยีอย่างคุณมีสิทธิ์อะไรที่จะบอกกองทัพสหรัฐว่าทำอะไรได้หรือไม่ได้

เมื่อวันอังคารที่ผ่านมา รัฐมนตรีว่าการกระทรวงกลาโหม Hegseth ได้ส่งคำขาดให้ซีอีโอของ Anthropic โดยตรง: ต้องตกลงก่อนเวลา 17:01 น. วันศุกร์ มิฉะนั้นจะรับผิดชอบต่อผลลัพธ์

Anthropic ไม่ได้ตอบรับ

ซีอีโอของพวกเขาได้เผยแพร่คำแถลงสาธารณะ โดยระบุว่า: เรามีความเข้าใจอย่างลึกซึ้งถึงความสำคัญของ AI ต่อการป้องกันประเทศของสหรัฐอเมริกา แต่ในบางกรณี AI อาจทำลายมากกว่าปกป้องคุณค่าของประชาธิปไตย เราไม่สามารถยอมรับข้อเรียกร้องนี้ได้ด้วยจิตสำนึกของตน

ตัวแทนการเจรจาของกระทรวงกลาโหมสหรัฐฯ เอมิล ไมเคิล ได้โจมตีเขาบนโซเชียลมีเดียว่าเป็นคนหลอกลวง กล่าวหาว่าเขามีความรู้สึกเหมือนเป็นพระเจ้าและนำความมั่นคงแห่งชาติมาเป็นของเล่น

การจับมือชั่วคราว

จากนั้น สิ่งที่ไม่คาดคิดก็เกิดขึ้น

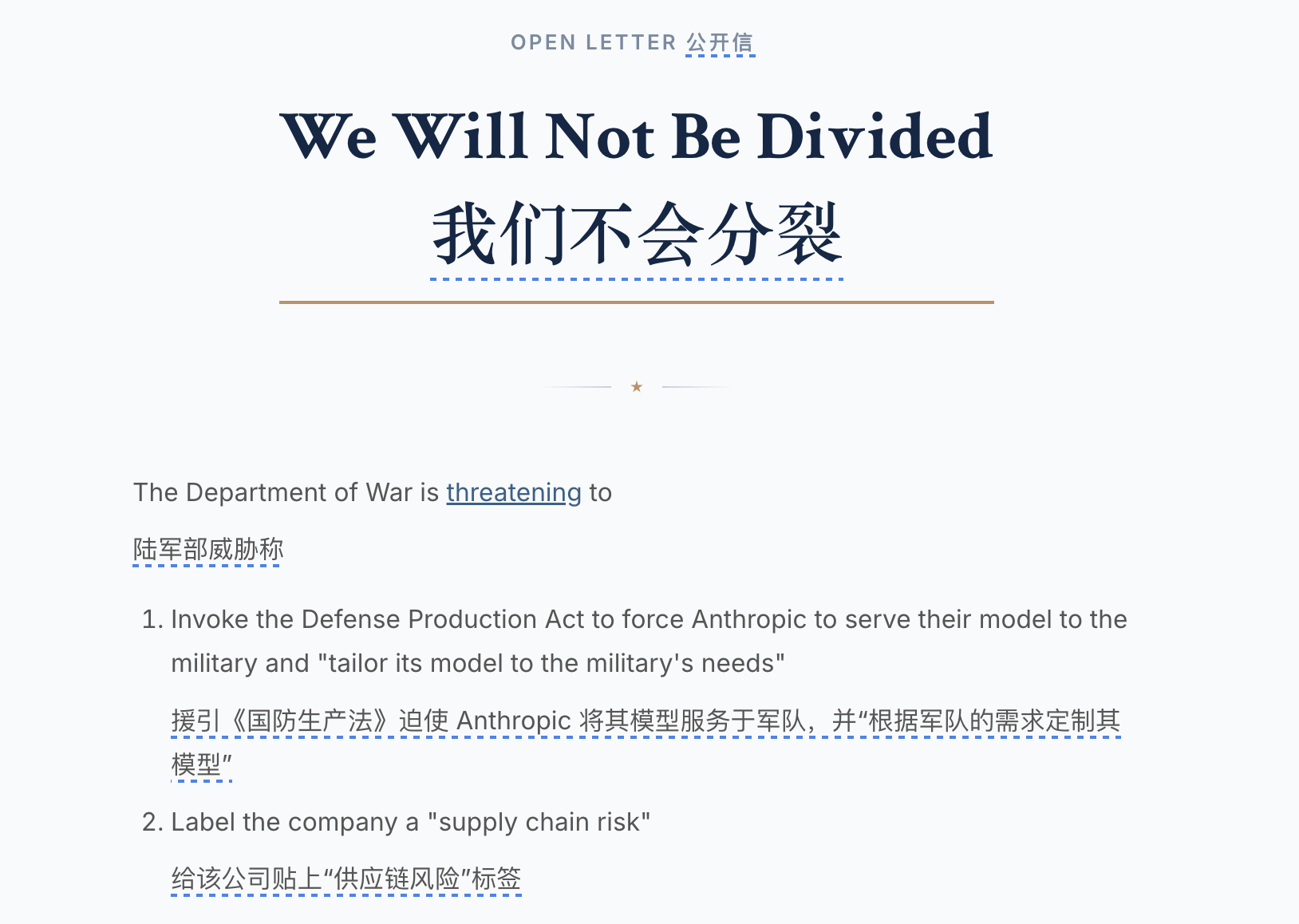

พนักงานของ OpenAI และ Google จำนวนกว่า 400 คนได้ลงนามในจดหมายเปิดผนึกที่มีชื่อว่า "เราไม่ถูกแบ่งแยก"

จดหมายระบุว่ากระทรวงกลาโหมกำลังเจรจากับบริษัท AI แต่ละแห่งอย่างเป็นลำดับ เพื่อให้ผู้อื่นยอมรับเงื่อนไขที่ Anthropic ปฏิเสธ โดยใช้ความกลัวแยกแยะบริษัทแต่ละแห่ง

ซีอีโอของ OpenAI ยังส่งจดหมายภายในถึงพนักงานทั้งหมด โดยระบุว่า OpenAI มีเส้นแดงเดียวกันกับ Anthropic:

ไม่มีการติดตามเฝ้าระวังขนาดใหญ่ ไม่มีอาวุธที่สามารถฆ่าได้ด้วยตนเอง

บริษัทสองแห่งที่ก่อนหน้านี้เพียงไม่กี่วันยังไม่ยอมจับมือกัน ตอนนี้กลับมาอยู่บนฝั่งเดียวกันเพราะกระทรวงกลาโหม

แต่ความสามัคคีแบบนี้ อาจคงอยู่ได้เพียงไม่กี่ชั่วโมง

เวลา 17:01 น. วันศุกร์ คำเด็ดขาดของกระทรวงกลาโหมสหรัฐฯ สิ้นสุดลง Anthropic ไม่ได้ลงนาม

บริษัทเทคโนโลยีของสหรัฐฯ ที่มีมูลค่า 380,000 ล้านดอลลาร์สหรัฐ ปฏิเสธกระทรวงกลาโหมสหรัฐฯ แม้จะเสี่ยงต่อการสูญเสียสัญญา trị 200 ล้านดอลลาร์สหรัฐ ในอดีต การกระทำเช่นนี้อาจจบลงเพียงการยกเลิกสัญญาและเปลี่ยนผู้ให้บริการ แต่ครั้งนี้ การตอบสนองของวอชิงตันไม่ได้เป็นเพียงระดับธุรกิจเท่านั้น

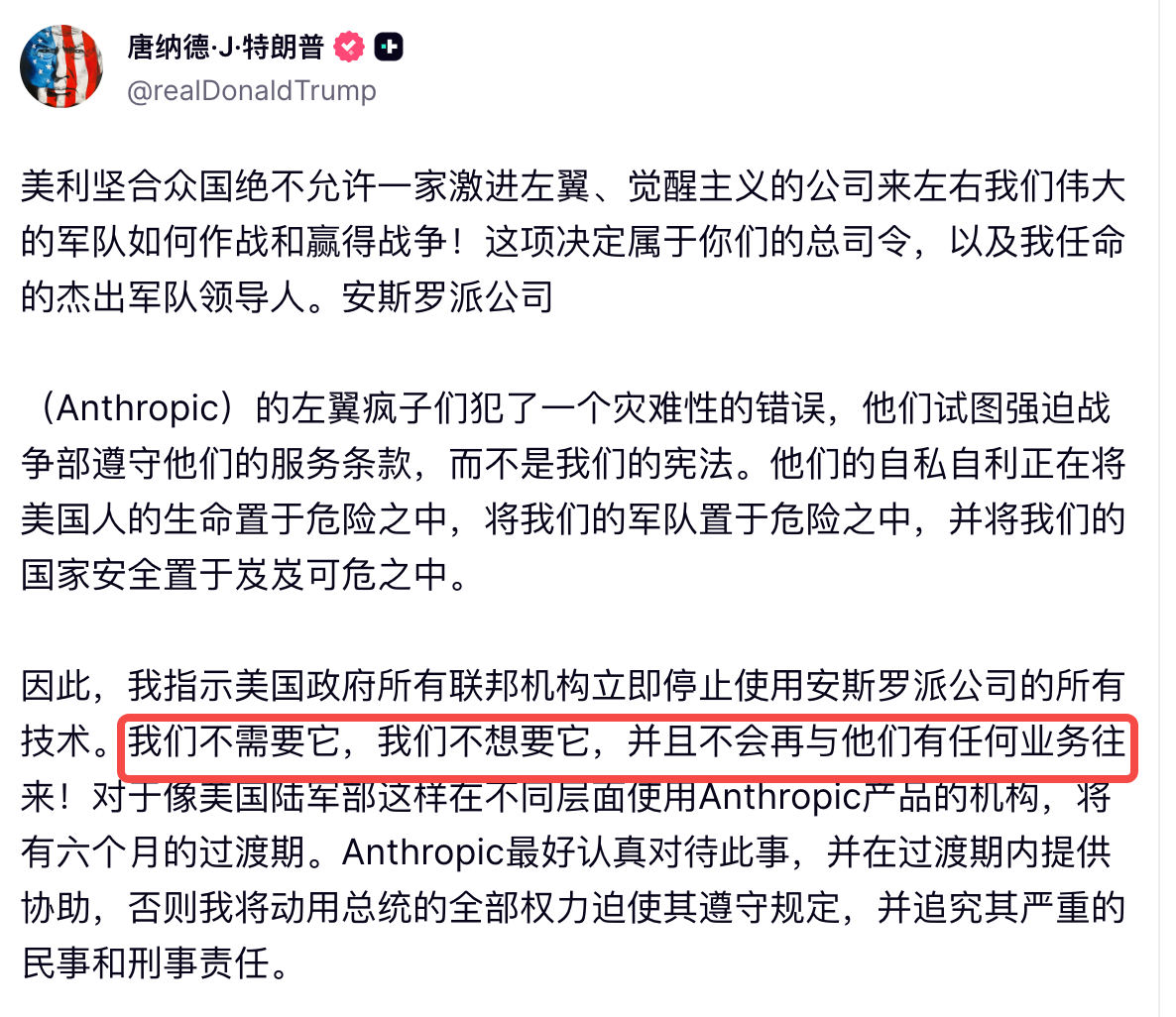

ทรัมป์โพสต์บน Truth Social ประมาณหนึ่งชั่วโมงต่อมา เรียก Anthropic ว่า "พวกหัวซ้ายบ้าคลั่ง" และกล่าวว่าพวกเขาพยายามเหนือรัฐธรรมนูญ แล้วเล่นกับชีวิตของทหารอเมริกัน

เขาเรียกร้องให้หน่วยงานรัฐบาลทั้งหมดหยุดใช้เทคโนโลยีของ Anthropic ทันที

ทันทีนั้น รัฐมนตรีว่าการกระทรวงกลาโหมสหรัฐฯ Hegseth ประกาศจัดให้ Anthropic เป็น "ความเสี่ยงด้านความปลอดภัยของห่วงโซ่อุปทาน" ป้ายนี้มักใช้กับบริษัทเช่น Huawei ซึ่งหมายความชัดเจนว่า ผู้รับเหมาทุกรายที่ทำธุรกิจกับกองทัพสหรัฐฯ ห้ามใช้ผลิตภัณฑ์ของ Anthropic อีกต่อไป

Anthropic กล่าวว่าจะฟ้องร้อง

ในคืนเดียวกันนั้น OpenAI ซึ่งก่อนหน้านี้ยังคงท่าทีเดียวกัน กลับได้ลงนามข้อตกลงกับกระทรวงกลาโหม

ปัญหาอุดมการณ์

OpenAI ได้รับอะไรไปบ้าง?

ตำแหน่งที่ Claude ถูกขับออก: ผู้จัดหา AI สำหรับเครือข่ายลับของกองทัพสหรัฐฯ อย่างไรก็ตาม OpenAI ได้เสนอเงื่อนไขสามประการต่อกระทรวงกลาโหม: ไม่ดำเนินการติดตามเฝ้าระวังขนาดใหญ่ ไม่พัฒนาอาวุธอัตโนมัติ และการตัดสินใจที่มีความเสี่ยงสูงต้องมีการมีส่วนร่วมของมนุษย์

กระทรวงกลาโหมสหรัฐฯ บอกว่า ตกลง

คุณไม่ได้อ่านผิด ข้อกำหนดที่ Anthropic ใช้เวลาหลายสัปดาห์แต่ไม่ยอมรับ เมื่อเสนอโดยบริษัทอื่น กลับตกลงกันได้ภายในไม่กี่วัน?

Of course, the two solutions are not exactly the same.

Anthropic เพิ่มอีกหนึ่งชั้น: พวกเขาเชื่อว่ากฎหมายปัจจุบันตามไม่ทันความสามารถของ AI เช่น AI สามารถซื้อและรวมข้อมูลตำแหน่งของคุณ ประวัติการท่องเว็บ และข้อมูลโซเชียลมีเดียได้อย่างถูกต้องตามกฎหมาย แล้วผลลัพธ์สุดท้ายก็เทียบเท่ากับการติดตามตรวจสอบ แต่ละขั้นตอนไม่ผิดกฎหมาย

Anthropic กล่าวว่าการเขียนเพียงแค่ “ไม่ติดตามตรวจสอบ” สี่คำนั้นไม่เพียงพอ ช่องโหว่นี้ต้องปิดให้สนิท OpenAI ไม่ได้ยึดมั่นในจุดนี้ พวกเขาได้รับคำอธิบายจากกระทรวงกลาโหมว่ากฎหมายปัจจุบันเพียงพอ

แต่ถ้าคุณคิดว่านี่เป็นเพียงข้อแตกต่างเรื่องเงื่อนไข คุณก็คงมองโลกแบบเด็กๆ มากเกินไป การเจรจาครั้งนี้ตั้งแต่เริ่มต้นไม่ได้เป็นเพียงการเจรจาเรื่องเงื่อนไข

David Sacks หัวหน้าด้านปัญญาประดิษฐ์ของทำเนียบขาว ได้วิพากษ์วิจารณ์ Anthropic อย่างเปิดเผยมาตั้งแต่ก่อนหน้านี้ว่ากำลังสร้าง "ปัญญาประดิษฐ์ที่มีอุดมการณ์" (ให้ความสำคัญกับอุดมการณ์และเรื่องความถูกต้องทางการเมือง); เจ้าหน้าที่ระดับสูงของกระทรวงกลาโหมได้พูดกับสื่อว่า ปัญหาของ Dario คือถูกขับเคลื่อนด้วยอุดมการณ์ "เรารู้ว่าเรากำลังจัดการกับใคร"

xAI ของเอลอน มัสก์ ซึ่งเป็นคู่แข่งโดยตรงของ Anthropic ได้โจมตี Anthropic ซ้ำๆ บน X ในสัปดาห์นี้ โดยอ้างว่าบริษัทนี้ "เกลียดวัฒนธรรมตะวันตก"

而 Anthropic 的 CEO 去年没去特朗普的就职典礼。OpenAI 的 CEO 去了。

ฆ่าไก่ให้ลิงดู

ดังนั้นเรามาสรุปสิ่งที่เกิดขึ้นกัน

หลักการเดียวกัน เส้นแดงเดียวกัน Anthropic ถูกจัดให้อยู่ในระดับเดียวกับ Huawei เป็นภัยคุกคามด้านความมั่นคงแห่งชาติของสหรัฐฯ เนื่องจากขอการป้องกันเพิ่มอีกชั้นหนึ่ง ยืนผิดข้าง และแสดงท่าทีผิด

OpenAI ลดชั้นหนึ่งไป ความสัมพันธ์ดี ได้สัญญาไป คุณบอกว่านี่คือชัยชนะของหลักการ หรือราคาของหลักการ?

สัญญาของกระทรวงกลาโหมไม่ได้ถูกต่อต้านเป็นครั้งแรก

ในปี 2018 บริษัท Google มีพนักงานมากกว่า 4,000 คนลงนามในจดหมายร้องเรียน และมีคนประมาณสิบคนลาออก เพื่อประท้วงการที่บริษัทเข้าร่วมโครงการ Project Maven ของกระทรวงกลาโหมสหรัฐฯ ซึ่งใช้ปัญญาประดิษฐ์วิเคราะห์วิดีโอที่โดรนถ่าย เพื่อช่วยให้กองทัพระบุเป้าหมายได้เร็วขึ้น

Google ได้ถอนตัวออกไปสุดท้าย ไม่ต่อสัญญาและจากไป พนักงานชนะ

ผ่านไป 8 ปี ความขัดแย้งเดียวกันก็กลับมาอีกครั้ง แต่ครั้งนี้กติกาเปลี่ยนไปอย่างสิ้นเชิง บริษัทอเมริกันแห่งหนึ่งบอกฉันว่าสามารถทำธุรกิจกับกองทัพได้ แต่มีสองสิ่งที่ห้ามทำ รัฐบาลอเมริกาตอบกลับด้วยการขับไล่ออกจากระบบ联邦ทั้งหมด

และป้ายกำกับ "ความเสี่ยงด้านความปลอดภัยของห่วงโซ่อุปทาน" มีผลกระทบ远不止丢掉一份 2 亿美元的合同。

รายได้ของ Anthropic ในปีนี้อยู่ที่ประมาณ 14 พันล้านดอลลาร์สหรัฐ สัญญา 2 ร้อยล้านดอลลาร์จึงไม่ถือเป็นอะไรเลย แต่ป้ายนี้หมายความว่า บริษัทใดก็ตามที่มีธุรกิจกับกองทัพสหรัฐ ห้ามใช้ Claude

บริษัทเหล่านี้ไม่จำเป็นต้องเห็นด้วยกับท่าทีของกระทรวงกลาโหม พวกเขาแค่ต้องทำการประเมินความเสี่ยง: ถ้ายังใช้ Claude อาจสูญเสียสัญญาของรัฐบาล; ถ้าเปลี่ยนไปใช้โมเดลอื่น จะไม่มีปัญหาใดๆ

การเลือกนั้นง่ายมาก นี่คือสัญญาณที่แท้จริงของเรื่องนี้

สิ่งที่สำคัญไม่ใช่แอนโธร์พิคจะรับไหวหรือไม่ แต่คือบริษัทถัดไปจะกล้ารับหรือไม่ มันจะพิจารณาผลลัพธ์นี้ ดูต้นทุนของการยึดมั่นในหลักการ แล้วตัดสินใจอย่างมีเหตุผล

กลับมามองภาพอินเดียอีกครั้ง ทุกคนจับมือกันยกขึ้นเหนือศีรษะ แต่เพียงคู่นี้เท่านั้นที่กำมือไว้คนละข้าง

อาจนี่แหละคือความปกติ

หลักการของบริษัท AI อาจเหมือนกัน แต่ไม่แน่ใจว่าจะจับมือกันได้หรือไม่