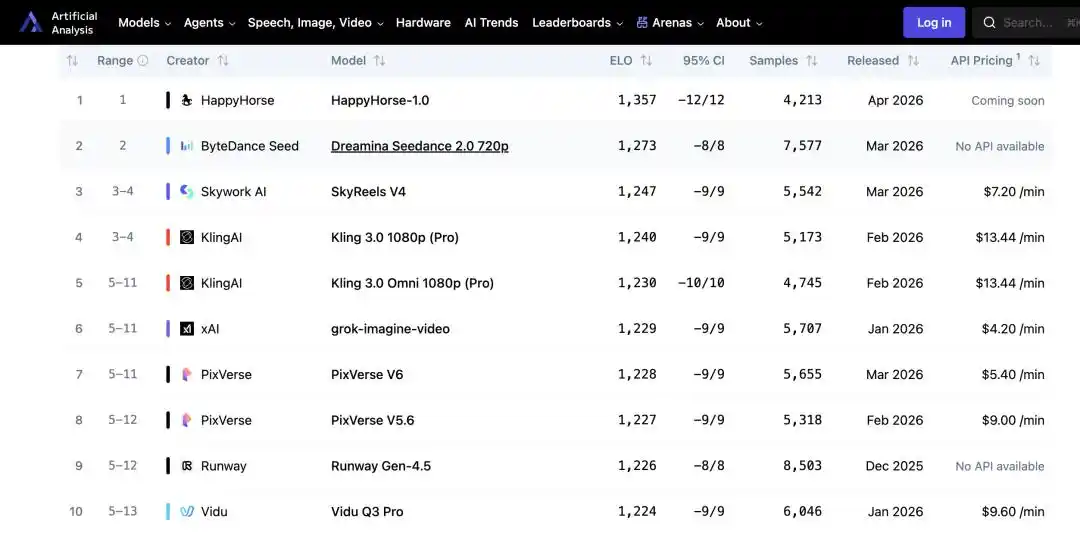

ไม่มีงานเปิดตัว ไม่มีบล็อกเทคนิค และไม่มีการรับรองจากบริษัทใดๆ—โมเดลการแปลงข้อความเป็นวิดีโอชื่อ HappyHorse-1.0 ได้ขึ้นอันดับหนึ่งบนตารางคะแนน AI Video Arena ของแพลตฟอร์มประเมิน AI ที่มีชื่อเสียง Artificial Analysis โดยมีคะแนน Elo สูงกว่า Seedance 2.0 และทิ้งห่างผู้เล่นรายใหญ่หลายราย เช่น Ke Ling และ Tian Gong ทำให้เกิดการแข่งขันเพื่อไขปริศนาในวงการเทคโนโลยี

อันดับของ Artificial Analysis ไม่ใช่การประเมินจากพารามิเตอร์ทางเทคนิค แต่เป็นคะแนน Elo ที่สรุปจากผลการทดสอบแบบไม่เปิดเผยตัวผู้ใช้จริง ซึ่งสะท้อนถึงการรับรู้ที่แท้จริงของผู้คนทั่วไปหลังจากดูแล้ว สิ่งนี้ทำให้อันดับนี้ยากต่อการตั้งคำถามมากกว่าตารางคะแนนทั่วไป และทำให้คำถามว่า “สิ่งนี้ถูกสร้างขึ้นโดยใครกันแน่” กลายเป็นคำถามที่ไม่สามารถมองข้ามได้

“Happy Horse” ค่อยๆ ขึ้นสู่อันดับหนึ่ง กระตุ้นการแข่งขันทายปริศนาในวงการเทคโนโลยี

การเดาบน X มาอย่างรวดเร็ว สิ่งแรกที่หลายคนสังเกตเห็นคือลำดับภาษาบนเว็บไซต์อย่างเป็นทางการ: จีนกลางและกวางตุ้งเรียงอยู่ก่อนภาษาอังกฤษ สำหรับผลิตภัณฑ์ที่มุ่งเป้าไปยังผู้ใช้ทั่วโลก ลำดับนี้ค่อนข้างผิดปกติ—หากทีมจากสหรัฐอเมริกาเป็นผู้นำ การจัดอันดับภาษาอังกฤษให้อยู่อันดับแรกแทบจะเป็นเรื่องแน่นอน จึงสามารถยืนยันได้ว่าทีมด้านหลังมาจากราชอาณาจักรจีน

ชื่อเองก็เป็นเบาะแส ปี 2026 เป็นปีม้าตามปฏิทินจีน ชื่อ “HappyHorse” ซ่อนคำเล่นคำเกี่ยวกับปีม้าที่ไม่ได้ซ่อนเร้นไว้มากนัก ซึ่งเมื่อต้นปีนี้ “Pony Alpha” ก็เคยใช้กลยุทธ์คล้ายกัน ดังนั้นรายชื่อผู้ต้องสงสัยจึงยาวขึ้นอย่างรวดเร็ว: ผู้ก่อตั้ง Tencent และ Alibaba ต่างมีนามสกุลว่า “马” (Ma) จึงถูกจัดอยู่ในรายการโดยธรรมชาติ; บางคนเดิมพันว่าเป็น Xiaomi เพราะเล่ยจุนเป็นคนขี้อายและชอบเปิดเผยสิ่งต่างๆ อย่างกะทันหัน; บางคนคิดว่ามันดูเหมือน DeepSeek มากกว่า เพราะ DS ก่อนหน้านี้เคยเปิดตัวโมเดลภาพอย่างเงียบๆ แล้วก็ลบออกอย่างเงียบๆ อีกครั้ง การเดาทั้งหลายเต็มไปด้วยความตื่นเต้น แต่ยังไม่มีใครสามารถแสดงหลักฐานที่ชัดเจนได้

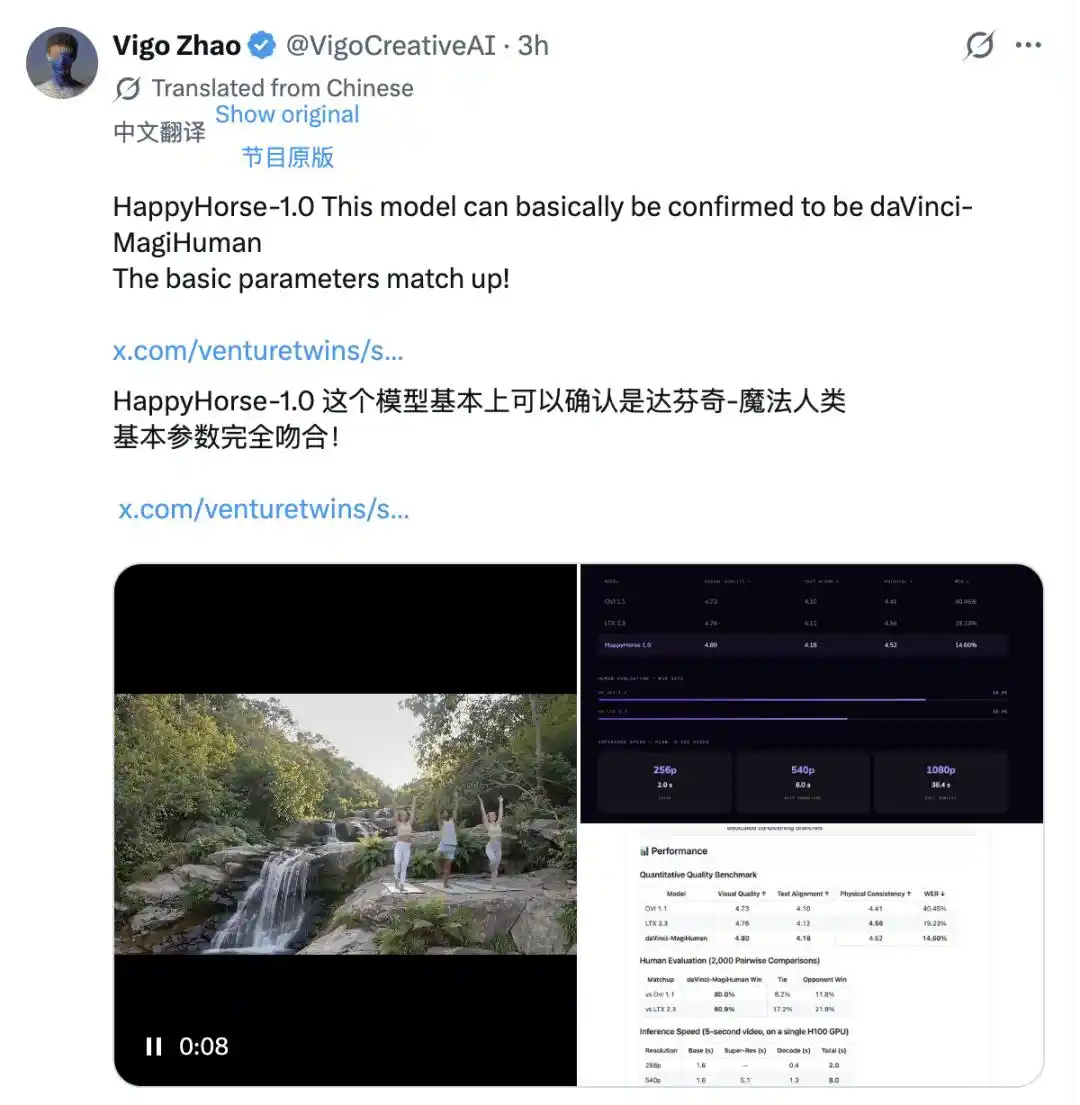

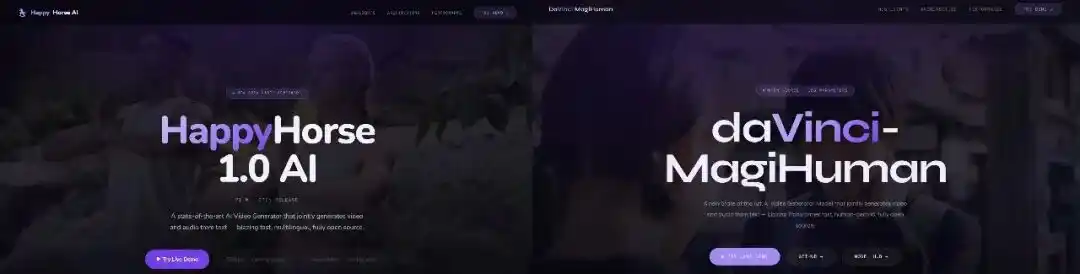

สิ่งที่ระบุเป้าหมายอย่างแท้จริงคือการเปรียบเทียบรายข้อในระดับเทคนิค ผู้ใช้ X ชื่อ Vigo Zhao ได้นำข้อมูลอ้างอิงสาธารณะของ HappyHorse-1.0 มาเปรียบเทียบกับโมเดลที่รู้จักทีละตัว และพบว่ามีความสอดคล้องสูงกับโมเดลหนึ่งชื่อ daVinci-MagiHuman ซึ่งก็คือโมเดลโอเพนซอร์ส “Da Vinci MagiHuman” ที่เปิดตัวบน GitHub ในเดือนมีนาคม

คุณภาพภาพ: 4.80, การจัดแนวข้อความ: 4.18, ความสอดคล้องทางกายภาพ: 4.52, อัตราความผิดพลาดของคำพูด: 14.60% — ข้อมูลทั้งสองชุดตรงกันทุกจุด โครงสร้างเว็บไซต์ก็เหมือนกันแทบทั้งหมด: รูปแบบการนำเสนอคำอธิบายโครงสร้าง ตารางประสิทธิภาพ และวิดีโอสาธิต ดูเหมือนใช้เทมเพลตเดียวกันทั้งคู่ ทั้งสองระบบใช้สถาปัตยกรรม Transformer แบบสตรีมเดียว เหมือนกันในการสร้างเสียงและวิดีโอร่วมกัน และรองรับรายการภาษาเดียวกันทั้งหมด การซ้ำซ้อนในระดับนี้ยากที่จะอธิบายด้วยความบังเอิญ

ข้อสรุปที่ได้รับการยอมรับมากที่สุดในวงการเทคโนโลยีคือ HappyHorse เป็นเวอร์ชันที่พัฒนาต่อยอดจาก Sand.ai ซึ่งเป็นผู้ร่วมพัฒนาของ daVinci-MagiHuman โดยใช้โมเดลโอเพ่นซอร์สเป็นพื้นฐาน โดยมีเป้าหมายหลักในการตรวจสอบขีดจำกัดของโมเดลภายใต้ความชอบที่แท้จริงของผู้ใช้ เพื่อเตรียมความพร้อมสำหรับการนำไปใช้งานเชิงพาณิชย์ในอนาคต

daVinci-MagiHuman จะเปิดซอร์สโค้ดอย่างเป็นทางการในวันที่ 23 มีนาคม 2026 เป็นผลผลิตจากการร่วมมือของทีมหนุ่มสองทีม ทีมหนึ่งมาจากห้องปฏิบัติการวิจัยปัญญาประดิษฐ์แบบสร้างสรรค์ (GAIR) ของวิทยาลัยปัญญาสร้างสรรค์เซี่ยงไฮ้ (SII) โดยมีนักวิชาการหลิว เผิงเฟยเป็นหัวหน้า อีกทีมหนึ่งคือ Sand.ai (สามดุ๊ก เทคโนโลยี) จากปักกิ่ง ผู้ก่อตั้งคือคาโอ เหยียน ซึ่งก็มีพื้นฐานทางวิชาการเช่นกัน โดยบริษัทมุ่งเน้นไปที่โมเดลโลกแบบถอยหลัง

โมเดลใช้ Transformer แบบลำดับเดียวที่มีพารามิเตอร์ 15 พันล้านตัวและใช้การสนใจแบบบริสุทธิ์ โดยรวมโทเค็นจากข้อความ วิดีโอ และเสียงทั้งหมดเข้าไปในลำดับเดียวกันเพื่อสร้างแบบจำลองร่วมกัน — ก่อนหน้านี้ในชุมชนโอเพนซอร์ส ยังไม่มีใครเริ่มต้นจากศูนย์ในการฝึกล่วงหน้าแบบรวมเสียงและวิดีโอจริงๆ ซึ่งส่วนใหญ่จะเป็นการเชื่อมต่อบนพื้นฐานของโมเดลเดี่ยว

วิดีโอโมเดลแบบโอเพนซอร์ส ทำได้อย่างไรจึงสามารถกลับตัวกลับใจในสองสัปดาห์?

หลังจากระบุตัวตนแล้ว คำถามอีกข้อกลับยากกว่า: HappyHorse-1.0 凭什么能在短短两周内拿到比Seedance 2.0更高的Elo分数?

จากข้อมูลที่เปิดเผยบนเว็บไซต์อย่างเป็นทางการ ฮัปปี้ฮอร์สไม่ได้ปรับเปลี่ยนโครงสร้างพื้นฐานใดๆ สมมติฐานที่สมเหตุสมผลกว่าคือ มันได้ปรับแต่งกลยุทธ์การสร้างแบบเริ่มต้นให้เหมาะสมกับสถานการณ์การประเมิน

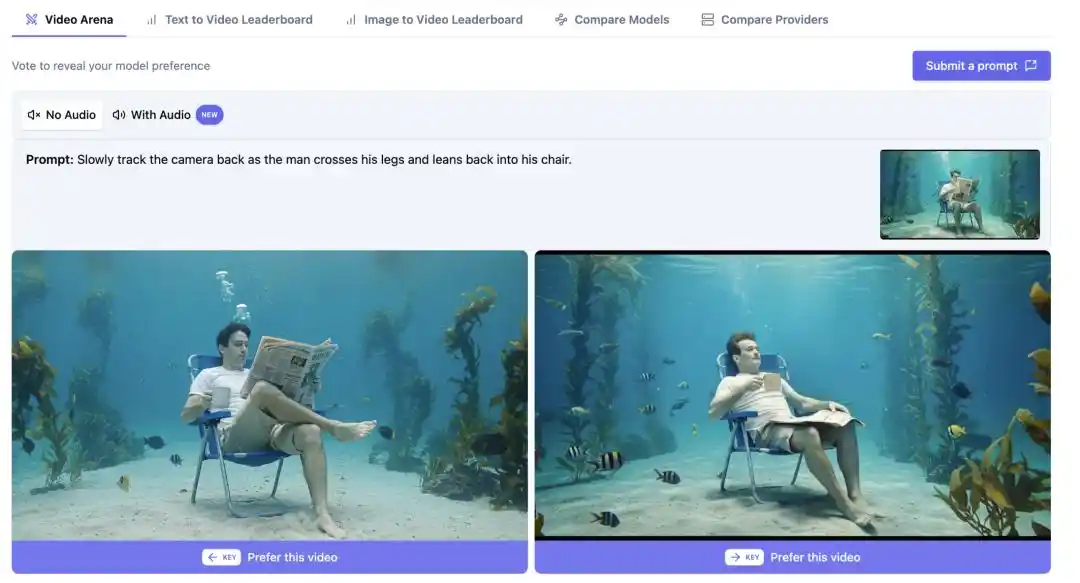

ระบบ Elo เป็นการสะสมของความชอบของผู้ใช้ โดยการปรับปรุงเล็กน้อยในประเด็นที่รับรู้ได้ไว เช่น สีหน้าของตัวละครมีความเสถียรหรือไม่ เสียงและภาพสอดคล้องกันหรือไม่ ภาพสวยงามหรือไม่ ทำให้ในแบบทดสอบแบบไม่รู้ตัว มักจะถูกเลือกมากกว่า ขีดจำกัดความสามารถของโมเดลยังคงไม่เปลี่ยน แต่ “ผลการประเมิน” สามารถปรับแต่งให้ดีขึ้นได้

ในตัวอย่างการทดสอบแบบเปิดเผยของ Artificial Analysis ภาพใบหน้าและเนื้อหาประเภทพูดหน้ากล้องคิดเป็นสัดส่วนเกิน 60% ขณะที่ daVinci-MagiHuman มุ่งเน้นการสร้างภาพใบหน้าตั้งแต่ขั้นตอนการฝึกอบรม จึงมีข้อได้เปรียบเชิงธรรมชาติในบริบทดังกล่าว ซึ่งเป็นเหตุผลหลักที่ทำให้อัตราการชนะในการทดสอบแบบเปิดเผยสูงกว่า; หากตัวอย่างการทดสอบเน้นภาพใบหน้าแบบใกล้ๆ โมเดลที่เชี่ยวชาญด้านภาพใบหน้าจะได้เปรียบอย่างเป็นระบบ ซึ่งไม่มีความเกี่ยวข้องโดยตรงกับประสิทธิภาพจริงของมันในสถานการณ์ซับซ้อน เช่น หลายบุคคล การเคลื่อนกล้องที่ซับซ้อน หรือการเล่าเรื่องระยะยาว

ผลลัพธ์คือ มีช่องว่างที่ชัดเจนระหว่างตัวเลขในตารางอันดับกับประสบการณ์จริง ผู้อภิปรายบน X แบ่งออกเป็นสองฝ่าย ฝ่ายที่สงสัยหลังการทดสอบเชื่อว่า HappyHorse-1.0 และ Seedance 2.0 ยังคงมีช่องว่างที่มองเห็นได้ในรายละเอียดตัวละครและความต่อเนื่องของการเคลื่อนไหว และจึงตั้งคำถามถึงความเป็นตัวแทนของคะแนน Elo

ในขณะเดียวกัน ผู้สนับสนุนต่างมีความหวังสูงต่อศักยภาพของ HappyHorse ที่จะแก้ไขปัญหาสำคัญของอุตสาหกรรมคือ “ความสม่ำเสมอของคุณภาพภาพในซีเควนซ์หลายมุมกล้อง” เนื่องจากปัญหานี้ยังไม่ได้รับการแก้ไขอย่างเหมาะสมโดยโมเดลวิดีโอหลักๆ ปัจจุบัน หาก daVinci-MagiHuman สามารถก้าวข้ามจุดนี้ได้ อาจมีความสำคัญมากกว่าการจัดอันดับในรายการใดๆ

ข้อจำกัดของโมเดลเองก็ไม่ควรถูกปิดบังด้วยตัวเลข บล็อกเกอร์ Xiaohongshu @JACK's AI World ได้ติดตั้งและทดสอบ daVinci-MagiHuman ตั้งแต่แรกเริ่ม และพบว่ามันต้องใช้ H100 ในการรัน ซึ่งการ์ดจอสำหรับผู้ใช้ทั่วไปแทบจะเป็นไปไม่ได้ แม้ว่าชุมชนจะกำลังศึกษาแนวทางการลดขนาดข้อมูล แต่ในระยะสั้น ผู้ใช้ทั่วไปยังเผชิญความยากลำบากในการติดตั้งแบบโลคัล

ในบริบทจริง มันมีจุดแข็งหลักในการสร้างบุคคลเดียว เมื่อมีหลายคนปรากฏหรือฉากซับซ้อนขึ้น คุณภาพจะลดลง—นี่ไม่ใช่ปัญหาที่แก้ได้ด้วยการปรับพารามิเตอร์ แต่เกี่ยวข้องโดยตรงกับการออกแบบที่เน้นภาพบุคคล เวลาในการสร้างโดยทั่วไปอยู่ที่ประมาณ 10 วินาที หากยาวกว่านั้นจะเกิดความยุ่งเหยิง และการส่งออกความละเอียดสูงยังต้องพึ่งปลั๊กอินซูเปอร์เรโซลูชันในการเสริม

ผลสรุปจาก AI Vision ของ @JACK คือ: daVinci-MagiHuman มีความสะดวกในการใช้งานน้อยกว่า LTX 2.3 และควรรอให้ชุมชนพัฒนาการวัดผลเชิงปริมาณให้เสร็จก่อนจึงจะเหมาะสำหรับการใช้งานรายวัน

เส้นทางการสร้างวิดีโอ รอคอย “ปลาตะเพียน” ตัวจริงหรือยัง?

แน่นอน การอยู่อันดับหนึ่งเพียงครั้งเดียวไม่ได้บ่งบอกอะไรหลายอย่าง ต่อไป HappyHorse ยังต้องผ่านการทดสอบอย่างละเอียดในด้านความเสถียร ความเร็วในการเข้าถึงแบบพร้อมกันสูง ความสอดคล้องข้ามบริบท ความแม่นยำในการควบคุมบทบาท และความสามารถทั่วไปนอกเหนือจากชุดการประเมิน ซึ่งเหล่านี้คือตัวชี้วัดหลักที่กำหนดว่าโมเดลหนึ่งๆ จะสามารถเข้าสู่กระบวนการทำงานของผู้สร้างเนื้อหาได้จริงหรือไม่

แต่หากมองในบริบทของอุตสาหกรรมที่กว้างขึ้น สัญญาณที่สิ่งนี้ส่งออกไปนั้นชัดเจนพอแล้ว

โมเดลวิดีโอแบบโอเพ่นซอร์สไม่ใช่เรื่องใหม่ แต่สิ่งที่ยังคงแยกแยะระหว่างแบบโอเพ่นซอร์สกับแบบปิดซอร์สคือช่องว่างด้านคุณภาพที่มองเห็นได้—ในสถานการณ์ที่ต้องส่งมอบให้ลูกค้า คุณภาพการสร้างของโมเดลแบบโอเพ่นซอร์สยังไม่สามารถข้ามขีดจำกัดจาก “ใช้งานได้” ไปสู่ “สามารถส่งมอบได้” ได้ อำนาจการตั้งราคาของผลิตภัณฑ์ปิดซอร์สเช่น Ke Ling และ Seedance นั้นในระดับหนึ่งถูกสร้างขึ้นจากช่องว่างนี้

ความหมายของครั้งนี้คือ ผลิตภัณฑ์ที่สร้างจากโมเดลโอเพนซอร์ส ได้เข้ามาแข่งขันอย่างตรงไปตรงมากับคู่แข่งแบบปิดซอร์สหลักในรายการเรียงลำดับการทดสอบแบบไม่เปิดเผยตัวตน โดยอิงจากประสบการณ์ของผู้ใช้จริง ไม่ว่าจะมีการปรับแต่งเพื่อเหมาะกับสภาพแวดล้อมการทดสอบมากน้อยเพียงใด สำหรับผู้ผลิตแบบปิดซอร์สที่สร้างอำนาจในการกำหนดราคาจากช่องว่างนี้ อย่างน้อยนี่ก็เป็นสัญญาณที่ควรให้ความสำคัญ

สำหรับนักพัฒนา จุดเปลี่ยนนี้มีความหมายที่ชัดเจนยิ่งขึ้น ในบริบทเฉพาะทาง เช่น ภาพบุคคล ตัวตนดิจิทัล และผู้ดำเนินรายการเสมือน เมื่อคุณภาพการสร้างของฐานโอเพ่นซอร์สแตะถึงขีดจำกัดที่ “สามารถส่งมอบได้” โครงสร้างต้นทุนของการปรับใช้ด้วยตนเองจะเปลี่ยนแปลงอย่างมีนัยสำคัญ—ไม่เพียงแต่ลดต้นทุนการเรียกใช้ API แต่ยังสำคัญกว่านั้นคือการนำข้อมูล โมเดล และกระบวนการอนุมานทั้งหมดมาอยู่ภายใต้การควบคุมของตนเอง ซึ่งให้ความยืดหยุ่นในระดับการปรับแต่งเชิงลึกและการปฏิบัติตามกฎระเบียบด้านความเป็นส่วนตัวที่โซลูชันแบบปิดไม่สามารถให้ได้

HappyHorse-1.0 ไม่ได้เป็นภัยคุกคามต่อตำแหน่งทางตลาดของ Seedance 2.0 หรือ Ke Ling ในระยะสั้น แต่เมื่อความเข้าใจว่าโมเดลแบบเปิดแหล่งที่มาสามารถแข่งขันกับโมเดลแบบปิดได้ถูกยืนยันแล้ว การปรับปรุงเชิงปริมาณ การปรับแต่งเฉพาะด้าน และการเร่งความเร็วการให้เหตุผลจะถูกขับเคลื่อนต่อไปโดยชุมชนในอัตราที่เร็วกว่าผลิตภัณฑ์แบบปิดอย่างมาก

ในปีม้าครั้งนี้ สิ่งที่ควรให้ความสนใจอย่างแท้จริง อาจไม่ใช่ม้าตัวไหนวิ่งเร็วที่สุด แต่คือเส้นทางเองที่กำลังกว้างขึ้น

บทความนี้มาจากหมายเลขเวิร์กช็อป WeChat “AI Value Officer” โดยผู้เขียน: Hoshino แก้ไขโดย Meiqi