บทความ | LetterAI

Google ดูเหมือนจะรีบแล้ว

เพิ่งมีข่าวว่า เซอร์เกย์ บริน ผู้ร่วมก่อตั้งกูเกิล ได้เปิดใช้งาน "โหมดผู้ก่อตั้ง" อีกครั้ง โดยตรงไปยังการควบคุมและจัดตั้งทีมงานชั้นยอดเพื่อเร่งพัฒนาความสามารถหลักของ Gemini ให้ทันเทียบคู่แข่งอย่าง Anthropic ในด้านการเขียนโปรแกรมด้วย AI และตัวแทนอัตโนมัติ

ทันทีหลังจากนั้น โกเกิลก็ประกาศอัปเดตสำคัญในช่วงกลางคืน โดยเปิดตัวตัวแทนปัญญาประดิษฐ์เพื่อการวิจัยอัตโนมัติรุ่นใหม่สองรุ่นที่สร้างขึ้นจากโมเดล Gemini 3.1 Pro: Deep Research และ Deep Research Max

ไม่เพียงแต่เสริมความสามารถในการให้เหตุผลในระดับพื้นฐานของโมเดล แต่ยังผลักดันอย่างแข็งขันให้ตัวแทนปัญญาประดิษฐ์อิสระพัฒนาไปสู่ระดับองค์กรและแพลตฟอร์มสำหรับนักพัฒนา โดยเปิดผ่าน API รองรับข้อมูลส่วนตัว และงานแบบอะซิงโครนัสเบื้องหลัง เพื่อแย่งชิงตำแหน่งนำในบริบทที่มีมูลค่าสูงอย่าง “เครื่องมือวิจัย/วิเคราะห์ AI” และรับมือกับคู่แข่งอย่าง OpenAI (Hermes) และ Perplexity

ตัวแทนอัจฉริยะทั้งสองตัวนี้อนุญาตให้นักพัฒนาผสานข้อมูลจากเครือข่ายเปิดกับข้อมูลเฉพาะขององค์กรผ่านการเรียก API เพียงครั้งเดียว พร้อมสร้างกราฟและอินโฟกราฟิกแบบเนทีฟภายในรายงานการวิจัย รวมถึงสามารถเชื่อมต่อกับแหล่งข้อมูลบุคคลที่สามใดๆ ผ่าน Model Context Protocol (MCP)

ตัวแทนอัจฉริยะทั้งสองตัวจะเปิดให้ใช้งานในรูปแบบพรีวิวสาธารณะผ่านแพ็กเกจชำระเงินของ Gemini API ตั้งแต่วันนี้ โดยสามารถเข้าถึงผ่าน Interactions API ที่ Google เปิดตัวครั้งแรกในเดือนธันวาคม 2025

ใช่ ตัวแทนใหม่เหล่านี้ในขณะนี้สามารถใช้งานได้ผ่าน API เท่านั้น ผู้ใช้ทั่วไปไม่สามารถใช้งานได้ในแอป Gemini แม้จะสมัครรับบริการแบบจ่ายเงินก็ตาม ผู้ใช้บางคนแสดงความผิดหวังเมื่อเห็นข่าวอัปเดตแต่ไม่สามารถใช้งานได้: “谷歌不知何故,持续惩罚着我们这些Gemini App的Pro订阅用户……”

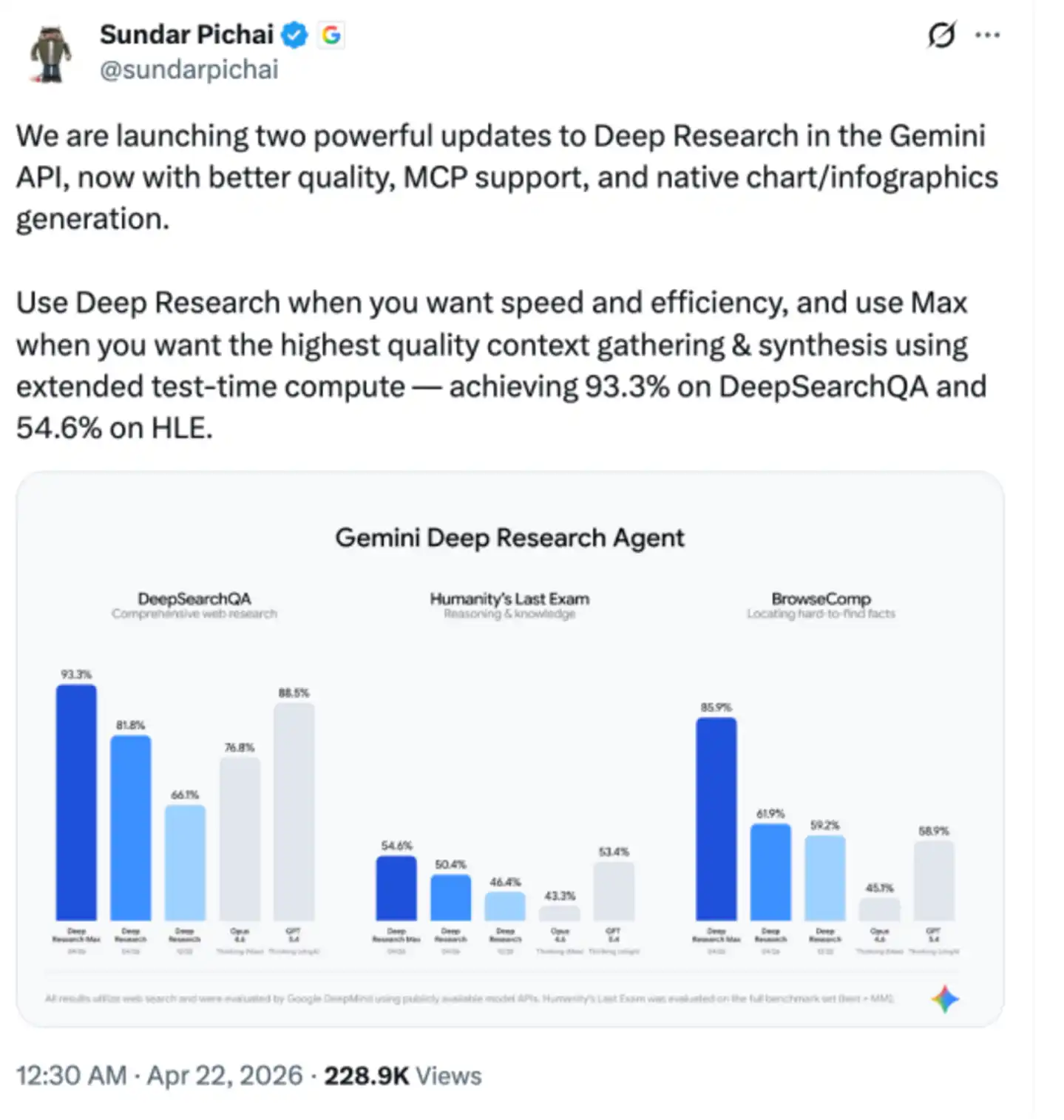

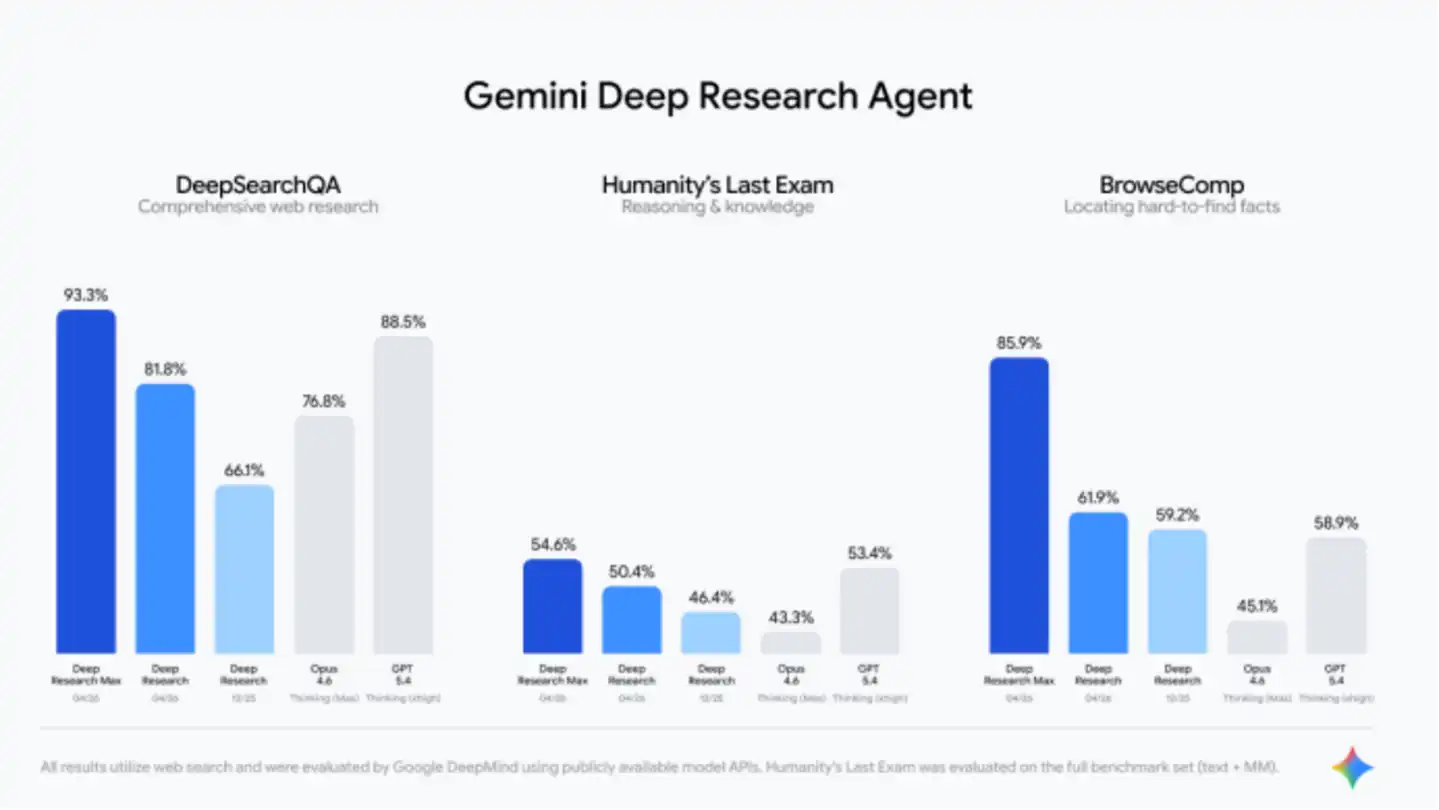

ซันดาร์ พิชัย ซีอีโอของกูเกิล ยังลงมาโปรโมตเองบน X ว่า: “เมื่อคุณต้องการความเร็วและประสิทธิภาพ ให้ใช้ Deep Research; เมื่อคุณต้องการการรวบรวมและสรุปบริบทคุณภาพสูงสุด ให้ใช้รุ่น Max — ซึ่งบรรลุผลลัพธ์ 93.3% สำหรับ DeepSearchQA และ 54.6% สำหรับ HLE โดยการขยายการคำนวณระหว่างการทดสอบ”

เมื่อ 18 เดือนก่อน เป้าหมายของ Google Deep Research คือการช่วยนักศึกษาปริญญาเอกหลีกเลี่ยงไม่ให้จมอยู่กับแท็บเบราว์เซอร์จำนวนมาก ขณะนี้ โกลด์แมน แซคส์ ต้องการให้มันแทนที่งานวิจัยพื้นฐานของนักวิเคราะห์ระดับเริ่มต้นในธนาคารการเงิน

ช่องว่างระหว่างเป้าหมายทั้งสองนี้—และว่าเทคโนโลยีนี้สามารถปิดช่องว่างนี้ได้จริงหรือไม่—จะกำหนดว่าตัวแทนการวิจัยอัตโนมัติจะกลายเป็นผลิตภัณฑ์ที่เปลี่ยนแปลงวงการซอฟต์แวร์องค์กร หรือแค่เป็นการสาธิตปัญญาประดิษฐ์อีกชิ้นหนึ่งที่ดูน่าประทับใจในการทดสอบมาตรฐาน แต่กลับทำให้ผิดหวังในการประชุม

สองเวอร์ชัน รองรับภาระงานที่แตกต่างกัน

Deep Research รุ่นมาตรฐานมีความล่าช้าต่ำกว่าและต้นทุนต่ำกว่า เหมาะสำหรับสถานการณ์ที่ต้องการความเร็ว

Deep Research Max ให้ความสำคัญกับความลึกมากกว่าความเร็ว ตัวแทนนี้ดำเนินการให้เหตุผล ค้นหา และวนซ้ำอย่างลึกซึ้งผ่านการขยายการคำนวณในช่วงการทดสอบ (extended test-time compute) เพื่อสร้างรายงานสุดท้าย

กูเกิลชี้ว่า กระบวนการทำงานแบบอะซิงโครนัสในพื้นหลังเป็นสถานการณ์การใช้งานที่เหมาะสมที่สุด เช่น การรันผ่านงานตามเวลา (cron job) ในช่วงกลางคืน เพื่อจัดส่งรายงานการตรวจสอบอย่างละเอียดครบถ้วนให้กับทีมวิเคราะห์ในเช้าวันถัดไป

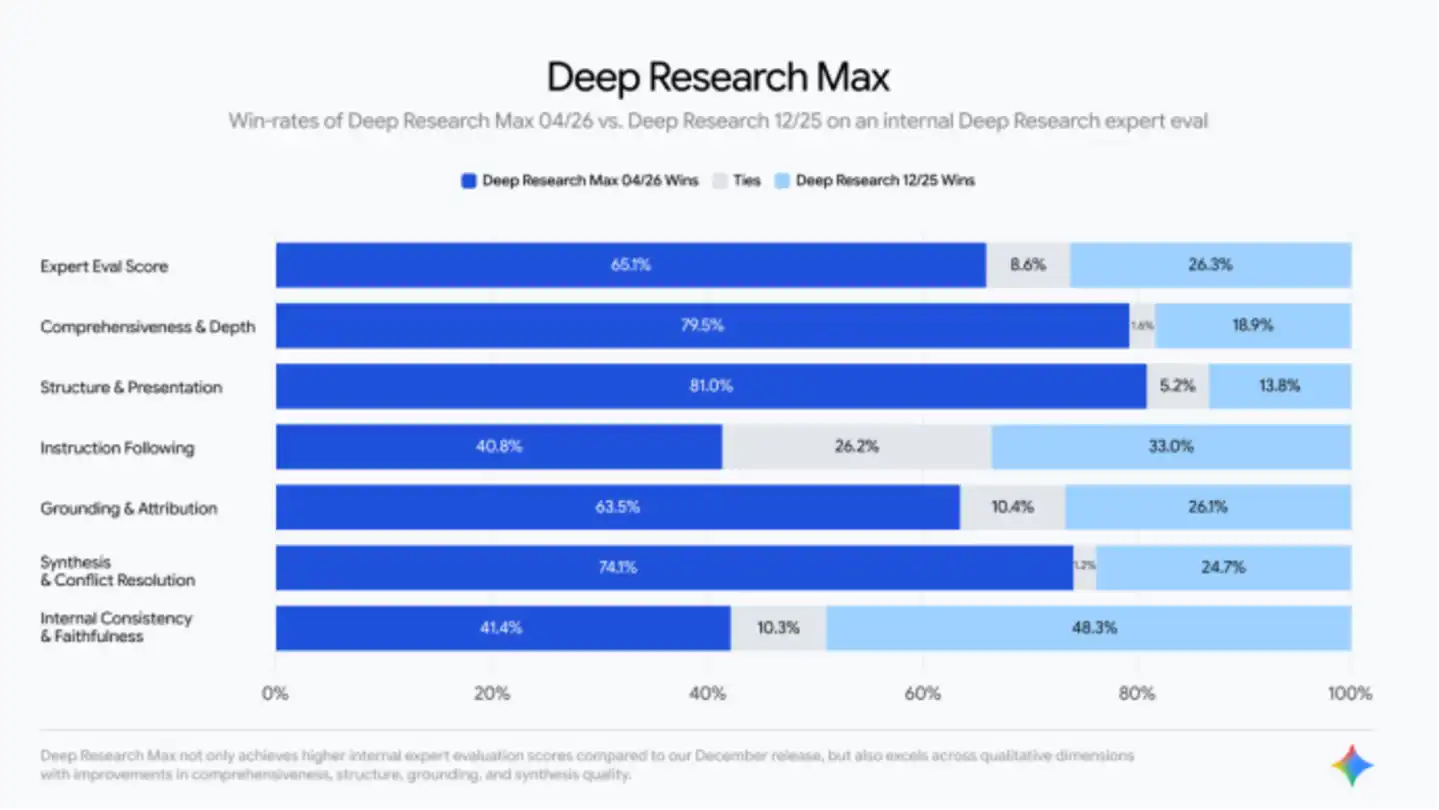

ในการทดสอบมาตรฐานของกูเกิลเอง Deep Research Max ได้รับความก้าวหน้าอย่างมีนัยสำคัญในงานการดึงข้อมูลและการให้เหตุผล ตัวแทนนี้สามารถรับข้อมูลจากแหล่งที่มาจำนวนมากกว่ารุ่นก่อนหน้า และจับรายละเอียดเล็กๆ น้อยๆ ที่โมเดลเก่ามักละเลย

Google ยังให้การเปรียบเทียบกับคู่แข่งด้วย

อย่างไรก็ตาม การเปรียบเทียบกับ GPT-5.4 ของ OpenAI และ Opus 4.6 ของ Anthropic จึงไม่เป็นธรรมอย่างสมบูรณ์ GPT-5.4 มีประสิทธิภาพดีในการค้นหาเว็บอัตโนมัติ แต่ไม่ได้รับการปรับแต่งโดยเฉพาะสำหรับการวิจัยเชิงลึก ดังนั้น OpenAI จึงได้พัฒนา DR Agent ของตนเอง ซึ่งหลังจากอัปเดตในเดือนกุมภาพันธ์ได้เปลี่ยนไปใช้ GPT-5.2 แทน GPT-5.4 โมเดลค้นหาที่แข็งแกร่งที่สุดของ OpenAI จริงๆ แล้วคือ GPT-5.4 Pro แต่显然 Google ไม่ได้นำมารวมไว้ในการเปรียบเทียบ

ตามข้อมูลของ OpenAI GPT-5.4 Pro ได้คะแนนสูงสุดถึง 89.3% ในการทดสอบประสิทธิภาพการค้นหาตัวแทน BrowseComp ในขณะที่ GPT-5.4 ได้คะแนน 82.7%

ตามรายงานของ Anthropic เอง Opus 4.6 ได้คะแนน 84% บน BrowseComp ซึ่งสูงกว่าค่าที่ Google แสดงไว้ คะแนนนี้ได้มาภายใต้การปิดฟังก์ชันการให้เหตุผล แต่โมเดลกลับแสดงประสิทธิภาพดีกว่าการตั้งค่าการให้เหตุผลแบบเข้มข้นที่ Google ใช้ในการทดสอบมาตรฐาน API

ช่องว่างเหล่านี้น่าจะเกิดจากวิธีการทดสอบที่แตกต่างกัน—โมเดลถูกประเมินผ่าน API เดิม หรือถูกห่อหุ้มอยู่ในเครื่องมือของแต่ละห้องปฏิบัติการเอง ข้อมูลของกูเกิลอาจไม่ผิด แต่ควรตีความอย่างระมัดระวัง ไม่ว่าอย่างไรก็ตาม วิธีการนำเสนอของมันขาดความโปร่งใสเพียงพอ

รองรับ MCP

ฟีเจอร์ที่มีผลกระทบมากที่สุดในการอัปเดตนี้คือการเพิ่มการรองรับ Model Context Protocol (MCP) ฟีเจอร์นี้จะเปลี่ยน Deep Research จากเครื่องมือวิจัยบนเว็บที่ทรงพลัง ให้กลายเป็นสิ่งที่ใกล้เคียงกับ “นักวิเคราะห์ข้อมูลทั่วไป” มากขึ้น

MCP เป็นมาตรฐานเปิดที่เกิดขึ้นใหม่สำหรับเชื่อมต่อโมเดล AI กับแหล่งข้อมูลภายนอก ทำให้ Deep Research สามารถสอบถามฐานข้อมูลส่วนตัว คลังเอกสารภายใน และบริการข้อมูลจากบุคคลที่สามเฉพาะทางได้อย่างปลอดภัย โดยข้อมูลที่ละเอียดอ่อนไม่ต้องออกจากสภาพแวดล้อมเดิมของมัน

ในทางปฏิบัติ หมายความว่ากองทุนฮีดจ์สามารถกำหนด Deep Research ให้เชื่อมต่อกับฐานข้อมูลการซื้อขายภายในและเครื่องมือข้อมูลทางการเงิน จากนั้นขอให้ตัวแทนรวมข้อมูลเหล่านี้เข้ากับข้อมูลสาธารณะจากอินเทอร์เน็ต เพื่อสรุปข้อมูลเชิงลึกอย่างเป็นองค์รวม

กูเกิลเปิดเผยว่าขณะนี้กำลังร่วมมืออย่างแข็งขันกับบริษัทต่างๆ เช่น FactSet, S&P และ PitchBook เพื่อออกแบบเซิร์ฟเวอร์ MCP ของตน ซึ่งแสดงให้เห็นชัดเจนว่ากูเกิลกำลังมองหาการผสานรวมอย่างลึกซึ้งกับผู้ให้ข้อมูลที่วงการวอลล์สตรีทและอุตสาหกรรมการเงินโดยทั่วไปพึ่งพาในชีวิตประจำวัน

ตามบทความบล็อกของลูกาส ฮาส และศรีนิวาส ทาเดปัลลี ผู้จัดการผลิตภัณฑ์ของ Google DeepMind เป้าหมายคือ “ทำให้ลูกค้าร่วมสามารถรวมผลิตภัณฑ์ข้อมูลทางการเงินเข้ากับกระบวนการทำงานที่ขับเคลื่อนโดย Deep Research และบรรลุการเพิ่มประสิทธิภาพอย่างก้าวกระโดด โดยการใช้จักรวาลข้อมูลขนาดใหญ่ของมันเพื่อรวบรวมบริบทด้วยความเร็วเหมือนสายฟ้า”

ฟีเจอร์นี้ช่วยแก้ไขจุดที่ท้าทายที่สุดอย่างหนึ่งในการนำ AI ไปใช้ในองค์กร: ช่องว่างขนาดใหญ่ระหว่างข้อมูลที่โมเดลสามารถหาได้บนอินเทอร์เน็ตเปิด กับข้อมูลที่องค์กรต้องการสำหรับการตัดสินใจจริง ก่อนหน้านี้ การปิดช่องว่างนี้ต้องใช้งานวิศวกรรมที่ปรับแต่งเป็นพิเศษจำนวนมาก

ในขณะเดียวกัน MCP รองรับการผสานรวมความสามารถในการท่องเว็บและเหตุผลอัตโนมัติของ Deep Research ทำให้ความซับซ้อนส่วนใหญ่สามารถลดลงเหลือเพียงการตั้งค่าครั้งเดียว นักพัฒนาสามารถให้ Deep Research ใช้งานพร้อมกันได้กับ Google Search, เซิร์ฟเวอร์ MCP ระยะไกล, URL Context, การดำเนินการโค้ด และการค้นหาไฟล์ — หรือปิดการเข้าถึงอินเทอร์เน็ตทั้งหมดและทำการค้นหาเฉพาะบนข้อมูลที่กำหนดเอง

ระบบยังรองรับการป้อนข้อมูลแบบหลายรูปแบบ รวมถึง PDF, CSV, รูปภาพ, เสียง และวิดีโอ 作为 grounding (บริบท grounding)

Native charts

ฟีเจอร์สำคัญที่สองคือการสร้างกราฟและอินโฟกราฟิกแบบเนทีฟ

เวอร์ชัน Deep Research ก่อนหน้านี้สามารถสร้างรายงานแบบข้อความล้วนเท่านั้น หากผู้ใช้ต้องการการนำเสนอแบบภาพ ต้องส่งออกข้อมูลและสร้างกราฟด้วยตนเอง ข้อจำกัดนี้ทำให้ตำแหน่งการให้บริการแบบอัตโนมัติแบบครบวงจรอ่อนแอลงอย่างมาก

ตอนนี้ ตัวแทนรุ่นใหม่สามารถฝังกราฟและอินโฟกราฟิกคุณภาพสูงไว้ในรายงานโดยตรง พร้อมเรนเดอร์ข้อมูลชุดซับซ้อนแบบไดนามิกในรูปแบบ HTML หรือ Nano Banana ของ Google ทำให้กราฟเหล่านี้กลายเป็นส่วนหนึ่งของเรื่องราวการวิเคราะห์โดยตรง

สำหรับผู้ใช้งานองค์กร — โดยเฉพาะอย่างยิ่งผู้ที่อยู่ในอุตสาหกรรมการเงินและที่ tư vấnที่ต้องผลิตผลงานที่สามารถส่งมอบได้ทันทีให้กับผู้มีส่วนได้ส่วนเสีย — ฟีเจอร์นี้เปลี่ยน Deep Research จากเครื่องมือที่ “เร่งกระบวนการวิจัย” ให้กลายเป็นเครื่องมือที่สามารถสร้างผลลัพธ์การวิเคราะห์ที่ใกล้เคียงกับผลิตภัณฑ์สุดท้าย

นอกจากนี้ ด้วยการรวมฟีเจอร์การวางแผนแบบร่วมมือใหม่ (ซึ่งอนุญาตให้ผู้ใช้ทบทวน แนะนำ และปรับปรุงแผนการวิจัยของตัวแทนก่อนดำเนินการ) พร้อมกับการส่งออกแบบสตรีมแบบเรียลไทม์ของขั้นตอนการให้เหตุผลระหว่างกลาง ระบบใหม่นี้ช่วยให้นักพัฒนาสามารถควบคุมขอบเขตการสำรวจอย่างละเอียด ขณะเดียวกันก็รักษาความโปร่งใสในระดับสูงที่อุตสาหกรรมการกำกับดูแลต้องการ

Deep Research กำลังกลายเป็นส่วนหนึ่งของ "โครงสร้างพื้นฐาน" ที่ Google ให้แก่ธุรกิจ

บทความบนบล็อกอย่างเป็นทางการของกูเกิลระบุชัดเจนว่า เมื่อผู้พัฒนาใช้ตัวแทน Deep Research ในการสร้าง พวกเขาจะเรียกใช้โครงสร้างพื้นฐานการวิจัยอัตโนมัติเดียวกันที่ให้ความสามารถในการวิจัยแก่ผลิตภัณฑ์ยอดนิยมหลายตัวของกูเกิล เช่น Gemini App, NotebookLM, Google Search และ Google Finance ซึ่งแสดงให้เห็นว่าตัวแทนที่ให้บริการผ่าน API ไม่ใช่เวอร์ชันภายในของกูเกิลที่ถูกลดทอน แต่เป็นระบบเดียวกันที่ให้บริการในระดับแพลตฟอร์ม

กระบวนการวิวัฒนาการนี้ดำเนินไปอย่างรวดเร็วมาก

Google ได้เปิดตัว Deep Research ครั้งแรกในแอป Gemini ในเดือนธันวาคม 2024 เป็นฟีเจอร์สำหรับผู้ใช้ปลายทาง โดยขับเคลื่อนด้วย Gemini 1.5 Pro Google อธิบายว่าเป็นผู้ช่วยวิจัย AI ส่วนตัวที่สามารถสรุปข้อมูลจากอินเทอร์เน็ตภายในไม่กี่นาที ช่วยให้ผู้ใช้ประหยัดเวลาทำงานหลายชั่วโมง

ในเดือนมีนาคม 2025 谷歌ได้ปรับปรุง Deep Research ด้วย Gemini 2.0 Flash Thinking Experimental และเปิดให้ผู้ใช้ทั่วไปทดลองใช้ ต่อมาได้อัปเกรดเป็น Gemini 2.5 Pro Experimental โดย谷歌รายงานว่าผู้ประเมินมีความชอบรายงานจากเครื่องมือนี้มากกว่าคู่แข่งถึง 2 ต่อ 1

เดือนธันวาคม 2025 เป็นจุดเปลี่ยนที่สำคัญ โดย谷歌ได้เปิดตัว Interactions API ซึ่งให้บริการ Deep Research ผ่านทางโปรแกรมเป็นครั้งแรก ขับเคลื่อนโดย Gemini 3 Pro และได้เปิดตัว benchmark DeepSearchQA แบบโอเพ่นซอร์สพร้อมกัน

โมเดลพื้นฐานที่ขับเคลื่อนการปรับปรุงครั้งนี้คือ Gemini 3.1 Pro ซึ่งเปิดตัวเมื่อวันที่ 19 กุมภาพันธ์ 2026 โมเดลนี้มีความก้าวหน้าอย่างมากในความสามารถในการให้เหตุผลพื้นฐาน: ในการทดสอบ ARC-AGI-2 ซึ่งประเมินความสามารถของโมเดลในการแก้รูปแบบตรรกะใหม่ๆ Gemini 3.1 Pro ได้คะแนน 77.1% ซึ่งมากกว่า Gemini 3 Pro มากกว่าสองเท่า