สามสิบวันอันวุ่นวายนี้ โมเดลขนาดใหญ่สิบเอ็ดตัว เหมือนกับการแสดงพลุที่วุ่นวาย

ผู้เขียนบทความ แหล่งที่มา: 0x9999in1, ME News

สรุปสั้น

- สามสิบวันแห่งการแข่งขันอย่างสุดขีด: ระหว่างวันที่ 26 มีนาคม ถึง 24 เมษายน มีการเปิดตัวโมเดลขนาดใหญ่สำคัญ 11 รุ่นทั่วโลก โดยเฉลี่ยหนึ่งรุ่นทุก 2.7 วัน ตลาดเผชิญกับภาวะ “ความเหนื่อยล้าจากพารามิเตอร์” อย่างรุนแรง

- การผ่าตัดลดน้ำหนักของพารามิเตอร์ขนาดใหญ่: รวมพารามิเตอร์ของ V4-Pro อยู่ที่ 1.6T แต่เปิดใช้งานเพียง 49B ผ่านการปรับโครงสร้าง CSA+HCA ลด FLOPs เหลือ 27% และ KV cache ลดลงเหลือเพียง 10% ซึ่งน่าประทับใจมาก

- การแยกช่องว่างทางเทคโนโลยีของอัลเคมี: สร้างรูปแบบการฝึกหลังการเรียนรู้แบบแรกของโลก “เรียนรู้แบบอิสระก่อน แล้วค่อยรวมผ่านการกลั่นออนไลน์” V4-Pro-Max ใกล้เคียงกับขีดจำกัดของระบบปิดในงานการให้เหตุผลและงานตัวแทน

- เสียงโหวตที่มีมูลค่าจริง: GPT-5.5 ทำให้ NVIDIA เพิ่มขึ้นเพียง 4.2% ในหนึ่งวันก่อนแตะจุดสูงสุด ขณะที่ V4 ซึ่งเปิดซอร์สโค้ดอย่างสมบูรณ์จาก MIT ได้จุดประกายการเติบโตอย่างต่อเนื่องของโซ่พลังการคำนวณในท้องถิ่นของจีนและฮ่องกง

- ตรรกะการแข่งขันระดับลึก: โมเดลปิดแหล่งที่มาขาย “ภาษี” ขณะที่โมเดลขนาดใหญ่เปิดแหล่งที่มาขาย “เหล็ก” การปรากฏตัวของ V4 ทำให้สมุดบัญชีพลังการประมวลผลสำหรับการปรับใช้แบบส่วนตัวระดับองค์กรทั่วโลกสามารถคำนวณให้สมดุลได้ในที่สุด

เดือนเมษายนแห่งความตื่นเต้นของเหล่าเทพเจ้า พร้อมกับความเหนื่อยล้าทางการตลาด

发疯了。全都发疯了。

หากคุณเป็นผู้สังเกตการณ์ที่จับตาดูเส้นทาง AI สามสิบวันที่ผ่านมาคงทำให้คุณรู้สึกไม่สบายตัวอย่างแน่นอน ระหว่างวันที่ 26 มีนาคม 2026 ถึง 24 เมษายน ภายในเวลาไม่ถึงหนึ่งเดือน โมเดลขนาดใหญ่ที่มีอิทธิพลอย่างมีนัยสำคัญอย่างน้อย 11 ตัวได้เข้าสู่ตลาด

รายชื่อที่ดูเหมือนกำลังอ่านเมนูอาหาร: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, 月之暗面 Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

นอกจากนี้ ในช่วงเช้ามืดวันที่ 23 เมษายน ได้มีการเปิดตัว DeepSeek V4 อย่างเงียบๆ เหมือนระเบิดใต้น้ำ

โดยเฉลี่ยแล้ว จะมีโมเดลใหม่ออกมาทุกๆ 2.7 วัน ซึ่งเร็วจนกองทุนการลงทุนยังอ่านประกาศไม่ทัน นักลงทุนเพิ่งได้ยินเรื่อง “พารามิเตอร์เหนือกว่า” ของบริษัท A ก็พบว่า “คะแนนทดสอบ” ของบริษัท B ได้ถูกส่งมาถึงโต๊ะแล้ว ตลาดแทบจะชินชากับสิ่งนี้ไปแล้ว การ “แข่งขันบน Benchmark” ที่กล่าวถึงในปัจจุบันที่มีการแข่งขันสูงมาก กลับดูเหมือนเป็นเกมตัวเลขที่เล่นเพื่อความบันเทิงของตัวเอง

แต่เงินฉลาดเสมอ หรือพูดอีกอย่างหนึ่ง คันเดิลสติกไม่เคยพูดโกหก

การวิเคราะห์กราฟเทียนของสินทรัพย์ AI ของจีน สหรัฐอเมริกา และฮ่องกงในช่วง 30 วันที่ผ่านมา จะพบความจริงที่โหดร้ายอย่างยิ่ง: ในสงครามแห่งเทพเจ้าครั้งนี้ มีเพียงสองจุดที่สามารถทิ้งร่องรอยอย่างต่อเนื่องไว้บนกราฟเท่านั้น

อันดับแรก เมื่อวันที่ 8 เมษายน โอเพนเอไอจากฝั่ง大洋彼岸เปิดตัว GPT-5.5 ผู้ครองราชย์ที่ไม่มีข้อโต้แย้ง ซึ่งผลักดันให้นิวเดียเพิ่มขึ้น 4.2% ในวันเดียว จากนั้น? ก็ไม่มีอะไรต่อไปแล้ว ยอดสูงสุดในวันเดียว ข่าวดีถูกปลดปล่อยหมดแล้ว ทุกคนตระหนักว่า แม้จะเป็นกษัตริย์ปิดแหล่งที่ยิ่งใหญ่เพียงใด ก็ยากที่จะเคลื่อนไหวภูเขาแห่งทุนโลกให้เคลื่อนไหวได้ง่ายเหมือนสองปีก่อน

โหนดที่สองคือวันที่ 23-24 เมษายน การเปิดตัวรุ่นตัวอย่าง DeepSeek V4 ไม่มีงานเปิดตัวที่หรูหรา ไม่มีวิดีโอโปรโมตที่น่าตื่นเต้น น้ำหนักโมเดลถูกอัปโหลดโดยตรงไปยัง Hugging Face และ ModelScope ภายใต้ใบอนุญาต MIT

ผลลัพธ์? มันช่วยผลักดันโซ่พลังการคำนวณของจีนและฮ่องกงให้พุ่งขึ้นต่อเนื่อง

ทำไมสิ่งที่ผู้เชี่ยวชาญหลายรายที่ใช้รหัสปิดไม่สามารถทำได้ กลับถูกโมเดลโอเพนซอร์สทำสำเร็จ?

เพื่อตอบคำถามนี้ เราต้องทำตัวเหมือนผู้เล่าเรื่อง ทิ้งเอกสารประชาสัมพันธ์ที่น่าเบื่อไป แล้วเปิดฝาเครื่องของ DeepSeek V4 เพื่อดูว่าข้างในมีสิ่งมีชีวิตอะไรซ่อนอยู่

การวิเคราะห์ V4: ไม่ต้องเชื่อถือความงามแบบใช้กำลังของพารามิเตอร์อีกต่อไป

โมเดลขนาดใหญ่ ใช้เงินมากมาก ทุกคนรู้เรื่องนี้

ในปีที่ผ่านมา ผู้ผลิตโมเดลขนาดใหญ่ได้ตกอยู่ในภาวะ “ความกลัวว่าพลังไม่เพียงพอ” คุณทำหนึ่งล้านล้าน ผมก็ทำสองล้านล้าน ทุกคนคิดว่า只要แรงมาก หินก็บินได้ ปัญญาที่เกิดขึ้นจะสามารถแก้ไขทุกอย่างได้ แต่สิ่งที่ตามมาคือต้นทุนการประมวลผลที่น่ากลัวมาก แม้แต่ข้าวเหลือของเจ้าของที่ดินก็ไม่พอใช้

DeepSeek V4 ได้เปิดตัวโมเดล MoE (Mixed Experts) สองรุ่น: V4-Pro และ V4-Flash มาดูข้อมูลหลักบางชุดกันก่อน

V4-Pro: พารามิเตอร์ทั้งหมด 1.6T (1.6 ล้านล้าน) แต่พารามิเตอร์ที่เปิดใช้งานต่อโทเค็นมีเพียง 49B (49,000 ล้าน)

V4-Flash: พารามิเตอร์ทั้งหมด 284B (284,000 ล้าน) พารามิเตอร์ที่เปิดใช้งานเพียง 13B (13,000 ล้าน)

เข้าใจแล้วใช่ไหม? นี่คือการใช้พลังน้อยแต่ได้ผลมากอย่างยิ่งยวด แก่นแท้ของสถาปัตยกรรม MoE คือไม่ต้องเปิดสัญญาณเตือนทั้งหมดทุกครั้ง เมื่อเจอภารกิจฆ่าไก่ ก็ระดมผู้เชี่ยวชาญฆ่าไก่ไม่กี่คน; เมื่อเจอภารกิจสังหารมังกร ค่อยเรียกดาบสังหารมังกรออกมา ฐานรากขนาด 1.6 ล้านล้านช่วยรับประกันว่ามัน “เคยผ่านโลกมาแล้ว มีความรู้กว้างขวาง” ส่วนการเปิดใช้งานขนาด 490 พันล้านช่วยรับประกันว่ามัน “ตอบสนองเร็ว คล่องตัว”

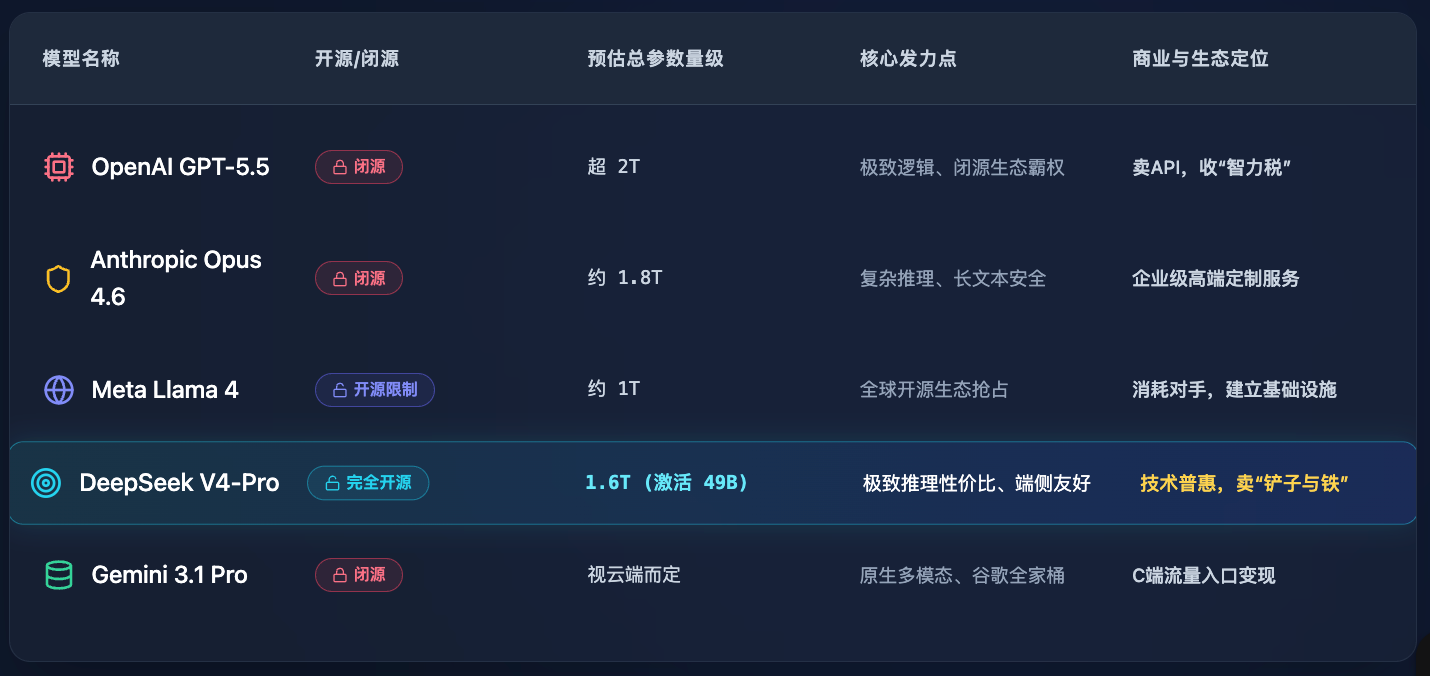

เพื่อดูความแตกต่างนี้อย่างชัดเจนยิ่งขึ้น เราจึงจัดตารางเปรียบเทียบเส้นทางหลักๆ ที่ได้รับความนิยมในตลาดปัจจุบัน (ข้อมูลเป็นการประมาณการและคำนวณจากข้อมูลสาธารณะของตลาด):

จากตารางจะเห็นได้ว่า V4-Pro ไม่ได้พยายามยึดติดกับการเอาชนะ GPT-5.5 ในแง่พารามิเตอร์ทั้งหมด แต่กลับมุ่งความพยายามไปที่ “วิธีทำให้เจ้าสิ่งมหึมนี้กินน้อยลงและวิ่งเร็วขึ้น”

แต่นั่นยังไม่พอ สิ่งที่ทำให้ผู้เชี่ยวชาญต้องอึ้งคือการกำจัดอย่างไม่ยั้งมือต่อ “นักล่าหน่วยความจำกราฟิก”

วันสิ้นสุดของ刺客หน่วยความจำแสดง: มีดสามเล่มที่ตัดกระดูกตามสถาปัตยกรรม

อะไรคือ “显存刺客”؟ นั่นคือ “บริบทยาว (Long Context)”

ตอนนี้ทุกค่ายต่างอ้างว่ารองรับบริบท 1 ล้านโทเค็น ฟังดูยอดเยี่ยม สามารถใส่หนังสือ “สามก๊ก” ทั้งเล่มลงไปและมันจะอ่านจบภายในไม่กี่วินาที แต่ค่าใช้จ่ายล่ะ? การประมวลผลข้อความยาวจะสร้าง KV cache ขนาดใหญ่มหาศาล (การใช้หน่วยความจำ GPU เพื่อเก็บข้อมูลประวัติขณะประมวลผล) เหมือนกับว่าคุณต้องเขียนเนื้อหาหน้าก่อนหน้าลงบนกระดานดำขนาดใหญ่ทุกครั้งที่อ่านหน้าใหม่ เมื่อคุณอ่านถึงล้านตัวอักษร กระดานดำจะมีจำนวนมากจนแม้แต่ศูนย์ข้อมูลในจงเฉียนเหยียนก็ไม่สามารถจุได้

หน่วยความจำ แพงกว่าพลังการคำนวณ นี่คือกฎที่ไม่ได้ระบุไว้ในอุตสาหกรรม AI

DeepSeek V4 แก้ปัญหานี้อย่างไร? พวกเขาทำการผ่าตัดโดยตรงที่กลไกการให้ความสำคัญพื้นฐาน นี่คือเครื่องมือแรกและรุนแรงที่สุดในการอัปเกรดสถาปัตยกรรมของพวกเขา: กลไกการให้ความสำคัญแบบผสม (CSA + HCA)

CSA (Compressed Sparse Attention) บวกกับ HCA (Heavy Compressed Attention) ฟังดูเหมือนภาษาจากดาวอังคาร แต่แปลเป็นภาษาธรรมดาคือ: มันไม่ได้ท่องจำแบบเครื่องจักรอีกต่อไป แต่เรียนรู้ที่จะ “เน้นจุดสำคัญ” และ “จดโน้ตแบบเรียบง่ายสุด”

ผลลัพธ์นั้นรุนแรงมาก: ในบริบท 1M ค่า FLOPs (จำนวนการคำนวณจุดลอยตัว) สำหรับการประมวลผลแบบ token เดียวของ V4-Pro ลดลงเหลือเพียง 27% เทียบกับรุ่นก่อนหน้า V3.2! ยิ่งไปกว่านั้น แคช KV ยังลดลงเหลือเพียง 10% ของ V3.2!

นี่คือแนวคิดอะไรกันแน่? งานที่ก่อนหน้านี้ต้องใช้เซิร์ฟเวอร์ระดับท็อป 10 เครื่องเพื่อประมวลผลข้อความยาวล้านตัวอักษร ตอนนี้แค่ใช้เซิร์ฟเวอร์ 1 เครื่องก็ทำได้อย่างสบายๆ ต้นทุนการประมวลผลลดลงเหลือเพียงหนึ่งในสิบ นี่คือการปรับปรุงแบบเปลี่ยนเกม

ยังมีมีดอีกสองใบ

มีดใบที่สองเรียกว่า “การเชื่อมต่อข้ามชั้นด้วยข้อจำกัดแมนิโฟลด์ (mHC)” โมเดลขนาดใหญ่ในอดีตใช้ “การเชื่อมต่อแบบรีซิดูอัลแบบดั้งเดิม” ในการส่งผ่านข้อมูลระหว่างชั้น คล้ายกับการใช้ท่อเหล็กเก่าที่เป็นสนิมส่งน้ำ เมื่อแรงดันน้ำสูงขึ้นก็มักจะรั่วไหล เมื่อเผชิญกับข้อมูลการฝึกล่วงหน้าขนาดมหาศาล 32T token ท่อเก่าๆ นี้รับไม่ไหว mHC จึงเหมือนการเปลี่ยนเป็นเครือข่ายไฟเบอร์ออปติก ซึ่งเพิ่มความมั่นคงในการส่งสัญญาณข้ามชั้น ไม่มีข้อมูลสูญหาย ไม่เบี่ยงเบน

มีดเล่มที่สาม: เปลี่ยนน้ำมันเครื่องยนต์ ทิ้งวิธีดั้งเดิมและใช้ตัวปรับ Muon แทน ตัวนี้ช่วยเร่งการรวมตัว ขณะที่คนอื่นต้องใช้เวลาสี่สิบเก้าวันเพื่อหลอมยาหนึ่งหม้อ มันอาจเสร็จภายในยี่สิบวัน เวลาคือเงิน ช่วงเวลาการประมวลผลคือดอลลาร์

การตัดสามครั้งนี้ ทำให้ V4 รักษาโรคของโมเดลขนาดใหญ่ได้หายขาด

ความลับในเตาเผาไถ่: จากการต่อสู้คนละทางสู่การรวมเป็นหนึ่งเดียว

ในอุตสาหกรรมโมเดลขนาดใหญ่ ทุกคนรู้ดีว่าการฝึกล่วงหน้าแค่เปลี่ยนคนที่ไม่รู้หนังสือให้กลายเป็นคนที่รู้เรื่องมากมายแต่พูดไม่เป็น แต่สิ่งที่ทำให้มันกลายเป็นผู้เชี่ยวชาญระดับยอดเยี่ยมจริงๆ คือการฝึกหลังการฝึกล่วงหน้า (Post-training)

DeepSeek V4 ในการฝึกอบรมเพิ่มเติม ได้ใช้กลยุทธ์ “สองขั้นตอน” ที่เข้มข้นมาก

ในอดีต การฝึก MoE คล้ายกับครูหลายคนล้อมรอบนักเรียนคนเดียวเพื่อสอน ซึ่งมักเกิดความขัดแย้งกัน แล้ว V4 ทำอย่างไร?

ระยะที่หนึ่ง: “ต่างคนต่างทำ” มันใช้ SFT (การปรับแต่งแบบมีผู้ควบคุม) และ GRPO (การเพิ่มประสิทธิภาพเชิงกลยุทธ์แบบเป็นกลุ่มสัมพัทธ์) เพื่อฝึกโมเดลแต่ละ “เครือข่ายผู้เชี่ยวชาญ” แยกกันอย่างอิสระ ผู้เชี่ยวชาญด้านการเขียนโค้ดจะฝึกเขียนโค้ดทุกวัน ส่วนผู้เชี่ยวชาญด้านคณิตศาสตร์จะทุ่มเทแก้โจทย์คณิตศาสตร์ทุกวัน ไม่เกี่ยวข้องกันและไม่รบกวนกัน นี่คือการดึงศักยภาพแต่ละจุดให้สูงสุด

ขั้นที่สอง: “ทุกสรรพสิ่งกลับคืนสู่รากเดียว” ผ่านเทคนิคการกลั่นออนไลน์ ผู้เชี่ยวชาญที่ฝึกฝนวิชามาอย่างยอดเยี่ยมเหล่านี้จะถูกรวมเข้าด้วยกันเป็นโมเดลเดียวที่สมบูรณ์แบบ ไม่มีการสูญเสียพลังงานภายใน ไม่มีการค้าง

มาดูสองเทคนิคหลักที่พวกเขาบังคับให้ออกมา

หนึ่งคือโหมด V4-Pro-Max ซึ่งเป็นโหมดที่มีพลังการประมวลผลสูงสุด คล้ายกับการปลดล็อกกุญแจทางพันธุกรรม ตามที่พวกเขาอ้าง (และได้รับการยืนยันโดยชุมชนอย่างรวดเร็ว) ในแบบทดสอบการเขียนโค้ด V4-Pro ได้บรรลุระดับชั้นนำแล้ว และในงานที่ซับซ้อนเกี่ยวกับการให้เหตุผลและ Agent (ตัวแทนอัจฉริยะ) ช่องว่างเมื่อเทียบกับโมเดลปิดที่ทันสมัย เช่น GPT-5.5, Opus 4.6 ได้ลดลงอย่างมีนัยสำคัญ

ที่สองคือ V4-Flash-Max ซึ่งน่าสนใจยิ่งกว่า มันเป็นโมเดลขนาดเล็กเพียง 284B แต่เมื่อให้เวลาในการคิดเพียงพอ ประสิทธิภาพในการให้เหตุผลกลับใกล้เคียงกับ Pro สิ่งนี้แสดงให้เห็นว่า “คุณภาพของอัลกอริทึม” เริ่มเอาชนะ “ขนาดพารามิเตอร์” ได้แล้ว ตราบใดที่คุณให้เวลาเพียงพอ มันก็สามารถแก้ปัญหาใหญ่ได้ แม้สมองจะเล็ก อย่างไรก็ตาม ในเรื่องของปริมาณความรู้โดยตรงและงาน Agent ขั้นสูงที่ซับซ้อนมากหลายขั้นตอน มันยังคงถูกจำกัดโดยขนาดพารามิเตอร์ (เพราะ “ท้อง” มันมีขนาดจำกัด) แต่สำหรับการใช้งานรายวันในระดับองค์กรส่วนใหญ่ ประสิทธิภาพนี้ถือว่าเกินความต้องการแล้ว

สุดท้าย การจัดเก็บน้ำหนักใช้การจัดเก็บความแม่นยำผสม FP4+FP8 อย่างชาญฉลาด รักษาความแม่นยำไว้ได้的同时 ยังช่วยประหยัดหน่วยความจำ GPU ทุกจุดล้วนสื่อถึงความน่าดึงดูดของนักวิทยาศาสตร์ที่รู้จักประหยัด

เพื่อเปรียบเทียบอย่างชัดเจนยิ่งขึ้นถึงการเพิ่มประสิทธิภาพทางวิศวกรรมที่เกิดจากการฝึกอบรมหลังจากนั้น เราจะจัดตารางเปรียบเทียบตัวชี้วัดที่เข้มข้นอีกหนึ่งตาราง:

กลิ่นของทุน: ทำไม V4 จึงจุดประกายโซ่พลังการคำนวณของจีนและฮ่องกง?

พูดมาถึงตรงนี้ การวิเคราะห์ด้านเทคนิคก็ใกล้จบแล้ว แต่เรายังไม่ได้ตอบคำถามสำคัญที่ตั้งไว้ตอนต้น:

ทำไม GPT-5.5 จึงไม่สามารถทำให้ภาคพลังการคำนวณครองตลาดอย่างต่อเนื่อง ขณะที่ DeepSeek V4 ทำได้?

สิ่งนี้ต้องการให้เราออกจากโค้ด และมองการแข่งขันนี้ด้วยมุมมองของทุนและธุรกิจ

GPT-5.5 แข็งแกร่งมาก แข็งแกร่งจนไม่มีใครสามารถเอาชนะได้ แต่มันเป็นแบบปิดแหล่งที่มา ความหมายของปิดแหล่งที่มาคืออะไร? หมายความว่า OpenAI เป็น “หลุมดำ” ขนาดใหญ่ หากคุณต้องการใช้ความสามารถของมัน คุณต้องซื้อ API ของมัน นี่คือรูปแบบการ “เรียกเก็บภาษี” กำไรไหลไปยังซิลิคอนแวลลีย์ และความต้องการหน่วยประมวลผลกระจุกตัวอยู่ที่ศูนย์ข้อมูลบนคลาวด์ของไมโครซอฟต์ สำหรับผู้ผลิตฮาร์ดแวร์ทั่วโลก ศูนย์ประมวลผลท้องถิ่น และตัวแทนเซิร์ฟเวอร์ของแต่ละประเทศ พวกเขาแทบไม่ได้รับส่วนแบ่งใดๆ นอกจากการมองขึ้นไปบนฟ้า GPT-5.5 จะแข็งแกร่งแค่ไหน มันก็ยังเป็นงานเฉลิมฉลองของผู้อื่น NVIDIA ปรับตัวสูงขึ้น เพราะทุกคนคิดว่า OpenAI จะต้องซื้อการ์ดเพิ่มอีก

แต่ DeepSeek V4 ไม่เหมือนกัน

มันเป็นโอเพ่นซอร์ส และได้รับใบอนุญาต MIT อย่างสมบูรณ์แบบ MIT License เป็นการบริจาคที่เอื้อเฟื้อที่สุดในโลกโอเพ่นซอร์ส หมายความว่าบริษัทเชิงพาณิชย์สามารถนำไปใช้ แก้ไข และขายได้ฟรี โดยไม่ต้องกังวลเรื่องความเสี่ยงทางกฎหมาย

ร้ายกว่านั้น เราได้ใช้เนื้อหาจำนวนมากในการโต้แย้งว่า: V4 ลดต้นทุนการประมวลผลของโมเดลและการใช้งานหน่วยความจำกราฟิกลงจนเหลือเพียงข้อเท้า

เมื่อรวมสองจุดนี้เข้าด้วยกัน คุณจะได้ข้อสรุปที่ทำให้ตลาดทุนตื่นเต้นอย่างสุดขีด: จุดวิกฤตของการปรับใช้แบบเอกชนได้มาถึงแล้ว

ในอดีต บริษัทที่ต้องการปรับใช้โมเดลขนาดใหญ่กว่า 1T เอง เมื่อเห็นตารางราคาฮาร์ดแวร์ ก็จะปิดเอกสารลงอย่างเงียบๆ และหันไปซื้อ API แทน แต่ตอนนี้ V4 บอกกับทุกคนว่า: คุณแค่ต้องการเครื่องจำนวนน้อยๆ ก็สามารถรันสมองยักษ์ที่ใกล้เคียงกับ GPT-4 หรือแม้แต่ท้าทายระดับ GPT-5.5 ได้ที่โลเคชันของคุณเอง ข้อมูลไม่ต้องออกจังหวัด ไม่ต้องออกประเทศ ปลอดภัยอย่างสมบูรณ์

เมื่อทุกคนสามารถรันได้ในท้องถิ่นแล้ว ต่อไปจะเกิดอะไรขึ้น?

ซื้อเครื่อง! ซื้อเซิร์ฟเวอร์! ซื้อโมดูลแสง! สร้างศูนย์คอมพิวเตอร์อัจฉริยะ!

บริษัทปิดซอร์สขายความรู้ทางปัญญา ในขณะที่บริษัทเปิดซอร์สโดยพื้นฐานแล้วกำลังช่วยขายสินค้าให้กับผู้ผลิตฮาร์ดแวร์ทั้งอุตสาหกรรม DeepSeek V4 คือผู้ที่จุดประกายไฟนั้น ยิ่งมันใช้งานง่ายและเปิดซอร์สมากเท่าใด ความต้องการพลังการประมวลผลแบบท้องถิ่นในจีน ฮ่องกง และไต้หวันก็ยิ่งพุ่งสูงขึ้นอย่างระเบิด บริษัทที่ทำธุรกิจประกอบเซิร์ฟเวอร์ ระบบระบายความร้อนด้วยของเหลว และการดูแลรักษาศูนย์ข้อมูล ต่างก็เริ่มเห็นรายได้จริงจากการนำไปใช้งานในระดับใหญ่

นี่คือเหตุผลที่โซ่พลังการคำนวณของจีนและฮ่องกงพุ่งขึ้นต่อเนื่องทันทีที่ V4 เปิดตัวในวันที่ 23 เมษายน ทุนไม่ได้จ่ายเพื่อความรู้สึก แต่ทุนกำลังเตรียมตำแหน่งล่วงหน้าสำหรับ “คลื่นการปรับใช้แบบส่วนตัวในอุตสาหกรรมนับพันและธุรกิจนับร้อย” ที่กำลังจะมาถึง

นี่คือกลยุทธ์ทางธุรกิจที่ซ่อนอยู่เบื้องหลัง

ข้อสรุป: น้ำลงและหิน

สามสิบวันอันวุ่นวายนี้ โมเดลขนาดใหญ่สิบเอ็ดตัว เหมือนกับการแสดงพลุที่วุ่นวาย

ผู้ยิ่งใหญ่ต่าง挥ใช้เงินทุนบนเวทีพารามิเตอร์ พยายามใช้กำลังการคำนวณเป็นหมัดหนักถล่มคู่แข่ง แต่หลังจากเสียงวุ่นวายเงียบลง ผู้ที่ยังคงอยู่และเปลี่ยนแปลงภูมิทัศน์ของอุตสาหกรรม มักไม่ใช่ผู้ที่ดังที่สุด

การปรากฏตัวของ DeepSeek V4 เหมือนนักลอบสังหารที่เยือกเย็น มันไม่ได้แข่งกับคุณว่าใครใช้เงินมากกว่า มันแค่โจมตีจุดอ่อนที่เจ็บที่สุด: ตัดหน่วยความจำ GPU ที่ไม่จำเป็นออก ลดอุปสรรคในการปรับใช้ และเปลี่ยนเกมระดับสูงให้กลายเป็นเกมสำหรับทุกคน

ในสงคราม AI ที่เรียกว่า "รัตนาคีรี" ยุคของการสะสมพารามิเตอร์อย่างไม่เลือกกำลังจะสิ้นสุดลงอย่างรวดเร็ว สนามรบในอนาคตจะเป็นของผู้ที่สามารถหาจุดสมดุลที่ยอดเยี่ยมระหว่าง "ประสิทธิภาพสูงสุด" กับ "ประสิทธิภาพทางวิศวกรรม"

ลมพายุจะถอยกลับเสมอ เมื่อคลื่นถอยออก คุณจะรู้ว่าใครกำลังว่ายน้ำเปลือย และใครคือหินที่ไม่อาจพังทลาย

V4 ได้ส่งอาวุธไปถึงทุกคนแล้ว ตอนนี้ ขึ้นอยู่กับแต่ละผู้นำว่าจะตั้งค่ายบนดินแดนใหม่นี้อย่างไร

เมื่อคุณเข้าใจชั้นนี้แล้ว คุณอาจฟังเสียงรบกวนที่พูดถึงการเปิดตัวที่น่าตื่นเต้นหรือการกำหนดนิยามใหม่ ด้วยความสงบมากขึ้น และกังวลน้อยลง

ท้ายที่สุด ไม่ว่าเวทมนตร์จะงดงามเพียงใด สุดท้ายก็ต้องลงมาอยู่บนสมุดบัญชี และคำนวณให้สมดุลกับเงินเล็กๆ ไม่กี่เหรียญ

อ้างอิงจาก:

- คำแนะนำชุด DeepSeek V4 การเปิดตัวอย่างเป็นทางการ, ทีม DeepSeek, GitHub/ModelScope/HuggingFace. (2026).

- การระเบิดของ AI ในเดือนเมษายน: การวิเคราะห์วัฏจักรโมเดลขนาดใหญ่ 30 วัน, ME News Market Observer. (2026).

- กฎหมายการขยายขนาดและการเปลี่ยนผ่านสู่รูปแบบหลังการฝึกอบรม, วารสารเศรษฐศาสตร์ปัญญาประดิษฐ์. (2026).

- รายงานสถานะตลาดห่วงโซ่อุปทานการคำนวณระดับโลก (เมษายน 2026), การวิเคราะห์ข้อมูลทางการเงินแบบแพน-เอเชีย. (2026).