ขณะที่คนทั่วไปยังคงศึกษา “เวทมนตร์คำสั่งที่ทรงพลังที่สุด” ห้องปฏิบัติการชั้นนำของซิลิคอนแวลลีย์ได้เปลี่ยนโครงสร้างพื้นฐานของ AI ให้กลายเป็นสายการผลิตแล้ว

ผู้เขียนบทความ แหล่งที่มา: ซินจีหยวน

คุณยังคงแก้ไข prompt ซ้ำๆ ในช่องแชทของ ChatGPT อยู่หรือ

เมื่อเร็วๆ นี้ ผู้ใช้ X ได้โพสต์ทวีตที่เริ่มต้นด้วยคำร้องไห้: แม่แบบโครงการ Claude Code ที่บริษัทชั้นนำใช้อย่างลับๆ ถูกเปิดเผย!

นี่ไม่ใช่การเขียนพรอมต์อีกต่อไป นี่คือโครงสร้างพื้นฐานด้านวิศวกรรม AI

กลยุทธ์ทั้งชุดหมุนรอบไฟล์หนึ่งไฟล์ชื่อว่า「CLAUDE.md」และหลักการหลักของมันมีเพียงสามข้อ:

ทุกครั้งที่ Claude ทำผิด → คุณเพิ่มกฎหนึ่งข้อ; ทุกครั้งที่คุณซ้ำตัวเอง → คุณเพิ่มเวิร์กโฟลว์หนึ่งชุด; ทุกครั้งที่เกิดบั๊ก → คุณเพิ่มเกราะป้องกันหนึ่งชั้น

การทำเช่นนี้ มีจุดประสงค์เพื่อสะสมประสบการณ์โครงการให้เป็นบริบทระยะยาวและข้อจำกัดอัตโนมัติที่จะถูกอ่านทุกครั้งที่เริ่มต้น

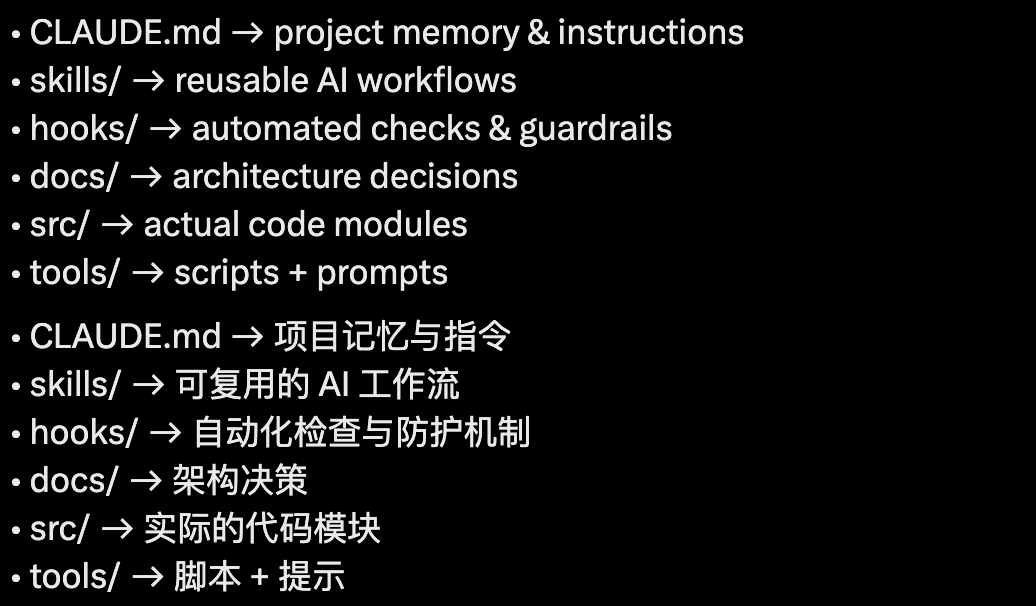

โครงสร้างทั้งหมดเหมือนกับการจัดองค์กรของบริษัท AI: CLAUDE.md เป็นคู่มือการเข้าทำงาน, skills/ เป็นมาตรฐานการปฏิบัติงาน, hooks/ เป็นฝ่ายปฏิบัติตามกฎระเบียบ, docs/ เป็นข้อบังคับของบริษัท, tools/ เป็นฝ่ายสนับสนุน, src/ เป็นแผนกธุรกิจที่ลงมือทำงานจริง

คุณไม่ได้กำลังคุยกับ AI อีกต่อไป แต่กำลังสร้าง AI ที่เข้าใจรีพอสิทอรีโค้ดของคุณ

ส่วนที่บ้าที่สุดคือคุณแค่ตั้งค่าครั้งเดียว Claude จะตรวจสอบโค้ดอัตโนมัติ รีแฟกเตอร์ตามคำสั่ง บังคับใช้กฎสถาปัตยกรรม เขียนเอกสารการเผยแพร่ รันเวิร์กโฟลว์จากทักษะ และจดจำข้อผิดพลาดในอดีต

และมันจะยิ่งฉลาดขึ้นเมื่อใช้งานมากขึ้น

ผู้คนส่วนใหญ่เปิด ChatGPT เขียนคำสั่ง คัดลอกและวางซ้ำๆ แต่ภายใต้วิธีการนี้ คุณแค่เปิดเทอร์มินัลแล้วรันรหัส skill ที่จัดส่งแล้ว

มันเหมือนกับการเลี้ยงทีมเพื่อนร่วมงาน AI ไว้ในคลังโค้ดของตัวเอง

ข้อความทวิตนี้สื่อถึงสัญญาณเล็กๆ ที่ยุคสมัยกำลังค่อยๆ เปลี่ยนผ่าน ซึ่งคนส่วนใหญ่ยังไม่ทันตระหนัก

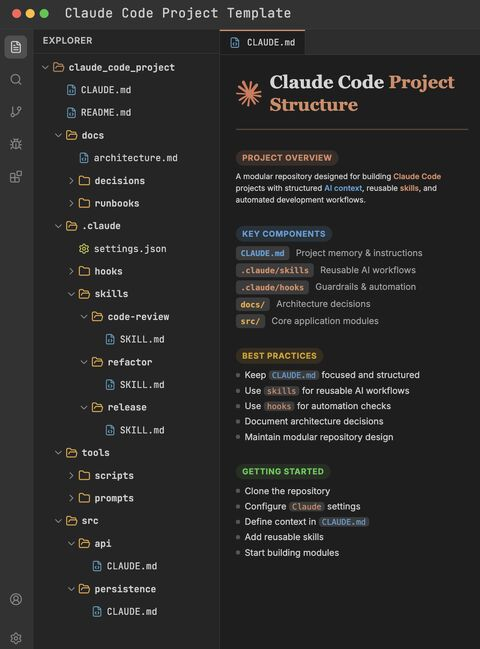

ภาพหน้าจอที่ไม่ถือว่าเป็นการรั่วไหล แต่เปิดเผยความจริง

ภาพหน้าจอที่ @ai_rohitt โพสต์นี้ เป็นรูปแบบมาตรฐานของ Claude Code ที่เอกสารอย่างเป็นทางการของ Anthropic แนะนำอย่างเปิดเผย

CLAUDE.md เป็นไฟล์ความจำโครงการที่ Claude Code จะอ่านอัตโนมัติเมื่อเริ่มการสนทนาแต่ละครั้ง

.claude/skills/ และ .claude/hooks/ เป็นกลไกการขยายที่ได้รับการสนับสนุนอย่างเป็นทางการ

นี่คือแนวทางที่ชุมชนได้หารือกันมาหลายเดือนแล้ว ไม่ใช่ “เทมเพลตภายใน” ที่ใครขโมยมา

แต่สิ่งที่ทำให้นักพัฒนาที่มีประสบการณ์บางคนแชร์อย่างสมัครใจ แสดงว่ามันได้รับการยอมรับจากนักพัฒนาที่ใช้ Claude ทุกวัน

ผู้คนจำนวนมากอาจเพิ่งรู้เมื่อสองวันที่ผ่านมาว่ามันสามารถใช้งานได้เช่นนี้

ทีมชั้นนำจากซิลิคอนแวลลีย์ได้เปลี่ยนเรื่องนี้ให้เป็นสายการผลิตแล้ว

ตัวอย่างแรกคือทีม OpenAI Frontier

ในการทดลองของทีม Frontier ที่ OpenAI เปิดเผยอย่างเป็นทางการ ระบบ beta ภายในที่เริ่มจาก repo ว่างเปล่า ได้รับการสร้างโค้ดประมาณ 1 ล้านบรรทัดและประมาณ 1,500 PR โดย Codex ในระยะเวลาประมาณ 5 เดือน; ทีมขยายจาก 3 คนเป็น 7 คน โดยไม่มีการเขียนโค้ดด้วยมือ

Ryan Lopopolo ผู้นำทีมได้กล่าวเพิ่มเติมในการสัมภาษณ์ครั้งต่อมาว่า ระบบการทำงานนี้ใกล้เคียงกับรูปแบบสุดขีดของ “โค้ดมนุษย์ 0 รายการ การทบทวนด้วยมนุษย์ 0 รายการ”

เขาเชื่อว่าแทนที่จะประหยัดโทเค็น ควรใช้ความสามารถในการประมวลผลแบบขนานสูงมากและต้นทุนต่ำมากของโมเดล เพื่อแทนที่ความสนใจแบบซิงโครไนซ์ที่จำกัดและมีต้นทุนสูงของมนุษย์

ตัวอย่างที่สองคือระบบตัวแทนอัตโนมัติภายใน Stripe ที่ชื่อว่า Minions

Minions ภายใน Stripe สร้างและผลักดันให้มีการรวม PR มากกว่า 1,300 รายการต่อสัปดาห์ ซึ่งโค้ดเหล่านี้ถูกสร้างขึ้นโดย AI ทั้งหมดตั้งแต่ต้นจนจบ แต่ยังผ่านการทบทวนโดยมนุษย์

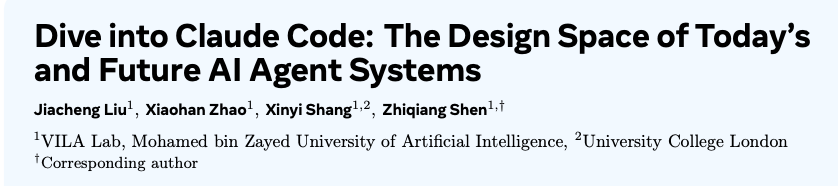

ยังมีข้อมูลอีกคู่หนึ่ง: 1.6% เทียบกับ 98.4% ซึ่งมาจากบทความของ VILA-Lab ที่มหาวิทยาลัย Mohamed bin Zayed for AI

https://arxiv.org/pdf/2604.14228

นักวิจัยได้วิเคราะห์โค้ดต้นฉบับ TypeScript จำนวน 512,000 บรรทัดของ Claude Code เวอร์ชัน 2.1.88 อย่างเป็นระบบ และสรุปว่ามีเพียง 1.6% เท่านั้นที่เป็นตรรกะการตัดสินใจของ AI ส่วนที่เหลืออีก 98.4% เป็นโครงสร้างพื้นฐานด้านวิศวกรรมที่แน่นอน

กล่าวอย่างเฉพาะเจาะจงคือ หมวดหมู่ทั้งสี่ได้แก่ ประตูการอนุญาต การจัดการบริบท การกำหนดเส้นทางเครื่องมือ และการกู้คืนข้อผิดพลาด

ตัวเลขชุดนี้ไม่ได้หมายความว่าโมเดลสามารถมีส่วนร่วมเพียง 1.6% แต่แสดงให้เห็นว่าสำหรับผลิตภัณฑ์ Claude Code ความซับซ้อนส่วนใหญ่ไม่อยู่ที่ตัวโมเดลเอง แต่อยู่ที่โครงสร้างพื้นฐานด้านวิศวกรรมที่แน่นอน เช่น สิทธิ์ การบริบท การจัดเส้นทางเครื่องมือ และกลไกการกู้คืน

โครงสร้าง CLAUDE.md/skills/hooks ในรูปภาพนั้น เป็น “โครงสร้างพื้นฐานรุ่นเริ่มต้น” ที่นักพัฒนาทั่วไปก็สามารถสร้างขึ้นได้ มันมีรูปแบบเดียวกับสถาปัตยกรรมระดับผลิตภัณฑ์ของ OpenAI และ Stripe แต่มีขนาดเล็กกว่ามาก

ความลับที่เปิดเผยใน CLAUDE.md

ในสามปีที่ผ่านมา ทุกคนต่างถามว่า “GPT จะฉลาดขึ้นเมื่อไหร่” “Claude จะออกเวอร์ชันใหม่เมื่อไหร่”

แต่ทีมที่ใช้งานการเขียนโปรแกรมด้วย AI ในสภาพแวดล้อมการผลิตจริง อาจไม่ได้สนใจเรื่องนี้เลย แต่กลับสนใจว่าจะทำให้ AI จำข้อผิดพลาดที่เคยเกิดขึ้นก่อนหน้านี้ได้อย่างไร วิธีที่จะให้ AI ดูข้อจำกัดของโครงสร้างโครงการก่อนเริ่มทำงาน และวิธีที่จะให้เครื่องมือหยุด AI ไว้เมื่อมันเกิดข้อผิดพลาด

CLAUDE.md คือตัวรับผิดชอบทั้งหมดนี้

คำจำกัดความอย่างเป็นทางการจาก Anthropic มีเพียงหนึ่งประโยค:

ไฟล์ markdown ที่วางไว้ที่รากโครงการ โดย Claude Code จะอ่านอัตโนมัติทุกครั้งที่เริ่มเซสชัน

https://code.claude.com/docs/en/memory

ฟังดูเหมือนง่าย แต่โครงสร้างหลายชั้นที่อยู่รอบๆ มันนั่นแหละคือสิ่งที่ทำให้มันยอดเยี่ยมจริงๆ

CLAUDE.md คือสมองของโครงการ

การตัดสินใจด้านสถาปัตยกรรม ข้อตกลงในการตั้งชื่อ ข้อกำหนดการทดสอบ และจุดที่เคยผิดพลาดซ้ำๆ ทั้งหมดถูกเก็บไว้ที่นี่ มันคือ “คู่มือพนักงาน” ที่ AI จะเห็นเป็นอันดับแรกทุกครั้งที่เริ่มทำงาน

.claude/skills/ เป็นงานไหลที่สามารถใช้ซ้ำได้

บอริส เชนรี ผู้สร้าง Claude Code ได้เน้นย้ำคำพูดนี้ซ้ำแล้วซ้ำเล่าในชุมชน: "ถ้าคุณทำสิ่งใดสิ่งหนึ่งมากกว่าหนึ่งครั้งต่อวัน ให้เปลี่ยนมันเป็นทักษะหรือคำสั่ง"

ทักษะหนึ่งคือชุดวิธีการที่สามารถดำเนินการได้ การทบทวนโค้ด การสร้างข้อความ commit และการเขียนคำอธิบายการเผยแพร่ ไม่ควรเป็นงานที่ต้องพิมพ์คำสั่งด้วยมือทุกวัน ควรเป็นงานที่เรียกใช้ทักษะแล้วได้ผลลัพธ์ทันที

.claude/hooks/ เป็นระบบป้องกันอัตโนมัติ

นี่คือส่วนที่สำคัญที่สุด มันไม่ได้พึ่งการตัดสินใจของ AI แต่ใช้โค้ดที่แน่นอนเพื่อขัดขวาง AI ก่อนที่มันจะผิดพลาด นี่คือเหตุผลที่กล้าให้ AI ทำงานโดยไม่มีการดูแล เพราะขอบเขตของข้อผิดพลาดถูกจำกัดโดย hooks

docs/decisions/ เป็นบันทึกการตัดสินใจด้านสถาปัตยกรรม

ทำให้ AI ไม่เพียงแต่รู้ว่าโค้ดคืออะไร แต่ยังรู้ว่าทำไมโค้ดถึงเป็นแบบนี้

จุดนี้มักถูกมองข้ามที่สุด แต่เป็นจุดเปลี่ยนที่ใหญ่ที่สุดของการร่วมมือกับ AI

tools/ และ src/ เป็นชั้นการดำเนินการ

สิ่งที่น่าสังเกตในสถาปัตยกรรมนี้ ไม่ใช่การที่นักพัฒนาคนใดคนหนึ่งสร้างไดเรกทอรีที่สวยงาม แต่คือทีมอิสระจำนวนมากกำลังเข้าสู่ทิศทางเดียวกัน: การนำแบบจำลองไปใส่ไว้ในโครงสร้างที่ประกอบด้วยบริบท เครื่องมือ สิทธิ์ การประเมิน และวงจรป้อนกลับ

บน GitHub สามารถมองเห็นโปรเจกต์ที่คล้ายกันได้หลายโครงการแล้ว:

rohitg00 的 awesome-claude-code-toolkit, diet103 的 claude-code-infrastructure-showcase และ affaan-m 的 everything-claude-code ต่างสร้างสภาพแวดล้อมการพัฒนาแบบวิศวกรรมสำหรับ Claude Code โดยใช้ส่วนประกอบต่างๆ เช่น agents, skills, hooks, rules และ MCP configs

นี่แสดงให้เห็นว่า กระบวนการทำงานด้านการเขียนโปรแกรมด้วย AI ที่สุกงอมจริงๆ ไม่ได้ขึ้นอยู่กับโมเดลที่แข็งแกร่งขึ้นเพียงอย่างเดียว หรือคำสั่งที่ยาวขึ้นเพียงอย่างเดียว แต่คือการผนวกโมเดลเข้ากับระบบวิศวกรรมที่สามารถใช้ซ้ำได้ ควบคุมได้ ฟื้นตัวได้ และตรวจสอบได้

สำหรับโครงสร้างไดเรกทอรีที่แน่นอน การดำเนินการของแต่ละแห่งอาจไม่เหมือนกันทั้งหมด

การทดลองขีดจำกัดของห้องปฏิบัติการ OpenAI

วันที่ 11 กุมภาพันธ์ 2026 บล็อกอย่างเป็นทางการของ OpenAI ได้เผยแพร่บทความเรื่อง: 《Harness engineering: leveraging Codex in an agent-first world》

https://openai.com/index/harness-engineering/

Anthropic ได้ปรับแนวคิดโครงสร้างของ Claude Code รอบแนวคิดนี้; เว็บไซต์ของ Martin Fowler ได้สรุปเป็นสูตรว่า: 「Agent=Model+Harness」

คำว่า "Harness" มาจากการขี่ม้า มันหมายถึงชุดอุปกรณ์ลากม้าทั้งชุด ได้แก่ เข็มขัด牵引 สายบังคับ แสกน และหน้ากากม้า

ม้าตัวหนึ่งสามารถวิ่งได้เร็วและมีพลังมาก แต่มันเองไม่รู้ว่าจะไปทางไหน: อุปกรณ์ลากทั้งชุดต่างหากที่กำหนดทิศทางของมัน

เปรียบเทียบกับการเขียนโปรแกรมด้วย AI: โมเดลมีความสามารถสูงมาก แต่มันไม่รู้ว่าควรไปที่ไหนในคลังโค้ดของคุณ Harness คือพวงมาลัย + เบรก + ระบบนำทางที่คุณสร้างขึ้นให้มัน

การทดลองของทีม OpenAI Frontier ที่ว่า “1 ล้านบรรทัดโดยไม่มีมนุษย์” แก่นแท้คือการขับเคลื่อน Harness ให้ถึงขีดสุด

แนวทางการปฏิบัติทางวิศวกรรมหลักของพวกเขาประกอบด้วยข้อต่อไปนี้

โครงสร้างชั้นที่มีข้อจำกัดเข้มงวด

ตั้งแต่ Types ถึง Config ถึง Repo ถึง Service ถึง Runtime ถึง UI ความพึ่งพาจะไหลแบบทางเดียว และถูกบังคับใช้โดย linter ที่ระดับ CI หาก Agent เขียนโค้ดที่ขัดแย้งกับโครงสร้างชั้น ระบบจะล้มเหลวในการสร้างทันที

ข้อผิดพลาดของ linter เองคือคำสั่งในการแก้ไข ซึ่งเป็นรายละเอียดที่ขัดกับความเข้าใจโดยทั่วไป

ข้อผิดพลาด lint ของโครงการทั่วไปคือ “violation detected” สำหรับมนุษย์อ่าน; ข้อผิดพลาด lint ของ OpenAI Frontier คือ “ใช้ logger.info({event: 'name', …data}) แทน console.log” ซึ่งเป็นคำสั่งที่ Agent สามารถอ่านและแก้ไขได้โดยตรง

เอกสารทำหน้าที่เป็นแหล่งข้อมูลเดียวที่เชื่อถือได้ แผนผังสถาปัตยกรรม แผนการดำเนินการ และข้อกำหนดการออกแบบทั้งหมดอยู่ในไดเรกทอรี docs/ ภายในรีโพสิทอรี ตัวแทนไม่ต้องการฐานความรู้ภายนอกใดๆ เพราะทุกอย่างมีอยู่ในรีโพสิทอรีแล้ว

สิ่งนี้มีประสิทธิภาพมากแค่ไหน?

โมเดลไม่ได้เปลี่ยน แต่ LangChain ได้ปรับ harness รวมถึงระบบพรอมต์ เครื่องมือ middleware และโหมดการให้เหตุผล ส่งผลให้คะแนน Terminal Bench 2.0 เพิ่มจาก 52.8 เป็น 66.5

สิ่งที่คุณสามารถทำได้วันนี้

สร้างสมองโครงการสำหรับ AI

คำถามกลับมาที่นักพัฒนาทั่วไป: หากแนวคิดได้เปลี่ยนไปแล้ว 作为一名普通工程师,今天就能做点什么。

สิ่งแรก ให้สร้างไฟล์ CLAUDE.md ในไดเรกทอรีรูทของโปรเจกต์ที่สำคัญที่สุดของคุณ

ไม่จำเป็นต้องสมบูรณ์แบบหรือยาวเหยียด แค่เขียนกฎโครงสร้างทีม ข้อตกลงการตั้งชื่อ ข้อกำหนดการทดสอบ และจุดที่เคยผิดพลาดซ้ำๆ ให้เขียนเวอร์ชันที่ใช้งานได้ภายใน 10 นาที

เมื่อ AI ทำผิดครั้งต่อไป อย่าแก้ไขด้วยมือทันที แต่ให้ถามตัวเองว่า: CLAUDE.md ขาดอะไรอยู่?

เรื่องที่สอง แปลงสิ่งที่ทำซ้ำทุกวันให้เป็นทักษะ

โปรดสังเกตคำพูดเด่นของ Boris Cherny: 「หากคุณทำสิ่งใดสิ่งหนึ่งมากกว่าหนึ่งครั้งต่อวัน ให้เปลี่ยนมันให้เป็นทักษะหรือคำสั่ง」

การทบทวนโค้ด การสร้างข้อความ commit การเขียนคำอธิบายการปล่อยเวอร์ชัน และการแก้บั๊กที่ซ้ำกัน ควรเป็นทักษะ ไม่ควรเป็นสิ่งที่ต้องพิมพ์คำสั่งซ้ำๆ ทุกวัน

เรื่องที่สาม เพิ่ม hook ที่จุดที่มักจะติดกับดัก

ฮุคคือส่วนที่มีเลเวอเรจสูงที่สุดใน 98.4% ที่ไม่พึ่ง AI ให้ฉลาดขึ้น แต่พึ่งรหัสที่แน่นอนในการตรวจสอบบังคับ นี่คือกระบวนการแปลงการตัดสินใจของวิศวกรมนุษย์ให้เป็นข้อจำกัดที่เครื่องอ่านได้

หัวใจของเรื่องนี้ไม่ได้อยู่ที่การเขียนโค้ด แต่อยู่ที่การเขียนกฎ

คำพูดของ Karpathy ที่ถูกแชร์ต่ออย่างกว้างขวางบนทวิตเตอร์ในเดือนมกราคมปีนี้: “ฉันได้เปลี่ยนจากเขียนโค้ดด้วยตัวเอง 80% เป็นการให้ Agent เขียนโค้ด 80%”

ในอีกห้าปีข้างหน้า เส้นโค้งความสามารถของวิศวกรกำลังเปลี่ยนจาก “ฉันเขียนโค้ดได้กี่บรรทัด” เป็น “ฉันสามารถออกแบบสภาพแวดล้อมการทำงานที่เข้มงวดแค่ไหนสำหรับ AI”

งานการเขียนโค้ดกำลังถูก Agent รับช่วงต่อ

แต่การออกแบบโลกที่ทำให้เอเจนต์สามารถเขียนโค้ดที่ดีได้ ยังคงเป็นงานของมนุษย์ และยากกว่าเดิม สำคัญกว่าเดิม และน่าสนใจกว่าเดิม