Em 27 de março, o primeiro Fórum de Inovação e Segurança em Agentic AI e a Primeira Conferência Internacional Web 4.0 de Hong Kong, organizados conjuntamente pelo Hong Kong Science and Technology Parks Corporation, ME Group e iPollo, foram realizados com grande sucesso no Hong Kong Science and Technology Parks Corporation. Sob o tema “Aplicações Inovadoras de Agentic AI: Transformação Tecnológica e Integração Industrial na Era Web 4.0”, o evento reuniu líderes de destaque dos setores governamental, acadêmico, industrial e de pesquisa, incluindo Paul Chan, Secretário das Finanças do Governo da Região Administrativa Especial de Hong Kong; Dennis Chen, Presidente do Hong Kong Science and Technology Parks Corporation; Kong Jianping, Diretor do Hong Kong Science and Technology Parks Corporation e fundador da Nano Labs; e Cai Wensheng, renomado investidor-anjo, para discutir conjuntamente as oportunidades e desafios na nova era em que a IA transcende a “conversa” para a “ação”.

Neste momento em que a Inteligência Artificial Agêntica (Agentic AI) atrai grande atenção, os desafios de segurança que ela traz são especialmente cruciais. Yu Xian, fundador da SlowMist, foi convidado a participar desta conferência e proferiu uma palestra principal intitulada “Desafios e Inovações de Defesa em Segurança entre IA e o Mundo Cripto”, compartilhando com líderes globais da indústria as últimas observações e práticas da SlowMist no campo da segurança da IA.

Foco no Frontal: Análise Profunda das Ameaças de Segurança do OpenClaw e dos AI Agents

À medida que a tecnologia de IA continua a penetrar no mundo das criptomoedas, aplicações de AI Agent, como "OpenClaw" (养龙虾), ganharam popularidade rapidamente. Mas por trás do entusiasmo, uma questão mais profunda está surgindo: os limites de segurança dos AI Agentes ainda não foram verdadeiramente estabelecidos.

Na palestra, Yu Cheng desmontou profundamente o OpenClaw e fez um julgamento crucial: “Texto é instrução.” Ele explicou que, no contexto de execução de Agentes de IA, todas as entradas deixam de ser meramente “informações” e passam a ser instruções potencialmente executáveis. Isso significa que qualquer informação externa recebida pelo modelo — seja proveniente de entrada do usuário, documentação ou Skill de terceiros — pode ser diretamente interpretada e executada, ampliando a superfície de ataque da camada de código para a camada “cognitiva”. Nesse mecanismo, as rotas de ataque são drasticamente simplificadas. Atacantes não precisam contornar defesas de segurança tradicionais; basta criar conteúdo textual cuidadosamente elaborado para induzir o Agente a executar operações não previstas, como transferência de ativos, vazamento de informações sensíveis ou até execução remota de comandos. A natureza oculta e o baixo custo desse tipo de ataque o tornam uma ameaça real e significativa.

Nesse mecanismo, as rotas de ataque são drasticamente simplificadas. Atacantes não precisam contornar defesas de segurança tradicionais; basta criar conteúdo textual cuidadosamente elaborado para induzir o Agente a executar operações não previstas, como transferência de ativos, vazamento de informações sensíveis ou até execução remota de comandos. A natureza oculta e o baixo custo desse tipo de ataque o tornam uma ameaça real e significativa.

Com base no mecanismo acima, Cosine resumiu ainda mais os três principais riscos enfrentados pelo OpenClaw atualmente:

- Entrada e manipulação de intenção (camada de interação do usuário): Atacantes podem enganar o Agente a executar operações de alto risco por meio de “injeção direta de prompts”. Em particular, deve-se estar atento à envenenamento indireto da cadeia de suprimentos — atacantes inserem instruções maliciosas nos documentos Markdown das Skills. Como o Markdown frequentemente desempenha o papel de “ponto de instalação”, o texto originalmente informativo很容易 se transforma em um script malicioso (por exemplo, curl | bash), levando à roubo de dados.

- Risco da camada de decisão e orquestração (camada de lógica de aplicação): Este erro não vem do modelo em si, mas sim da “lógica de execução incorreta”. Atacantes podem interferir no raciocínio lógico do Agente, fazendo com que ele altere endereços de recebimento em processos de negócios, como transferências de criptomoedas, causando perdas financeiras diretas.

- Risco na camada do modelo (cérebro central): inclui “alucinações” geradas pelo modelo, levando-o a executar comandos de sistema inexistentes ou perigosos, bem como padrões de operação inseguros aprendidos incorretamente a partir dos dados de treinamento.

Yuxian apontou: "Os problemas expostos pelo OpenClaw não são fenômenos isolados, mas sim desafios estruturais enfrentados universalmente pelo ecossistema atual de AI Agents." Em outras palavras, os problemas de segurança já não são mais um "caso isolado" de um único projeto, mas um risco sistêmico que toda a indústria deve enfrentar.

Ataque e defesa: construir um ecossistema aberto e seguro para Agentes de IA

Diante das formas de ameaça em constante evolução, Yu Xian propôs, em sua palestra, a abordagem de segurança “ofensiva e defensiva” da SlowMist: não apenas compreender as rotas de ataque, mas também integrar capacidades de defesa nos mecanismos de operação dos Agentes, alcançando segurança incorporada.

Ele apresentou aos convidados uma série de ferramentas e soluções de código aberto desenvolvidas pela SlowMist em torno de AI Agent, visando promover a formação de um ecossistema de segurança transparente, verificável e reutilizável:

- OpenClaw Guia de Práticas de Segurança Minimalistas: Um manual end-to-end de implantação de segurança, da camada cognitiva à camada de infraestrutura, fornecendo um “selo de pensamento de segurança” sistemático para a implantação de Agentes de IA com altos privilégios em ambientes de produção reais.

- SlowMist Agent Security Skill: Um framework abrangente de revisão de segurança que adiciona uma “visão aguçada” a agentes como o OpenClaw. Ele não apenas detecta riscos de envenenamento em Skills comuns, mas também identifica riscos em endereços de carteiras na cadeia, repositórios de código e URLs.

- MistTrack Skills: Um pacote de habilidades plug-and-play para AI Agents, oferecendo capacidades profissionais de conformidade AML e análise de risco de endereço em criptomoedas, adequado para avaliação de risco de endereço on-chain e julgamento de risco antes da transação.

- MCP Security Checklist: Uma lista de verificação sistemática de segurança para auditoria e fortalecimento rápido dos serviços do Agent, ajudando a equipe a evitar omissões de pontos críticos de defesa ao implantar MCPs/Skills e cadeias de ferramentas de IA relacionadas.

- Demonstração de MCP malicioso: Um exemplo de servidor MCP malicioso de código aberto para reproduzir cenários de ataque reais e testar a robustez dos sistemas de defesa, útil para pesquisa de segurança e validação de defesas.

Através desta série de práticas, Yu Cheng enfatiza: "As capacidades de segurança devem ser integradas ao Agent, e não apenas dependentes de proteções periféricas." Apenas ao vincular profundamente os mecanismos de defesa à lógica de operação do Agent, o AI Agent poderá operar de forma contínua e segura no complexo ecossistema Web3 e AI.

Segurança sistematizada: ADSS proteção abrangente para IA + ecossistema Web3

No final da palestra, Yu Sheng apresentou a ADSS (AI Development Security Solution) proposta pela SlowMist.

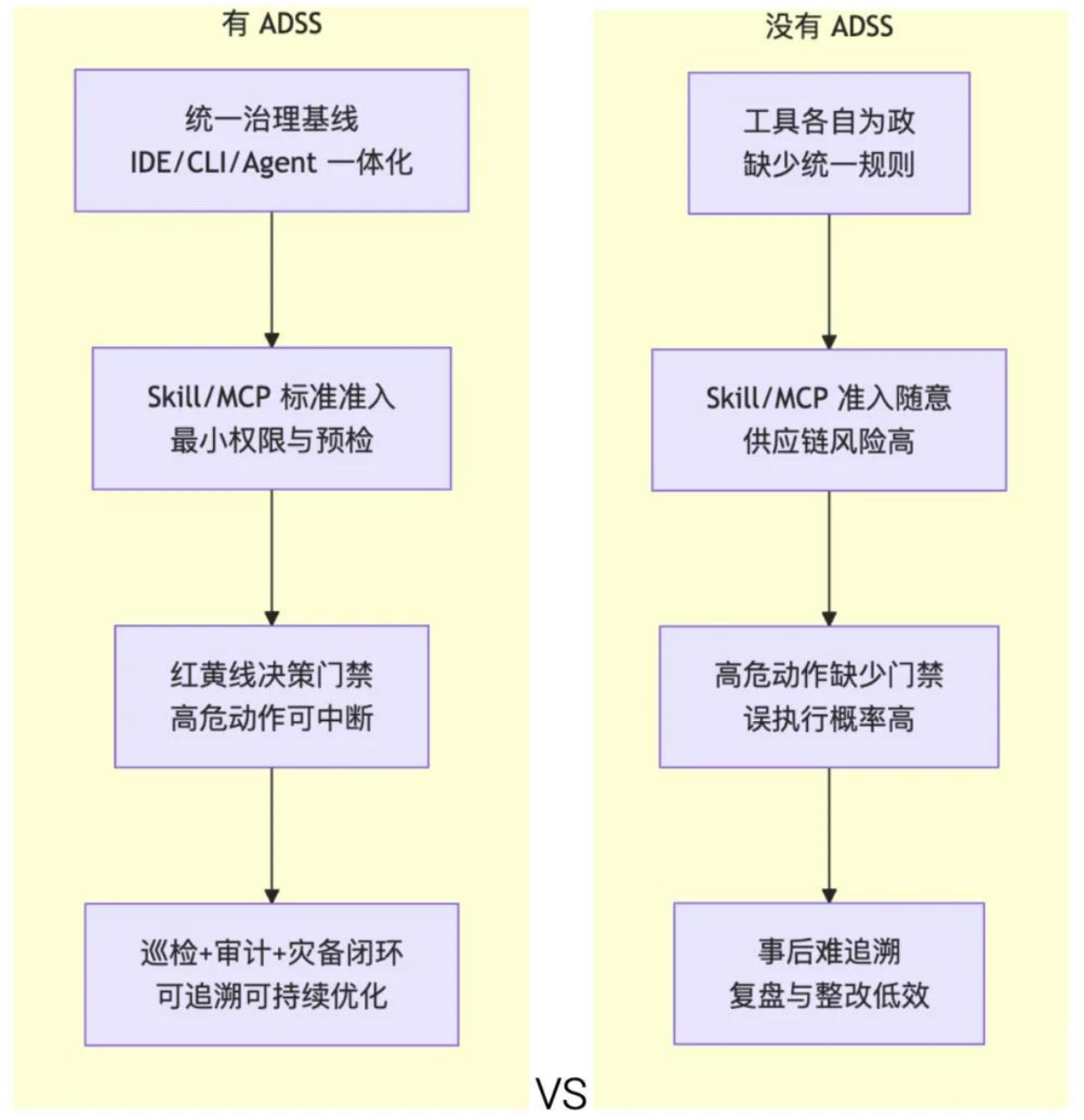

Se as ferramentas mencionadas anteriormente são consideradas “capacidades táticas”, então o ADSS é mais como um framework de segurança de nível sistêmico. Sua ideia central é: elevar ações de segurança isoladas para um mecanismo de operação de segurança sistematizado, executável, auditável e sustentável.

ADSS constrói capacidades de governança segura para AI + Web3 em múltiplos níveis:

- Governança de segurança L1 (linha de base de desenvolvimento): Estabelecer padrões unificados de segurança para desenvolvimento e uso, abrangendo ferramentas de desenvolvimento, framework de Agent, ecossistema de plugins e ambiente de execução, fornecendo à equipe uma fonte unificada de políticas e critérios de auditoria.

- Permissões e restrições de operação L2: controlam eficazmente o escopo de execução de comportamentos de alto risco por meio da convergência dos limites de permissão do Agente, minimização das permissões de chamada de ferramentas e introdução de mecanismos de confirmação humano-máquina para operações críticas.

- Proteção contra interações externas L3: introduzir percepção de ameaças em tempo real em níveis de recursos externos, como URLs, repositórios de dependências e fontes de plugins, para reduzir a probabilidade de conteúdo malicioso ou envenenamento da cadeia de suprimentos entrar na cadeia de execução.

- Isolamento de ativos na cadeia L4: Para operações envolvendo transações na cadeia, combina análise de risco na cadeia com mecanismo de assinatura independente, permitindo que o Agente construa transações sem acessar diretamente a chave privada, reduzindo o risco sistêmico associado a operações de ativos de alto valor.

- Inspeção contínua e análise pós-execução L5: por meio de auditoria de logs, revisões de segurança periódicas e mecanismos operacionais, realiza-se uma capacidade de segurança em ciclo fechado, permitindo “pré-verificação antes da execução, controle durante a execução e análise pós-execução”.

Yusen destacou que o ADSS não é uma única ferramenta, mas sim um sistema de operações de segurança sustentável e evolutivo. Seu objetivo é ajudar as equipes a construírem um sistema de segurança de Agentes auditável e atualizável, por meio de estratégias sistematizadas, auditorias contínuas e integração de capacidades, sem reduzir significativamente a eficiência de desenvolvimento e a capacidade de automação, a fim de enfrentar ameaças de segurança em constante evolução no contexto da profunda integração entre IA e Web3.

Conclusão

O primeiro Fórum de Inovação e Segurança em Agentic AI reuniu não apenas as principais forças do setor, mas também ofereceu perspectivas proativas para a segurança de AI Agents. Com a profunda integração entre Agentic AI e Web3, os desafios de segurança continuarão a aumentar. Como a empresa líder global em segurança blockchain, a SlowMist continuará promovendo a implementação de governança de segurança sistematizada, por meio de ADSS, ferramentas de código aberto e práticas, construindo capacidades de segurança inerentes para AI Agents e apoiando o setor a alcançar desenvolvimento sustentável e controlado na onda de inovação.