Enquanto todos se concentram na luta pelas camadas de modelos, uma equipe que detém o padrão aberto de inferência lança oficialmente seu foco na nova infraestrutura de IA, com o mais prestigiado grupo de investidores da rodada semente da Silicon Valley.

Autor do artigo, fonte: Machine Heart

Em 5 de maio, a startup de infraestrutura de IA RadixArk anunciou a conclusão de um financiamento semente de US$ 100 milhões, com avaliação pós-investimento de US$ 400 milhões. Em termos de valor, avaliação e portfólio de investidores, este é o maior investimento inicial até agora na categoria AI Infra em 2026.

Esta rodada foi liderada pela Accel, com participação conjunta da Spark Capital. Os investidores institucionais incluem a NVentures, filial da NVIDIA, AMD, MediaTek, Databricks, além de instituições de primeiro nível como Salience Capital, HOF Capital, Walden Catalyst, A&E Investment, LDVP e WTT Fubon Family. Praticamente todos os principais players nas áreas de GPU a CPU, chips de borda e plataformas de dados estiveram presentes.

Além do grupo de instituições de topo, diversos líderes tecnológicos globais com experiência nas áreas da Intel, Broadcom, OpenAI, xAI e PyTorch também participaram deste round como anjos investidores.

O组合 de CEO de três grandes fabricantes de hardware + fundador de um laboratório de modelos de ponta + criador do PyTorch é extremamente raro em toda a história da infraestrutura de IA. Investidores familiarizados com esse campo afirmam diretamente: isso é uma aposta no “padrão de fato da próxima geração de infraestrutura”.

O melhor motor de raciocínio do mundo, nas mãos deles

A história da RadixArk deve começar com um projeto de código aberto chamado SGLang.

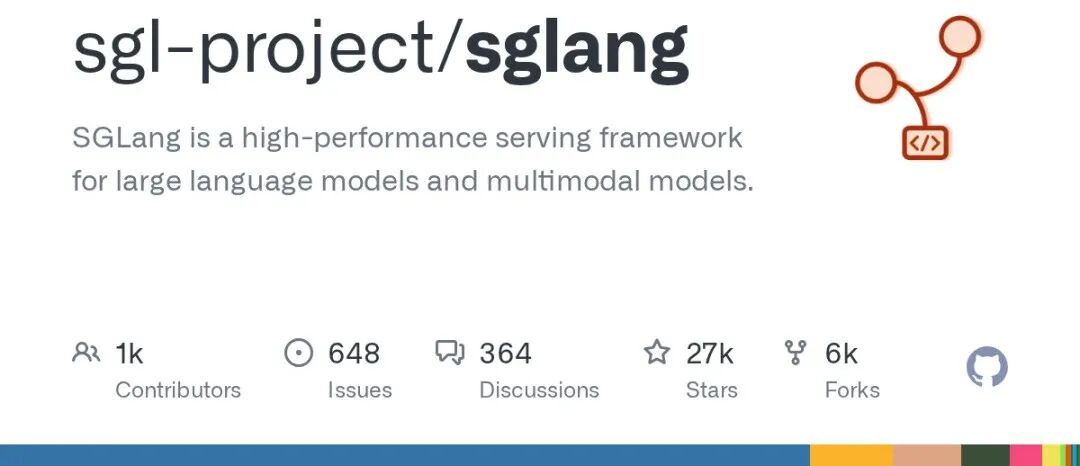

Desde seu lançamento em 2023, o SGLang tornou-se um dos padrões-fatores em inferência de modelos grandes de código aberto, com uma taxa de iteração incrível em dois anos, acumulando mais de 27K estrelas no GitHub e sendo implantado em mais de 400K GPUs. Trilhões de tokens de tráfego de produção são processados diariamente no SGLang, com usuários como Google, Microsoft, NVIDIA, Oracle, AMD, LinkedIn, xAI e Thinking Machines Lab.

Nos últimos dois anos, as arquiteturas de modelos passaram por uma série de transformações significativas, incluindo MoE, contexto longo, modelos de raciocínio e fusão multimodal. Em cada reestruturação de arquitetura, o SGLang garantiu compatibilidade no Dia 0 — um mecanismo inovador que suporta imediatamente modelos de código aberto assim que são lançados, com desempenho próximo ao limite físico da máquina. Um comentário frequentemente mencionado por investidores é que a velocidade de iteração do SGLang, combinada com sua disciplina de engenharia, é absolutamente superior entre projetos de código aberto.

Por trás da disciplina subjacente, está uma equipe fundadora com profundo conhecimento em sistemas e algoritmos.

A CEO Ying Sheng graduou-se em bacharelado no programa ACM da Universidade Jiao Tong de Xangai e obteve seu doutorado na Universidade de Stanford. Ela é a fundadora da LMSYS Org e uma das principais criadoras do SGLang. Durante seu doutorado, atuou como pesquisadora visitante no Sky Lab da UC Berkeley e trabalhou anteriormente na Databricks e na xAI, onde foi responsável pela equipe de inferência da xAI. Seus trabalhos em direções como esparsificação de atenção e reutilização de cache KV receberam grande atenção da indústria, sendo o mecanismo RadixAttention do SGLang em suas fases iniciais um de seus trabalhos mais representativos.

O CTO Zhu Banghua graduou-se em Engenharia Eletrônica na Universidade Tsinghua e obteve seu doutorado na UC Berkeley, sob a orientação dos especialistas em aprendizado de máquina Michael I. Jordan e Jiantao Jiao. Durante seu doutorado, co-fundou a Nexusflow, posteriormente adquirida pela NVIDIA, onde atuou como Principal Research Scientist da NVIDIA. Entre os projetos que liderou, estão a implementação completa de sistemas de treinamento industriais e a otimização de sistemas de baixo nível e acumulação de experiência em treinamento em larga escala dentro da NVIDIA.

Um técnico de uma fabricante de hardware essencial avaliou que este é o conjunto mais valioso de fundadores no empreendedorismo de AI Infra em 2026: de um lado, um empreendedor pesquisador que domina o padrão de inferência de código aberto; do outro, um especialista em algoritmos de grandes modelos proveniente do núcleo de pesquisa da fabricante de GPUs.

Ter em mãos o mecanismo de inferência SGLang, que processa trilhões de tokens por dia — isso já é o ponto de partida dos sonhos para empreendedores de AI Infra. E essa equipe ainda tem mais cartas na manga.

Dia 0: Domando o DeepSeek V4 com aprendizado por reforço

Além do mecanismo de inferência, a RadixArk também alcançou avanços significativos no lado de treinamento.

Em novembro de 2025, a equipe lançou como código aberto o framework de aprendizado por reforço Miles, focado na estabilidade e eficiência do treinamento de RL em larga escala, sendo atualmente utilizado por mais de 20 equipes para treinamento de modelos MoE com aprendizado por reforço.

De 2025 a 2026, a competição em capacidades de Reasoning, Uso de Ferramentas e Agentic será intensificada em todos os níveis, e cada avanço exige um sistema capaz de suportar RL distribuído em escala massiva. Observadores do setor apontaram uma dor recorrente e persistentemente não resolvida: o maior desafio para as equipes de grandes modelos hoje vai muito além de qualquer otimização pontual. A fricção nas fronteiras ao longo de toda a cadeia — desde o treinamento até o RL e, por fim, a inferência em produção — cada etapa isoladamente está quase otimizada, mas quando combinadas, perdem eficiência em todos os pontos.

A combinação de Miles e SGLang está tentando preencher a lacuna de eficiência enfrentada pelas equipes de modelos grandes na cadeia completa de "treinamento-RL-inferência".

A capacidade do novo modelo Day-0 é uma demonstração direta da competência técnica da equipe de Infraestrutura.

Em 25 de abril, foi lançado o DeepSeek-V4, com arquitetura complexa. No mesmo dia, o SGLang e o Miles implementaram suporte simultâneo para inferência e treinamento por RL do DeepSeek-V4. Isso foi possível graças às otimizações em nível de sistema da equipe, incluindo o cache de prefixo ShadowRadix projetado para atenção híbrida, o Flash Compressor que realiza compressão em um único chip e o Lightning TopK, que reduz a latência do Top-K a 15 microssegundos, além de integrar toda a pipeline de RL, da inferência FP8 ao treinamento BF16.

Endosso de consenso full-stack:

Os grandes players entraram coletivamente — o que está causando tanta ansiedade?

NVIDIA, AMD, MediaTek, Broadcom, Intel — empresas-chave na camada de hardware, todas presentes na rodada semente, é quase impensável dentro da indústria. Na verdade, os fabricantes de hardware sabem melhor do que ninguém que, atualmente, a capacidade de processamento ainda é cara e escassa, e simplesmente aumentar o hardware já não é sustentável. Um sistema de inferência aberto que realmente desacople o hardware e consiga extrair o máximo desempenho dos chips em plataformas heterogêneas é a maior necessidade urgente deles.

A entrada simultânea da Databricks, dos criadores do PyTorch e das principais figuras da OpenAI / Thinking Machines / xAI indica uma forte expectativa por parte do modelo e da camada de sistema em relação à “infraestrutura integrada de treinamento e inferência”. Cada nome no elenco de anjos representa uma perspectiva de aposta extremamente precisa:

- Chen Liwu, CEO da Intel, figura de referência na indústria de semicondutores com décadas de experiência.

- John Schulman é ex-cofundador da OpenAI, cofundador da Thinking Machines Lab e um dos pioneiros do aprendizado por reforço.

- Soumith Chintala — cofundador do PyTorch, o guardião dos frameworks de deep learning globais.

- Igor Babuschkin, ex-cofundador da xAI, construiu pessoalmente os sistemas de treinamento e plataformas de hardware mais complexos da indústria.

- Lilian Weng, cofundadora do Thinking Machines Lab, possui as melhores insights práticas sobre a implementação industrial de sistemas de IA.

Quando pessoas capazes de liderar sozinhas uma rodada de financiamento em qualquer ocasião escolhem aparecer coletivamente no mesmo cap table, é uma aposta entusiasmada no futuro.

Infraestrutura para todos: tornar o acesso à construção de IA exclusivo de poucos

A visão da RadixArk pode ser resumida em uma frase: tornar a infraestrutura de IA tão acessível, confiável e não monopolizada por ninguém quanto a eletricidade. Isso soa como um manifesto idealista, mas na prática, eles estão transformando essa frase em realidade:

- Academia

Três anos atrás, um estudante de doutorado especializado em otimização de inferência de LLMs tinha geralmente apenas duas opções: a API da OpenAI, cobrada por token e sem acesso a nenhuma estrutura interna; ou código aberto antigo, cujo README dizia “funciona em uma única GPU”, distante em anos de engenharia do cenário distribuído real descrito no artigo.

SGLang quebra esse dilema — alta capacidade diária industrial e código totalmente aberto, sendo adotado como baseline padrão pelos grupos de pesquisa de sistemas da Stanford, Berkeley, CMU e UW. Para pesquisadores de agentes, o prefix cache do RadixAttention organiza prefixos compartilhados em uma estrutura em árvore, calculando apenas uma vez os KV idênticos, reduzindo experimentos que antes levavam dois dias para serem concluídos em apenas meio dia; citar o SGLang em artigos locais de inferência tornou-se quase uma prática padrão.

- Startup

Um grupo de engenheiros que deixaram grandes empresas, com uma compreensão profunda de um cenário vertical, saíram para empreender. Eles não tinham orçamento de milhões de dólares em poder de computação, nem uma equipe dedicada de infraestrutura, apenas uma intuição forte sobre o produto.

No passado, construir pipelines de inferência para produção e manter a carga de engenharia de compatibilidade entre hardware frequentemente ultrapassava o limite de capacidade de empresas em rodada semente, consumindo grande parte do tempo em reinventar a roda. Agora, elas podem diretamente implantar serviços de inferência com desempenho próximo ao estado-da-arte sobre o SGLang e treinar modelos especializados com o Miles — a infraestrutura já não é mais um gargalo, e o tempo e dinheiro economizados podem ser totalmente direcionados para o que realmente desejam construir.

- Gigante tecnológico

Por que gigantes como Google, Microsoft e NVIDIA, que possuem as melhores infraestruturas internas do mundo, também aparecem na lista de usuários do SGLang? A resposta está na estrutura dos investidores desta rodada — cinco fabricantes-chave de hardware: NVIDIA, AMD, MediaTek, Broadcom e Intel, todos entraram simultaneamente. Eles sabem melhor do que ninguém o que significa para todo o ecossistema um sistema de inferência aberto, independente de hardware e não vinculado a nenhum concorrente. Utilizar um sistema aberto mantido coletivamente pela comunidade e apoiado por múltiplas fabricantes de hardware é, por si só, uma estratégia de infraestrutura em um nível superior.

A declaração oficial da RadixArk não é emocional, mas é suficientemente afiada:

“A próxima geração de IA não deve ser limitada pelo acesso a infraestruturas privadas. Mais equipes devem poder possuir seus próprios modelos, seus próprios sistemas, seu próprio futuro.”

Este financiamento semente de 100 milhões de dólares visa transformar esta frase em realidade técnica: tornar o SGLang o padrão de produção no Dia 0 para qualquer novo modelo; transformar o Miles em um framework de nível infraestrutura para treinamento em larga escala e RL; e, sobre esse núcleo aberto, construir uma plataforma gerenciada que não prenda modelos nem sequestre clientes, mas ofereça capacidades de infraestrutura de ponta.

A visão da RadixArk nunca foi substituir ninguém. Mas sim permitir que um laboratório acadêmico, um estúdio de três pessoas, uma startup recém-financiada em sua rodada semente, e gigantes com capitalização de trilhões de dólares — todos comecem na mesma linha de partida de infraestrutura.

Se Anthropic em 2023, Mistral em 2024 e Thinking Machines Lab em 2025 representaram apostas direcionais em camadas de modelos de IA, então a RadixArk em 2026 está apostando em algo mais fundamental e mais duradouro: colocar realmente o poder de construir IA de ponta nas mãos de um número suficientemente grande de pessoas.

Após o fechamento do financiamento, a equipe lançou uma iniciativa de retorno à comunidade de código aberto: participar do registro na plataforma e compartilhar no Twitter garante créditos gratuitos para uso após o lançamento oficial da plataforma RadixArk. Para esta equipe que cresceu dentro da comunidade de código aberto, trata-se de uma forma de agradecer, com capacidade de processamento real, todas as pessoas que apoiaram o SGLang até hoje.

- Link: platform.radixark.com