Autor: Claude, Deep潮 TechFlow

Leitura da Shenchao: Na data de 14 de abril, a NVIDIA lançou a família Ising, o primeiro conjunto de modelos de IA quântica de código aberto do mundo, aumentando a velocidade de decodificação de correção de erros em 2,5 vezes e a precisão em 3 vezes em comparação com os padrões da indústria.

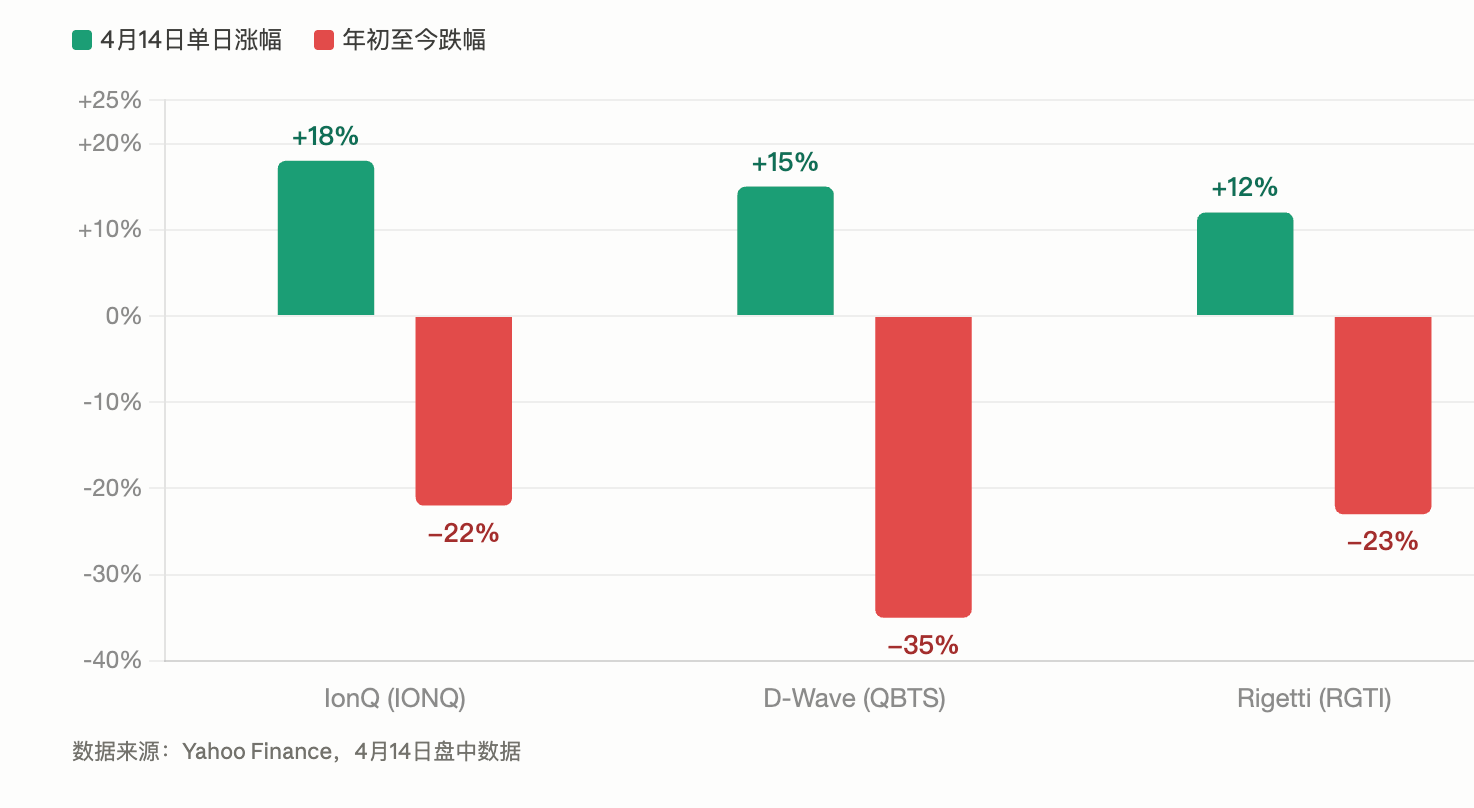

As ações de empresas quânticas subiram coletivamente hoje, com a IonQ aumentando 18% e a D-Wave 15%. No mesmo dia, o cientista-chefe William Dally revelou na GTC 2026 que a IA reduziu o tempo de migração da biblioteca de células padrão de chips de 8 pessoas durante 10 meses para apenas uma noite com uma GPU, e o resultado do design superou o feito manualmente.

NVIDIA está usando IA para acelerar dois dos problemas de engenharia mais difíceis: tornar os computadores quânticos verdadeiramente utilizáveis e tornar o próprio design de GPU mais rápido e melhor.

Em 14 de abril, no "Dia Mundial da Computação Quântica", a NVIDIA lançou a primeira família mundial de modelos de IA abertos para computação quântica, NVIDIA Ising, fazendo com que as ações de empresas relacionadas à computação quântica subissem coletivamente. No mesmo período, o cientista-chefe da empresa, William Dally, revelou na GTC 2026 os últimos avanços no uso de IA nos processos internos de design de chips da NVIDIA, com um aumento de eficiência de até centenas de vezes em uma das tarefas.

Duas pistas apontam para a mesma conclusão: a IA está se transformando de uma "ferramenta de camada de aplicação" em "infraestrutura da infraestrutura", acelerando tanto os setores a jusante (computação quântica) quanto a própria iteração de hardware da IA.

Primeiro modelo de IA quântica de código aberto do mundo, visando os dois principais gargalos da computação quântica

De acordo com o comunicado de imprensa da NVIDIA de 14 de abril, a família de modelos Ising inclui inicialmente dois domínios de modelos: Ising Calibration e Ising Decoding, destinados aos dois principais gargalos para a implementação da computação quântica.

Os qubits de processadores quânticos são intrinsicamente ruidosos; os melhores processadores quânticos atuais cometem aproximadamente um erro a cada mil operações. Para que os computadores quânticos tenham valor prático, a taxa de erro precisa ser reduzida a menos de um trilionésimo.

Ising Calibration é um modelo de linguagem visual com 35 bilhões de parâmetros que interpreta automaticamente os dados de medição de processadores quânticos e toma decisões de calibração, reduzindo o processo de calibração, que anteriormente levava dias, para algumas horas. Ising Decoding é um par de modelos de rede neural convolucional 3D (otimizados respectivamente para velocidade e precisão) usados para decodificação em tempo real na correção de erros quânticos, sendo 2,5 vezes mais rápido e 3 vezes mais preciso do que o padrão aberto atual do setor, pyMatching.

Sam Stanwyck, Diretor de Produtos Quânticos da NVIDIA, explicou durante o lançamento a lógica da estratégia de código aberto: os fabricantes de hardware quântico possuem características de ruído distintas, e modelos de código aberto permitem que eles finetune localmente com seus próprios dados, melhorando o desempenho e protegendo ao mesmo tempo dados proprietários.

O CEO da NVIDIA, Jensen Huang, foi ainda mais direto. Em seu comunicado, ele afirmou que a IA está se tornando o plano de controle das máquinas quânticas, transformando qubits frágeis em sistemas confiáveis e escaláveis de GPU quântica.

De acordo com a NVIDIA, várias instituições já adotaram o modelo Ising, incluindo a Escola de Engenharia e Ciências Aplicadas da Universidade de Harvard, o Laboratório Nacional de Aceleradores Fermilab, a IQM Quantum Computers, o Laboratório Nacional Lawrence Berkeley e o Laboratório Nacional de Física do Reino Unido.

Ações de empresas relacionadas à computação quântica subiram coletivamente, com a IonQ disparando 18% em um único dia

No dia do lançamento de Ising, as ações de empresas de computação quântica na bolsa americana experimentaram uma forte alta coletiva. De acordo com dados da Yahoo Finance, a IonQ subiu cerca de 18%, a D-Wave Quantum subiu cerca de 15% e a Rigetti Computing subiu cerca de 12%.

Este rally ocorre no contexto de um forte ajuste generalizado das ações de tecnologia quântica desde o início do ano. Até 14 de abril, a IonQ caiu cerca de 22% no ano, a D-Wave caiu cerca de 35% e a Rigetti caiu cerca de 23%. O recuo de dois dígitos do dia não alterou a tendência descendente do ano, mas a magnitude da movimentação coletiva ainda é notável.

É importante destacar que os fatores impulsionadores deste movimento de mercado não se limitam ao anúncio da Ising. No mesmo dia, a IonQ anunciou avanços significativos na rede quântica e um contrato com a DARPA, enquanto a Rigetti recebeu um pedido de 8,4 milhões de dólares do Centro Indiano de Desenvolvimento de Computação Avançada (C-DAC). A combinação de múltiplos catalisadores amplificou o efeito setorial.

A instituição de análise Resonance prevê que o mercado global de computação quântica ultrapassará 11 bilhões de dólares até 2030. O consórcio para o desenvolvimento da economia quântica (QED-C), em relatório divulgado no mesmo dia, afirmou que o mercado quântico global atingiu 1,9 bilhão de dólares em 2025, com um aumento de 14% no número de funcionários em empresas puramente quânticas.

80 homens-mês reduzidos a uma noite: IA reconfigura o processo de design de chips da NVIDIA

Ising impulsiona a aceleração para indústrias externas, enquanto a NVIDIA utiliza IA para redefinir seus próprios processos de design de chips.

O cientista-chefe da NVIDIA, William Dally, revelou vários casos concretos durante uma conversa com o cientista-chefe do Google, Jeff Dean, na GTC 2026. Os dados mais impactantes vieram da migração da biblioteca de células padrão: sempre que a NVIDIA migra para um novo processo semicondutor (por exemplo, de 7 nm para 5 nm), é necessário redesenhar e adaptar cerca de 2.500 a 3.000 células padrão ao novo processo, o que anteriormente exigia 8 engenheiros trabalhando por cerca de 10 meses. A NVIDIA desenvolveu uma ferramenta de aprendizado por reforço chamada NVCell, que agora pode concluir esse processo em uma única GPU durante uma noite, com as células produzidas apresentando desempenho igual ou superior ao de projetos manuais em termos de área, consumo de energia e latência.

Segundo o Tom's Hardware, Dally descreveu o processo como um "jogo eletrônico de correção de erros de regras de design", exatamente o tipo de otimização por tentativa e erro em que o aprendizado por reforço se destaca.

Em um nível mais abstrato, a NVIDIA desenvolveu modelos de linguagem grandes internos e dedicados chamados Chip Nemo e Bug Nemo. Esses modelos foram ajustados com dados proprietários acumulados pela NVIDIA ao longo de 30 anos, abrangendo todo o código RTL, documentos de design de hardware e especificações arquitetônicas de todos os GPUs da empresa na história. Segundo Dally, engenheiros júnior podem fazer perguntas diretamente ao Chip Nemo, economizando tempo que antes era gasto interrompendo repetidamente designers sênior. Ele descreveu o Chip Nemo como "um mentor muito paciente".

No nível de otimização de circuitos, a NVIDIA também aplicou aprendizado por reforço a problemas clássicos de design de circuitos, como cadeias de carry-lookahead. Dally afirmou que os designs gerados pela IA são “soluções estranhas que os humanos nunca considerariam, mas que na prática superam os designs humanos em 20% a 30%”.

Ainda há um longo caminho a percorrer até que a IA projete chips independentemente

No entanto, Dally também estabeleceu claramente os limites das expectativas. Ele disse que gostaria muito de alcançar um estado end-to-end, mas ainda está muito longe desse objetivo.

O design atual de chips de IA da NVIDIA ainda é auxiliar, não substitutivo. A IA atua separadamente em etapas como migração de unidades padrão, classificação e resumo de bugs, previsão de roteamento e exploração do espaço arquitetural, mas ainda não formou um processo automatizado completo de ponta a ponta. A visão de longo prazo de Dally é um modelo de múltiplos agentes, onde diferentes sistemas de IA assumem responsabilidades distintas em cada etapa do design, semelhante à divisão de tarefas de uma equipe de engenharia humana.

Segundo o Computer Weekly, Dally e Dean também discutiram, durante a conversa, o impacto dos agentes de IA nas ferramentas de software tradicionais: quando os agentes de IA operam muito mais rapidamente do que os humanos, as ferramentas de software projetadas para usuários humanos se tornam gargalos de desempenho, exigindo a reprojetação de ferramentas de programação a aplicações empresariais.