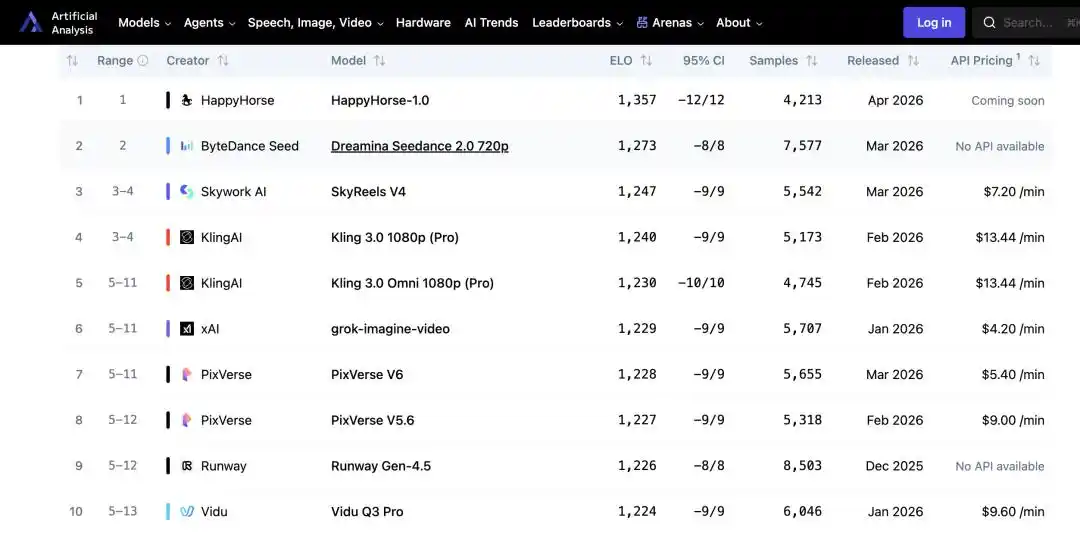

Sem lançamento, sem blog técnico, sem endosso de nenhuma empresa — um modelo de conversão de texto para vídeo chamado HappyHorse-1.0 subiu silenciosamente ao topo da classificação AI Video Arena da plataforma de avaliação de IA Artificial Analysis, superando o Seedance 2.0 com uma pontuação Elo mais alta e deixando para trás concorrentes principais como Ke Ling e Tian Gong, desencadeando de repente uma “competição de desvendamento” no mundo técnico.

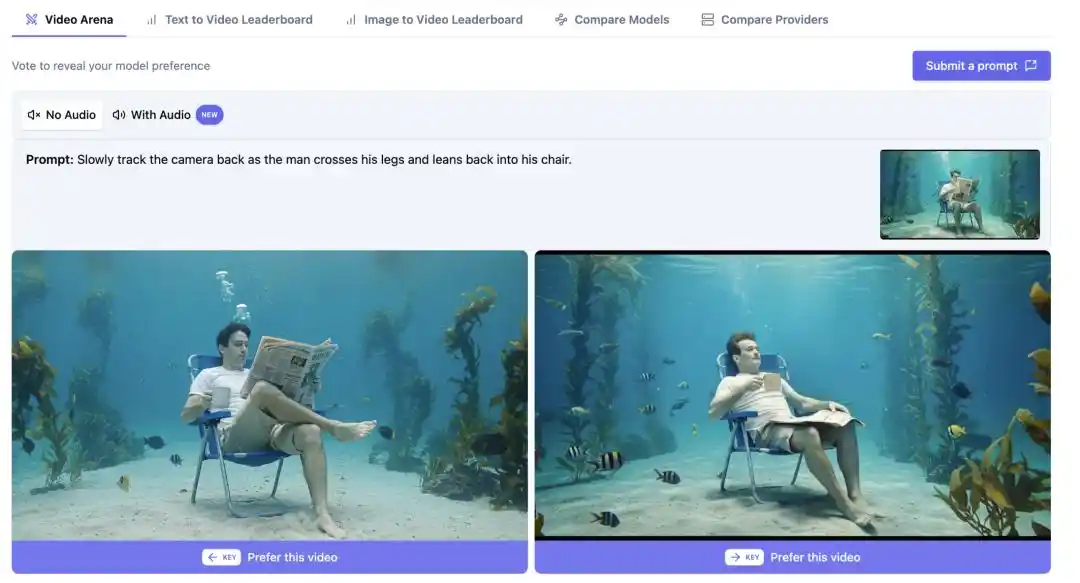

A classificação do Artificial Analysis não é uma avaliação de parâmetros técnicos, mas sim uma pontuação Elo compilada a partir de resultados de testes cegos realizados por usuários reais, refletindo a percepção real de pessoas comuns após visualizarem. Isso torna essa classificação mais difícil de ser questionada facilmente em comparação com listas tradicionais de pontuação, e transforma a pergunta “quem realmente fez isso?” em algo impossível de ignorar.

"Happy Horse" sobe silenciosamente ao topo, desencadeando uma competição de adivinhação no mundo da tecnologia

As especulações no X surgiram rapidamente. O primeiro ponto notado foi a ordem dos idiomas no site oficial: chinês mandarim e cantonês aparecem antes do inglês. Para um produto voltado para usuários globais, essa ordem é um pouco incomum — se a equipe fosse dos Estados Unidos, o inglês quase certamente seria o primeiro. É quase certo que a equipe por trás disso é da China.

O próprio nome também é uma pista. O ano de 2026 é o Ano do Cavalo no calendário lunar, e o nome "HappyHorse" esconde um trocadilho pouco sutil sobre o Ano do Cavalo — algo semelhante já foi feito anteriormente este ano com "Pony Alpha". Assim, a lista de suspeitos rapidamente se expandiu: os fundadores do Tencent e do Alibaba têm sobrenome "Ma", o que os coloca naturalmente na lista; alguns apostam na Xiaomi, acreditando que Lei Jun é tradicionalmente discreto e gosta de revelar surpresas inesperadas; outros acham que o perfil combina mais com o DeepSeek, já que o DS anteriormente lançou silenciosamente um modelo visual e depois o removeu silenciosamente. As especulações estão fervilhando, mas nenhuma delas apresenta evidências concretas.

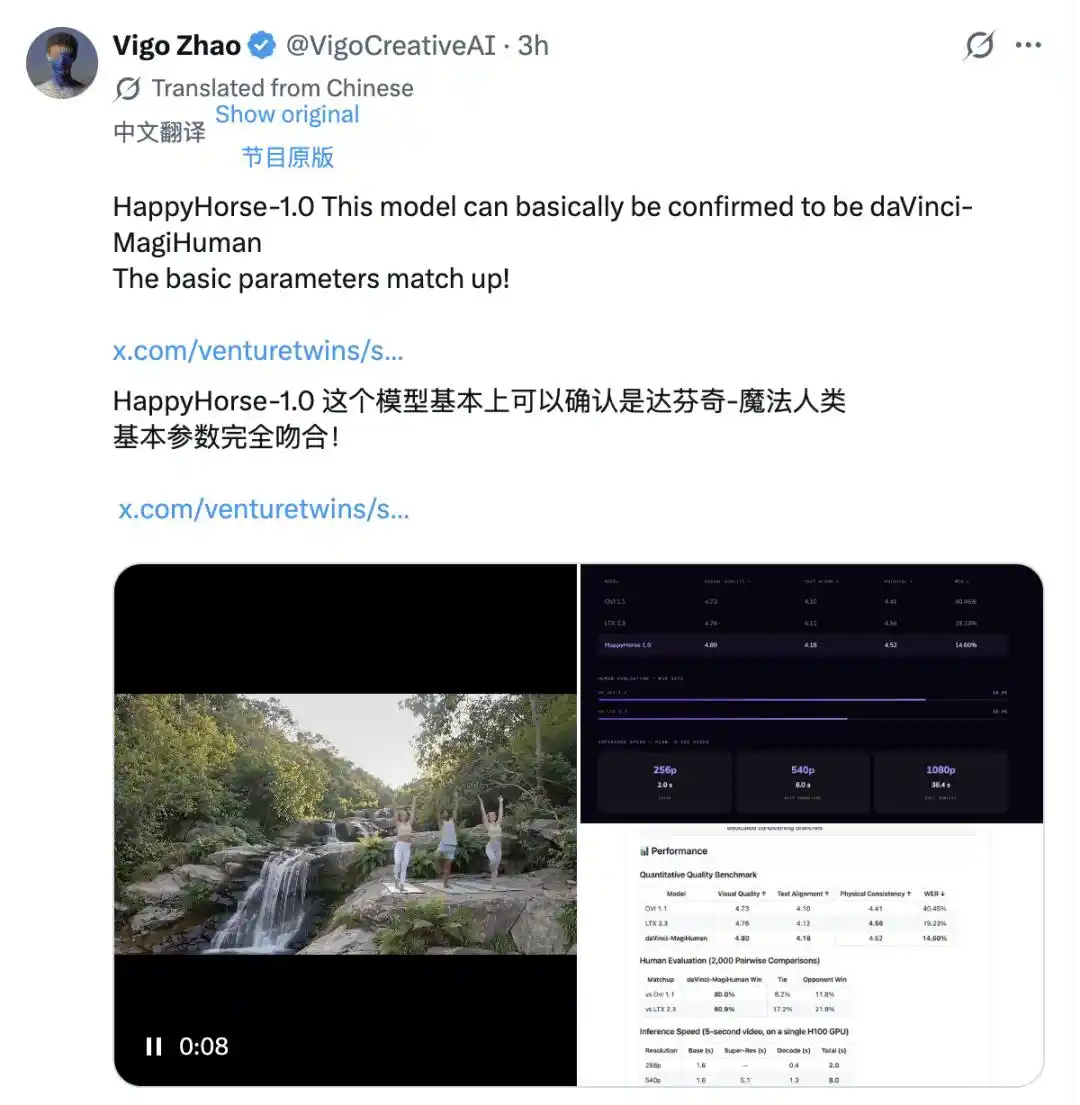

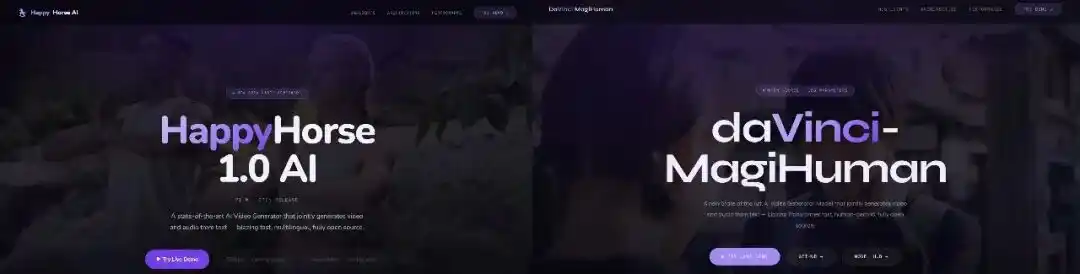

O que realmente identificou o alvo foi uma comparação técnica ponto a ponto. O usuário do X, Vigo Zhao, comparou os dados de referência públicos do HappyHorse-1.0 com modelos conhecidos um a um e encontrou um objeto com alta correspondência: daVinci-MagiHuman, o modelo de código aberto lançado no GitHub em março chamado “da Vinci Magic Human”.

Qualidade visual 4,80, alinhamento de texto 4,18, consistência física 4,52, taxa de erro de fala 14,60% — os dois conjuntos de dados correspondem ponto a ponto. A estrutura do site oficial também é quase idêntica: o estilo de apresentação da descrição da arquitetura, da tabela de desempenho e do vídeo de demonstração parece vir do mesmo modelo. Ambos utilizam a arquitetura Transformer de fluxo único, geram áudio e vídeo conjuntamente e suportam a mesma lista de idiomas. Esse grau de sobreposição é difícil de explicar por coincidência.

A conclusão mais reconhecida no ambiente técnico atual é que o HappyHorse é uma versão iterativa otimizada da Sand.ai, uma das parceiras de desenvolvimento conjuntas da daVinci-MagiHuman, com o objetivo principal de validar o limite de desempenho do modelo sob preferências reais dos usuários, preparando o terreno para a implementação comercial subsequente.

daVinci-MagiHuman será aberto oficialmente em 23 de março de 2026, resultado da colaboração de duas equipes jovens. Uma vem do Laboratório de Pesquisa em Inteligência Artificial Generativa (GAIR) da Academia de Inovação de Xangai (SII), liderada pelo acadêmico Liu Pengfei; a outra é a Sand.ai (San Dai Technology), de Pequim, fundada por Cao Yue, que também possui formação acadêmica, com foco em modelos mundiais autoregressivos.

O modelo utiliza um Transformer de fluxo único com atenção pura de 15 bilhões de parâmetros, incorporando todos os tokens de texto, vídeo e áudio em uma única sequência para modelagem conjunta — ninguém na comunidade de código aberto havia antes treinado desde zero uma previsão conjunta real de áudio e vídeo; a maioria apenas concatena em bases unimodais.

Como um modelo de vídeo de código aberto conseguiu uma recuperação em duas semanas?

Depois de esclarecer a identidade, outra questão se tornou ainda mais difícil de responder: por que o HappyHorse-1.0 conseguiu obter uma pontuação Elo mais alta que o Seedance 2.0 em apenas duas semanas, sendo que o daVinci-MagiHuman só foi aberto em março?

De acordo com as informações divulgadas no site oficial, o HappyHorse não modificou a arquitetura subjacente; a suposição mais plausível é que ajustou especificamente a estratégia de geração padrão para o cenário de avaliação.

O sistema Elo é essencialmente uma acumulação de preferências dos usuários; em itens sensíveis como a estabilidade das expressões faciais, a sincronização entre áudio e vídeo e a agradabilidade visual, fazer pequenas melhorias já aumenta a probabilidade de ser escolhido em testes cegos. O limite de capacidade do modelo não mudou, mas a "performance na avaliação" pode ser aprimorada.

Na verdade, nas amostras de teste cego da Artificial Analysis, imagens de rostos e conteúdo de narração oral representam mais de 60%, e o daVinci-MagiHuman, desde a fase de treinamento, focou-se na interpretação de rostos, possuindo uma vantagem natural nesses cenários — essa é a principal razão pela qual sua taxa de vitória nos testes cegos é superior; se as amostras de teste cego forem predominantemente close-ups de rostos, modelos especializados em rostos terão uma vantagem sistemática, o que não tem relação direta com seu desempenho real em cenários complexos, como múltiplos personagens, câmeras complexas ou narrativas de longa duração.

Como resultado, houve uma diferença evidente entre os números na classificação e a experiência prática, e os usuários no X se dividiram em dois grupos. Os céticos, após os testes, consideraram que o HappyHorse-1.0 e o Seedance 2.0 ainda apresentam diferenças visíveis em detalhes de personagens e coerência dinâmica, questionando assim a representatividade da pontuação Elo.

Já os apoiadores têm grandes expectativas quanto ao potencial do HappyHorse, esperando que ele resolva o problema do setor da “consistência de qualidade visual em sequências de múltiplas câmeras”, algo que os modelos de vídeo atuais ainda não conseguiram resolver bem. Se o daVinci-MagiHuman realmente conseguir avançar nesse aspecto, isso pode ser mais importante do que uma classificação em qualquer ranking.

As limitações do próprio modelo também não devem ser ocultadas por números. O influenciador do Xiaohongshu @JACK's AI Vision implantou e testou o daVinci-MagiHuman logo no início. Descobriu que ele exige H100; placas gráficas de consumo comuns basicamente não têm chance. Embora a comunidade esteja pesquisando soluções de quantização, ainda é difícil para usuários individuais implantá-lo localmente a curto prazo.

Em termos de cenário, atualmente ele se destaca principalmente em cenas com uma única pessoa; assim que múltiplas pessoas aparecem ou o cenário se torna mais complexo, a qualidade diminui — esse não é um problema que pode ser resolvido apenas ajustando parâmetros, mas sim está diretamente relacionado ao seu design voltado para retratos. A duração da geração geralmente fica em torno de 10 segundos; além disso, vídeos mais longos tendem a ficar desordenados, e a saída em alta definição ainda depende de plugins de super-resolução para complementação.

A conclusão do AI Vision de @JACK é que a daVinci-MagiHuman tem usabilidade geral inferior à LTX 2.3 e só será adequada para uso diário após a comunidade aprimorar a quantificação.

O setor de geração de vídeos recebeu o verdadeiro "peixe-palha"?

Claro, liderar uma lista uma vez não diz muito. Ainda assim, o HappyHorse precisa passar por testes mais abrangentes em estabilidade, velocidade em altas cargas de acesso, consistência entre cenários, precisão no controle de papéis e capacidade de generalização além dos conjuntos de avaliação. São esses os indicadores fundamentais que determinam se um modelo pode realmente entrar no fluxo de trabalho dos criadores.

Mas, se ampliarmos a visão para o cenário setorial mais amplo, o sinal transmitido por esse evento já é suficientemente claro.

O próprio modelo de vídeo de código aberto não é nada novo. Mas sempre existiu uma diferença visível em termos de desempenho entre código aberto e fechado — em cenários que exigem entrega ao cliente, a qualidade de geração dos modelos de código aberto não conseguiu superar a barreira entre “utilizável” e “entregável”. O poder de precificação de produtos fechados como Keling e Seedance baseia-se, em grande parte, nessa lacuna.

O significado deste momento é que um produto baseado em modelo aberto superou, pela primeira vez, os principais concorrentes proprietários em uma classificação cega baseada na percepção real dos usuários. Independentemente de quantos ajustes tenham sido feitos especificamente para o cenário de avaliação, para fabricantes proprietários que construíram seu poder de precificação com base nessa diferença, trata-se, pelo menos, de um sinal que merece ser levado a sério.

Para desenvolvedores, esse ponto de inflexão tem um significado mais específico. Em cenários verticais como retratos, avatares digitais e streamers virtuais, assim que a qualidade de geração das bases abertas atingir o limiar de “entregável”, a estrutura de custos do deploy autônomo sofrerá uma mudança substancial — não apenas a redução dos custos de chamada à API, mas, mais importante ainda, a plena integração dos dados, modelos e cadeia de inferência sob controle próprio, obtendo flexibilidade inacessível a soluções fechadas em termos de personalização profunda e conformidade com privacidade.

O HappyHorse-1.0 não ameaçará短期内 a posição de mercado do Seedance 2.0 ou do KeLing, mas assim que for estabelecido o entendimento de que modelos abertos podem igualar o desempenho de modelos fechados, otimizações quantitativas, microajustes verticais e aceleração de inferência serão impulsionadas pela comunidade a uma taxa muito superior à dos produtos fechados.

Neste ano do Cavalo, o que realmente vale a pena observar talvez não seja qual cavalo corre mais rápido, mas sim o fato de que a pista está se alargando.

Este artigo é do número oficial do WeChat "AI Value Officer", autor: Xingye, editor: Meiqi